OpenAI は現在、世界の人工知能分野で追求の対象となっています。

Google が「Bard」を発表してから、中国のテクノロジー界は沸騰し始め、もともと辛辣な自然言語処理研究チームは今ではみんなの人気者になりました。資本と人材をめぐる競争が始まった。

「ChatGPT の中国版を構築する」は、Wang Huiwen のヒーロー投稿で広まり、数十人、数百人に広がり、中国の AI 実践者の共通の目標になりました。

しかし、ここ数日、ChatGPT に関する議論がどれほど盛り上がっていても、私たちは残酷な現実に直面しなければなりません:OpenAI を追いかけるこの競争で、ついに輝かしいトップを征服できるのです。多くのチームはありません。

コストが高い一方で、大規模なモデルを「洗練」するための資金は ChatGPT を構築するためのチケットにすぎませんが、他方では、それができる人材は限られています。大きなモデルを訓練します。大規模なモデルは OpenAI による ChatGPT 作成の技術的な基礎であり、適切な人材を見つけることも非常に重要です。

大規模モデルは、産業界、学界、研究者の共同の取り組みとなるはずです。ChatGPT の参加者が勝ちたいのであれば、一流の科学者だけでなく、優れた能力を備えたオペレーターも必要です。チームには、政治やビジネスの環境を理解し、経験を持っている必要があり、資本市場でカリスマ性があり、積極的に参加するスター起業家も含まれていなければなりません。

この記事は、この ChatGPT 競争の波における主要な国内潜在勢力の立場を学術研究の観点から評価することを目的としています。

すべての大学の中で、清華大学は間違いなく最前線にあります。

清華大学は、中国の自然言語処理 (NLP) 分野における重要な学術研究センターです。その NLP 研究の歴史は深く、その研究チームには次のような有名人が含まれています。 Tang Jie、Sun Maosong、Liu Zhiyuan、Huang Minlie などの学者が責任者であり、大規模言語モデルの分野での彼らの研究は近年非常に顕著です。さらに、JD.com副社長の何暁東氏、ファーウェイクラウドの人工知能分野の主任研究員である天琦氏など、大手メーカーの大型モデルのリーダーの多くは清華大学の子孫である。

整理した結果、清華大学にはこの ChatGPT の波に追いつく潜在的な勢力が 3 つあります。1 つ目は、Li Juanzi 氏が率いる Knowledge Engineering Laboratory (KEG) です。 2 番目は自然言語処理および社会人文計算研究所 (THUNLP) で、その学術リーダーは孫毛松氏であり、チームリーダーの劉志源は彼の弟子です、3 番目は対話型人工知能研究グループ (CoAI) です。 、Zhu Xiaoyanと彼の学生Huang Minlieが共同でリーダーを務めています。

大規模模型製作ブームの最後の波において、清華大学コンピューターサイエンス学部の Tang Jie 教授大学は最も著名な学術代表大学であった。 2020年には北京の大学を集め、知源研究所の「Enlightenment」1.0および2.0モデルの開発を主導した。

##唐潔

同時に, Tang Jie氏は、産学研究の統合と大規模モデルエコシステムの構築を重視する学者でもある。 2019 年、Tang Jie と Li Juanzi は、スター製品 AMnier と知識工学研究所の技術的成果を頼りに、Zhipu AI の設立を主導しました。現在の会社チームには、Tang Jie の学生が多数含まれており、全員が「Enlightenment」2.0 の主要な参加者です。

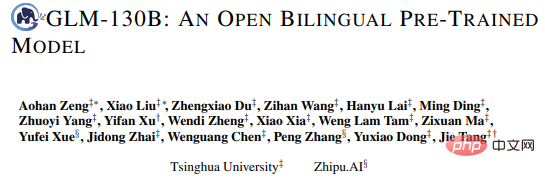

Tang Jie はデータマイニングの分野の出身で、Li Juanzi はナレッジ グラフの分野で有名な学者です。これにより、Zhipu AI の大規模モデルの特徴は「データの知識」。昨年、Zhipu AI はバイリンガル GLM-130B モデルをリリースしました。これはオープンソースであり、研究機関や個人が無料でダウンロードできます。

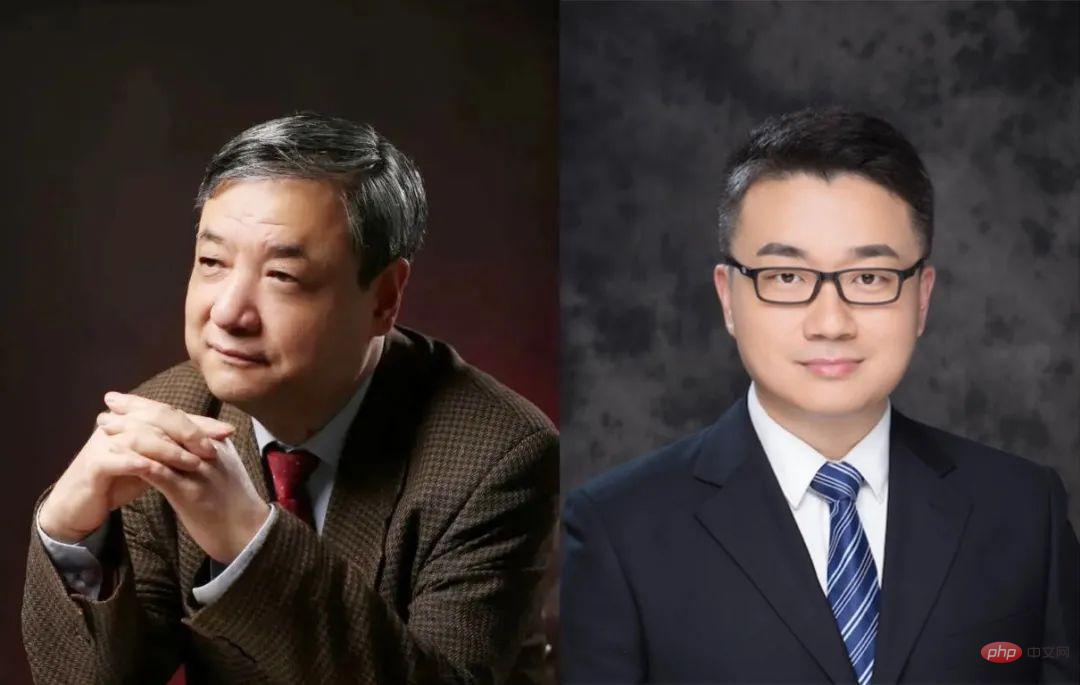

さらに、Tang Jie のチームは、アリババの M6 などの大規模モデルの開発をサポートするために、多くの大企業との交流や連絡関係も確立しています。 Tang Jieの学生であるYang Zhilinは、NLPスタートアップCircular Intelligenceの共同創設者であり、ファーウェイの大型モデル「Pangu」の研究開発にも参加しました。 内部関係者によると、Zhipu AI は現在 ChatGPT のような製品を研究しており、過去 2 か月以内に発売する予定です。 NLP の主題方向性の観点から見ると、清華省は最も「根付いていて成熟した」部門です。 」部門 孫茂松と劉志遠のチームです。 清華大学自然言語処理および社会人文計算研究室 (THUNLP) は、中国で最も早くから NLP 研究を実施した最も影響力のある科学研究部門です。 1970 年代後半にこの研究所が初めて設立されたとき、中国における NLP の先駆者である黄長寧氏が所長を務め、ACL フェローの孫茂松氏は孫茂松氏の学生で、劉志源氏は孫茂松氏の学生でした。 清華省孫茂松、劉志源

孫茂松 (左)、劉志遠 (右)

#THUNLP は NLP の分野で深い蓄積を持ち、2015 年には人間が作成した多数の詩をもとに学習された漢詩生成システム「Nine Songs」をリリースし、学術界や学術界で広く注目を集めました。業界。

大規模な言語モデルに関しては、Sun Maosong 氏と Liu Zhiyuan 氏のチームは 2018 年に事前トレーニング パラダイムをフォローアップし、2019 年初頭に ERNIE 言語モデルをリリースしました (百度版ERNIEと同名)知源研究所の「五道文源」の前身であるCPMモデルを開発。

Sun Maosong、Liu Zhiyuan、およびその大学院生は、NLP と大規模モデルの分野で複数の企業を立ち上げました。 2017 年に Tu Cunchao 氏によって設立され、法律分野での NLP の適用に焦点を当てている Power Law Intelligence、2022 年に Qi Fanchao 氏によって設立された Shenyan Technology は、自社開発の中国語を使用して産業レベルの中国情報処理エンジンの構築に取り組んでいます。大型モデル。

さらに、昨年 Zeng Guoyang 氏によって設立された Wall-Facing Intelligence があり、大規模モデルの高速化とアプリケーションに焦点を当てています。同社のチームは「Wudao Wenyuan」のバックボーン メンバーです。 」。彼らは、THUNLP および Zhiyuan Research Institute の Language Large Model Technology Innovation Center と共同で OpenBMB オープン ソース コミュニティを立ち上げ、数百億の中国大型モデルのライブ トレーニング プロジェクトである CPM-Live と、大型モデルのフルプロセス アクセラレーション ツールを立ち上げました。 。

ChatGPT のこの波において、THUNLP の利点は多くの NLP 学術的成果と大規模モデルの研究開発経験にありますが、課題はエンジニアリングと商業化にあります。

ChatGPT チャット ロボットとして、対話システム技術によってサポートされています。この方向で清華大学は研究を行っています。対話型人工知能 (CoAI) 研究グループの研究者は非常に優れています。

CoAI の会長は、Zhu Xiaoyan 氏とその学生の Huang Minlie 氏が務めています。 Huang Minlie 氏は、会話型人工知能の分野の専門家であり、著書『Modern Natural Language Generation』の著者であり、以前には Zhiyuan の大型モデル「Wudao」の開発にも参加していました。

黄民の嘘##黄民の嘘彼も清華大学出身で、起業を始めた学者の一人で、2021年に「Lingxin Intelligence」を設立した。大型モデルと対話システムの研究基盤に基づいて、Huang Minlie 氏は心理カウンセリング チャット ロボット トラックを選択しました。 2022 年に、彼のチームは「AI ユートピア」と呼ばれる対話型ロボットを発売しました。ユーザーは AI キャラクターをカスタマイズし、ロボットと詳細な会話を行うことができます。

大規模モデルをトレーニングできる数少ない国内チームの 1 つとして、Huang Minlie 氏は最近資金調達の Pre-A ラウンドを完了した後、ChatGPT と比較して「Lingxin Intelligence」を「中国」として位置づけたいと述べました。 Character AI」 - テキスト生成に基づいてユーザーに感情的な共感を提供します。彼のチームは、メンタルヘルスの分野で 30 億を超えるモデル パラメーターを含む大量の高品質のトレーニング データを蓄積していることがわかります。

国内の大手インターネット企業の中で、大規模モデルをリードする第一陣には、Baidu、Alibaba、JD が含まれます。ファーウェイとの.com。さらに、ChatGPT の開発への参入を発表したこの一連のインターネット企業には、Tencent、ByteDance、Kuaishou、360、iFlytek、NetEase などが含まれます。軍拡競争のようなChatGPTの研究開発においては、大手メーカーの紙幣能力が絶対的な優位性を持っていることは間違いない。

一部の業界関係者は、現時点では、ChatGPT のようなテクノロジーの 360 を含む一部の大手メーカーのインジケーターは、GPT-2 よりわずかに優れたレベルにしか到達できず、GPT-2 とは異なりますとコメントしています。現在の ChatGPT は、世代間ギャップに比べて、大規模な言語モデル (Kuaishou、iFlytek、NetEase など) は素手で戦うため、ChatGPT の起動時期と実際の効果には大きな不確実性があります。ベータ版のような。

自然言語処理の分野では、Baidu は大手メーカーの中で技術を蓄積しています。最も長い歴史を持つもの。

Baidu Wenxin 大型モデルの研究開発は、CTO の Wang Haifeng が主導しています。 「Wen Xin Yi Yan」プロジェクトでは、Wang Haifeng 氏が総司令官を務めており、コアメンバーの Wu Tian (Baidu Group 副社長でフライングパドルプラットフォームの研究開発リーダー) と Wu Hua (Wu Hua) 氏もいます。 Baidu 技術委員会の委員長および Baidu 翻訳技術チームの創設者の 1 人) 1)。

##王海峰

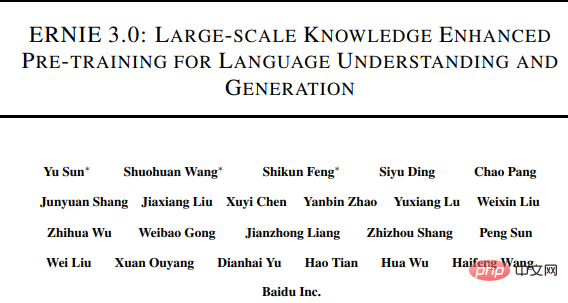

Baidu は最も早い段階で中国 事前トレーニングモデルの開発に深く関わっているチームの1つで、2019年に中国効果がBERTを超えるERNIE 1.0および2.0モデルをリリースし、2021年7月にリリースされたERNIE 3.0はSuperGLUEでGPT-3を超え、2021年7月にリリースされたERNIE 3.0はSuperGLUEでGPT-3を上回りました。同年発売の「彭城」 - 百度・文心」(ERNIE 3.0 Titan)は初の知識強化1000億レベルの大型モデルである。

「知識の強化」は、Wenxin シリーズがたどる技術的なルートです。つまり、言語知識と言語知識の導入です。世界の知識など。大規模なナレッジグラフと膨大なデータからの融合学習により、大規模モデルの学習効率と解釈可能性が向上します。

Baidu は 2021 年に、PLATO と呼ばれる会話ロボットも発売しました。このモデルは、数百億パラメータの会話生成大型モデル PLATO-XL に基づいています。

Baidu の利点は、長年にわたる AI 研究で深く培われたユーザー データである豊富な検索コーパス データにあり、Baidu Feipiao ディープラーニング プラットフォームと自社開発チップによってサポートされています。 。

Microsoft と Google の間の激しい戦争の後、Baidu は ChatGPT 製品 (「Wen Xin Yi Yan」) の開発計画を発表した中国の最初のチームの 1 つでした。内部関係者らは、その製品形態が独立したポータルになる可能性がある、あるいはMicrosoft Bingを模倣してBaidu検索ポータルと接続される可能性があることを明らかにした。

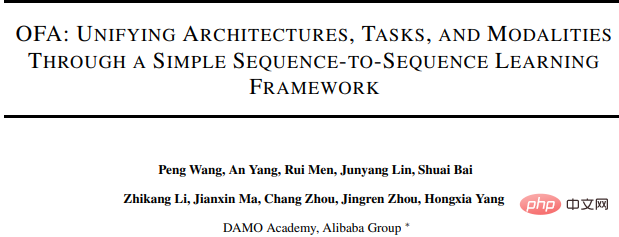

アリババダモアカデミーは2021年にビッグモデル業界に参入し、スマートモデル業界に参加します。袁研究所は「Wudao・Wenhui」大規模モデルを開発し、その後、GPT-3 のアーキテクチャを完全に参照し、言語理解と生成機能を統合した純粋なテキスト事前トレーニング言語モデル PLUG (270 億パラメータ) を発売しました。 、そのレベルは GPT-3 に近いです。

M6 マルチモーダル大型モデル シリーズは、DAMO アカデミーのインテリジェント コンピューティング研究室の元メンバーである Yang Honxia 氏 (昨年辞任) と Tang Jie 氏のチームによって開発されました。清華大学には、数百億から 10 兆までの範囲のパラメータがあります。

DAMO アカデミーの現副学長である周静仁氏のリーダーシップの下、DAMO アカデミーは昨年 9 月に「Tongyi」モデルを立ち上げました。

##周景仁

「同義」大型モデルは、次のモデルを統合しました。初めての状態、アーキテクチャ、タスク、そしてその背後にある技術サポートは、統合学習パラダイム OFA です。

昨年、中国の大型モデルのオープンソースのエコロジー構築を促進するために、DAMO アカデミーも AI を立ち上げました。モデルのオープンソース コミュニティ。「Model Scope」は業界に大きな反響を引き起こしました。

最近、DAMO アカデミーは、「Tongyi」大型モデルに基づいて、テキスト生成に加えてペイント機能も備えた Alibaba 版 ChatGPT を開発していることを確認しました。その ChatGPT に似た製品は DingTalk と深く統合されることが理解されています。

JD.com は、JD.com 世代をサポートするために 2020 年に AI テキスト生成の研究を開始しました商品ページの説明文。 JD.comのモールページの製品紹介の20%は、NLPテクノロジーを使用してAIチームによって生成されていると報告されています。この時期、NLP技術全体の低迷により研究開発が滞ったが、その後JD.comが再び注目し、延西大型モデルを発売した。

He Xiaodong 氏は、2018 年に Microsoft を退職して JD.com に入社し、現在は JD.com グループの副社長、JD.com AI Research Institute のエグゼクティブ ディレクターを務めています。現在、JD.com の大規模モデル研究チームのリーダーです。

##He Xiaodong

2021 年、彼はJD AIの前責任者であるZhou Bowen氏(2021年11月に辞任)が率いるドメインモデルK-PLUGは、JD Yanxipianプラットフォーム上で開発されました。このモデルは、JD.com の e コマース シナリオと密接に統合されており、e コマース分野の特定の知識から学習し、製品のコピーライティングを自動的に生成できます。

Huawei

ファーウェイは2020年に大型モデルの展開を開始しており、そのリーダーはTian Qi(IEEEフェロー、国際ユーラシア科学アカデミー会員)です。

2020 8 月 3 日、彼は人工知能分野のチーフサイエンティストとしてHuawei Cloudに入社し、同年夏にGPT-3が登場するとすぐにチームを結成し、Panguモデルの研究開発を開始しました。したがって、ファーウェイは2020年に大型モデル競争に参加した最初の大手メーカーの1つとなった。

Shengteng AIに基づいて、Pengcheng LabsおよびCircular Intelligenceと協力して、ファーウェイは2021年4月に中国語、ビジュアル、マルチモード4を含む「Pangu」シリーズの大型モデルをリリースしました。主要なモデル: 状態および科学的コンピューティング。

Pangu NLP 大規模モデルは、数千億語規模で中国語を生成および理解する業界初の大規模モデルです。事前トレーニング段階では、業界セグメントの小さなサンプル データを含む 40 TB の中国語テキスト データが学習されました。モデル構造に関しては、Pangu はエンコードおよびデコード アーキテクチャを採用し、生成と理解のパフォーマンスを保証します。

ファーウェイは、数千億のモデルと強力なコンピューティング リソースにおける研究開発の経験を持っていますが、今回はほとんど発言しておらず、まだ実現していません。同様のモデルを開発するかどうかを明確にする。

ChatGPTがもたらしたAI商用化ブームの波は、技術的な障壁が非常に高く、また、科学者にとっては自分のビジネスを始める大きなチャンスです。

蘭州テクノロジーの創設者である周明、アイデア研究所の主席科学者である張嘉興、蘭振中、西湖新陳、そして仙源テクノロジーの創設者である周ボーウェンは、いずれも学術的なスタートです。代表します。

彼らにとって、将来の ChatGPT ビジネス戦争で勝つためには、エンジニアリング能力と市場運営能力を強化する必要もあります。 Zhang Jiaxing 氏や Lan Zhenzhong 氏と同様に、彼らはすでに研究開発チームの CEO を探しています。

さらに、2 つの参入モードも観察できます: 1 つは、商業化の欠点を補うための強力な技術力に基づくものであり、もう 1 つは、経験豊富な上司が排除され、技術的才能を備えた商業化です。チームを結成することに惹かれます。

最終的にどのモデルがより成功するかは様子を見てみます。

大規模モデル スタック パラメーターの最終ラウンドのトレンドが本格化したとき, Zhou Ming 独自のアプローチをとり、自身のスタートアップ企業である蘭州科技のために軽量大型モデル路線を選択しました。

2021 年 6 月、周明氏は蘭州テクノロジーを設立し、翌 7 月、彼のチームは 10 億個のパラメーターを備えた「孟子」モデルをリリースし、その効果は 1,000 億個の大型モデルに匹敵しました。 。

これは、学術界と産業界の両方における周明氏の業績の成果です。

周明

周明はNLP の分野で最も影響力のある中国科学者の 1 人。彼は 1991 年にハルビン工業大学を博士号を取得して卒業しました。彼は百度 CTO の王海峰氏の学生であり、ハルビン工業大学教授で NLP マスターの李勝氏の弟子でもあります。周明氏は博士課程の在学中に、中国初の中国語-英語翻訳システムを開発しました。

周明氏は卒業後、教師として清華大学に入学し、1999 年にマイクロソフト リサーチ アジア (MSRA) の創立学部長である李凱福氏に引き抜かれ、 2001 年に NLP グループのディレクターに就任。その後、マイクロソフト アジア リサーチの副社長に昇進しました。

MSRA 在籍中に、Zhou Ming は NLP テクノロジーの産業化に多くの成果を上げました。彼は ACL サミットで 100 以上の論文に参加し、主導しました。関連テクノロジーはまた、 Windows、Office、Azure、Microsoft Xiaoiceなどの世界クラスの製品の中から。

2020 年、周明氏は新たな方法で学界と産業界の協力を求める決意を固め、マイクロソフトでの 21 年間のキャリアに終止符を打ち、李凱福氏が設立したイノベーション ワークスに入社しました。人工知能工学研究所の主任研究員を務め、起業家チームの育成を開始し、最終的に蘭州テクノロジーを設立しました。

公式ニュースによると、蘭州科技はChatGPTの基盤技術と同様の大規模言語モデルを利用し、膨大なデータを持つ中国語オンラインと協力して国産ChatGPTを構築するとのこと。周明氏のチームが今後も軽量モデル路線を続けるのか、それとも技術サポートとして1000億レベルを超える大型モデルの製作に転じるのかはまだ分からない。

2022 年、Zhou Bowen は学界に戻り、電子工学科の終身教授として清華大学に着任しました。清華大学フイヤン教授、電子工学部協調インタラクティブインテリジェンス研究センター所長。

同時に、Zhou Bowen氏はまだ新人起業家です。 2021年末に彼はJD.comの上級副社長を辞任し、Xianyuan Technologyを設立するために去った。

周ボーエン

周ボーエンはジュニアクラスの卒業生です。中国科学大学の博士号を取得し、コロラド大学ボルダー校に通い博士号を取得しました。卒業後は IBM に勤務し、IBM Research Artificial Intelligence Foundations (AI Foundations) の学部長、IBM Watson Group の主任科学者、および IBM Distinguished Engineer を務めました。 2017 年、Zhou Bowen は JD.com グループの副社長として JD.com に入社し、JD.com の AI 研究を担当しました。

NLP、マルチモダリティ、人間とコンピューターの対話などはすべて、Zhou Bowen が長年携わってきた分野です。彼が提案した自己注意融合マルチヘッド機構の自然言語表現機構は、後にTransformerアーキテクチャの中核となるアイデアの一つとなり、AIGC分野においても2つの自然言語生成モデルアーキテクチャとアルゴリズムを提案した。 2020 年に IEEE フェローに選出されました。

Zhou Bowen 氏の見解では、ChatGPT の中心的な進歩は、モデルの拡大ではなく、人間のコラボレーションとインタラクティブな学習の改善です。さらに、ChatGPT は確実にマルチモダリティに進化します。それは、彼が率いる協調インタラクティブインテリジェンス研究センターの重要な研究方向です。

Xianyuan Technology では、Zhou Bowen 氏が、消費者および市場中心のリアルタイム イノベーションを加速し、SKU イノベーションの成功を向上させるための生成人工知能の使用など、いくつかの AIGC アプリケーションも実装しました。 。

広東・香港・マカオ大湾区には、彭城研究所とテンセントに加えて、もう 1 つの大手モデルプレーヤーです。つまり、IDEA 研究所 (正式名称「広東・香港・マカオ大湾区デジタル経済研究所」) は、沈祥陽などの著名な AI 科学者によって 2020 年に設立されました。

アイデア研究所の大型モデル担当者 張嘉興です、彼もMSRA出身のAI科学者です。

张家兴

张家兴

Zhang Jiaxing は北京大学電子工学科を卒業し、博士号を取得しました。 2006 年に侯世民氏 (現在は北京大学電子工学部教授) に師事し、卒業後はまず Baidu に一定期間滞在し、その後 Microsoft の Bing Search チームに加わり、Zhou Jingren 氏と協力しました。 MSRA で、Zhang Jiaxing はシステム指向の研究に従事し、2012 年にディープラーニングに転向しました。

2014 年、Zhang Jiaxing は Alibaba iDST (Dharma 研究所の前身) チームに加わりました。 , そして 1 年後、会話ロボットを金融シナリオに適用する NLP 技術チームを率いるために Ant Financial に行きました。2020 年、Zhang Jiaxing は 360 Digital CEO の Wu Haisheng に招待され、チーフサイエンティストとして 360 Digital に加わりました。1 年間滞在した後、

MSRA 周立東学部長の推薦により、Zhang Jiaxing は、コグニティブ コンピューティングおよび自然言語研究センターを担当する主席科学者として IDEA Research Institute に入社しました。

Zhang Jiaxing 氏のチームは常に AIGC の波をリードしており、「Fengshen Bang」オープンソース モデル シリーズの開発を主導し、中国初の安定拡散モデルの中国版を立ち上げました。

ChatGPT の出現後、Zhang Jiaxing 氏は昨年末にチームの大規模モデル開発を ChatGPT の対話タスク ルートにすぐに移行しました。彼によると、彼のチームによって開発されたクラス ChatGPT モデルは ChatGPT と同等であり、パラメーターは 50 億しかありません。テキスト生成速度も非常に高速です。現在内部テスト中であり、近い将来公開テストされる予定です。

現在の 50 億パラメータのモデルはすでに非常にうまく機能していますが、次は Zhang Jiaxing が 1000 億モデルでサポートされる ChatGPT のような製品を開発し、商用化を推進する予定です。彼は最近、資金を集めて CEO を見つける準備をしているところです。チームの CEO は、Xihu Xinchen の創設者である Lan Zhenzhong です。

LAN Zhenzhong

昨年、多くの国内 AI 塗装製品で競争の中で際立っていたのは、Lan Zhenzhong チームによる「Dream Stealer」(現在は「Dream Diary」に改名)です。

Lan Zhenzhong は中山大学を学士号を取得して卒業し、カーネギー メロン大学でコンピュータ ビジョンを研究して博士号を取得し、その後 Google に就職したとき、 Googleを頼りに自然言語処理に切り替えた 有名な軽量大型モデル「ALBERT」はTPUリソースを使用して開発されました。

2020 年 6 月、Lan Zhenzhong 氏は中国に戻り、ウェストレイク大学に入学し、深層学習研究室を設立し、言語と視覚の組み合わせに関するマルチモーダル研究を開始しました。

西湖大学と以前参加していた志源「清源クラブ」の科学研究リソースを頼りに、蘭振中氏は産学研究モデルを開始し、西湖新城を設立しました。心理相談チャットロボット「Xiaotian」は、2022年8月に国内塗装製品「Dream Stealer」を安定普及波で発売する予定です。

ChatGPT が登場してから間もなく、Xihu Xinchen は同様のテキスト生成製品「Xinchen Chat」を発売しました。違いは、インターネットにアクセスできることと、マルチモーダル インタラクティブであること、テキストの生成だけでなく画像の出力もできることです。

学者としてスタートし、その後自分のビジネスを立ち上げた多くの人々と同様に、Lan Zhenzhong 氏も、中国の企業を構築するには管理経験と強力なリソース統合能力を備えた CEO がチームに必要であると深く感じていました。 OpenAI のバージョン。明日のAI技術レビューにご注目ください:「Lan Zhenzhongも「ヒーロー投稿」を投稿、中国版ChatGPTスター企業がCEOを募集中」

以上がChatGPT の中国版を作成するには、どのような国内の学術勢力がその機会を掴むことができるでしょうか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。