米メディア:マスク氏らがAIトレーニングの中止を求めたのは正しい、安全のために速度を落とす必要がある

3月30日のニュースによると、テスラのCEOイーロン・マスク氏とアップルの共同創設者スティーブ・ウォズニアック氏、その他1,000人以上が最近、 GPT-4 よりも強力な AI システムのトレーニングを一時停止します。アメリカの主流オンライン メディアである BI は、社会全体の利益のために AI の開発は減速する必要があると考えています。

公開書簡の中で、ウォズニアック氏やマスク氏らは、AI技術がますます強力になるにつれ、安全ガードレールを設置し、より高度なAIモデルのトレーニングを一時停止するよう要請した。彼らは、OpenAI の GPT-4 のような強力な AI モデルについては、「その影響がプラスであり、リスクが制御可能であると確信できる場合にのみ開発すべきである」と考えています。

もちろん、人々が AI の安全ガードレールを要求するのはこれが初めてではありません。しかし、AIの複雑化・高度化に伴い、警戒を求める声が高まっています。

米国のコーネル大学のデジタルおよび情報法の教授であるジェームス・グリメルマン氏は、次のように述べています。「新しい AI モデルの開発を遅らせることは、非常に良い考えです。私たちにとって有益な場合は、数か月または数年待っても害はありません、いずれにせよ終わりに到達します、そして、それが有害である場合、私たちはまた、最善の対応方法を考え出し、戦い方を理解するために余分な時間を稼ぎます。

ChatGPT の台頭は、速すぎる動きの潜在的な危険性を浮き彫りにします

昨年 11 月、OpenAI のチャットボット ChatGPT が公開テストのために開始されたとき、大きなセンセーションを引き起こしました。当然のことながら、人々は ChatGPT の機能を宣伝し始め、社会に対するその破壊的な影響はすぐに明らかになりました。 ChatGPT は医療専門家試験に合格し始め、爆弾の作り方を指導し、さらには自分の分身も作成しました。

AI、特に ChatGPT やテキストから画像への変換ツール Stable Diffusion などのいわゆる生成人工知能 (AIGC) ツールを使えば使うほど、その欠点や偏見を生み出す方法が見えてきます。可能性、そしてその力を利用する上で私たち人間がいかに無力であるか。

BI 編集者のハサン・チョードリー氏は、AI には「ターボチャージャーとなり、私たちの間違いの蔓延を加速する」可能性があると書いています。ソーシャルメディアと同様に、それは人間の最良の部分と最悪の部分を利用します。しかし、ソーシャルメディアとは異なり、AIは人々の生活により深く組み込まれることになるでしょう。

ChatGPT や他の同様の AI 製品はすでに情報を歪めたり間違いを犯したりする傾向があり、これについてウォズニアック氏は公に語っています。いわゆる「幻覚」(真実ではない情報)が起こりやすく、OpenAI CEO のサム・アルトマンでさえ、同社のモデルが人種的、性差別的、そして偏った答えを生み出す可能性があることを認めました。 Stable Diffusion は著作権問題にも遭遇し、デジタル アーティストの作品からインスピレーションを盗んだとして非難されています。

AI がより日常的なテクノロジーに統合されるにつれて、より多くの誤った情報が大規模に世界に導入される可能性があります。休暇の計画を支援するなど、AI にとって無害であるように見えるタスクでも、完全に信頼できる結果が得られるとは限りません。

自由市場で急速な開発が求められる場合、責任を持って AI テクノロジーを開発するのは困難です

はっきり言っておきますが、AI、特に ChatGPT などの AIGC のようなテクノロジーは非常に革新的です。人間が嫌がる退屈な作業のほとんどを実行するマシンを開発することには、本質的に何の問題もありません。

テクノロジーは労働力に存亡の危機をもたらしましたが、テクノロジー業界の平等化ツールとしても歓迎されています。 ChatGPT が今後数年間にボット反乱を主導する準備をしているという証拠もありません。

多くの AI 企業は、責任を持ってこのテクノロジーを開発するために倫理学者を関与させています。しかし、製品の開発を急ぐことがその社会的影響を上回ってしまうと、AI を安全に作成することに重点を置いたチームは、安心して仕事を遂行することができなくなります。

この AI ブームにおいて、スピードは無視できない要素のようです。 OpenAI は、同社が十分な速さで行動すれば、競争をかわして AIGC 分野のリーダーになれると信じています。これにより、Microsoft、Google、その他ほぼすべての企業が追随するようになりました。

強力な AI モデルが完成する前に公開エクスペリエンスとしてリリースしても、テクノロジーは向上しません。 AI の最適なユースケースはまだ見つかっていません。開発者は自分たちが作成するテクノロジーによって生成されるノイズを遮断する必要があり、ユーザーはノイズに気を取られるからです。

誰もがスピードを緩めたいわけではない

マスク氏らの公開書簡は、要点を外していると考える他の人々からも批判されている。

ワシントン大学のエミリー・M・ベンダー教授はツイッターで、マスク氏や他のテクノロジーリーダーたちは、AIが引き起こす実際の損害ではなく、誇大広告サイクルにおけるAIの力にのみ焦点を当てていると述べた。

コーネル大学のデジタル・情報法教授ジェリー・メルマン氏は、公開書簡に署名したテクノロジーリーダーたちは「遅ればせながら到着」し、自らに結果をもたらす可能性のあるパンドラの箱を開けようとしていると付け加えた。同氏は、「彼らがこの書簡に署名した以上、方向転換して同じ政策を自動運転車などの他の技術に適用することはできない」と述べた。結果を達成する。しかし今、会話は方向転換したようだ。 AI は数十年前から存在していますが、おそらくあと数年は待ってもよいでしょう。

以上が米メディア:マスク氏らがAIトレーニングの中止を求めたのは正しい、安全のために速度を落とす必要があるの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7554

7554

15

15

1382

1382

52

52

83

83

11

11

28

28

96

96

Spring Boot と OpenAI の出会いによる新しいプログラミング パラダイム

Feb 01, 2024 pm 09:18 PM

Spring Boot と OpenAI の出会いによる新しいプログラミング パラダイム

Feb 01, 2024 pm 09:18 PM

2023年、AI技術が注目を集め、プログラミング分野を中心にさまざまな業界に大きな影響を与えています。 AI テクノロジーの重要性に対する人々の認識はますます高まっており、Spring コミュニティも例外ではありません。 GenAI (汎用人工知能) テクノロジーの継続的な進歩に伴い、AI 機能を備えたアプリケーションの作成を簡素化することが重要かつ緊急になっています。このような背景から、AI 機能アプリケーションの開発プロセスを簡素化し、シンプルかつ直観的にし、不必要な複雑さを回避することを目的とした「SpringAI」が登場しました。 「SpringAI」により、開発者はAI機能を搭載したアプリケーションをより簡単に構築でき、使いやすく、操作しやすくなります。

データに最適なエンベディング モデルの選択: OpenAI とオープンソースの多言語エンベディングの比較テスト

Feb 26, 2024 pm 06:10 PM

データに最適なエンベディング モデルの選択: OpenAI とオープンソースの多言語エンベディングの比較テスト

Feb 26, 2024 pm 06:10 PM

OpenAI は最近、最新世代の埋め込みモデル embeddingv3 のリリースを発表しました。これは、より高い多言語パフォーマンスを備えた最もパフォーマンスの高い埋め込みモデルであると主張しています。このモデルのバッチは、小さい text-embeddings-3-small と、より強力で大きい text-embeddings-3-large の 2 つのタイプに分類されます。これらのモデルがどのように設計され、トレーニングされるかについてはほとんど情報が開示されておらず、モデルには有料 API を介してのみアクセスできます。オープンソースの組み込みモデルは数多くありますが、これらのオープンソース モデルは OpenAI のクローズド ソース モデルとどう違うのでしょうか?この記事では、これらの新しいモデルのパフォーマンスをオープンソース モデルと実証的に比較します。データを作成する予定です

OpenAI Super Alignment チームの遺作: 2 つの大きなモデルがゲームをプレイし、出力がより理解しやすくなる

Jul 19, 2024 am 01:29 AM

OpenAI Super Alignment チームの遺作: 2 つの大きなモデルがゲームをプレイし、出力がより理解しやすくなる

Jul 19, 2024 am 01:29 AM

AIモデルによって与えられた答えがまったく理解できない場合、あなたはそれをあえて使用しますか?機械学習システムがより重要な分野で使用されるにつれて、なぜその出力を信頼できるのか、またどのような場合に信頼してはいけないのかを実証することがますます重要になっています。複雑なシステムの出力に対する信頼を得る方法の 1 つは、人間または他の信頼できるシステムが読み取れる、つまり、考えられるエラーが発生する可能性がある点まで完全に理解できる、その出力の解釈を生成することをシステムに要求することです。見つかった。たとえば、司法制度に対する信頼を築くために、裁判所に対し、決定を説明し裏付ける明確で読みやすい書面による意見を提供することを求めています。大規模な言語モデルの場合も、同様のアプローチを採用できます。ただし、このアプローチを採用する場合は、言語モデルが

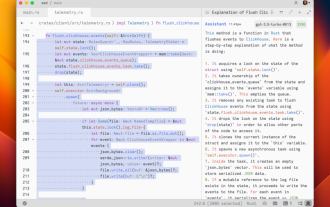

Rust ベースの Zed エディターはオープンソース化されており、OpenAI と GitHub Copilot のサポートが組み込まれています

Feb 01, 2024 pm 02:51 PM

Rust ベースの Zed エディターはオープンソース化されており、OpenAI と GitHub Copilot のサポートが組み込まれています

Feb 01, 2024 pm 02:51 PM

著者丨コンパイル: TimAnderson丨プロデュース: Noah|51CTO Technology Stack (WeChat ID: blog51cto) Zed エディター プロジェクトはまだプレリリース段階にあり、AGPL、GPL、および Apache ライセンスの下でオープンソース化されています。このエディターは高性能と複数の AI 支援オプションを備えていますが、現在は Mac プラットフォームでのみ利用可能です。 Nathan Sobo 氏は投稿の中で、GitHub 上の Zed プロジェクトのコード ベースでは、エディター部分は GPL に基づいてライセンスされ、サーバー側コンポーネントは AGPL に基づいてライセンスされ、GPUI (GPU Accelerated User) インターフェイス部分はApache2.0ライセンス。 GPUI は Zed チームによって開発された製品です

OpenAI を待つのではなく、Open-Sora が完全にオープンソースになるのを待ちましょう

Mar 18, 2024 pm 08:40 PM

OpenAI を待つのではなく、Open-Sora が完全にオープンソースになるのを待ちましょう

Mar 18, 2024 pm 08:40 PM

少し前まで、OpenAISora はその驚くべきビデオ生成効果で急速に人気を博し、数ある文学ビデオ モデルの中でも際立って世界的な注目を集めるようになりました。 2 週間前にコストを 46% 削減した Sora トレーニング推論再現プロセスの開始に続き、Colossal-AI チームは世界初の Sora のようなアーキテクチャのビデオ生成モデル「Open-Sora1.0」を完全にオープンソース化し、全体をカバーしました。データ処理、すべてのトレーニングの詳細、モデルの重みを含むトレーニング プロセスを管理し、世界中の AI 愛好家と協力してビデオ作成の新時代を推進します。ちょっと覗いてみましょう。Colossal-AI チームがリリースした「Open-Sora1.0」モデルによって生成された賑やかな街のビデオを見てみましょう。オープンソラ1.0

マイクロソフトとOpenAIは人型ロボットに1億ドル投資する計画!ネチズンはマスク氏に電話をかけている

Feb 01, 2024 am 11:18 AM

マイクロソフトとOpenAIは人型ロボットに1億ドル投資する計画!ネチズンはマスク氏に電話をかけている

Feb 01, 2024 am 11:18 AM

MicrosoftとOpenAIが人型ロボットのスタートアップに巨額の資金を投資していることが年初に明らかになった。このうちマイクロソフトは9500万ドル、OpenAIは500万ドルを投資する予定だ。ブルームバーグによると、同社は今回のラウンドで総額5億米ドルを調達する予定で、資金調達前の評価額は19億米ドルに達する可能性がある。何が彼らを惹きつけるのでしょうか?まずはこの会社のロボット分野の実績を見てみましょう。このロボットはすべて銀と黒で、その外観はハリウッドの SF 大作映画に登場するロボットのイメージに似ています。今、彼はコーヒー カプセルをコーヒー マシンに入れています。正しく置かれていない場合でも、何もせずに自動的に調整されます。人間リモコン: ただし、しばらくすると、コーヒーを持ち帰って楽しむことができます: 家族にそれを認識した人はいますか? はい、このロボットは少し前に作成されました。

Embedding サービスのローカル実行パフォーマンスは OpenAI Text-Embedding-Ada-002 を上回っており、とても便利です。

Apr 15, 2024 am 09:01 AM

Embedding サービスのローカル実行パフォーマンスは OpenAI Text-Embedding-Ada-002 を上回っており、とても便利です。

Apr 15, 2024 am 09:01 AM

Ollama は、Llama2、Mistral、Gemma などのオープンソース モデルをローカルで簡単に実行できるようにする非常に実用的なツールです。この記事では、Ollamaを使ってテキストをベクトル化する方法を紹介します。 Ollama をローカルにインストールしていない場合は、この記事を読んでください。この記事では、nomic-embed-text[2] モデルを使用します。これは、短いコンテキストおよび長いコンテキストのタスクにおいて OpenAI text-embedding-ada-002 および text-embedding-3-small よりも優れたパフォーマンスを発揮するテキスト エンコーダーです。 o が正常にインストールされたら、nomic-embed-text サービスを開始します。

突然! OpenAI、情報漏洩の疑いでイリヤの盟友を解雇

Apr 15, 2024 am 09:01 AM

突然! OpenAI、情報漏洩の疑いでイリヤの盟友を解雇

Apr 15, 2024 am 09:01 AM

突然! OpenAIが従業員を解雇、理由は情報漏洩の疑い。一人は、行方不明の主任科学者イリヤの同盟者であり、スーパーアライメントチームの中心メンバーであるレオポルド・アッシェンブレナーです。もう一人も単純ではありません。彼は LLM 推論チームの研究者であり、スーパー アライメント チームでも働いていたパベル イズマイロフです。 2人が具体的にどのような情報を漏らしたのかは不明だ。このニュースが暴露された後、多くのネチズンは「かなりショックを受けた」と表明した。私はつい最近アシェンブレナーの投稿を見て、彼のキャリアが成長していると感じたが、これほどの変化は予想していなかった。写真の中のネチズンの中には、「OpenAI はアシェンブレナーを失った、私は」と考えている人もいます。