Google の驚異的な「暗視」カメラが突然人気になりました。完璧なノイズリダクションと 3D パースペクティブ合成

最近、Google の AI 夜景撮影動画が話題になっています。

ビデオ内のテクノロジーは RawNeRF と呼ばれ、その名前が示すように、NeRF の新しい亜種です。

NeRF は、2D 画像情報をトレーニング データとして使用して 3D シーンを復元する、完全に接続されたニューラル ネットワークです。

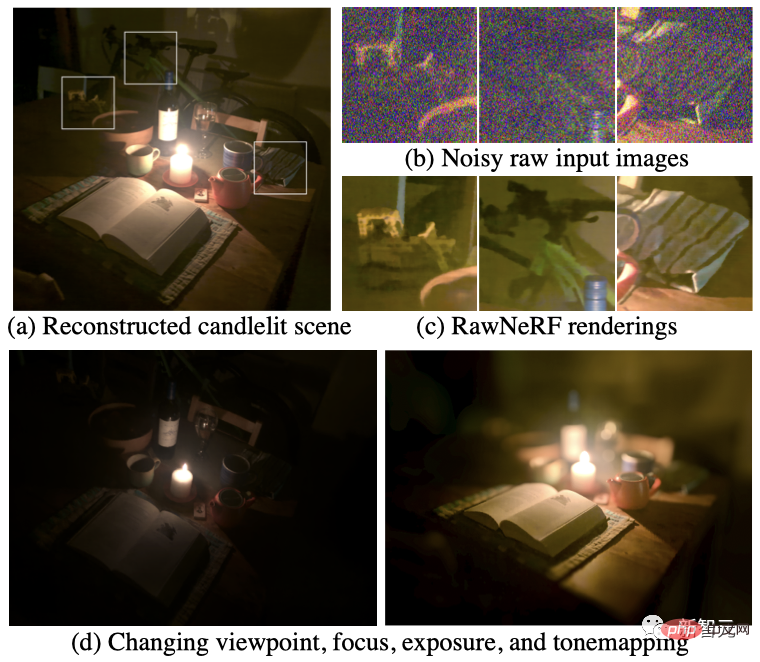

RawNeRF は、以前の NeRF と比較して多くの改善が加えられています。ノイズを完全に低減するだけでなく、カメラの視点を変更し、フォーカス、露出、トーン マッピングを調整します。 Google によるこの論文は 2021 年 11 月に公開され、CVPR 2022 に含まれています。

プロジェクトアドレス: https://bmild.github.io/rawnerf/ #夜のRawNeRF

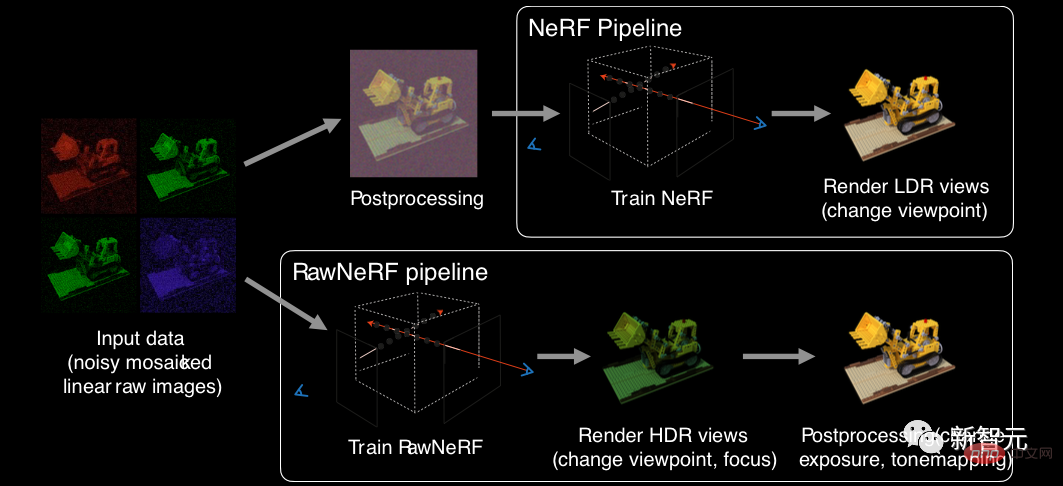

以前、NeRFはトーンマップされた低ダイナミックレンジLDR画像を入力として使用していました。Google の RawNeRF は、シーンのダイナミック レンジ全体を保持できる線形の RAW 画像を直接トレーニングします。

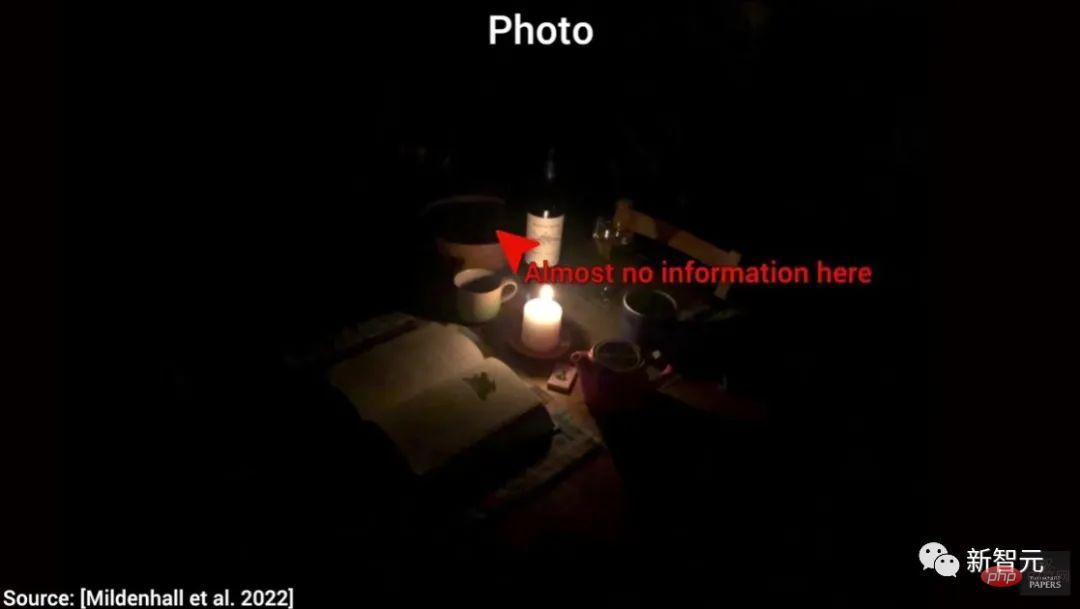

合成ビューの分野では、暗い写真の処理が常に問題となっています。

この場合、画像には最小限の詳細しか含まれていないためです。そして、これらの画像により、新しいビューをつなぎ合わせることが困難になります。

こんな感じの写真なので、さらに詳しく。

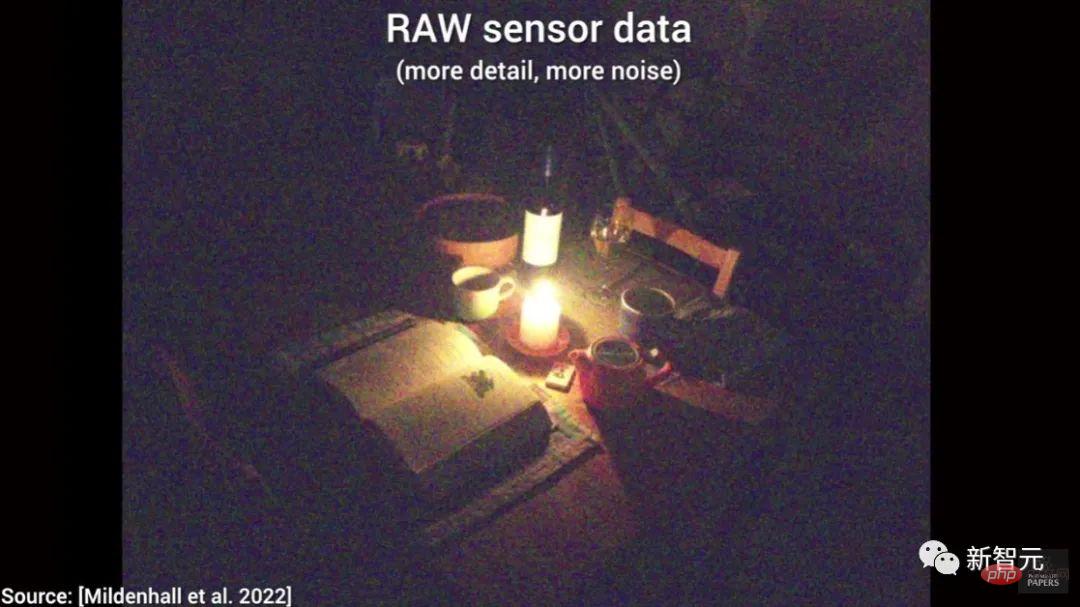

しかし、ノイズが多すぎるという問題がまだあります。

良いニュースは、画像ノイズ低減テクノロジーを使用できることです。

#ノイズリダクション後の画像効果は良好であることがわかりますが、合成ビューとなると、この品質はまだ十分ではありません。

#ノイズリダクション後の画像効果は良好であることがわかりますが、合成ビューとなると、この品質はまだ十分ではありません。

しかし、画像ノイズ除去テクノロジーは、単一の画像のノイズを除去できるため、画像のグループのノイズを除去することもできるというアイデアを提供します。

RawNeRF の効果を見てみましょう。

そして、さらに驚くべき機能があります。基盤となるデータをトーン マッピングして、暗い画像から詳細を抽出します。

そして、さらに驚くべき機能があります。基盤となるデータをトーン マッピングして、暗い画像から詳細を抽出します。

たとえば、画像の焦点を変更すると、大きな被写界深度効果が生まれます。

たとえば、画像の焦点を変更すると、大きな被写界深度効果が生まれます。

さらに驚くべきことは、これがリアルタイムであることです。

さらに驚くべきことは、これがリアルタイムであることです。

#さらに、焦点の変化に応じて画像の露出も変化します。

次に、RawNeRF の 5 つの古典的なアプリケーション シナリオを見てみましょう。

5 つの古典的なシーン

1. 画像の鮮明さ

この画像を見てください。道路標識の情報を見ますか?

RawNeRF 処理後、道路標識上の情報がより鮮明になっていることがわかります。

次のアニメーションでは、オリジナルの NeRF テクノロジーと RawNeRF の画像合成の違いがはっきりとわかります。

実際、いわゆる NeRF はそれほど古いテクノロジーではなく、まだ 2 年しか経っていません...

RawNeRF はハイライト処理で非常に優れたパフォーマンスを示しており、右下隅のナンバー プレートの周囲のハイライトの変化も確認できます。

#2. 鏡面ハイライト

鏡面ハイライトは、キャプチャするのが非常に難しいオブジェクトです。カメラを動かしながら撮影すると、写真の変化が大きくなり、写真間の相対的な距離が遠くなります。 これらの要素は、アルゴリズムを学習する上で大きな課題です。

下の写真からわかるように、RawNeRF によって生成された鏡面ハイライトはかなり復元されていると言えます。

#3. 薄い構造

明るい場所でも、以前の技術ではフェンスがうまく表示されませんでした。

フェンスがナンバープレートと重なっている場合でも、効果は非常に優れています。

道路上の反射は、より挑戦的な鏡面ハイライト。ご覧のとおり、RawNeRF も非常に自然かつ現実的に処理します。

#5. フォーカスを変更し、露出を調整します

#5. フォーカスを変更し、露出を調整します

このシーンでは、視点を変更し、常にフォーカスを変更し、同時に露出を調整してみましょう。

以前は、これらのタスクを完了するには、25 ~ 200 枚の写真のコレクションが必要でした。

さあ、撮影を完了するには数秒しかかかりません。

もちろん、RawNeRF は現時点では完璧ではなく、左側の RawNeRF 画像と右側の実際の写真の間にはまだいくつかの違いがあることがわかります。

しかし、RAWnerf は、ノイズに満ちた一連のオリジナル画像から現在のエフェクトに至るまで、大幅な進歩を遂げました。ご存知のとおり、2 年前のテクノロジーではこれを行うことはまったくできませんでした。

RAW の利点

簡単に説明すると、NeRF トレーニング パイプラインはカメラによって処理された LDR 画像を受け取り、その後のシーンの再構築とビューのレンダリングは LDR に基づいて行われます。色空間。したがって、NeRF の出力は実際には後処理されており、大幅な修正や編集は不可能です。

対照的に、RawNeRF は線形の生の HDR 入力データで直接トレーニングされます。結果として得られるレンダリングは、元の写真と同様に、フォーカスや露出などを変更して編集できます。

#これによってもたらされる主な利点は、HDR ビューの合成とノイズ リダクション処理の 2 点です。

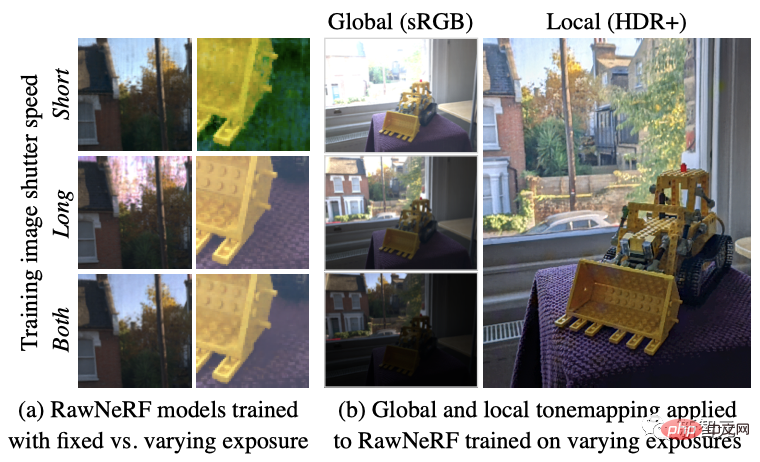

明るさが極端に変化するシーンでは、固定シャッター速度ではダイナミック レンジ全体を捉えるのに十分ではありません。 RawNeRF モデルは、短時間露光と長時間露光の両方を同時に最適化し、ダイナミック レンジ全体を復元できます。

たとえば、(b) の光の比率が大きいシーンでは、暗い部分の詳細を保持するために、より複雑なローカル トーン マッピング アルゴリズム (HDR 後処理など) が必要です。アウトドアシーンも同時にハイライト。

さらに、RawNeRF は、線形カラーを使用して、正しく飽和した「ぼやけた」ハイライトを備えた合成デフォーカス効果をレンダリングすることもできます。

画像ノイズ処理に関して、著者は完全に未処理の HDR 線形オリジナル画像に対して RawNeRF をさらにトレーニングして、数十、場合によっては数百の入力画像を処理できます。

この種の堅牢性は、RawNeRF が暗闇の中でシーンを再構築するタスクを見事に完了できることを意味します。

たとえば、(a) 1 本のキャンドルだけで照らされたこの夜のシーンでは、RawNeRF は、後処理によって破壊されてしまうノイズの多い生データから詳細を抽出できます (b、c) )。

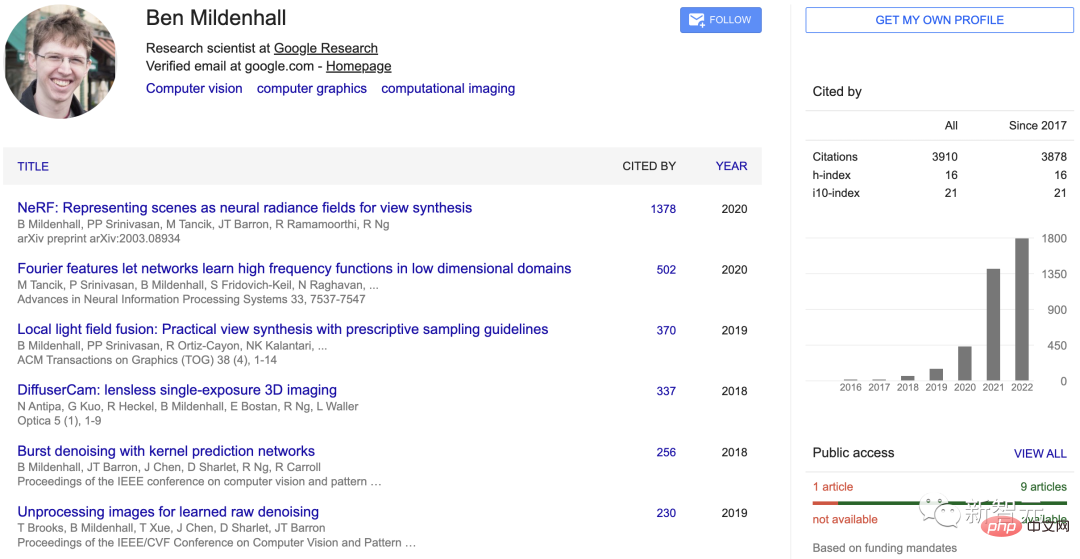

著者紹介

この論文の筆頭著者、Ben Mildenhall は Google の研究者です。コンピューター ビジョンとグラフィックスの問題に取り組む研究科学者。

彼は、2015 年にスタンフォード大学でコンピューター サイエンスと数学の学士号を取得し、カリフォルニア大学バークレー校でコンピューター サイエンスの博士号を取得しました。 2020年に。

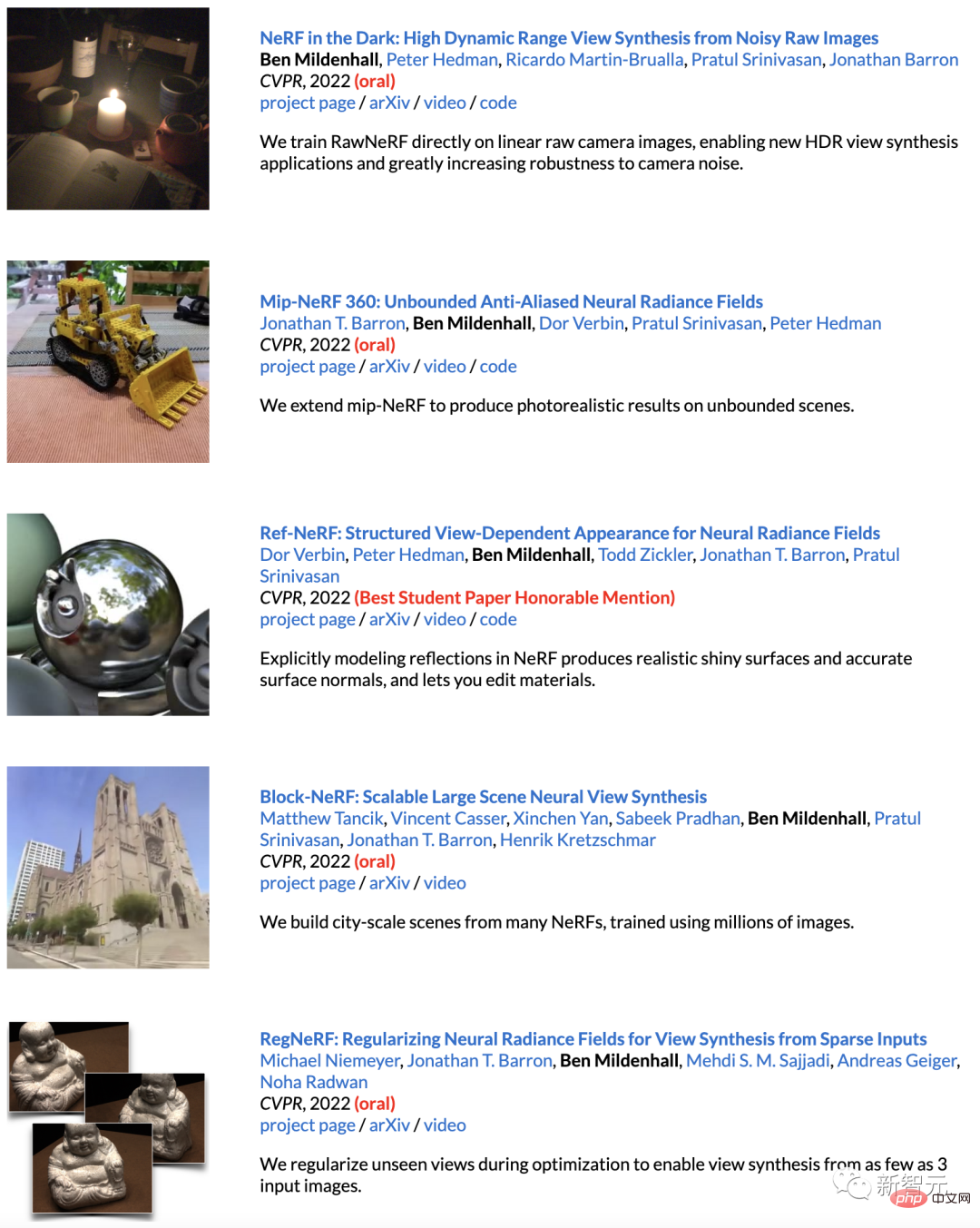

終了したばかりの CVPR 2022 は、ベンのハイライトの瞬間と言えます。

受理された 7 件の論文のうち 5 件が口頭発表を受賞し、1 件は最優秀学生論文の佳作を受賞しました。

動画が公開されるとすぐに、すべてのネチズンを驚かせました。みんなで一緒に楽しみましょう。

#

テクノロジーの進歩のスピードを見ると、そう遠くないうちに、夜間に写真を撮ることを心配する必要がなくなりました。了解~

以上がGoogle の驚異的な「暗視」カメラが突然人気になりました。完璧なノイズリダクションと 3D パースペクティブ合成の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7461

7461

15

15

1376

1376

52

52

77

77

11

11

17

17

17

17

DeepSeekを検索する方法

Feb 19, 2025 pm 05:39 PM

DeepSeekを検索する方法

Feb 19, 2025 pm 05:39 PM

DeepSeekは、特定のデータベースまたはシステムでのみ検索する独自の検索エンジンであり、より速く、より正確です。それを使用する場合、ユーザーはドキュメントを読み、さまざまな検索戦略を試し、ユーザーエクスペリエンスに関するヘルプを求めてフィードバックを求めて、利点を最大限に活用することをお勧めします。

セサミオープンドア交換Webページ登録リンクゲートトレーディングアプリ登録Webサイト最新

Feb 28, 2025 am 11:06 AM

セサミオープンドア交換Webページ登録リンクゲートトレーディングアプリ登録Webサイト最新

Feb 28, 2025 am 11:06 AM

この記事では、SESAME Open Exchange(gate.io)Webバージョンの登録プロセスとGate Tradingアプリを詳細に紹介します。 Web登録であろうとアプリの登録であろうと、公式Webサイトまたはアプリストアにアクセスして、本物のアプリをダウンロードし、ユーザー名、パスワード、電子メール、携帯電話番号、その他の情報を入力し、電子メールまたは携帯電話の確認を完了する必要があります。

Bybit Exchangeリンクを直接ダウンロードしてインストールできないのはなぜですか?

Feb 21, 2025 pm 10:57 PM

Bybit Exchangeリンクを直接ダウンロードしてインストールできないのはなぜですか?

Feb 21, 2025 pm 10:57 PM

Bybit Exchangeリンクを直接ダウンロードしてインストールできないのはなぜですか? BYBITは、ユーザーにトレーディングサービスを提供する暗号通貨交換です。 Exchangeのモバイルアプリは、次の理由でAppStoreまたはGooglePlayを介して直接ダウンロードすることはできません。1。AppStoreポリシーは、AppleとGoogleがApp Storeで許可されているアプリケーションの種類について厳しい要件を持つことを制限しています。暗号通貨交換アプリケーションは、金融サービスを含み、特定の規制とセキュリティ基準を必要とするため、これらの要件を満たしていないことがよくあります。 2。法律と規制のコンプライアンス多くの国では、暗号通貨取引に関連する活動が規制または制限されています。これらの規制を遵守するために、BYBITアプリケーションは公式Webサイトまたはその他の認定チャネルを通じてのみ使用できます

セサミオープンドアトレーディングプラットフォームダウンロードモバイルバージョンgateioトレーディングプラットフォームのダウンロードアドレス

Feb 28, 2025 am 10:51 AM

セサミオープンドアトレーディングプラットフォームダウンロードモバイルバージョンgateioトレーディングプラットフォームのダウンロードアドレス

Feb 28, 2025 am 10:51 AM

アプリをダウンロードしてアカウントの安全を確保するために、正式なチャネルを選択することが重要です。

セサミオープンドアエクスチェンジウェブページログイン最新バージョンgateio公式ウェブサイトの入り口

Mar 04, 2025 pm 11:48 PM

セサミオープンドアエクスチェンジウェブページログイン最新バージョンgateio公式ウェブサイトの入り口

Mar 04, 2025 pm 11:48 PM

ログインステップやパスワード回復プロセスなど、セサミオープンエクスチェンジWebバージョンのログイン操作の詳細な紹介も、ログイン障害、ページを開くことができず、プラットフォームにスムーズにログインするのに役立つ検証コードを受信できません。

gate.io交換公式登録ポータル

Feb 20, 2025 pm 04:27 PM

gate.io交換公式登録ポータル

Feb 20, 2025 pm 04:27 PM

Gate.ioは、幅広い暗号資産と取引ペアを提供する主要な暗号通貨交換です。 gate.ioの登録は非常に簡単です。公式ウェブサイトにアクセスするか、「登録」をクリックし、登録フォームに入力し、電子メールを確認し、2因子検証(2FA)を設定する必要があります。登録を完了します。 gate.ioを使用すると、ユーザーは安全で便利な暗号通貨取引体験を楽しむことができます。

Binance Binance公式Webサイト最新バージョンログインポータル

Feb 21, 2025 pm 05:42 PM

Binance Binance公式Webサイト最新バージョンログインポータル

Feb 21, 2025 pm 05:42 PM

Binance Webサイトログインポータルの最新バージョンにアクセスするには、これらの簡単な手順に従ってください。公式ウェブサイトに移動し、右上隅の[ログイン]ボタンをクリックします。既存のログインメソッドを選択してください。「登録」してください。登録済みの携帯電話番号または電子メールとパスワードを入力し、認証を完了します(モバイル検証コードやGoogle Authenticatorなど)。検証が成功した後、Binance公式WebサイトLogin Portalの最新バージョンにアクセスできます。