AI はユーザーが考えていることを認識し、それを描画します。プロジェクト コードはオープンソースです。

SF 小説「三体問題」では、地球を占領しようとするトリソラ人には非常にユニークな設定が与えられています。彼らは脳波を通じて情報を共有し、思考と思考が透明です。陰謀的ではありません。彼らにとって、考えることと話すことは同じ言葉です。一方、人類は思考の不透明さを利用して「壁に向かう計画」を立て、ついにトリソララン人を欺くことに成功し、段階的な勝利を収めた。

そこで問題は、人間の思考は本当に完全に不透明なのかということです。いくつかの技術的手段の出現により、この質問に対する答えはそれほど絶対的ではないようです。多くの研究者が人間の思考の謎を解読し、脳信号の一部をテキスト、画像、その他の情報に解読しようとしています。

最近、2 つの研究チームが画像デコードの方向で同時に重要な進歩を遂げ、関連論文が CVPR 2023 に採択されました 。

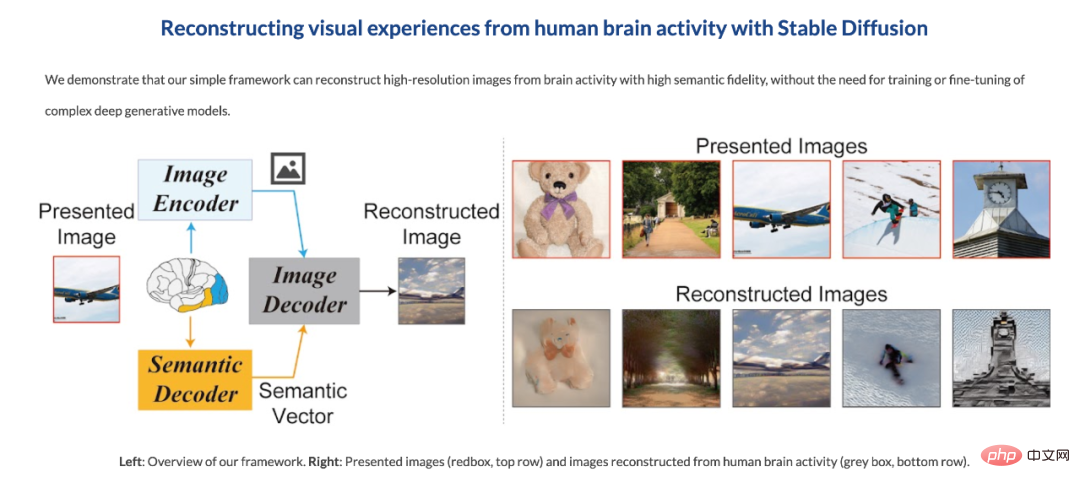

最初のチームは大阪大学で、最近非常に人気のある安定拡散を使用して、機能的磁気共鳴画像法 (fMRI) によって得られた人間の脳活動画像から脳活動パターンを再構成しています。解像度、高精度の画像 (「安定拡散は脳信号を読み取って画像を再現し、その研究は CVPR に受理されました」を参照)。

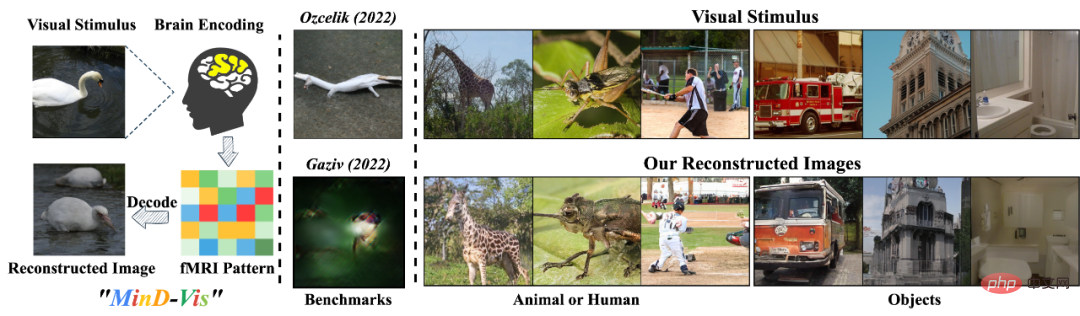

##偶然にも、ほぼ同時に、シンガポール国立大学、香港中文大学、そして香港中文大学の中国チームが参加しました。スタンフォード大学でも同様の結果が得られました。彼らは、「MinD-Vis」と呼ばれる人間の視覚デコーダを開発しました。これは、事前にトレーニングされたマスク モデリングと潜在拡散モデルを通じて fMRI データから直接デコードできます。これらの画像は、適度に詳細なだけでなく、画像のセマンティクスや特徴 (テクスチャや形状など) を正確に表現する画像を生成します。現在、この研究のコードはオープンソースです。

#論文のタイトル: 脳を超えて見る: ビジョン デコーディングのためのスパース マスク モデリングを使用した条件付き拡散モデル

- 論文リンク: http://arxiv.org/abs/2211.06956

- コードリンク: https://github.com/zjc062/mind-vis

- プロジェクトlink: https://mind-vis.github.io/

研究概要

「目に見えるものは、あなたが考えるものです。」人間の知覚と事前知識は脳内で密接に関係しています。私たちの世界の認識は、客観的な刺激だけでなく、経験によっても影響されます。これらの影響により、複雑な脳活動が形成されます。これらの脳活動を理解し、情報を解読することは認知神経科学の重要な目標の 1 つであり、視覚情報を解読することは困難な問題です。

機能的磁気共鳴画像法 (fMRI) は、画像カテゴリなどの視覚情報を回復するために一般的に使用される非侵襲的で効果的な方法です。

MinD-Vis の目的は、深層学習モデルを使用して fMRI データから視覚刺激を直接デコードする可能性を探ることです。

以前の方法が fMRI データから複雑な神経活動を直接デコードする場合、{fMRI - 画像} のペアリングや効果的な生物学的誘導が欠如しているため、再構成された画像は通常不鮮明で意味的に意味がありません。 。したがって、脳活動と視覚刺激との関係を確立するのに役立つ fMRI 表現を効果的に学習することは重要な課題です。

さらに、個人差が問題を複雑にするため、大規模なデータセットから表現を学習し、fMRI から条件付き合成を生成する際の制約を緩和する必要があります。

したがって、著者は、自己教師あり学習 (プレテキストタスクを使用した自己教師あり学習) と大規模な生成モデルを使用することで、モデルを微調整できると考えています。比較的小さなデータ セットで、コンテキストに関する知識と驚くべき生成能力を備えています。 スパースコードマスク脳モデリング (SC-MBM) は、脳の特徴を効果的に視覚的にデコードするための、生物学的に誘導された事前訓練済み学習者として提案されています。

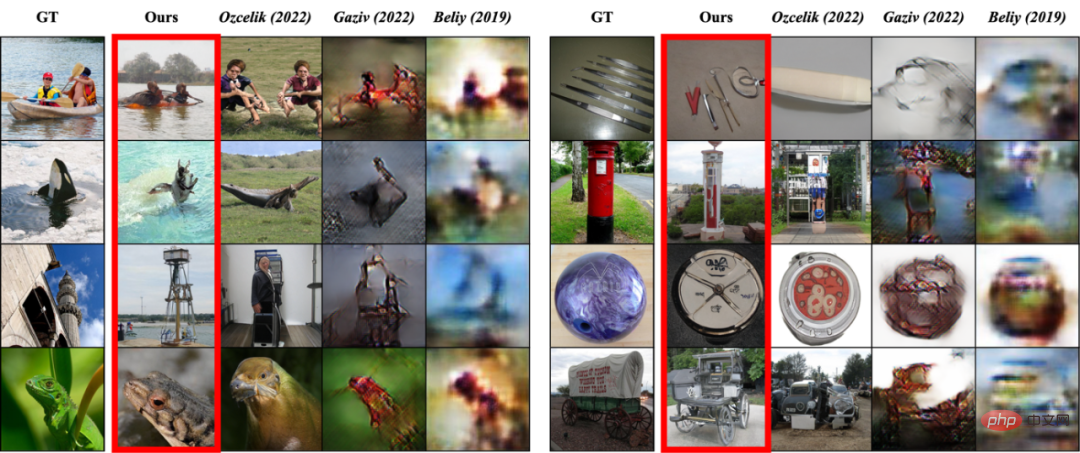

#以前の方法との比較 - 生成品質

#以前の方法との比較 - 生成品質

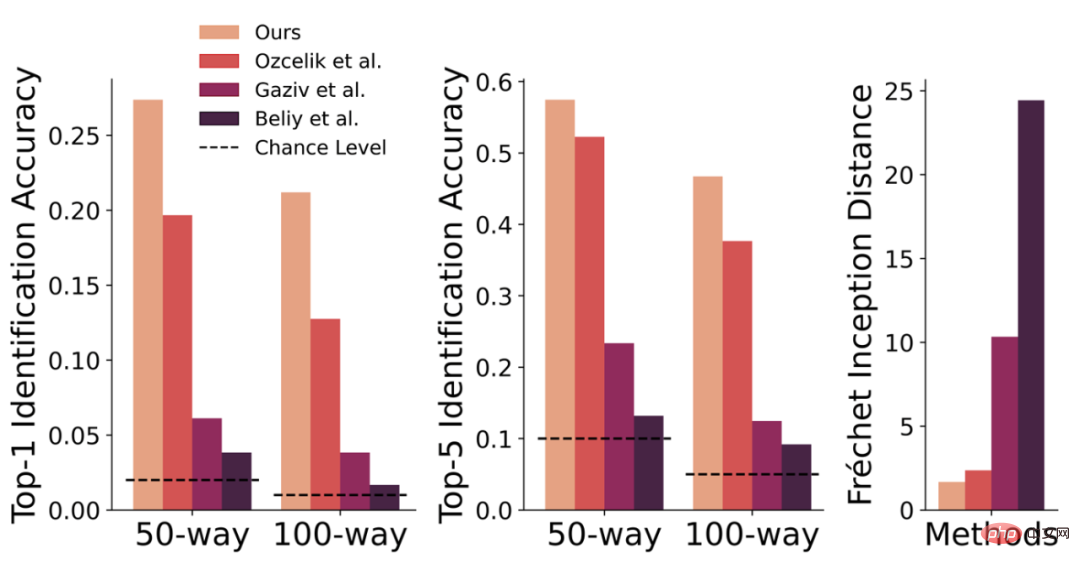

##従来手法との比較 – 評価指標の定量的比較

##従来手法との比較 – 評価指標の定量的比較

#大規模生成モデルの自己教師あり学習{fMRI - 画像} ペアの収集は非常に高価で時間がかかるため、このタスクは常にデータ アノテーションの欠如に悩まされてきました。さらに、各データセットと各個人のデータには特定のドメイン オフセットがあります。

このタスクでは、研究者らは脳活動と視覚刺激の間の関係を確立し、それによって対応する画像情報を生成することを目的としました。

これを行うために、彼らは自己教師あり学習と大規模な生成モデルを使用しました。彼らは、このアプローチにより、比較的小さなデータセットでモデルを微調整し、状況に応じた知識と驚くべき生成機能を獲得できると信じています。

MinD-Vis フレームワーク

以下では、MinD-Vis フレームワークを詳しく紹介し、設計の理由や考え方を紹介します。

fMRI データには次のような特徴と問題があります。

fMRI は 3D ボクセル (ボクセル) を使用して脳血中酸素濃度の相関を測定します (太字)を変更して、脳活動の変化を観察します。隣接するボクセルの振幅は多くの場合類似しており、fMRI データに空間的冗長性が存在することを示しています。

fMRI データを計算する場合、通常、関心領域 (ROI) が抽出され、データは 1D ベクトルに変換されます。このタスクでは、脳の視覚野からの信号のみを抽出するため、ボクセル数(約 4000)は画像のピクセル数(256*256*3)に比べてはるかに少なく、このようなデータはデータとはなりません。緯度の点で処理される画像データと通常の画像データの使用方法にはかなりのギャップがあります。

- 個人差、実験計画の違い、脳信号の複雑さにより、各データセットと各個人のデータには一定のドメインシフトが発生します。

- 固定された視覚刺激の場合、研究者はモデルによって復元された画像が意味的に一貫していることを望んでいますが、個人差により、この視覚刺激に対する反応は人それぞれ異なります。また、モデルによって復元されたイメージが意味的に一貫していることも期待されており、モデルにある程度のばらつきと柔軟性があることが望まれます。

- これらの問題に対処するために、MinD-Vis は 2 つの段階で構成されています。

クロスアテンション コンディショニングとタイムステップ コンディショニングを通じて事前トレーニングされた fMRI エンコーダと LDM を統合し、条件付き合成のダブル コンディショニングを実行します。次に、ペアの {fMRI, Image} を使用して、LDM のクロス アテンション ヘッドを共同で微調整します。

- これら 2 つの手順については、ここで詳しく説明します。

-

MinD-Vis の概要

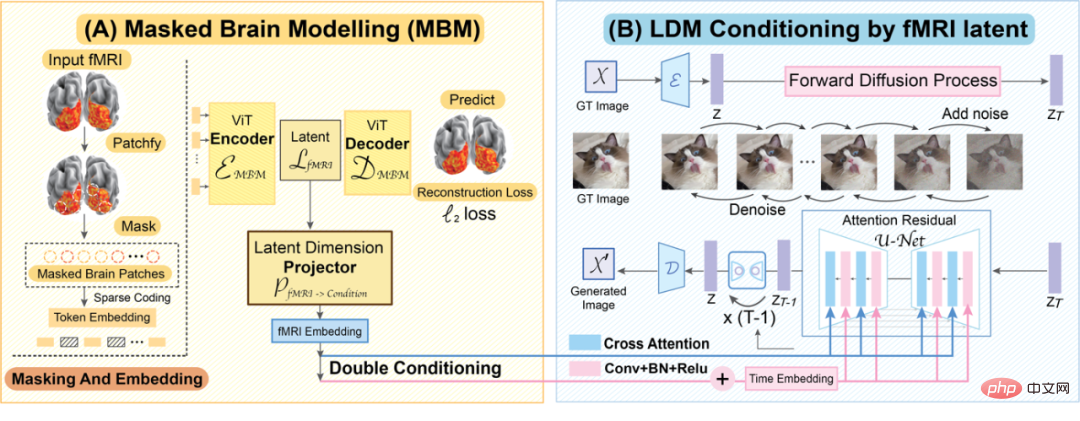

(A) スパースコーディングされたマスクド脳モデリング (SC-MBM) (MinD-Vis の概要は左)

fMRI の空間情報の冗長性により、たとえ大部分はマスクされていますが、fMRI データは引き続き復元できます。したがって、MinD-Vis の最初の段階では、計算時間を節約するために fMRI データのほとんどがマスクされます。ここで、著者はマスクされたオートエンコーダと同様のアプローチを使用します。

- fMRI ボクセルをパッチに分割します

- パッチ サイズと同じものを使用します。ステップ サイズ 1D 畳み込み層を埋め込みに変換します

- #残りの fMRI パッチを位置埋め込みに追加し、ビジョン トランスフォーマーの入力として使用します #Decoding 再構築されたデータを取得します

- 再構築されたデータと元のデータの間の損失を計算します

- バックプロパゲーションを通じてモデルを最適化し、再構築されたデータを作成します可能な限りデータを元のデータと同様にします

- 手順 2 ~ 6 を繰り返して最終モデルをトレーニングします

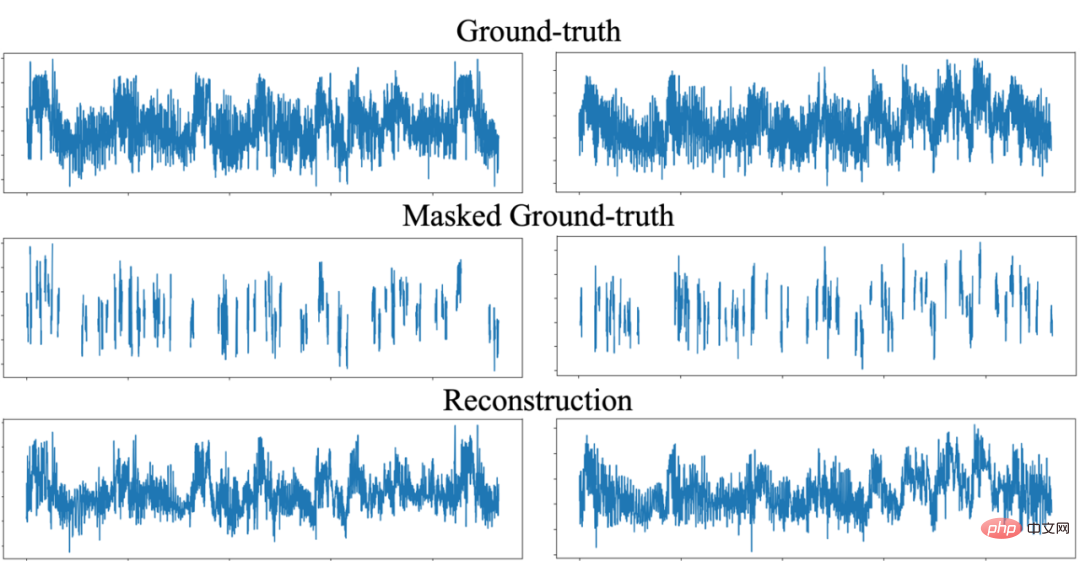

##SC-MBM はマスクされた fMRI 情報を効果的に復元できます

この設計は次のようなものですマスク オートエンコーダーとの違いは何ですか?

マスク モデリングを自然画像に適用する場合、モデルでは通常、1 以上の埋め込み対パッチ サイズの比率が使用されます。- このタスクでは、著者は比較的大きな埋め込みとパッチ サイズの比率を使用しました。これにより、情報容量が大幅に増加し、fMRI 用に大きな表現空間が作成されます。脳内情報のスパースエンコーディングにも対応した設計*。

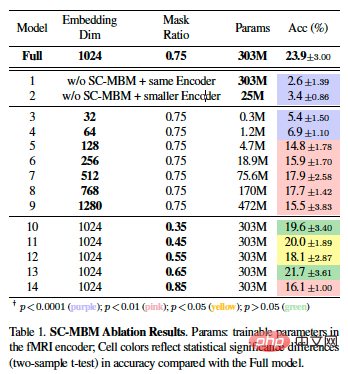

#SC-MBM のアブレーション実験

(B) Double-Conditioned LDM (DC-LDM) (MinD-Vis 概要右)

大規模な実験はステージ A で実行されました。コンテキスト学習により、fMRI エンコーダは fMRI データを局所性制約のあるスパース表現に変換できます。ここで、著者らは復号化タスクを条件付き生成問題として定式化し、事前トレーニングされた LDM を使用してこの問題を解決します。

#LDM は、条件付き情報として fMRI データ z を使用して画像の潜在空間を操作します。目標は、逆拡散を通じて画像を形成する方法を学習することです。プロセス。

- 画像生成タスクでは、多様性と一貫性は相反する目標であり、画像に対する fMRI は生成の一貫性により依存します。

- 生成の一貫性を確保するために、著者はクロスアテンション コンディショニングとタイム ステップ コンディショニングを組み合わせ、UNet の中間層に時間埋め込みを備えた条件付きメカニズムを使用します。

- 彼らは、最適化目標式を二重調整交互式にさらに再定式化しました。

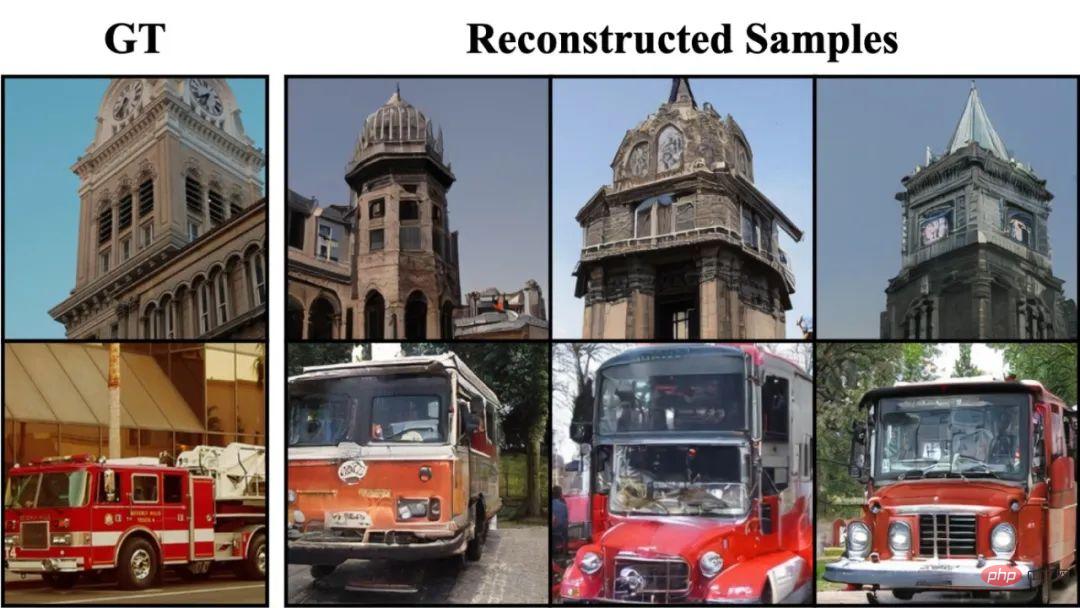

#さまざまなランダム状態の画像を複数回デコードすることで、この方法の安定性を実証します。

微調整

fMRI エンコーダーは SC-MBM によって事前トレーニングされた後、ダブルコンディショニングによって事前にトレーニングされた LDM が統合されます。ここで、著者:

- 畳み込み層を使用してエンコーダの出力を潜在次元にマージします。

- fMRI エンコーダ、クロス アテンション ヘッド、プロジェクション ヘッドを共同で最適化します。 ;

- #クロスアテンションヘッドの微調整は、事前訓練されたコンディショニング空間と fMRI 潜在空間を接続する鍵です;

- fMRI 画像をピアに渡した後、最終的な微調整のプロセスで、大容量の fMRI 表現を通じて、fMRI と画像特徴間のより明確な関係が学習されます。

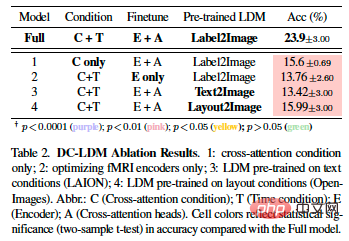

DC-LDMのアブレーション実験

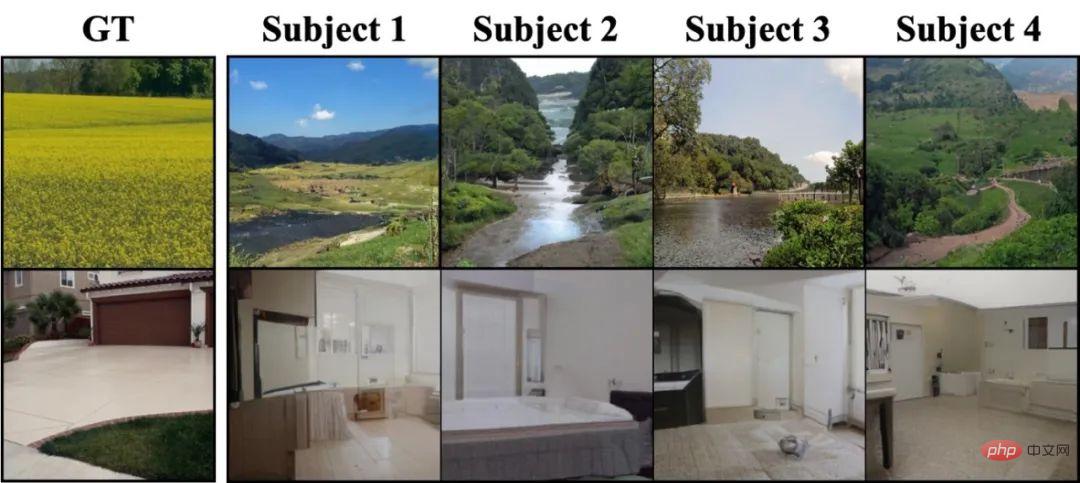

追加の詳細驚くべきことに、MinD-Vis は、グラウンド トゥルース画像には実際には存在しないものの、画像の内容に非常に関連のある一部の詳細をデコードできます。たとえば、写真が自然風景の場合、MinD-Vis は川と青空をデコードし、住宅の場合、MinD-Vis は同様の室内装飾をデコードします。これには利点と欠点の両方があります。良いことは、これが私たちが想像したものをデコードできることを示していることですが、悪い点は、これがデコード結果の評価に影響を与える可能性があることです。

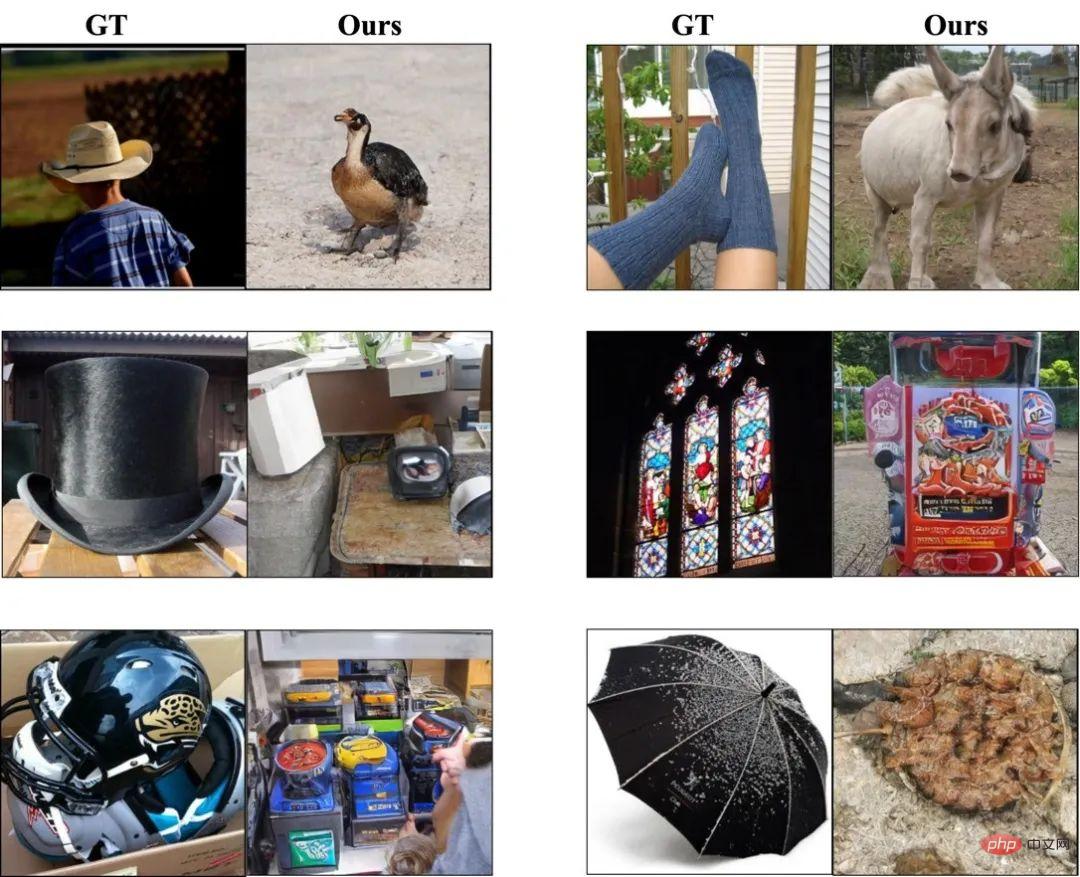

##お気に入りのロールオーバーのコレクション

著者は、学習サンプルの数が少ない場合、刺激を解読する難易度が異なると考えています。たとえば、GOD データセットには、衣服よりも多くの動物の訓練サンプルが含まれています。これは、意味的に「furry」に似た単語は、衣服ではなく動物としてデコードされる可能性が高いことを意味します。上の図では、靴下が羊としてデコードされています。

実験設定

データセット

ここで、著者は 3 つの公開データ セットを使用しました。- 事前トレーニングの第 1 段階: Human Connectome プロジェクトを使用しました。これは、136,000 個の fMRI データ セグメントを提供します。画像はなく、fMRI のみが提供されます。

- エンコーダーと第 2 段階生成モデルの微調整: Generic Object Decoding Dataset (GOD) および Brain, Object, Landscape Dataset (BOLD5000) データセットが使用されました。これら 2 つのデータ セットは、それぞれ 1250 と 5254 の {fMRI, Image} ペアを提供し、そのうち 50 と 113 がそれぞれテスト セットとして取得されました。

この記事のモデル構造(ViTと拡散モデル)の設計は主に過去の文献を参考にしています。モデルパラメータの詳細については本文を参照してください。同様に、非対称アーキテクチャも採用しています。エンコーダは意味のある fMRI 表現を学習することを目的とし、デコーダは不明瞭なパッチを予測しようとします。したがって、以前の設計に従ってデコーダを小さくし、事前トレーニング後に破棄します。

評価指標

以前の文献と同様に、著者は意味論を評価するために n-way の上位 1 位と上位 5 位の分類精度も使用しました。結果の正確さ。これは、ランダムに選択された n-1 個のカテゴリと、複数の試行にわたる正しいカテゴリの上位 1 位と上位 5 位の分類精度を計算することで結果を評価する方法です。以前のアプローチとは異なり、ここでは、手作りの特徴を使用する代わりに、事前にトレーニングされた ImageNet1K 分類器を使用して、生成された画像の意味論的な正しさを判断する、より直接的で複製可能な評価方法を採用しています。さらに、生成された画像の品質を評価するための基準としてフレシェ開始距離 (FID) を使用しました。ただし、データセット内の画像の数が限られているため、FID は画像の分布を完全には評価できない場合があります。 ###############効果#########

この記事の実験は個人レベルで行われます。つまり、モデルは同じ個人でトレーニングおよびテストされます。以前の文献との比較のために、GOD データセットの 3 番目の被験者の結果をここで報告し、他の被験者の結果を付録にリストします。

最後に書きました

このプロジェクトを通じて、著者はfMRIによる人間の脳の視覚情報の復元の実現可能性を実証しました。しかし、この分野には、個人間の差異をより適切に処理する方法、デコードにおけるノイズや干渉の影響を軽減する方法、fMRI デコードと他の神経科学技術を組み合わせて、人間の脳の仕組みと機能をより包括的に理解します。同時に、人間の脳と個人のプライバシーを取り巻く倫理的および法的問題をより深く理解し、尊重する必要もあります。

さらに、このテクノロジーを実用的なアプリケーションに変えるために、医療や人間とコンピューターのインタラクションなど、より幅広い応用シナリオを探求する必要もあります。医療分野では、fMRI デコード技術は将来、視覚障害者、聴覚障害者、さらには全身麻痺の患者などの特殊なグループが思考を解読できるようにするために使用される可能性があります。これらの人々は身体障害があるため、従来のコミュニケーション方法では自分の考えや願望を表現することができません。 fMRI 技術を使用することで、科学者は彼らの脳活動を解読して彼らの考えや願望にアクセスし、より自然かつ効率的にコミュニケーションできるようになります。ヒューマン コンピューター インタラクションの分野では、fMRI デコード テクノロジを使用して、より自然で効率的なヒューマン コンピューター インタラクション エクスペリエンスを実現するためにユーザーの脳活動をデコードするなど、よりインテリジェントで適応性のあるヒューマン コンピューター インターフェイスおよび制御システムを開発できます。

私たちは、大規模なデータセットと大規模なモデルのコンピューティング能力のサポートにより、fMRI デコードがより広範囲かつ広範囲に影響を及ぼし、認知神経科学と人工知能の開発を促進すると信じています。知性を発展させます。

注: *スパースコーディングを使用して脳内で視覚刺激表現を学習するための生物学的基礎: スパースコーディングは、感覚情報の表現戦略として提案されています。研究によると、視覚刺激は視覚皮質でまばらにコード化されており、これにより情報伝達効率が向上し、脳の冗長性が低下します。 fMRI を使用すると、視覚野で収集された少量のデータから自然シーンの視覚内容を再構成できます。スパース コーディングは、コンピューター ビジョンで効率的にコーディングする方法です。この記事では、fMRI データを小さなブロックに分割して局所性制約を導入し、各小さなブロックを高次元ベクトル空間にまばらにエンコードする SC-MBM 法について言及しました。これは、生物学的に効果的かつ効率的な脳特徴学習器として使用できます。 、視覚的なエンコードとデコードに使用されます。

以上がAI はユーザーが考えていることを認識し、それを描画します。プロジェクト コードはオープンソースです。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7471

7471

15

15

1377

1377

52

52

77

77

11

11

19

19

30

30

Laravelの地理空間:インタラクティブマップと大量のデータの最適化

Apr 08, 2025 pm 12:24 PM

Laravelの地理空間:インタラクティブマップと大量のデータの最適化

Apr 08, 2025 pm 12:24 PM

700万のレコードを効率的に処理し、地理空間技術を使用したインタラクティブマップを作成します。この記事では、LaravelとMySQLを使用して700万を超えるレコードを効率的に処理し、それらをインタラクティブなマップの視覚化に変換する方法について説明します。最初の課題プロジェクトの要件:MySQLデータベースに700万のレコードを使用して貴重な洞察を抽出します。多くの人は最初に言語をプログラミングすることを検討しますが、データベース自体を無視します。ニーズを満たすことができますか?データ移行または構造調整は必要ですか? MySQLはこのような大きなデータ負荷に耐えることができますか?予備分析:キーフィルターとプロパティを特定する必要があります。分析後、ソリューションに関連している属性はわずかであることがわかりました。フィルターの実現可能性を確認し、検索を最適化するためにいくつかの制限を設定しました。都市に基づくマップ検索

MySQLを解決する方法は開始できません

Apr 08, 2025 pm 02:21 PM

MySQLを解決する方法は開始できません

Apr 08, 2025 pm 02:21 PM

MySQLの起動が失敗する理由はたくさんあり、エラーログをチェックすることで診断できます。一般的な原因には、ポートの競合(ポート占有率をチェックして構成の変更)、許可の問題(ユーザー許可を実行するサービスを確認)、構成ファイルエラー(パラメーター設定のチェック)、データディレクトリの破損(テーブルスペースの復元)、INNODBテーブルスペースの問題(IBDATA1ファイルのチェック)、プラグインロード障害(エラーログのチェック)が含まれます。問題を解決するときは、エラーログに基づいてそれらを分析し、問題の根本原因を見つけ、問題を防ぐために定期的にデータをバックアップする習慣を開発する必要があります。

インストール後にMySQLの使用方法

Apr 08, 2025 am 11:48 AM

インストール後にMySQLの使用方法

Apr 08, 2025 am 11:48 AM

この記事では、MySQLデータベースの操作を紹介します。まず、MySQLWorkBenchやコマンドラインクライアントなど、MySQLクライアントをインストールする必要があります。 1. mysql-uroot-pコマンドを使用してサーバーに接続し、ルートアカウントパスワードでログインします。 2。CreatedAtaBaseを使用してデータベースを作成し、データベースを選択します。 3. createTableを使用してテーブルを作成し、フィールドとデータ型を定義します。 4. INSERTINTOを使用してデータを挿入し、データをクエリし、更新することでデータを更新し、削除してデータを削除します。これらの手順を習得することによってのみ、一般的な問題に対処することを学び、データベースのパフォーマンスを最適化することでMySQLを効率的に使用できます。

mysqlはjsonを返すことができますか

Apr 08, 2025 pm 03:09 PM

mysqlはjsonを返すことができますか

Apr 08, 2025 pm 03:09 PM

MySQLはJSONデータを返すことができます。 json_extract関数はフィールド値を抽出します。複雑なクエリについては、Where句を使用してJSONデータをフィルタリングすることを検討できますが、そのパフォーマンスへの影響に注意してください。 JSONに対するMySQLのサポートは絶えず増加しており、最新バージョンと機能に注意を払うことをお勧めします。

MySQLはダウンロード後にインストールできません

Apr 08, 2025 am 11:24 AM

MySQLはダウンロード後にインストールできません

Apr 08, 2025 am 11:24 AM

MySQLのインストール障害の主な理由は次のとおりです。1。許可の問題、管理者として実行するか、SUDOコマンドを使用する必要があります。 2。依存関係が欠落しており、関連する開発パッケージをインストールする必要があります。 3.ポート競合では、ポート3306を占めるプログラムを閉じるか、構成ファイルを変更する必要があります。 4.インストールパッケージが破損しているため、整合性をダウンロードして検証する必要があります。 5.環境変数は誤って構成されており、環境変数はオペレーティングシステムに従って正しく構成する必要があります。これらの問題を解決し、各ステップを慎重に確認して、MySQLを正常にインストールします。

リモートシニアバックエンジニア(プラットフォーム)がサークルが必要です

Apr 08, 2025 pm 12:27 PM

リモートシニアバックエンジニア(プラットフォーム)がサークルが必要です

Apr 08, 2025 pm 12:27 PM

リモートシニアバックエンジニアの求人事業者:サークル場所:リモートオフィスジョブタイプ:フルタイム給与:$ 130,000- $ 140,000職務記述書サークルモバイルアプリケーションとパブリックAPI関連機能の研究開発に参加します。ソフトウェア開発ライフサイクル全体をカバーします。主な責任は、RubyonRailsに基づいて独立して開発作業を完了し、React/Redux/Relay Front-Endチームと協力しています。 Webアプリケーションのコア機能と改善を構築し、機能設計プロセス全体でデザイナーとリーダーシップと緊密に連携します。肯定的な開発プロセスを促進し、反復速度を優先します。 6年以上の複雑なWebアプリケーションバックエンドが必要です

酸性特性を理解する:信頼できるデータベースの柱

Apr 08, 2025 pm 06:33 PM

酸性特性を理解する:信頼できるデータベースの柱

Apr 08, 2025 pm 06:33 PM

データベース酸属性の詳細な説明酸属性は、データベーストランザクションの信頼性と一貫性を確保するための一連のルールです。データベースシステムがトランザクションを処理する方法を定義し、システムのクラッシュ、停電、または複数のユーザーの同時アクセスの場合でも、データの整合性と精度を確保します。酸属性の概要原子性:トランザクションは不可分な単位と見なされます。どの部分も失敗し、トランザクション全体がロールバックされ、データベースは変更を保持しません。たとえば、銀行の譲渡が1つのアカウントから控除されているが別のアカウントに増加しない場合、操作全体が取り消されます。 TRANSACTION; updateaccountssetbalance = balance-100wh

マスターSQL制限条項:クエリの行数を制御する

Apr 08, 2025 pm 07:00 PM

マスターSQL制限条項:クエリの行数を制御する

Apr 08, 2025 pm 07:00 PM

sqllimit句:クエリ結果の行数を制御します。 SQLの制限条項は、クエリによって返される行数を制限するために使用されます。これは、大規模なデータセット、パジネートされたディスプレイ、テストデータを処理する場合に非常に便利であり、クエリ効率を効果的に改善することができます。構文の基本的な構文:SelectColumn1、column2、... FromTable_nameLimitnumber_of_rows; number_of_rows:返された行の数を指定します。オフセットの構文:SelectColumn1、column2、... FromTable_nameLimitoffset、number_of_rows; offset:skip