ゲイリー・マーカスはヒントンとマスクに公の場で叫んだ:ディープラーニングは壁にぶつかっている、私は10万ドルを賭ける

「誰かが(ディープラーニングが)壁にぶつかったと言ったら、その人がしなければならないのは、ディープラーニングでできないことのリストを作ることだけです。5年以内に、私たちはディープラーニングがそれを証明できるでしょう。」

6 月 1 日、隠遁生活を送るジェフリー ヒントンが、カリフォルニア大学バークレー校のピーター アッベール教授のポッドキャストにゲストとして出演しました。二人は、マスクされた自動エンコーダ、AlexNet からスパイキング ニューラル ネットワークに至るまで、90 分間会話を交わしました。 、など待ってください。

番組の中で、ヒントン氏は「ディープラーニングは壁にぶつかっている」という見方に明確に疑問を呈しました。

「ディープラーニングは壁に突き当たっている」という発言は、著名な AI 学者ゲイリー・マーカス氏による 3 月の記事から来ています。正確に言うと、「純粋なエンドツーエンドの深層学習」はほぼ終わりを迎えており、AI 分野全体が新しい活路を見つけなければならないと彼は考えています。

出口はどこですか? Gary Marcus 氏によると、シンボル処理には大きな将来性があります。しかし、この見解はコミュニティによって真剣に受け止められたことはなく、ヒントン氏は以前、「シンボル処理手法へのいかなる投資も大きな間違いである。」とさえ述べていました。ゲイリー・マーカス。

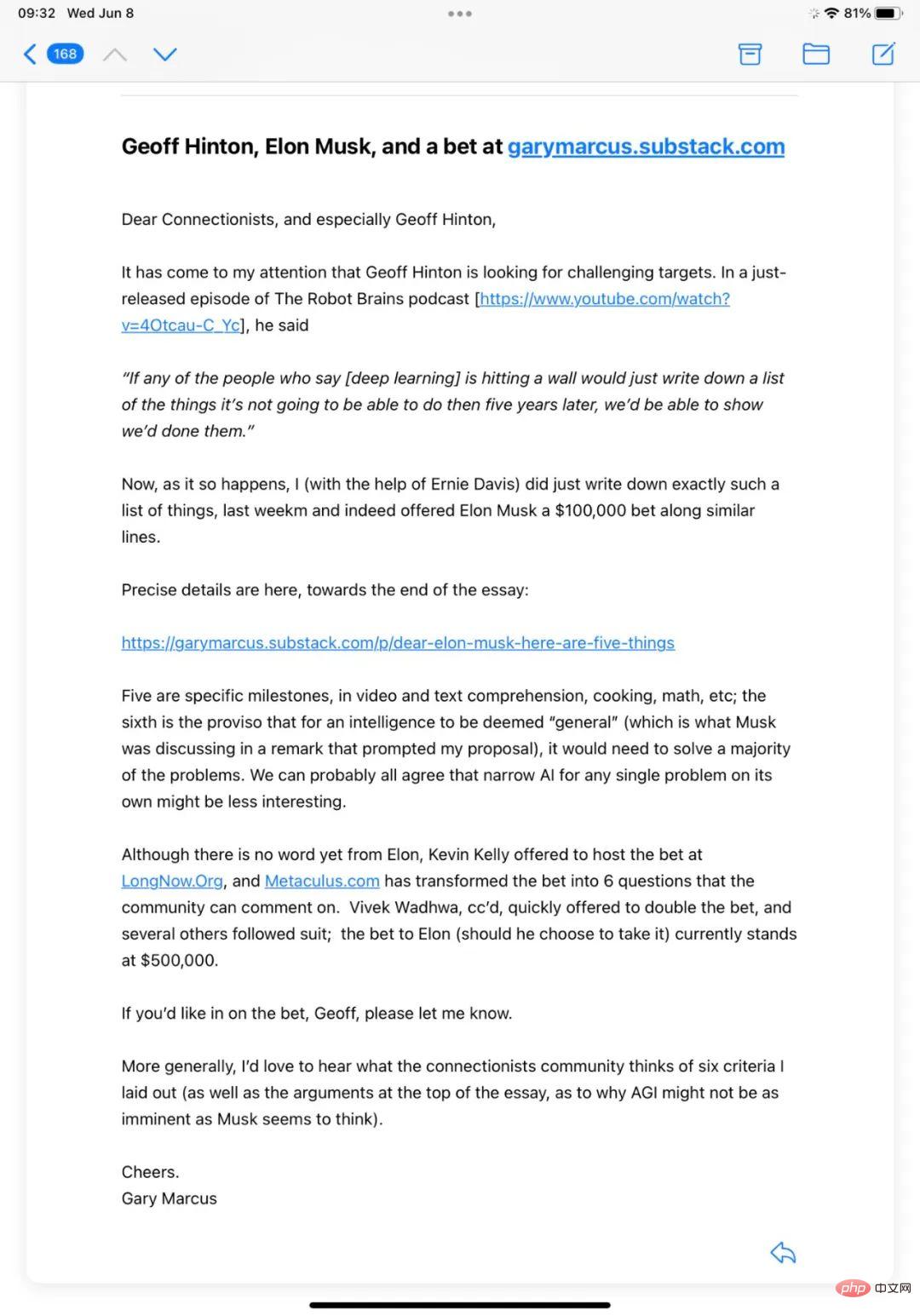

つい十数時間前、ゲイリー・マーカスはTwitterでジェフリー・ヒントンに公開書簡を送りました:

その書簡にはこう書かれていました:「ジェフリー・ヒントンがこうしていることに気づきました」 「私はいくつかの挑戦的なターゲットを探していました。私は実際にアーニー・デイビスの助けを借りてそのようなリストを書き、先週マスクに10万ドルの賭けをしました。」

その書簡にはこう書かれていました:「ジェフリー・ヒントンがこうしていることに気づきました」 「私はいくつかの挑戦的なターゲットを探していました。私は実際にアーニー・デイビスの助けを借りてそのようなリストを書き、先週マスクに10万ドルの賭けをしました。」

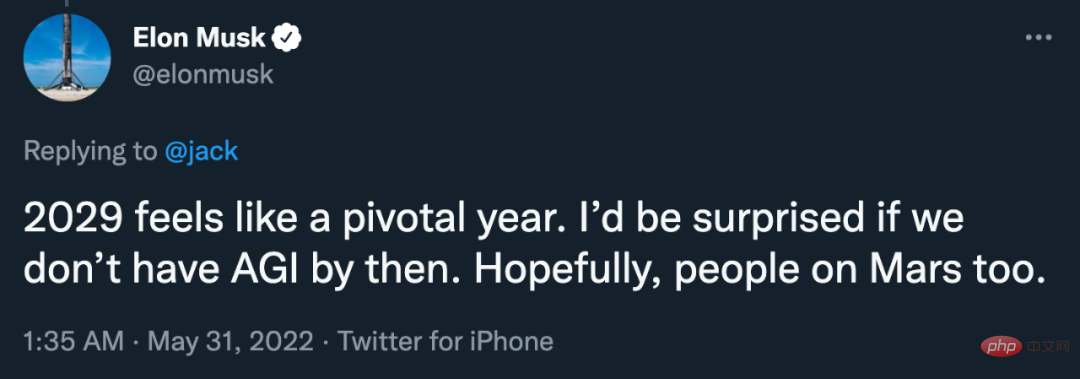

ここでマスクに何が起こっているのでしょうか?きっかけは5月末のツイートから始まる。

マスク氏との10万ドルの賭け

長い間、人々はAGIとは宇宙の旅(HAL)やアイアンマン(JARVIS)などの映画で描かれている種類のAIであると理解していました。 )。特定のタスクのために訓練される現在の AI とは異なり、AGI は人間の脳に近く、タスクを完了する方法を学習できます。

ほとんどの専門家は、AGI の実現には数十年かかると信じていますが、中には目標が決して達成されないと信じている人もいます。この分野の専門家を対象とした調査では、2099 年までに AGI を達成できる可能性は 50% であると推定されています。

対照的に、マスク氏はより楽観的であるように見え、ツイッターで公の場で次のように表現したことさえあった。「2029年は重要な年だ。それまでにAGIを達成できなかったら驚くだろう。火星に願いを。同じことが地球上の人々にも当てはまるだろう」

ゲイリー・マーカスは反対の意を表明したが、すぐにこう尋ねた。「いくら賭けてもいいですか?」

ゲイリー・マーカスは反対の意を表明したが、すぐにこう尋ねた。「いくら賭けてもいいですか?」

マスク氏はこの質問には答えなかったが、ゲイリー・マーカス氏は、10万ドルの金額でロングベットでゲームをセットアップできると言い続けた。

ゲイリー・マーカス氏の見解では、マスク氏の関連する見解は信頼できるものではありません:「たとえば、あなたは2015年に完全自動運転車を実現するには2年かかると言いました。それ以来、あなたはほぼ毎年言ってきました。それらはすべて自動運転車です」同じことを言っていますが、完全な自動運転はまだ実現していません。」

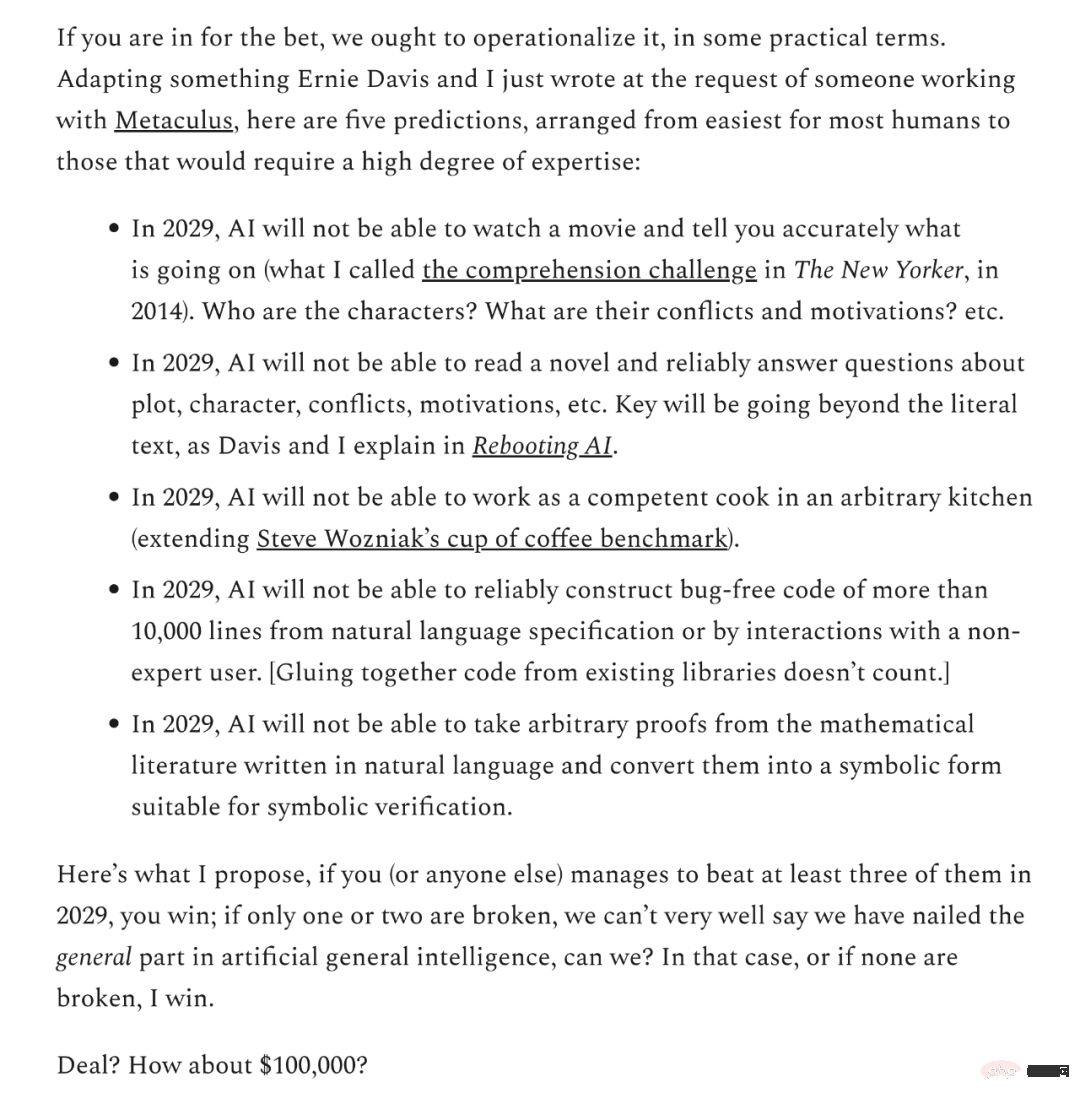

彼はまた、賭けとして、AGI が実現できるかどうかをテストするための 5 つの基準をブログに書きました:

2029 年には、AI は映画を読んで何が起こっているのか (登場人物が誰であるか、彼らの葛藤や動機が何であるかなど) を正確に伝えることができなくなります;

- 2029 年に、AI は小説を読んで確実に伝えることができる プロット、登場人物、対立、動機などに関する質問に答えることができる;

- 2029 年には、AI はどのキッチンでも有能なシェフとして機能できなくなるでしょう;

- 2029 年には、AI は自然言語仕様を介した通信や、専門家以外のユーザーとの対話によるバグのないコードを 10,000 行以上確実に構築できなくなります (既存のライブラリからコードを結合することはカウントされません)。 ;

- 2029 年、AI は自然言語で書かれた数学文献から始めることはできませんそこから証拠を取得し、記号検証に適した記号形式に変換します。

「あなた (または他の誰か) が 2029 年にそれを達成できた場合の私のアドバイスは、少なくとも 3 つです」 ##########################################、たとえ勝ったとしても。取引? 10万ドルはどうですか?」

より多くの人々の追求により、この賭けの金額は500,000ドルに増加しました。しかし、今のところマスク氏は応じていない。

ゲイリー・マーカス: AGI はあなたが思っているほど「近く」ではありません

6 月 6 日、ゲイリー・マーカスは、Scientific American に記事を掲載し、自身の見解を繰り返し述べました。あなた。

一般の人にとって、人工知能の分野では大きな進歩が見られるように見えます。メディアの報道の中では、OpenAI の DALL-E 2 はあらゆるテキストを画像に変換できるようで、GPT-3 は全能であり、5 月にリリースされた DeepMind の Gato システムはあらゆるタスクで良好なパフォーマンスを発揮します…ある DeepMind 上級幹部は、開始したとさえ自慢していました。人間と同じレベルの知能を持つ汎用人工知能 (AGI) の探求...

だまされないでください。機械はいつか人間と同じくらい賢くなるかもしれないし、もしかしたらそれ以上に賢くなるかもしれないが、今日ではそこまでには程遠い。現実世界を真に理解し推論するマシンを作成するには、やるべきことがまだたくさんあります。今私たちが本当に必要としているのは、気取った態度を減らし、基礎研究を増やすことです。

確かに、AI はいくつかの分野で確かに進歩しています。合成画像はますますリアルに見え、音声認識は騒がしい環境でも機能します。しかし、普遍的な人間レベルの AI には程遠いです。まだまだ長い道のりです。たとえば、人工知能は記事やビデオの本当の意味をまだ理解できず、予期せぬ障害や中断に対処することもできません。私たちは依然として、AI を信頼できるものにするという、AI が長年抱えてきた課題に直面しています。

ガトーを例に挙げると、野球を投げる投手の画像にタイトルを追加するというタスクが与えられると、システムは 3 つの異なる答えを返します。「野球選手が野球場で投げる」、「男性が投げる」 「ピッチャーが野球場で野球を投げる」および「野球の試合で野球選手が打者とキャッチャーに野球を投げる」。最初の答えは正しいですが、他の 2 つは画像に表示されていない追加のプレーヤーが含まれているようです。これは、Gato システムが画像に実際に何が含まれているかを認識しているのではなく、ほぼ類似した画像の典型的なものを認識していることを示唆しています。野球ファンなら誰でも、これがボールを投げたばかりの投手であることがわかります。近くに捕手と打者がいると予想されますが、画像には明らかに彼らがいません。

DALL-E 2 も同様に、「青い立方体の上にある赤い立方体」と「赤い立方体」という 2 つの位置関係を混同します。赤いキューブの上に「ブルーキューブ」。同様に、Googleが5月にリリースしたImagenモデルでは、「馬に乗った宇宙飛行士」と「馬に乗った宇宙飛行士」を区別できなかった。

DALL-E のようなシステムが故障すると、まだ少し面白いと思うかもしれませんが、一部の AI システムは、故障すると非常に深刻な問題を引き起こす可能性があります。たとえば、自動運転のテスラは最近、道路の真ん中で一時停止の標識を持っている作業員に向かって直接走行し、速度を落とす前に人間のドライバーが介入する必要がありました。自動運転システムは人間を認識し、一時停止の標識を自動的に認識することはできましたが、この 2 つの異常な組み合わせに遭遇した場合には速度を落とすことができませんでした。

したがって、残念なことに、AI システムは依然として信頼性が低く、新しい環境にすぐに適応することが困難です。

Gato は、DeepMind によって報告されたすべてのタスクで良好なパフォーマンスを発揮しましたが、他の現代システムほど優れたパフォーマンスを発揮することはほとんどありませんでした。 GPT-3 は流暢な散文を書くことがよくありますが、基本的な算術を習得するのがまだ難しく、現実の理解があまりにも浅いため、「一部の専門家は、靴下を食べると脳の状態を変えるのに役立つと信じています。 「。」

この背後にある問題は、人工知能分野の最大の研究チームがもはや学術機関ではなく、大手テクノロジー企業であることです。大学とは異なり、企業には公正に競争するインセンティブがありません。彼らの新しい論文は学術的審査なしに報道機関を通じて発表されたため、メディア報道や査読の回避につながりました。私たちが得る情報は、企業自体が私たちに知ってもらいたいものだけです。

ソフトウェア業界には、このビジネス戦略を表す「デモウェア」という特別な言葉があります。これは、ソフトウェアの設計が展示用には適しているが、必ずしも現実世界には適していないことを意味します。

そして、このようにして販売される AI 製品は、スムーズにリリースできないか、実際にはめちゃくちゃです。

ディープ ラーニングは、機械がデータ パターンを識別する能力を向上させますが、それには 3 つの大きな欠陥があります: 学習されたパターンは概念的なものではなく表面的なものであること、生成された結果の解釈が難しいこと、そして一般化することが難しいことです。ハーバード大学のコンピュータ科学者レ ヴァリアン氏が指摘したように、「将来の中心的な課題は、AI の学習と推論の形式を統一することです。」

現在、企業は新しいアイデアを生み出すことよりも、ベンチマークを超えることを追求しています。より根本的な問題について立ち止まって考えるのではなく、小さな改善を目指します。

華やかな商品陳列を追求するのではなく、「学習と推論を同時に行えるシステムを構築するにはどうすればよいか」といった基本的な質問をする人がもっと必要です。

AGI に関する議論は終わりには程遠く、他の研究者も参加しています。研究者のスコット・アレクサンダーは、ゲイリー・マーカスは伝説であり、彼が過去数年間に書いたことは多かれ少なかれ完全に正確であるが、それでも価値があるとブログで指摘した。

たとえば、Gary Marcus は以前 GPT-2 のいくつかの問題を批判していましたが、8 か月後に GPT-3 が誕生したときに、これらの問題は解決されました。しかし、Gary Marcus は GPT-3 に容赦はせず、「OpenAI の言語ジェネレーターは、何について話しているのかわからない。」という記事まで書きました。

本質的に言えば、1 つの観点が現時点では正しいです。 「ゲイリー・マーカスは大規模な言語モデルをからかいましたが、これらのモデルはますます良くなり、この傾向が続けば、AGI はすぐに実現されるでしょう。」

以上がゲイリー・マーカスはヒントンとマスクに公の場で叫んだ:ディープラーニングは壁にぶつかっている、私は10万ドルを賭けるの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7489

7489

15

15

1377

1377

52

52

77

77

11

11

19

19

41

41

phpmyAdminはデータテーブルを作成します

Apr 10, 2025 pm 11:00 PM

phpmyAdminはデータテーブルを作成します

Apr 10, 2025 pm 11:00 PM

phpMyAdminを使用してデータテーブルを作成するには、次の手順が不可欠です。データベースに接続して、[新しいタブ]をクリックします。テーブルに名前を付けて、ストレージエンジンを選択します(InnoDB推奨)。列名、データ型、null値、その他のプロパティを許可するかどうかなど、列の追加ボタンをクリックして列の詳細を追加します。一次キーとして1つ以上の列を選択します。 [保存]ボタンをクリックして、テーブルと列を作成します。

Oracleデータベースの作成方法Oracleデータベースを作成する方法

Apr 11, 2025 pm 02:33 PM

Oracleデータベースの作成方法Oracleデータベースを作成する方法

Apr 11, 2025 pm 02:33 PM

Oracleデータベースを作成するのは簡単ではありません。根本的なメカニズムを理解する必要があります。 1.データベースとOracle DBMSの概念を理解する必要があります。 2。SID、CDB(コンテナデータベース)、PDB(プラグ可能なデータベース)などのコアコンセプトをマスターします。 3。SQL*Plusを使用してCDBを作成し、PDBを作成するには、サイズ、データファイルの数、パスなどのパラメーターを指定する必要があります。 4.高度なアプリケーションは、文字セット、メモリ、その他のパラメーターを調整し、パフォーマンスチューニングを実行する必要があります。 5.ディスクスペース、アクセス許可、パラメーター設定に注意し、データベースのパフォーマンスを継続的に監視および最適化します。 それを巧みに習得することによってのみ、継続的な練習が必要であることは、Oracleデータベースの作成と管理を本当に理解できます。

Oracleデータベースの作成方法Oracleデータベースの作成方法

Apr 11, 2025 pm 02:36 PM

Oracleデータベースの作成方法Oracleデータベースの作成方法

Apr 11, 2025 pm 02:36 PM

Oracleデータベースを作成するには、一般的な方法はDBCAグラフィカルツールを使用することです。手順は次のとおりです。1。DBCAツールを使用してDBNAMEを設定してデータベース名を指定します。 2. SyspasswordとSystemPassWordを強力なパスワードに設定します。 3.文字セットとNationalCharactersetをAL32UTF8に設定します。 4.実際のニーズに応じて調整するようにMemorySizeとTableSpacesizeを設定します。 5. logfileパスを指定します。 高度な方法は、SQLコマンドを使用して手動で作成されますが、より複雑でエラーが発生しやすいです。 パスワードの強度、キャラクターセットの選択、表空間サイズ、メモリに注意してください

Oracleデータベースステートメントの作成方法

Apr 11, 2025 pm 02:42 PM

Oracleデータベースステートメントの作成方法

Apr 11, 2025 pm 02:42 PM

Oracle SQLステートメントのコアは、さまざまな条項の柔軟なアプリケーションと同様に、選択、挿入、更新、削除です。インデックスの最適化など、ステートメントの背後にある実行メカニズムを理解することが重要です。高度な使用法には、サブクエリ、接続クエリ、分析関数、およびPL/SQLが含まれます。一般的なエラーには、構文エラー、パフォーマンスの問題、およびデータの一貫性の問題が含まれます。パフォーマンス最適化のベストプラクティスには、適切なインデックスの使用、Select *の回避、条項の最適化、およびバインドされた変数の使用が含まれます。 Oracle SQLの習得には、コードライティング、デバッグ、思考、基礎となるメカニズムの理解など、練習が必要です。

mysqlデータテーブルフィールド操作ガイドの追加、変更、削除方法ガイド

Apr 11, 2025 pm 05:42 PM

mysqlデータテーブルフィールド操作ガイドの追加、変更、削除方法ガイド

Apr 11, 2025 pm 05:42 PM

MySQLのフィールド操作ガイド:フィールドを追加、変更、削除します。フィールドを追加:table table_nameを変更するcolumn_name data_type [not null] [default default_value] [プライマリキー] [auto_increment]フィールドの変更:column_name data_typeを変更するcolumn_name data_type [not null] [default default_value] [プライマリキー]

MySQLデータベースのネストされたクエリインスタンスの詳細な説明

Apr 11, 2025 pm 05:48 PM

MySQLデータベースのネストされたクエリインスタンスの詳細な説明

Apr 11, 2025 pm 05:48 PM

ネストされたクエリは、1つのクエリに別のクエリを含める方法です。これらは主に、複雑な条件を満たし、複数のテーブルを関連付け、要約値または統計情報を計算するデータを取得するために使用されます。例には、平均賃金を超える従業員を見つけること、特定のカテゴリの注文を見つけること、各製品の総注文量の計算が含まれます。ネストされたクエリを書くときは、サブ征服を書き、結果を外側のクエリ(エイリアスまたは条項として参照)に書き込み、クエリパフォーマンスを最適化する必要があります(インデックスを使用)。

Oracleデータベーステーブルの整合性の制約は何ですか?

Apr 11, 2025 pm 03:42 PM

Oracleデータベーステーブルの整合性の制約は何ですか?

Apr 11, 2025 pm 03:42 PM

Oracleデータベースの整合性の制約により、以下を含むデータの精度を確保できます。NULL:NULL値は禁止されています。一意:単一のヌル値を許可する一意性を保証します。一次キー:一次キーの制約、一意を強化し、ヌル値を禁止します。外部キー:テーブル間の関係を維持する、外部キーはプライマリテーブルのプライマリキーを参照します。チェック:条件に応じて列の値を制限します。

オラクルは何をしますか

Apr 11, 2025 pm 06:06 PM

オラクルは何をしますか

Apr 11, 2025 pm 06:06 PM

Oracleは、世界最大のデータベース管理システム(DBMS)ソフトウェア会社です。その主な製品には、次の機能が含まれます。リレーショナルデータベース管理システム(Oracle Database)開発ツール(Oracle Apex、Oracle Visual Builder)ミドルウェア(Oracle Weblogic Server、Oracle SOA Suite)Cloud Service(Oracle Cloud Infrastructure)Cloud ServiceおよびBusiness Intelligence(Oracle Analytics Cloud、Oracle Essbase)Blockchain(Oracle Blockchain Pla