画質による視覚認識の妨げを懸念、DAMOアカデミーがより堅牢なフレームワークを提案

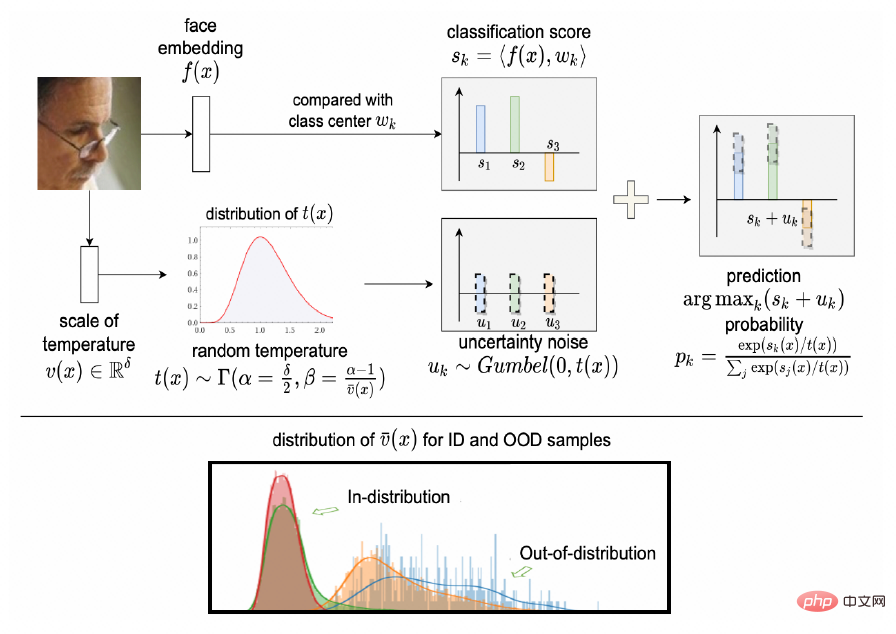

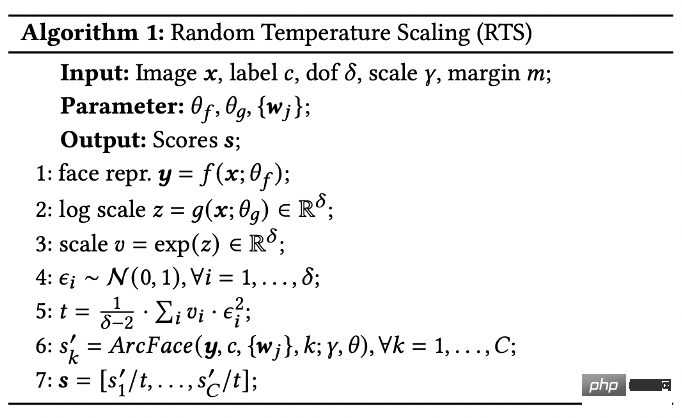

この記事では、機械学習に関するトップの国際会議である AAAI 2023 に採択された論文「Improving Training and Inference of Face Recognition Models via Random Speed Scaling」を紹介します。この論文は、温度調整パラメータと分類損失関数における分類不確実性の間の内部関係を確率論的な観点から革新的に分析し、分類損失関数の温度調整係数がガンベル分布に従う不確実性変数のスケール係数であることを明らかにしました。したがって、特徴抽出の信頼性をモデル化するために、RTS と呼ばれる新しいトレーニング フレームワークが提案されています。 RTS トレーニング フレームワークに基づいて、より信頼性の高い認識モデルがトレーニングされ、トレーニング プロセスがより安定し、展開中にサンプルの不確実性の測定スコアを提供して、不確実性の高いサンプルを拒否し、より堅牢な視覚認識システムの構築に役立ちます。広範な実験により、RTS が安定してトレーニングし、不確実性の尺度を出力して堅牢な視覚認識システムを構築できることが示されました。

- 紙のアドレス: https://arxiv.org/abs/2212.01015

- #オープンソース モデル: https://modelscope.cn/models/damo/cv_ir_face-recognition-ood_rts/summary#背景

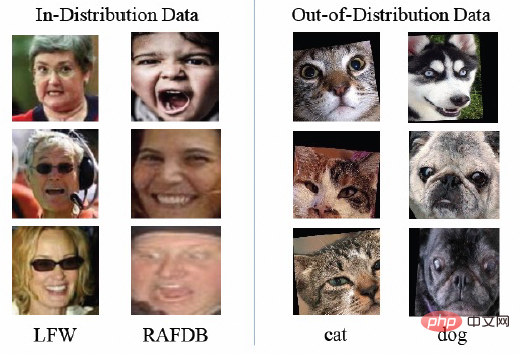

視覚認識システムは通常、実際のシーンでさまざまな干渉に遭遇します。例: オクルージョン (装飾または複雑な前景)、イメージング ブラー (フォーカス ブラーまたはモーション ブラー)、極端な照明 (露出オーバーまたは露出不足など)。これらの干渉はノイズの影響として要約できますが、さらに猫の顔や犬の顔などの画像の誤検出もあり、これらの誤検出データは分布外 (OOD) データと呼ばれます。視覚認識においては、前述のノイズやOODデータが不確実性の源となり、影響を受けるサンプルは深度モデルに基づいて抽出された特徴量に不確実性を重畳し、視覚認識システムに干渉を引き起こします。たとえば、ベースライブラリ画像が不確実な干渉を持つサンプルによって汚染されている場合、「特徴ブラックホール」が形成され、視覚認識システムに隠れた危険をもたらします。したがって、表現の信頼性をモデル化する必要があります。 特性評価信頼性モデリングに関する関連研究

従来のマルチモデル ソリューション従来の視覚認識リンクの信頼性を制御する方法は、独立した品質モデルを通じて行われます。典型的な画質モデリング方法は次のとおりです:

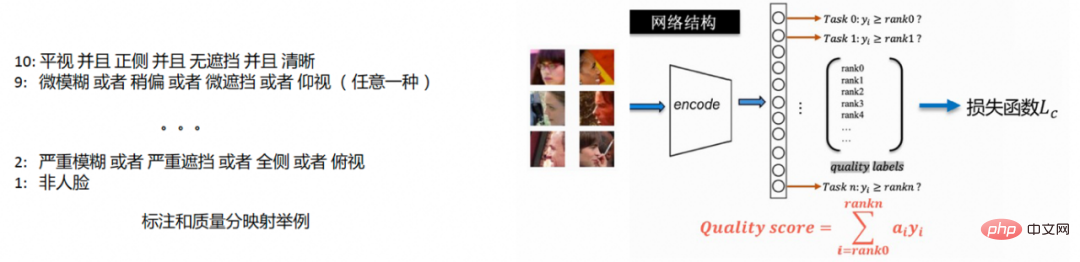

1. 注釈データを収集し、明瞭さ、オクルージョンの有無、姿勢など、品質に影響を与える特定の要素に注釈を付けます。

2. 影響因子のラベルに従って、品質スコアを 1 から 10 までマッピングします。スコアが高いほど、品質は高くなります。具体的な例については、例を参照してください。下の図の左側にあります。

3. 最初の 2 つのステップで品質スコアのアノテーションを取得した後、順序回帰トレーニングを実行して、図の右側の例に示すように、導入フェーズ中の品質スコアを予測します。下の図。

#独立した品質モデル ソリューションでは、視覚認識リンクに新しいモデルを導入する必要があり、トレーニングは以下に依存します。注釈情報。

#独立した品質モデル ソリューションでは、視覚認識リンクに新しいモデルを導入する必要があり、トレーニングは以下に依存します。注釈情報。

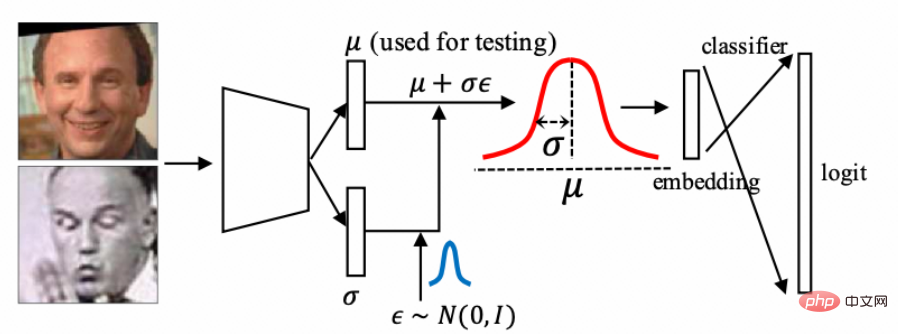

DUL

不確実性モデリング手法には、「顔認識におけるデータ不確実性学習」が含まれます。はガウス分布の平均と分散の合計として計算され、不確実性を含む特徴はトレーニングのために後続の分類器に送信されます。したがって、画質に関連する不確実性スコアは展開段階で取得できます。

DUL は、不確実性を記述するために加算法を使用します。ノイズ推定のスケールも、ノイズ推定のスケールと同じです。特定の種類のデータ。特徴分布は密接に関係しています。データの分布が比較的密である場合、DUL によって推定されるノイズの規模も比較的小さくなります。 OOD 分野の研究では、データ分布の密度は OOD を識別するための適切な指標ではないことが指摘されています。

DUL は、不確実性を記述するために加算法を使用します。ノイズ推定のスケールも、ノイズ推定のスケールと同じです。特定の種類のデータ。特徴分布は密接に関係しています。データの分布が比較的密である場合、DUL によって推定されるノイズの規模も比較的小さくなります。 OOD 分野の研究では、データ分布の密度は OOD を識別するための適切な指標ではないことが指摘されています。

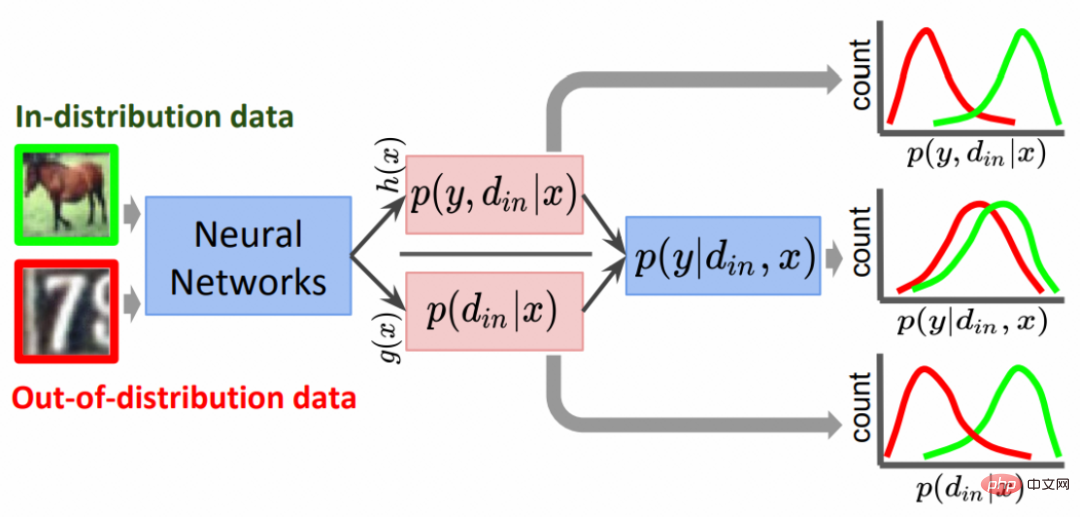

ゴディン

OOD 分野の研究「一般化 odin: 分布外データから学習せずに分布外画像を検出する」では、2 つの独立したブランチを使用して、同時確率分布の形式を使用して OOD データを処理します。 h(x)とg(x)は分類確率値と温度調整値を推定します。 温度値は確率値としてモデル化され、範囲は 0 ~ 1 に制限されているため、温度のモデル化は適切ではありません。 上記の問題と関連研究を考慮して、この論文は確率の観点から開始し、温度調整係数と分類における不確実性の関係を研究します。損失関数 分析後、RTS トレーニング フレームワークが提案されます。

方法

確率的観点に基づく体温調節因子の分析

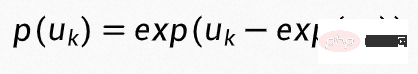

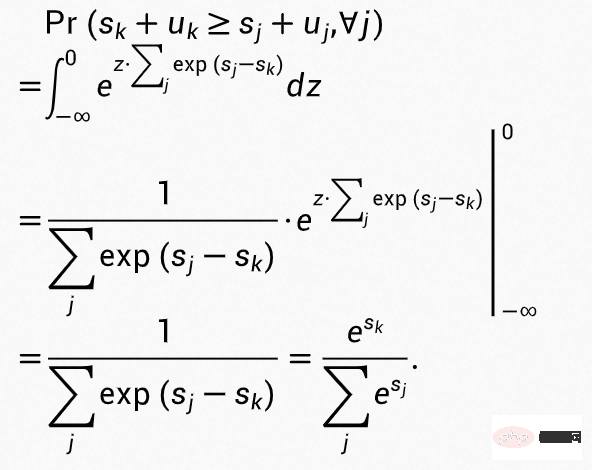

#まず、温度調整係数と不確かさの関係を分析します。 不確実性 が標準ガンベル分布に準拠する確率変数であると仮定すると、確率密度関数は  # のように記述できます。

# のように記述できます。

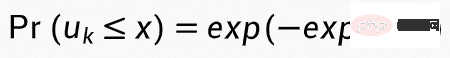

累積分布関数は # であり、クラス k に分類される

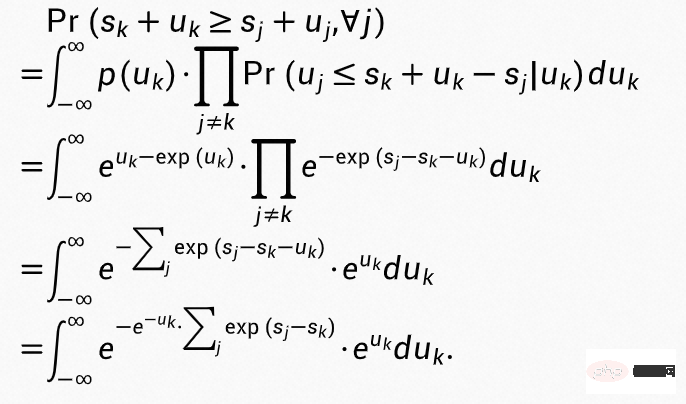

累積分布関数は # であり、クラス k に分類される  の確率値は次のとおりです:

の確率値は次のとおりです:

を上の式に代入すると、次のようになります:

##k クラスに分類された確率値は、softmax 関数に従うスコアであることがわかります。同時に、t を使用してスケールを調整することができます。不確実性、つまり、標準ガンベル分布に準拠します。

##k クラスに分類された確率値は、softmax 関数に従うスコアであることがわかります。同時に、t を使用してスケールを調整することができます。不確実性、つまり、標準ガンベル分布に準拠します。

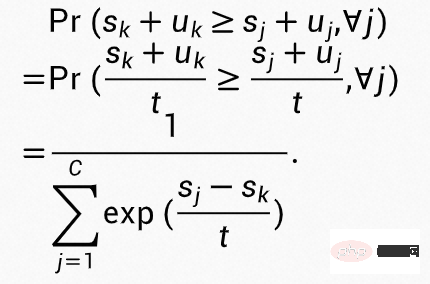

確率値が次のように分類されることがわかります。このときのクラス k は、温度調整値 t Score のソフトマックス関数と一致します。

確率値が次のように分類されることがわかります。このときのクラス k は、温度調整値 t Score のソフトマックス関数と一致します。

モデリング温度

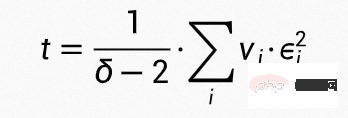

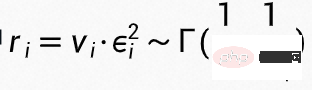

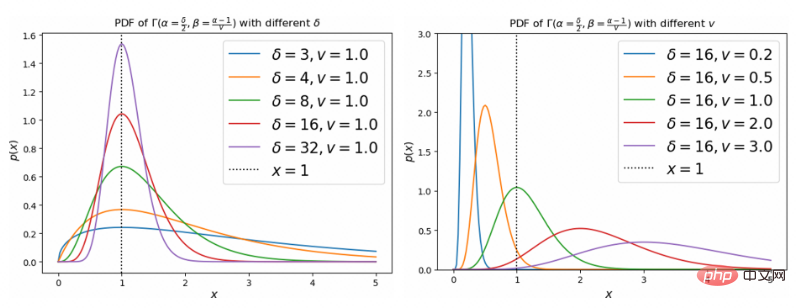

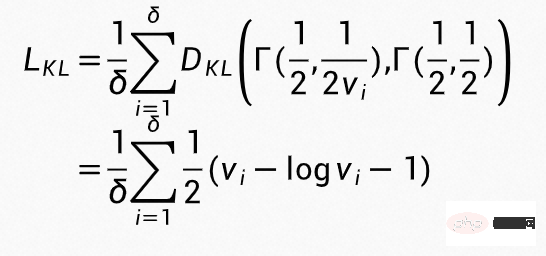

分類に対する不確実性推定の影響を軽減するには、温度 t が 1 に近い必要があるため、温度 t を ## に従うように、beta = frac {alpha - 1 } {v})$ 分布。 v と  独立したガンマ分布変数の合計としてモデル化します。 :

独立したガンマ分布変数の合計としてモデル化します。 : where

where 、t が

、t が

が分布に与える影響は以下のとおりです。

が分布に与える影響は以下のとおりです。

##トレーニング方法

さらに詳細な分析と理論的証明については、論文を参照してください。

さらに詳細な分析と理論的証明については、論文を参照してください。

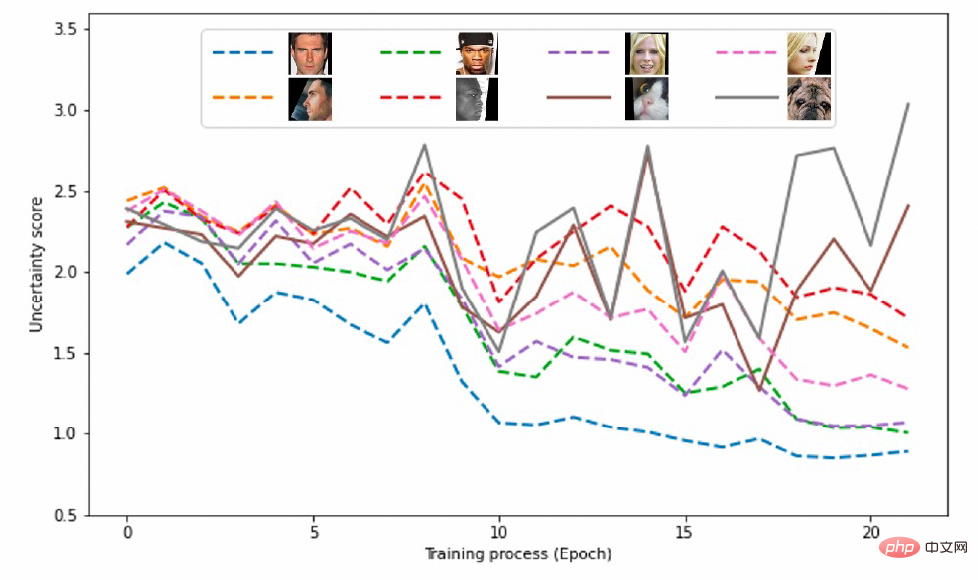

トレーニング フェーズでは、トレーニング データには顔のトレーニング データのみが含まれます。誤って検出された猫の顔と犬の顔の OOD データは、テスト中に OOD データの認識効果を検証するために使用されます。このテストは、トレーニング プロセスのさまざまな段階での OOD サンプルの不確実性の動的なプロセスを示しています。

トレーニング フェーズ

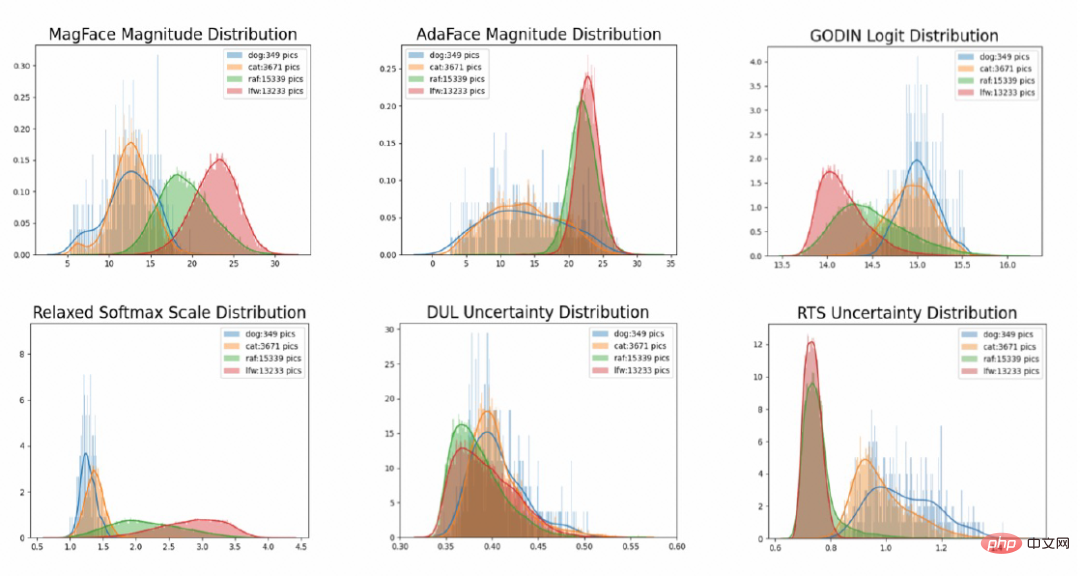

分布内データ (顔) と分布外データを描画します。異なるエポック番号におけるデータ (猫の顔と犬の顔が誤って顔として検出されたもの) の不確実性スコアを比較した結果、以下の図から、初期段階ではすべてのサンプルの不確実性スコアがより大きな値付近に分布し、その後はトレーニングが進むと、OOD サンプルの不確実性が徐々に増加し、顔データの不確実性が徐々に減少します。顔の品質が良くなるほど、不確実性は低くなります。 IDデータとOODデータは閾値を設定することで区別でき、画質は不確実性スコアに反映されます。

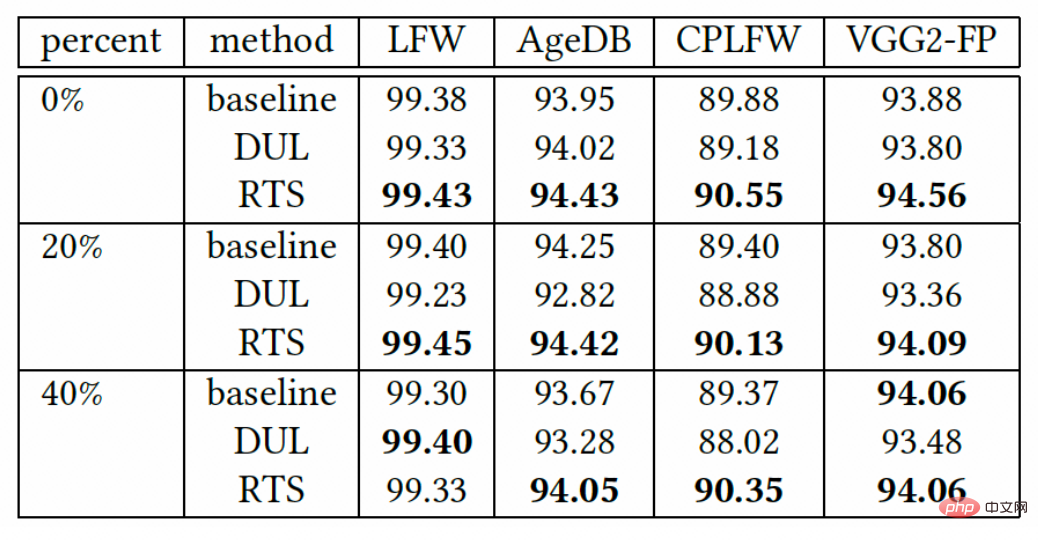

#トレーニング段階でのノイズの多いトレーニング データに対する堅牢性を説明するため。この記事では、さまざまな割合のノイズをトレーニング セットに適用します。さまざまな割合のノイズ トレーニング データに基づくモデル認識効果は次のとおりです。RTS は、ノイズ データに基づくトレーニングでもより良い認識結果を達成できることがわかります。

展開フェーズ

画像以下は、展開フェーズ中に RTS フレームワークによって取得された不確実性スコアが顔の品質と高い相関関係があることを示しています

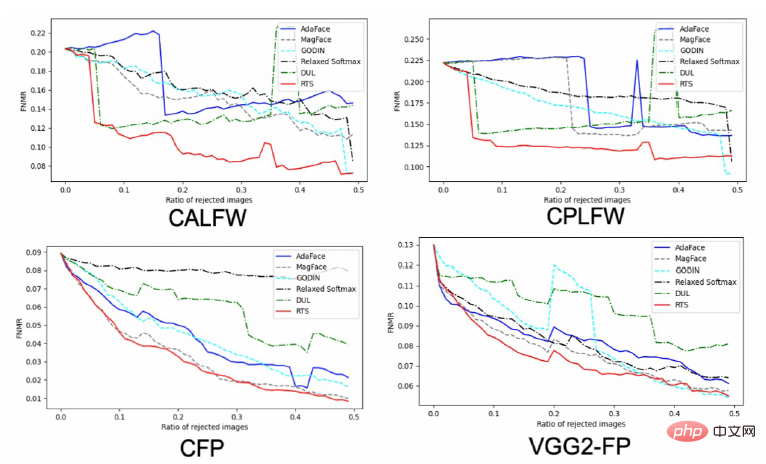

同時に、低品質のサンプルを除去した後のエラーマッチング曲線がベンチマーク上にプロットされます。得られた不確実性スコアに基づいて、ベンチマークの不確実性が高いサンプルを不確実性の高いものから低いものへ順に除去し、残りのサンプルの誤差マッチング曲線を描画します。以下の図からわかるように、不確実性の高いサンプルがより多くフィルタリングされると、誤一致は少なくなり、同じ数の不確実性サンプルが除去されると、RTS の誤一致は少なくなります。

#OOD サンプルに対する不確実性スコアの識別効果を検証するために、流通中のデータセットを使用しました。テスト中に構築されたデータセット(顔)と配布外のデータセット(誤って顔として検出された猫の顔と犬の顔)。データサンプルは以下の通りです。

#RTS の効果を 2 つの側面から説明します。まず不確かさの分布図を描くと、下図のように RTS 法は OOD データに対して強い識別能力を持っています。

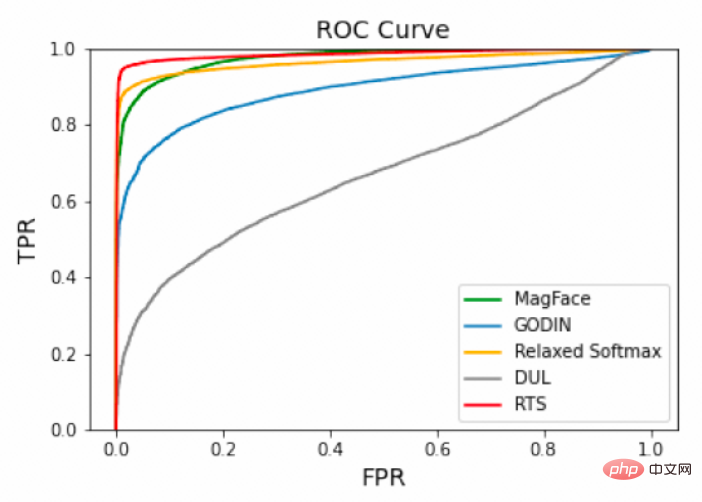

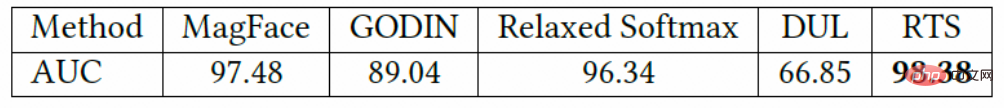

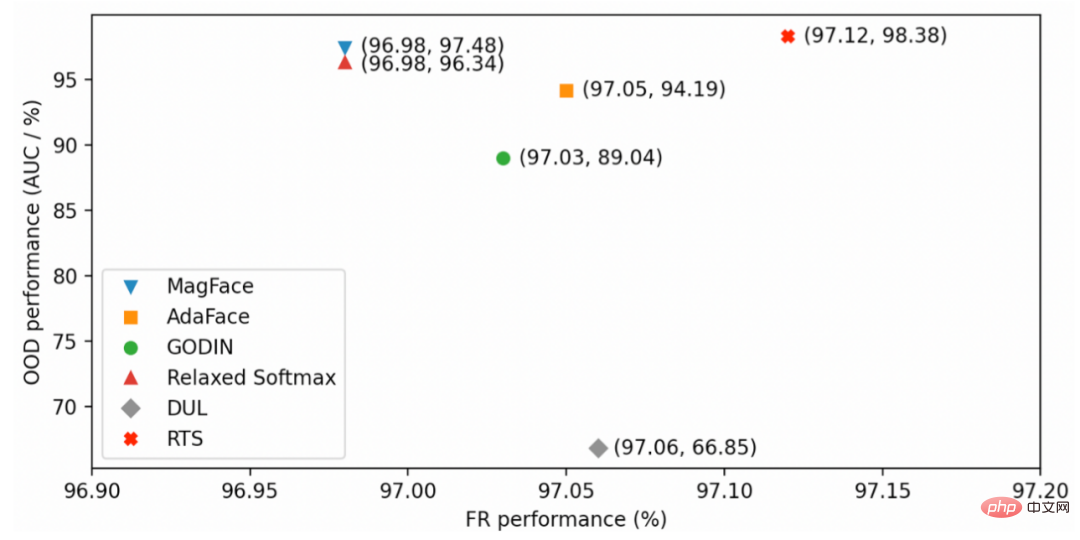

同時に、OOD テスト セットの ROC 曲線も描画され、その AUC 値はご覧のとおり、ROC 権限が計算されました。RTS の不確実性スコアにより、OOD データをより適切に識別できます。

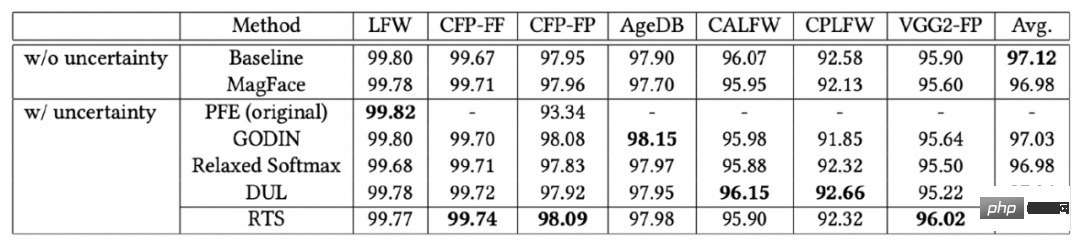

ベンチマークで一般的な認識能力をテストするために、RTS は顔認識能力に影響を与えることなく OOD データの認識能力を高めます。 RTS アルゴリズムを使用すると、識別と OOD データ識別においてバランスの取れた結果を達成できます。

#適用

1.https://modelscope.cn/models/damo/cv_resnet50_face-detection_retinaface/summary

#2.https://modelscope.cn/models/damo/cv_resnet101_face-detection_cvpr22papermogface/summary

3.https://modelscope.cn/models/damo/cv_manual_face-detection_tinymog/summary

4.https://modelscope. cn/models/damo/cv_manual_face-detection_ulfd /summary

5.https://modelscope.cn/models/damo/cv_manual_face-detection_mtcnn/summary

6.https:/ /modelscope.cn/models/damo/cv_resnet_face-recognition_facemask/summary

7.https://modelscope.cn/models/damo/cv_ir50_face -recognition_arcface/summary

8. https://modelscope.cn/models/damo/cv_manual_face-liveness_flir/summary

9.https ://modelscope.cn/models/damo/cv_manual_face-liveness_flrgb/summary

10.https://modelscope.cn/models/damo/cv_manual_facial-landmark-confidence_flcm/summary

11.https://modelscope.cn/models/damo/cv_vgg19_facial-expression-recognition_fer/summary

12.https:// modelscope.cn/models/damo/cv_resnet34_face -attribute-recognition_fairface/summary

以上が画質による視覚認識の妨げを懸念、DAMOアカデミーがより堅牢なフレームワークを提案の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1677

1677

14

14

1431

1431

52

52

1334

1334

25

25

1280

1280

29

29

1257

1257

24

24

CUDA の汎用行列乗算: 入門から習熟まで!

Mar 25, 2024 pm 12:30 PM

CUDA の汎用行列乗算: 入門から習熟まで!

Mar 25, 2024 pm 12:30 PM

General Matrix Multiplication (GEMM) は、多くのアプリケーションやアルゴリズムの重要な部分であり、コンピューター ハードウェアのパフォーマンスを評価するための重要な指標の 1 つでもあります。 GEMM の実装に関する徹底的な調査と最適化は、ハイ パフォーマンス コンピューティングとソフトウェア システムとハードウェア システムの関係をより深く理解するのに役立ちます。コンピューター サイエンスでは、GEMM を効果的に最適化すると、計算速度が向上し、リソースが節約されます。これは、コンピューター システムの全体的なパフォーマンスを向上させるために非常に重要です。 GEMM の動作原理と最適化方法を深く理解することは、最新のコンピューティング ハードウェアの可能性をより有効に活用し、さまざまな複雑なコンピューティング タスクに対してより効率的なソリューションを提供するのに役立ちます。 GEMMのパフォーマンスを最適化することで

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

ファーウェイのQiankun ADS3.0インテリジェント運転システムは8月に発売され、初めてXiangjie S9に搭載される

Jul 30, 2024 pm 02:17 PM

ファーウェイのQiankun ADS3.0インテリジェント運転システムは8月に発売され、初めてXiangjie S9に搭載される

Jul 30, 2024 pm 02:17 PM

7月29日、AITO Wenjieの40万台目の新車のロールオフ式典に、ファーウェイの常務取締役、ターミナルBG会長、スマートカーソリューションBU会長のYu Chengdong氏が出席し、スピーチを行い、Wenjieシリーズモデルの発売を発表した。 8月にHuawei Qiankun ADS 3.0バージョンが発売され、8月から9月にかけて順次アップグレードが行われる予定です。 8月6日に発売されるXiangjie S9には、ファーウェイのADS3.0インテリジェント運転システムが初搭載される。 LiDARの支援により、Huawei Qiankun ADS3.0バージョンはインテリジェント運転機能を大幅に向上させ、エンドツーエンドの統合機能を備え、GOD(一般障害物識別)/PDP(予測)の新しいエンドツーエンドアーキテクチャを採用します。意思決定と制御)、駐車スペースから駐車スペースまでのスマート運転のNCA機能の提供、CAS3.0のアップグレード

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

何?ズートピアは国産AIによって実現するのか?ビデオとともに公開されたのは、「Keling」と呼ばれる新しい大規模な国産ビデオ生成モデルです。 Sora も同様の技術的ルートを使用し、自社開発の技術革新を多数組み合わせて、大きく合理的な動きをするだけでなく、物理世界の特性をシミュレートし、強力な概念的結合能力と想像力を備えたビデオを制作します。データによると、Keling は、最大 1080p の解像度で 30fps で最大 2 分の超長時間ビデオの生成をサポートし、複数のアスペクト比をサポートします。もう 1 つの重要な点は、Keling は研究所が公開したデモやビデオ結果のデモンストレーションではなく、ショートビデオ分野のリーダーである Kuaishou が立ち上げた製品レベルのアプリケーションであるということです。さらに、主な焦点は実用的であり、白紙小切手を書かず、リリースされたらすぐにオンラインに移行することです。Ke Ling の大型モデルは Kuaiying でリリースされました。

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

総合的にDPOを超える:Chen Danqi氏のチームはシンプルなプリファレンス最適化SimPOを提案し、最強の8Bオープンソースモデルも洗練させた

Jun 01, 2024 pm 04:41 PM

総合的にDPOを超える:Chen Danqi氏のチームはシンプルなプリファレンス最適化SimPOを提案し、最強の8Bオープンソースモデルも洗練させた

Jun 01, 2024 pm 04:41 PM

大規模言語モデル (LLM) を人間の価値観や意図に合わせるには、人間のフィードバックを学習して、それが有用で、正直で、無害であることを確認することが重要です。 LLM を調整するという点では、ヒューマン フィードバックに基づく強化学習 (RLHF) が効果的な方法です。 RLHF 法の結果は優れていますが、最適化にはいくつかの課題があります。これには、報酬モデルをトレーニングし、その報酬を最大化するためにポリシー モデルを最適化することが含まれます。最近、一部の研究者はより単純なオフライン アルゴリズムを研究しており、その 1 つが直接優先最適化 (DPO) です。 DPO は、RLHF の報酬関数をパラメータ化することで、選好データに基づいてポリシー モデルを直接学習するため、明示的な報酬モデルの必要性がなくなります。この方法は簡単で安定しています

Apple 16 システムのどのバージョンが最適ですか?

Mar 08, 2024 pm 05:16 PM

Apple 16 システムのどのバージョンが最適ですか?

Mar 08, 2024 pm 05:16 PM

Apple 16 システムの最適なバージョンは iOS16.1.4 です。iOS16 システムの最適なバージョンは人によって異なります。日常の使用体験における追加と改善も多くのユーザーから賞賛されています。 Apple 16 システムの最適なバージョンはどれですか? 回答: iOS16.1.4 iOS 16 システムの最適なバージョンは人によって異なる場合があります。公開情報によると、2022 年にリリースされた iOS16 は非常に安定していてパフォーマンスの高いバージョンであると考えられており、ユーザーはその全体的なエクスペリエンスに非常に満足しています。また、iOS16では新機能の追加や日常の使用感の向上も多くのユーザーからご好評をいただいております。特に最新のバッテリー寿命、信号性能、加熱制御に関して、ユーザーからのフィードバックは比較的好評です。ただし、iPhone14を考慮すると、