彼氏とデートするときに言語モデルについて聞く必要がありますか?自然: アイデアを提案し、メモを要約する GPT-3 は現代の「科学研究者」になりました

猿にタイプライターのキーをランダムに押させてください。十分な長さだけ押し続ける限り、猿はシェイクスピアの全作品をタイプすることができます。

文法と意味論を理解するサルだったらどうなるでしょうか?答えは、科学的研究さえもあなたのために行うことができるということです。

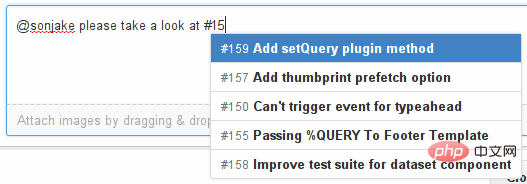

言語モデルの開発の勢いは非常に急速です。数年前には、入力メソッドで入力される次の単語を自動的に完成させることしかできませんでしたが、現在ではすでに研究者を支援できるようになりました。科学論文を分析して執筆し、コードを生成します。

ただし、Copilot の補完コンテンツは間違いが多いため、使い慣れた言語で使用することをお勧めします。

文献検索

おそらく、言語モデルの最も成熟したアプリケーション シナリオは、ドキュメントの検索と要約です。

AI2 が開発した Semantic Scholar 検索エンジンは、TLDR 言語モデルを使用して各論文の Twitter のような説明を提供します。

この検索エンジンは、主に生物医学とコンピューター サイエンスの約 2 億件の論文をカバーしています。

TLDR は、Meta によって以前にリリースされた BART モデルに基づいて開発され、その後 AI2 研究者が人間が書いた要約に基づいてモデルを微調整しました。

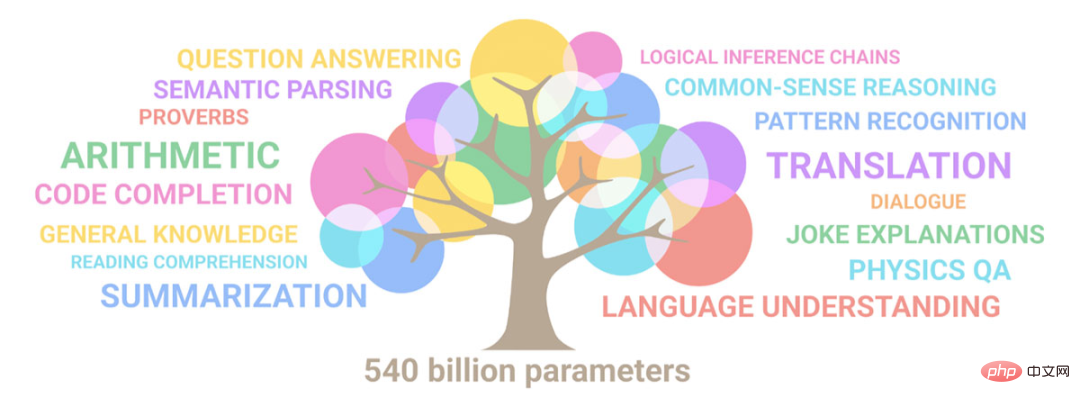

今日の標準からすると、TLDR には約 4 億個のパラメーターしか含まれていないのに対し、GPT-3 の最大バージョンには 1,750 億個のパラメーターが含まれているため、大規模な言語モデルではありません。

TLDR は、AI2 によって開発された拡張科学論文アプリケーションである Semantic Reader でも使用されます。

ユーザーが Semantic Reader でテキスト内の引用を使用すると、TLDR の概要を含む情報ボックスがポップアップ表示されます。

Semantic Scholar のチーフサイエンティスト、Dan Weld 氏は、言語モデルを使用して読書体験を向上させることが目的であると述べました。

言語モデルがテキストの要約を生成するとき、モデルは記事に存在しないいくつかの事実を生成する可能性があります。研究者はこの問題を「幻想」と呼んでいますが、実際には言語モデルは単にでっちあげたり、嘘をついたりするだけです。

TLDR は信頼性テストで良好なパフォーマンスを示し、論文の著者は TLDR の精度を 2.5 ポイント (3 ポイント中) と評価しました。

ウェルド氏は、要約の長さが約 20 単語しかなく、おそらくアルゴリズムが本文に登場しない単語を要約に含めないため、TLDR の方が現実的であると述べました。

検索ツールに関しては、カリフォルニア州サンフランシスコの機械学習非営利団体である Oought が 2021 年に Elicit を立ち上げました。ユーザーが「マインドフルネスが意思決定に与える影響は何ですか?」と尋ねたら、 「作成していますか?」と尋ねると、10 個の論文を含むテーブルが出力されます。

ユーザーは、概要やメタデータ、研究参加者に関する情報などを列に入力するようソフトウェアに要求できます。 、方法と結果の情報。GPT-3 などのツールを使用して論文から抽出または生成されます。

メリーランド大学カレッジパーク校の Joel Chan は、人間とコンピューターのインタラクションを研究しており、新しいプロジェクトを開始するたびに、Elicit を使用して関連する論文を検索しています。

ストックホルムのカロリンスカ研究所の神経科学者であるグスタフ ニルソンヌ氏も、Elicit を使用して、プールされた分析に追加できるデータを含む論文を見つけました。他の検索でファイルが見つかりました。

進化するモデル

AI2 のプロトタイプは、LLM に未来的な雰囲気を与えます。

研究者は科学論文の要約を読んだ後に質問があるものの、全文を読む時間がまだない場合があります。

AI2 のチームは、NLP の分野でこれらの質問に答えることができるツールも開発しました。

#このモデルでは、研究者はまず NLP 論文の要約を読んでから、関連する質問 (「分析された会話の属性は 5 つありますか?」など)を行う必要があります。 その後、研究チームは他の研究者に論文全体を読んだ後にこれらの質問に答えるように依頼しました。

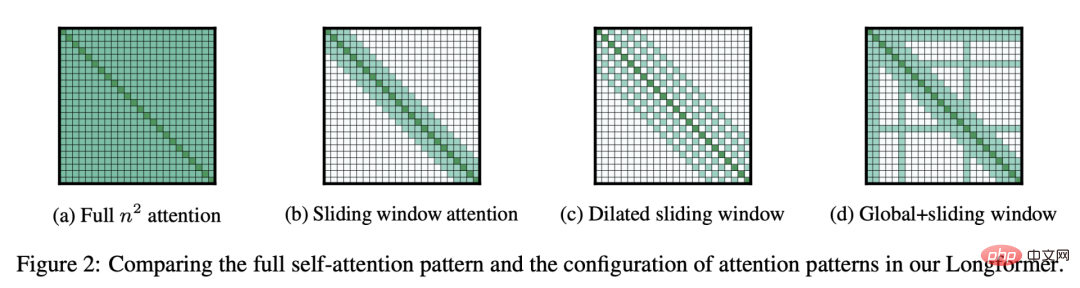

#AI2 は、Longformer 言語モデルの別のバージョンを完全な論文として入力としてトレーニングし、収集されたデータセットを使用しました。他の論文に関するさまざまな質問に対する回答を生成します。

ACCoRD モデルは、NLP に関連する 150 の科学概念の定義と類推を生成できます。

MS2 は、470,000 件の医療文書と 20,000 件の複数文書の概要を含むデータセットです。MS2 で BART を微調整した後、研究者は質問と一連の文書を提示し、A を生成することができました。メタ分析の簡単な概要。

2019 年、AI2 は 2018 年に Google が作成した言語モデル BERT を微調整し、Semantic Scholar の論文に基づいて 1 億 1,000 万のパラメータを備えた SciBERT を作成しました。

Scite は人工知能を使用して科学検索エンジンを作成し、SciBERT をさらに微調整して、検索エンジンが対象論文を引用する論文をリストする際に、それらの論文を支持論文、対照論文、またはその他の方法でその論文を参照する方法として分類できるようにしました。

ロザティ氏は、このニュアンスは人々が科学文献の限界やギャップを特定するのに役立つと述べました。

AI2 の SPECTER モデルも、論文をコンパクトな数学的表現に単純化する SciBERT に基づいています。

カンファレンスの主催者は、提出された論文を査読者と照合するために SPECTER を使用し、Semantic Scholar はユーザーのライブラリに基づいて論文を推奨するために SPECTER を使用している、と Weld 氏は述べています。

ヘブライ大学と AI2 のコンピュータ科学者であるトム・ホープ氏は、効果的な薬剤の組み合わせ、遺伝子と病気の関連性、新型コロナウイルス感染症の研究と方向性における科学的課題を特定するために、言語モデルを微調整する研究プロジェクトを行っていると述べた。

しかし、言語モデルはより深い洞察や発見機能を提供できるでしょうか?

5 月、ホープとウェルドはマイクロソフトの最高科学責任者エリック ホーヴィッツと共著で、この目標を達成するための課題を概説する解説文を執筆しました。その内容には、「) は再組織化の結果であると推測するためのモデルの指導も含まれます」と書かれています。 2つのコンセプトです。」

Hope 氏は、これは OpenAI の DALL・E 2 画像生成モデル「宇宙に飛んでいる猫の画像を生成する」のと基本的に同じことだと述べていますが、どうすれば複合的な抽象化に移行できるでしょうか。非常に複雑な科学概念についてはどうですか?

これは未解決の質問です。

今日に至るまで、大規模な言語モデルは研究に大きな影響を与えてきました。人々が仕事を支援するためにこれらの大規模な言語モデルを使い始めていない場合、こうした機会を逃すことになります。

参考資料:

https://www.nature.com/articles/d41586-022-03479-w

以上が彼氏とデートするときに言語モデルについて聞く必要がありますか?自然: アイデアを提案し、メモを要約する GPT-3 は現代の「科学研究者」になりましたの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7475

7475

15

15

1377

1377

52

52

77

77

11

11

19

19

31

31

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

Llama 70B を実行するシングル カードはデュアル カードより高速、Microsoft は FP6 を A100 オープンソースに強制導入

Apr 29, 2024 pm 04:55 PM

Llama 70B を実行するシングル カードはデュアル カードより高速、Microsoft は FP6 を A100 オープンソースに強制導入

Apr 29, 2024 pm 04:55 PM

FP8 以下の浮動小数点数値化精度は、もはや H100 の「特許」ではありません。 Lao Huang は誰もが INT8/INT4 を使用できるようにしたいと考え、Microsoft DeepSpeed チームは NVIDIA からの公式サポートなしで A100 上で FP6 の実行を開始しました。テスト結果は、A100 での新しい方式 TC-FPx の FP6 量子化が INT4 に近いか、場合によってはそれよりも高速であり、後者よりも精度が高いことを示しています。これに加えて、エンドツーエンドの大規模モデルのサポートもあり、オープンソース化され、DeepSpeed などの深層学習推論フレームワークに統合されています。この結果は、大規模モデルの高速化にも即座に影響します。このフレームワークでは、シングル カードを使用して Llama を実行すると、スループットはデュアル カードのスループットの 2.65 倍になります。 1つ