推論速度はStable Diffusionの2倍で、画像の生成と修復を1つのGoogleモデルで行うことができ、新しいSOTAを実現します。

テキストから画像への生成は、2022 年に最も注目されている AIGC の方向性の 1 つであり、「Science」誌によって 2022 年の科学的ブレークスルー トップ 10 の 1 つに選ばれました。最近、Google の新しいテキストから画像への生成に関する論文「Muse: Text-To-Image Generation via Masked Generative Transformers」が大きな注目を集めています。

- 論文アドレス: https://arxiv.org/pdf/2301.00704v1.pdf

- プロジェクト アドレス: https://muse-model.github.io/

Google の以前の Imagen モデルと同様に、この調査では、現実的で高品質の画像生成には、事前トレーニングされた LLM に基づく調整が重要であることがわかりました。 Muse モデルは、Transformer (Vaswani et al.、2017) アーキテクチャに基づいて構築されています。

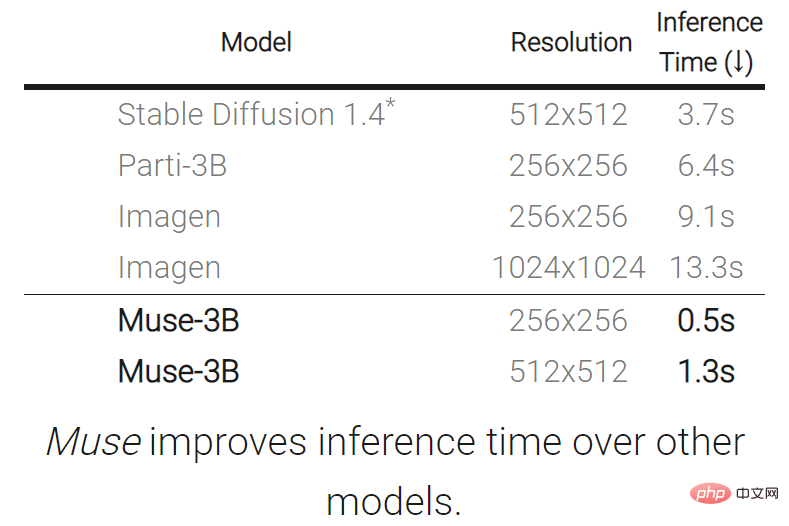

カスケードピクセル空間拡散モデルに基づく Imagen (Saharia et al., 2022) または Dall-E2 (Ramesh et al., 2022) との比較 Muse との比較、効率個別トークンの使用により大幅に改善されます。 SOTA 自己回帰モデル Parti (Yu et al., 2022) と比較すると、Muse は並列デコードを使用するため、より効率的です。

TPU-v4 での実験結果に基づいて、研究者らは、Muse の推論速度は Imagen-3B または Parti-3B モデルよりも 10 倍以上速く、Stable Diffusion v1 よりも速いと推定しています。 .4 (Rombach et al., 2022) 2 倍高速になります。研究者は、拡散モデルが Stable Diffusion v1.4 で使用されており、推論中に明らかにより多くの反復が必要になるため、Muse の方が Stable Diffusion よりも高速であると考えています。

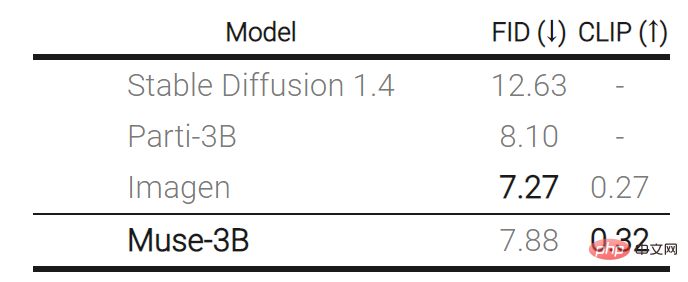

一方、Muse の効率が向上しても、生成される画像の品質が低下したり、入力テキスト プロンプトのモデルの意味理解が低下したりすることはありません。この研究では、CLIP スコア (Radford et al., 2021) や FID (Heusel et al., 2017) などの複数の基準に対して Muse の生成結果を評価しました。 Muse-3B モデルは、COCO (Lin et al., 2014) ゼロショット検証ベンチマークで CLIP スコア 0.32 および FID スコア 7.88 を達成しました。

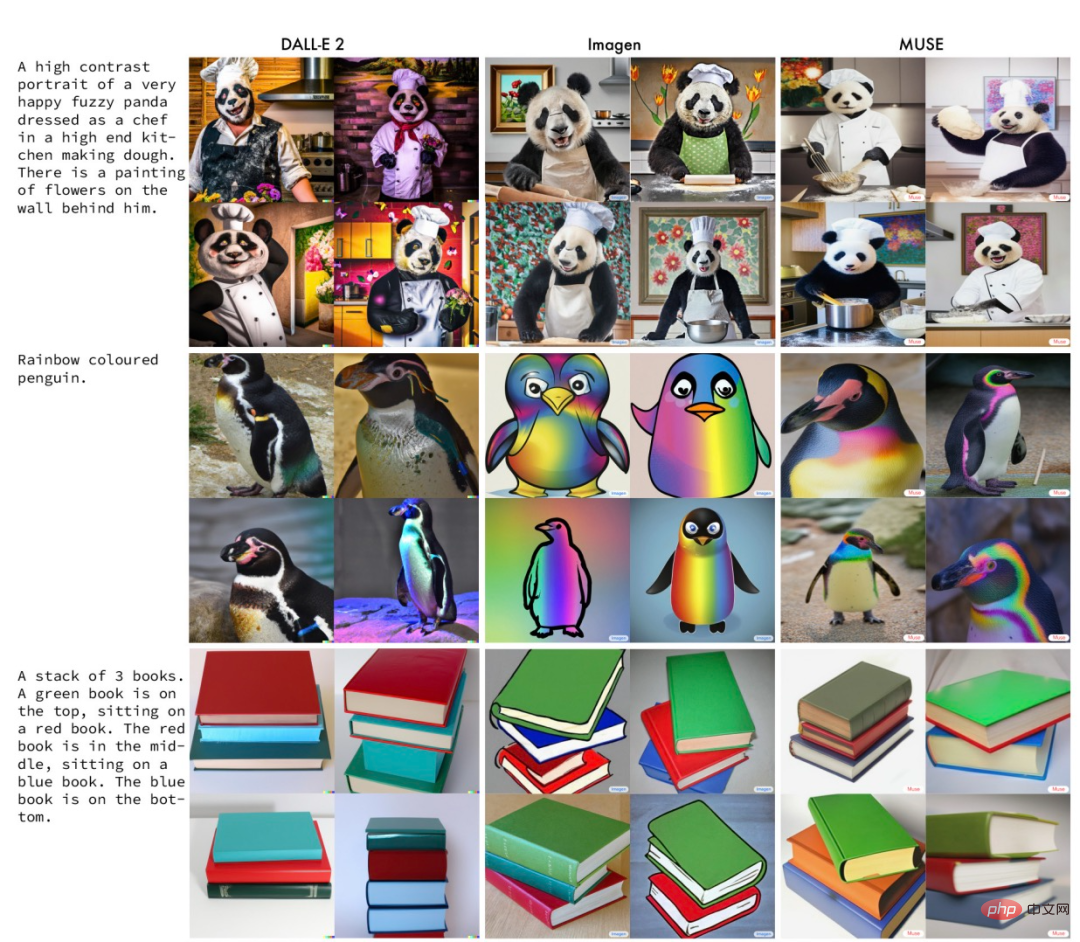

Muse 生成効果を見てみましょう:

テキストと画像の生成: Muse モデルは、テキストから高品質の画像を迅速に生成します。 (TPUv4 では、解像度 512x512 のイメージを生成するのに 1.3 秒かかり、解像度 256x256 のイメージを生成するのに 0.5 秒かかります)。たとえば、「自転車に乗っているクマとハンドルバーに止まっている鳥」を生成します。

モデルの紹介

モデルの紹介

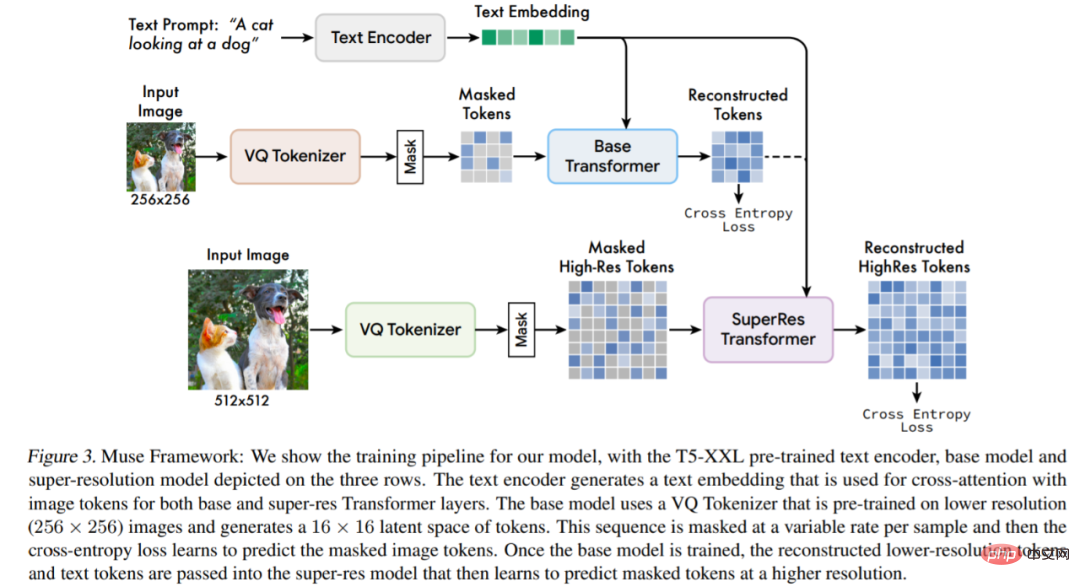

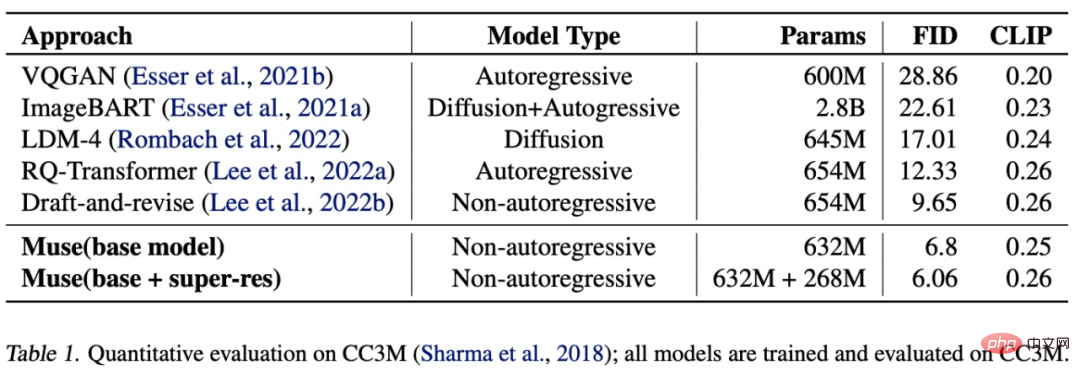

事前トレーニングされたテキスト エンコーダー: この研究では、事前トレーニングされた大規模言語モデル (LLM) を利用すると画像生成の品質を向上できることがわかりました。彼らは、Muse モデルが LLM 埋め込みの豊富な視覚的および意味論的な概念を生成された画像にマッピングすることを学習したと仮説を立てました。この研究では、入力テキストのサブタイトルが与えられると、それをフリーズされた T5-XXL エンコーダーに通し、言語埋め込みベクトルの 4096 次元シーケンスが生成されます。これらの埋め込みベクトルは、Transformer モデルに線形投影されます。 VQGAN を使用したセマンティック トークン化: このモデルのコア コンポーネントは、VQGAN モデルから取得したセマンティック トークンの使用です。このうち、VQGANはエンコーダとデコーダで構成され、量子化層は入力画像を学習コードブックのトークン列にマッピングします。この研究ではすべて、畳み込み層を使用してエンコーダとデコーダを構築し、さまざまな解像度の画像のエンコードをサポートしています。 基本モデル: 基本モデルは、入力が埋め込みと T5 に投影されたイメージ トークンであるマスク トランスフォーマーです。この研究では、すべてのテキスト埋め込みを (マスクなしで) 保持し、異なる比率の画像トークンをランダムにマスクし、特別な [マスク] トークンに置き換えます。 超解像度モデル: この研究では、モデルのカスケードを使用することが有益であることが判明しました。まず、16 × 16 の潜在マップ (256 × 256 の画像に相当) を生成する基本モデルを使用します。基本潜在マップは、64 × 64 潜在マップ (512 × 512 画像に相当) である超解像度モデルにアップサンプリングされます。 デコーダの微調整: モデルの詳細を生成する能力をさらに向上させるために、この研究では、エンコーダの容量を維持しながら、より多くの残留レイヤとチャネルを追加することで VQGAN デコーダの容量を増加します。変更なし。その後、VQGAN エンコーダーの重み、コードブック、トランスフォーマー (つまり、ベース モデルと超解像度モデル) をフリーズしながら、新しいデコーダー レイヤーが微調整されます。 Muse には、上記のコンポーネントに加えて、可変マスク比コンポーネント、推論中の反復並列デコード コンポーネントなども含まれています。 以下の表に示すように、Muse は他のモデルと比較して推論時間を短縮します。 #次の表は、ゼロショット COCO のさまざまなモデルによって測定された FID スコアと CLIP スコアを示しています。 以下の表に示すように、Muse (632M (ベース) 268M (超解像度) パラメーター モデル) は、CC3M データセットでトレーニングおよび評価した場合、6.06 の SOTA FID スコアを取得しました。 次の図は、同じプロンプトで Muse、Imagen、および DALL-E 2 によって生成された結果の例です。 興味のある読者は、論文の原文を読んで研究の詳細を学ぶことができます。 実験と結果

以上が推論速度はStable Diffusionの2倍で、画像の生成と修復を1つのGoogleモデルで行うことができ、新しいSOTAを実現します。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1672

1672

14

14

1428

1428

52

52

1332

1332

25

25

1277

1277

29

29

1257

1257

24

24

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

時系列予測 NLP 大規模モデルの新機能: 時系列予測の暗黙的なプロンプトを自動的に生成

Mar 18, 2024 am 09:20 AM

時系列予測 NLP 大規模モデルの新機能: 時系列予測の暗黙的なプロンプトを自動的に生成

Mar 18, 2024 am 09:20 AM

今日は、時系列予測のパフォーマンスを向上させるために、時系列データを潜在空間上の大規模な自然言語処理 (NLP) モデルと整合させる方法を提案するコネチカット大学の最近の研究成果を紹介したいと思います。この方法の鍵は、潜在的な空間ヒント (プロンプト) を使用して時系列予測の精度を高めることです。論文タイトル: S2IP-LLM: SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting ダウンロードアドレス: https://arxiv.org/pdf/2403.05798v1.pdf 1. 大きな問題の背景モデル

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

この論文では、自動運転においてさまざまな視野角 (遠近法や鳥瞰図など) から物体を正確に検出するという問題、特に、特徴を遠近法 (PV) 空間から鳥瞰図 (BEV) 空間に効果的に変換する方法について検討します。 Visual Transformation (VT) モジュールを介して実装されます。既存の手法は、2D から 3D への変換と 3D から 2D への変換という 2 つの戦略に大別されます。 2D から 3D への手法は、深さの確率を予測することで高密度の 2D フィーチャを改善しますが、特に遠方の領域では、深さ予測に固有の不確実性により不正確さが生じる可能性があります。 3D から 2D への方法では通常、3D クエリを使用して 2D フィーチャをサンプリングし、Transformer を通じて 3D と 2D フィーチャ間の対応のアテンション ウェイトを学習します。これにより、計算時間と展開時間が増加します。

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません