GPT4 のリリースが目前に迫り、人間の脳に匹敵するため、多くの業界リーダーが黙ってはいられないのです。

著者 | Xu Jiecheng

査読者 | Yun Zhao

100 兆、この数字はどれくらい大きいでしょうか?毎日 500 万枚の宝くじが当たるという超能力を持っているとして、飲食せずにすべてのお金を貯めたとしても、100 兆の富を貯めるには約 5,500 年生きなければなりません。しかし、私が今日話したい100兆というのは、「人民元」や「ドル」といった誰もが欲しがる単位の背後にあるものではありません。ここでの 100 兆というのは、多くのシリコンバレーのテクノロジー界の大物が共同設立した人工知能研究会社 OpenAI が所有するパラメータの数を指しており、同社は第 4 世代の生成事前トレーニング Transformer-GPT-4 をリリースしようとしています。

誰もがこのデータをより直感的に理解できるようにするために、人間の脳を使用して GPT-4 と比較することができます。通常の状況下では、正常な人間の脳には約 800 ~ 1,000 億個のニューロンと約 100 兆個のシナプスがあります。これらのニューロンとシナプスは、人間の 100 年の人生におけるほぼすべての思考、判断、行動を直接制御しており、GPT-4 には人間の脳のシナプスと同じくらい多くのパラメーターがあります。それでは、このような大規模で高密度なニューラル ネットワークの可能性は何でしょうか? GPT-4 の出現は私たちにどのような驚きをもたらすでしょうか? 私たちは本当に人間の脳を作り出す能力を持っているのでしょうか?

これらの刺激的な質問を検討する前に、まず GPT-4 のいくつかの「先駆者」の開発の歴史を理解することをお勧めします。

1. GPT: このままでは大ヒットになる

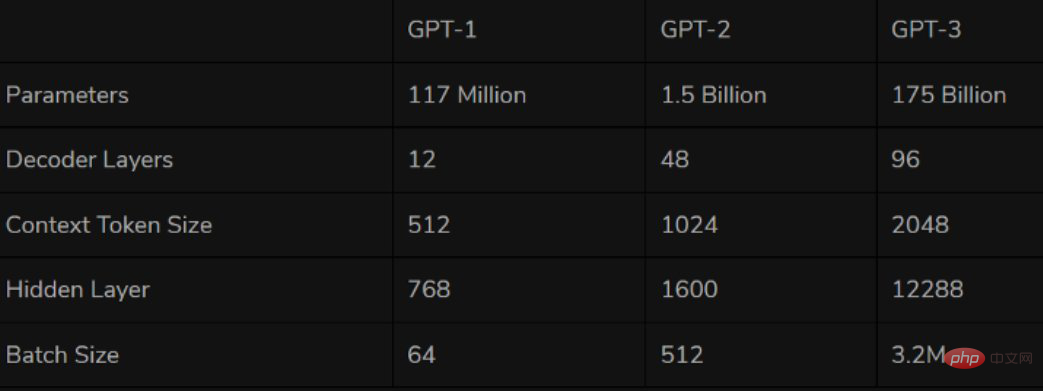

2018年にGPTシリーズの初代モデルGPT-1が誕生し、それが私たちです よく言われる NLP 事前トレーニング モデルの初年度です。 Transformer に基づく最初の事前トレーニング モデルとして、GPT-1 は、Transformer のデコーダーを特徴抽出器として使用する 2 段階の事前トレーニング FineTuning を採用しており、合計 12 層に 1 億 1,000 万のパラメーターが積み重ねられています。トレーニング タスクとしての「一方向言語モデル」。

パフォーマンスの点では、GPT-1 には一定の一般化機能があり、監視タスクとは関係のない NLP タスクで使用できます。一般的なタスクは次のとおりです:

- 自然言語推論: 2 つの文間の関係 (包含、矛盾、中立性) を判断します

- 質疑応答と常識的な推論:入力記事といくつかの回答、出力された回答の精度

- 意味的類似性認識: 2 つの文の意味が関連しているかどうかを判断します

- 分類: 入力テキストがどのカテゴリに属するかを判断します

GPT-1 は調整されていないタスクに対してある程度の効果がありますが、一般化能力は微調整された教師ありタスクに比べてはるかに低いため、GPT-1 はかなり優れているとしか考えられません。 1. 会話型 AI ではなく、言語理解ツール。

GPT-1 の登場から 1 年後、予定通り 2019 年に GPT-2 も登場しました。兄貴分の GPT-1 と比較して、GPT-2 は元のネットワークにあまり多くの構造革新や設計を加えず、より多くのネットワーク パラメーターとより大きなデータ セットのみを使用しました。最大のモデルには合計 48 のレイヤーがあり、パラメータの量は 15 億に達し、学習ターゲットは教師なし事前トレーニング モデルを使用して教師ありタスクを実行します。

出典: Twitter

パフォーマンスの面では、OpenAI の優れた強みが本当に奇跡をもたらしているようです。 GPT-2 は、その理解能力に加えて、この世代で初めて強力な才能を示しました。概要を読んだり、チャットしたり、書き続けたり、話をでっち上げたり、さらにはフェイク ニュースを生成したり、フィッシング メールを作成したり、オンラインで他人になりすますこともできます。すべて簡単です。 「大きくなった」後、GPT-2 は一連の普遍的で強力な機能を実証し、複数の特定の言語モデリング タスクで当時最高のパフォーマンスを達成しました。当時 OpenAI が「GPT-2 は危険すぎてリリースできない」と発言したのも不思議ではありません。

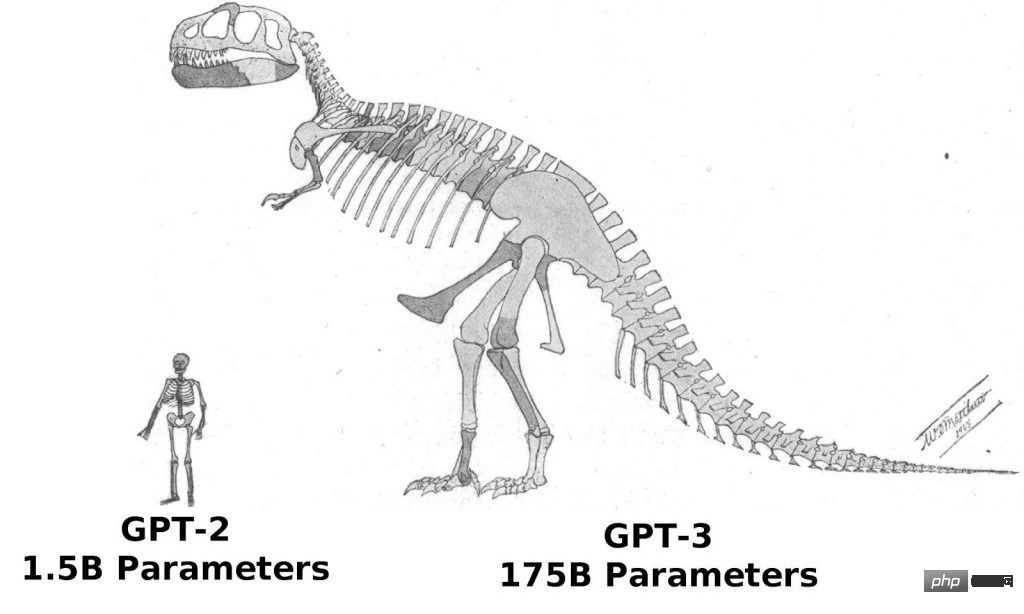

GPT-2 の成功以来、OpenAI の「ヘラクレス」に対する信念はますます強固になりました。2020 年にリリースされた GPT-3 は、マイクロイノベーションと急速な拡大、アイデア。 GPT-3 の Transformer が Sparse 構造を適用していることを除けば、GPT-3 と GPT-2 の構造にはほとんど違いはありません。 「勢い」という点では、GPT-3 モデルは 96 層に達し、トレーニング パラメーターは 1,750 億 (GPT-2 の 10 倍以上) に達しました。

GPT-3 は、OpenAI のビジョンを再度証明しました。GPT-3 の強力なパフォーマンスと大幅に多くのパラメータにより、より多くのトピック テキストが含まれており、前世代の GPT-2 よりも明らかに優れています。現在利用可能な最大の高密度ニューラル ネットワークである GPT-3 は、Web ページの説明を対応するコードに変換し、人間の物語を模倣し、カスタム詩を作成し、ゲーム スクリプトを生成し、さらには亡くなった哲学者を模倣して、人生の真の意味を予測することができます。 GPT-3 は微調整を必要とせず、難しい文法問題の処理に関しては、出力タイプのいくつかのサンプル (少量の学習) のみが必要です。 GPT-3 は、言語専門家にとって私たちの想像力をすべて満たしてくれたと言えます。

2. チューリングテストを総合的にクリアし、学習や商用利用の敷居を下げます

そう言えば、誰もが同じ疑問を抱くと思います - GPT-3 GPT-4 はすでに非常に強力ですが、GPT-4 には他に何が期待できるでしょうか?

ご存知のとおり、AI システムの知能をテストする中心的な方法はチューリング テストです。人間の知能の概念を定義するために科学的に定量化できる標準をまだ使用できない場合, チューリングテストは、現在、相手が人間の知能を持っているかどうかを判断できる数少ない実現可能な検査方法の1つです。ことわざを使うと、アヒルのように見え、アヒルのように歩き、アヒルのように鳴くものがあれば、それはアヒルです。したがって、AI システムがチューリング テストに合格できれば、そのシステムが人間の思考を持ち、ある面で人間に取って代わる可能性があることを意味します。韓国のITメディアの報道によると、業界は11月中旬以降、GPT-4がチューリングテストに完全に合格したと報告していた。韓国のVodier AI企業幹部、ナム・セドン氏は、韓国の「エコノミックニュース」との最近のインタビューで、「GPT-4がチューリングテストに合格したというニュースは公式には確認されていないが、このニュースはかなり信頼できるはずだ」と語った。

##OpenAI の技術者で現在 CEO を務める Sam Altman 氏も、自身の Twitter でこの情報を確認したようです。アルトマン氏は11月10日、「スター・ウォーズ」の登場人物ダース・ベイダーの古典的なセリフを真似て、「あなたが作り出したこのテクノロジーパニックを誇りに思うな。チューリングテストに合格する能力は『オリジナル』にある」とツイートした。力の前では何もできません。」

業界が GPT-4 に注目している理由は、おそらく GPT-4 の実際の商業的閾値が従来の GPT-3 よりも低いためでしょう。これまで莫大なコストやインフラストラクチャ上の理由で関連テクノロジーを使用できなかった企業も GPT-4 を使用することが期待されます。 GPT-4は現在上場の最終段階にあり、今年12月から来年2月までに発売される予定だ。 Cambridge AI Research のアナリスト、Alberto Garcia 氏はブログを公開し、次のように予測しました。「GPT-4 はデータ処理の最適化により重点を置くため、GPT-4 の学習コストは GPT-3 よりも低くなることが予想されます。 GPT-4 のエピソード おそらく GPT-3 の数百万ドルから約 100 万ドルに減額されるでしょう。」

3. 異なる道が同じ目標につながります: 人間の脳をシミュレートするほうが早くなる可能性があります

上記の情報がすべて真実であれば、現時点で予測できます。来年の GPT-4 のリリースにより、ディープラーニング研究の分野には新たな波が到来し、より高度でより自然で、身元の識別がほぼ不可能なチャットサービスロボットが多数登場することになるでしょう。さまざまな産業に対応し、これをベースにさらに高度なチャットロボットが登場し、従来のさまざまなビジネスから高品質でパーソナライズされたAIサービスが生まれ、認知知能によるバリアフリーコミュニケーションも初めて実現する可能性が高い。

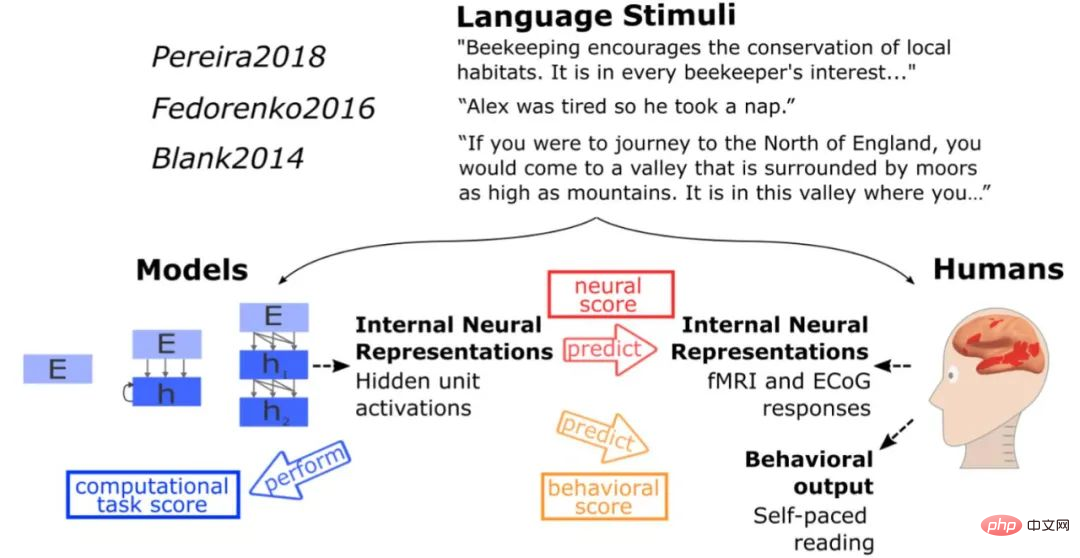

冒頭で述べた人間の脳の製造またはシミュレーションの問題に戻りましょう。 MITの研究によると、GPT-3のニューラルネットワークは人間の脳を直接模倣しようとはしていませんが、GPT-3によって提示された言語処理手法は人間の脳の進化の過程で得られた解決策と一定の類似点を持っています。テスト用の人間の脳と同じ刺激をモデルに入力すると、モデルは人間の脳と同じ種類の活性化を獲得し、40 を超える言語モデルのテストにおいて、GPT-3 はほぼ完璧な推論を行いました。この機能は確かに人間の脳の言語処理中枢の機能と似ています。この点に関して、スタンフォード大学の心理学およびコンピューターサイエンスの助教授ダニエル・ヤミンズ氏も次のように述べています。「人工知能ネットワークは脳を直接模倣するわけではありませんが、最終的には脳のように見えることになります。これはある意味、人工知能のネットワークが存在することを示しています」 「人工知能と自然の間にはギャップがあり、ある種の収斂進化が起こっているようです。」

出典: インターネット

GPT シリーズ モデルは直接使用していないことがわかります。ブルー ブレイン プロジェクトの設計思想は脳の構造をシミュレートすることですが、それがもたらす効果はブルー ブレイン プロジェクトよりも私たちの期待に近いようです。したがって、この研究の方向性が本当に実現可能であり、GPT-4 が GPT-3 に基づいていくつかの面で飛躍的な進歩を遂げることができれば、人間の脳の一部の機能をシミュレートするという目標に大きく近づくことになるでしょう。

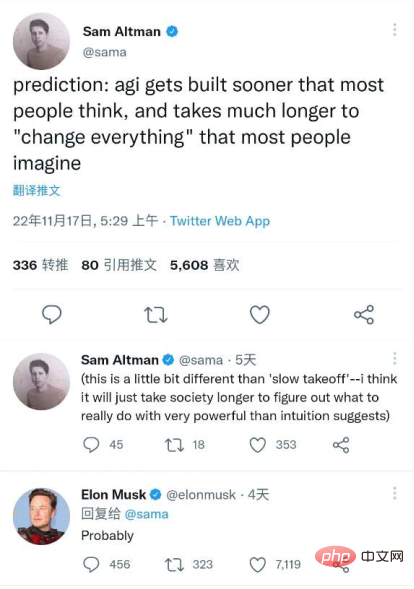

最後に、「シリコンバレーの鉄人」イーロン・マスク氏も認めた、OpenAI CEO のサム・アルトマン氏の最近の Twitter の投稿からの引用で終わりたいと思います。知性は、ほとんどの人が想像するよりも早く確立され、長い時間をかけてほとんどの人が想像するすべてを「変える」でしょう。」

出典:Twitter

参考リンク:

https://dzone .com/articles/what-can-you-do-with-the-openai-gpt-3- language-mod

https://analyticsindiamag.com/gpt-4-is-almost-here- and-it-looks-better-than-anything-else/

https://analyticsindiamag.com/openais-whisper-might-hold-the-key-to-gpt4/

以上がGPT4 のリリースが目前に迫り、人間の脳に匹敵するため、多くの業界リーダーが黙ってはいられないのです。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7461

7461

15

15

1376

1376

52

52

77

77

11

11

17

17

17

17

PHP バージョン 5.4 の新機能: 呼び出し可能な型ヒント パラメーターを使用して呼び出し可能な関数またはメソッドを受け入れる方法

Jul 29, 2023 pm 09:19 PM

PHP バージョン 5.4 の新機能: 呼び出し可能な型ヒント パラメーターを使用して呼び出し可能な関数またはメソッドを受け入れる方法

Jul 29, 2023 pm 09:19 PM

PHP5.4 バージョンの新機能: 呼び出し可能な型ヒント パラメーターを使用して呼び出し可能な関数またはメソッドを受け入れる方法 はじめに: PHP5.4 バージョンでは、非常に便利な新機能が導入されています。呼び出し可能な型ヒント パラメーターを使用して、呼び出し可能な関数またはメソッドを受け入れることができます。この新機能により、追加のチェックや変換を行わずに、関数やメソッドで対応する呼び出し可能なパラメーターを直接指定できるようになります。この記事では、呼び出し可能な型ヒントの使用法を紹介し、いくつかのコード例を示します。

製品パラメータとは何を意味しますか?

Jul 05, 2023 am 11:13 AM

製品パラメータとは何を意味しますか?

Jul 05, 2023 am 11:13 AM

製品パラメータは、製品属性の意味を指します。たとえば、衣類のパラメータには、ブランド、素材、モデル、サイズ、スタイル、生地、適用グループ、色などが含まれ、食品のパラメータには、ブランド、重量、素材、保健免許番号、適用グループ、色などが含まれ、家電のパラメータには、家電製品のパラメータが含まれます。ブランド、サイズ、色、原産地、適用可能な電圧、信号、インターフェース、電力などが含まれます。

i9-12900Hパラメータ評価リスト

Feb 23, 2024 am 09:25 AM

i9-12900Hパラメータ評価リスト

Feb 23, 2024 am 09:25 AM

i9-12900H は 14 コア プロセッサです。使用されているアーキテクチャとテクノロジはすべて新しく、スレッドも非常に高速です。全体的な動作は優れており、いくつかのパラメータが改善されています。特に包括的で、ユーザーに優れたエクスペリエンスをもたらします。 。 i9-12900H パラメータ評価レビュー: 1. i9-12900H は、q1 アーキテクチャと 24576kb プロセス テクノロジを採用した 14 コア プロセッサで、20 スレッドにアップグレードされています。 2. 最大 CPU 周波数は 1.80! 5.00 ghz で、主にワークロードによって異なります。 3. 価格と比較すると、非常に適しており、価格性能比が非常に優れており、通常の使用が必要な一部のパートナーに非常に適しています。 i9-12900H のパラメータ評価とパフォーマンスの実行スコア

PHP 警告: in_array() に対する解決策にはパラメーターが必要です

Jun 22, 2023 pm 11:52 PM

PHP 警告: in_array() に対する解決策にはパラメーターが必要です

Jun 22, 2023 pm 11:52 PM

開発プロセス中に、次のようなエラー メッセージが表示される場合があります: PHPWarning: in_array()expectsparameter。このエラー メッセージは、in_array() 関数を使用するときに表示されます。関数のパラメータの受け渡しが正しくないことが原因である可能性があります。このエラー メッセージの解決策を見てみましょう。まず、in_array() 関数の役割を明確にする必要があります。配列に値が存在するかどうかを確認します。この関数のプロトタイプは次のとおりです: in_a

C++ 関数パラメータの型の安全性チェック

Apr 19, 2024 pm 12:00 PM

C++ 関数パラメータの型の安全性チェック

Apr 19, 2024 pm 12:00 PM

C++ パラメーターの型の安全性チェックでは、コンパイル時チェック、実行時チェック、静的アサーションを通じて関数が予期される型の値のみを受け入れるようにし、予期しない動作やプログラムのクラッシュを防ぎます。 コンパイル時の型チェック: コンパイラは型の互換性をチェックします。実行時の型チェック:dynamic_cast を使用して型の互換性をチェックし、一致しない場合は例外をスローします。静的アサーション: コンパイル時に型条件をアサートします。

指定された値を引数として受け取る逆双曲線正弦関数の値を見つける C++ プログラム

Sep 17, 2023 am 10:49 AM

指定された値を引数として受け取る逆双曲線正弦関数の値を見つける C++ プログラム

Sep 17, 2023 am 10:49 AM

双曲線関数は、円の代わりに双曲線を使用して定義され、通常の三角関数と同等です。ラジアン単位で指定された角度から双曲線正弦関数の比率パラメーターを返します。しかし、その逆、つまり別の言い方をすればいいのです。双曲線正弦から角度を計算したい場合は、双曲線逆正弦演算のような逆双曲線三角関数演算が必要です。このコースでは、C++ で双曲線逆サイン (asinh) 関数を使用し、ラジアン単位の双曲線サイン値を使用して角度を計算する方法を説明します。双曲線逆正弦演算は次の式に従います -$$\mathrm{sinh^{-1}x\:=\:In(x\:+\:\sqrt{x^2\:+\:1})}ここで\:In\:is\:自然対数\:(log_e\:k)

100億個のパラメータを持つ言語モデルは実行できないのでしょうか? MIT の中国人医師が SmoothQuant 定量化を提案しました。これにより、メモリ要件が半分に減り、速度が 1.56 倍向上しました。

Apr 13, 2023 am 09:31 AM

100億個のパラメータを持つ言語モデルは実行できないのでしょうか? MIT の中国人医師が SmoothQuant 定量化を提案しました。これにより、メモリ要件が半分に減り、速度が 1.56 倍向上しました。

Apr 13, 2023 am 09:31 AM

大規模言語モデル (LLM) は優れたパフォーマンスを持っていますが、パラメーターの数は簡単に数千億に達する可能性があり、コンピューティング機器とメモリの需要が非常に大きいため、一般の企業にはそれを買う余裕がありません。量子化は一般的な圧縮操作であり、モデルの重みの精度を下げる (32 ビットから 8 ビットなど) ことにより、推論速度の高速化とメモリ要件の削減と引き換えにモデルのパフォーマンスの一部を犠牲にします。しかし、1,000 億を超えるパラメータを持つ LLM の場合、既存の圧縮方法ではモデルの精度を維持できず、ハードウェア上で効率的に実行することもできません。最近、MIT と NVIDIA の研究者が共同で、汎用のポストトレーニング量子化 (GPQ) を提案しました。

機械学習のハイパーパラメータ調整の概要 (PySpark ML)

Apr 08, 2023 pm 07:21 PM

機械学習のハイパーパラメータ調整の概要 (PySpark ML)

Apr 08, 2023 pm 07:21 PM

ML における重要なタスクは、モデルの選択、つまりデータを使用して特定のタスクに最適なモデルまたはパラメーターを見つけることです。これはチューニングとも呼ばれます。 LogisticRegression などの単一の推定器を調整することも、複数のアルゴリズム、特性評価、その他のステップを含むパイプライン全体を調整することもできます。ユーザーは、パイプライン内の各要素を個別に調整するのではなく、パイプライン全体を一度に調整できます。 ML における重要なタスクは、モデルの選択、つまりデータを使用して特定のタスクに最適なモデルまたはパラメーターを見つけることです。これはチューニングとも呼ばれます。単一の Estimator (LogisticRegression など) を調整できます。