推奨論文: 深層敵対的学習に基づく超音波画像における乳房腫瘍のセグメンテーションと分類

条件付き GAN (cGAN) Atrous Convolution (AC) 重み付きブロック (CAW) を使用したチャネル アテンション。

この論文は、深層敵対的学習に基づく超音波画像の乳房腫瘍のセグメンテーションおよび分類手法 (cGAN AC CAW) を提案します。この論文は 2019 年に提案されましたが、当時はセグメンテーションに GAN を使用する方法を提案していました。非常に斬新なアイデアです。この論文は基本的に当時統合できた技術をすべて統合しており、非常に良い成果を上げているので非常に読み応えがあります。また論文では、典型的な敵対的損失と l1 の SSIM も提案されています。損失関数としてのノルム損失。

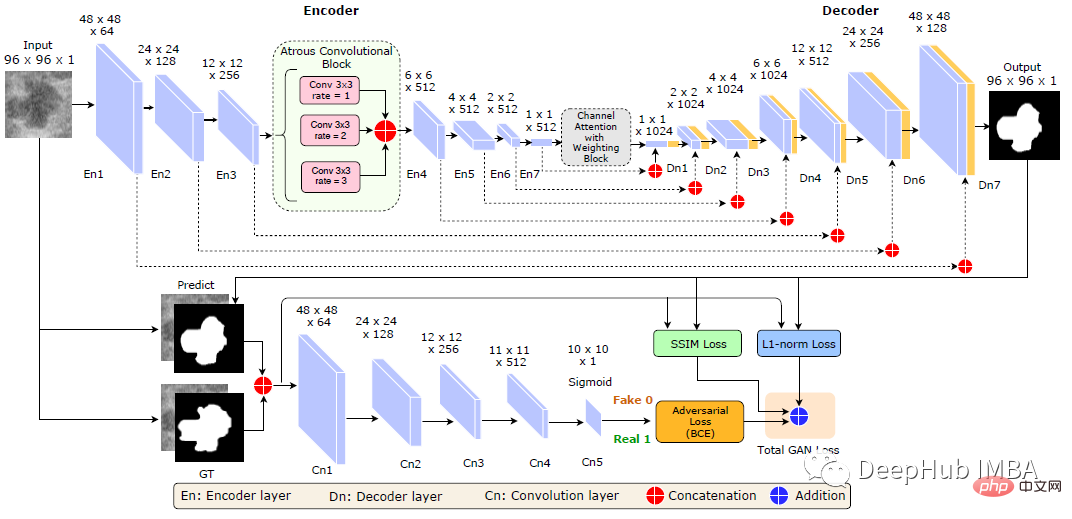

cGAN AC CAW を使用したセマンティック セグメンテーション

ジェネレーター G

ジェネレーター ネットワークにはエンコーダー部分が含まれています。 7 つの畳み込み層 (En1 ~ En7) とデコーダー: 7 つの逆畳み込み層 (Dn1 ~ Dn7)。

En3 と En4 の間に atrous コンボリューション ブロックを挿入します。拡張率 1、6、9、カーネルサイズ 3×3、ストライド 2。

En7 と Dn1 の間には、チャネル重み付け (CAW) ブロックを備えたチャネル アテンション レイヤーもあります。

CAW ブロックは、チャネル アテンション モジュール (DAN) とチャネル重み付けブロック (SENet) の集合であり、ジェネレーター ネットワークの最高レベルの機能の表現能力を高めます。

Discriminator D

これは一連の畳み込み層です。

ディスクリミネーターへの入力は、画像と腫瘍領域をマークするバイナリ マスクの連結です。

識別器の出力は、0.0 (完全に偽物) から 1.0 (本物) の範囲の値を持つ 10×10 行列です。

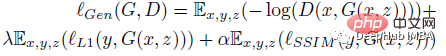

損失関数

ジェネレーター G の損失関数は、敵対的損失 (バイナリ クロスエントロピー損失)、学習プロセスを促進し、セグメンテーション マスク境界を改善するための l1-ノルム、SSIM 損失の 3 つの項で構成されます。形状:

# ここで、z は確率変数です。識別器 D の損失関数は次のとおりです。

分類タスクにランダム フォレストを使用します

各画像を学習済みのネットワークに入力します。ネットワークを生成します。 、腫瘍の境界を取得し、この境界から 13 の統計的特徴を計算します: フラクタル次元、欠損性、凸包、凸性、真円性、面積、周長、重心、短軸および長軸の長さ、滑らかさ、Hu モーメント (6)、および中心モーメント(順序 3 以下)

は、徹底的な特徴選択 (Exhaustive feature selected) アルゴリズムを使用して、最適な特徴セットを選択します。 EFS アルゴリズムは、フラクタル次元、隙間、凸包、重心が 4 つの最適な特徴であることを示しています。

これらの選択された特徴はランダム フォレスト分類器に入力され、良性腫瘍と悪性腫瘍を区別するように訓練されます。

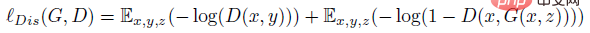

結果の比較

セグメンテーション

データセットには、画像に含まれる 150 個の悪性腫瘍と 100 個の良性腫瘍が含まれています。モデルをトレーニングするために、データ セットはトレーニング セット (70%)、検証セット (10%)、およびテスト セット (20%) にランダムに分割されました。

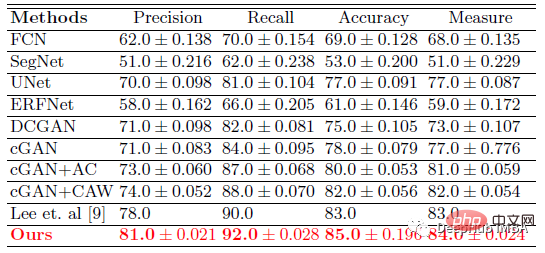

このモデル (cGAN AC CAW) は、すべての指標において他のモデルよりも優れています。 Dice スコアと IoU スコアはそれぞれ 93.76% と 88.82% です。

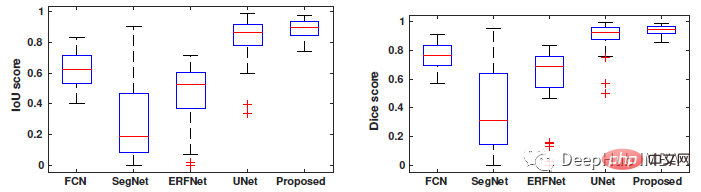

FCN、SegNet、ERFNet、U-Net などのセグメンテーション ヘッドを使用したペーパー モデルの IoU と Dice の箱ひげ図比較。

このモデルの Dice 係数の値の範囲は 88% ~ 94%、IoU の値の範囲は 80% ~ 89% ですが、他のディープ セグメンテーション手法 FCN 、SegNet、ERFNet、および U-Net の値の範囲は大きくなります。

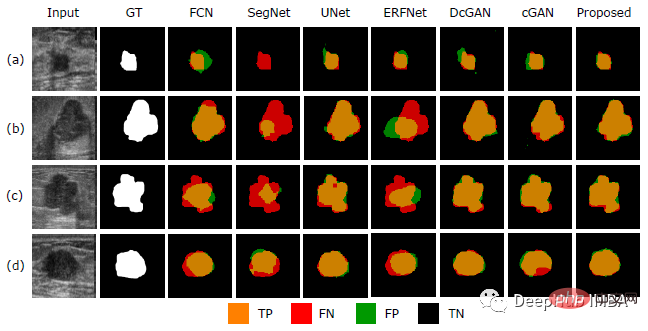

セグメンテーションの結果 上の図に示すように、SegNet と ERFNet は最悪の結果を生成し、多数の偽陰性領域 (赤) といくつかの偽陽性領域 (緑) が発生しました。

U-Net、DCGAN、および cGAN は良好なセグメンテーションを提供しますが、論文で提案されているモデルはより正確な乳房腫瘍境界セグメンテーションを提供します。

分類

#提案された乳房腫瘍分類法は、[9]よりも優れており、合計精度は 85% です。

以上が推奨論文: 深層敵対的学習に基づく超音波画像における乳房腫瘍のセグメンテーションと分類の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7553

7553

15

15

1382

1382

52

52

83

83

11

11

22

22

96

96

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

以前に書きましたが、今日は、深層学習テクノロジーが複雑な環境におけるビジョンベースの SLAM (同時ローカリゼーションとマッピング) のパフォーマンスをどのように向上させることができるかについて説明します。ここでは、深部特徴抽出と深度マッチング手法を組み合わせることで、低照度条件、動的照明、テクスチャの弱い領域、激しいセックスなどの困難なシナリオでの適応を改善するように設計された多用途のハイブリッド ビジュアル SLAM システムを紹介します。当社のシステムは、拡張単眼、ステレオ、単眼慣性、ステレオ慣性構成を含む複数のモードをサポートしています。さらに、他の研究にインスピレーションを与えるために、ビジュアル SLAM と深層学習手法を組み合わせる方法も分析します。公開データセットと自己サンプリングデータに関する広範な実験を通じて、測位精度と追跡堅牢性の点で SL-SLAM の優位性を実証しました。

golang 関数で新しい関数を動的に作成するためのヒント

Apr 25, 2024 pm 02:39 PM

golang 関数で新しい関数を動的に作成するためのヒント

Apr 25, 2024 pm 02:39 PM

Go 言語は、クロージャとリフレクションという 2 つの動的関数作成テクノロジを提供します。クロージャを使用すると、クロージャ スコープ内の変数にアクセスでき、リフレクションでは FuncOf 関数を使用して新しい関数を作成できます。これらのテクノロジーは、HTTP ルーターのカスタマイズ、高度にカスタマイズ可能なシステムの実装、プラグイン可能なコンポーネントの構築に役立ちます。

C++ 関数の命名におけるパラメーターの順序に関する考慮事項

Apr 24, 2024 pm 04:21 PM

C++ 関数の命名におけるパラメーターの順序に関する考慮事項

Apr 24, 2024 pm 04:21 PM

C++ 関数の名前付けでは、読みやすさを向上させ、エラーを減らし、リファクタリングを容易にするために、パラメーターの順序を考慮することが重要です。一般的なパラメータの順序規則には、アクション-オブジェクト、オブジェクト-アクション、意味論的な意味、および標準ライブラリへの準拠が含まれます。最適な順序は、関数の目的、パラメーターの種類、潜在的な混乱、および言語規約によって異なります。

AlphaFold 3 が発売され、タンパク質とすべての生体分子の相互作用と構造をこれまでよりもはるかに高い精度で包括的に予測します。

Jul 16, 2024 am 12:08 AM

AlphaFold 3 が発売され、タンパク質とすべての生体分子の相互作用と構造をこれまでよりもはるかに高い精度で包括的に予測します。

Jul 16, 2024 am 12:08 AM

エディター | Radish Skin 2021 年の強力な AlphaFold2 のリリース以来、科学者はタンパク質構造予測モデルを使用して、細胞内のさまざまなタンパク質構造をマッピングし、薬剤を発見し、既知のあらゆるタンパク質相互作用の「宇宙地図」を描いてきました。ちょうど今、Google DeepMind が AlphaFold3 モデルをリリースしました。このモデルは、タンパク質、核酸、小分子、イオン、修飾残基を含む複合体の結合構造予測を実行できます。 AlphaFold3 の精度は、これまでの多くの専用ツール (タンパク質-リガンド相互作用、タンパク質-核酸相互作用、抗体-抗原予測) と比較して大幅に向上しました。これは、単一の統合された深層学習フレームワーク内で、次のことを達成できることを示しています。

Java で効率的で保守しやすい関数を記述するにはどうすればよいでしょうか?

Apr 24, 2024 am 11:33 AM

Java で効率的で保守しやすい関数を記述するにはどうすればよいでしょうか?

Apr 24, 2024 am 11:33 AM

効率的で保守しやすい Java 関数を作成するための鍵は、シンプルに保つことです。意味のある名前を付けてください。特殊な状況に対処します。適切な可視性を使用してください。

Excel関数の公式の完全なコレクション

May 07, 2024 pm 12:04 PM

Excel関数の公式の完全なコレクション

May 07, 2024 pm 12:04 PM

1. SUM 関数は、列またはセルのグループ内の数値を合計するために使用されます (例: =SUM(A1:J10))。 2. AVERAGE 関数は、列またはセルのグループ内の数値の平均を計算するために使用されます (例: =AVERAGE(A1:A10))。 3. COUNT 関数。列またはセルのグループ内の数値またはテキストの数をカウントするために使用されます。例: =COUNT(A1:A10)。 4. IF 関数。指定された条件に基づいて論理的な判断を行い、結果を返すために使用されます。対応する結果。

C++関数のデフォルトパラメータと可変パラメータの長所と短所の比較

Apr 21, 2024 am 10:21 AM

C++関数のデフォルトパラメータと可変パラメータの長所と短所の比較

Apr 21, 2024 am 10:21 AM

C++ 関数のデフォルト パラメーターの利点には、呼び出しの簡素化、可読性の向上、エラーの回避などがあります。欠点は、柔軟性が限られていることと、名前の制限があることです。可変引数パラメーターの利点には、無制限の柔軟性と動的バインディングが含まれます。欠点としては、複雑さの増大、暗黙的な型変換、デバッグの難しさなどが挙げられます。

カスタム PHP 関数と定義済み関数の違いは何ですか?

Apr 22, 2024 pm 02:21 PM

カスタム PHP 関数と定義済み関数の違いは何ですか?

Apr 22, 2024 pm 02:21 PM

カスタム PHP 関数と定義済み関数の違いは次のとおりです。 スコープ: カスタム関数はその定義のスコープに限定されますが、事前定義関数はスクリプト全体からアクセスできます。定義方法: カスタム関数は function キーワードを使用して定義されますが、事前定義関数は PHP カーネルによって定義されます。パラメータの受け渡し: カスタム関数はパラメータを受け取りますが、事前定義された関数はパラメータを必要としない場合があります。拡張性: カスタム関数は必要に応じて作成できますが、事前定義された関数は組み込みで変更できません。