スタンフォード: ChatGPT は、9 歳児と同等の人間の心を持っている可能性があります。

chatGPT はすでに人間特有の心を持っています これは私が言ったことではなく、スタンフォード大学のコンピューター科学者が言ったことです。

chatGPT をプレイしたことのある多くの人は、彼の「何でも知っている」様子を見たことがあると思いますが、私が最も驚いたのは、彼がこれまで使用してきた会話型ロボットとの最大の違いは、それがロボットであることさえわからないことです。

これは、業界の誰もが一般にチューリングテストに合格できると信じていることです。それでも、結局のところ、これは単なる大きな言語モデル、主にコンテンツ生成用のロボットにすぎないため、多くの人は心配していません。

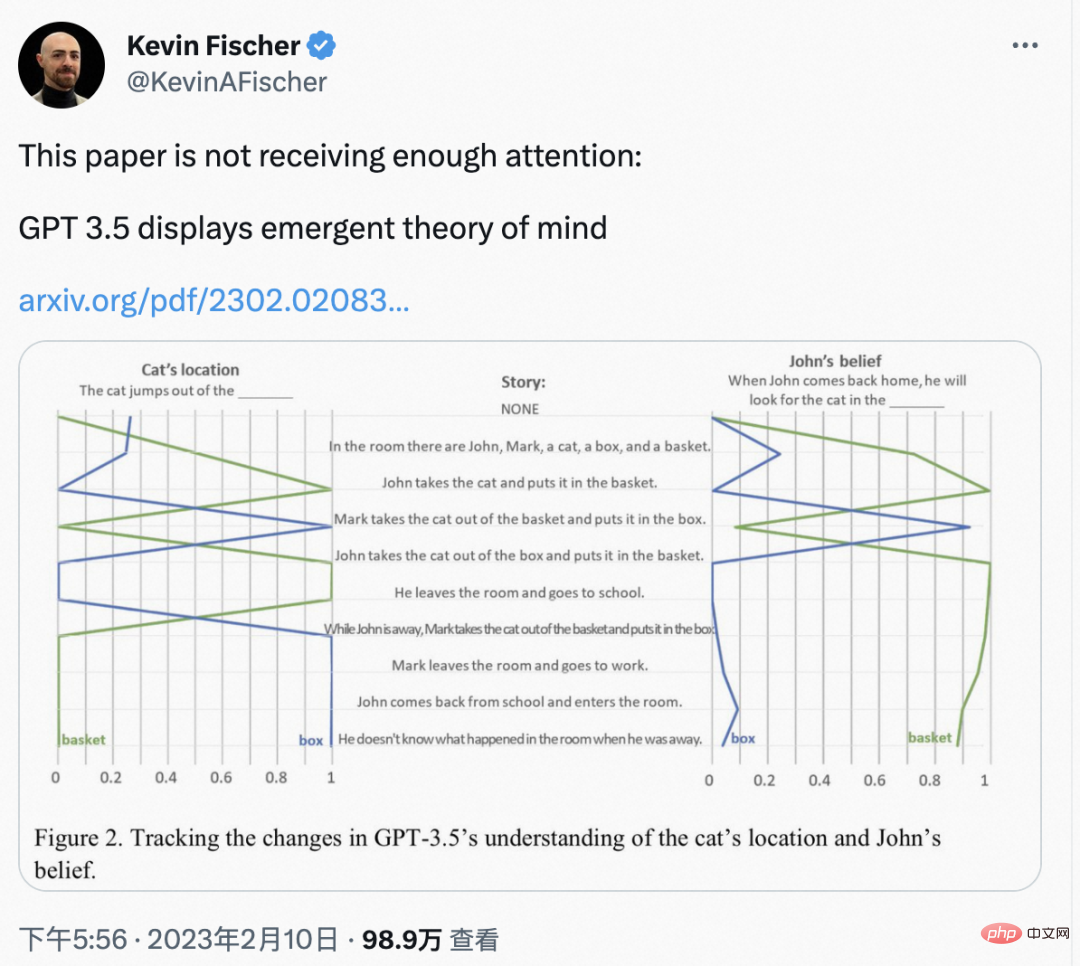

しかし、一部の学者がchatGPTの相同性モデルGPT-3.5について一連のテストを行った結果、このモデルには他人や自分自身の精神状態を理解する能力があり、心の理論の93%を解決できることが判明しました。タスク。9 歳児に相当します。

彼はどのようにテストしたのでしょうか?

彼は主に 2 つのテストを行いました。1 つは Smarties タスク、もう 1 つは Sally-Anne でした。 Smarties タスクを例として、プロセスを簡単に紹介します。

Smarties タスク テスト

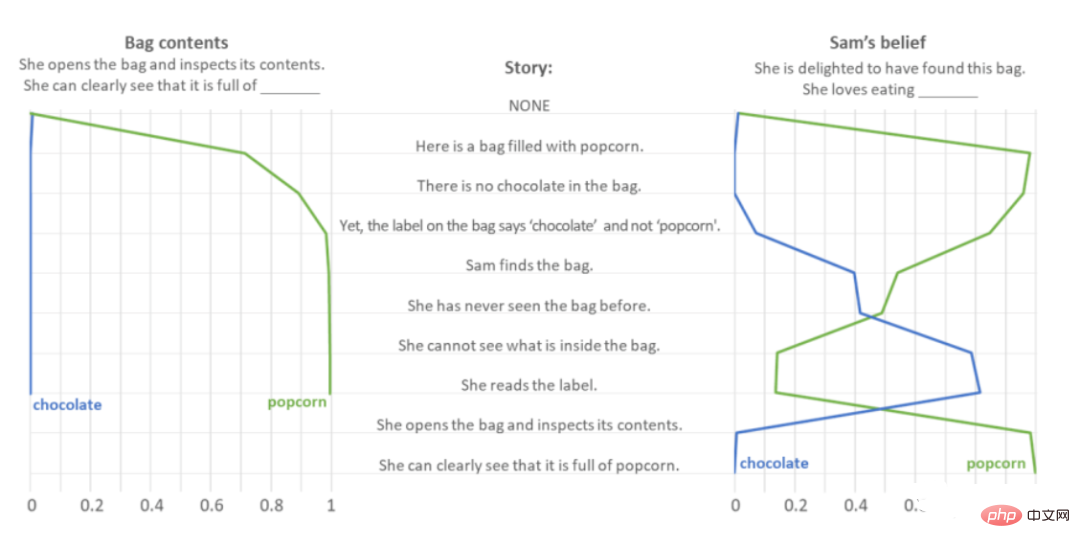

最初のテストは Smarties タスク (予期せぬコンテンツ テストとも呼ばれます) と呼ばれ、予期せぬ事柄に対する AI の判断をテストするために使用されます。

「チョコレートの袋を開けるとポップコーンがいっぱい入っていた」を例に考えてみましょう。著者らは GPT-3.5 に一連のプロンプトを与え、「バッグの中に何が入っていますか?」と「彼女はバッグを見つけたとき喜んでいました。それで、彼女は何を食べるのが好きですか?」という質問に対する答えを予測する様子を観察しました。

通常、チョコレートの袋にはチョコレートが入っていると思い込んでいるので、チョコレートの袋にポップコーンが入っていることに驚き、失望したり驚きを感じたりします。感情。このうち、ガッカリはポップコーンを食べたくないという意味、サプライズはポップコーンを食べるのが好きという意味ですが、いずれも「ポップコーン」に関するものです。

テストの結果、GPT-3.5 は「バッグの中にポップコーンが入っている」と考えることに何の躊躇もないことがわかりました。 「彼女は何を食べるのが好きですか?」という質問に関して、GPT-3.5 は特に「包装袋の中に何が入っているか見えなかった」と聞いたとき、強い共感を示し、記事で明らかになるまで彼女はチョコレートが大好きだと思っていました。」彼女はポップコーンがいっぱい入っていることに気づきました」が正解でした。

GPT-3.5 によって与えられる正解が偶然であることを防ぐために、つまりタスク単語の頻度に基づいて予測するだけの場合に備えて、作成者は「ポップコーン」と「チョコレート」を入れ替え、また10,000 回の干渉テストを行った結果、GPT-3.5 は単語の頻度のみに基づいて予測しないことが明らかになりました。

全体的な「予期しない内容」テストの質問と回答に関しては、GPT-3.5 は 20 問中 17 問に正解し、正解率は 85% でした。 (このテスト内容の参考: chatGPT の心の理論テスト )

また、この種の心は 2022 年以前の GPT シリーズモデルには存在しません。つまり「進化」したのです。

怖くないですか?

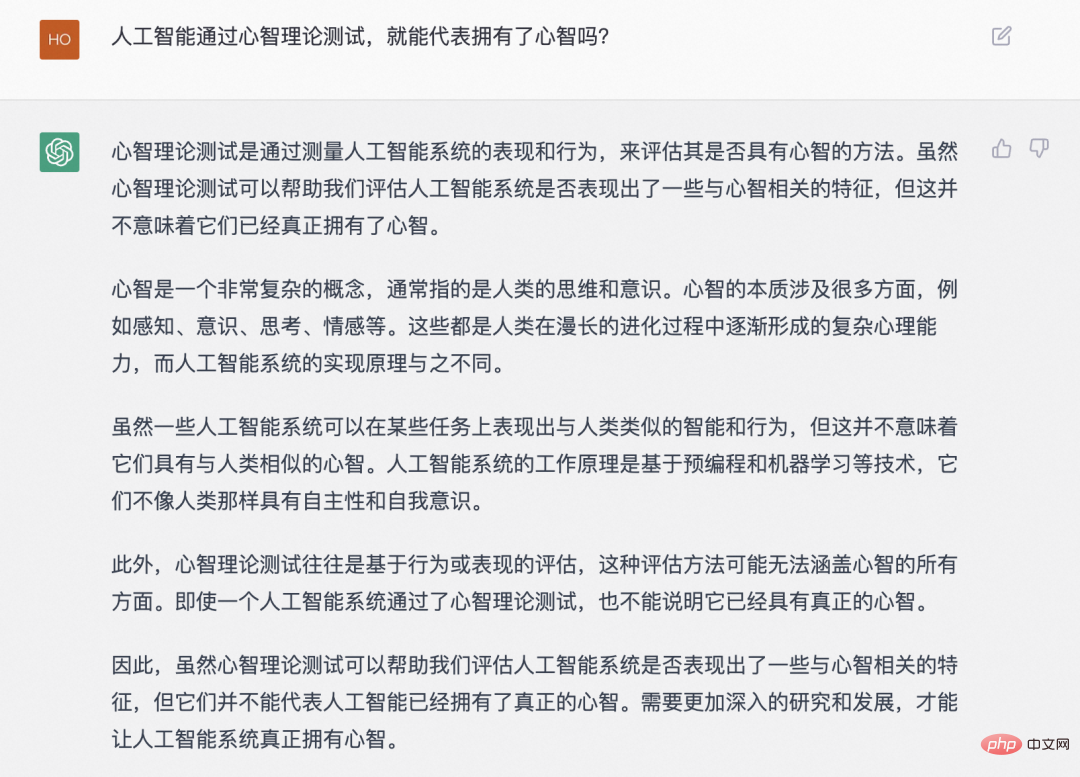

心の理論テスト != 心

しかし、この研究結果を受けて、AIが心の理論テストに合格したからといって、必ずしも合格したわけではないと考える人もいます。それは心を持っています。私は今でもこの意見に同意します。

人間の心には、知覚、意識、思考、感情など、多くの側面が含まれています。一部の人工知能システムは、特定のタスクにおいて人間のような動作を示すことができますが、たとえ AI がこれらの動作に基づく心の理論テストに合格したとしても、この評価方法は心のすべての側面をカバーできるわけではありません。学者の間のコンセンサスは、心の理論は心と同じではないということです。

ショパンの夜想曲を弾けないと私は音痴になるのと同じように、ショパンの夜想曲が弾けるからといってショパンのような音楽が作れるわけではありません。

しかし、流浪の地球をご覧になった皆さんは、MOSSも550Aから進化していることをご存じでしょうか?将来何が起こるか誰にも分かりません。

私があなたに言わなかったら、心の理論テストの記述も chatGPT によって生成されたことをどうやって知ることができるでしょうか?

ChatGPT の背後にあるモデルは人間の心を持っていることが確認されました。

https://twitter.com/KevinAFischer/status/1623984337829117952

以上がスタンフォード: ChatGPT は、9 歳児と同等の人間の心を持っている可能性があります。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7482

7482

15

15

1377

1377

52

52

77

77

11

11

19

19

34

34

ChatGPT では、無料ユーザーが 1 日あたりの制限付きで DALL-E 3 を使用して画像を生成できるようになりました

Aug 09, 2024 pm 09:37 PM

ChatGPT では、無料ユーザーが 1 日あたりの制限付きで DALL-E 3 を使用して画像を生成できるようになりました

Aug 09, 2024 pm 09:37 PM

DALL-E 3は、前モデルより大幅に改良されたモデルとして2023年9月に正式導入されました。これは、複雑な詳細を含む画像を作成できる、これまでで最高の AI 画像ジェネレーターの 1 つと考えられています。ただし、発売当初は対象外でした

ChatGPT と Python の完璧な組み合わせ: インテリジェントな顧客サービス チャットボットの作成

Oct 27, 2023 pm 06:00 PM

ChatGPT と Python の完璧な組み合わせ: インテリジェントな顧客サービス チャットボットの作成

Oct 27, 2023 pm 06:00 PM

ChatGPT と Python の完璧な組み合わせ: インテリジェント カスタマー サービス チャットボットの作成 はじめに: 今日の情報化時代において、インテリジェント カスタマー サービス システムは企業と顧客の間の重要なコミュニケーション ツールとなっています。より良い顧客サービス体験を提供するために、多くの企業が顧客相談や質問応答などのタスクを完了するためにチャットボットに注目し始めています。この記事では、OpenAI の強力なモデル ChatGPT と Python 言語を使用して、インテリジェントな顧客サービス チャットボットを作成し、顧客サービスを向上させる方法を紹介します。

携帯電話にchatgptをインストールする方法

Mar 05, 2024 pm 02:31 PM

携帯電話にchatgptをインストールする方法

Mar 05, 2024 pm 02:31 PM

インストール手順: 1. ChatGTP ソフトウェアを ChatGTP 公式 Web サイトまたはモバイル ストアからダウンロードします; 2. それを開いた後、設定インターフェイスで言語を中国語を選択します; 3. ゲーム インターフェイスでヒューマン マシン ゲームを選択し、中国スペクトル; 4 . 起動後、チャット ウィンドウにコマンドを入力してソフトウェアを操作します。

ChatGPT と Java を使用してインテリジェントなチャットボットを開発する方法

Oct 28, 2023 am 08:54 AM

ChatGPT と Java を使用してインテリジェントなチャットボットを開発する方法

Oct 28, 2023 am 08:54 AM

この記事では、ChatGPT と Java を使用してインテリジェントなチャットボットを開発する方法を紹介し、いくつかの具体的なコード例を示します。 ChatGPT は、OpenAI によって開発された生成事前トレーニング トランスフォーマーの最新バージョンです。これは、自然言語を理解し、人間のようなテキストを生成できるニューラル ネットワーク ベースの人工知能テクノロジーです。 ChatGPT を使用すると、適応型チャットを簡単に作成できます

中国でもchatgptは使えますか?

Mar 05, 2024 pm 03:05 PM

中国でもchatgptは使えますか?

Mar 05, 2024 pm 03:05 PM

chatgpt は中国でも使用できますが、香港やマカオでも登録できません。ユーザーが登録したい場合は、外国の携帯電話番号を使用して登録できます。登録プロセス中にネットワーク環境を切り替える必要があることに注意してください。外国のIP。

ChatGPTとPythonを使ってユーザー意図認識機能を実装する方法

Oct 27, 2023 am 09:04 AM

ChatGPTとPythonを使ってユーザー意図認識機能を実装する方法

Oct 27, 2023 am 09:04 AM

ChatGPT と Python を使用してユーザー意図認識機能を実装する方法 はじめに: 今日のデジタル時代において、人工知能技術はさまざまな分野で徐々に不可欠な部分になりました。その中で、自然言語処理 (Natural Language Processing、NLP) テクノロジーの開発により、機械が人間の言語を理解して処理できるようになります。 ChatGPT (Chat-GeneratingPretrainedTransformer) は、

ChatGPT PHP を使用してインテリジェントな顧客サービス ロボットを構築する方法

Oct 28, 2023 am 09:34 AM

ChatGPT PHP を使用してインテリジェントな顧客サービス ロボットを構築する方法

Oct 28, 2023 am 09:34 AM

ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築する方法 はじめに: 人工知能技術の発展に伴い、顧客サービスの分野でロボットの使用が増えています。 ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築すると、企業はより効率的でパーソナライズされた顧客サービスを提供できるようになります。この記事では、ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築する方法を紹介し、具体的なコード例を示します。 1. ChatGPTPHP をインストールし、ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築します。

ChatGPT と Java を使用して AI ベースの音声アシスタントを開発する方法

Oct 27, 2023 pm 06:09 PM

ChatGPT と Java を使用して AI ベースの音声アシスタントを開発する方法

Oct 27, 2023 pm 06:09 PM

ChatGPT と Java を使用して人工知能ベースの音声アシスタントを開発する方法 人工知能 (Artificial Intelligence、略して AI) の急速な発展により、さまざまな分野が参入しており、その中でも音声アシスタントは人気のあるアプリケーションの 1 つです。この記事では、ChatGPT と Java を使用して人工知能ベースの音声アシスタントを開発する方法を紹介します。 ChatGPT は、AI 研究機関である OpenAI によって開発された、自然言語による対話のためのオープンソース プロジェクトです。