ハルビン工業大学と南洋工業大学が世界初の「マルチモーダルディープフェイク検出と測位」モデルを提案:AIGCにフェイクを隠す場所を与えない

安定拡散などの視覚生成モデルの急速な発展により、高忠実度の顔画像が自動的に偽造される可能性があり、ディープフェイクの問題はますます深刻になっています。

ChatGPT のような大規模な言語モデルの出現により、大量の偽記事が簡単に生成され、悪意を持って虚偽の情報が拡散される可能性もあります。

この目的を達成するために、画像およびテキスト モダリティにおける上記の AIGC テクノロジーの偽造に対処する一連のシングルモーダル検出モデルが設計されました。ただし、これらの方法は、新たな捏造シナリオにおけるマルチモーダルなフェイクニュースの改ざんにうまく対処できません。

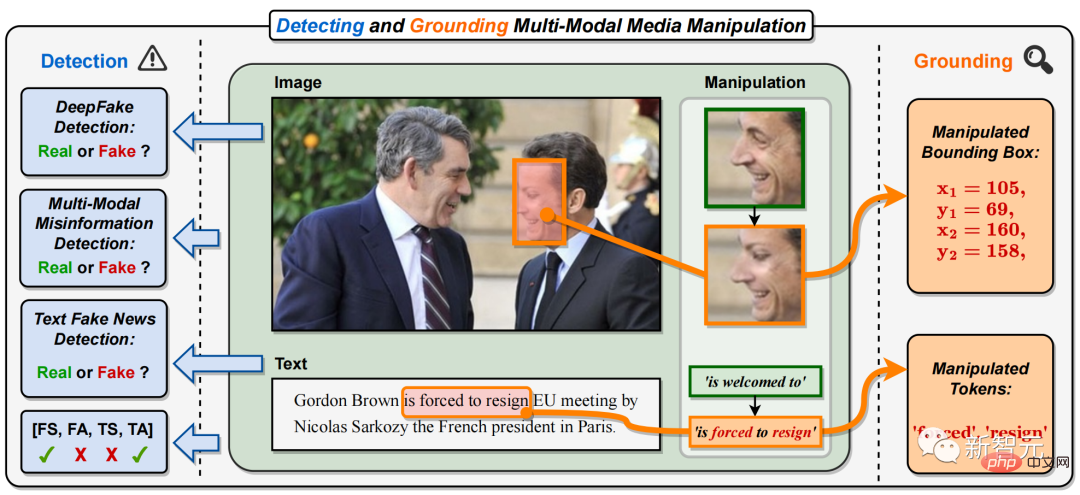

具体的には、マルチモーダルメディア改ざんでは、さまざまなニュース報道の写真に含まれる重要人物の顔 (図 1 のフランス大統領の顔) が置き換えられ、テキストキーが置き換えられます。フレーズまたは単語が改ざんされています (図 1 では、肯定的なフレーズ「歓迎します」が否定的なフレーズ「辞任を強いられます」に改ざんされています)。

これにより、主要なニュース人物の身元が変更または隠蔽されるだけでなく、ニューステキストの意味が改変または誤解され、大規模に拡散されるマルチモーダルなフェイクニュースが作成されます。インターネット上で。

## 図 1. この論文では、マルチモーダル メディア改ざんを検出および特定するタスクを提案しています (DGM4) )。既存のシングルモーダル DeepFake 検出タスクとは異なり、DGM4 は、入力された画像とテキストのペアが true か false かを予測するだけでなく、より詳細な改ざんタイプを検出し、画像改ざん領域の位置を特定しようとします。テキスト改ざん、単語。このタスクでは、真と偽のバイナリ分類に加えて、改ざん検出についてのより包括的な説明と深い理解を提供します。

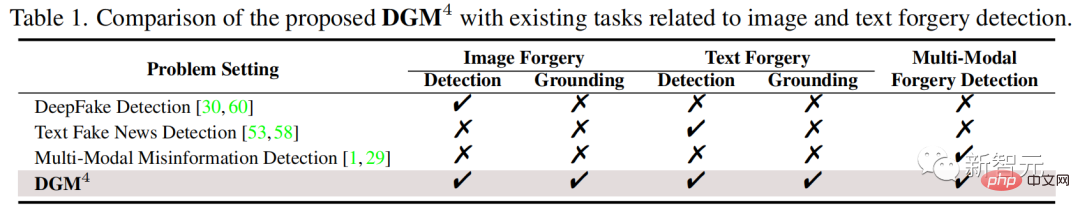

#表 1: 提案された DGM4 と既存の画像およびテキストの偽造検出 関連タスクの比較マルチモーダルメディア改ざんタスクの検出と特定

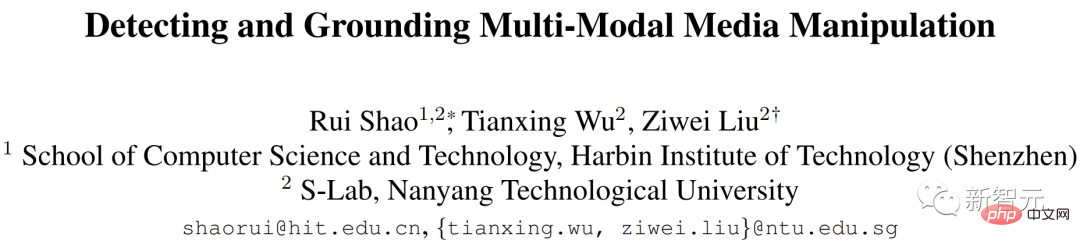

この新しい課題を理解するために、ハルビン工業大学 (深セン) と南洋理工大学の研究が行われています。研究者らは、マルチモーダルメディア改ざん (DGM4) を検出して特定するタスクを提案し、DGM4 データセットを構築してオープンソース化し、さらにマルチモーダル階層改ざん推論も提案しました。モデル。現在、この作品は CVPR 2023 に含まれています。

On 記事のアドレス: https://arxiv.org/abs /2304.02556

GitHub:https://github.com/rshaojimmy/MultiModal-DeepFake

#プロジェクトのホームページ: https://rshaojimmy.github.io/Projects/MultiModal-DeepFake

図 1 および表 1 に示すように、検出また、マルチモーダル メディア操作の検出と接地 (DGM4) と既存のシングルモーダル改ざん検出の違いは次のとおりです。

1) とは異なります。既存の DeepFake 画像検出および偽テキスト検出手法では、単一モーダルの偽情報のみを検出できるため、DGM4 では画像とテキストのペアにおけるマルチモーダリティの同時検出が必要です。 ##2) バイナリ分類に焦点を当てた既存の DeepFake 検出とは異なり、DGM4 はさらに、画像改ざん領域とテキスト改ざん単語の特定を考慮します。これには、画像とテキストのモダリティ間の改ざんについて、より包括的かつ詳細な推論を実行する検出モデルが必要です。

マルチモーダル メディア改ざんデータ セットの検出と特定DGM

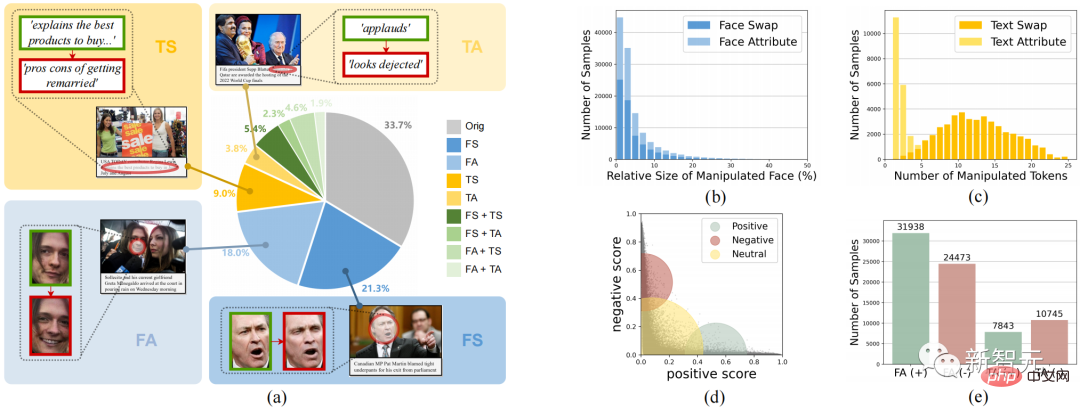

4の研究をサポートするために、図 2 に示すように、この研究の貢献 世界初の

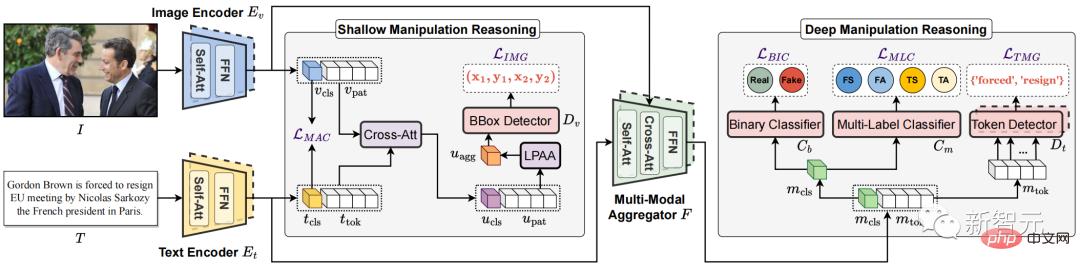

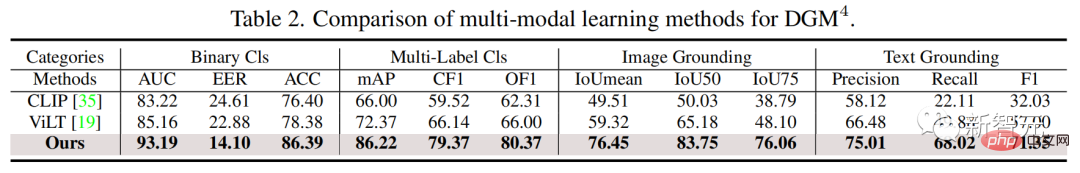

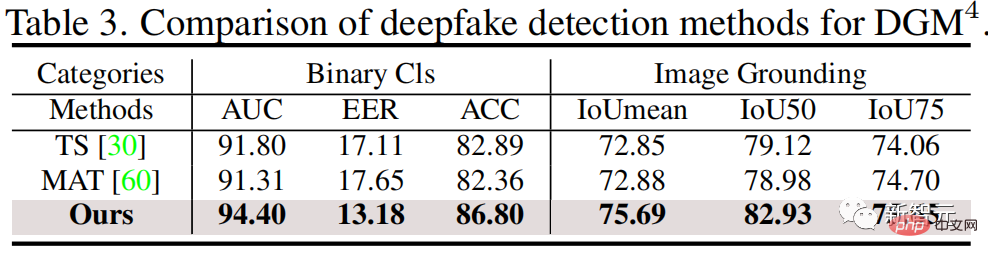

マルチモーダルメディア改ざんの検出と位置特定(DGM4)データセットを開発しました。 #図 2. DGM4データセット DGM 4 データセットでは、顔置換改ざん (FS)、顔属性改ざん (FA)、テキスト置換改ざん (TS)、テキスト属性改ざん (TA) の 4 種類の改ざんを調査します。 図 2 は、(a) 改ざんの種類の数の分布、(b) ほとんどの改ざんされた領域を含む、DGM4 の全体的な統計情報を示しています。画像のサイズは小さい(特に顔属性の改ざんの場合)、(c) テキスト属性の改ざんは、テキスト置換改ざんよりも改ざんされた単語が少ない、(d) テキスト感情スコアの分布、(e) 各改ざんタイプのサンプル数。 このデータは、77,426 の元の画像とテキストのペアと 152,574 の改ざんされたサンプル ペアを含む、合計 230,000 の画像とテキストのペアのサンプルを生成しました。改ざんされたサンプルのペアには、66722 件の顔置換改ざん、56411 件の顔属性改ざん、43546 件のテキスト置換改ざん、および 18588 件のテキスト属性改ざんが含まれます。 この記事では、マルチモーダル改ざんがモダリティ間で微妙な意味論的な不一致を引き起こすと考えています。したがって、モダリティ間の意味論的特徴を融合および推論することによって、改ざんされたサンプルのクロスモーダル意味論的不一致を検出することが、DGM4 に対処するこの記事の主なアイデアです。 図 3. 提案されたマルチモーダル階層型改ざん推論モデル HierArchical Multi-modal Manipulation rEasoning tRansformer (HAMMER) マルチモーダル階層改ざん推論モデル HierArchical Multi-modal Manipulation rEasoning tRansformer (HAMMER) を提案します。 具体的には、図 3 に示すように、HAMMER モデルには次の 2 つの特徴があります。 1) 浅い改ざん推論では、# を介して##操作を意識した対照学習 を使用して、画像エンコーダーとテキスト エンコーダーによって抽出された画像とテキストの単一モーダルの意味論的特徴を調整します。同時に、シングルモーダルの埋め込み機能は、情報のやり取りにクロスアテンション メカニズムを使用し、ローカル パッチ アテンション集約メカニズム (ローカル パッチ アテンション集約) が画像改ざん領域を特定するように設計されています。 ##2) 深層改ざん推論では、マルチモーダル アグリゲーターのモダリティを意識したクロスアテンション メカニズムを使用して、マルチモーダル セマンティック機能をさらに融合します。これに基づいて、特別な マルチモーダル シーケンス タグ付けとマルチモーダル マルチラベル分類 実験結果

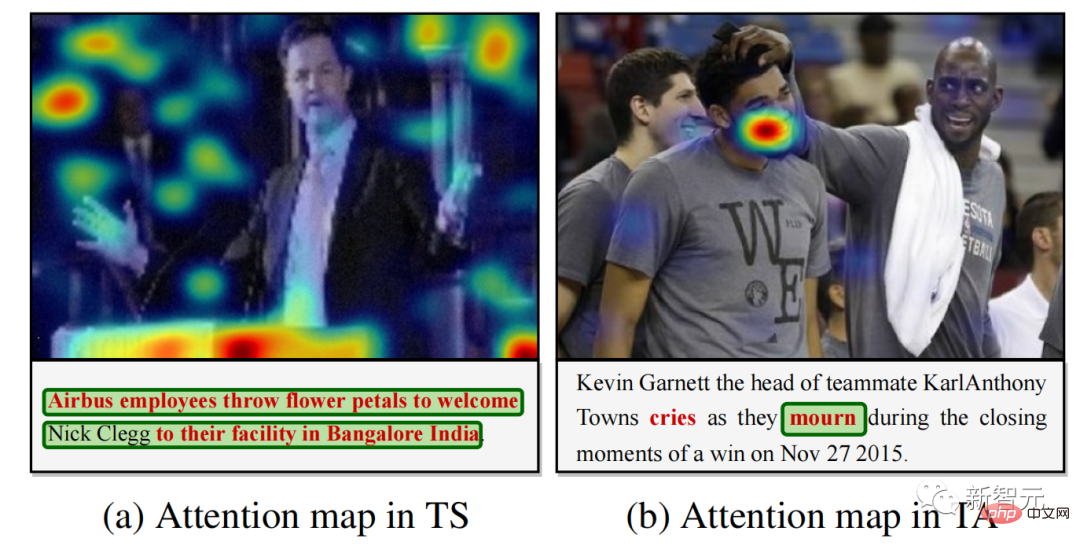

# 図 4. マルチモーダル改ざん検出と位置特定結果の視覚化 図5 . 改ざんされたテキストに対するモデル改ざん検出アテンションの視覚化 図 4 は、マルチモーダル改ざん検出と位置特定の視覚的な結果を示しており、HAMMER が改ざん検出と改ざん検出を正確かつ同時に実行できることを示しています。ローカリゼーションタスク。図 5 は、改ざんされた単語に対するモデル アテンションの視覚化結果を示しており、HAMMER が改ざんされたテキストと意味的に矛盾する画像領域に焦点を当てることによって、マルチモーダルな改ざん検出と位置特定を実行することをさらに示しています。 この作業のコードとデータ セットのリンクは、このプロジェクトの GitHub で共有されています。誰でもこの GitHub リポジトリにスターを付けて、DGM4 を使用することを歓迎します。データセットとハンマー DGM4 問題を勉強しましょう。 DeepFake の分野は、画像の単一モダリティ検出だけでなく、より広範なマルチモダリティ改ざん検出の問題でもあり、早急に解決する必要があります。

この研究は、マルチモーダルなフェイクニュースに対処するために、マルチモーダルなメディア改ざんを検出および特定するという新しい研究トピックを提案します。

以上がハルビン工業大学と南洋工業大学が世界初の「マルチモーダルディープフェイク検出と測位」モデルを提案:AIGCにフェイクを隠す場所を与えないの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7469

7469

15

15

1376

1376

52

52

77

77

11

11

19

19

29

29

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

この論文では、自動運転においてさまざまな視野角 (遠近法や鳥瞰図など) から物体を正確に検出するという問題、特に、特徴を遠近法 (PV) 空間から鳥瞰図 (BEV) 空間に効果的に変換する方法について検討します。 Visual Transformation (VT) モジュールを介して実装されます。既存の手法は、2D から 3D への変換と 3D から 2D への変換という 2 つの戦略に大別されます。 2D から 3D への手法は、深さの確率を予測することで高密度の 2D フィーチャを改善しますが、特に遠方の領域では、深さ予測に固有の不確実性により不正確さが生じる可能性があります。 3D から 2D への方法では通常、3D クエリを使用して 2D フィーチャをサンプリングし、Transformer を通じて 3D と 2D フィーチャ間の対応のアテンション ウェイトを学習します。これにより、計算時間と展開時間が増加します。