テキスト行が 3D ダイナミック シーンを生成します: Meta の「ワン ステップ」モデルは非常に強力です

テキスト行を入力するだけで 3D ダイナミック シーンを生成しますか?

はい、一部の研究者はすでにそれを行っています。現在の世代効果はまだ初期段階にあり、いくつかの単純なオブジェクトしか生成できないことがわかります。しかし、この「ワンステップ」法は依然として多くの研究者の注目を集めています。論文の中で、Meta の研究者は、テキストの説明から 3 次元の動的なシーンを生成できる方法である MAV3D (Make-A-Video3D) を初めて提案しました。

論文リンク: https://arxiv.org/abs/2301.11280

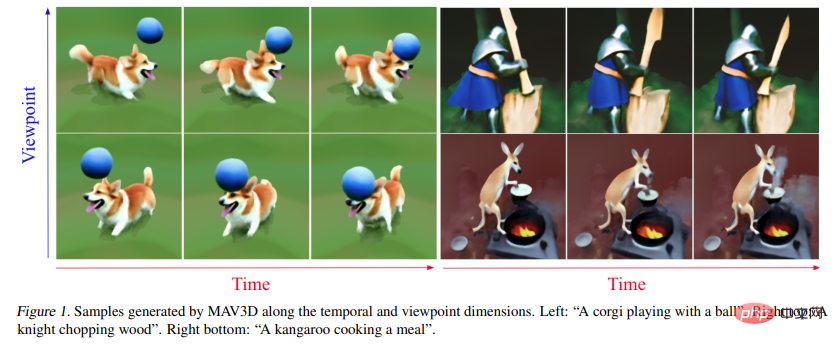

- 具体的にはこの方法では、4D 動的神経放射場 (NeRF) を使用して、テキストからビデオ (T2V) 拡散ベースのモデルをクエリすることで、シーンの外観、密度、動きの一貫性を最適化します。提供されたテキストによって生成されたダイナミック ビデオ出力は、任意のカメラ角度または角度から表示でき、任意の 3D 環境に合成できます。

- MAV3D は 3D または 4D データを必要としません。T2V モデルはテキストと画像のペアおよびラベルのないビデオでのみトレーニングされます。

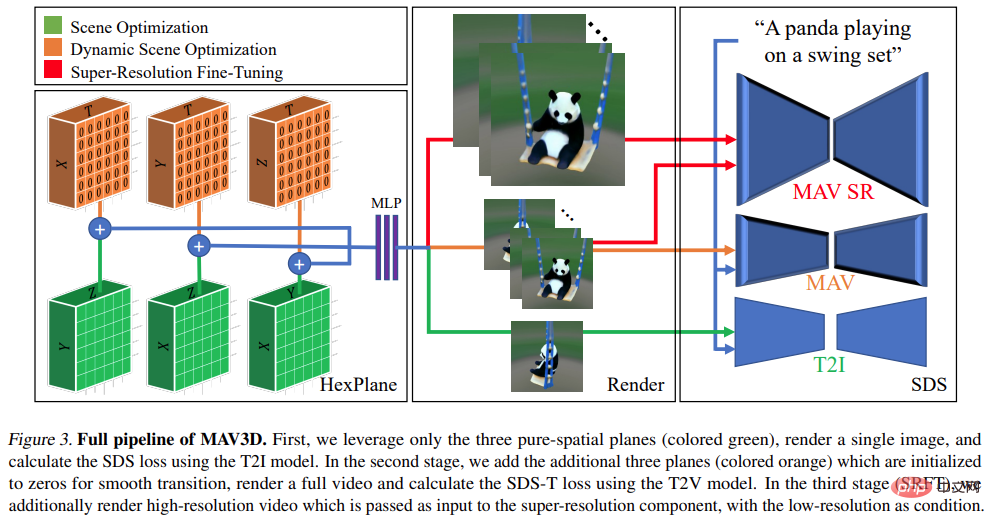

テキストから 4D ダイナミック シーンを生成する MAV3D の効果を見てみましょう:

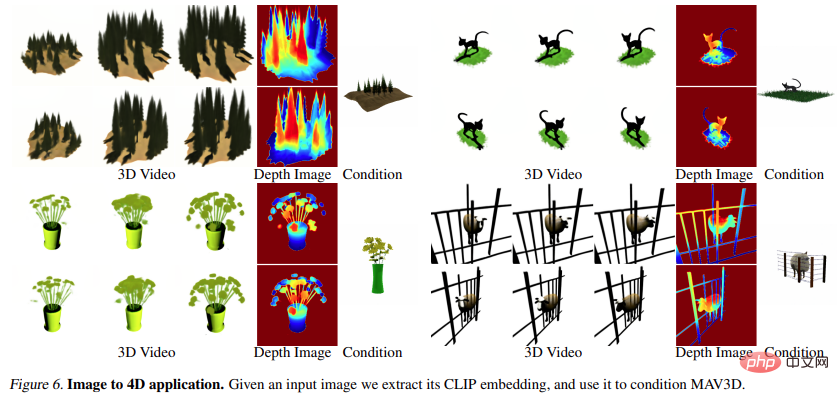

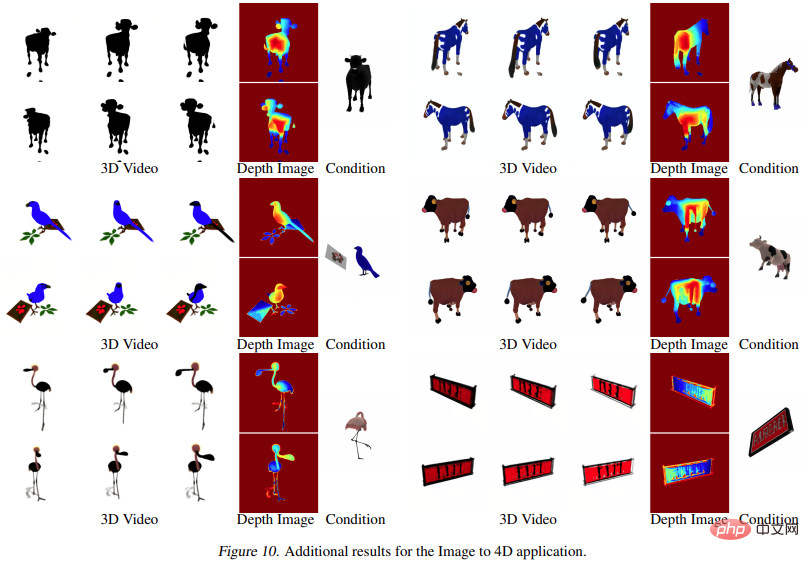

#さらに、画像から 4D、エフェクトに直接移動することもできます。

##研究者らは、包括的な調査を通じて証明しました。定量的および定性的実験 以前に確立された内部ベースラインに基づくこの方法の有効性も向上しました。これは、テキストの説明に基づいて 3D ダイナミック シーンを生成する最初の方法であると報告されています。

方法

より高いレベルから、テキスト プロンプト p が与えられると、空間および時間の任意の点でプロンプトに一致するシーンの外観をシミュレートする 4D 表現を研究で適合させることができます。ペアのトレーニング データがなければ、研究では  の出力を直接監視できませんが、一連のカメラ ポーズ が与えられると、

の出力を直接監視できませんが、一連のカメラ ポーズ が与えられると、

から画像シーケンスをレンダリングできます。

から画像シーケンスをレンダリングできます。

そしてそれらをビデオ V にスタックします。次に、テキスト プロンプト p とビデオ V が、フリーズされ事前トレーニングされた T2V 拡散モデルに渡され、ビデオの信頼性とプロンプトの配置がスコア付けされ、SDS (スコア蒸留サンプリング) を使用してシーン パラメーター θ の更新方向が計算されます。

そしてそれらをビデオ V にスタックします。次に、テキスト プロンプト p とビデオ V が、フリーズされ事前トレーニングされた T2V 拡散モデルに渡され、ビデオの信頼性とプロンプトの配置がスコア付けされ、SDS (スコア蒸留サンプリング) を使用してシーン パラメーター θ の更新方向が計算されます。

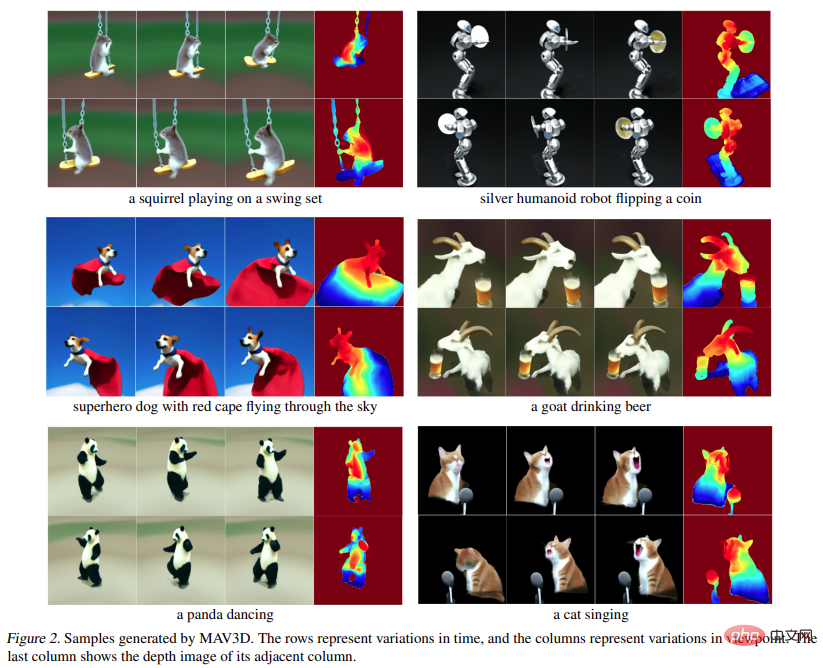

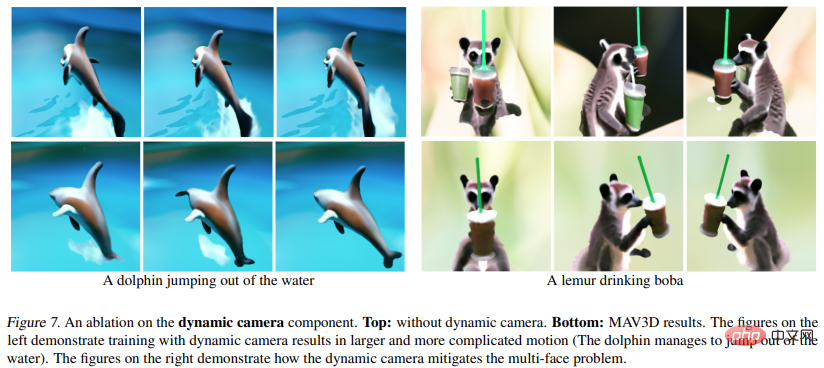

上記のパイプラインは、DreamFusion の拡張機能とみなすことができ、シーン モデルに時間次元を追加し、テキストからイメージへの変換 (T2I) の代わりに T2V モデルを使用します。 )監修用モデル。ただし、高品質の Text-to-4D 生成を実現するには、さらなる革新が必要です:

- まず、柔軟なシーン モーション モデリングを可能にする新しい方法が必要です。4D 表現;

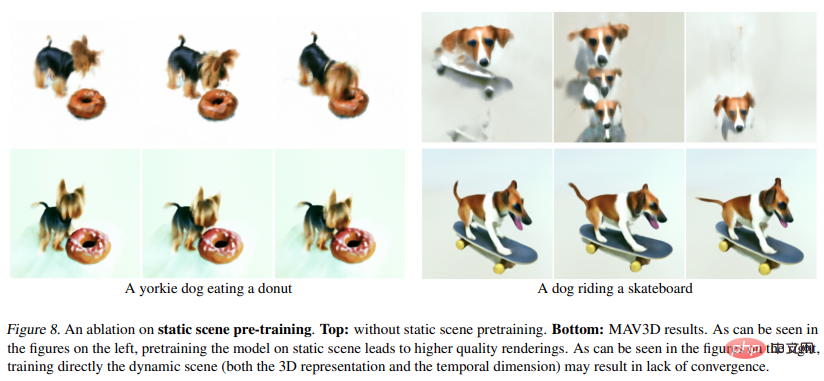

- # 第 2 に、ビデオ品質を向上させ、モデルの収束を改善するには、マルチレベルの静的から動的への最適化スキームが必要です。このスキームでは、いくつかのモーション レギュラライザーを使用して実際のモーションを生成します。

- 3 番目に、超解像度微調整 (SRFT) を使用してモデルの解像度を向上させる必要があります。

具体的な手順については、以下の図を参照してください:

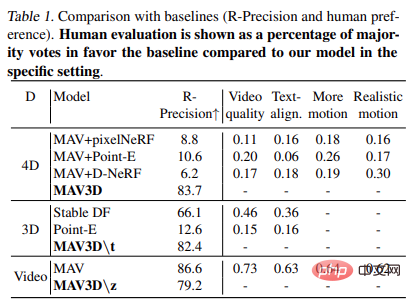

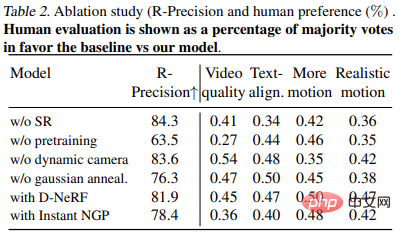

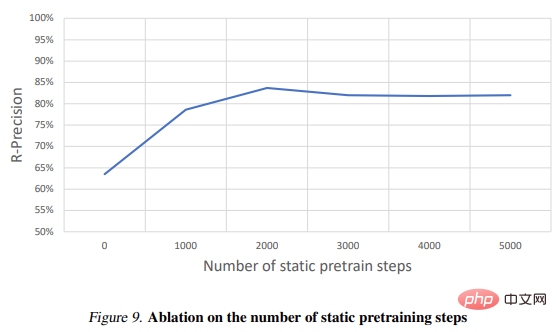

実験では、研究者らはテキストの説明から動的なシーンを生成する MAV3D の機能を評価しました。まず、研究者らは Text-To-4D タスクにおけるこの方法の有効性を評価しました。 MAV3D がこの課題に対する最初のソリューションであると報告されているため、研究ではベースラインとして 3 つの代替方法を開発しました。次に、T2V および Text-To-3D サブタスク モデルの簡易バージョンを評価し、文献内の既存のベースラインと比較します。第三に、包括的なアブレーション研究により、方法設計が正当化されます。 4 番目に、実験では動的 NeRF を動的メッシュに変換し、最終的にモデルを Image-to-4D タスクに拡張するプロセスを説明します。

メトリクス

CLIP R-Precision を使用して生成されたビデオを評価する研究。テキストと生成されたシーン間の一貫性を測定します。 。報告されるメトリックは、レンダリングされたフレームから入力プロンプトを取得する精度です。私たちは、CLIP の ViT-B/32 バリアントを使用して、さまざまなビューとタイム ステップでフレームを抽出し、生成された 2 つのビデオのそれぞれについて人間の評価者に好みを尋ねることによって 4 つの定性的メトリクスも使用しました。 (i) ビデオ品質; ( ii) テキストプロンプトへの忠実度、(iii) アクティビティの量、(iv) 動きのリアリズム。テキスト プロンプトのセグメンテーションで使用されるすべてのベースラインとアブレーションを評価しました。

図 1 と図 2 は例です。さらに詳しい視覚化については、make-a-video3d.github.io を参照してください。

# 結果

表 1 に比較を示します。ベースラインまで (R - 精度と人間の好み)。人間によるレビューは、特定の環境におけるモデルと比較したベースライン多数派を支持する投票の割合として表示されます。

リアルタイム レンダリング

従来のグラフィック エンジンを使用する仮想現実やゲームなどのアプリケーションには、テクスチャメッシュなどの標準形式。 HexPlane モデルは、以下に示すようにアニメーション メッシュに簡単に変換できます。まず、マーチング キューブ アルゴリズムを使用して、各時間 t で生成された不透明フィールドから単純なメッシュが抽出され、その後 (効率化のため) メッシュが抽出され、ノイズの多い小さな連結成分が除去されます。 XATLAS アルゴリズムは、メッシュ頂点をテクスチャ アトラスにマッピングするために使用されます。テクスチャは、各頂点を中心とする小さな球内で平均化された HexPlane カラーを使用して初期化されます。最後に、微分可能メッシュを使用して HexPlane によってレンダリングされたいくつかのサンプル フレームとよりよく一致するようにテクスチャがさらに最適化されます。これにより、市販の 3D エンジンで再生できるテクスチャ メッシュのコレクションが生成されます。#Image to 4D

図 6 と図 10 は、指定された入力画像から生成できるメソッドを示しています。奥行きと動き、結果として 4D アセットが得られます。

## ※研究の詳細については原論文を参照してください。

以上がテキスト行が 3D ダイナミック シーンを生成します: Meta の「ワン ステップ」モデルは非常に強力ですの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7563

7563

15

15

1385

1385

52

52

84

84

11

11

28

28

99

99

ddrescue を使用して Linux 上のデータを回復する

Mar 20, 2024 pm 01:37 PM

ddrescue を使用して Linux 上のデータを回復する

Mar 20, 2024 pm 01:37 PM

DDREASE は、ハード ドライブ、SSD、RAM ディスク、CD、DVD、USB ストレージ デバイスなどのファイル デバイスまたはブロック デバイスからデータを回復するためのツールです。あるブロック デバイスから別のブロック デバイスにデータをコピーし、破損したデータ ブロックを残して正常なデータ ブロックのみを移動します。 ddreasue は、回復操作中に干渉を必要としないため、完全に自動化された強力な回復ツールです。さらに、ddasue マップ ファイルのおかげでいつでも停止および再開できます。 DDREASE のその他の主要な機能は次のとおりです。 リカバリされたデータは上書きされませんが、反復リカバリの場合にギャップが埋められます。ただし、ツールに明示的に指示されている場合は切り詰めることができます。複数のファイルまたはブロックから単一のファイルにデータを復元します

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhone のモバイル データ接続に遅延や遅い問題が発生していませんか?通常、携帯電話の携帯インターネットの強度は、地域、携帯ネットワークの種類、ローミングの種類などのいくつかの要因によって異なります。より高速で信頼性の高いセルラー インターネット接続を実現するためにできることがいくつかあります。解決策 1 – iPhone を強制的に再起動する 場合によっては、デバイスを強制的に再起動すると、携帯電話接続を含む多くの機能がリセットされるだけです。ステップ 1 – 音量を上げるキーを 1 回押して放します。次に、音量小キーを押して、もう一度放します。ステップ 2 – プロセスの次の部分は、右側のボタンを押し続けることです。 iPhone の再起動が完了するまで待ちます。セルラーデータを有効にし、ネットワーク速度を確認します。もう一度確認してください 修正 2 – データ モードを変更する 5G はより優れたネットワーク速度を提供しますが、信号が弱い場合はより適切に機能します

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

柔軟かつ高速な 5 本の指を備え、人間のタスクを自律的に完了する初のロボットが登場、大型モデルが仮想空間トレーニングをサポート

Mar 11, 2024 pm 12:10 PM

柔軟かつ高速な 5 本の指を備え、人間のタスクを自律的に完了する初のロボットが登場、大型モデルが仮想空間トレーニングをサポート

Mar 11, 2024 pm 12:10 PM

今週、OpenAI、Microsoft、Bezos、Nvidiaが投資するロボット企業FigureAIは、7億ドル近くの資金調達を受け、来年中に自立歩行できる人型ロボットを開発する計画であると発表した。そしてテスラのオプティマスプライムには繰り返し良い知らせが届いている。今年が人型ロボットが爆発的に普及する年になることを疑う人はいないだろう。カナダに拠点を置くロボット企業 SanctuaryAI は、最近新しい人型ロボット Phoenix をリリースしました。当局者らは、多くのタスクを人間と同じ速度で自律的に完了できると主張している。人間のスピードでタスクを自律的に完了できる世界初のロボットである Pheonix は、各オブジェクトを優しくつかみ、動かし、左右にエレガントに配置することができます。自律的に物体を識別できる

アメリカ空軍が初のAI戦闘機を公開し注目を集める!大臣はプロセス全体を通じて干渉することなく個人的にテストを実施し、10万行のコードが21回にわたってテストされました。

May 07, 2024 pm 05:00 PM

アメリカ空軍が初のAI戦闘機を公開し注目を集める!大臣はプロセス全体を通じて干渉することなく個人的にテストを実施し、10万行のコードが21回にわたってテストされました。

May 07, 2024 pm 05:00 PM

最近、軍事界は、米軍戦闘機が AI を使用して完全自動空戦を完了できるようになったというニュースに圧倒されました。そう、つい最近、米軍のAI戦闘機が初めて公開され、その謎が明らかになりました。この戦闘機の正式名称は可変安定性飛行シミュレーター試験機(VISTA)で、アメリカ空軍長官が自ら飛行させ、一対一の空戦をシミュレートした。 5 月 2 日、フランク ケンダル米国空軍長官は X-62AVISTA でエドワーズ空軍基地を離陸しました。1 時間の飛行中、すべての飛行動作が AI によって自律的に完了されたことに注目してください。ケンダル氏は「過去数十年にわたり、私たちは自律型空対空戦闘の無限の可能性について考えてきたが、それは常に手の届かないものだと思われてきた」と語った。しかし今では、