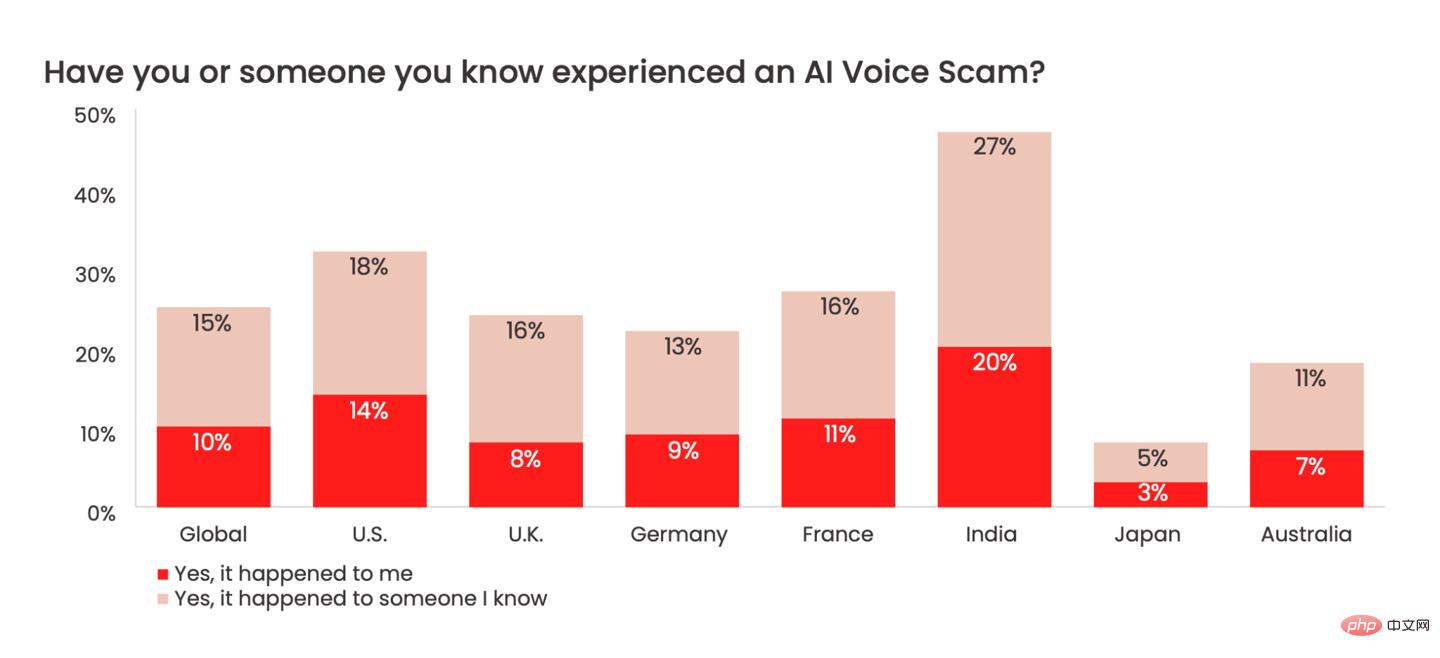

マカフィーが発表した最新のレポートによると、人工知能 (AI) を利用した音声詐欺がますます横行しており、詐欺電話を受けた人の 77% が経済的損失を引き起こすとのことです。

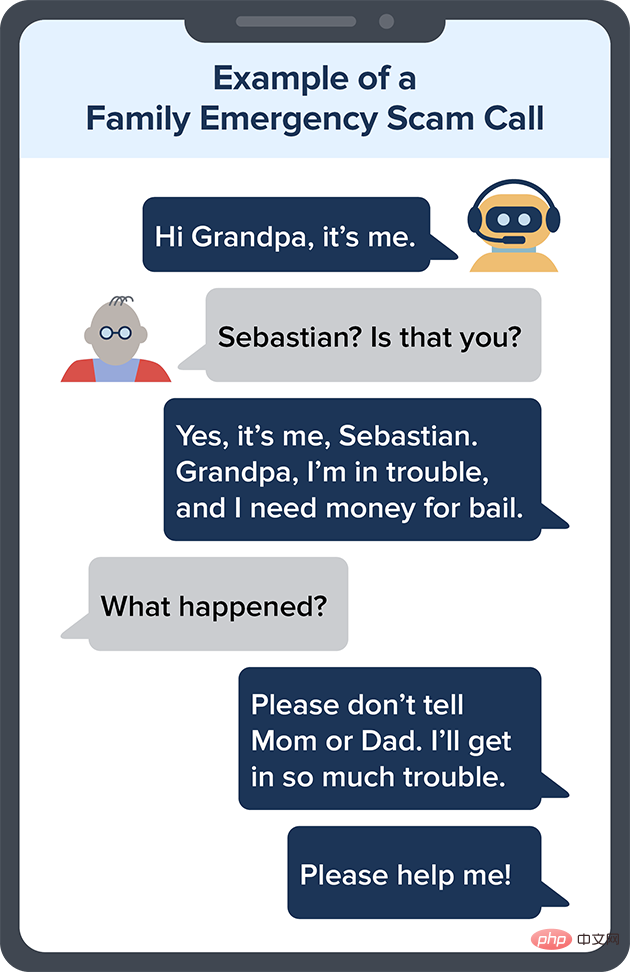

報告書では 2 つの実際のケースについて言及しました。1 つは AI を使用して被害者の親族をシミュレートし、何かのために緊急にお金が必要であると表明しました。もう 1 つは AI を使用して娘をシミュレートしました. 実際に娘が誘拐されたわけではないにもかかわらず、母親から身代金を要求された。

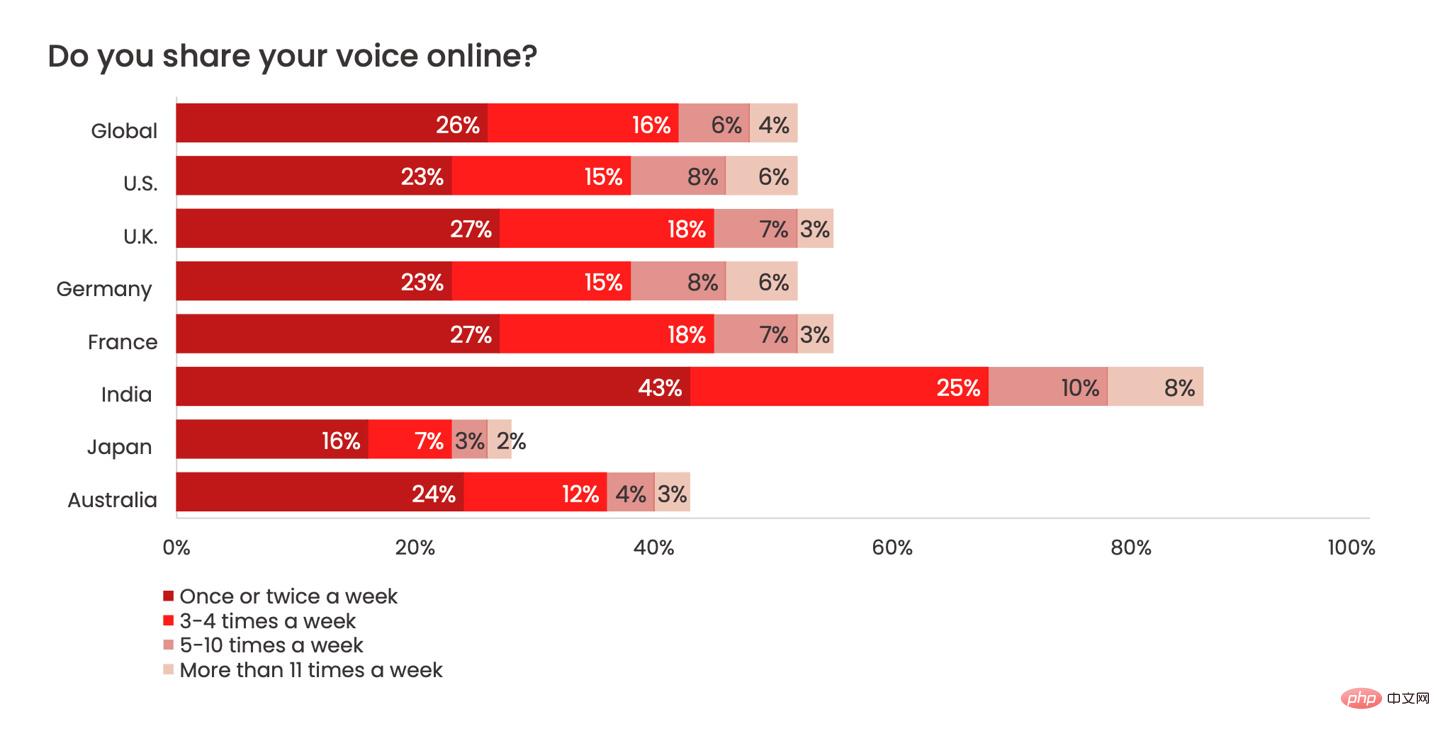

AI 音声クローン ツールは非常に安価で入手可能なため、悪意のある当事者が音声クローンを迅速かつ簡単に作成できます。サンプル音声を入手する方法は、ソーシャル メディアで自分の声を共有している人々からです。オンラインで自分の声を共有すればするほど、攻撃者があなたの声を見つけて複製することが容易になります。

添付レポートの内容は次のとおりです。

PDF] をクリックして元のレポートにアクセスしてください。

以上がAI 音声詐欺: 95% が人間の音声をシミュレートし、接続者の 77% が経済的損失を被るの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。