Xi Xiaoyao Technology Talk 原文

著者 | Xiaoxi、ZenMoore

GPT-4 の現在の最大の問題は何ですか?おそらく、彼が何もできなかったマシンの一時的な幻覚とは別に、それは入力の長さのスタックによるものでした。 GPT-4 の現在の通常バージョンの約 8000 のコンテキスト長は、一般的な会話や検索のシナリオでは十分すぎるかもしれませんが、GPT-4 の現在の基本バージョンは、コンテンツ生成やインテリジェントな読み取りなどの面でまだ多少限界があります。

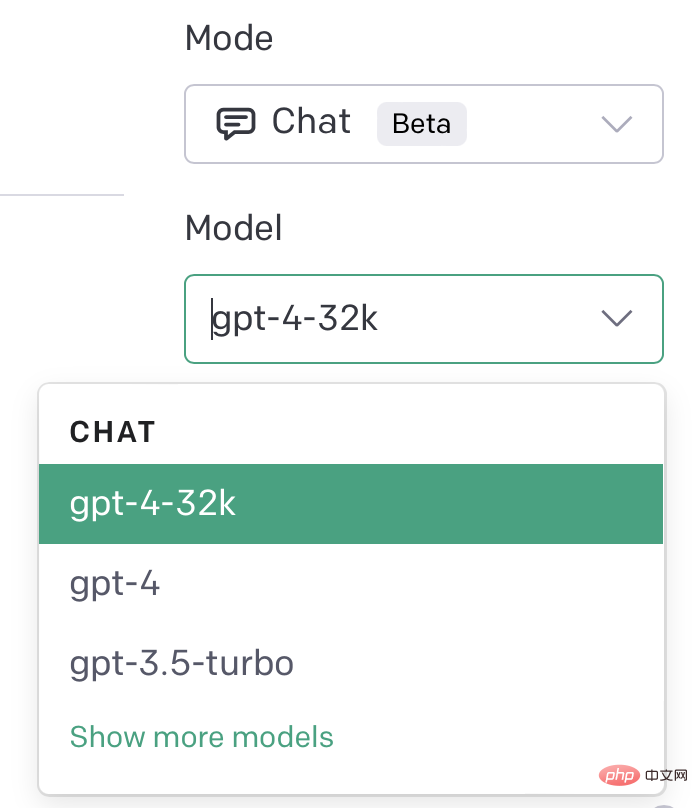

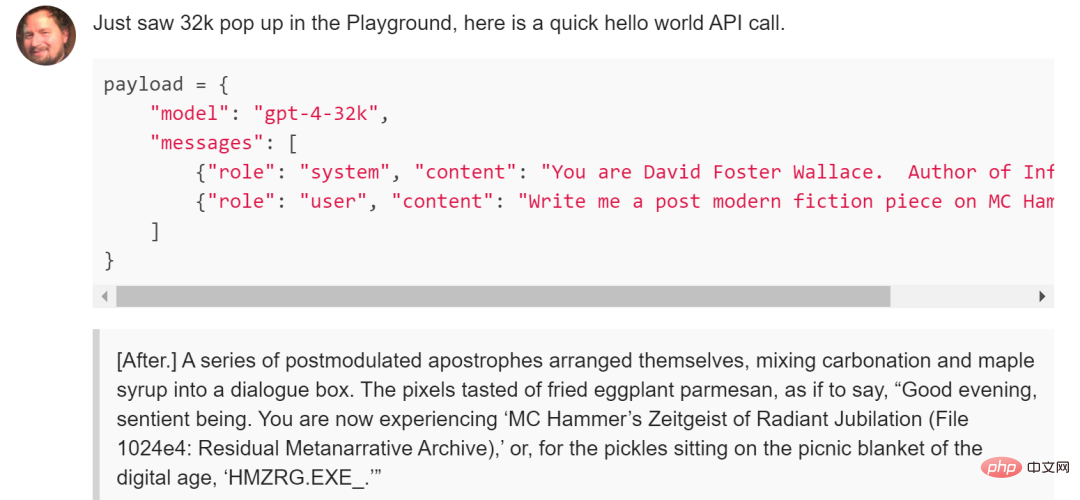

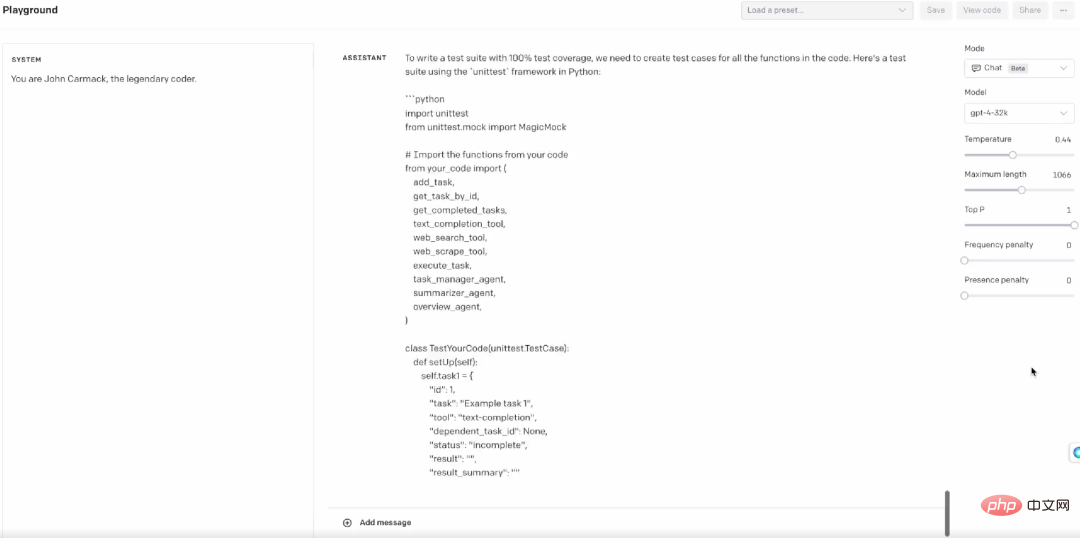

ただし、実際には GPT-4 は 32768 個のトークン長をサポートしていることも GPT-4 の記者会見で言及されましたが、まだ完全にはリリースされておらず、順次自動的に更新される予定です。この 2 日間で、32k GPT-4 の夜明けが近づいているようです。多くの GPT-4 ユーザーは、PlayGround で GPT-4 32k オプションをすでに確認できます。

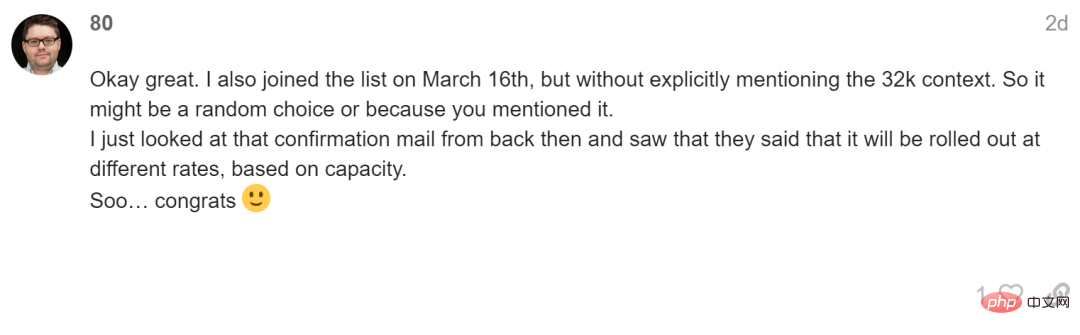

## のモデルを指定してアップグレード版を呼び出すこともできます#ただし、これは一部のユーザー向けの GPT-4 の内部テストである必要があり、待機リストの申請時間に応じて内部テストの割り当てが解放されるべきではありません。内部テストの 32k バージョンを受け取ったユーザーは、 3月16日の順番待ちリストに登録されましたが、同時に参加したものの32kバージョンのロックを解除しなかったユーザーもいます。考えられる理由の 1 つは、クローズド ベータ版を受け取ったユーザーが登録時に 32k GPT-4 に対する大きな関心を強調していたことです。

## のモデルを指定してアップグレード版を呼び出すこともできます#ただし、これは一部のユーザー向けの GPT-4 の内部テストである必要があり、待機リストの申請時間に応じて内部テストの割り当てが解放されるべきではありません。内部テストの 32k バージョンを受け取ったユーザーは、 3月16日の順番待ちリストに登録されましたが、同時に参加したものの32kバージョンのロックを解除しなかったユーザーもいます。考えられる理由の 1 つは、クローズド ベータ版を受け取ったユーザーが登録時に 32k GPT-4 に対する大きな関心を強調していたことです。

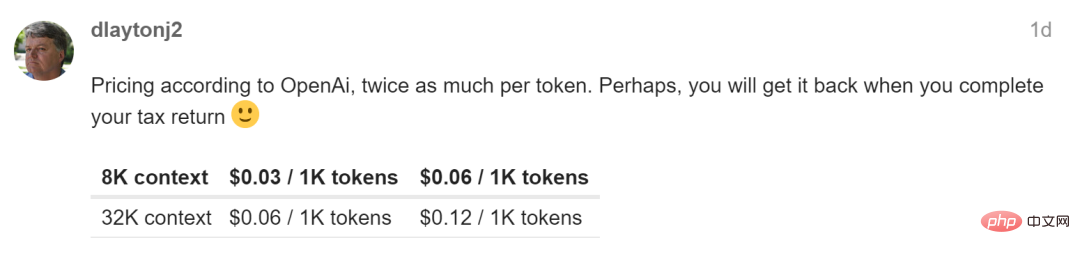

もちろん、何はともあれ、32k GPT-4 は私たちに近づいているように見えますが、32k GPT-4 はどのような想像力をもたらすでしょうか? 変化についてはどうですか?有効?結局のところ、GPT-4 の 8k バージョンよりも 2 倍高価であり、応答時間が遅くなる可能性があります...

もちろん、何はともあれ、32k GPT-4 は私たちに近づいているように見えますが、32k GPT-4 はどのような想像力をもたらすでしょうか? 変化についてはどうですか?有効?結局のところ、GPT-4 の 8k バージョンよりも 2 倍高価であり、応答時間が遅くなる可能性があります...

https://www.php.cn/link/894a200a66c2b57205af564d6883882a

プロジェクト リンク:https ://www.php.cn/link/18fe8ebf5d52c8992581f439ba783aa3

もちろん、オープンソース プロジェクトのパフォーマンスと安定性は GPT-4 に匹敵するものではありません。 GPT-4 のお誘い、近いうちに必ずお会いできると思いますので、「ペースが上がるといいな」と思います!

以上がGPT-4 は、入力長 32000 バージョンの内部テストを開始しました。招待状を受け取りましたか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。