蒸留は段階的に行うこともできます。新しい方法により、小型モデルを 2000 倍のサイズの大型モデルと同等にできるようになります。

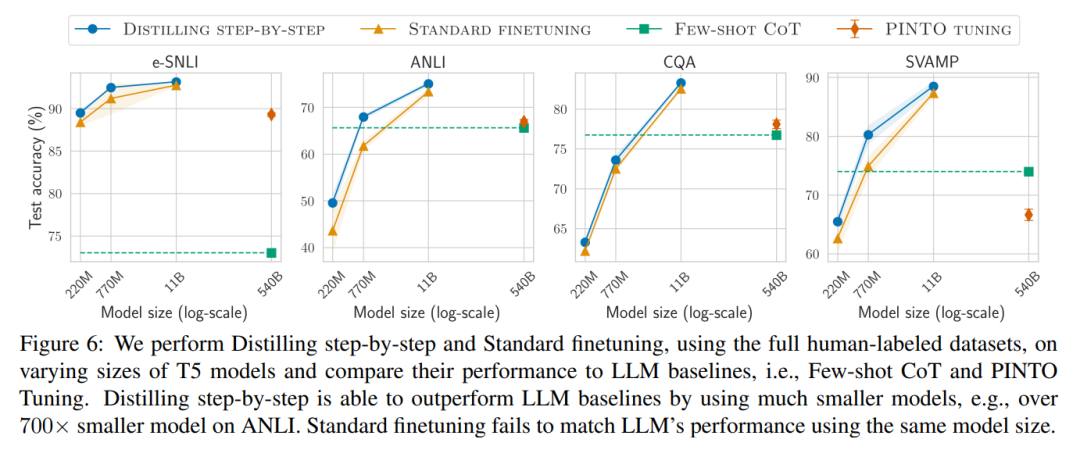

大規模な言語モデルには素晴らしい機能がありますが、規模が大きいため、その展開に必要なコストが膨大になることがよくあります。ワシントン大学は、Google Cloud Computing Artificial Intelligence Research Institute および Google Research と協力して、この問題をさらに解決し、モデルのトレーニングを支援するステップバイステップ蒸留パラダイムを提案しました。 LLM と比較して、この方法は小さなモデルをトレーニングして特定のタスクに適用する場合に効果的であり、従来の微調整や蒸留よりも必要なトレーニング データが少なくなります。ベンチマーク タスクでは、770M T5 モデルが 540B PaLM モデルよりも優れたパフォーマンスを示しました。印象的なことに、彼らのモデルは利用可能なデータの 80% しか使用していませんでした。

大規模言語モデル (LLM) は優れた少数ショット学習を実証していますが、しかし、このような大規模なモデルを実際のアプリケーションに展開することは困難です。 1,750 億パラメータ規模の LLM に対応する専用インフラストラクチャには、少なくとも 350 GB の GPU メモリが必要です。さらに、今日の最先端の LLM は 5,000 億を超えるパラメータで構成されており、より多くのメモリとコンピューティング リソースが必要になります。このようなコンピューティング要件は、低遅延を必要とするアプリケーションはもちろんのこと、ほとんどのメーカーにとっては手の届かないものです。

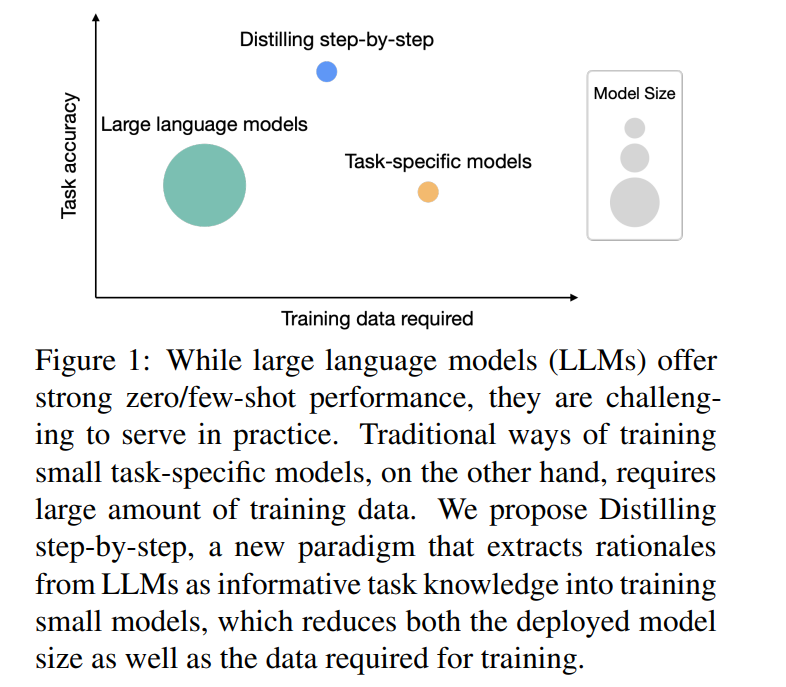

大規模モデルの問題を解決するために、デプロイ担当者は多くの場合、代わりに小規模な特定のモデルを使用します。これらの小さなモデルは、微調整や蒸留などの一般的なパラダイムを使用してトレーニングされます。微調整では、人間が注釈を付けた下流のデータを使用して、事前トレーニングされた小規模なモデルをアップグレードします。蒸留では、より大きな LLM によって生成されたラベルを使用して、同様に小さなモデルをトレーニングします。残念ながら、これらのパラダイムにはモデル サイズを縮小する一方でコストがかかります。LLM と同等のパフォーマンスを達成するには、微調整には高価な人間によるラベルが必要であり、蒸留には入手が困難な大量のラベルなしデータが必要です。

「Distilling Step-by-Step! Outperforming Larger Language Models with Less Training Data and Smaller Model Sizes」というタイトルの論文で、ワシントン大学と Google の研究者が新しいシンプルなメカニズムを発表しました。 , ステップバイステップの蒸留は、より少ないトレーニング データを使用して小規模なモデルをトレーニングするために導入されています。このメカニズムにより、LLM の微調整と抽出に必要なトレーニング データの量が削減され、その結果、モデル サイズが小さくなります。

#紙のリンク: https://arxiv.org/pdf/2305.02301 v1.pdf

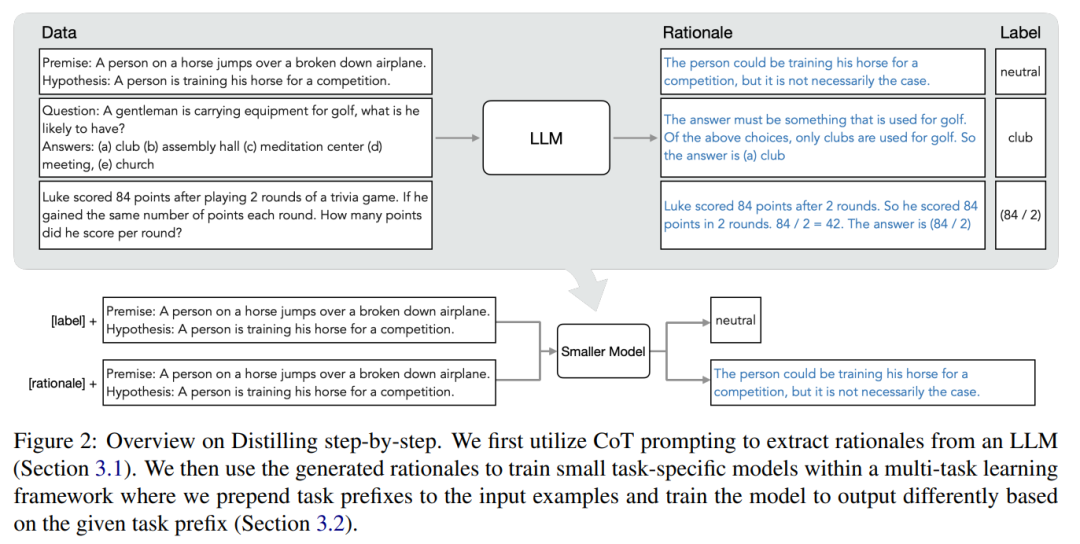

#このメカニズムの核心は、視点を変えて、LLM をノイズ ラベルのソースとしてではなく、推論できるエージェントとしてみなすことです。 LLM は、モデルによって予測されたラベルを説明およびサポートするために使用できる自然言語の理論的根拠を生成できます。たとえば、「紳士はゴルフ用品を持ち歩いていますが、何を持っていると思いますか? (a) クラブ、(b) 講堂、(c) 瞑想センター、(d) 会議、(e) 教会」と質問された場合、LLM は「(a)」と答えることができます。 ) クラブ」を思考連鎖 (CoT) 推論によって解釈し、「答えはゴルフをプレイするために使用されるものに違いない」と説明することでこのラベルを合理化します。上記の選択肢のうち、ゴルフに使用するクラブのみです。これらの位置合わせを、マルチタスク トレーニング設定で小規模なモデルをトレーニングし、ラベル予測と位置合わせ予測を実行するための追加の豊富な情報として使用します。

図 1 に示すように、段階的蒸留では、LLM の 1/500 未満のパラメーター数でタスク固有の小さなモデルを学習できます。また、段階的蒸留では、従来の微調整や蒸留よりもはるかに少ないトレーニング サンプルを使用します。

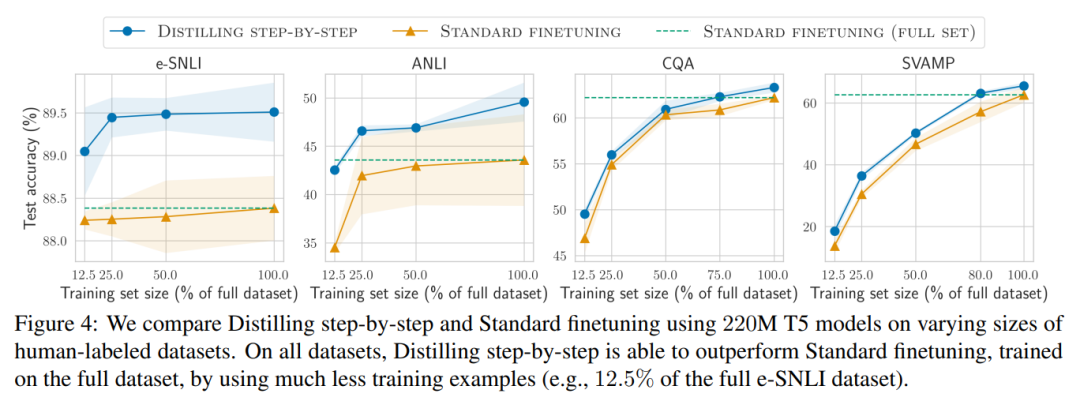

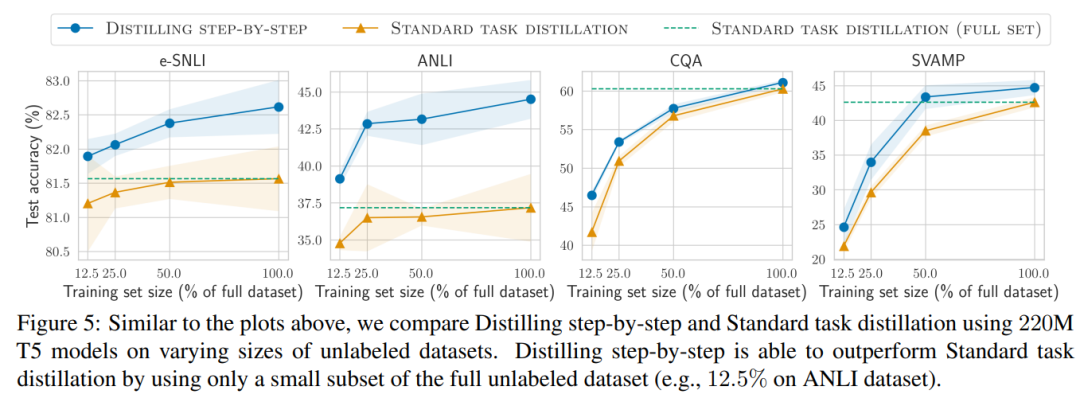

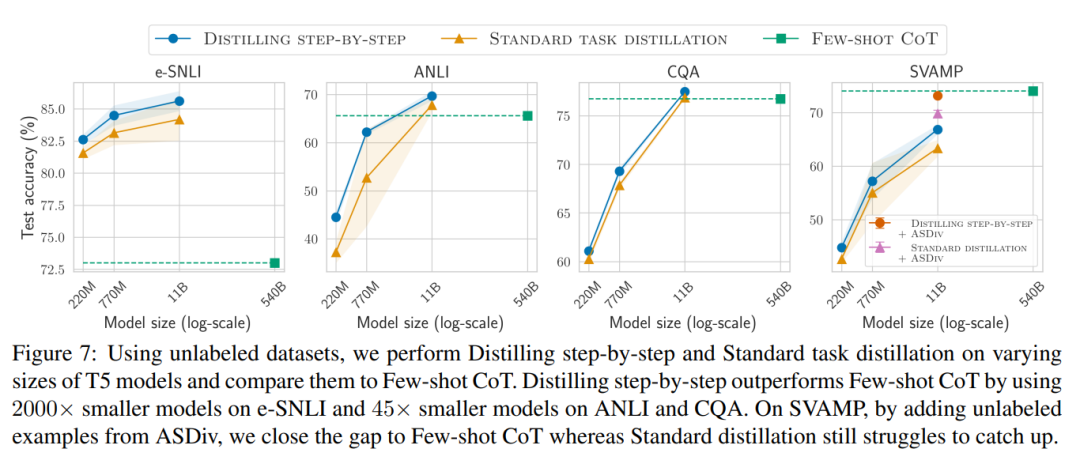

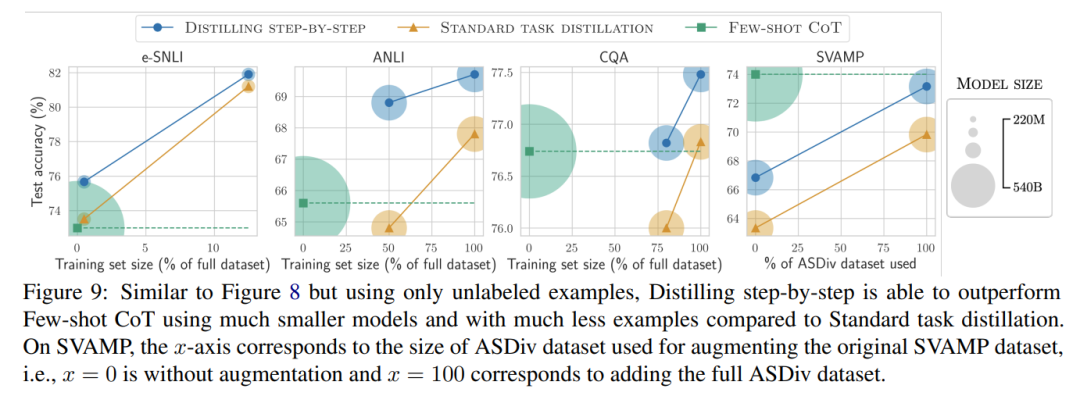

ラベルのないデータのみがある場合、小規模モデルのパフォーマンスは LLM のパフォーマンスより優れています。11B T5 モデルを使用した場合のみ、540B の PaLM のパフォーマンスを超えます。改善されました。 研究ではさらに、小規模なモデルのパフォーマンスが LLM よりも悪い場合、段階的蒸留の方が標準的な蒸留方法よりも追加のラベルなしデータを効果的に利用できることが示されています。LLM のパフォーマンスと同等の小規模なモデルを作成します。 研究者らは、LLM の推論能力を使用して予測を予測し、データ効率の高い方法で小規模なモデルをトレーニングする、段階的蒸留の新しいパラダイムを提案しました。マナー、モデル。全体的なフレームワークを図 2 に示します。 パラダイムには 2 つの簡単なステップがあります。まず、LLM とラベルのないデータを与えます。 set は、LLM に出力ラベルとラベルの位置揃えを生成するように指示します。理論的根拠は自然言語で説明され、モデルによって予測されたラベルのサポートを提供します (図 2 を参照)。正当化は、現在の自己教師あり LLM の新たな動作特性です。 次に、タスク ラベルに加えて、これらの理由を使用して、より小さな下流モデルをトレーニングします。率直に言って、理由は、入力が特定の出力ラベルにマップされる理由を説明するための、より豊富で詳細な情報を提供します。 研究者らは、実験で段階的蒸留の有効性を検証しました。まず、標準的な微調整およびタスク蒸留手法と比較して、段階的蒸留ははるかに少ない数のトレーニング サンプルでより優れたパフォーマンスを達成するのに役立ち、小さなタスク固有のモデルを学習する際のデータ効率が大幅に向上します。

段階的蒸留

実験結果

#第二に、研究は次のことを示しています。段階的蒸留方法は、より小さいモデル サイズで LLM のパフォーマンスを上回り、LLM と比較して導入コストが大幅に削減されることがわかりました。

#

以上が蒸留は段階的に行うこともできます。新しい方法により、小型モデルを 2000 倍のサイズの大型モデルと同等にできるようになります。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7531

7531

15

15

1379

1379

52

52

82

82

11

11

21

21

78

78

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhone のモバイル データ接続に遅延や遅い問題が発生していませんか?通常、携帯電話の携帯インターネットの強度は、地域、携帯ネットワークの種類、ローミングの種類などのいくつかの要因によって異なります。より高速で信頼性の高いセルラー インターネット接続を実現するためにできることがいくつかあります。解決策 1 – iPhone を強制的に再起動する 場合によっては、デバイスを強制的に再起動すると、携帯電話接続を含む多くの機能がリセットされるだけです。ステップ 1 – 音量を上げるキーを 1 回押して放します。次に、音量小キーを押して、もう一度放します。ステップ 2 – プロセスの次の部分は、右側のボタンを押し続けることです。 iPhone の再起動が完了するまで待ちます。セルラーデータを有効にし、ネットワーク速度を確認します。もう一度確認してください 修正 2 – データ モードを変更する 5G はより優れたネットワーク速度を提供しますが、信号が弱い場合はより適切に機能します

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません