ディープラーニングに最適な GPU の選択

機械学習プロジェクトに取り組むとき、特にディープ ラーニングとニューラル ネットワークを扱うときは、CPU よりも GPU を使用した方がよいでしょう。これは、ニューラル ネットワークに関しては、非常に基本的な GPU であっても CPU よりも優れたパフォーマンスを発揮するためです。

しかし、どの GPU を購入すべきでしょうか? この記事では、予算と特定のモデリング要件に基づいて情報に基づいた選択ができるように、考慮すべき関連要素をまとめます。

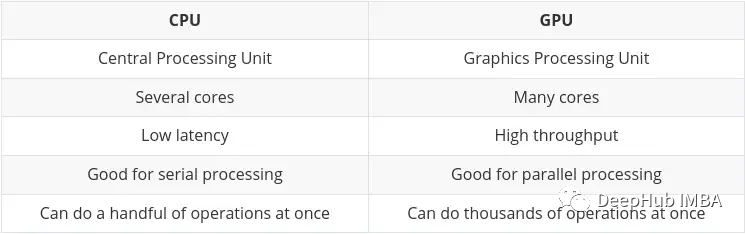

機械学習には CPU よりも GPU の方が優れているのはなぜですか?

CPU (Central Processing Unit) はコンピュータの主要な機能であり、非常に柔軟で、さまざまなプログラムやハードウェアからの命令を処理する必要があるだけでなく、一定の処理速度も要求されます。このマルチタスク環境で適切なパフォーマンスを発揮するために、CPU には少数の柔軟で高速な処理ユニット (コアとも呼ばれます) が搭載されています。

GPU (グラフィックス プロセッシング ユニット) GPU は、マルチタスクに関してはそれほど柔軟性がありません。ただし、大量の複雑な数学的計算を並行して実行できます。これは、多くの単純な計算を同時に処理できる、より多くの単純なコア (数千から数万) を使用することで実現されます。

複数の計算を並行して実行するという要件は、次の場合に最適です。

- グラフィックのレンダリング - 移動するグラフィック オブジェクトは、その軌道を常に計算する必要があるため、常に大量の並列計算が必要になります。計算を繰り返しました。

- 機械学習と深層学習 - 多数の行列/テンソル計算を GPU で並列処理できます。

- あらゆる種類の数学的計算を分割して並列実行できます。

CPU と GPU の主な違いは、Nvidia 自身のブログにまとめられています:

Tensor Processing Unit (TPU)

人工知能と機械学習/深層学習の発展に伴い、テンソルコアと呼ばれる、より特化した処理コアが登場しました。テンソル/行列計算を実行する場合、より高速かつ効率的です。機械学習/深層学習で扱うデータ型はテンソルだからです。

専用の TPU もありますが、最新の GPU の一部には多くの Tensor コアも含まれており、これについては後ほどまとめます。

Nvidia と AMD

この質問に対する答えは間違いなく Nvidia であるため、これはかなり短いセクションになります

AMD の GPU を機械/深層学習に使用することは可能ですが、 , しかし、この記事の執筆時点では、Nvidia の GPU は互換性が高く、一般に TensorFlow や PyTorch などのツールとの統合がより適切です (たとえば、PyTorch による AMD GPU のサポートは、現在 Linux でのみ利用可能です)。

AMD GPU を使用するには、追加のツール (ROCm) を使用する必要があり、追加の作業が必要になり、バージョンがすぐに更新されない可能性があります。この状況は将来的には改善される可能性がありますが、今のところは Nvidia を使い続ける方が良いでしょう。

GPU 選択の主な属性

機械学習タスクに適しており、予算に合った GPU を選択するには、基本的に次の 4 つの主要な要素のバランスが重要です。

- GPU にはどのくらいのメモリが搭載されていますか?

- GPU には CUDA および/または tensor コアがいくつありますか?

- カードはどのようなチップ アーキテクチャを使用していますか?

- 何電力要件はありますか?

自分にとって何が重要なのかをより深く理解できるように、これらの側面を 1 つずつ見ていきましょう。

GPU メモリ

答えは、多ければ多いほど良いです!

実際には、タスクとモデルの大きさによって異なります。たとえば、画像、ビデオ、またはオーディオを処理する場合、定義上、かなり大量のデータを処理することになり、GPU RAM が非常に重要な考慮事項になります。

メモリ不足の問題を解決する方法は常にあります (バッチ サイズを減らすなど)。ただし、これではトレーニング時間が無駄になるため、ニーズのバランスをうまくとる必要があります。

経験に基づく私の提案は次のとおりです:

- 4GB: 過度に複雑なモデルや大きな画像を扱っていない限り、これが絶対的な最小値だと思います。 、ビデオまたはオーディオ。ほとんどの場合機能しますが、日常的な使用には十分ではありません。始めたばかりで、全力を尽くしずに試してみたい場合は、

- 8GB から始めることができます。毎日の学習に最適なスタートであり、RAM 制限を超えることなくほとんどのタスクを完了できますが、問題があります。より複雑な画像、ビデオ、またはオーディオ モデルを操作するときに発生する可能性があります。

- 12GB: これは科学研究の最も基本的な要件だと思います。画像、ビデオ、またはオーディオを扱うモデルも含め、ほとんどの大きなモデルを処理できます。

- 12GB: 多ければ多いほど、より大きなデータ セットやより大きなバッチ サイズを処理できるようになります。 12GBを超えると、実際に価格が上昇し始めます。

一般的に、コストが同じであれば、より多くのメモリを備えた「低速」のカードを選択する方が良いでしょう。 GPU の利点は高いスループットであり、GPU を介してデータを転送するには利用可能な RAM に大きく依存することに注意してください。

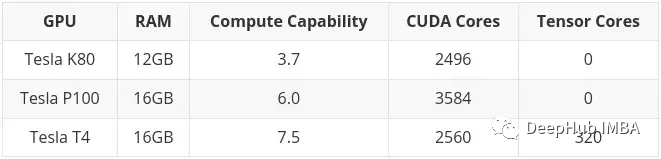

CUDA コアと Tensor コア

これは実際には非常に単純で、多ければ多いほど良いのです。

最初に RAM、次に CUDA を検討してください。機械/ディープ ラーニングの場合、Tensor コアは CUDA コアよりも優れています (高速で効率的)。これは、機械/深層学習の分野で必要な計算に合わせて正確に設計されているためです。

しかし、CUDA カーネルはすでに十分に高速であるため、これは問題ではありません。 Tensor コアを含むカードを入手できれば、それは大きなメリットですが、あまりこだわりすぎないでください。

「CUDA」については後で何度も出てくるので、最初に要約しましょう:

CUDA コア - これらはグラフィック カード上の物理プロセッサであり、通常は数千個あります。 , 4090はすでに16,000です。

CUDA 11 - 数字は変更される場合がありますが、これはグラフィックス カードが適切に機能するためにインストールされるソフトウェア/ドライバーを指します。 NV は定期的に新しいバージョンをリリースしており、他のソフトウェアと同様にインストールおよび更新できます。

CUDA 生成 (または計算能力) - これは、更新反復におけるグラフィックス カードのコード番号を示します。これはハードウェアで固定されているため、新しいカードにアップグレードすることによってのみ変更できます。番号とコードネームで区別されます。例: 3. ×[ケプラー]、5. x[マクスウェル]、6. × [パスカル]、7. x[チューリング]と8. x(アンペア)。

チップ アーキテクチャ

これは実際、あなたが思っているよりも重要です。ここでは AMD について議論しているのではありません。私の目には「古い黄色」が残っているだけです。

上で述べたように、30 シリーズ カードは Ampere アーキテクチャであり、最新の 40 シリーズ カードは Ada Lovelace です。通常、フアン氏はアーキテクチャに有名な科学者や数学者の名前を付けるが、今回はループとサブルーチンの概念を確立した女性数学者でコンピュータープログラムの創始者である英国の有名な詩人バイロンの娘、エイダ・ラブレスを選んだ。

カードのコンピューティング能力を理解するには、次の 2 つの側面を理解する必要があります。

- 大幅な機能の改善

- ここでの重要な機能は、混合精度トレーニングです。

32 ビット浮動小数点より精度の低い数値形式を使用すると、多くの利点があります。まず、必要なメモリが少なくなり、より大規模なニューラル ネットワークのトレーニングと展開が可能になります。次に、必要なメモリ帯域幅が少なくなるため、データ転送操作が高速化されます。 3 番目の数学演算は、特に Tensor コアを搭載した GPU 上で、精度は低下しますが、より高速に実行されます。混合精度トレーニングは、完全精度トレーニングと比較してタスク固有の精度を損なうことなく、これらの利点をすべて実現します。これは、完全な精度を必要とするステップを識別し、それらのステップにのみ 32 ビット浮動小数点を使用し、それ以外の場合は 16 ビット浮動小数点を使用することによって行われます。

こちらが Nvidia の公式ドキュメントです。ご興味がございましたら、お読みください:

https://docs.nvidia.com/deeplearning/performance/mixed-precision-training/index .html

混合精度トレーニングは、GPU が 7.x (Turing) 以降のアーキテクチャを備えている場合にのみ可能です。つまり、デスクトップでは RTX 20 シリーズ以降、サーバーでは「T」または「A」シリーズを意味します。

混合精度トレーニングにこのような利点がある主な理由は、RAM の使用量が削減されることです。Tensor Core の GPU により混合精度トレーニングが高速化されます。そうでない場合は、FP16 を使用するとビデオ メモリも節約され、より大きなバッチ サイズをトレーニングできます。間接的にトレーニング速度が向上します。

それは放棄されますか

RAM に対する特に高い要件があるが、ハイエンド カードを購入する十分な資金がない場合は、2 番目のカードで古い GPU を選択することもできます。ハンドマーケット。これにはかなり大きな欠点があります...カードの寿命は終わりました。

典型的な例は、4992 個の CUDA コアと 24GB の RAM を搭載した Tesla K80 です。 2014年には約7,000ドルで販売されていました。現在の価格は 150 ~ 170 ドルです! (塩辛の価格は 600 ~ 700 ドル程度です) このような安い価格でこれだけのメモリが得られるのは非常に興奮するでしょう。

しかし、非常に大きな問題があります。 K80 のコンピューティング アーキテクチャは 3.7 (Kepler) ですが、CUDA 11 以降はサポートされなくなりました (現在の CUDA バージョンは 11.7)。これはカードの有効期限が切れていることを意味するため、非常に安く販売されています。

したがって、中古カードを選ぶときは、最新バージョンのドライバーと CUDA をサポートしているかどうかを必ず確認してください。これが最も重要なことです。

ハイエンド ゲーム カード VS ワークステーション/サーバー カード

Lao Huang は基本的にカードを 2 つの部分に分割しました。コンシューマー向けグラフィックス カードおよびワークステーション/サーバー グラフィックス カード (つまり、プロフェッショナル向けグラフィックス カード)。

この 2 つの部分には明らかな違いがあり、同じ仕様 (RAM、CUDA コア、アーキテクチャ) の場合、一般に消費者向けグラフィック カードの方が安価です。ただし、プロ仕様のカードは通常、品質が高く、エネルギー消費量が低くなります (実際、タービンの騒音は非常に大きく、コンピューター室に置く場合には問題ありませんが、自宅や研究室に置く場合は少しうるさいです)。

ハイエンド (非常に高価な) プロフェッショナル カードでは、大量の RAM が搭載されていることに気づくかもしれません (例: RTX A6000 には 48GB、A100 には 80GB があります!)。これは、通常、高レベルの RAM を必要とする 3D モデリング、レンダリング、機械/深層学習のプロフェッショナル市場をターゲットにしているためです。繰り返しになりますが、お金があるなら A100 を買ってください! (H100 は A100 の新しいバージョンであり、現時点では評価できません)

しかし個人的には、コンシューマー向けハイエンド ゲーム カードを選択すべきだと考えています。十分なお金がない場合は、この記事を読まないでください。

提案の選択

それでは、最後に予算とニーズに基づいていくつかの提案をします。

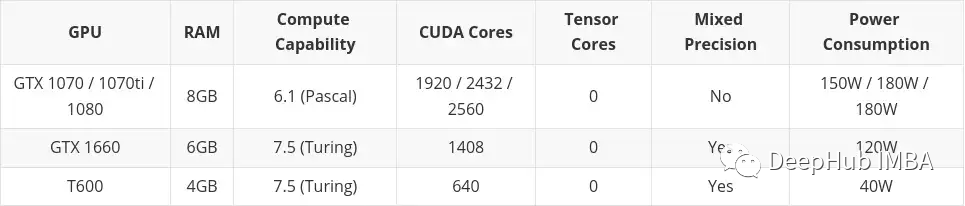

- 低予算

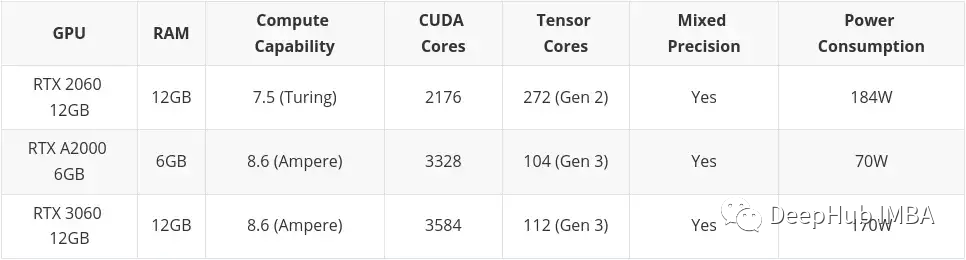

- 中予算

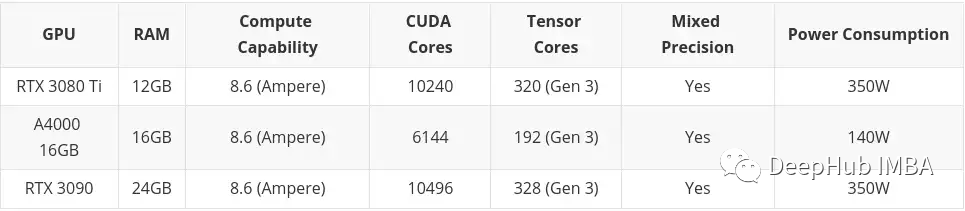

- 高予算

高予算では、それ以降は考慮されません。ハイエンドのコンシューマー向けグラフィックス カード。繰り返しますが、お金があるなら、A100 または H100 を購入してください。

この記事には中古市場で購入したカードも含まれます。これは主に、予算が低い場合は中古品を検討すべきだと思うからです。プロフェッショナル デスクトップ シリーズ カード (T600、A2000、および A4000) もここに含まれています。これは、構成の一部が同様のコンシューマー向けグラフィック カードよりわずかに劣るものの、消費電力が大幅に優れているためです。

#低予算

##高予算

##高予算

#オンライン/クラウド サービス

前述したように、K80 には 24GB の RAM と 4992 CUDA が搭載されています。基本的には 2 枚の K40 カードがリンクされています。これは、Colab で K80 を使用すると、実際にカードの半分にアクセスできることを意味します。つまり、12 GB と 2496 CUDA コアのみになります。

買わなければ、私が勝ちます買わないでください。明日は 200 円値下げされます

以上がディープラーニングに最適な GPU の選択の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7720

7720

15

15

1642

1642

14

14

1396

1396

52

52

1289

1289

25

25

1233

1233

29

29

この記事では、SHAP: 機械学習のモデルの説明について説明します。

Jun 01, 2024 am 10:58 AM

この記事では、SHAP: 機械学習のモデルの説明について説明します。

Jun 01, 2024 am 10:58 AM

機械学習とデータ サイエンスの分野では、モデルの解釈可能性が常に研究者や実務家に焦点を当ててきました。深層学習やアンサンブル手法などの複雑なモデルが広く適用されるようになったことで、モデルの意思決定プロセスを理解することが特に重要になってきました。 Explainable AI|XAI は、モデルの透明性を高めることで、機械学習モデルに対する信頼と自信を構築するのに役立ちます。モデルの透明性の向上は、複数の複雑なモデルの普及や、モデルを説明するための意思決定プロセスなどの方法によって実現できます。これらの方法には、特徴重要度分析、モデル予測間隔推定、ローカル解釈可能性アルゴリズムなどが含まれます。特徴重要度分析では、入力特徴に対するモデルの影響度を評価することで、モデルの意思決定プロセスを説明できます。モデルの予測間隔の推定

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

以前に書きましたが、今日は、深層学習テクノロジーが複雑な環境におけるビジョンベースの SLAM (同時ローカリゼーションとマッピング) のパフォーマンスをどのように向上させることができるかについて説明します。ここでは、深部特徴抽出と深度マッチング手法を組み合わせることで、低照度条件、動的照明、テクスチャの弱い領域、激しいセックスなどの困難なシナリオでの適応を改善するように設計された多用途のハイブリッド ビジュアル SLAM システムを紹介します。当社のシステムは、拡張単眼、ステレオ、単眼慣性、ステレオ慣性構成を含む複数のモードをサポートしています。さらに、他の研究にインスピレーションを与えるために、ビジュアル SLAM と深層学習手法を組み合わせる方法も分析します。公開データセットと自己サンプリングデータに関する広範な実験を通じて、測位精度と追跡堅牢性の点で SL-SLAM の優位性を実証しました。

Beelink EX グラフィックス カード拡張ドックは、GPU パフォーマンスの損失ゼロを約束します

Aug 11, 2024 pm 09:55 PM

Beelink EX グラフィックス カード拡張ドックは、GPU パフォーマンスの損失ゼロを約束します

Aug 11, 2024 pm 09:55 PM

最近発売された Beelink GTi 14 の際立った機能の 1 つは、ミニ PC の下に隠し PCIe x8 スロットがあることです。同社は発売時に、これにより外部グラフィックスカードをシステムに接続しやすくなると述べた。ビーリンクにはnがあります

AMD FSR 3.1 のリリース: フレーム生成機能は Nvidia GeForce RTX および Intel Arc GPU でも動作します

Jun 29, 2024 am 06:57 AM

AMD FSR 3.1 のリリース: フレーム生成機能は Nvidia GeForce RTX および Intel Arc GPU でも動作します

Jun 29, 2024 am 06:57 AM

AMD は、今年の第 2 四半期に FSR 3.1 をリリースするという 24 年 3 月の当初の約束を果たしました。 3.1 リリースを本当に際立たせているのは、フレーム生成側がアップスケーリング側から切り離されていることです。これにより、Nvidia および Intel GPU の所有者は FSR 3 を適用できるようになります。

C++ での機械学習アルゴリズムの実装: 一般的な課題と解決策

Jun 03, 2024 pm 01:25 PM

C++ での機械学習アルゴリズムの実装: 一般的な課題と解決策

Jun 03, 2024 pm 01:25 PM

C++ の機械学習アルゴリズムが直面する一般的な課題には、メモリ管理、マルチスレッド、パフォーマンスの最適化、保守性などがあります。解決策には、スマート ポインター、最新のスレッド ライブラリ、SIMD 命令、サードパーティ ライブラリの使用、コーディング スタイル ガイドラインの遵守、自動化ツールの使用が含まれます。実践的な事例では、Eigen ライブラリを使用して線形回帰アルゴリズムを実装し、メモリを効果的に管理し、高性能の行列演算を使用する方法を示します。

あなたが知らない機械学習の 5 つの流派

Jun 05, 2024 pm 08:51 PM

あなたが知らない機械学習の 5 つの流派

Jun 05, 2024 pm 08:51 PM

機械学習は人工知能の重要な分野であり、明示的にプログラムしなくてもコンピューターにデータから学習して能力を向上させる機能を提供します。機械学習は、画像認識や自然言語処理から、レコメンデーションシステムや不正行為検出に至るまで、さまざまな分野で幅広く応用されており、私たちの生活様式を変えつつあります。機械学習の分野にはさまざまな手法や理論があり、その中で最も影響力のある 5 つの手法は「機械学習の 5 つの流派」と呼ばれています。 5 つの主要な学派は、象徴学派、コネクショニスト学派、進化学派、ベイジアン学派、およびアナロジー学派です。 1. 象徴主義は、象徴主義とも呼ばれ、論理的推論と知識の表現のためのシンボルの使用を強調します。この学派は、学習は既存の既存の要素を介した逆演繹のプロセスであると信じています。

フラッシュ アテンションは安定していますか?メタとハーバードは、モデルの重みの偏差が桁違いに変動していることを発見しました

May 30, 2024 pm 01:24 PM

フラッシュ アテンションは安定していますか?メタとハーバードは、モデルの重みの偏差が桁違いに変動していることを発見しました

May 30, 2024 pm 01:24 PM

MetaFAIR はハーバード大学と協力して、大規模な機械学習の実行時に生成されるデータの偏りを最適化するための新しい研究フレームワークを提供しました。大規模な言語モデルのトレーニングには数か月かかることが多く、数百、さらには数千の GPU を使用することが知られています。 LLaMA270B モデルを例にとると、そのトレーニングには合計 1,720,320 GPU 時間が必要です。大規模なモデルのトレーニングには、これらのワークロードの規模と複雑さにより、特有のシステム上の課題が生じます。最近、多くの機関が、SOTA 生成 AI モデルをトレーニングする際のトレーニング プロセスの不安定性を報告しています。これらは通常、損失スパイクの形で現れます。たとえば、Google の PaLM モデルでは、トレーニング プロセス中に最大 20 回の損失スパイクが発生しました。数値的なバイアスがこのトレーニングの不正確さの根本原因です。

説明可能な AI: 複雑な AI/ML モデルの説明

Jun 03, 2024 pm 10:08 PM

説明可能な AI: 複雑な AI/ML モデルの説明

Jun 03, 2024 pm 10:08 PM

翻訳者 | Li Rui によるレビュー | 今日、人工知能 (AI) および機械学習 (ML) モデルはますます複雑になっており、これらのモデルによって生成される出力はブラックボックスになっており、関係者に説明することができません。 Explainable AI (XAI) は、利害関係者がこれらのモデルがどのように機能するかを理解できるようにし、これらのモデルが実際に意思決定を行う方法を確実に理解できるようにし、AI システムの透明性、信頼性、およびこの問題を解決するための説明責任を確保することで、この問題を解決することを目指しています。この記事では、さまざまな説明可能な人工知能 (XAI) 手法を検討して、その基礎となる原理を説明します。説明可能な AI が重要であるいくつかの理由 信頼と透明性: AI システムが広く受け入れられ、信頼されるためには、ユーザーは意思決定がどのように行われるかを理解する必要があります