人工知能の発展が速すぎて、悪影響を与える可能性があることを心配していますか?それを規制する国内法があればよかったと思いますか?現在、AI の使用を制限する新しい法律はなく、少なくとも現時点では、AI を導入する企業にとって自主規制が最良の選択肢となることがよくあります。

「人工知能」は長年にわたりテクノロジーの世界で最もホットなバズワードとして「ビッグデータ」に取って代わりましたが、2022 年 11 月下旬に ChatGPT AI の発売により AI ゴールド ラッシュが始まり、私たちを含む多くの AI 観察者を驚かせました。人間の言語と理解を模倣する驚くべき能力のおかげで、わずか数か月の間に、多数の強力な生成 AI モデルが世界の注目を集めました。

ChatGPT の出現によって促進された、主流文化における生成モデルの異常な台頭は、これがどこへ向かうのかについて多くの疑問を引き起こしています。魅力的な詩や風変わりなアートを生み出す AI の驚くべき力は、消費者への危害や失業から、不当投獄、さらには人類の破滅に至るまで、その悪影響についての懸念に変わりつつあります。

これを非常に心配している人もいます。先月、AI研究者の連合は、OpenAIが先月立ち上げた大規模モデルであるGPT-4よりも大きな新しい生成モデルの開発について、6か月の一時停止を求めた(詳細記事:公開書簡がAI研究の一時停止を促している)。言語モデル (LLM)。

チューリング賞受賞者のヨシュア・ベンジオ氏とOpenAIの共同創設者イーロン・マスク氏らが署名した公開書簡では、「高度な人工知能は地球上の生命の歴史に重大な変化をもたらす可能性があり、そうすべきである」と述べた。 「適切な注意とリソースを使って計画と管理を行ってください。」「残念ながら、このレベルの計画と管理はまだ達成されていません。」という呼びかけが高まっています。世論調査によると、アメリカ人は人工知能が信頼できるとは考えておらず、特に自動運転車や政府の給付金へのアクセスなどの影響力のある事柄に関して規制されることを望んでいる。

しかし、雇用における AI の使用に焦点を当てたニューヨーク市の法律など、AI を対象としたいくつかの新しい現地法にもかかわらず、施行の取り組みは遅れています。今月の時点で、議会はゴールラインに近づいている AI を特にターゲットにした新たな連邦規制はありません (ただし、AI は金融サービスやヘルスケアなどの高度に規制された業界の法的領域に進出しています)。

人工知能の影響で、企業は何をすべきでしょうか?企業が人工知能のメリットを共有したいと考えるのは当然のことです。結局のところ、「データドリブン」になりたいという衝動は、デジタル時代で生き残るために必要なものとみなされています。しかし、企業はまた、AI の不適切な使用によって生じる可能性のある、現実的または認識されている悪影響も避けたいと考えています。

「

ウエストワールド」では人工知能が猛威を振るっています。人工知能法律事務所 BNH.AI の創設者であるアンドリュー バート氏はかつてこう言いました、「リスクの管理方法は誰も知りません。やり方は人それぞれです。」 そうは言っても、企業はいくつかのフレームワークを使用して、 AI リスクの管理に役立ちます。バート氏は、米国国立標準技術研究所 (NIST) が提供し、今年初めに完成した人工知能リスク管理フレームワーク (

#RMF: リスク管理フレームワーク) の使用を推奨しています。 RMF は、企業が人工知能がどのように機能するか、また人工知能がもたらす可能性のある悪影響について考えるのに役立ちます。 「地図、測定、管理、統治」アプローチを使用して、さまざまなサービス提供にわたって人工知能を使用するリスクを理解し、最終的に軽減します。

もう 1 つの AI リスク管理フレームワークは、O'Neil Risk Advisory & Algorithmic Auditing (ORCAA) の CEO である Cathy O'Neil 氏によるものです。 ORCAAは「

説明可能な公平性」と呼ばれるフレームワークを提案しました。 説明可能な公平性により、組織はアルゴリズムのバイアスをテストするだけでなく、結果の違いが検出されたときに何が起こるかを研究する方法も得られます。たとえば、銀行が学生ローンの適格性を判断している場合、ローンの承認または拒否、あるいは利息の増減に法的にどのような要素を使用できますか?

明らかに、銀行はこれらの質問に答えるためにデータを使用する必要があります。しかし、どのようなデータを使用できるのでしょうか。つまり、ローン申請者を反映する要素は何でしょうか?どの要素の使用が法的に許可され、どの要素が使用されてはならないのでしょうか?これらの質問に答えるのは簡単でも単純でもない、とオニール氏は言う。

#「このフレームワークの目的は、これらの法的要素が合法でなければならないということです」とオニール氏は、前回の Nvidia GPU Technology Conference (GTC) でのディスカッション中に述べました。

新しい AI 法がなくても、企業は公平かつコンプライアンスを遵守する方法を自問し始める必要があると、データ分析とデータ分析のプロバイダーである Dataiku AI の責任者であるトリヴェニ ガンジー氏は述べています。 AI ソフトウェア: 既存の法律を遵守するために AI を倫理的に実装します。

「人々は考え始めなければなりません。既存の法律をどのように取り入れて、今日存在する AI のユースケースに適用することができるでしょうか?」 「人々は、人工知能を構築する際の倫理的かつ価値観に基づいた方法について考えています。たとえ包括的な処方箋がないとしても、これらは実際に企業が自問し始めている問題です。」

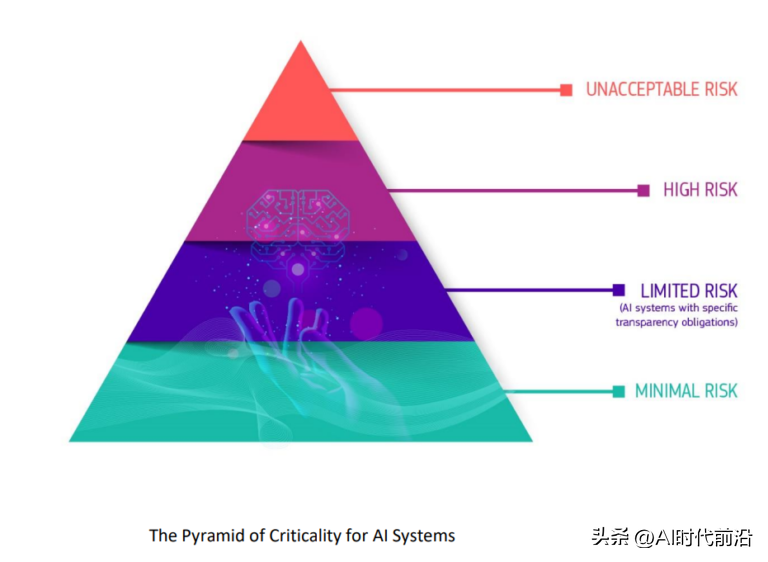

EU、人工知能の潜在的な危害を「重要度ピラミッド」に分類

EU はすでに独自の規制である人工知能法を進めており、この法案は今年後半に発効する可能性がある。

人工知能法案は、EU 居住者に影響を与える人工知能の使用に関する共通の規制および法的枠組みを作成します。これには、人工知能の開発方法や企業が人工知能をどのような目的で使用できるかなどが含まれます。要件を遵守しなかった場合の法的影響。この法律は、特定のユースケースでAIを導入する前に承認を得ることを企業に義務付けたり、リスクが高すぎるとみなされる他の特定のAIの使用を禁止したりする可能性がある。

以上が自己規制は今や人工知能の制御基準となっているの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。