スマートカーセンサーキャリブレーションテクノロジーの詳細な解釈

センサーのキャリブレーションは、自動運転認識システムに必要なリンクであり、その後のセンサー フュージョンに必要なステップおよび前提条件です。その目的は、2 つ以上のセンサーを統一された時空間座標系に変換して、センサー フュージョンを実現することです。意味を持つことは、知覚的な意思決定の重要な前提条件です。センサーが設計仕様を満たしていること、および測定値の精度が保証されていることを確認するために、センサーは製造および設置後に実験を通じて校正する必要があります。

センサーを自動運転車に取り付けた後、センサーを校正する必要がありますが、同時に、車両の走行プロセス中に振動やその他の理由によりセンサーが調整されます。本来の位置からずれてしまうため、一定間隔でセンサーを校正する必要があります。自動運転車は、環境認識と自己認識のために複数の種類のセンサーを同時に使用します。自動運転車の認識プロセスでは、センサーの堅牢性と精度が特に重要です。

01 カメラのキャリブレーション

車載カメラは車両に一定の角度と位置で設置され、環境を比較するため、車載カメラで収集したデータを車両走行環境の実際の物体に対応させること、つまり、車載カメラで生成した画像ピクセル座標系の点座標とカメラ内の点座標との変換関係を求めること環境座標系では、カメラのキャリブレーションが必要です。

1. カメラ内部パラメータのキャリブレーション

1.1 カメラモデルの確立

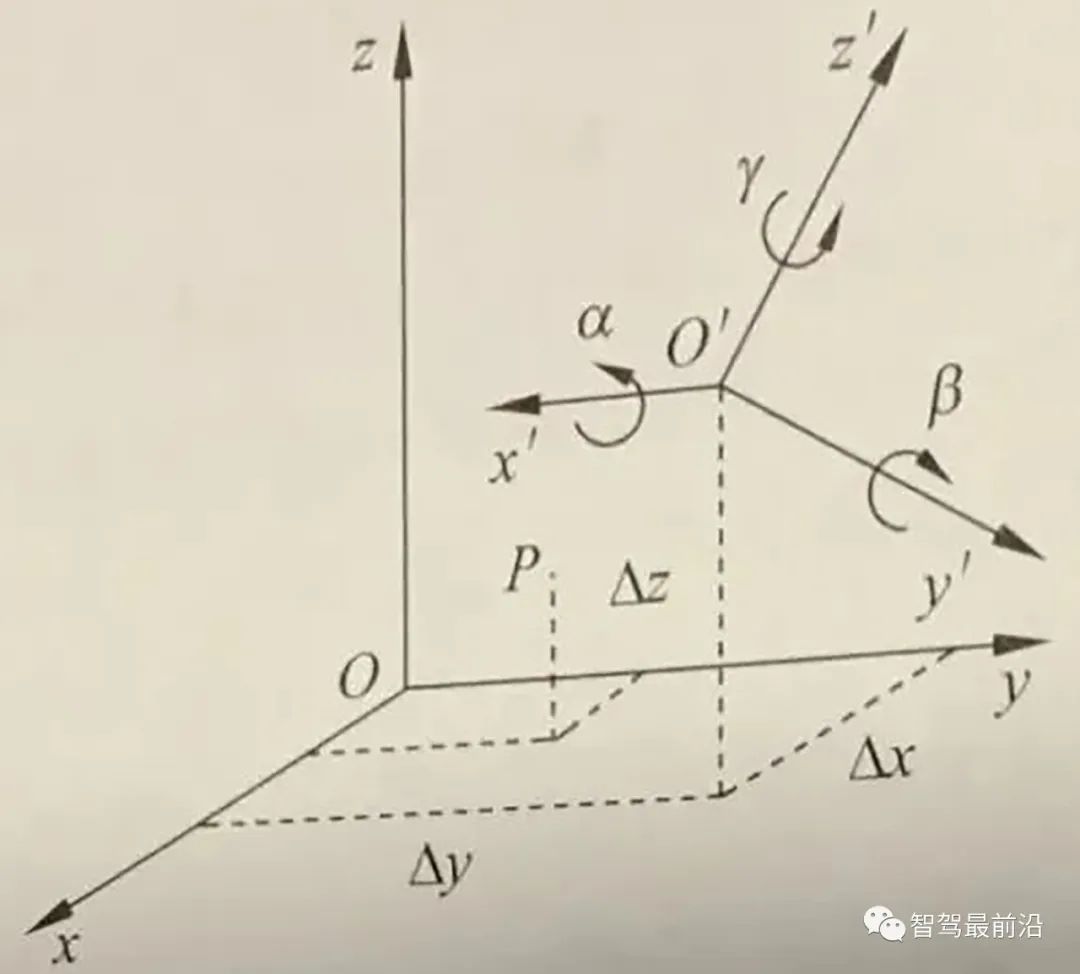

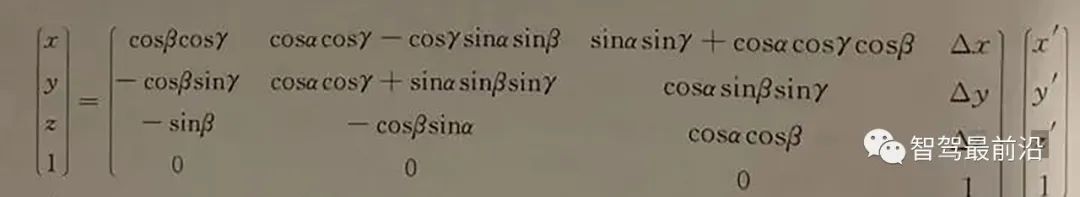

環境座標系、カメラ座標系、画像物理座標系、および画像ピクセル座標系間の相互変換関係を通じて、環境座標系と画像ピクセル座標系の間の変換関係を見つけることができます。

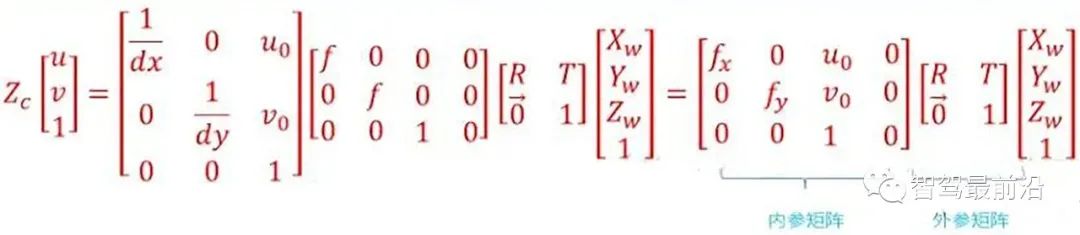

現実世界の点 P。環境座標系での座標は (Xw, Yw, Zw)、画像内での位置は (u, v) であり、両者には次の関係があります。

#環境座標系と画像ピクセル座標系の変換関係

#環境座標系と画像ピクセル座標系の変換関係

内部パラメータ行列については、 4 番目の定数 fx、fy、Uo、Vo。カメラの焦点距離、メインポイント、センサーなどの設計上の技術指標に関係し、外部要因(周囲の環境、カメラの位置など)とは無関係であるため、カメラの内部パラメータと呼ばれます。カメラ。内部基準はカメラが工場出荷時に決定されます。ただし、製造工程などにより、同じ生産ラインで生産されたカメラであっても内部パラメータが若干異なるため、実験によりカメラの内部パラメータを求めることが必要になる場合があります。単眼カメラのキャリブレーションとは、通常、実験的手段を通じてカメラの内部パラメータを決定することを指します。

#外部パラメータ行列には、回転行列と平行移動行列が含まれます。回転行列と平行移動行列は、点をワールド座標系からカメラ座標系に変換する方法を共同で記述します。コンピューター ビジョンでは、外部パラメーター マトリックスを決定するプロセスは通常、視覚的ローカリゼーションと呼ばれます。車載カメラを自動運転車に設置した後、カメラの位置を車両座標系で校正する必要があります。さらに、車の衝撃や振動により、車載カメラの位置は時間の経過とともに徐々に変化するため、自動運転車は定期的にカメラの位置を再調整する必要があります。これはキャリブレーションと呼ばれます。

1.2 カメラの歪み補正

実際の使用では、カメラは理想的なピンホールを完全に正確に追従することはできません。モデルが透視投影を実行すると、通常、レンズ歪みが存在します。つまり、実際のカメラ結像面上の物点によって生成された画像と理想的な結像の間には、特定の光学歪み誤差が存在します。歪み誤差は、主に半径方向の歪み誤差と接線方向の歪み誤差です。歪み誤差です。

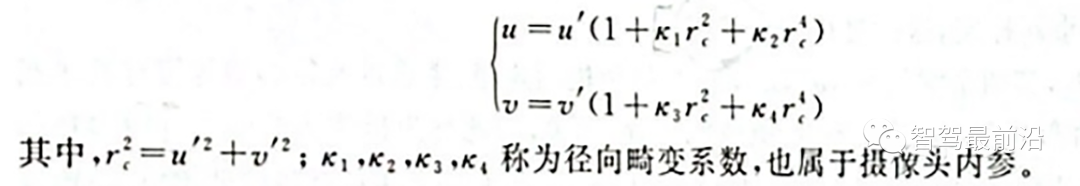

放射状歪み: レンズの特性により、カメラ レンズの端で光が多かれ少なかれ曲がる傾向があり、これを放射状歪みと呼びます。このような歪曲収差は、一般的な安価なレンズの方が顕著であり、放射状歪曲収差には主に樽型歪曲収差と糸巻き型歪曲収差があります。樽型歪曲収差とは、レンズの物体やレンズ内のレンズ群の構造によって生じる結像像が樽型に広がることです。樽型歪みは、通常、広角レンズを使用する場合、またはズームレンズの広角端を使用する場合に検出しやすくなります。糸巻き型歪みとは、レンズによって画像が中心に向かって「縮む」現象です。ズームレンズの望遠端を使用すると、糸巻型歪みに気づきやすくなります。#コンピュータ ビジョンでは、放射状の歪みはシーンの再構成に非常に重要な影響を与えます。自動運転システムが環境を認識するためには、カメラが周囲の環境を高精度に再構成する必要があり、歪みが補正されていないと正確な環境情報を取得できません。たとえば、環境内のターゲットは画像のどの領域にも現れる可能性があり、歪みが補正されないと、ビジョン技術によって取得されるターゲットの位置やサイズが不正確になることが多く、自動運転車の運転の安全性に直接影響を及ぼします。さらに、自動運転車にはさまざまな場所に複数のカメラが装備されているため、放射状の歪みを考慮しない場合、画像のスティッチング処理中に、対応する特徴の不一致によってスティッチングされた画像のぼやけ効果が発生します。 一般的なカメラの場合、画像の放射状の歪みは、低次の多項式モデルとして記述されることがよくあります。 (u, v) が修正された点の座標、(u', u') が修正されていない点の座標であると仮定すると、この 2 つの間の変換は次の式で決定できます。

放射歪み低次多項式モデル

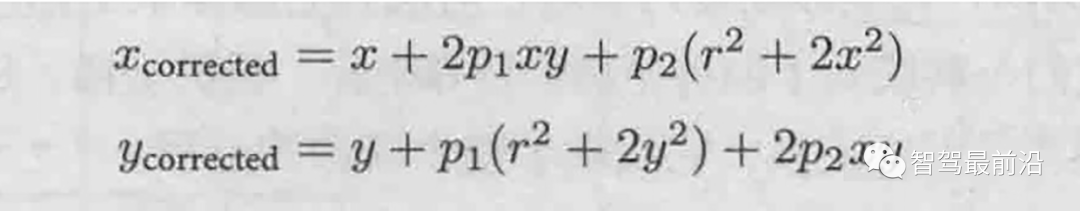

一方、カットの接線方向の歪みは、他の 2 つのパラメータ p1 と p2 を使用して補正できます。

#接線方向の歪み 低次数多項式モデル

#1.3 カメラ内部パラメータの校正方法

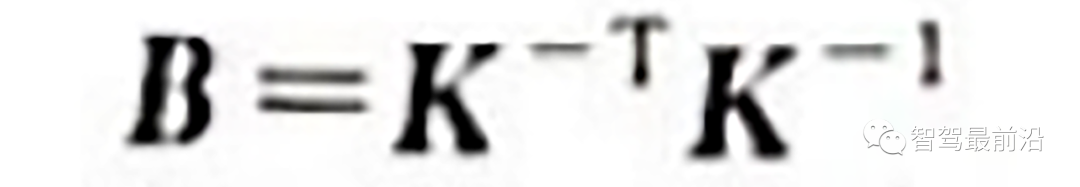

この段階では、通常、歪みパラメータの校正は他の内部パラメータと同時に実行されます。現在最も広く使用されているのは、2000 年に Zhang Zhengyou によって提案された Zhang Zhengyou 校正方法です。 Zhang Zhengyou のキャリブレーション方法は、チェス盤のキャリブレーション ボードをさまざまな位置で撮影することによって、各画像内のチェス盤のキャリブレーション ボードの内側のコーナー ポイントを見つけ、内側のコーナー ポイント間の対応を通じて行列  に対する制約を確立します。これにより、内部パラメータ行列 K が復元されます。

に対する制約を確立します。これにより、内部パラメータ行列 K が復元されます。

2. カメラ間の外部パラメータのキャリブレーション

自動運転車では、知覚の死角を最小限に抑えるために、マルチカメラモードがよく使われます。複数のカメラ間の相対的な位置関係を求めることをカメラの外部パラメータキャリブレーションと呼びます。

別の観点から見ると、カメラの外部パラメータのキャリブレーションは「姿勢推定」問題とも呼ばれます。 2 つのカメラ間の相対姿勢 [R|t] は 6 自由度 (空間的な位置と回転の関係) を持ち、理論的には、2 つのカメラが同時に空間内の 3 点を取得する限り、2 つのカメラ間の関係は次のようになります。相対的な姿勢が復元されます。 3組の対応点からカメラ間の相対姿勢を復元する問題は、「Perspective-3-Point-Promement(P3P)」と呼ばれる。実際には、ロバスト性を向上させるために相対姿勢を復元するために 3 点以上の点が使用されることが多く、P3P 問題は PnP 問題として一般化されます。

当初、研究者らは直接線形変換 (DLT) 法を使用して PnP 問題を解決しましたが、その後、精度を向上させるために、研究者らはロバストな線形化再投影誤差を提案しました。 PnP問題の解決には選択法が用いられ、姿勢推定において有名なバンドル調整法(Bundle Adjustment, BA)が提案されている。

02 Lidar キャリブレーションLidar は自動運転プラットフォームの主要センサーの 1 つであり、認識と測位において重要な役割を果たします。カメラと同様に、LIDAR も使用前に内部パラメータと外部パラメータを調整する必要があります。内部パラメータ校正とは、内部のレーザー送信機の座標系とレーダー自体の座標系の間の変換関係を指し、工場出荷前に校正されており、そのまま使用できます。自動運転システムが実行する必要があるのは、外部パラメータの校正、つまりライダー自身の座標系と車体座標系の関係です。

ライダーと車体は剛結合されており、両者の相対的な姿勢や変位は固定されます。 LIDAR 間、LIDAR と車両間の相対座標関係を確立するには、LIDAR 設置を校正し、LIDAR データを LIDAR 座標系から車体座標系に変換する必要があります。

車体座標系とライダー座標系

1. LiDAR と LiDAR 間のキャリブレーション

自動運転車の場合、複数の LiDAR が存在する場合があります。この場合、LiDAR によって取得される各外部環境は、車体座標系に正確にマッピングする必要があります。したがって、複数のライダーがある場合には、複数のライダーの相対位置を校正して校正する必要がある。

LIDAR 間の外部パラメータを調整するためのアイデアは数多くありますが、より一般的に使用されるのは、異なる LIDAR と車体間の座標変換関係を通じて、LIDAR 間の関係を間接的に導出するというものです。それらの間の変換関係。

2. ライダーとカメラのキャリブレーション

自動運転車では、ライダーと自動運転車はしっかりと接続されています。それらの間の変位は固定されているため、ライダースキャンによって取得されたデータ点は、環境座標系でそれらに対応する固有の位置座標を持ちます。同様に、カメラも環境座標系で固有の位置座標を持っているため、LIDAR とカメラの間に固定の座標変換が存在します。 LIDAR とカメラの共同キャリブレーションは、単線 LIDAR と画像上のキャリブレーション オブジェクトの対応する特徴点を抽出することにより、単線 LIDAR 座標、カメラ座標、画像ピクセル座標などの複数のセンサー座標の統合を完了します。 LIDAR とカメラの空間キャリブレーションを実現します。

カメラの外部パラメータのキャリブレーションと LIDAR の外部パラメータのキャリブレーションが完了すると、実際に 2 つの関係を完全に決定でき、LIDAR のスキャン ポイントを画像ピクセル座標系に投影できます。 。

カメラの内部パラメータ校正方法と同じように、LIDAR およびカメラの外部パラメータ校正方法でも校正プレートの校正方法を使用できます。

以上がスマートカーセンサーキャリブレーションテクノロジーの詳細な解釈の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7473

7473

15

15

1377

1377

52

52

77

77

11

11

19

19

30

30

なぜ自動運転ではガウス スプラッティングが非常に人気があるのに、NeRF は放棄され始めているのでしょうか?

Jan 17, 2024 pm 02:57 PM

なぜ自動運転ではガウス スプラッティングが非常に人気があるのに、NeRF は放棄され始めているのでしょうか?

Jan 17, 2024 pm 02:57 PM

上記と著者の個人的な理解 3 次元ガウシアンプラッティング (3DGS) は、近年、明示的な放射線フィールドとコンピューター グラフィックスの分野で出現した革新的なテクノロジーです。この革新的な方法は、数百万の 3D ガウスを使用することを特徴とし、主に暗黙的な座標ベースのモデルを使用して空間座標をピクセル値にマッピングする神経放射線場 (NeRF) 方法とは大きく異なります。明示的なシーン表現と微分可能なレンダリング アルゴリズムにより、3DGS はリアルタイム レンダリング機能を保証するだけでなく、前例のないレベルの制御とシーン編集も導入します。これにより、3DGS は、次世代の 3D 再構築と表現にとって大きな変革をもたらす可能性のあるものとして位置付けられます。この目的を達成するために、私たちは 3DGS 分野における最新の開発と懸念について初めて体系的な概要を提供します。

うわ〜すごい! Samsung Galaxy Ring体験:2999元の本物のスマートリング

Jul 19, 2024 pm 02:31 PM

うわ〜すごい! Samsung Galaxy Ring体験:2999元の本物のスマートリング

Jul 19, 2024 pm 02:31 PM

サムスンは7月17日にSamsung Galaxy Ringの国内版を正式にリリースし、価格は2,999元となった。 Galaxy Ring の実際の電話は、まさに「WowAwesome、これは私だけの特別な瞬間です」の 2024 年バージョンです。 AppleのVision Proを除けば、近年で最も新鮮さを感じさせる(フラグっぽいですが)電子製品です。 (写真では左右のリングがGalaxy Ring↑) Samsung Galaxy Ringの仕様(データは中国銀行公式サイトより):ZephyrRTOSシステム、8MBストレージ、10ATM防水+IP68、バッテリー容量18mAh~23.5 mAh (さまざまなサイズ

自動運転シナリオにおけるロングテール問題を解決するにはどうすればよいでしょうか?

Jun 02, 2024 pm 02:44 PM

自動運転シナリオにおけるロングテール問題を解決するにはどうすればよいでしょうか?

Jun 02, 2024 pm 02:44 PM

昨日の面接で、ロングテール関連の質問をしたかと聞かれたので、簡単にまとめてみようと思いました。自動運転のロングテール問題とは、自動運転車におけるエッジケース、つまり発生確率が低い考えられるシナリオを指します。認識されているロングテール問題は、現在、単一車両のインテリジェント自動運転車の運用設計領域を制限している主な理由の 1 つです。自動運転の基礎となるアーキテクチャとほとんどの技術的問題は解決されており、残りの 5% のロングテール問題が徐々に自動運転の開発を制限する鍵となってきています。これらの問題には、さまざまな断片的なシナリオ、極端な状況、予測不可能な人間の行動が含まれます。自動運転におけるエッジ シナリオの「ロング テール」とは、自動運転車 (AV) におけるエッジ ケースを指します。エッジ ケースは、発生確率が低い可能性のあるシナリオです。これらの珍しい出来事

フルスクリーンにアップグレードしてください! iPhone SE4は9月に進みました

Jul 24, 2024 pm 12:56 PM

フルスクリーンにアップグレードしてください! iPhone SE4は9月に進みました

Jul 24, 2024 pm 12:56 PM

最近、iPhone SE4に関する新しいニュースがWeiboで明らかになりました。iPhone SE4の背面カバーのプロセスはiPhone 16の標準バージョンとまったく同じであると言われています。つまり、iPhone SE4はガラスの背面パネルとストレートスクリーン&ストレートエッジデザイン。 iPhone SE4は今年9月に前倒しして発売されると報じられており、iPhone 16と同時に発表される可能性が高い。 1. 公開されたレンダリングによると、iPhone SE4の前面デザインはiPhone 13と似ており、ノッチスクリーンに前面カメラとFaceIDセンサーが搭載されています。背面はiPhoneXrと同様のレイアウトを採用していますが、カメラは1つだけで、全体的なカメラモジュールはありません。

カメラかライダーを選択しますか?堅牢な 3D オブジェクト検出の実現に関する最近のレビュー

Jan 26, 2024 am 11:18 AM

カメラかライダーを選択しますか?堅牢な 3D オブジェクト検出の実現に関する最近のレビュー

Jan 26, 2024 am 11:18 AM

0.前面に書かれています&& 自動運転システムは、さまざまなセンサー (カメラ、ライダー、レーダーなど) を使用して周囲の環境を認識し、アルゴリズムとモデルを使用することにより、高度な知覚、意思決定、および制御テクノロジーに依存しているという個人的な理解リアルタイムの分析と意思決定に。これにより、車両は道路標識の認識、他の車両の検出と追跡、歩行者の行動の予測などを行うことで、安全な運行と複雑な交通環境への適応が可能となり、現在広く注目を集めており、将来の交通分野における重要な開発分野と考えられています。 。 1つ。しかし、自動運転を難しくしているのは、周囲で何が起こっているかを車に理解させる方法を見つけることです。これには、自動運転システムの 3 次元物体検出アルゴリズムが、周囲環境にある物体 (位置を含む) を正確に認識し、記述することができる必要があります。

携帯電話の 1 インチセンサーはどれくらいの大きさですか? 実はカメラの 1 インチセンサーよりも大きいのです。

May 08, 2024 pm 06:40 PM

携帯電話の 1 インチセンサーはどれくらいの大きさですか? 実はカメラの 1 インチセンサーよりも大きいのです。

May 08, 2024 pm 06:40 PM

昨日の記事では「センサーサイズ」について言及していませんでしたが、ここまで誤解が多いとは思いませんでした…1インチってどれくらいですか?歴史的な問題*により、カメラでも携帯電話でも、センサーの対角長の「1インチ」は25.4mmではありません。 ※真空管に関して言えば、ここでは膨張はありません。線路の幅を決めるのは馬のお尻のようなものです。誤解を避けるために、より厳密に書くと、「タイプ 1.0」または「タイプ 1.0」となります。また、センサーサイズが1/2型未満の場合はタイプ1=18mm、センサーサイズが1/2型以上の場合はタイプ1=18mmとなります。

自動運転と軌道予測についてはこの記事を読めば十分です!

Feb 28, 2024 pm 07:20 PM

自動運転と軌道予測についてはこの記事を読めば十分です!

Feb 28, 2024 pm 07:20 PM

自動運転では軌道予測が重要な役割を果たしており、自動運転軌道予測とは、車両の走行過程におけるさまざまなデータを分析し、将来の車両の走行軌跡を予測することを指します。自動運転のコアモジュールとして、軌道予測の品質は下流の計画制御にとって非常に重要です。軌道予測タスクには豊富な技術スタックがあり、自動運転の動的/静的知覚、高精度地図、車線境界線、ニューラル ネットワーク アーキテクチャ (CNN&GNN&Transformer) スキルなどに精通している必要があります。始めるのは非常に困難です。多くのファンは、できるだけ早く軌道予測を始めて、落とし穴を避けたいと考えています。今日は、軌道予測に関するよくある問題と入門的な学習方法を取り上げます。関連知識の紹介 1. プレビュー用紙は整っていますか? A: まずアンケートを見てください。

SIMPL: 自動運転向けのシンプルで効率的なマルチエージェント動作予測ベンチマーク

Feb 20, 2024 am 11:48 AM

SIMPL: 自動運転向けのシンプルで効率的なマルチエージェント動作予測ベンチマーク

Feb 20, 2024 am 11:48 AM

原題: SIMPL: ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving 論文リンク: https://arxiv.org/pdf/2402.02519.pdf コードリンク: https://github.com/HKUST-Aerial-Robotics/SIMPL 著者単位: 香港科学大学DJI 論文のアイデア: この論文は、自動運転車向けのシンプルで効率的な動作予測ベースライン (SIMPL) を提案しています。従来のエージェントセントとの比較