AI顔交換詐欺で430万元騙し取られる 消費者専門家が直ちに3つの防御策を推奨

最近、包頭市公安局は、福州市のテクノロジー企業の法定代表者である郭氏が AI の顔変更により 10 分間で 430 万元を騙し取られたと発表しました 人工知能の安全性についての白熱した議論。

顔認識 の欠点を解決し、効果的に人物を識別します。写真、ビデオ、マスク、シミュレーション モデルなど、特にこの事件で発生した顔変更および音声変更詐欺。」

AI によってもたらされる潜在的なリスクについて、「AI ゴッドファーザー」ヒントンはかつてニューヨーク タイムズのインタビューで次のように述べています。 .」現実に基づいて、この声明は「警戒主義者」ではありません。パンドラの箱の中の「悪」が徐々に顕在化する一方で、AIGCはAIの開発を新たなステージへ急速に進めている。

テクノロジーの「悪」に注意してください: 見ることが必ずしも信じるとは限りません

「安全な包頭」WeChat 公開アカウントによると、包頭市公安局電気通信サイバー犯罪捜査局は、福州のテクノロジー企業の法定代理人である郭氏が詐欺被害に遭ったと発表した。元さん、幸いなことに、騙し取られた資金336万8400元は横取りされており、「インテリジェントAI変面・擬音技術」が使われていた。

彼らはどうやってそれをやったのでしょうか?これは複雑なプロセスです。ニュース自体、郭氏の観点から見ると、被害者 は主に変面技術とオノマトペ技術 に騙されていましたが、他にも隠されたものがいくつかある可能性があります。事件の背景には、犯罪者がどのチャネルを通じて被害者と連絡を確立したか、関連するソーシャル ソフトウェアのアカウントを取得する方法、なりすます必要がある人物を知る方法、対応する画像および音声素材を入手する方法などの条件が含まれます。被害者の選び方。

変顔技術とオノマトペ技術という 2 つの重要な課題に焦点を当てると、主な問題は 基礎データの取得、トレーニング フレームワーク、およびリアルタイム レンダリングです。データ レベルでは、なりすまし者の音声およびビデオ情報は、ソーシャル メディアなどのソーシャル エンジニアリング ライブラリから取得することも、紛失した黒電話のフォト アルバムやチャット履歴から抽出することもできます。トレーニング フレームワークに関しては、現在、いくつかの国内主流ショートビデオ プラットフォームの編集ソフトウェアは、警告メッセージなしで顔を変える特殊効果をサポートしており、海外のオープンソース フレームワークには 30 以上の合成手法が存在します。リアルタイム レンダリングに関しては、ハイジャックされたレンダリングは、電話機のフラッシュや侵入型ソフトウェアのインストールなどの攻撃操作によっても達成される可能性があります。

したがって、 「百聞は一見に如かず」 テクノロジーの背後には常に意図的な「悪」が存在しており、これに対して警戒する必要があります。

「魔

」で「魔法」の芽を摘み、打ち破る リスクは避けられないのに、どうすれば「魔法」を使って「魔法」を倒すことができるのでしょうか? 現在、多くの金融機関が関連する実装手段と関連テクノロジーのアプリケーションを持っています。たとえば、ライブ偽造防止や仲介者識別などのテクノロジーは、金融ビジネスのシナリオにも適用されています。

「ライブ偽造防止、中間識別、およびその他のテクノロジーの中核となる機能は、

顔認識の欠点を回避し、写真、ビデオ、マスク、シミュレーション モデルなど、特に次のようなものを効果的に識別することです。 MaMaConsumer Artificial Intelligence Research Instituteのインテリジェントコア専門家であるFeng Yue氏は、「このような技術革新に基づいて、MaMaConsumer Financeは現在、バッチ詐欺の99%を阻止することができます。顔変更および声変更詐欺がこの事件に登場しました。」と述べました。攻撃、偽造情報、仲介機関、偽造申請、長期貸付、通信詐欺、その他のリスクを効果的に防止します。」プロセス全体の末端にある金融機関と比較して、ソーシャル ソフトウェアは偽造検出メカニズムを導入し、ピア ユーザーに異常な行動や異常な画像偽造がないかどうかをマークするリアルタイムの通話認証リマインダーをユーザーに提供する義務があります。 、異常音捏造。より早期のリスク警告情報により、リスク結果の発生をより効果的に防止できます。 プラットフォーム関連の実装に加えて、一般の人々もいくつかの自助措置を講じることができます。現在、ユーザーのデータが顔や声の変更に使用されるのを防ぐことができるタイプの技術があります。このタイプの技術は、と呼ばれています。

敵対的サンプル テクノロジー。人間の顔画像を例にとると、肉眼では見えない敵対的摂動マスクを画像に混ぜることで、顔変更技術を無効にすることができます。ユーザーはこの種のテクノロジーを使用して、ソーシャルメディア上の画像や音声などのメディア情報を公開する前に保護できます。 最後に、

「予防意識」はすべての「魔法」の基礎ですであり、国民も私物や情報のセキュリティ保護を強化する必要があります。

「不明なテキスト メッセージのリンクや電子メールのリンクなどをクリックしないでください。不明なソースからの QR コードをスキャンしたり、アプリをダウンロードしたりしないでください。自分の顔やその他の個人生体情報を簡単に他人に提供しないでください。」 ID カード、銀行カード、確認コード、その他の情報を簡単に公開せず、アニメーションやビデオなどを過度に公開または共有しないでください」と Feng Yue 氏は提案しました。 「携帯電話やその他のモバイルデバイスが紛失しないという保証はありません。定期的に WeChat のチャット記録を消去したり、密接な関係を持つ人々との関連する痕跡を隠したり、モバイルのフォトアルバムを暗号化したり、携帯電話のデータ保護機能を有効にしたりすることができます。電話。これらの日常的な行為は詐欺につながる可能性があります。外部で傍受されます。」

成功を段階的に達成するには長い時間がかかります。人工知能テクノロジーの「悪用」を防ぐことは、デジタル時代においても中心的な問題であり続けるでしょう。

出典:金融業界情報

以上がAI顔交換詐欺で430万元騙し取られる 消費者専門家が直ちに3つの防御策を推奨の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7457

7457

15

15

1376

1376

52

52

77

77

11

11

17

17

14

14

カーソルAIでバイブコーディングを試してみましたが、驚くべきことです!

Mar 20, 2025 pm 03:34 PM

カーソルAIでバイブコーディングを試してみましたが、驚くべきことです!

Mar 20, 2025 pm 03:34 PM

バイブコーディングは、無限のコード行の代わりに自然言語を使用してアプリケーションを作成できるようにすることにより、ソフトウェア開発の世界を再構築しています。 Andrej Karpathyのような先見の明に触発されて、この革新的なアプローチは開発を許可します

2025年2月のトップ5 Genai発売:GPT-4.5、Grok-3など!

Mar 22, 2025 am 10:58 AM

2025年2月のトップ5 Genai発売:GPT-4.5、Grok-3など!

Mar 22, 2025 am 10:58 AM

2025年2月は、生成AIにとってさらにゲームを変える月であり、最も期待されるモデルのアップグレードと画期的な新機能のいくつかをもたらしました。 Xai’s Grok 3とAnthropic's Claude 3.7 SonnetからOpenaiのGまで

オブジェクト検出にYolo V12を使用する方法は?

Mar 22, 2025 am 11:07 AM

オブジェクト検出にYolo V12を使用する方法は?

Mar 22, 2025 am 11:07 AM

Yolo(あなたは一度だけ見ています)は、前のバージョンで各反復が改善され、主要なリアルタイムオブジェクト検出フレームワークでした。最新バージョンYolo V12は、精度を大幅に向上させる進歩を紹介します

ChatGpt 4 oは利用できますか?

Mar 28, 2025 pm 05:29 PM

ChatGpt 4 oは利用できますか?

Mar 28, 2025 pm 05:29 PM

CHATGPT 4は現在利用可能で広く使用されており、CHATGPT 3.5のような前任者と比較して、コンテキストを理解し、一貫した応答を生成することに大幅な改善を示しています。将来の開発には、よりパーソナライズされたインターが含まれる場合があります

Google' s Gencast:Gencast Mini Demoを使用した天気予報

Mar 16, 2025 pm 01:46 PM

Google' s Gencast:Gencast Mini Demoを使用した天気予報

Mar 16, 2025 pm 01:46 PM

Google Deepmind's Gencast:天気予報のための革新的なAI 天気予報は、初歩的な観察から洗練されたAI駆動の予測に移行する劇的な変化を受けました。 Google DeepmindのGencast、グラウンドブレイク

chatgptよりも優れたAIはどれですか?

Mar 18, 2025 pm 06:05 PM

chatgptよりも優れたAIはどれですか?

Mar 18, 2025 pm 06:05 PM

この記事では、Lamda、Llama、GrokのようなChatGptを超えるAIモデルについて説明し、正確性、理解、業界への影響における利点を強調しています(159文字)

O1対GPT-4O:OpenAIの新しいモデルはGPT-4Oよりも優れていますか?

Mar 16, 2025 am 11:47 AM

O1対GPT-4O:OpenAIの新しいモデルはGPT-4Oよりも優れていますか?

Mar 16, 2025 am 11:47 AM

OpenaiのO1:12日間の贈り物は、これまでで最も強力なモデルから始まります 12月の到着は、世界の一部の地域で雪片が世界的に減速し、雪片がもたらされますが、Openaiは始まったばかりです。 サム・アルトマンと彼のチームは12日間のギフトを立ち上げています

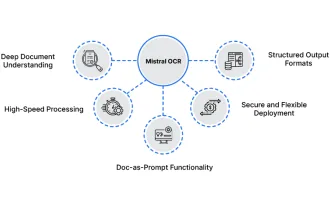

次のラグモデルにミストラルOCRを使用する方法

Mar 21, 2025 am 11:11 AM

次のラグモデルにミストラルOCRを使用する方法

Mar 21, 2025 am 11:11 AM

Mistral OCR:マルチモーダルドキュメントの理解により、検索された世代の革命を起こします 検索された生成(RAG)システムはAI機能を大幅に進めており、より多くの情報に基づいた応答のために膨大なデータストアにアクセスできるようになりました