ChatGPT の技術ロジックと進化を理解する 10 分 (前世、現世)

0. 前書き

11 月 30 日、OpenAI は、一般向けに無料でテストできる ChatGPT と呼ばれる AI チャットボットをリリースし、わずか数日でネットワーク全体で普及しました。

見出しや公開アカウントでの複数の宣伝から判断すると、コードを書いたり、バグをチェックしたりするだけでなく、小説を書いたり、学校への申請書を書いたりするなどのゲームの企画もできる万能なようです。

科学 (良い) と学習 (素晴らしい) の精神で、私は ChatGPT のテストと検証に時間をかけて、**ChatGPT が非常に「強力」である理由を整理しました**。

著者は AI を専門的に勉強したことがなく、エネルギーも限られているため、AI-003 のような詳細な技術的な章はすぐにありません。001 と 002 を理解することは、通常の食事の範囲を超えています。メロンの塊の範囲。

この記事には多くの専門用語が登場しますが、理解の難しさを軽減するよう努めます。

同時に、私はAIの専門家ではないので、間違いや漏れがあればご指摘ください。

謝辞: レビューしてくれたクラスメート X と Z、特にプロフェッショナリズムに優れたクラスメート X に感謝します

1. GPT とは

ChatGPT これには 2 つの単語が含まれています, 1つはチャット、つまり会話ができることです。別の言葉はGPTです。

GPT の正式名は、Generative Pre-Trained Transformer (生成事前トレーニング トランスフォーマー モデル) です。

この中には、Generative、Pre-Trained、Transformer という合計 3 つの単語が含まれています。

一部の読者は、私が上記でトランスフォーマーを中国語に翻訳していないことに気づくかもしれません。

Transformerは専門用語なので、直訳すると変圧器です。ただし、本来の意味が失われやすいので、翻訳しない方が良いでしょう。

Transformer については、以下の第 3 章で詳しく説明します。

2. GPT のテクノロジー進化タイムライン

GPT の開始から現在までの開発の歴史は次のとおりです:

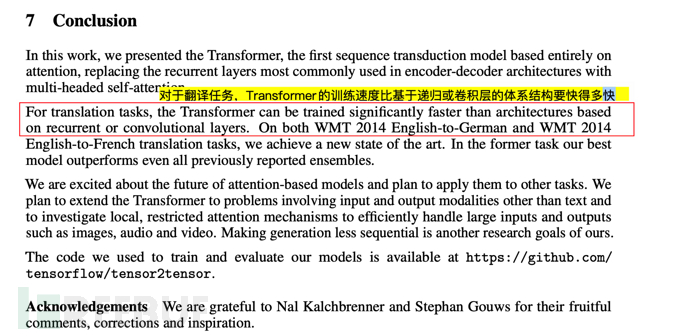

2017 年 6 月、Google は論文「注目は次のとおりです」を発表しました。 all you need" 》 は、GPT 開発の基礎となった Transformer モデルを最初に提案しました。論文アドレス: https://arxiv.org/abs/1706.03762

2018 年 6 月、OpenAI は論文「Improving Language Understanding by Generative Pre-Training」(生成的事前トレーニングによる言語理解能力の向上) をリリースしました。 、GPTモデル(Generative Pre-Training)を初めて提案しました。論文のアドレス: https://paperswithcode.com/method/gpt。

2019 年 2 月、OpenAI は論文「Language Models are Unsupervised Multitask Learners」(言語モデルは教師なしマルチタスク学習者であるべき) を発表し、GPT-2 モデルを提案しました。論文アドレス: https://paperswithcode.com/method/gpt-2

2020 年 5 月、OpenAI は論文「言語モデルは少数のショット学習者である」(言語モデルは少数のサンプルである必要があります) をリリースしました。論文アドレス: https://paperswithcode.com/method/gpt-3

2022 年 2 月末、OpenAI は論文「言語モデルのトレーニング」を発表しました。 「人間のフィードバックで指示に従う」(人間のフィードバック指示フローを使用して言語モデルをトレーニングする)、指示 GPT モデルを発表しました。論文アドレス: https://arxiv.org/abs/2203.02155

2022 年 11 月 30 日, OpenAI が ChatGPT を開始しました モデルは試用可能で、ネットワーク全体で非常に人気があります。参照: AI-001 - What can ChatGPT, a Popular chatbot on all network, do?

3. GPT の T- Transformer (2017) 第 1 章の

セクション 1 では、Transformer に適切な翻訳はないと述べましたが、

しかし、Transformer は GPT (Generative Pre-Training) の最も重要かつ基本的なキーワードです。 Transformer).

(注: GPT の Transformer は、Google の論文の元の Transformer と比較して簡素化されており、Decoder 部分のみが保持されています。この記事のセクション 4.3 を参照してください)

3.1. が焦点です善良さについてもっと知りたいですか?

善良な人間と同じように、最も重要なことは善良であること、あるいは人間であることです?

##読者の皆さん、そうですか?少し安全な答えは次のとおりです: 善人でも人間でもない; どちらもOK、彼らも人間です まあ、少し複雑なので、人間の言葉で話を広げてみましょう: 3.2. 申し訳ありませんが、あなたは良い人ですさらに拡張して、どうでしょうか? 「ごめんなさい、あなたは良い人です。」?セマンティクスの焦点は「ごめんなさい」になります。しかし、セマンティクスの前提は依然として人間です。3.3. に戻るトピック、トランスフォーマーとは何ですか。この記事「トランスフォーマーを 10 分で理解する」(https://zhuanlan.zhihu.com/p/82312421) を参照してください。ご存知のとおり、トランスフォーマーに関する私の次の内容は無視して、直接第 4 章に進んでください。よく理解できない場合は、私の理解を確認してください。参考になるかもしれません。3.3.1. 前世代の RNN モデルの主な欠陥

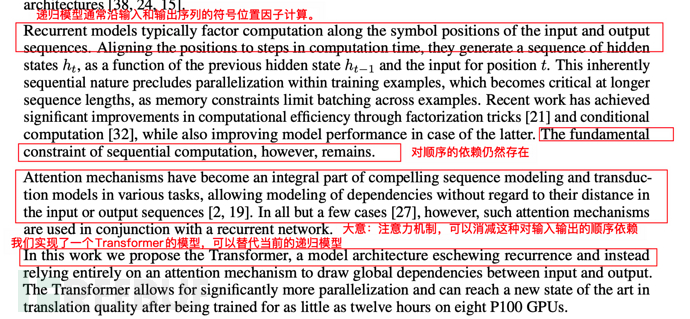

Transformer モデルが登場する前は、RNN モデル (リカレント ニューラル ネットワーク) が典型的な NLP モデルでした。 RNN には他にもバリアント モデルがあります (名前は無視しても、Transformer が登場した後は重要ではなくなりました) が、それらはすべて同じ問題を抱えており、うまく解決できません。

RNN の基本原理は、各単語のデータを保持しながら各単語ベクトルを左から右にブラウズすることであり (たとえば、これは犬です)、後続の各単語は前の単語に依存します。 RNN の重要な問題: RNN は逐次的に計算される必要があります。書籍や記事には多数の単語が含まれており、順序依存性があるため並列化できないため、効率が非常に低いことが想像できます。誰もがこのように理解するのは簡単ではないかもしれませんが、例を挙げてみましょう (実際の状況とは少し異なりますが、簡略化して理解しています):

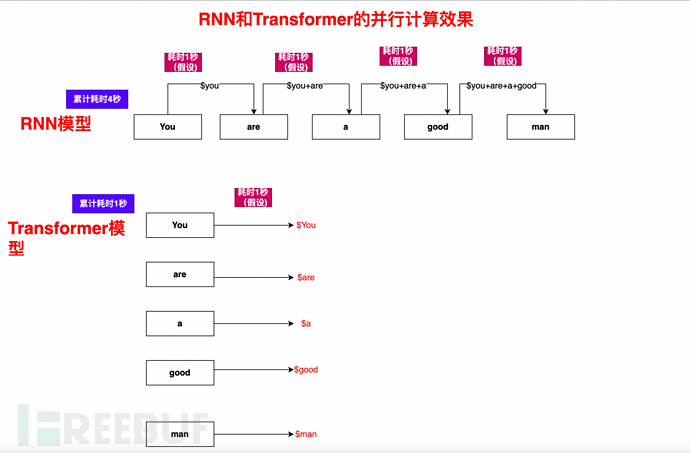

RNN ループでは、次の文はどうなりますか?あなたは良い男です、計算する必要があります? 毛織物?

1)、あなたとあなたは良い人を計算し、結果セット $You

2)、$You に基づいて、 Are と You are a good man を使用し、$ を計算しますAre

3)、$You、$Are に基づいて $a

4) などを計算し、$is、$good、$ man を計算し、最終的にあなたは良い人ですのすべての要素の完全な計算

ご覧のとおり、計算プロセスは 1 つずつ、逐次計算、単一の組立ラインであり、後続のプロセスは前のプロセスに依存するため、非常に遅い

3.3.2. Transformer のすべてに注意を払う

前述したように、2017 年 6 月に、Google は「必要なのは注意だけです」という論文をリリースしました。 、これが初めて Transformer モデルが提案され、GPT 開発の基礎となりました。論文アドレス: https://arxiv.org/abs/1706.03762

タイトルの「Attending is all you need」から、Transformer が実際に「All in Attendance」を提唱していることがわかります。

それでは、「注意」とは何でしょうか?

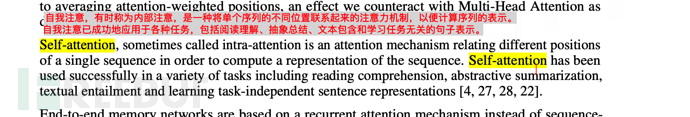

「必要なのは注意だけだ」という論文では、その定義を次のように見ることができます。

セルフ・アテンション (セルフ・アテンション) は、内部注意とも呼ばれ、シーケンスの表現を計算するために、単一シーケンスの異なる位置を関連付けるアテンション メカニズム。自己注意は、読解、抽象的な要約、談話の組み込み、タスクに依存しない文章表現の学習など、さまざまなタスクでうまく活用されています。

単純な理解単語間の相関関係は、注意のベクトルによって記述されます。

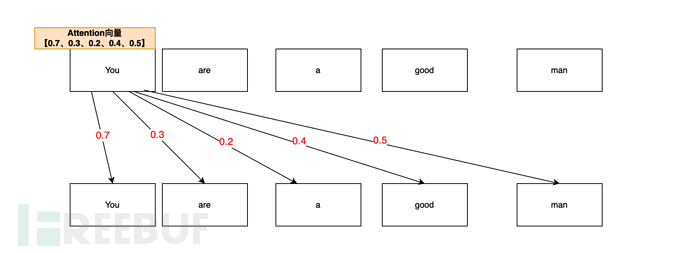

例: You are a good man (あなたは良い人です). AI が You の注意ベクトルを分析するとき、次のように分析する可能性があります:

From Your are a good man注意メカニズムを通じて測定された文では、あなたとあなた (自分) の間の注意相関確率が最も高くなります (0.7、70%)。結局のところ、あなた (あなた) が最初にあなた (あなた) であるため、あなたの注意は, あなた ベクトルは 0.7

あなたと男 (人) の注意ベクトルは (0.5, 50%) に関連しています、あなた (あなた) は人 (男) なので、あなたの注意ベクトルはそして人間は 0.5

あなたと良い人 (良い人) の間の注意相関は、再び (0.4、40%) であり、人間としての基準では、あなたはまだ良い人 (良い人) です。したがって、You,good の注意ベクトル値は 0.4

You,are のベクトル値は 0.3、You,a のベクトル値は 0.2 です。

つまり、最終的なあなたの注意ベクトル リストは [0.7, 0.3, 0.2, 0.4, 0.5] になります (この記事では例のみ)。

このように、多くの既成の記事、Web ページ、Zhihu Q&A、Baidu Zhizhi などは、自然な注釈付きデータ セット (一言で言えば、 、超節約)。

3.5.2. 逐次計算を並列計算に変換し、トレーニング時間を大幅に削減します

手動アノテーションに加えて、RNN についてはセクション 3.3.1 の主要な欠陥で説明します。逐次計算と単一パイプラインの問題です。

セルフアテンション メカニズムをマスク メカニズムおよびアルゴリズムの最適化と組み合わせることで、記事、文、または段落を並行して計算できます。

あなたは良い人です。コンピューターの数と同じだけ、Transformer がどれほど高速であるかがわかります:

4. GPT (Generative Pre-Training) - June 2018

次に、ChatGPT の前世 - GPT(1) です。

2018年6月、OpenAIはGPTモデル(Generative Pre-Training)を初めて提案した論文「Improving Language Understanding by Generative Pre-Training」(生成的事前トレーニングによる言語理解の向上)を発表しました。 。論文のアドレス: https://paperswithcode.com/method/gpt。

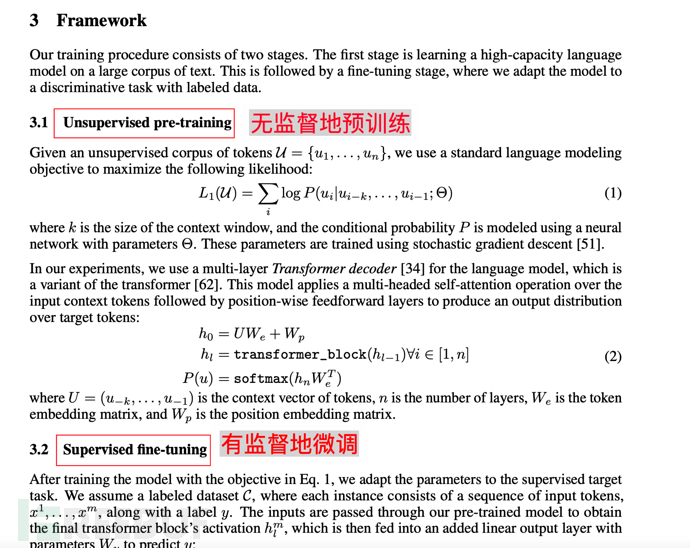

4.1. GPT モデルの核となる命題 1-事前トレーニング

GPT モデルは、Transformer が逐次相関と依存性を排除し、建設的な命題を提示するという前提に依存しています。

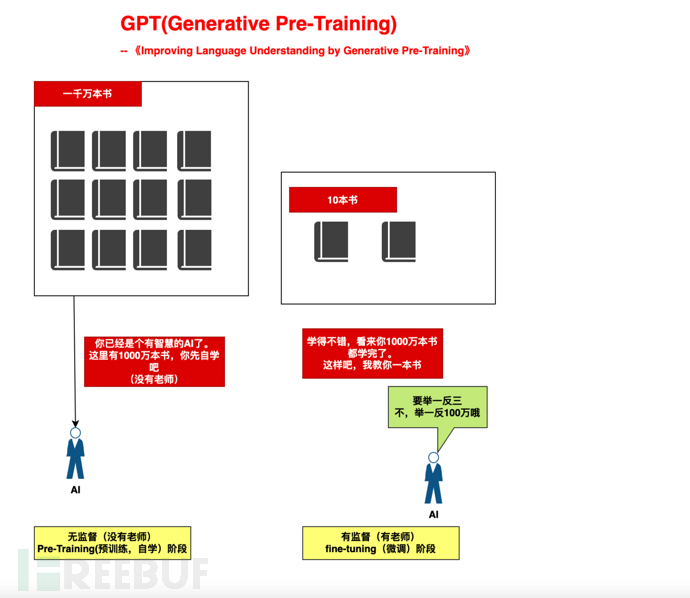

まず、大量の教師なし事前トレーニングを実行します。

注: 教師なしとは、人間の介入が必要なく、ラベル付きのデータセットも必要ないことを意味します (教材や教師は必要ありません) ) の事前トレーニング。

次に、少量の教師あり微調整を使用して、理解能力を修正します。

4.1.1. たとえば

たとえば、子供を 2 段階で育てるようなものです。 :

1)、大規模自習段階(1,000万冊の自習、教師なし):AIに十分な計算能力を提供し、アテンションメカニズムに基づいて自ら学習させます。

2)、小規模指導段階 (10 冊の本を教える): 10 冊の本に基づいて、1 つの例から推論を導き出します

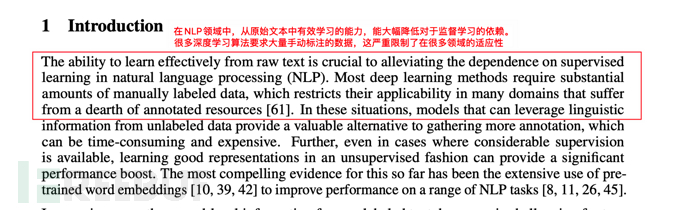

4.1.2. 論文冒頭の説明

いわゆる明確な導入、冒頭の導入から、GPT モデルの説明も見ることができます。教師あり学習とデータの手動ラベル付け。

4.2. GPT モデルの中核命題 2 - 生成

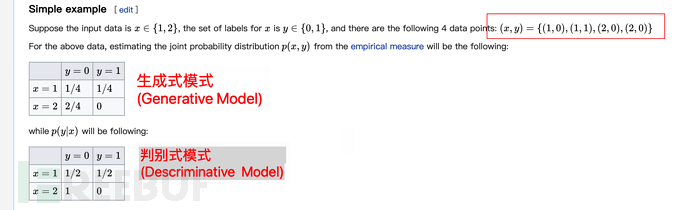

機械学習には、判別モデルと生成モデルがあります生成モデルには 2 つの違いがあります。

GPT (Generative Pre-Training) は、その名前が示すように、生成モデルを使用します。

生成モデルは判別モデルよりもビッグ データの学習に適しており、後者は正確なサンプル (手動でラベル付けされた有効なデータ セット) により適しています。事前トレーニングをより適切に実装するには、生成モデルの方が適切です。

注: このセクションの焦点は上の文にあります (ビッグ データの学習に適しています)。理解が複雑だと感じる場合は、このセクションの残りの部分は読まないでください。

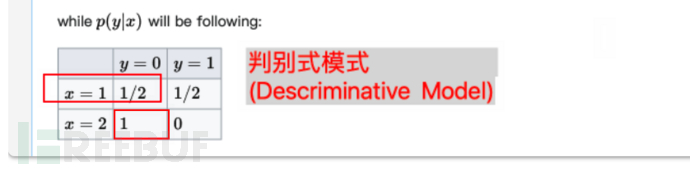

Wiki 生成モデル資料 (https://en.wikisensitivity.org/wiki/Generative_model) では、2 つの違いを説明するために次の例が示されています。

これだけを見てもわかりにくいかもしれませんので、補足説明させていただきます。

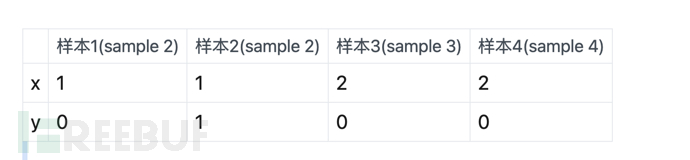

上記の意味は、サンプルが 4 つあると仮定した場合です:

すると、生成モデルの特徴は、確率がグループ化されていないことです (サンプル内の確率を計算し、サンプルの合計で割ります)。上記の表を例にとると、合計があることがわかります。 x=1、y=0 の確率は 1/4 (サンプルの総数は 4) であると考えられます。

同様に、x=2、y=0 は合計 2 つあり、x=2、y=0 の確率は 2/4 です。

判別モデルの特徴は**確率グループ分け計算(グループ内の確率を計算し、グループ内の和で割る)**です。上の表を例にとると、x=1とy=0のサンプルは合計1つ、x=1のグループはサンプルが合計2つあるため、確率は1/2となります。

同様に、x=2、y=0は合計2つあります。同時に、グループ内に x=2 のサンプルが 2 つある場合、x=2、y=0 の確率は 2/2=1 (つまり 100%) になります。

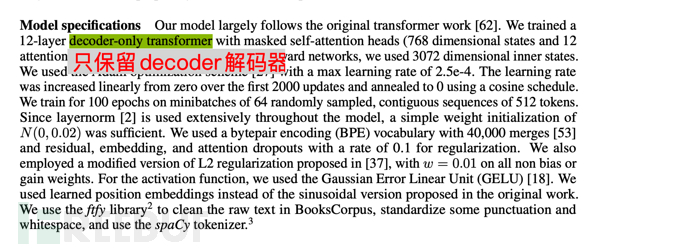

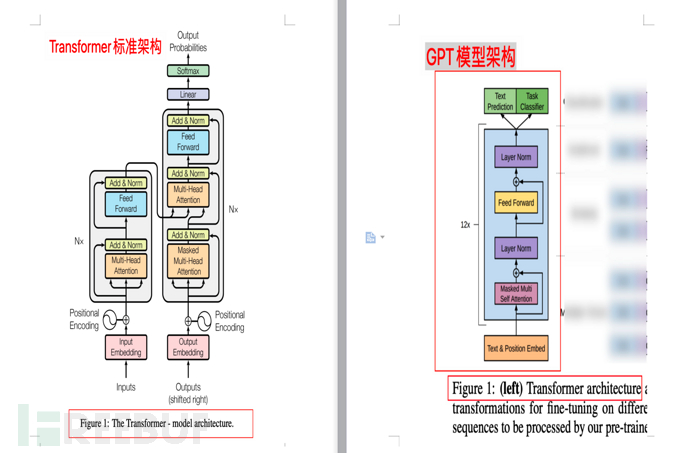

4.3. オリジナルの Transfomer と比較した GPT のモデルの改善

以下は GPT のモデルの説明です。GPT は 12 層デコーダのみのデコーダをトレーニングしました (デコーダのみ、エンコーダなし)により、モデルがより単純になります。

注 1: Google の論文「Attender is all you need」のオリジナルの Transformer は、Encoder と Decoder の 2 つの部分から構成されており、前者 (Encoder) は翻訳に相当し、後者 (Decoder) は生成に相当します。

注 2: Google は、Encoder をコアとして BERT (Bidirectional Encoder Representations from Transformers、Bidirectional Encoder Representations from Transformers) モデルを構築しました。双方向の内部は、BERT が上位コンテキストと下位コンテキストの両方を使用して単語を予測することを意味するため、BERT は自然言語理解タスク (NLU) の処理に優れています。

注 3: このセクションの主な点は、GPT は Transformer に基づいていますが、Transformer と比較すると、モデルが単純化され、Encoder が削除され、Decoder のみが保持されるということです。同時に、BERT のコンテキスト予測 (双方向) と比較して、GPT は単語のコンテキストのみを使用して単語を予測する (一方向) ことを推奨しており、モデルがよりシンプルで計算が速く、極端な生成により適しています。したがって、GPT の方が処理能力が優れています 自然言語生成タスク (NLG) は、AI-001 で発見したものです - インターネット上で人気のチャットボットである ChatGPT ができること ChatGPT は、「作文」を書いたり、嘘をでっち上げたりするのが非常に得意です。この段落を理解したら、このセクションの残りの部分を読む必要はありません。

注 4: 人間をシミュレートするという観点から見ると、GPT のメカニズムは実際の人間により似ています。なぜなら人間は、上(前に言ったこと)から次(つまり次)も推測するからです いわゆる発せられた言葉は、注がれた水のようなものです 人間は、後に言われたことで前の言葉を調整することはできませんたとえ間違っていると言ったとしても、悪い言葉は人の心を傷つけ、発せられた言葉(上記)に基づいてのみ修正し説明することができます。

4.3.1. アーキテクチャ図の比較

次の図は、Transformer モデルのアーキテクチャと GPT モデルの比較を示しています。アーキテクチャ (それぞれ論文より) 「必要なのは注意だけです」と「生成的事前トレーニングによる言語理解を向上させる」)

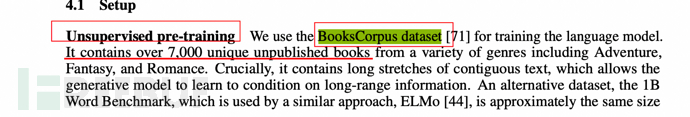

前述の生成モードは、大規模なデータ セットの事前トレーニングに適しています。では、GPT はどのくらいの大きさのデータ セットを使用するのでしょうか? 論文で述べたように、このデータセットは BooksCorpus と呼ばれるデータセットを使用しており、これには 7,000 冊を超える未出版の書籍が含まれています。

5.2. なぜそのような調整を行うのでしょうか?ゼロショット問題の解決を試みる

GPT-2 はなぜこのように調整されているのでしょうか?論文の記述から判断すると、ゼロショット(ゼロショット学習問題)**を解こうというものです。

ゼロショット (ゼロショット学習) の問題点は何ですか?それは単純に推論能力として理解できます。これは、未知のものに直面したときに、AIがそれを自動的に認識できる、つまり推論する能力を持っていることを意味します。

たとえば、動物園に行く前に、パンダのように白と黒の縞模様がある馬のような動物はシマウマであると教えます。シマウマを正しく見つけることができます。

5.3. マルチタスクを理解するにはどうすればよいですか?

従来の ML では、モデルをトレーニングする場合、特別な AI をトレーニングするための特別なアノテーション付きデータセットが必要です。

たとえば、犬の画像を認識できるロボットをトレーニングするには、犬のラベルが付けられた画像が 100 万枚必要ですが、トレーニング後、AI は犬を認識できるようになります。このAIはシングルタスクとも呼ばれる専用AIです。

マルチタスクに関しては、専用の AI をトレーニングするのではなく、あらゆるタスクを完了できるように大量のデータを供給することが提唱されています。

5.4. GPT-2 のデータとトレーニング規模

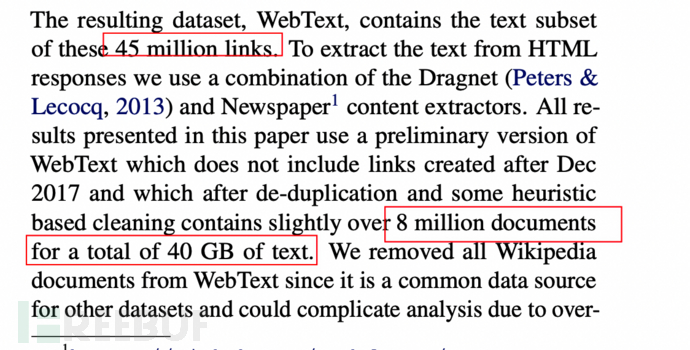

データセットは 800 万 Web ページ、サイズ 40GB に増加しました。

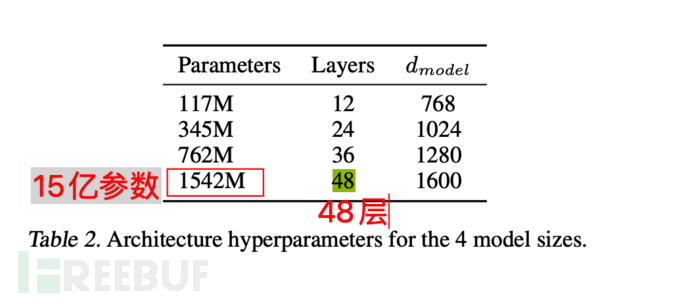

モデル自体も最大 15 億のパラメーターに達し、Transformer スタックは 48 レイヤーに達します。簡単に例えると、15 億個の人間のニューロンをシミュレートするようなものです (単なる例であり、完全に同等ではありません)。

6. GPT-3 (2020 年 5 月)

2020 年 5 月に、OpenAI は論文「言語モデルは少数の学習者である」(言語モデルは少数の学習者である) をリリースしました。モデルは数ショット学習器である必要があります)、GPT-3 モデルが提案されています。論文アドレス: https://paperswithcode.com/method/gpt-3

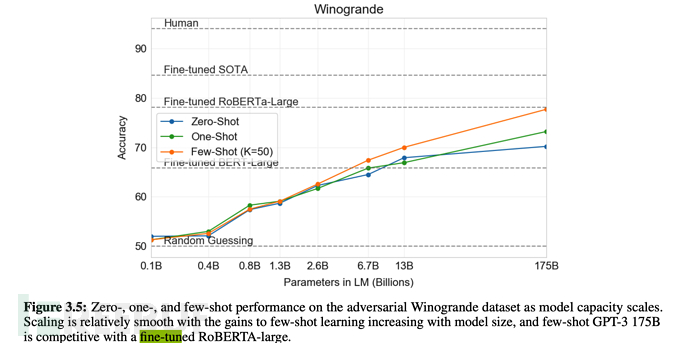

6.1. GPT-3 の画期的な効果の進行状況

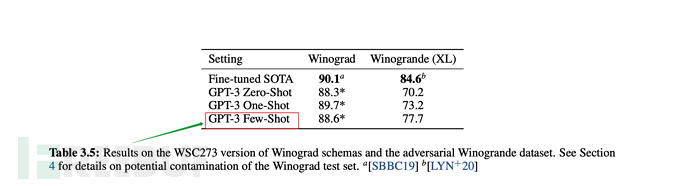

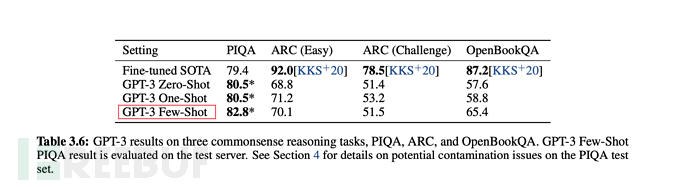

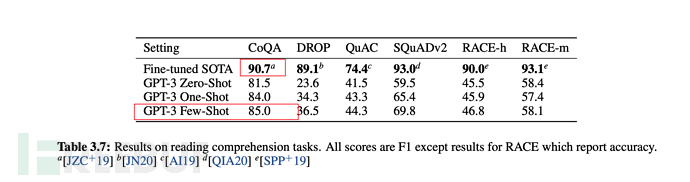

効果については論文で次のように説明されています:

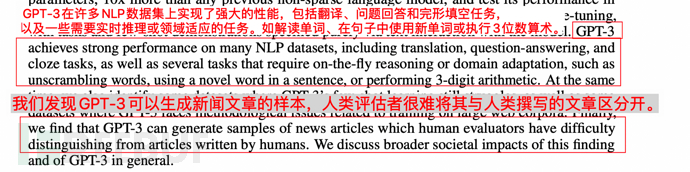

1. GPT-3 は、翻訳、質問応答、穴埋めで強力なパフォーマンスを発揮すると同時に、単語を解読したり、文中で新しい単語を使用したり、3 桁の計算を実行したりすることができます。

2. GPT-3 は、人間が識別できないニュース記事のサンプルを生成できます。

以下に示すように:

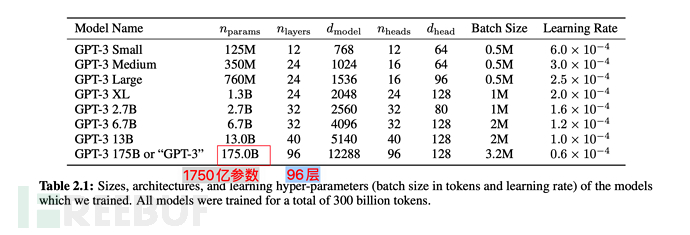

6.3. GPT-3 のトレーニング規模

6.3. GPT-3 のトレーニング規模

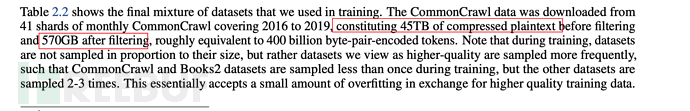

GPT-3 はフィルタリング前に 45TB の圧縮テキストを使用しますが、フィルタリング後もまだ 570GB の大量のデータが存在します。

モデルパラメータに関しては、GPT-2 の 15 億から 1,750 億に 110 倍以上増加し、トランスフォーマー層も GPT-2 の 15 億から 1,750 億に増加しました。 48から96まで。

モデルパラメータに関しては、GPT-2 の 15 億から 1,750 億に 110 倍以上増加し、トランスフォーマー層も GPT-2 の 15 億から 1,750 億に増加しました。 48から96まで。

7. 命令 GPT (2022 年 2 月)

2022 年 2 月末、OpenAI は、「人間のフィードバックを使用した指示に従う言語モデルのトレーニング」という論文をリリースしました。ヒューマンフィードバック) 言語モデルをトレーニングするための命令フローをフィードバックし、命令 GPT モデルを公開します。論文アドレス: https://arxiv.org/abs/2203.02155

7.1. GPT-3 と比較した命令 GPT の主要な変更点

命令 GPT は、GPT に基づく強化された最適化のラウンドです。 3 に準拠しているため、GPT-3.5 とも呼ばれます。

前述したように、GPT-3 は教師なし学習を主張しながら、少数ショットの少数ショット学習を提唱しています。

しかし実際には、少数ショットの効果は、監視を微調整する方法よりも明らかに悪いです。 ######だから何をすべきか?微調整を監督するために微調整に戻りますか?明らかに違います。

OpenAI は新しい答えを提供します。GPT-3 に基づいて、手動フィードバック (RHLF) に基づいて報酬モデル (報酬モデル) をトレーニングし、その報酬モデル (報酬モデル、RM) を使用してトレーニングと学習を行います。モデル。

なんてことだ、私は若くして死ぬことになる。 。機械 (AI) を訓練するために機械 (AI) を使用する時代が来ました。 。

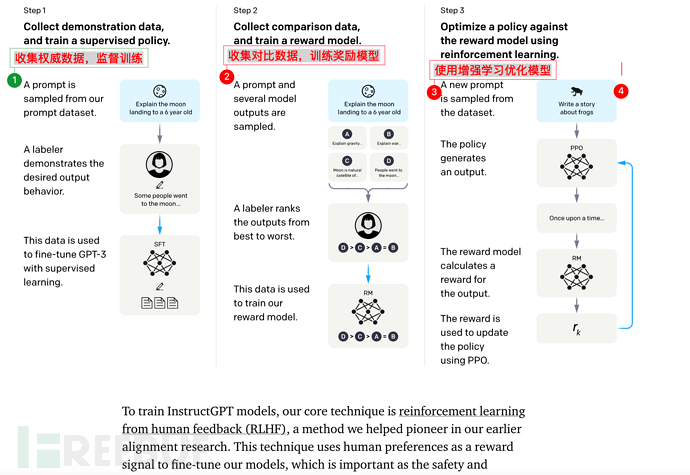

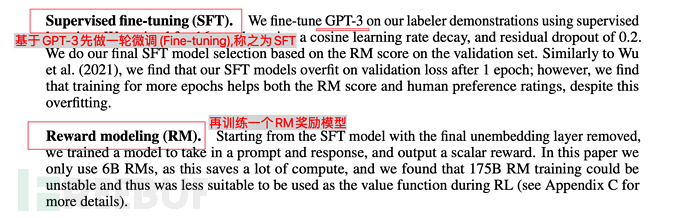

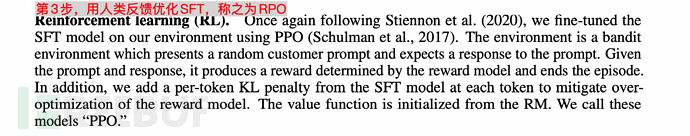

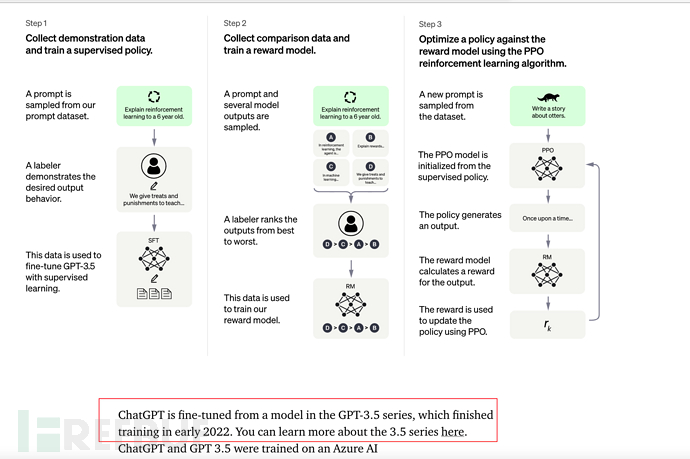

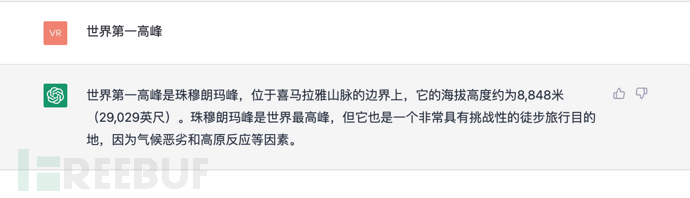

#7.2. インストラクション GPT のコア トレーニング ステップ

2)、次に報酬モデル (RM)

2)、次に報酬モデル (RM)

3) をトレーニングし、最後に強化学習を通じて SFT を最適化します

7.3. 命令 GPT のトレーニング スケール

7.3. 命令 GPT のトレーニング スケール

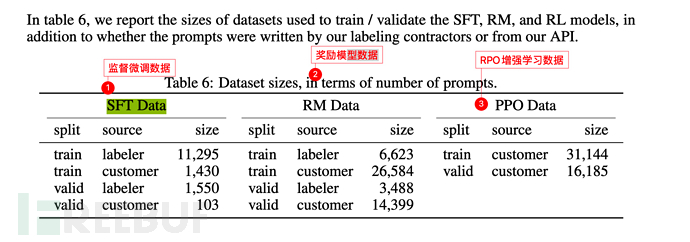

基本的なデータ スケールは、3 つのステップ (教師あり微調整 SFT、報酬) が追加されることを除いて、GPT-3 (セクション 6.3 を参照) と同じです。モデル トレーニング報酬モデル、RPO を最適化するための強化された学習)。

下の図のラベラーは、OpenAI によって雇用されている、または OpenAI に関連するラベラー (ラベラー)** を指します。

顧客とは、GPT-3 API を呼び出すユーザー (つまり、他の機械学習研究者、プログラマーなど) を指します。

ChatGPT のリリース後、ユーザーは 100 万人を超えていると言われており、私たち一人ひとりがその顧客であるため、将来 GPT-4 がリリースされると、その顧客は規模は少なくとも100万人になるだろう。

8. ChatGPT (2022 年 11 月) 2022 年 11 月 30 日、OpenAI は ChatGPT モデルを開始し、トライアルを提供しました。これは全体的に人気になりました。通信網。

2022 年 11 月 30 日、OpenAI は ChatGPT モデルを開始し、トライアルを提供しました。これは全体的に人気になりました。通信網。

参照: AI-001-人気のチャットボット ChatGPT でできること

8.1、ChatGPT と命令 GPT

ChatGPT と命令 GPT は本質的に同じ世代であり、単にベースになっているだけです。 structGPTにチャット機能を追加し、より効果的なアノテーションデータを生成するためのテストトレーニング用に公開しています。

8.2. [重要、以下の推奨ビデオを参照することをお勧めします] 人間の直感的な理解の観点から、ChatGPT の中心原理を補足説明します  は、国立台湾大学 Li Honyi 教授のビデオ「ChatGPT はどのように作られるのか?」を参照できます。 GPT ソーシャル化プロセス」は非常にわかりやすく説明されています。

は、国立台湾大学 Li Honyi 教授のビデオ「ChatGPT はどのように作られるのか?」を参照できます。 GPT ソーシャル化プロセス」は非常にわかりやすく説明されています。

https://www.inside.com.tw/article/30032-chatgpt-possible-4-steps-training

GPT は一方向の生成です。つまり、次のとおりです。上記をもとに生成されます。

たとえば、次のような文があります:

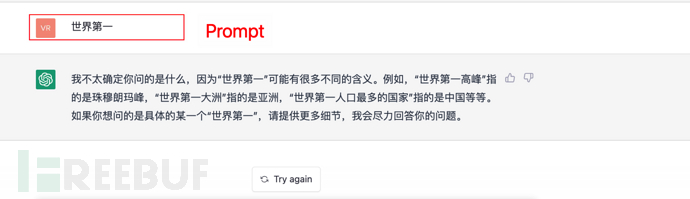

GPT モデルに入力を与える こんにちは、次の言葉は迎えに来ますね。ハンサムですね?あなたはそんなに背が高いですか?あなたはどのくらい美しいですか?待ってください。GPT は確率を計算し、最も高い確率を答えとして返します。

同様に、コマンド (またはプロンプト) が与えられると、ChatGPT は上記 (プロンプト) に基づいて次の (答え) も計算し、同時に上記の中で最も確率の高いものを選択して答えます。 。

以下に示すように:

概要:

概要:

1) 2017 年、Google は「必要なのは注意だけ」という論文を発表し、GPT への道を開く Transformer モデルを提案しました。

2)、2018 年 6 月、OpenAI は、BooksCorpus の大規模データ セット (7000 冊) を通じてトレーニングされた GPT 生成事前トレーニング モデルをリリースし、大規模な教師なし事前トレーニング (事前トレーニング) を提唱しました。トレーニング)モデル構築のための微調整(微調整)を監督しました。

3) 2019 年 2 月、OpenAI は GPT-2 モデルをリリースし、トレーニングの規模をさらに拡大しました (最大 15 億のパラメーターを持つ 40 GB のデータセットを使用)。同時にアイデア面ではファインチューニングプロセスを排除し、ゼロショット(ゼロショット学習)とマルチタスク(マルチタスク)を重視。しかし結局のところ、ゼロショットの効果は微調整よりも大幅に劣ります。

4), 2020 年 5 月、OpenAI は GPT-3 モデルをリリースし、**トレーニング規模をさらに拡大しました (570 GB のデータセットと 1,750 億のパラメーターを使用)**。同時に、少数ショット(少数のサンプル)学習モデルを採用し、優れた結果を達成します。もちろん、実験では微調整も同時に比較しましたが、効果は微調整よりもわずかに悪かったです。

5), OpenAIは2022年2月に命令GPTモデルをリリースしましたが、今回は主にGPT-3をベースとした教師あり微調整(Supervised Fine-tuning)リンクを追加し、これをベースにさらに追加 Reward Model 報酬モデルがインストールされ、RM トレーニング モデルを使用して、学習モデル上で RPO 拡張学習の最適化が実行されます。

6), 2022年11月30日、OpenAIは複数回の反復学習を経たstructGPTとして理解できるChatGPTモデルをリリースし、これをベースにチャット対話機能が追加されました。

10. 将来 (GPT-4 か?)

さまざまな兆候から判断すると、GPT-4 は 2023 年に発表される可能性がありますか?どれほど強力になるでしょうか?

同時に、ChatGPTの効果は業界でも大きな注目を集めており、今後はGPTに基づく学習モデルやその応用がさらに盛んになると考えられます。

未来はすぐにやって来ます、待ってみましょう。

いくつかの参考文献

ai.googleblog.com/2017/08/transformer-novel-neural-network.html

https://arxiv.org/abs/ 1706.03762

https://paperswithcode.com/method/gpt

https://paperswithcode.com/method/gpt-2

https://paperswithcode.com / Method/gpt-3

https://arxiv.org/abs/2203.02155

https://zhuanlan.zhihu.com/p/464520503

https: / /zhuanlan.zhihu.com/p/82312421

https://cloud.tencent.com/developer/article/1656975

https://cloud.tencent.com/developer/article /1848106

https://zhuanlan.zhihu.com/p/353423931

https://zhuanlan.zhihu.com/p/353350370

https://zhuanlan.zhihu.com/p/353423931

juejin.cn/post/6969394206414471175

https://zhuanlan.zhihu.com/p/266202548

https://en.wikisensitivity.org/wiki/Generative_model

https://zhuanlan.zhihu.com/p/67119176

https://zhuanlan.zhihu.com/p/365554706

https://cloud.tencent .com/developer /article/1877406

https://zhuanlan.zhihu.com/p/34656727

###https://zhuanlan.zhihu.com/p/590311003###以上がChatGPT の技術ロジックと進化を理解する 10 分 (前世、現世)の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7505

7505

15

15

1378

1378

52

52

78

78

11

11

19

19

55

55

ChatGPT では、無料ユーザーが 1 日あたりの制限付きで DALL-E 3 を使用して画像を生成できるようになりました

Aug 09, 2024 pm 09:37 PM

ChatGPT では、無料ユーザーが 1 日あたりの制限付きで DALL-E 3 を使用して画像を生成できるようになりました

Aug 09, 2024 pm 09:37 PM

DALL-E 3は、前モデルより大幅に改良されたモデルとして2023年9月に正式導入されました。これは、複雑な詳細を含む画像を作成できる、これまでで最高の AI 画像ジェネレーターの 1 つと考えられています。ただし、発売当初は対象外でした

Stable Diffusion 3 の論文がついに公開され、アーキテクチャの詳細が明らかになりましたが、Sora の再現に役立つでしょうか?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3 の論文がついに公開され、アーキテクチャの詳細が明らかになりましたが、Sora の再現に役立つでしょうか?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3 の論文がついに登場しました!このモデルは2週間前にリリースされ、Soraと同じDiT(DiffusionTransformer)アーキテクチャを採用しており、リリースされると大きな話題を呼びました。前バージョンと比較して、StableDiffusion3で生成される画像の品質が大幅に向上し、マルチテーマプロンプトに対応したほか、テキスト書き込み効果も向上し、文字化けが発生しなくなりました。 StabilityAI は、StableDiffusion3 はパラメータ サイズが 800M から 8B までの一連のモデルであると指摘しました。このパラメーター範囲は、モデルを多くのポータブル デバイス上で直接実行できることを意味し、AI の使用を大幅に削減します。

自動運転と軌道予測についてはこの記事を読めば十分です!

Feb 28, 2024 pm 07:20 PM

自動運転と軌道予測についてはこの記事を読めば十分です!

Feb 28, 2024 pm 07:20 PM

自動運転では軌道予測が重要な役割を果たしており、自動運転軌道予測とは、車両の走行過程におけるさまざまなデータを分析し、将来の車両の走行軌跡を予測することを指します。自動運転のコアモジュールとして、軌道予測の品質は下流の計画制御にとって非常に重要です。軌道予測タスクには豊富な技術スタックがあり、自動運転の動的/静的知覚、高精度地図、車線境界線、ニューラル ネットワーク アーキテクチャ (CNN&GNN&Transformer) スキルなどに精通している必要があります。始めるのは非常に困難です。多くのファンは、できるだけ早く軌道予測を始めて、落とし穴を避けたいと考えています。今日は、軌道予測に関するよくある問題と入門的な学習方法を取り上げます。関連知識の紹介 1. プレビュー用紙は整っていますか? A: まずアンケートを見てください。

携帯電話にchatgptをインストールする方法

Mar 05, 2024 pm 02:31 PM

携帯電話にchatgptをインストールする方法

Mar 05, 2024 pm 02:31 PM

インストール手順: 1. ChatGTP ソフトウェアを ChatGTP 公式 Web サイトまたはモバイル ストアからダウンロードします; 2. それを開いた後、設定インターフェイスで言語を中国語を選択します; 3. ゲーム インターフェイスでヒューマン マシン ゲームを選択し、中国スペクトル; 4 . 起動後、チャット ウィンドウにコマンドを入力してソフトウェアを操作します。

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

この論文では、自動運転においてさまざまな視野角 (遠近法や鳥瞰図など) から物体を正確に検出するという問題、特に、特徴を遠近法 (PV) 空間から鳥瞰図 (BEV) 空間に効果的に変換する方法について検討します。 Visual Transformation (VT) モジュールを介して実装されます。既存の手法は、2D から 3D への変換と 3D から 2D への変換という 2 つの戦略に大別されます。 2D から 3D への手法は、深さの確率を予測することで高密度の 2D フィーチャを改善しますが、特に遠方の領域では、深さ予測に固有の不確実性により不正確さが生じる可能性があります。 3D から 2D への方法では通常、3D クエリを使用して 2D フィーチャをサンプリングし、Transformer を通じて 3D と 2D フィーチャ間の対応のアテンション ウェイトを学習します。これにより、計算時間と展開時間が増加します。

中国でもchatgptは使えますか?

Mar 05, 2024 pm 03:05 PM

中国でもchatgptは使えますか?

Mar 05, 2024 pm 03:05 PM

chatgpt は中国でも使用できますが、香港やマカオでも登録できません。ユーザーが登録したい場合は、外国の携帯電話番号を使用して登録できます。登録プロセス中にネットワーク環境を切り替える必要があることに注意してください。外国のIP。

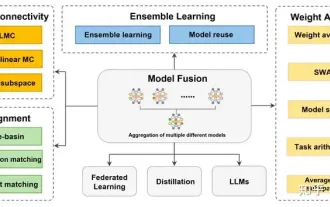

レビュー!深いモデルの融合 (LLM/基本モデル/フェデレーテッド ラーニング/ファインチューニングなど)

Apr 18, 2024 pm 09:43 PM

レビュー!深いモデルの融合 (LLM/基本モデル/フェデレーテッド ラーニング/ファインチューニングなど)

Apr 18, 2024 pm 09:43 PM

9 月 23 日、論文「DeepModelFusion:ASurvey」が国立国防技術大学、JD.com、北京理工大学によって発表されました。ディープ モデルの融合/マージは、複数のディープ ラーニング モデルのパラメーターまたは予測を 1 つのモデルに結合する新しいテクノロジーです。さまざまなモデルの機能を組み合わせて、個々のモデルのバイアスとエラーを補償し、パフォーマンスを向上させます。大規模な深層学習モデル (LLM や基本モデルなど) での深層モデルの融合は、高い計算コスト、高次元のパラメーター空間、異なる異種モデル間の干渉など、いくつかの課題に直面しています。この記事では、既存のディープ モデル フュージョン手法を 4 つのカテゴリに分類します。 (1) 「パターン接続」。損失低減パスを介して重み空間内の解を接続し、より適切な初期モデル フュージョンを取得します。

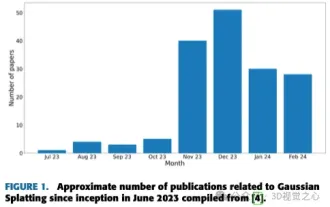

単なる 3D ガウス以上のもの!最先端の 3D 再構成技術の最新概要

Jun 02, 2024 pm 06:57 PM

単なる 3D ガウス以上のもの!最先端の 3D 再構成技術の最新概要

Jun 02, 2024 pm 06:57 PM

上記と著者の個人的な理解は、画像ベースの 3D 再構成は、一連の入力画像からオブジェクトまたはシーンの 3D 形状を推測することを含む困難なタスクであるということです。学習ベースの手法は、3D形状を直接推定できることから注目を集めています。このレビュー ペーパーは、これまでにない新しいビューの生成など、最先端の 3D 再構成技術に焦点を当てています。入力タイプ、モデル構造、出力表現、トレーニング戦略など、ガウス スプラッシュ メソッドの最近の開発の概要が提供されます。未解決の課題と今後の方向性についても議論します。この分野の急速な進歩と 3D 再構成手法を強化する数多くの機会を考慮すると、アルゴリズムを徹底的に調査することが重要であると思われます。したがって、この研究は、ガウス散乱の最近の進歩の包括的な概要を提供します。 (親指を上にスワイプしてください