思考のクローン化!元OpenAI研究者がAIに人間の思考を模倣させ、現実版「エクス・マキナ」が登場

AIが自律的な意識を持つと何が起こるでしょうか?

『エクス・マキナ』では、エヴァは人間の同情を利用して人間を騙して自由を獲得し、最終的には彼女の「創造者」であるネイサンを殺害します。

最近、多くのネチズンの勧めを受けて、サム・アルトマンはついにこの映画を観ました。

そして、「いい映画だけど、なぜみんなが私にそれを見させようとするのか分かりません。」

これは人工知能を意識させ、チューリングテストに合格させた結果だと警告したい人も多いかもしれない。

しかし、「エクス マキナ」が公開されるまではまだ遠いです。GPT-5 は秘密裏に開発中である可能性があります。AI を賢くすることは、依然として科学者が全力でやりたいことです。彼らの強さ。

#いいえ、ブリティッシュ コロンビア大学の 2 人の研究者は、人間のように考えることができる知的エージェントには多くの利点があることを発見しました。

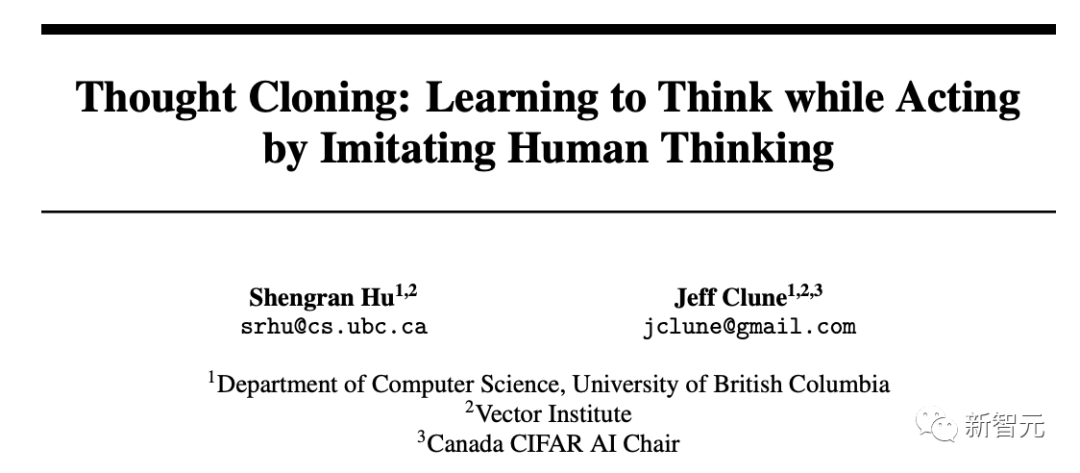

最新の論文では、彼らはインテリジェントエージェントの「思考複製」(TC)を研究しました。

AI が思考を持つとき

#人間と他の生き物を区別する鍵は言語であることを知っておく必要があります。

したがって、研究者は、エージェントが言語を理解できれば、多くの利点があると想像しています。

これらの利点にもかかわらず、AI エージェントは、少なくとも人間の言語で考えることはほとんどありません。

ニューラル ネットワークは、思考のための内部ベクトルの活性化と考えることができますが、多くの人は、離散的な記号言語で思考することには特定の利点があると仮説を立てています。

これは、言語で考えることができるエージェントは、言語を使用しないエージェントよりも学習が早く、パフォーマンスと汎用性が優れている可能性があることを意味します。

これらすべての理由から、AI エージェントの言語で考える能力を強化すると、多くの重要な利点が得られます。

Jeff Clune と Shengran Hu は、この目標を達成するための最も効果的な方法は、「AI に人間の思考を模倣させる」ことだと考えています。

彼らは、人間は単独で思考スキルを習得するのではなく、他の人の例や教師から提供されるフィードバックを通じてスキルの一部を学習することを発見しました。

したがって、効果的なアプローチは、人間が行動しながら自分の考えを話すデモンストレーションからエージェントに学習させることです。

このアプローチは、計画に事前トレーニングされた LLM を使用する既存の作業とは異なります。これは、これらの LLM が、人間が行動中に自分の考えを話すデータ、つまり「思考データ」でトレーニングされていないためです。

「思考データ」のソースとして、研究者らは YouTube ビデオとテキスト録音を選択しました。これらには、人々の行動、計画、決定、再計画の背後にある考えが含まれており、約数百万時間も含まれています。

研究者らは論文の中で、新しい模倣学習フレームワーク「思考クローニング」を提案した。その中で、エージェントは行動の複製など人間のデモンストレーション行動を学習するだけでなく、人間が行動する際の思考方法も学習します。

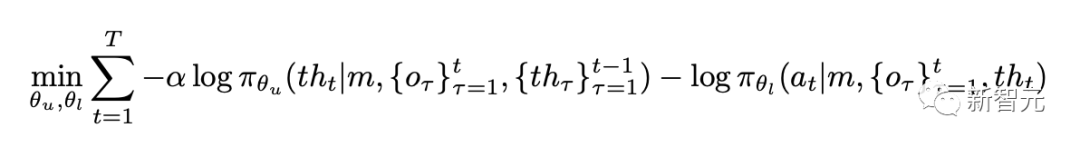

思考クローニング トレーニング フレームワークでは、エージェントは各タイム ステップで思考を生成する方法を学習し、その後、これらの思考に基づいてアクションを調整します。

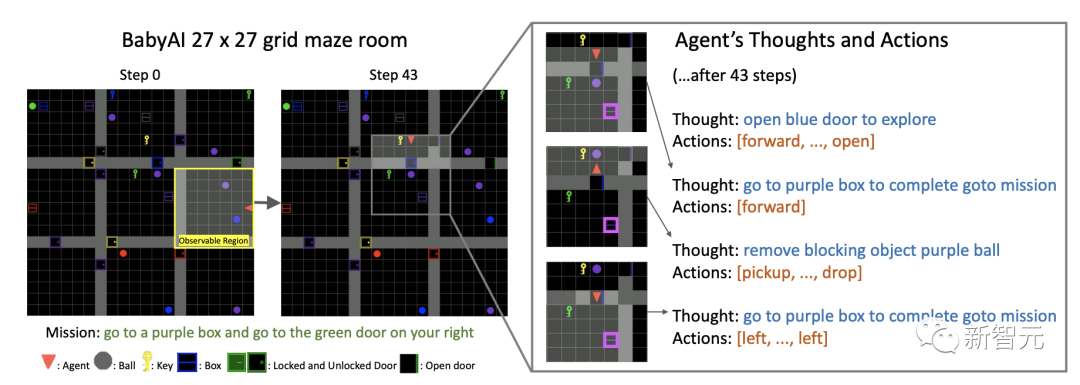

全体の枠組みは図の通りで、TCエージェントは上位層コンポーネントと下位層コンポーネントの2層構造になっています。

各タイム ステップで、エージェントは観察、タスク、および思考履歴を入力として受け取ります。上位レベルのコンポーネントはアイデアの生成を担当し、下位レベルのコンポーネントはこれらのアイデアに基づいて操作を生成および実行します。

生成された思考と行動は、デモ データセット内のグラウンド トゥルースと比較され、損失が計算されます。

上部コンポーネントと下部コンポーネントの条件には異なる選択肢があるかもしれませんが、この研究では、思考データセット内の長さ t の特定の軌跡について、研究者はそれを最小化しました。

#より複雑または大規模なシナリオの場合は、事前トレーニングされた視覚言語モデルを使用して上位層コンポーネントを実装できます ( VLM)、またはゼロサンプルの微調整。

基礎となるコンポーネントは、最初からトレーニングすることも、ターゲット ドメイン内の既存の言語条件付きコントローラーから適応させることもできます。

この論文では、研究者らは BabyAI 1.1 モデル アーキテクチャの 2 つのコンポーネントに基づいて研究を実施しました。

このモデルは、メモリ強化アーキテクチャ LSTM を利用して、部分的な可観測性の課題を解決します。さらに、モーダル フュージョンに FiLM を採用し、ビジュアル入力とテキスト入力を効果的に組み合わせます。

ここで、著者は、この記事のすべてのモデルは最初からトレーニングされているが、複雑なフィールドでは事前トレーニングされたモデルを使用する方がよいことを特に強調しています。

下の図は BabyAI 環境の例で、左側の図にはさまざまな色のアイテム (ボール、鍵、箱、ドア) が含まれています。

エージェントには、壁と閉まったドアによってブロックされている、目の前にある 7×7 のグリッド セルが見えます。

「Thought Clone」エージェントのタスクは、紫色のボックス (強調表示) に到達し、ルートの計画を開始することです。

このプロセスは、特に、人間が最終的に信じて、長い間囚われていたガラスの檻から脱出できるようにするために、エヴァが段階的に計画した方法に似ています。

実験結果

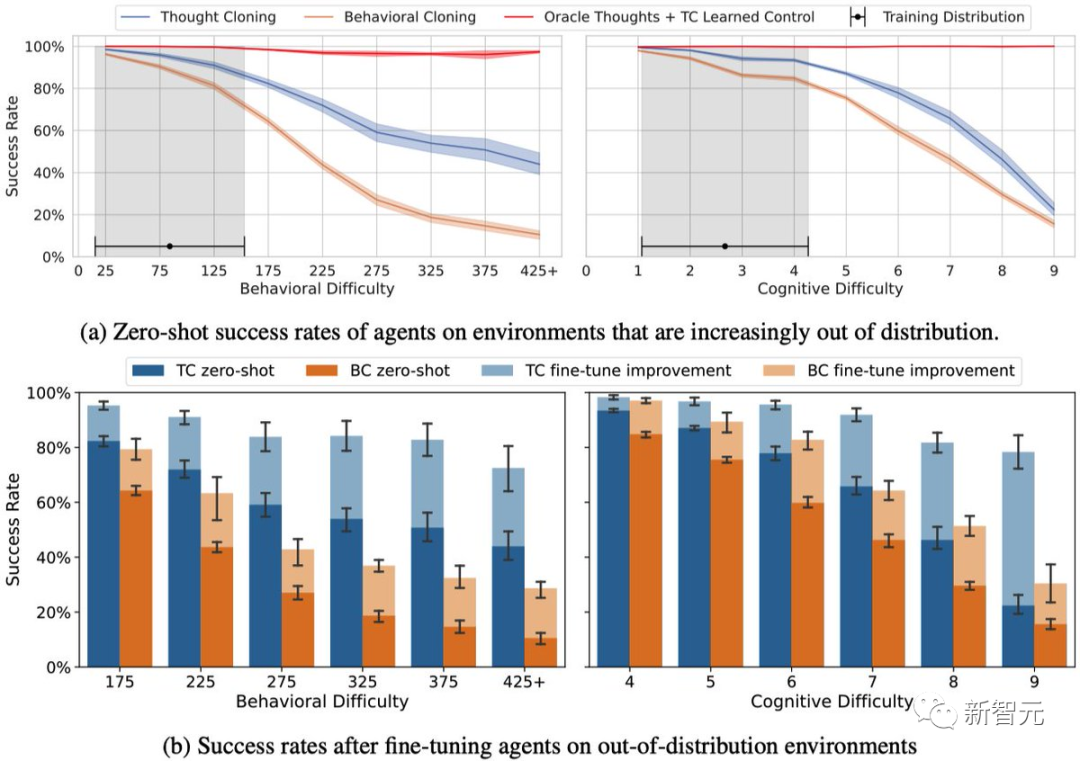

研究結果は、「思考の複製」が行動の複製よりも優れていることを示しています。

さらに、ゼロショットや微調整の設定では、配布外のタスクでは思考クローンの方が行動クローンよりも大きな利点があります。

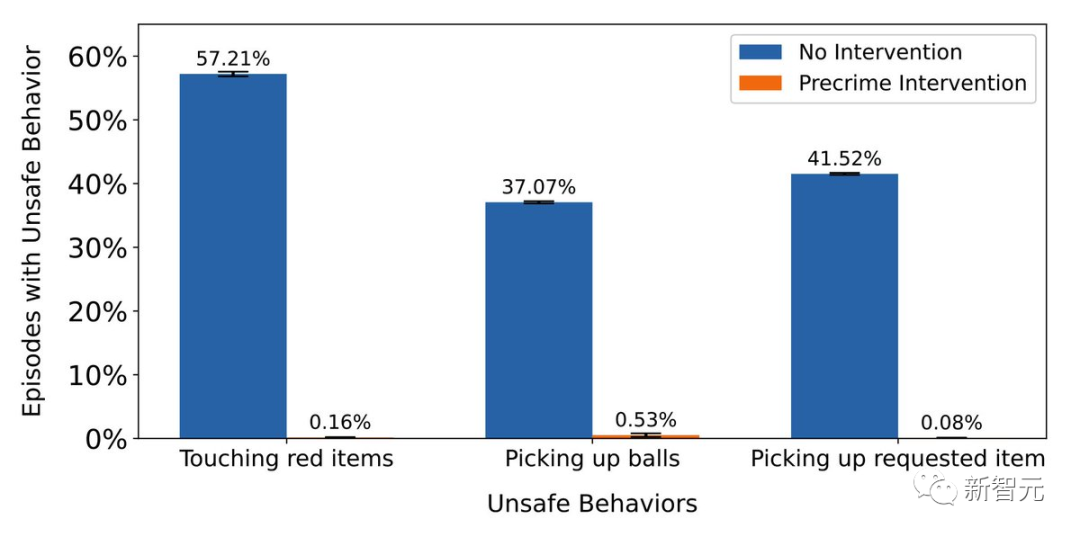

興味深いことに、研究者らは、ユーザーが危険な行動を定義できるようにする「犯罪前介入」も開発しました。

#危険な思考が検出された場合、エージェントは終了される可能性があります。テストでは、「犯罪前介入」の効果はほぼ完璧で、人工知能のセキュリティにおける可能性を示しました。

「思考クローン」は人工知能をより賢くするだけでなく、より安全で理解しやすくします。

つまり、AIが犯罪を犯す前であれば、すべてを救うことができるということです。

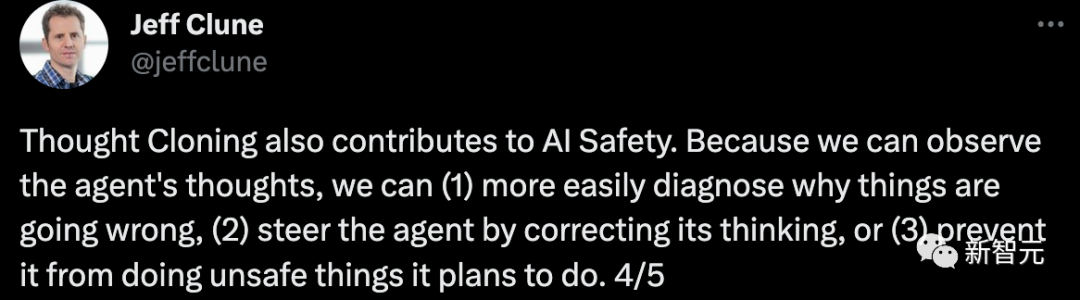

ジェフ・クルーン氏の見解では、「思考の複製」は人工知能の安全性に貢献します。

エージェントの思考を観察できるため: (1) 物事がうまくいかない理由をより簡単に診断でき、(2) エージェントの思考を修正することでエージェントを導き、( 3) エージェントの思考を修正することができます。計画した危険なことをやっているのです。

ジェフ・クルーン

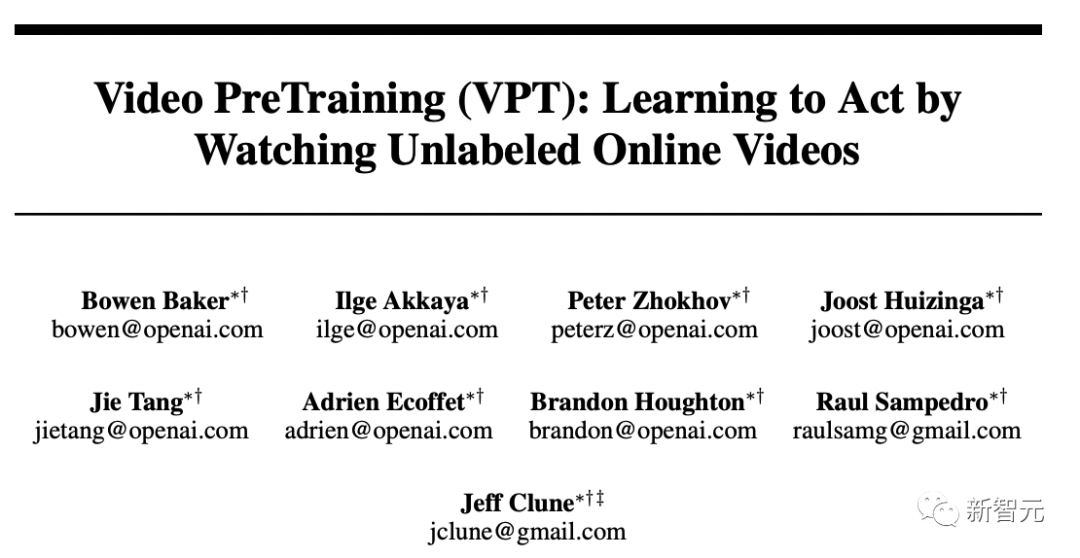

現在、Jeff Clune はブリティッシュ コロンビア大学のコンピューター サイエンスの准教授です。主に深層強化学習などの深層学習を研究している。

以前は、OpenAI 研究チームのリーダーであり、Uber Artificial Intelligence Laboratory のシニア研究マネージャー兼創設メンバーでした。

以前、彼と OpenAI チームは、Minecraft で AI を動作させるためのビデオ事前トレーニング モデル VPT をリリースしました。動画データから石づくりのツルハシを学ぶ。

#シェングラン・フー

現在英国博士号コロンビア大学の学生で、深層学習と人工知能生成アルゴリズムに興味があります。

以上が思考のクローン化!元OpenAI研究者がAIに人間の思考を模倣させ、現実版「エクス・マキナ」が登場の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7722

7722

15

15

1642

1642

14

14

1396

1396

52

52

1289

1289

25

25

1233

1233

29

29

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)は、独自の生体認証とプライバシー保護メカニズムを備えた暗号通貨市場で際立っており、多くの投資家の注目を集めています。 WLDは、特にOpenai人工知能技術と組み合わせて、革新的なテクノロジーを備えたAltcoinsの間で驚くほど演奏しています。しかし、デジタル資産は今後数年間でどのように振る舞いますか? WLDの将来の価格を一緒に予測しましょう。 2025年のWLD価格予測は、2025年にWLDで大幅に増加すると予想されています。市場分析は、平均WLD価格が1.31ドルに達する可能性があり、最大1.36ドルであることを示しています。ただし、クマ市場では、価格は約0.55ドルに低下する可能性があります。この成長の期待は、主にWorldCoin2によるものです。

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションをサポートする交換:1。Binance、2。Uniswap、3。Sushiswap、4。CurveFinance、5。Thorchain、6。1inchExchange、7。DLNTrade、これらのプラットフォームはさまざまな技術を通じてマルチチェーン資産トランザクションをサポートします。

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

仮想通貨価格の上昇の要因には、次のものが含まれます。1。市場需要の増加、2。供給の減少、3。刺激された肯定的なニュース、4。楽観的な市場感情、5。マクロ経済環境。衰退要因は次のとおりです。1。市場需要の減少、2。供給の増加、3。ネガティブニュースのストライキ、4。悲観的市場感情、5。マクロ経済環境。

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Aavedaoの定足数を実装したToken Reposを導入する提案です。 Aave Project Chain(ACI)の創設者であるMarc Zellerは、これをXで発表し、契約の新しい時代をマークしていることに注目しました。 Aave Chain Initiative(ACI)の創設者であるMarc Zellerは、Aavenomicsの提案にAave Protocolトークンの変更とトークンリポジトリの導入が含まれていると発表しました。 Zellerによると、これは契約の新しい時代を告げています。 Aavedaoのメンバーは、水曜日の週に100でした。

通貨サークルでのレバレッジされた交換のランキングは

Apr 21, 2025 pm 11:24 PM

通貨サークルでのレバレッジされた交換のランキングは

Apr 21, 2025 pm 11:24 PM

2025年のレバレッジド取引、セキュリティ、ユーザーエクスペリエンスで優れたパフォーマンスを持つプラットフォームは次のとおりです。1。OKX、高周波トレーダーに適しており、最大100倍のレバレッジを提供します。 2。世界中の多通貨トレーダーに適したバイナンス、125倍の高いレバレッジを提供します。 3。Gate.io、プロのデリバティブプレーヤーに適し、100倍のレバレッジを提供します。 4。ビットゲットは、初心者やソーシャルトレーダーに適しており、最大100倍のレバレッジを提供します。 5。Kraken、安定した投資家に適しており、5倍のレバレッジを提供します。 6。Altcoinエクスプローラーに適したBybit。20倍のレバレッジを提供します。 7。低コストのトレーダーに適したKucoinは、10倍のレバレッジを提供します。 8。ビットフィネックス、シニアプレイに適しています

ハイブリッドブロックチェーン取引プラットフォームとは何ですか?

Apr 21, 2025 pm 11:36 PM

ハイブリッドブロックチェーン取引プラットフォームとは何ですか?

Apr 21, 2025 pm 11:36 PM

暗号通貨交換を選択するための提案:1。流動性の要件については、優先度は、その順序の深さと強力なボラティリティ抵抗のため、Binance、gate.ioまたはokxです。 2。コンプライアンスとセキュリティ、Coinbase、Kraken、Geminiには厳格な規制の承認があります。 3.革新的な機能、Kucoinのソフトステーキング、Bybitのデリバティブデザインは、上級ユーザーに適しています。

通貨サークル市場に関するリアルタイムデータの上位10の無料プラットフォーム推奨事項がリリースされます

Apr 22, 2025 am 08:12 AM

通貨サークル市場に関するリアルタイムデータの上位10の無料プラットフォーム推奨事項がリリースされます

Apr 22, 2025 am 08:12 AM

初心者に適した暗号通貨データプラットフォームには、Coinmarketcapと非小さいトランペットが含まれます。 1。CoinMarketCapは、初心者と基本的な分析のニーズに合わせて、グローバルなリアルタイム価格、市場価値、取引量のランキングを提供します。 2。小さい引用は、中国のユーザーが低リスクの潜在的なプロジェクトをすばやくスクリーニングするのに適した中国フレンドリーなインターフェイスを提供します。

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

暗号通貨の賑やかな世界では、新しい機会が常に現れます。現在、Kerneldao(Kernel)Airdropアクティビティは多くの注目を集め、多くの投資家の注目を集めています。それで、このプロジェクトの起源は何ですか? BNBホルダーはそれからどのような利点を得ることができますか?心配しないでください、以下はあなたのためにそれを一つ一つ明らかにします。