PHPをベースにしたクローラフレームワークの紹介と活用事例の詳細解説

インターネット情報の爆発的な増加に伴い、多くのユーザーにとって重要な価値のある大量のデータが Web サイトに保存されています。したがって、クローラー技術は徐々にインターネット データを活用する強力な手段になってきました。

この記事では、PHP 言語に基づくクローラー フレームワークである Guzzle と Goutte を紹介します。 Guzzle は、PHP 用に開発された HTTP クライアントで、HTTP リクエストを送信し、REST リソースと対話するために使用できます。 Goutte はそれを補完するもので、Web コンテンツを簡単に取得し、データの抽出と分析を実行できる Guzzle ベースの Web クローラー フレームワークです。

まず、PHP に Guzzle と Goutte をインストールする必要があります。 Composer からインストールできます。具体的なコマンドは次のとおりです:

composer require guzzlehttp/guzzle composer require fabpot/goutte

インストールが完了したら、まず Guzzle の使い方を学びましょう。次のコードを使用して、HTTP GET リクエストを送信し、応答コンテンツを取得できます。

<?php

use GuzzleHttpClient;

$client = new Client();

$response = $client->get('https://www.example.com');

echo $response->getBody();このコードは、まず GuzzleClient オブジェクトを作成し、次に get() メソッドを使用して GET リクエストを指定された URL に送信します。と 応答内容を取得しました。 getBody() メソッドを呼び出して、応答本文の内容を取得します。

Goutte は Guzzle をベースに開発された Web クローラー フレームワークであり、その使用方法も非常に簡単です。次に、Goutte を使用する簡単な例を示します。

<?php

use GoutteClient;

$client = new Client();

$crawler = $client->request('GET', 'https://www.example.com');

$crawler->filter('h1')->each(function ($node) {

echo $node->text() . "

";

});このコードは、Goutte を使用して Client オブジェクトを作成し、指定された URL に GET リクエストを送信し、応答本文を取得して DOM オブジェクトに解析します。 $crawler->filter('h1') は、ページ上のすべての h1 タグ ノードを指定するフィルターであり、 each() メソッドを呼び出します。各 h1 タグ ノードに対して、指定された匿名関数が実行されます。 $node は現在のノード オブジェクトであり、その text() メソッドはノードのテキスト コンテンツを取得できます。

以下のより完全な例を見てみましょう。これは、Goutte を使用して Zhihu 上の質問と回答をクロールし、ユーザー名、回答内容、いいねの数、回答時間を CSV ファイルに保存する方法を示しています。

<?php

use GoutteClient;

$client = new Client();

$crawler = $client->request('GET', 'https://www.zhihu.com/question/21774949');

$fp = fopen('output.csv', 'w');

fputcsv($fp, ['User', 'Content', 'Votes', 'Time']);

$crawler->filter('.List-item')->each(function ($node) use ($fp) {

$user = $node->filter('.AuthorInfo .Popover')->text();

$content = $node->filter('.RichText')->text();

$votes = $node->filter('.Voters')->text();

$time = $node->filter('.ContentItem-time')->text();

fputcsv($fp, [$user, $content, $votes, $time]);

});

fclose($fp);このコードは、まず Zhihu の質問 ID 21774949 のページをクロールし、次にファイル ハンドルを使用して CSV ヘッダー行をoutput.csv ファイルに書き込みます。次に、filter() メソッドを使用してページ上のすべての質問ノードと回答ノードを検索し、各ノードで匿名関数を実行します。匿名関数では、filter() メソッドを使用して各ユーザーの名前、回答内容、いいね数、回答時間を検索し、fputcsv() メソッドを使用してこれら 4 つのフィールドをファイルに書き込みます。最後にファイルハンドルを閉じます。

要約すると、Guzzle と Goutte を使用してクローラー フレームワークを構築するのは非常に簡単で、強力な柔軟性とスケーラビリティを備えており、データ マイニングを含む (ただしこれに限定されない) さまざまなシナリオに適用できます。 、SEO 最適化およびその他の分野。ただし、ターゲット Web サイトに過度の負担をかけたり、ユーザーのプライバシーを侵害したりしないように、クローラーは Web サイトの robots.txt ファイルに準拠する必要があることに注意してください。

以上がPHPをベースにしたクローラフレームワークの紹介と活用事例の詳細解説の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7475

7475

15

15

1377

1377

52

52

77

77

11

11

19

19

31

31

Ubuntu および Debian 用の PHP 8.4 インストールおよびアップグレード ガイド

Dec 24, 2024 pm 04:42 PM

Ubuntu および Debian 用の PHP 8.4 インストールおよびアップグレード ガイド

Dec 24, 2024 pm 04:42 PM

PHP 8.4 では、いくつかの新機能、セキュリティの改善、パフォーマンスの改善が行われ、かなりの量の機能の非推奨と削除が行われています。 このガイドでは、Ubuntu、Debian、またはその派生版に PHP 8.4 をインストールする方法、または PHP 8.4 にアップグレードする方法について説明します。

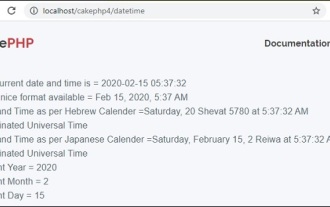

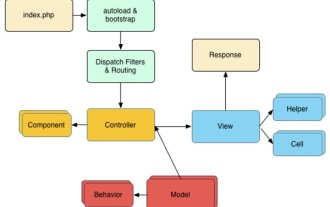

CakePHP について話し合う

Sep 10, 2024 pm 05:28 PM

CakePHP について話し合う

Sep 10, 2024 pm 05:28 PM

CakePHP は、PHP 用のオープンソース フレームワークです。これは、アプリケーションの開発、展開、保守をより簡単にすることを目的としています。 CakePHP は、強力かつ理解しやすい MVC のようなアーキテクチャに基づいています。モデル、ビュー、コントローラー

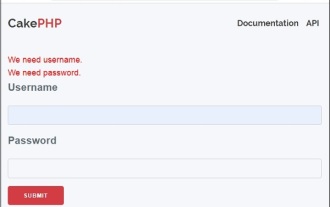

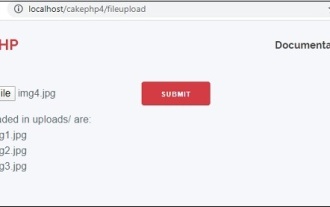

CakePHP ファイルのアップロード

Sep 10, 2024 pm 05:27 PM

CakePHP ファイルのアップロード

Sep 10, 2024 pm 05:27 PM

ファイルのアップロードを行うには、フォーム ヘルパーを使用します。ここではファイルアップロードの例を示します。

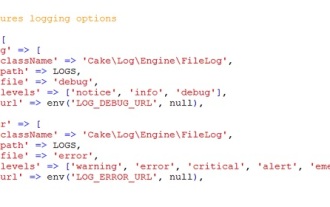

CakePHP のロギング

Sep 10, 2024 pm 05:26 PM

CakePHP のロギング

Sep 10, 2024 pm 05:26 PM

CakePHP へのログインは非常に簡単な作業です。使用する関数は 1 つだけです。 cronjob などのバックグラウンド プロセスのエラー、例外、ユーザー アクティビティ、ユーザーが実行したアクションをログに記録できます。 CakePHP でのデータのログ記録は簡単です。 log()関数が提供されています

PHP 開発用に Visual Studio Code (VS Code) をセットアップする方法

Dec 20, 2024 am 11:31 AM

PHP 開発用に Visual Studio Code (VS Code) をセットアップする方法

Dec 20, 2024 am 11:31 AM

Visual Studio Code (VS Code とも呼ばれる) は、すべての主要なオペレーティング システムで利用できる無料のソース コード エディター (統合開発環境 (IDE)) です。 多くのプログラミング言語の拡張機能の大規模なコレクションを備えた VS Code は、

CakePHP クイックガイド

Sep 10, 2024 pm 05:27 PM

CakePHP クイックガイド

Sep 10, 2024 pm 05:27 PM

CakePHP はオープンソースの MVC フレームワークです。これにより、アプリケーションの開発、展開、保守がはるかに簡単になります。 CakePHP には、最も一般的なタスクの過負荷を軽減するためのライブラリが多数あります。