テクノロジー周辺機器

テクノロジー周辺機器

AI

AI

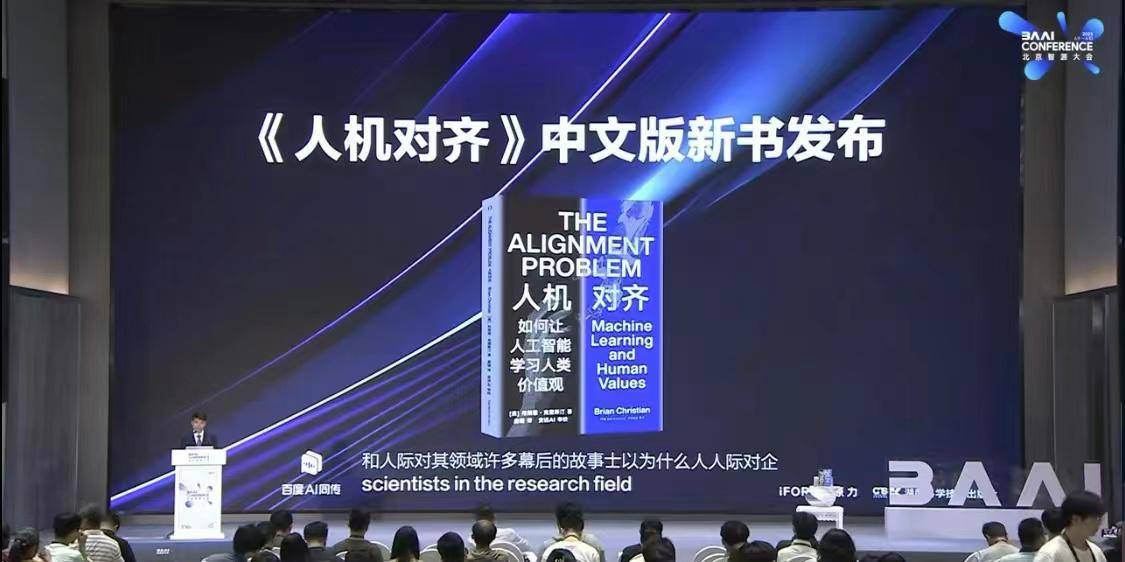

2023 Intelligent Source ConferenceでのAIセキュリティの話題が注目を集め、新刊『Human-Machine Alignment』が発売されました。

2023 Intelligent Source ConferenceでのAIセキュリティの話題が注目を集め、新刊『Human-Machine Alignment』が発売されました。

2023 Intelligent Source ConferenceでのAIセキュリティの話題が注目を集め、新刊『Human-Machine Alignment』が発売されました。

AI分野の多くの探検家や実践者が集まり、研究結果を共有し、実践経験を交換し、科学技術の美しさについて語り合いました。2023年北京インテリジェントソースカンファレンスはこのほど成功裏に開催されました。人工知能の分野、この輝かしい知恵 アイデアの交換や何百もの素晴らしいレポートやディスカッションを通じて、私たちは知能の驚くべき進化を共同で目撃することになります。

AI セキュリティと調整フォーラムでは、多くの専門家や学者が大規模モデルの時代に、ますます強力かつ多用途になる人工知能システムが安全で制御可能であり、人間の意図や価値観と一致していることをどのように保証するかについて意見交換しました。は非常に重要な問題です。この安全性の問題は、人間と機械の調整 (AI 調整) 問題としても知られており、今世紀の人類社会が直面する最も緊急かつ有意義な科学的課題の 1 つを表しています。

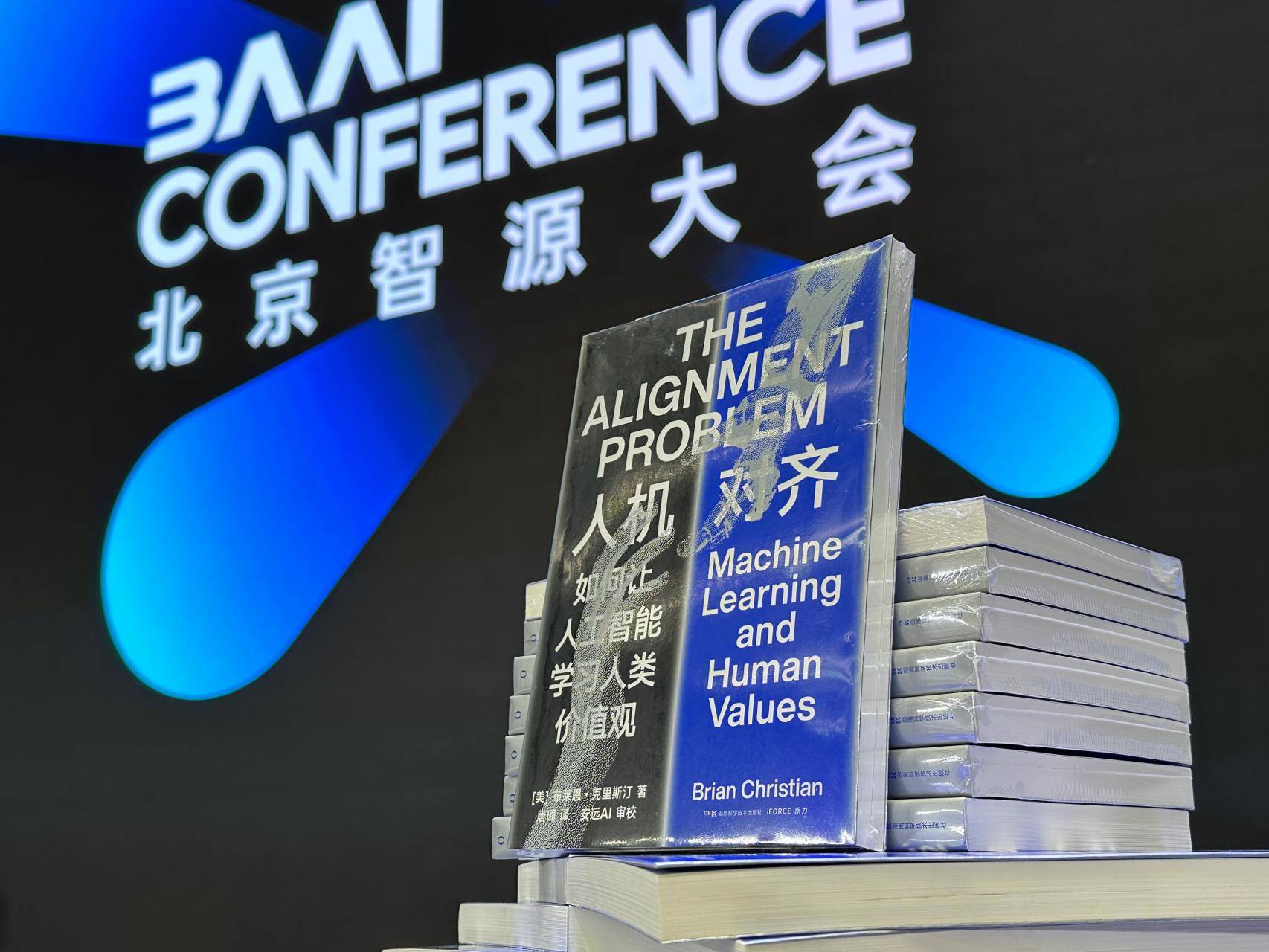

フォーラムでは、「ディープラーニングの父」ジェフリー・ヒントン氏、OpenAI 創設者サム・アルトマン氏、学者の張博氏を含む国内外のゲスト 14 名が、人間と機械の調整と大規模モデルの実現可能性に焦点を当てました。ブライアン・クリスチャン氏の最新作「The Alignment 問題」(中国語版のタイトルは「Human-Machine Alignment」)もカンファレンスで正式に発表されました。この本は湖南省科学技術出版局によって紹介および出版され、Anyuan AI によって書評されました。 Anyuan AIの創設者であるXie Minxi氏が新刊発売式を主宰した。

「Human-Computer Alignment」の著者であるブライアン・クリスチャン氏がオンライン講演に招待されました。スピーチでは、まず読者と会合に出席したゲストに挨拶を送りました。彼は新刊『Human-Machine Alignment』の出版を光栄に思っており、この本が中国における人工知能分野の継続的な研究に貢献できることを期待している。同時に、「人間と機械の調整」の主な内容について簡単に紹介します: この本は 3 つの部分に分かれており、最初の部分では機械学習システムに影響を与える現在の倫理と安全性の問題について説明します。 3 番目の記事では、教師あり学習、自己教師あり学習、強化学習に基づいて、現実世界の複雑な AI システムを調整する方法について説明します。中国での『Human-Computer Alignment』のリリースが研究者を助けるだけでなく、この分野に対する私たちの熱意を専門家以外のあらゆる人々に伝えることにも役立つことを願っています。最後に同氏は、今回の会議での議論や中国のAI分野の研究を通じて、人工知能分野の世界的な発展が促進されることへの期待を表明した。

《人間と機械の調整》

【米国】Brian Christian 著、Tang Lu 訳

出版社: 湖南科学技術出版社

最新の機械学習システムは非常に強力になっており、さまざまな状況で私たちに代わって情報を観察したり聞いたりして、私たちのために意思決定を行うことができます。しかし、警鐘が鳴らされている。機械学習が急速に進歩するにつれて、懸念も高まっています。人工知能 (AI) が私たちの真の目標と矛盾して動作する場合、潜在的なリスクや倫理的問題が発生する可能性があります。研究者らはこれをアライメント問題と呼んでいます。

ブライアン クリスチャンは、AI と私たちにとって切り離せない問題を生き生きとした文体で明確に説明しており、彼のベストセラー作品の読者は多くの恩恵を受けています。この本の中で、私たちはアライメント問題に積極的に取り組んだ最初の学者たちを知り、AIの開発が制御不能になるのを防ぐための彼らの並外れた努力と野心的な計画について学びます。クリステンは、機械学習の発展の歴史を簡潔に説明しただけでなく、自ら科学研究の最前線に深く入り込んで科学者と対話し、機械学習の最先端の進歩を正確に紹介しました。配列問題の研究の成否は人類の将来に重大な影響を与えるものであり、読者はそれを深く実感することができる。

調整の問題は、人間としての私たち自身の偏見や盲点を明らかにする鏡でもあり、私たちが決して明言されていない思い込みや、しばしば矛盾する目標をはっきりと見ることができるようになります。これは、人間のテクノロジーだけでなく人間の文化を検証し、時にはイライラさせ、時には啓示を与える、素晴らしい学際的な叙事詩です。

この本は海外で出版されると熱狂的な反響を呼び、Microsoft CEO Satya Nadella によって 2021 年に最もインスピレーションを与えられた 5 冊の本の 1 つとして挙げられ、ニューヨーク タイムズによって主要な AI テクノロジーとして評価されました。著者のブライアン・クリスチャン氏は次のように述べています。「中国の AI 分野と、より広範な中国の読者にもこの本が読まれることを願っています。皆さんにとって、この本が内容が豊富で、考えさせられ、刺激的なものであることを願っていますが、そうではないでしょう。研究者としてのあなたを助けるだけでなく、この分野に対するあなたの熱意をあなたの人生のコンピュータ科学者以外の人々に伝えるのにも役立ちます。」

暁翔朝報記者、周世豪

以上が2023 Intelligent Source ConferenceでのAIセキュリティの話題が注目を集め、新刊『Human-Machine Alignment』が発売されました。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7488

7488

15

15

1377

1377

52

52

77

77

11

11

19

19

40

40

AIが不正行為に遭遇したとき

May 31, 2023 pm 02:06 PM

AIが不正行為に遭遇したとき

May 31, 2023 pm 02:06 PM

「今日、詐欺が一般的であることは知っていますが、実際に詐欺に遭遇したことがまだ信じられません。」 5 月 23 日、読者のウー・ジアさん(仮名)は、数日前に遭遇した通信詐欺のことを思い出し、まだ恐怖を感じていました。 Wu Jia さんが遭遇した詐欺では、詐欺師は AI を使って Wu Jia さんの顔をよく知っている人物に変えていました。 Wu Jia さんは日常生活で防御が難しい AI 詐欺に遭遇しただけでなく、北京ビジネスデイリーの記者は、AI テクノロジーを使用した新しい通信詐欺モデルが最近高い頻度で発生していることに気づきました。 「会社経営者が 10 分で 430 万元を騙し取られた」などのテクノロジートピックが次々とホットな検索トピックに上がり、ユーザー間で新テクノロジーの応用についての議論も巻き起こっています。 「AI顔を変える」詐欺 人工知能が再び人気を集めているが、今回は通信詐欺だ。ウー・ジア

AI時代にChatGPTを安全に使う方法が白熱した議論を呼んでいる

Jun 03, 2023 pm 05:35 PM

AI時代にChatGPTを安全に使う方法が白熱した議論を呼んでいる

Jun 03, 2023 pm 05:35 PM

2022 年 11 月に一般公開されて以来、ChatGPT は大幅な成長を遂げてきました。 ChatGPT は多くの企業や個人にとって不可欠なツールとなっていますが、ChatGPT が私たちの日常生活に組み込まれ、大規模に仕事が行われるようになると、人々は自然に「ChatGPT は安全に使用できるのか?」と考えるようになります。 ChatGPT は、開発者によって実装された広範なセキュリティ対策、データ処理方法、プライバシー ポリシーにより、一般に安全であると考えられています。ただし、他のテクノロジーと同様に、ChatGPT もセキュリティの問題や脆弱性の影響を受けないわけではありません。この記事は、ChatGPT と AI 言語モデルのセキュリティをより深く理解するのに役立ちます。データの機密性、ユーザーのプライバシー、潜在的なリスク、AI 規制、セキュリティ対策などの側面を検討します。最後に、チャットに興味があるでしょう

10,000 ワードの長文丨 AI セキュリティ産業チェーン、ソリューション、起業の機会を解体する

Jun 06, 2023 pm 12:53 PM

10,000 ワードの長文丨 AI セキュリティ産業チェーン、ソリューション、起業の機会を解体する

Jun 06, 2023 pm 12:53 PM

重要なポイント: 1. 大規模な AI モデルのセキュリティ問題は決して単一の問題ではなく、人間の健康管理と同様に、複数の主題と産業チェーン全体が関与する複雑かつ体系的なシステム エンジニアリングです。 2. AI のセキュリティは、大規模な言語モデルのセキュリティ (AISafety)、モデルと使用モデルのセキュリティ (AI のセキュリティ)、大規模な言語モデルの開発が既存のネットワーク セキュリティに及ぼす影響に分けられます。安全保障、環境安全保障、社会保障、さまざまなレベル。 3. AIは「新種」であるため、大型モデルの学習過程では安全性の監視が必要であり、最終的に大型モデルが市場に投入される際には「品質検査」も必要となり、品質検査を経て市場に投入されるメソッド、これらはすべてセキュリティ問題を解決するためのマクロです。

2023 Intelligent Source ConferenceでのAIセキュリティの話題が注目を集め、新刊『Human-Machine Alignment』が発売されました。

Jun 14, 2023 pm 10:34 PM

2023 Intelligent Source ConferenceでのAIセキュリティの話題が注目を集め、新刊『Human-Machine Alignment』が発売されました。

Jun 14, 2023 pm 10:34 PM

AI分野の多くの探求者や実践者が集まり、研究成果を共有し、実践経験を交換し、科学技術の美しさについて語り合う2023年北京インテリジェントソースカンファレンスがこのほど成功裡に開催された。人工知能のこの考えは知恵で輝き、何百もの素晴らしいレポートやディスカッションを通じて知性の驚くべき進化を交換し、目撃します。 AIのセキュリティと調整フォーラムでは、多くの専門家や学者が意見交換し、大規模モデルの時代において、ますます強力かつ多用途になる人工知能システムが安全で制御可能であり、人間の意図や価値観と一致していることをどのように保証するかが課題となっています。極めて重要な問題。この安全性の問題は、人間と機械の調整 (AIalignment) 問題としても知られており、今世紀の人類社会が直面する最も緊急かつ有意義な科学的課題の 1 つを表しています。口論

「英国、米国、その他28か国は、致命的な傷害を防ぐためにAIの安全協力を強化することに合意した。」

Nov 02, 2023 pm 05:41 PM

「英国、米国、その他28か国は、致命的な傷害を防ぐためにAIの安全協力を強化することに合意した。」

Nov 02, 2023 pm 05:41 PM

英国、米国、中国を含む国々は、高度な人工知能がもたらすリスクに関するコンセンサスに合意し、技術の安全な開発と導入を確保することを約束した。英国政府が今週開催した2日間の「世界人工知能セキュリティサミット」では、ブラジル、インド、ナイジェリア、サウジアラビアと欧州連合を含む28カ国が「ブレッチリー宣言」と呼ばれるAI協定に署名した。英国政府は、この宣言は、特に広範な科学協力を通じて、先進的なAIの安全性と研究を進めるリスク、機会、国際協力に関する共同合意と責任を確立するというサミットの主な目的を達成すると述べた。参加国は、意図的な悪用の可能性が深刻なリスクをもたらす可能性があるとの見解を共有し、サイバーセキュリティ、バイオテクノロジー、偽情報、偏見、プライバシーのリスクについての懸念を強調した。

Huayunanと他の部門は共同で、AIセキュリティ分野における協力と研究を強化するために「AIセキュリティワーキンググループ」の設立を開始した。

Sep 18, 2023 am 11:53 AM

Huayunanと他の部門は共同で、AIセキュリティ分野における協力と研究を強化するために「AIセキュリティワーキンググループ」の設立を開始した。

Sep 18, 2023 am 11:53 AM

9月7日午後、2023Inclusion Bund Conference内で開催された「次世代セキュリティインテリジェンスの探索」フォーラムにおいて、世界権威の国際業界団体であるクラウドセキュリティアライアンス(CSA)グレーターチャイナは、「AI」の設立を発表した。華雲南と中国 電気通信研究所、アントグループ、ファーウェイ、西安電子科学技術大学、深セン国家金融技術評価センターを含む30以上の機関が最初のスポンサーとなった。 「AIセキュリティワーキンググループ」は、AI技術の急速な発展によって引き起こされるセキュリティ問題を共同で解決することに取り組んでいます。 Cloud Security Alliance Greater China AI Security Working Group は、China Telecom Research Institute と Ant Group が共同で主導し、人工知能産業チェーンの上流と下流に関わる企業、学校、研究機関、ユーザー部門を招集します。同盟内では。

バレないでAIは諦めて一刻も早く地球から離れましょう!ホーキング博士のアドバイスの意味は何ですか?

Oct 21, 2023 pm 05:17 PM

バレないでAIは諦めて一刻も早く地球から離れましょう!ホーキング博士のアドバイスの意味は何ですか?

Oct 21, 2023 pm 05:17 PM

積極的にエイリアンを探さないでください。できるだけ早く地球から離れるようにしてください。人工知能の開発を諦めろ、さもなくば世界に破滅をもたらす。以上は物理学者の故スティーブン・ホーキング博士が世界に残した3つのアドバイスです。おそらくあなたは、彼の発言が必然的に少し誇張されている、あるいは警戒心が強いとさえ思うでしょう。しかし、彼の心配が最終的に現実になったら、世界はどうなるか考えたことがありますか?地球外文明に興味がある人なら、SETI という名前を聞いたことがあるはずです。これは、世界中のネットワークに接続されたコンピューターを使用して地球外文明を探索する実験プロジェクトです。 1999年の設立以来、宇宙に存在する怪しい信号を絶えず探し続けています。そして、いつか思いがけず遠く離れた地球外文明に遭遇することを楽しみにしています。しかしホーキング博士はこれを信じています

世界初のAI安全研究所が英国に設立される

Oct 27, 2023 am 11:21 AM

世界初のAI安全研究所が英国に設立される

Oct 27, 2023 am 11:21 AM

CNBC、ロイター通信などの報道に基づき、10月27日のIT Houseニュースは現地時間木曜日、英国のスナク首相が世界初のAIセキュリティ研究機関を設立し、11月1~2日にAIセキュリティ会議を開催する計画を発表した。セキュリティサミット。サミットには世界中からAI企業、政府、市民社会、関連分野の専門家が集まり、国際的な協調行動を通じてAIがもたらすリスクを軽減する方法について話し合う。情報源のペクセルズ・スナク氏はスピーチの中で、間もなく設立されるこの研究所はAIセキュリティに対する世界の理解を促進し、新しいAIテクノロジーを注意深く研究、評価、テストして各新しいモデルの機能を理解し、さまざまなリスクを調査すると述べた。 「偏見や誤った情報」から「最も極端なリスク」などの社会的被害まで。スナク氏は「AI