AI のゴッドファーザー、ベンジオ: 私は道に迷っており、AI について心配することが「精神的な内部摩擦」になっています。

最近、チューリングビッグ 3 の 1 人、ヨシュア ベンジオが BBC のインタビューに応じました。

ベンジオはインタビュー中、強い「憂鬱」を感じていることを明かし、生涯追求してきたキャリアに多少の喪失感を感じていると語った。

具体的には、AI の開発スピードをもっと早く実感できれば、AI の実用性よりも安全性を優先する傾向があるのではないかと感じています。

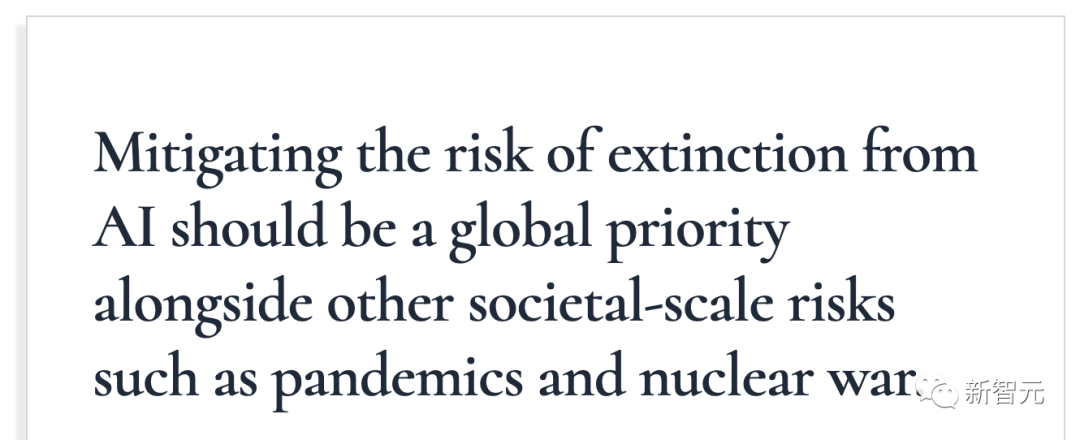

ご存知のとおり、ベンジオは数日前に公開された「AI が人類を滅ぼす可能性がある」に関する公開書簡に署名したところです。

ベンジオを失った

公開書簡への署名は、ベンジオの態度を明確に示しています。

この 22 単語の公開書簡は、AI が人類を滅ぼす可能性があるリスクを、核戦争や感染症などの社会危機と比較しています。

BBCのインタビューで、ベンジオ氏は自身の見解を詳しく語った。

彼は、AI をより厳格に規制するよう私たちに求め、たとえば、軍隊に AI を使用する権限を決して与えるべきではありません。

もちろん、政治機関は AI の発展に目をつぶっているわけではありません。

欧州連合は、AI に関して法制化した最初の組織になる可能性があります。また最近、欧州連合はAI関連の行動規範が今後数週間以内に作成される可能性があると述べた。

この種の心配は無理からぬものではありません。結局のところ、AIの高性能は、新たな化学兵器の開発など、人類に有害な目的に利用される可能性がある。

Bengio 氏は、特に AI が急速に発展している現在、「悪意のある」意図を持った人々が AI を使いこなすことを非常に心配していると述べました。

「それは軍隊かもしれないし、テロリストかもしれない。あるいは精神的に不安定な人々かもしれない。つまり、これらの人々がAIを使いこなしたら、AIに極めて危険な任務を実行させてしまうのだ」

さらに、AI が発展し続けた場合、その過程で AI を中断することはできないかもしれないと彼は言いました。

次に、ベンジオは再び自分自身について話しました。

これらの心配は間違いなく彼の内部の摩擦を増大させ、彼の私生活と仕事に影響を与えました。

ベンジオは、かつては AI マスターとして大きな栄誉を獲得していました (もちろん今もそうです)。当時、彼は自分のキャリアのために生涯をかけて戦う覚悟がありました。好きで、得意でした。

AI のキャリアは、かつて彼にアイデンティティ、認識、人生の方向性の感覚をもたらしました。しかし今では、こうした心配のせいで、これらのことは彼にとってもはや明確ではありません。

「AI 業界に携わる人々にとって、これは精神的に困難なことです。」

しかし、憂鬱な面もあり、ポジティブな面もまだあります。その裏にある態度。

「途方に暮れていると言えるかもしれません。しかし、忍耐強く、話し合いに参加し、他の人たちに一緒に考えるよう奨励しなければなりません。」

マスク氏も同様の懸念を表明した。

彼は、AI が人間を確実に絶滅させるとは信じていませんが、AI が人間を制限し、制御する可能性があると信じています。

Bengio は、AI 製品に関連するすべてのテクノロジー大手企業は管理され、登録される必要があると考えています。

「政府は自分たちが何をしているのかを追跡する必要があり、監査できるようにする必要があります。そしてそれは、飛行機や自動車の製造、製薬などの他の業界に対して私たちが行っている最も基本的なことです。」

「コンピュータ サイエンスでは通常受けられない、ある種の倫理トレーニングも導入する必要があります。」

ハギングフェイスの科学者、サーシャ ルッチョーニ博士社会はAIの偏見や誤った情報の拡散などの問題を懸念すべきであり、それが具体的な問題であると彼女は述べた。

彼女の哲学は、特定の問題がもっと注目されるべきだということです。人類の絶滅というのはちょっと想像上の話で、それについて話すことさえできません。

実際、AI が社会にもたらす多くの利点を示す例は数多くあります。

つい先週、AIを使って開発されたマイクロチップのおかげで、麻痺した人が思考だけで再び歩くことができるようになりました。

科学技術の影響に加えて、AI が国民経済に与える重大な影響も無視できません。

多くの企業が人間の労働を代替するために AI ツールを使用し始めています。これは、ハリウッドの脚本家がストライキを開始した重要な理由でもあります。

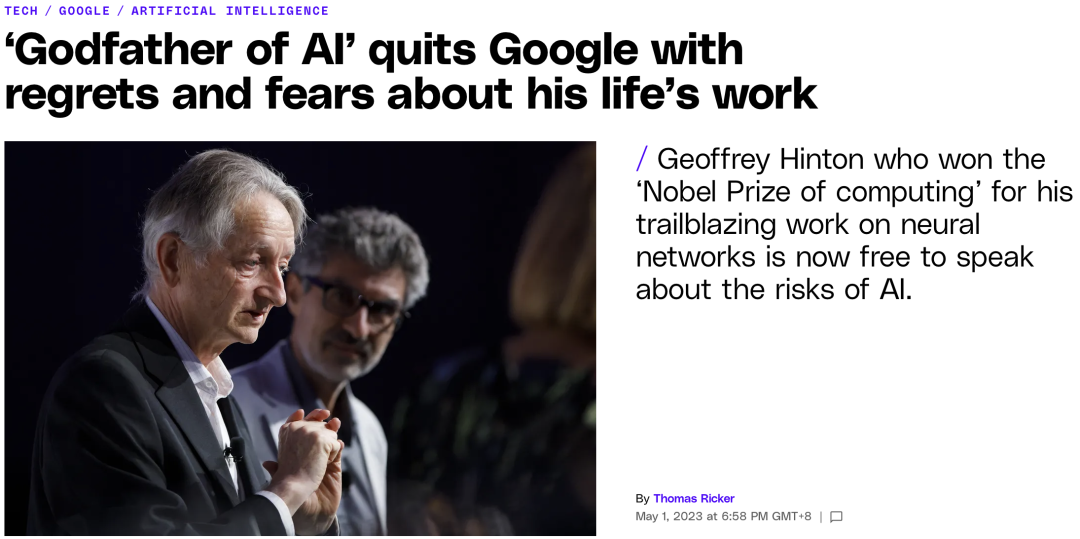

ヒントン氏は断固辞任

偶然にも少し前、チューリングビッグスリーの一人でもあるヒントン氏も、同じ理由で熱心に捜索活動を行っていた。

当時、大手メディアはこんな見出しで賑わっていました。ディープラーニングの巨匠でありニューラルネットワークの父であるジェフリー・ヒントンが、突然Googleからの辞任を発表しました。

Google への影響を考慮せずに、AI のリスクについて自由に話せるようになります。

ニューヨーク・タイムズの報道で、ヒントンは世界に直接警告しました。「気をつけてください、前方には危険があります、前方には危険があります、前方には危険があります!」

これが、彼が人工知能のリスクについて深く懸念している理由です。ヒントン氏は率直に「自分の生涯の仕事を深く後悔しています。」と述べた。終末予言者であるヒントン氏は、テクノロジー業界がここ数十年で最も重要な転換点にあることも指摘している。

これは、業界の多くの人々にも不安を感じさせており、自分たちが行っている研究が何らかの危険を外の世界に放出しているのではないかと懸念しています。

なぜなら、生成AIは誤った情報を生成するツールになっている可能性があるからです。そして将来のある時点で、人類に脅威をもたらす可能性があります。

ヒントン氏の見解では、悪意のある人々がこれを悪用するのを防ぐ方法はまだ見つかっていません。

ヒントン氏の辞任後、騒々しい反対の波のさなか、人工知能のゴッドファーザーであるヒントン氏は、AIの開発を制限する2通の公開書簡に署名しなかった。

同氏は、辞任する前にGoogleや他の企業を公に批判したくないと述べた。

ヒントン氏がついに決意を固め、辞任することをGoogleに通知するまでに先月かかった。

Google を離れることを選択した後、ヒントンはついに AI のリスクについて自由に話すことができるようになりました。

#自分の人生をかけた仕事を深く後悔しています。

私はこのように自分を慰めることしかできません。たとえ私がいなくても、他の人はいるでしょう。

以上がAI のゴッドファーザー、ベンジオ: 私は道に迷っており、AI について心配することが「精神的な内部摩擦」になっています。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1668

1668

14

14

1428

1428

52

52

1329

1329

25

25

1273

1273

29

29

1256

1256

24

24

CでChronoライブラリを使用する方法は?

Apr 28, 2025 pm 10:18 PM

CでChronoライブラリを使用する方法は?

Apr 28, 2025 pm 10:18 PM

CでChronoライブラリを使用すると、時間と時間の間隔をより正確に制御できます。このライブラリの魅力を探りましょう。 CのChronoライブラリは、時間と時間の間隔に対処するための最新の方法を提供する標準ライブラリの一部です。 Time.HとCtimeに苦しんでいるプログラマーにとって、Chronoは間違いなく恩恵です。コードの読みやすさと保守性を向上させるだけでなく、より高い精度と柔軟性も提供します。基本から始めましょう。 Chronoライブラリには、主に次の重要なコンポーネントが含まれています。STD:: Chrono :: System_Clock:現在の時間を取得するために使用されるシステムクロックを表します。 STD :: Chron

CでDMA操作を理解する方法は?

Apr 28, 2025 pm 10:09 PM

CでDMA操作を理解する方法は?

Apr 28, 2025 pm 10:09 PM

CのDMAとは、直接メモリアクセステクノロジーであるDirectMemoryAccessを指し、ハードウェアデバイスがCPU介入なしでメモリに直接データを送信できるようにします。 1)DMA操作は、ハードウェアデバイスとドライバーに大きく依存しており、実装方法はシステムごとに異なります。 2)メモリへの直接アクセスは、セキュリティリスクをもたらす可能性があり、コードの正確性とセキュリティを確保する必要があります。 3)DMAはパフォーマンスを改善できますが、不適切な使用はシステムのパフォーマンスの低下につながる可能性があります。実践と学習を通じて、DMAを使用するスキルを習得し、高速データ送信やリアルタイム信号処理などのシナリオでその効果を最大化できます。

Cのリアルタイムオペレーティングシステムプログラミングとは何ですか?

Apr 28, 2025 pm 10:15 PM

Cのリアルタイムオペレーティングシステムプログラミングとは何ですか?

Apr 28, 2025 pm 10:15 PM

Cは、リアルタイムオペレーティングシステム(RTOS)プログラミングでうまく機能し、効率的な実行効率と正確な時間管理を提供します。 1)Cハードウェアリソースの直接的な動作と効率的なメモリ管理を通じて、RTOのニーズを満たします。 2)オブジェクト指向の機能を使用して、Cは柔軟なタスクスケジューリングシステムを設計できます。 3)Cは効率的な割り込み処理をサポートしますが、リアルタイムを確保するには、動的メモリの割り当てと例外処理を避ける必要があります。 4)テンプレートプログラミングとインライン関数は、パフォーマンスの最適化に役立ちます。 5)実際のアプリケーションでは、Cを使用して効率的なロギングシステムを実装できます。

フィールドをMySQLテーブルに追加および削除する手順

Apr 29, 2025 pm 04:15 PM

フィールドをMySQLテーブルに追加および削除する手順

Apr 29, 2025 pm 04:15 PM

MySQLでは、AlterTabletable_nameaddcolumnnew_columnvarchar(255)afterexisting_columnを使用してフィールドを追加し、andtabletable_namedopcolumncolumn_to_dropを使用してフィールドを削除します。フィールドを追加するときは、クエリのパフォーマンスとデータ構造を最適化する場所を指定する必要があります。フィールドを削除する前に、操作が不可逆的であることを確認する必要があります。オンラインDDL、バックアップデータ、テスト環境、および低負荷期間を使用したテーブル構造の変更は、パフォーマンスの最適化とベストプラクティスです。

Cのスレッドパフォーマンスを測定する方法は?

Apr 28, 2025 pm 10:21 PM

Cのスレッドパフォーマンスを測定する方法は?

Apr 28, 2025 pm 10:21 PM

Cのスレッドパフォーマンスの測定は、標準ライブラリのタイミングツール、パフォーマンス分析ツール、およびカスタムタイマーを使用できます。 1.ライブラリを使用して、実行時間を測定します。 2。パフォーマンス分析にはGPROFを使用します。手順には、コンピレーション中に-pgオプションを追加し、プログラムを実行してGmon.outファイルを生成し、パフォーマンスレポートの生成が含まれます。 3. ValgrindのCallGrindモジュールを使用して、より詳細な分析を実行します。手順には、プログラムを実行してCallGrind.outファイルを生成し、Kcachegrindを使用して結果を表示することが含まれます。 4.カスタムタイマーは、特定のコードセグメントの実行時間を柔軟に測定できます。これらの方法は、スレッドのパフォーマンスを完全に理解し、コードを最適化するのに役立ちます。

トップ10のデジタル通貨取引プラットフォーム:トップ10の安全で信頼できるデジタル通貨交換

Apr 30, 2025 pm 04:30 PM

トップ10のデジタル通貨取引プラットフォーム:トップ10の安全で信頼できるデジタル通貨交換

Apr 30, 2025 pm 04:30 PM

上位10のデジタル仮想通貨取引プラットフォームは次のとおりです。1。Binance、2。Okx、3。Coinbase、4。Kraken、5。HuobiGlobal、6。Bitfinex、7。Kucoin、8。Gemini、9。Bitstamp、10。Bittrex。これらのプラットフォームはすべて、さまざまなユーザーニーズに適した高度なセキュリティとさまざまな取引オプションを提供します。

定量的交換ランキング2025デジタル通貨のトップ10の推奨事項定量取引アプリ

Apr 30, 2025 pm 07:24 PM

定量的交換ランキング2025デジタル通貨のトップ10の推奨事項定量取引アプリ

Apr 30, 2025 pm 07:24 PM

交換に組み込まれた量子化ツールには、1。Binance:Binance先物の定量的モジュール、低い取り扱い手数料を提供し、AIアシストトランザクションをサポートします。 2。OKX(OUYI):マルチアカウント管理とインテリジェントな注文ルーティングをサポートし、制度レベルのリスク制御を提供します。独立した定量的戦略プラットフォームには、3。3Commas:ドラッグアンドドロップ戦略ジェネレーター、マルチプラットフォームヘッジアービトラージに適しています。 4。Quadency:カスタマイズされたリスクしきい値をサポートするプロフェッショナルレベルのアルゴリズム戦略ライブラリ。 5。Pionex:組み込み16のプリセット戦略、低い取引手数料。垂直ドメインツールには、6。cryptohopper:クラウドベースの定量的プラットフォーム、150の技術指標をサポートします。 7。BITSGAP:

DeepSeekの公式Webサイトは、マウススクロールイベントの浸透の影響をどのように達成していますか?

Apr 30, 2025 pm 03:21 PM

DeepSeekの公式Webサイトは、マウススクロールイベントの浸透の影響をどのように達成していますか?

Apr 30, 2025 pm 03:21 PM

マウススクロールイベントの浸透の効果を実現する方法は? Webを閲覧すると、いくつかの特別なインタラクションデザインに遭遇することがよくあります。たとえば、DeepSeekの公式ウェブサイトでは、...