NVIDIA GPU を入手できない大型 AI モデルには、AMD チップが登場します。

AMDの「最終兵器」が登場!

東部時間6月13日、AMDは「AMDデータセンターおよび人工知能テクノロジープレミア」で、ChatGPTやその他の生成AIの使用を加速できる、これまでで最も先進的な人工知能GPU MI300Xチップを発売すると発表しました。処理速度が向上し、最大 192GB のメモリを使用できます。

対照的に、NVIDIA の H100 チップは 120 GB のメモリしかサポートしていません。これは、この新興市場における NVIDIA の優位性が挑戦される可能性があることを意味すると市場は一般に考えています。 MI300X は、今年後半に一部の顧客向けに出荷を開始する予定です。

投資家はAMDがAIチップの分野でNVIDIAと競合すると予想しているが、アナリストはそのトレンドに乗らず、AMDのこの強力な武器を吹き飛ばしていないが、AMDがNVIDIAチップの分野で挑戦したいと合理的に指摘している。が業界リーダーになるまでにはまだ長い道のりがあり、このチップだけでそれを達成することはできません。

Citi のチップアナリストである Chris Danely 氏は、最新のレポートで、AMD の MI300 チップは設計上の大きな勝利を収めたようだが、性能の限界と失敗の歴史を考慮すると、グラフィックス/CPU IC の持続可能性については疑問を表明していると述べました。私たちはAMDが引き続きIntelから市場シェアを獲得すると予想していますが、その新しいGenoa製品は予想よりも遅いペースで成長しているようです。」

同日、Cambrian-AI Research LLCの創設者兼主任アナリストであるカール・フロイント氏もフォーブスに次のように書いていますAMDが新たに発売したチップは市場関係者全員から大きな関心を集めているが、NvidiaのH100チップと比較すると、MI300Xは直面している主に次の 4 つの側面におけるいくつかの課題:

NVIDIA は本日、H100 の完全な出荷を開始します。同社は AI 業界でこれまでで最大のソフトウェアと研究者のエコシステムを持っています。

第二に、MI300Xチップは192GBのメモリを提供しますが、Nvidiaはこの時点ですぐに追いつき、同じ時間枠で追い越す可能性さえあるため、これは大きな利点ではありません。 MI300X は非常に高価であり、Nvidia の H100 と比較して大幅なコスト上の利点はありません。

3 番目が本当の鍵です。MI300 には、大規模言語モデル (LLM) のパフォーマンスを 2 倍にできる H100 のような Transformer Engine (NVIDIA GPU で Transformer モデルを高速化するためのライブラリ) がありません。数千の (NVIDIA) GPU を使用して新しいモデルをトレーニングするのに 1 年かかる場合、AMD ハードウェアを使用してトレーニングするにはさらに 2 ~ 3 年かかるか、問題を解決するために 3 倍の GPU を投資する必要がある可能性があります。

最後に、AMD はまだベンチマークを公開していません。ただし、LLM のトレーニングおよび実行時のパフォーマンスはシステム設計と GPU に依存するため、今年後半に業界の競合他社との比較が行われることを楽しみにしています。

ただし、フロイント氏は、MI300XがNvidiaのGH200 Grace Hopperスーパーチップの代替品になる可能性があるとも付け加えました。 OpenAIやMicrosoftのような企業はそのような代替手段を必要としており、AMDがこれらの企業に拒否できないオファーを与えるかどうかは疑問だが、AMDがNvidiaから多くの市場シェアを奪うことはないだろう。

AMDの株価は今年初めから94%上昇し、昨日の米国株式市場は3.61%下落して取引を終え、同業のNVIDIAは3.90%上昇して取引を終え、市場価値は初めて1兆ドルを超えた。時間。

実際、Nvidia はチップだけでなく、10 年以上にわたって AI 研究者に提供してきたソフトウェア ツールによっても優位に立っています。 Moor Insights & Strategy アナリストの Anshel Sag 氏は、「たとえ AMD がハードウェア パフォーマンスの点で競争力があるとしても、人々はそのソフトウェア ソリューションが Nvidia と競合できるとはまだ確信していません。」と述べています。

テクノロジー企業間の健全な競争を促進することが期待されますアメリカのテクノロジー評論家ビリー・デュバースタイン氏は12日、ChatGPTの人気でAIが新たな分野を切り開いたようで、多くの業界の大手企業の間で市場シェアを獲得するための競争が始まっていると指摘した。

NVIDIA と AMD のどちらがこの競争に勝っても、すべてのテクノロジー企業が恩恵を受けることになります。

Duberstein 氏は、潜在的な顧客は MI300 に非常に興味を持っていると述べました。同氏が引用した Digital Times の 6 月 8 日の記事によると、データセンターの顧客は Nvidia 製品の代替品を必死に探しています。 Nvidia は現在、高収益かつ高成長の人工知能 GPU 市場で圧倒的な地位を占めており、AI サーバー分野の市場シェアの 60 ~ 70% を占めています。Duberstein 氏は続けて、Nvidia H100 サーバーの現在の高価格を考慮すると、データセンター運営者は Nvidia が AI チップの価格を下げるのに役立つサードパーティの競合他社を持つことを望んでいると指摘しました。つまり、

これは AMD にとっては大きな利点であり、Nvidia にとっては課題です。これにより、すべての市場参加者にとって良好な収益が得られます。

先月、モルガン・スタンレーのアナリストであるジョセフ・ムーア氏は、AMDの人工知能売上高が当初の予想より「数倍」高くなる可能性があると述べ、自身の予測を修正した。GPU AI 産業チェーンを争う中国企業は今後もその恩恵を受けることが期待されます

現在、世界中の大手テクノロジー企業がAIの入場券を巡って争奪戦を繰り広げています。海外の大手企業と比較して、中国の大手テクノロジー企業はGPUの購入をより緊急に求めている。

「LatePost」によると、今年の春節以降、クラウドコンピューティング事業を展開する中国の大手インターネット企業がNVIDIAに大量発注を行ったという。 Byteは今年、Nvidiaに10億ドル以上のGPUを発注しており、別の大手企業からの発注も少なくとも10億元を超えている。 そして、Byte の今年だけの注文は、昨年 NVIDIA が中国で販売した商用 GPU の総数に近い可能性があります。

Sinolink SecuritiesはAMDの新たな動きについて引き続き楽観的であり、AI産業チェーンについても引き続き楽観的です。同庁は、生成AIの継続的な人気がAIチップに対する強い需要を引き起こしており、NVIDIAの第2四半期のデータセンター事業見通しは予想を上回っており、TSMCの4nm、5nm、7nmの容量使用率が大幅に増加していることが何よりの証拠であると考えている。

シノリンク証券は、業界チェーン調査によると、大手光モジュールDSPチップメーカーはAI関連ビジネスが将来急速に成長すると述べ、CPU/GPUヒートシンク大手企業はAI GPUが大幅に成長すると述べたと指摘した。第2四半期と第3四半期。主要企業は、次の四半期にはサーバー用 PCIe Retimer チップの需要が加速し、徐々に増加すると述べています。 2024年から2025年にかけて、AI業界の新製品がAI産業チェーンの発展を促進し、持続的な経済利益をもたらすと予想されています。

以上がNVIDIA GPU を入手できない大型 AI モデルには、AMD チップが登場します。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7471

7471

15

15

1377

1377

52

52

77

77

11

11

19

19

30

30

OneXGPU 2 の AMD Radeon RX 7800M は Nvidia RTX 4070 ラップトップ GPU を上回ります

Sep 09, 2024 am 06:35 AM

OneXGPU 2 の AMD Radeon RX 7800M は Nvidia RTX 4070 ラップトップ GPU を上回ります

Sep 09, 2024 am 06:35 AM

OneXGPU 2 は、AMD ですらまだ発表していない GPU である Radeon RX 7800M を搭載した最初の eGPU です。外部グラフィックス カード ソリューションのメーカーである One-Netbook によって明らかにされたように、新しい AMD GPU は RDNA 3 アーキテクチャに基づいており、Navi

ハンドヘルドコンソール用AMD Z2 Extremeチップが2025年初頭の発売に向けて発表

Sep 07, 2024 am 06:38 AM

ハンドヘルドコンソール用AMD Z2 Extremeチップが2025年初頭の発売に向けて発表

Sep 07, 2024 am 06:38 AM

AMDはRyzen Z1 Extreme(およびその非Extremeバージョン)をハンドヘルドゲーム機向けにカスタマイズしたにもかかわらず、このチップが主流のハンドヘルド機に搭載されたのはAsus ROG Ally(Amazonで現在569ドル)とLenovo Legion Go(3つ)の2つだけでした。 Rを数えると

取引 | 120Hz OLED、64GB RAM、AMD Ryzen 7 Pro を搭載した Lenovo ThinkPad P14s Gen 5 が現在 60% オフです

Sep 07, 2024 am 06:31 AM

取引 | 120Hz OLED、64GB RAM、AMD Ryzen 7 Pro を搭載した Lenovo ThinkPad P14s Gen 5 が現在 60% オフです

Sep 07, 2024 am 06:31 AM

最近、多くの学生が学校に戻り、古いラップトップがもう役に立たないことに気づいている人もいるかもしれません。大学生の中には、ゴージャスな OLED スクリーンを備えたハイエンドのビジネス ノートブックを市場に出す人もいるかもしれません。

Beelink SER9: Radeon 890M iGPU を搭載したコンパクト AMD Zen 5 ミニ PC が発表されましたが、eGPU オプションは限られていました

Sep 12, 2024 pm 12:16 PM

Beelink SER9: Radeon 890M iGPU を搭載したコンパクト AMD Zen 5 ミニ PC が発表されましたが、eGPU オプションは限られていました

Sep 12, 2024 pm 12:16 PM

Beelink は、新しいミニ PC と付属のアクセサリを猛烈な勢いで発表し続けています。要約すると、EQi12、EQR6、EX eGPU ドックをリリースしてから 1 か月強が経過しました。現在、同社は AMD の新しい Strix に注目しています。

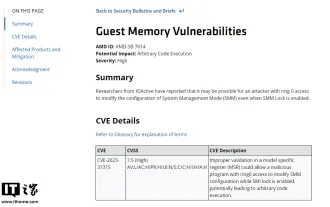

AMD、数百万台のRyzenおよびEPYCプロセッサに影響する「Sinkclose」の重大度の高い脆弱性を発表

Aug 10, 2024 pm 10:31 PM

AMD、数百万台のRyzenおよびEPYCプロセッサに影響する「Sinkclose」の重大度の高い脆弱性を発表

Aug 10, 2024 pm 10:31 PM

8月10日の当サイトのニュースによると、AMDは一部のEPYCおよびRyzenプロセッサにコード「CVE-2023-31315」の「Sinkclose」と呼ばれる新たな脆弱性が存在し、世界中の数百万のAMDユーザーが関与する可能性があることを正式に確認したとのこと。では、シンククローズとは何でしょうか? 『WIRED』の報道によると、この脆弱性により侵入者は「システム管理モード(SMM)」で悪意のあるコードを実行することが可能になるという。伝えられるところによると、侵入者はブートキットと呼ばれるマルウェアの一種を使用して相手のシステムを制御する可能性があり、このマルウェアはウイルス対策ソフトウェアでは検出できません。このサイトからの注: システム管理モード (SMM) は、高度な電源管理とオペレーティング システムに依存しない機能を実現するために設計された特別な CPU 動作モードです。

Ryzen AI 9 HX 370 を搭載した初の Minisforum ミニ PC、高額で発売されると噂

Sep 29, 2024 am 06:05 AM

Ryzen AI 9 HX 370 を搭載した初の Minisforum ミニ PC、高額で発売されると噂

Sep 29, 2024 am 06:05 AM

Aoostar は Strix Point mini PC を最初に発表した企業の 1 つであり、その後、Beelink が 999 ドルという高騰する開始価格で SER9 を発売しました。 Minisforum は、EliteMini AI370 をからかうことでパーティーに参加しました。その名前が示すように、これは会社の

IFA 2024 |新しい Lenovo Yoga Pro 7 が AMD Strix Point プロセッサーを搭載して登場

Sep 06, 2024 am 06:42 AM

IFA 2024 |新しい Lenovo Yoga Pro 7 が AMD Strix Point プロセッサーを搭載して登場

Sep 06, 2024 am 06:42 AM

ASUS は AMD Strix Point ラップトップの第一弾を発表しましたが、今回 Lenovo も参加しました。新しく発売されたラップトップの中には、Ryzen AI 9 365 を搭載した Yoga Pro 7 があります。今年初めに発売された Hawk Point オプションと比較すると、

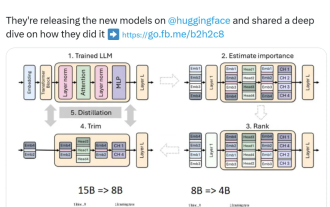

Nvidia はプルーニングと蒸留を試しています。Llama 3.1 8B のパラメータを半分にして、同じサイズでより良いパフォーマンスを実現しています。

Aug 16, 2024 pm 04:42 PM

Nvidia はプルーニングと蒸留を試しています。Llama 3.1 8B のパラメータを半分にして、同じサイズでより良いパフォーマンスを実現しています。

Aug 16, 2024 pm 04:42 PM

小型モデルの台頭。先月、Meta は Llama3.1 シリーズのモデルをリリースしました。これには、Meta のこれまでで最大のモデルである 405B モデルと、それぞれ 700 億と 80 億のパラメータを持つ 2 つの小型モデルが含まれています。 Llama3.1 は、オープンソースの新時代の到来を告げるものと考えられています。ただし、新世代モデルはパフォーマンスが強力ですが、導入時には依然として大量のコンピューティング リソースが必要です。したがって、多くの言語タスクで十分なパフォーマンスを発揮し、導入コストも非常に安価な小規模言語モデル (SLM) を開発するという別の傾向が業界に現れています。最近、NVIDIA の研究では、構造化された重み枝刈りと知識の蒸留を組み合わせることで、最初は大きなモデルから徐々に小さな言語モデルを取得できることが示されました。チューリング賞受賞、メタチーフA