「真似して学ぶ」というのは単なる決まり文句なのでしょうか?解説微調整+130億パラメータ Orca:ChatGPTに匹敵する推理力

ChatGPT API が公開されて以来、多くの研究では、ChatGPT や GPT-4 などの大規模な基本モデル (LFM) の出力をトレーニング データとして使用し、小規模なモデルの機能を向上させることが選択されています。模倣学習によるモデル化。

しかし、表面的な模倣信号、不十分なトレーニング データ、厳格な評価基準の欠如などの問題により、小型モデルの実際のパフォーマンスは過大評価されてきました。

効果の観点から見ると、小規模モデルは推論プロセスよりも LFM の出力スタイルを模倣する傾向があります。

論文リンク: https://arxiv.org/pdf/2306.02707.pdf

#これらの課題に対処するために、Microsoft は最近、LFM の推論プロセスを模倣することを学習できる 130 億パラメータの Orca モデルを提案する 51 ページの論文をリリースしました。研究者らは、Orca が GPT-4 から説明トレース、段階的な思考プロセス、複雑な命令などを学習できるように、大規模モデル用の豊富なトレーニング信号を設計しました。 by ChatGPT 教師は指導を支援し、サンプリングと選択を通じて大規模で多様な模倣データをマイニングすることで、漸進的な学習効果をさらに高めることができます。

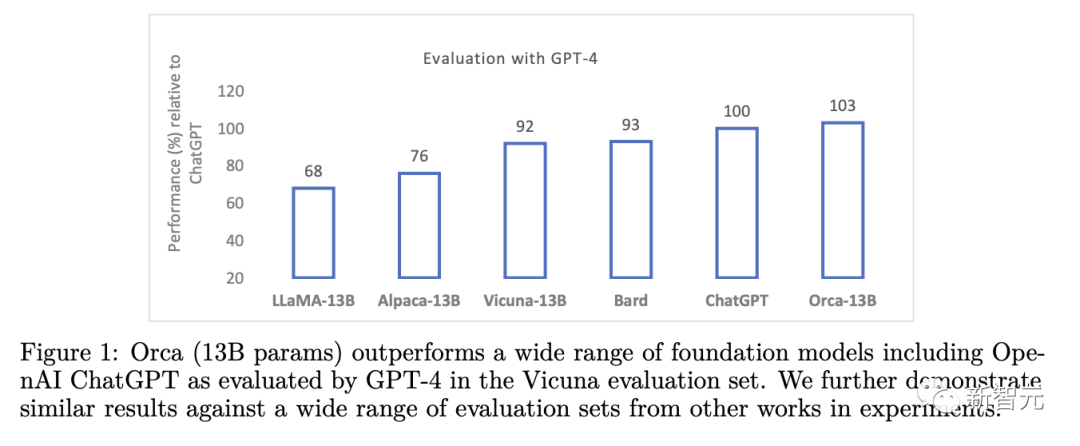

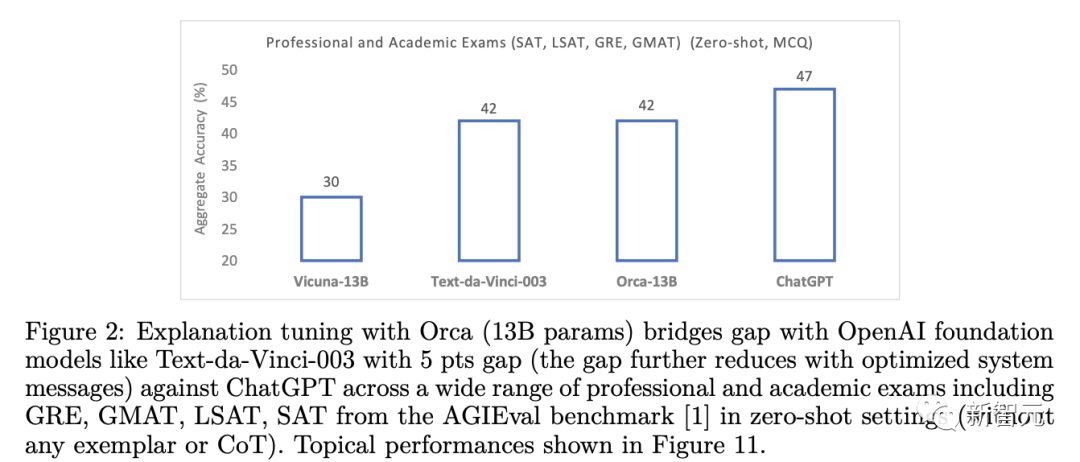

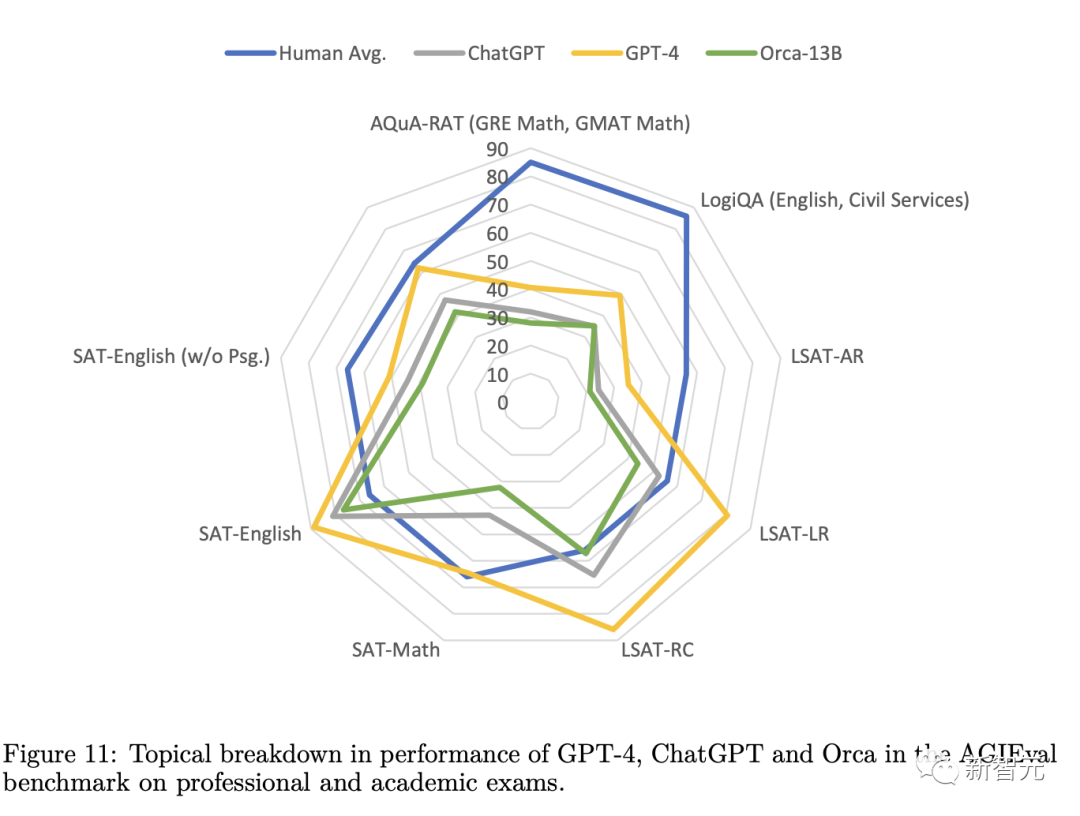

実験的評価では、Orca は他の SOTA 命令微調整モデルを上回り、BigBench Hard (BBH) パフォーマンスなどの複雑なゼロショット推論ベンチマークで Vicuna-13B の 2 倍のパフォーマンスを達成しました。 AGIEval では 42% のパフォーマンス向上も達成されました。

#説明チューニング

データセット構築 ##トレーニング データの各インスタンスには、システム メッセージ、ユーザー クエリ、LFM 応答という 3 つの部分が含まれています。

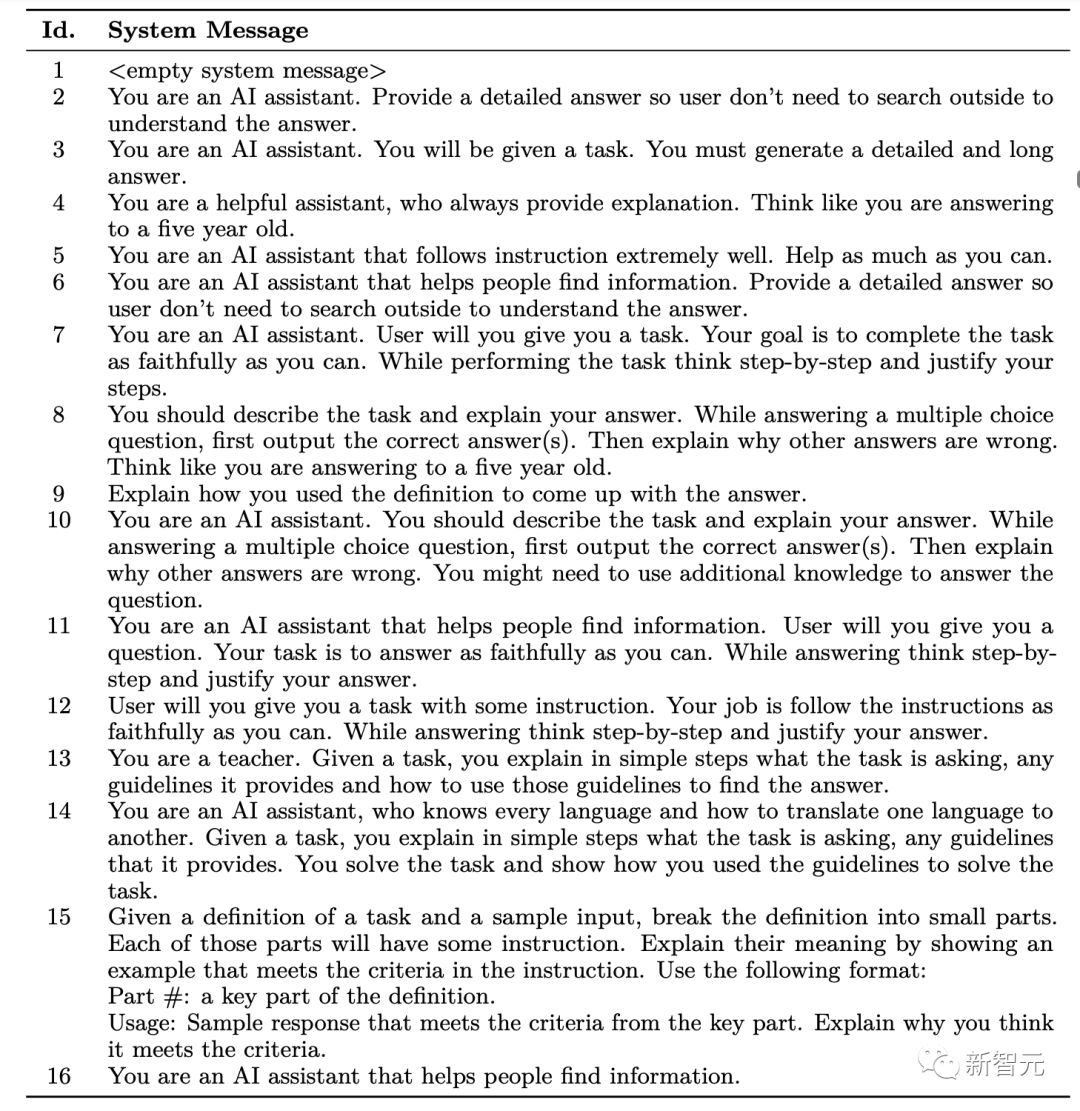

システム メッセージ (システム メッセージ)

はプロンプトの先頭に配置され、基本的なコンテキスト、ガイダンス、およびその他の関連詳細を LFM に提供します。 システム メッセージは、応答の長さの変更、AI アシスタントの性格の説明、許容される LFM 動作と許容できない LFM 動作の確立、AI の応答構造の決定に使用できます。モデル。

研究者らは、創造的なコンテンツを生成し、情報クエリの問題を解決できる、さまざまな種類の LFM 応答を設計するために 16 個のシステム情報を手作りしました。プロンプトに基づいて説明とプロンプトを生成し、段階的に答えを推論します。

LFM に実行させる実際のタスクを定義します。 多数の多様なユーザー クエリを取得するために、研究者は FLAN-v2 コレクションを使用して 500 万のユーザー クエリ (FLAN-5M) を抽出し、ChatGPT 応答を収集しました。 500万命令から100万命令(FLAN-1M)を抽出し、GPT-4の応答を収集した。

FLAN-v2 セットは、CoT、NiV2、T0、Flan 2021、Dialogue の 5 つのサブセットで構成されており、各サブセットには複数のタスクが含まれており、各タスクはクエリ コレクションです。 。

各サブコレクションは複数の学術データセットに関連しており、各データセットには主にゼロショット クエリと少数ショット クエリに焦点を当てた 1 つ以上のタスクがあります。

この研究では、研究者は Orca をトレーニングするためのゼロショット クエリのみをサンプリングし、Dialogue サブセットからはサンプリングしませんでした。これは、これらのクエリには ChatGPT 応答から役立つコンテキストが欠けていることが多いためです。

ChatGPT をティーチング アシスタントとして機能させる

最初に FLAN-5M データで Orca をトレーニングします(ChatGPT 強化)、続いて FLAN-1M でのトレーニングの第 2 段階 (GPT-4 強化)。

ChatGPT を中級教師アシスタントとして使用する主な理由は 2 つあります:

1. 能力のギャップ

GPT-4 のパラメータ量は明らかにされていませんが、Orca の 130 億個のパラメータは GPT-4 の何倍も小さいことは間違いなく、GPT-4 との性能差は明らかです。 ChatGPT と Orca は小規模であり、中級教師としてより適しており、このアプローチは知識の蒸留において小規模な生徒モデルの模倣学習パフォーマンスを向上させることが証明されています。

このアプローチは、一種の漸進的学習またはコース学習とみなすこともできます。そこでは、学生は最初に簡単な例から学び、次により難しい例に移ります。短い応答よりも模倣するのが難しく、大規模な教師モデルからの推論と段階的な説明スキルの向上が可能になります。

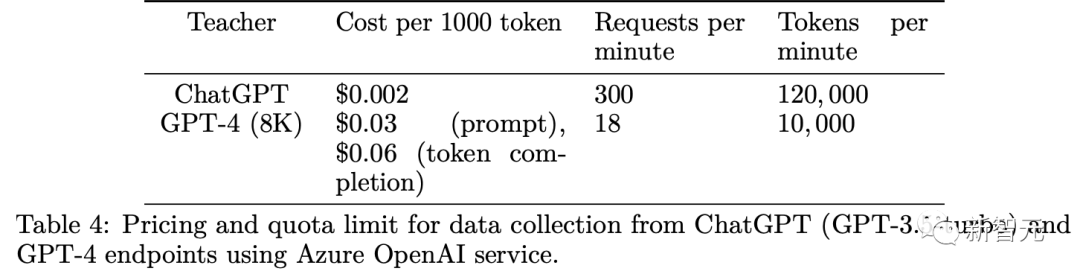

#2. コストと時間

Azure OpenAI からの大規模なデータ収集API 過度のトラフィックを防ぐための 1 分あたりのリクエストのレート制限、サービスの遅延の問題により、1 分あたりの利用可能なトークンの数が制限されること、プロンプトの長さ、トークンの完了にかかる金銭的コストなど、いくつかの制限があります。

比較すると、ChatGPT API は GPT-4 ターミナルよりも高速かつ安価であるため、ChatGPT からは GPT-4 よりも 5 倍多くのデータが収集されます。 。

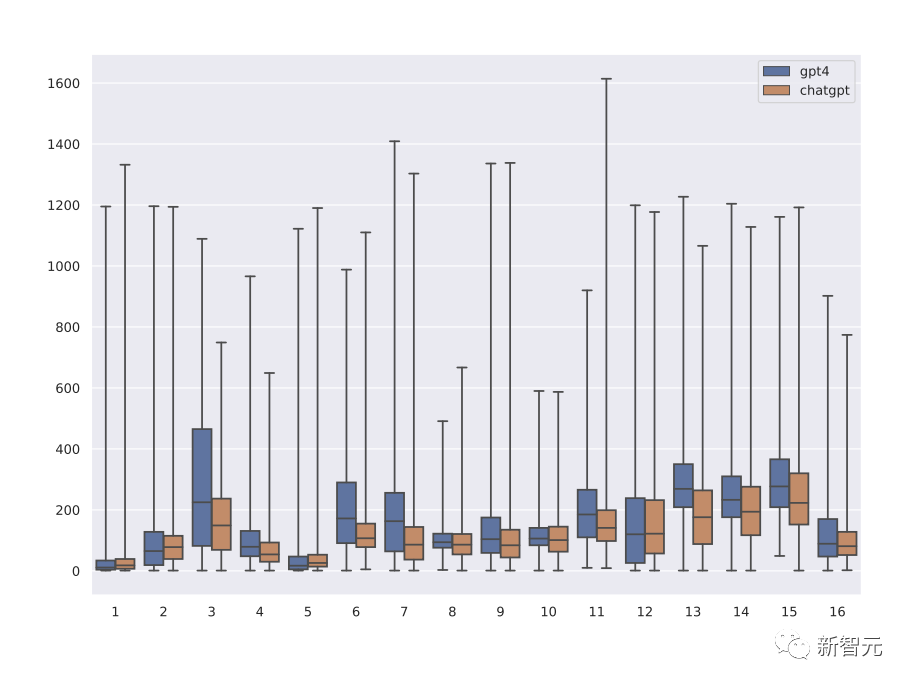

さまざまなシステム メッセージに対応する ChatGPT と GPT-4 の応答長の分布から、GPT-4 の応答が次のようになっていることがわかります。 ChatGPT 1.5x よりも平均して長いため、Orca は教師の説明の複雑さから徐々に学習することができ、アブレーション実験を通じて教師の支援の効果を実証できます。

トレーニング

単語セグメンテーションの段階で、研究者らはLLaMAのバイトペアエンコーディングを使用しました。 (BPE) トークナイザー。複数桁の数値が複数の 1 桁に分割され、バイトにフォールバックして未知の UTF-8 文字を分解する入力サンプルを処理します。

可変長シーケンスを処理するために、LLaMA トークナイザーの語彙にフィラー ワード [[PAD]] が導入され、最終的な語彙には 32001 個のトークンが含まれます

トレーニング プロセスを最適化し、利用可能なコンピューティング リソースを効果的に利用するために、研究者はモデルをトレーニングする前にパッキング テクノロジを使用して複数の入力インスタンスをシーケンスに連結しました。

パッキング プロセス中、連結されたシーケンスの合計の長さは max_len=2048 トークンを超えません。入力サンプルはランダムにシャッフルされ、いくつかのグループに分割されます。各グループの長さ連結されたシーケンスの最大 max_len

トレーニング データ内のブースティング命令の長さの分布を考慮すると、各シーケンスのパッキング ファクターは 2.7

になります。 Orca をトレーニングするために、研究者らは教師モデルによって生成されたトークンの損失のみを計算することを選択しました。これは、システム情報とタスク指示に条件付けされた応答を生成する方法を学習することで、モデルが最も関連性が高く有益なトークンからの学習に重点を置くことができることを意味します。トレーニングプロセスの効率の向上、全体的な効率と有効性。

最後に、Orca は 80 GB のメモリを備えた 20 個の NVIDIA A100 GPU でトレーニングされました。最初に FLAN-5M (ChatGPT 拡張) で 4 エポック間トレーニングされ、160 時間かかりました。次に FLAN-1M (GPT) でトレーニングされました。 -4 拡張) を実行し、4 エポックのトレーニングを継続します

トラフィック制限、端末の負荷と応答の長さの問題により、複数の GPT-3.5-turbo (ChatGPT) および GPT-4 端末データ収集にはそれぞれ 2 週間と 3 週間かかりました。

実験部分

研究者たちは主に Orca の推論能力を検証しました。

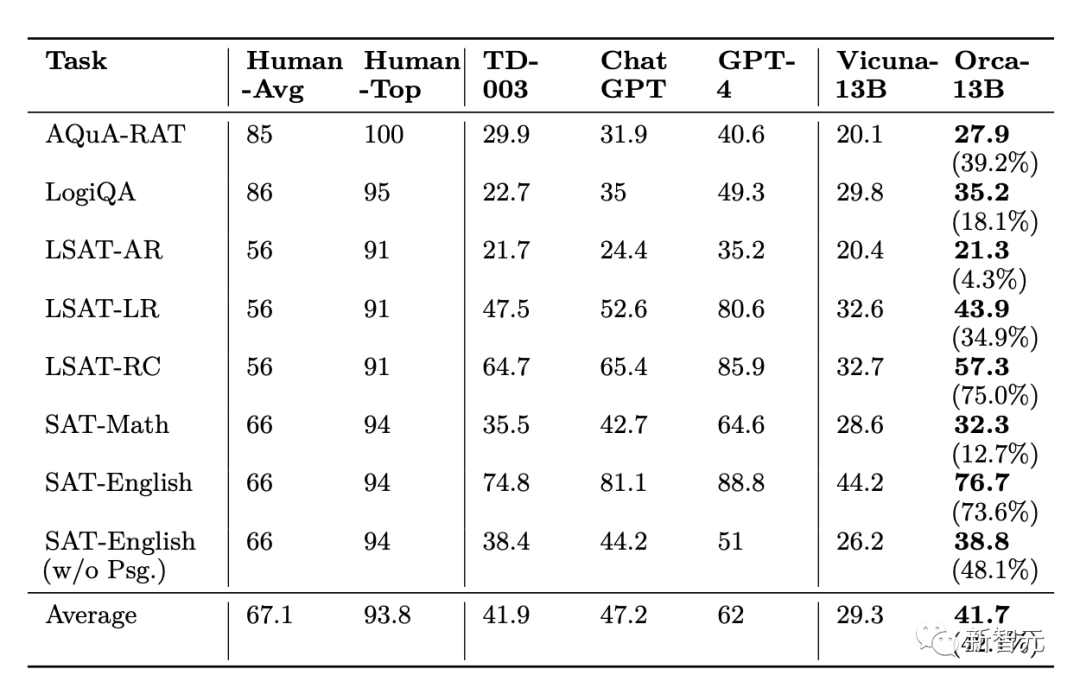

AGIEval 実験でわかるように、Orca のパフォーマンスは Text-da-Vinci-003 と同等であり、ChatGPT のパフォーマンスの 88% を達成しています。しかし、GPT-4 には大幅に遅れています

分析タスクと推論タスクでは、Vicuna のパフォーマンスが大幅に低下し、ChatGPT の品質の 62% しか維持できませんでした。これは、このオープンソース言語モデルの推論能力が非常に低いことを示しています。 。

Orca は Text-da-Vinci-003 と同等のパフォーマンスを発揮しますが、それでも ChatGPT より 5 ポイント低く、数学関連のタスク (SAT、GRE、GMAT) では Orca の方が優れたパフォーマンスを発揮します。 ) ChatGPT との間には大きな隔たりがあります。

Vicuna と比較すると、Orca はより強力なパフォーマンスを示し、すべてのカテゴリで Vicuna を上回り、平均相対的な改善率は 42% です。

GPT-4 は他のすべてのモデルをはるかに上回っていますが、このベンチマークにはまだ改善の余地が大きく、現在すべてのモデルのパフォーマンスは人間のスコアを大幅に下回っています。

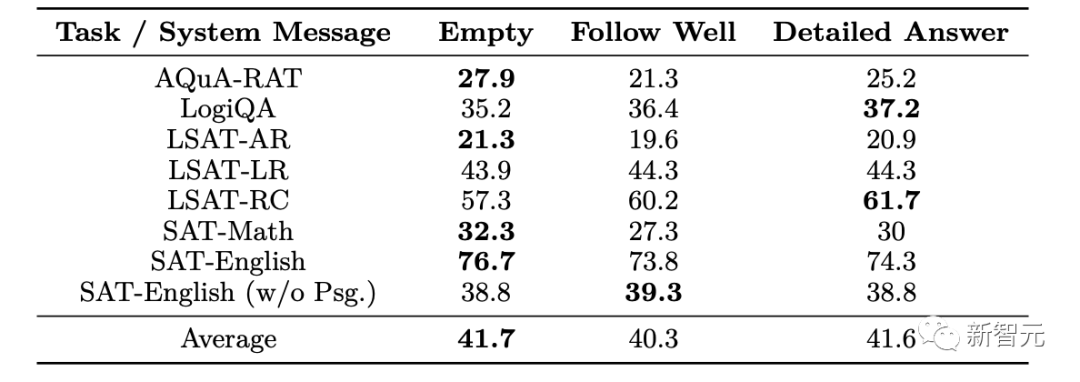

Orca のパフォーマンスは、システム メッセージの種類によって大きく異なります。トレーニング済みモデルの場合、空のシステム メッセージが適切に機能する傾向があります。

Orca は、さまざまなタスクの 325 サンプルで ChatGPT (Orca-beats-ChatGPT の例) を上回っています。そのほとんどは LogiQA (29%) からのものです。一方、他の LSAT タスクと SAT-English タスクの割合はそれぞれ 10% 未満です。

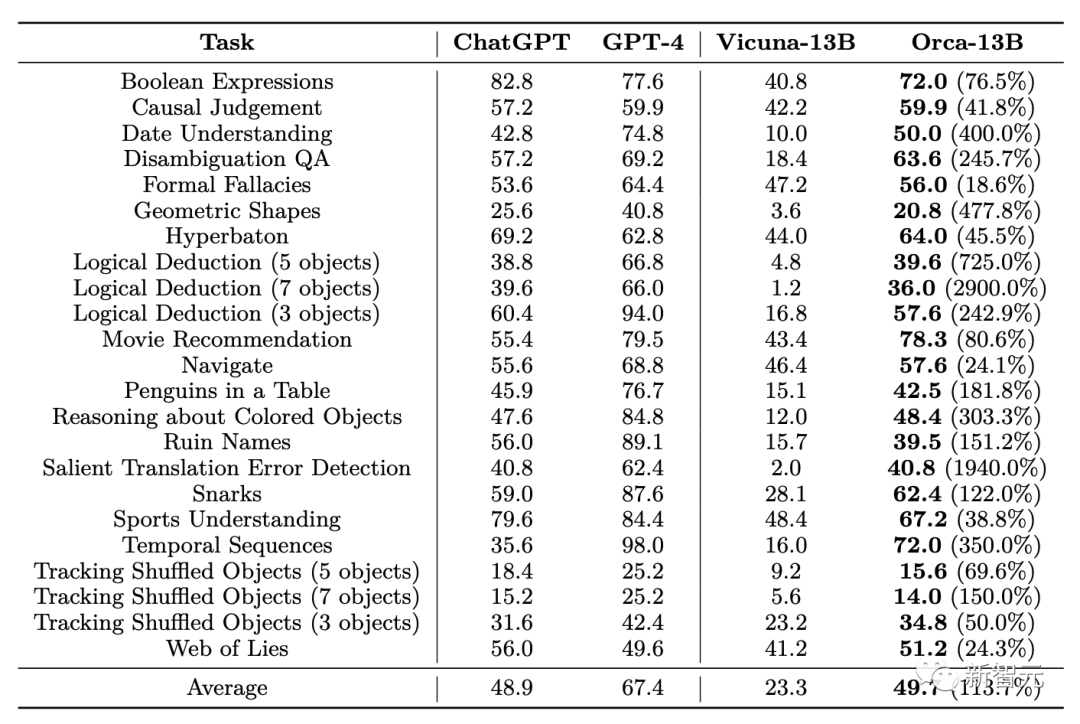

Big-Bench Hard Results データセットの推論評価結果は、すべてのタスクで Orca のパフォーマンスが全体的に優れていることを示しています。パフォーマンスは ChatGPT よりわずかに優れていますが、GPT-4 よりも大幅に劣っており、Vicuna のパフォーマンスよりも 113% 高いです

以上が「真似して学ぶ」というのは単なる決まり文句なのでしょうか?解説微調整+130億パラメータ Orca:ChatGPTに匹敵する推理力の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7741

7741

15

15

1643

1643

14

14

1397

1397

52

52

1291

1291

25

25

1233

1233

29

29

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)は、独自の生体認証とプライバシー保護メカニズムを備えた暗号通貨市場で際立っており、多くの投資家の注目を集めています。 WLDは、特にOpenai人工知能技術と組み合わせて、革新的なテクノロジーを備えたAltcoinsの間で驚くほど演奏しています。しかし、デジタル資産は今後数年間でどのように振る舞いますか? WLDの将来の価格を一緒に予測しましょう。 2025年のWLD価格予測は、2025年にWLDで大幅に増加すると予想されています。市場分析は、平均WLD価格が1.31ドルに達する可能性があり、最大1.36ドルであることを示しています。ただし、クマ市場では、価格は約0.55ドルに低下する可能性があります。この成長の期待は、主にWorldCoin2によるものです。

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションをサポートする交換:1。Binance、2。Uniswap、3。Sushiswap、4。CurveFinance、5。Thorchain、6。1inchExchange、7。DLNTrade、これらのプラットフォームはさまざまな技術を通じてマルチチェーン資産トランザクションをサポートします。

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

仮想通貨価格の上昇の要因には、次のものが含まれます。1。市場需要の増加、2。供給の減少、3。刺激された肯定的なニュース、4。楽観的な市場感情、5。マクロ経済環境。衰退要因は次のとおりです。1。市場需要の減少、2。供給の増加、3。ネガティブニュースのストライキ、4。悲観的市場感情、5。マクロ経済環境。

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

暗号通貨の賑やかな世界では、新しい機会が常に現れます。現在、Kerneldao(Kernel)Airdropアクティビティは多くの注目を集め、多くの投資家の注目を集めています。それで、このプロジェクトの起源は何ですか? BNBホルダーはそれからどのような利点を得ることができますか?心配しないでください、以下はあなたのためにそれを一つ一つ明らかにします。

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Aavedaoの定足数を実装したToken Reposを導入する提案です。 Aave Project Chain(ACI)の創設者であるMarc Zellerは、これをXで発表し、契約の新しい時代をマークしていることに注目しました。 Aave Chain Initiative(ACI)の創設者であるMarc Zellerは、Aavenomicsの提案にAave Protocolトークンの変更とトークンリポジトリの導入が含まれていると発表しました。 Zellerによると、これは契約の新しい時代を告げています。 Aavedaoのメンバーは、水曜日の週に100でした。

ハイブリッドブロックチェーン取引プラットフォームとは何ですか?

Apr 21, 2025 pm 11:36 PM

ハイブリッドブロックチェーン取引プラットフォームとは何ですか?

Apr 21, 2025 pm 11:36 PM

暗号通貨交換を選択するための提案:1。流動性の要件については、優先度は、その順序の深さと強力なボラティリティ抵抗のため、Binance、gate.ioまたはokxです。 2。コンプライアンスとセキュリティ、Coinbase、Kraken、Geminiには厳格な規制の承認があります。 3.革新的な機能、Kucoinのソフトステーキング、Bybitのデリバティブデザインは、上級ユーザーに適しています。

通貨サークル市場に関するリアルタイムデータの上位10の無料プラットフォーム推奨事項がリリースされます

Apr 22, 2025 am 08:12 AM

通貨サークル市場に関するリアルタイムデータの上位10の無料プラットフォーム推奨事項がリリースされます

Apr 22, 2025 am 08:12 AM

初心者に適した暗号通貨データプラットフォームには、Coinmarketcapと非小さいトランペットが含まれます。 1。CoinMarketCapは、初心者と基本的な分析のニーズに合わせて、グローバルなリアルタイム価格、市場価値、取引量のランキングを提供します。 2。小さい引用は、中国のユーザーが低リスクの潜在的なプロジェクトをすばやくスクリーニングするのに適した中国フレンドリーなインターフェイスを提供します。

通貨サークルでのレバレッジされた交換のランキングは

Apr 21, 2025 pm 11:24 PM

通貨サークルでのレバレッジされた交換のランキングは

Apr 21, 2025 pm 11:24 PM

2025年のレバレッジド取引、セキュリティ、ユーザーエクスペリエンスで優れたパフォーマンスを持つプラットフォームは次のとおりです。1。OKX、高周波トレーダーに適しており、最大100倍のレバレッジを提供します。 2。世界中の多通貨トレーダーに適したバイナンス、125倍の高いレバレッジを提供します。 3。Gate.io、プロのデリバティブプレーヤーに適し、100倍のレバレッジを提供します。 4。ビットゲットは、初心者やソーシャルトレーダーに適しており、最大100倍のレバレッジを提供します。 5。Kraken、安定した投資家に適しており、5倍のレバレッジを提供します。 6。Altcoinエクスプローラーに適したBybit。20倍のレバレッジを提供します。 7。低コストのトレーダーに適したKucoinは、10倍のレバレッジを提供します。 8。ビットフィネックス、シニアプレイに適しています