Python サーバー プログラミング: PyTorch を使用したディープ ラーニング

人工知能テクノロジーの急速な発展に伴い、ディープラーニングテクノロジーは多くの応用分野で不可欠なツールとなっています。人気の深層学習フレームワークとして、PyTorch は多くの研究者やエンジニアの最初の選択肢となっています。この記事では、Python サーバー プログラミングでディープ ラーニングに PyTorch を使用する方法を紹介します。

- PyTorch の概要

PyTorch は、研究者やエンジニアがさまざまなディープ ニューラル ネットワークを迅速に構築およびトレーニングできるようにする、柔軟な設計コンセプトとツールを提供するオープンソースの Python ディープ ラーニング フレームワークです。 。 PyTorch の核となるアイデアは「即時実行」です。これにより、ユーザーはネットワーク モデルをリアルタイムで確認および変更して、より良いトレーニング結果を達成できます。

PyTorch を使用する主な利点は次のとおりです:

- 使いやすさ: PyTorch は直感的な API とドキュメントを提供するため、初心者でも簡単に使い始めることができます。

- 柔軟性: PyTorch はさまざまな柔軟な設計コンセプトとツールを提供し、ユーザーがさまざまなネットワーク構造を自由に設計および実験できるようにします。

- カスタマイズが簡単: PyTorch を使用すると、ユーザーは Python の強力な機能を使用してネットワーク層とトレーニング プロセスをカスタマイズし、より高度な深層学習機能を実現できます。

- サーバー プログラミングの基礎

サーバー プログラミングでディープ ラーニングに PyTorch を使用するには、基本的なサーバー プログラミングの知識が必要です。サーバー プログラミングの基本についてはここでは詳しく紹介しませんが、次の点に注意する必要があります。

- データ ストレージ: 通常、サーバーは大量のデータの読み取りと書き込みを行う必要があるため、データベース、ファイル システムなどの効率的なデータ ストレージ方法を使用する必要がある。

- ネットワーク通信: サーバーは通常、HTTP リクエスト、WebSocket リクエストなどのさまざまなネットワーク リクエストを処理する必要があります。

- マルチスレッドとマルチプロセス: サーバーのパフォーマンスと安定性を向上させるには、通常、マルチスレッドまたはマルチプロセスを使用してリクエストを処理する必要があります。

- セキュリティ: サーバーは、ファイアウォール、暗号化、認証、承認などを含む、データとシステムのセキュリティを保護する必要があります。

- #サーバー プログラミングにおける PyTorch のアプリケーション

- Modelトレーニング: サーバーはマルチ GPU 環境でのモデル トレーニングに PyTorch を使用できるため、トレーニング速度が加速され、モデルのパフォーマンスが向上します。

- モデル推論: サーバーはモデル推論に PyTorch を使用して、クライアントのリクエストにリアルタイムの応答を提供できます。

- モデル管理: サーバーは PyTorch を使用して複数のモデルを管理できるため、ユーザーはさまざまなモデルをすばやく切り替えてデプロイできます。

- 多言語サポート: PyTorch は、Java、C などの他のプログラミング言語と統合して、さまざまなアプリケーション シナリオと統合できます。

- 例: PyTorch を使用してモデルをトレーニングおよびデプロイする

import torch.nn as nn

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(1, 20, 5, 1)

self.conv2 = nn.Conv2d(20, 50, 5, 1)

self.fc1 = nn.Linear(4*4*50, 500)

self.fc2 = nn.Linear(500, 10)

def forward(self, x):

x = F.relu(self.conv1(x))

x = F.max_pool2d(x, 2, 2)

x = F.relu(self.conv2(x))

x = F.max_pool2d(x, 2, 2)

x = x.view(-1, 4*4*50)

x = F.relu(self.fc1(x))

x = self.fc2(x)

return F.log_softmax(x, dim=1)def train(model, device, train_loader, optimizer, epoch):

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

data, target = data.to(device), target.to(device)

optimizer.zero_grad()

output = model(data)

loss = F.nll_loss(output, target)

loss.backward()

optimizer.step()def infer(model, device, data):

model.eval()

with torch.no_grad():

output = model(data.to(device))

pred = output.argmax(dim=1, keepdim=True)

return pred.item()- 概要

以上がPython サーバー プログラミング: PyTorch を使用したディープ ラーニングの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7569

7569

15

15

1386

1386

52

52

87

87

11

11

28

28

107

107

Python での感情分析に BERT を使用する方法と手順

Jan 22, 2024 pm 04:24 PM

Python での感情分析に BERT を使用する方法と手順

Jan 22, 2024 pm 04:24 PM

BERT は、2018 年に Google によって提案された事前トレーニング済みの深層学習言語モデルです。正式名は BidirectionEncoderRepresentationsfromTransformers で、Transformer アーキテクチャに基づいており、双方向エンコードの特性を備えています。従来の一方向コーディング モデルと比較して、BERT はテキストを処理するときにコンテキスト情報を同時に考慮できるため、自然言語処理タスクで優れたパフォーマンスを発揮します。その双方向性により、BERT は文内の意味関係をより深く理解できるようになり、それによってモデルの表現能力が向上します。事前トレーニングおよび微調整方法を通じて、BERT は感情分析、命名などのさまざまな自然言語処理タスクに使用できます。

PyCharm と PyTorch の完璧な組み合わせ: 詳細なインストールと構成手順

Feb 21, 2024 pm 12:00 PM

PyCharm と PyTorch の完璧な組み合わせ: 詳細なインストールと構成手順

Feb 21, 2024 pm 12:00 PM

PyCharm は強力な統合開発環境 (IDE) であり、PyTorch はディープ ラーニングの分野で人気のあるオープン ソース フレームワークです。機械学習とディープラーニングの分野では、開発に PyCharm と PyTorch を使用すると、開発効率とコード品質が大幅に向上します。この記事では、PyCharm に PyTorch をインストールして構成する方法を詳しく紹介し、読者がこれら 2 つの強力な機能をより効果的に活用できるように、具体的なコード例を添付します。ステップ 1: PyCharm と Python をインストールする

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

以前に書きましたが、今日は、深層学習テクノロジーが複雑な環境におけるビジョンベースの SLAM (同時ローカリゼーションとマッピング) のパフォーマンスをどのように向上させることができるかについて説明します。ここでは、深部特徴抽出と深度マッチング手法を組み合わせることで、低照度条件、動的照明、テクスチャの弱い領域、激しいセックスなどの困難なシナリオでの適応を改善するように設計された多用途のハイブリッド ビジュアル SLAM システムを紹介します。当社のシステムは、拡張単眼、ステレオ、単眼慣性、ステレオ慣性構成を含む複数のモードをサポートしています。さらに、他の研究にインスピレーションを与えるために、ビジュアル SLAM と深層学習手法を組み合わせる方法も分析します。公開データセットと自己サンプリングデータに関する広範な実験を通じて、測位精度と追跡堅牢性の点で SL-SLAM の優位性を実証しました。

潜在空間の埋め込み: 説明とデモンストレーション

Jan 22, 2024 pm 05:30 PM

潜在空間の埋め込み: 説明とデモンストレーション

Jan 22, 2024 pm 05:30 PM

潜在空間埋め込み (LatentSpaceEmbedding) は、高次元データを低次元空間にマッピングするプロセスです。機械学習と深層学習の分野では、潜在空間埋め込みは通常、高次元の入力データを低次元のベクトル表現のセットにマッピングするニューラル ネットワーク モデルです。このベクトルのセットは、「潜在ベクトル」または「潜在ベクトル」と呼ばれることがよくあります。エンコーディング」。潜在空間埋め込みの目的は、データ内の重要な特徴をキャプチャし、それらをより簡潔でわかりやすい形式で表現することです。潜在空間埋め込みを通じて、低次元空間でデータの視覚化、分類、クラスタリングなどの操作を実行し、データをよりよく理解して活用できます。潜在空間埋め込みは、画像生成、特徴抽出、次元削減など、多くの分野で幅広い用途があります。潜在空間埋め込みがメイン

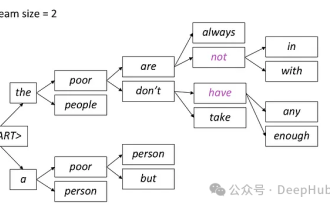

自然言語生成タスクと Pytorch コード実装における 5 つのサンプリング方法の紹介

Feb 20, 2024 am 08:50 AM

自然言語生成タスクと Pytorch コード実装における 5 つのサンプリング方法の紹介

Feb 20, 2024 am 08:50 AM

自然言語生成タスクにおいて、サンプリング法は生成モデルからテキスト出力を取得する手法です。この記事では、5 つの一般的なメソッドについて説明し、PyTorch を使用してそれらを実装します。 1. 貪欲復号 貪欲復号では、生成モデルは入力シーケンスに基づいて出力シーケンスの単語を時間ごとに予測します。各タイム ステップで、モデルは各単語の条件付き確率分布を計算し、最も高い条件付き確率を持つ単語を現在のタイム ステップの出力として選択します。このワードは次のタイム ステップへの入力となり、指定された長さのシーケンスや特別な終了マーカーなど、何らかの終了条件が満たされるまで生成プロセスが続行されます。 GreedyDecoding の特徴は、毎回現在の条件付き確率が最良になることです。

PyTorchを使用したノイズ除去拡散モデルの実装

Jan 14, 2024 pm 10:33 PM

PyTorchを使用したノイズ除去拡散モデルの実装

Jan 14, 2024 pm 10:33 PM

ノイズ除去拡散確率モデル (DDPM) の動作原理を詳細に理解する前に、まず、DDPM の基礎研究の 1 つである生成人工知能の開発の一部を理解しましょう。 VAEVAE は、エンコーダー、確率的潜在空間、およびデコーダーを使用します。トレーニング中に、エンコーダーは各画像の平均と分散を予測し、ガウス分布からこれらの値をサンプリングします。サンプリングの結果はデコーダに渡され、入力画像が出力画像と同様の形式に変換されます。 KL ダイバージェンスは損失の計算に使用されます。 VAE の大きな利点は、多様な画像を生成できることです。サンプリング段階では、ガウス分布から直接サンプリングし、デコーダを通じて新しい画像を生成できます。 GAN は、わずか 1 年で変分オートエンコーダ (VAE) において大きな進歩を遂げました。

PyTorch を使用した PyCharm のインストールに関するチュートリアル

Feb 24, 2024 am 10:09 AM

PyTorch を使用した PyCharm のインストールに関するチュートリアル

Feb 24, 2024 am 10:09 AM

PyTorch は、強力な深層学習フレームワークとして、さまざまな機械学習プロジェクトで広く使用されています。強力な Python 統合開発環境として、PyCharm はディープ ラーニング タスクを実装するときに優れたサポートも提供します。この記事では、PyTorch を PyCharm にインストールする方法を詳しく紹介し、読者が深層学習タスクに PyTorch をすぐに使い始めるのに役立つ具体的なコード例を示します。ステップ 1: PyCharm をインストールする まず、PyCharm がインストールされていることを確認する必要があります。

1 つの記事で理解: AI、機械学習、ディープラーニングのつながりと違い

Mar 02, 2024 am 11:19 AM

1 つの記事で理解: AI、機械学習、ディープラーニングのつながりと違い

Mar 02, 2024 am 11:19 AM

今日の急速な技術変化の波の中で、人工知能 (AI)、機械学習 (ML)、および深層学習 (DL) は輝かしい星のようなもので、情報技術の新しい波をリードしています。これら 3 つの単語は、さまざまな最先端の議論や実践で頻繁に登場しますが、この分野に慣れていない多くの探検家にとって、その具体的な意味や内部のつながりはまだ謎に包まれているかもしれません。そこで、まずはこの写真を見てみましょう。ディープラーニング、機械学習、人工知能の間には密接な相関関係があり、進歩的な関係があることがわかります。ディープラーニングは機械学習の特定の分野であり、機械学習