Baidu ビジネスのマルチモーダル理解と AIGC イノベーションの実践

1. リッチメディアのマルチモーダルについての理解

まず、マルチモーダル コンテンツに対する私たちの認識を紹介しましょう。

1. マルチモーダル理解

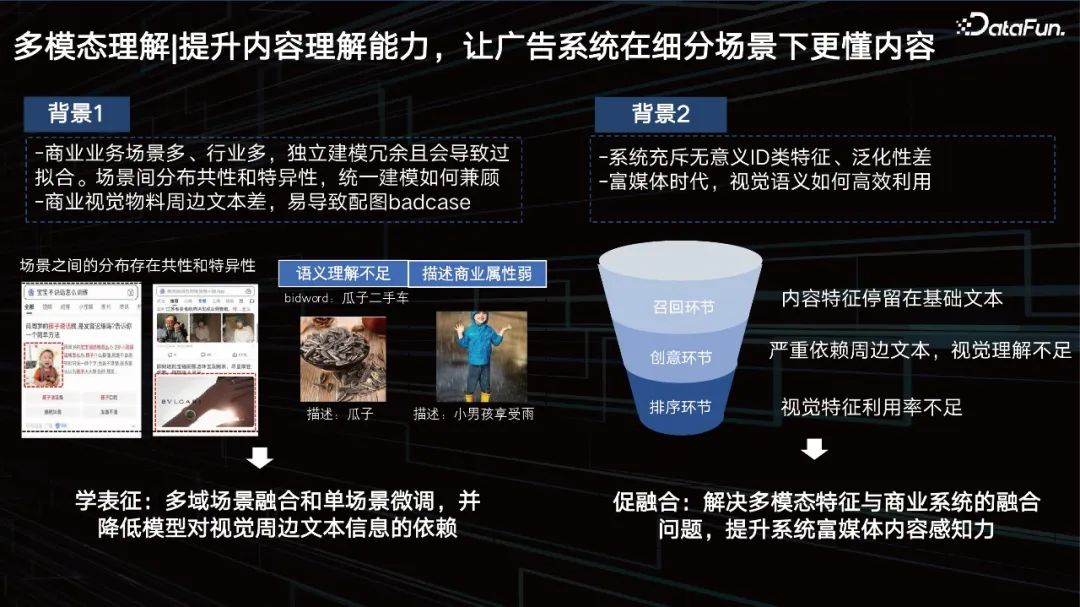

コンテンツ理解機能を向上させ、広告システムがセグメント化されたシナリオでコンテンツをよりよく理解できるようにします。

コンテンツ理解能力を向上させる場合、多くの実際的な問題に遭遇するでしょう:

- There多くの商用ビジネス シナリオと業界が存在する 独立したモデリングは冗長であり、過剰適合につながる シナリオ間の分布の共通性と特異性のバランスをとる方法 統合されたモデリングを考慮する方法

- #商用ビジュアル素材の周囲に不適切なテキストがあると、簡単に不適切なイラストが作成される可能性があります。

- #このシステムは意味のない ID 機能が満載であり、一般化が不十分です。

- リッチメディア時代には、ビジュアルセマンティクスを効果的に活用し、これらのコンテンツ機能、ビデオ機能、その他の機能をどのように統合するかが課題です。システム内のリッチメディアコンテンツの知覚強度を改善します。

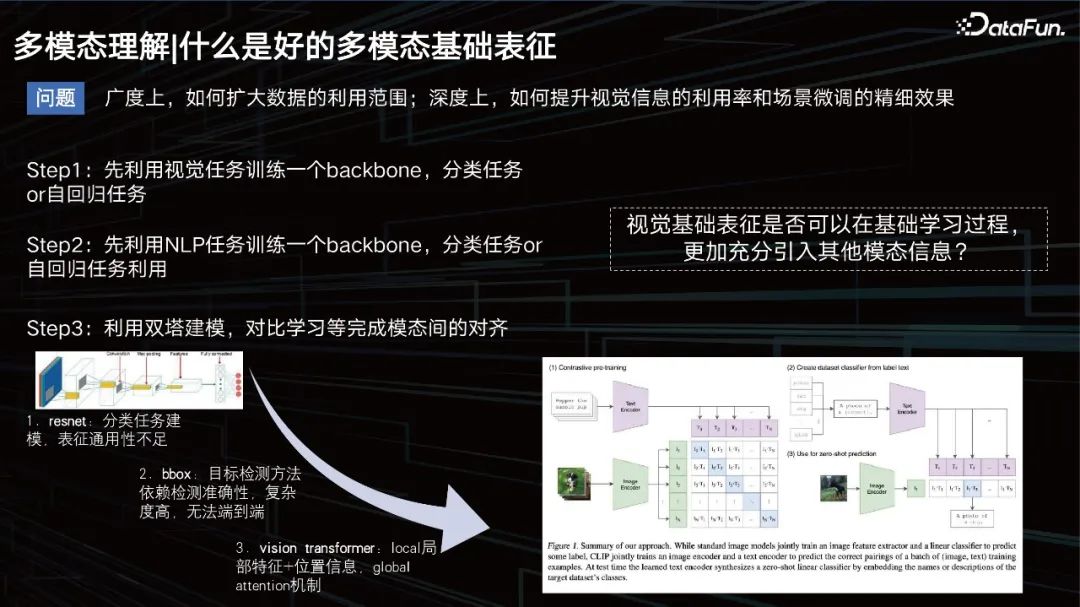

優れたマルチモーダル基本表現とは何ですか。

#優れたマルチモーダル表現とは何でしょうか?

データ適用範囲を幅の面で拡大し、奥行きの面で視覚効果を向上させ、シーン内のデータを確実に微調整する必要があります。

以前は、画像モダリティ、つまり自己回帰タスクを学習するようにモデルをトレーニングしてからテキスト タスクを実行し、次にいくつかのツインタワー モデルを適用してモーダルを閉じるという従来の考え方がありました。二人の関係。当時、テキスト モデリングは比較的単純で、誰もがビジョンをモデル化する方法を研究していました。 CNN に始まり、その後、bbox 法などの視覚的表現を改善するためにターゲット検出に基づくいくつかの手法が導入されましたが、この手法は検出能力が限られており、重すぎるため、大規模なデータのトレーニングには適していません。

2020年、2021年頃からVIT工法が主流になってきました。ここで言及しなければならないより有名なモデルの 1 つは、2020 年に OpenAI によってリリースされたモデルである CLIP です。これは、テキストとビジュアル表現のためのツインタワー アーキテクチャに基づいています。次に、コサインを使用して 2 つの間の距離を縮めます。このモデルは検索には非常に優れていますが、VQA タスクなどの論理的推論を必要とする一部のタスクでは能力が若干劣ります。

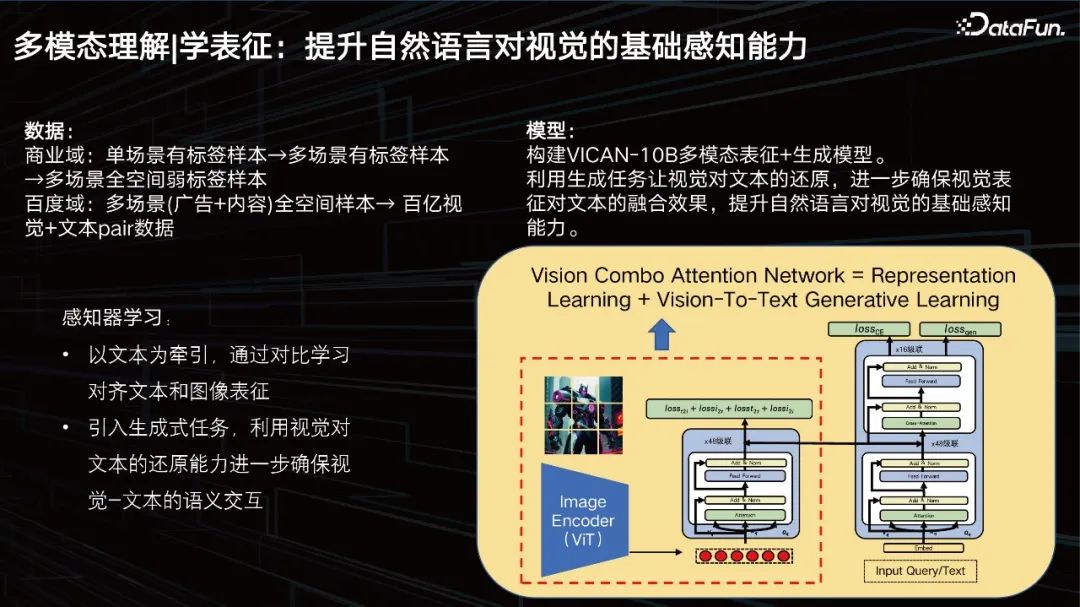

表現の学習: 自然言語から視覚への基本的な認識能力を向上させます。

# 私たちの目標は、自然言語の基本的な視覚認識を向上させることです。データに関しては、当社の事業領域には数十億件のデータがありますが、まだまだ不十分であり、さらに拡充し、事業領域の過去データを導入し、整理・整理する必要があります。数百億レベルのトレーニングセットが構築されました。

VICAN-12B マルチモーダル表現生成モデルを構築しました。生成タスクを使用してテキストの視覚的復元を可能にし、テキスト上の視覚的表現の融合効果をさらに確実にし、自然言語の視覚効果、基本的な知覚能力。上の写真は模型の全体構造を示したもので、2つの塔と1つの塔の複合構造であることがわかります。なぜなら、最初に解決すべきは大規模な画像検索タスクだからです。左側のボックス内の部分はビジュアル パーセプトロンと呼ばれるもので、20 億パラメータのスケールを持つ ViT 構造です。右側は2層に分かれており、下段は検索用のテキストトランスフォーマーのスタック、上段は生成用のテキストトランスフォーマーのスタックです。モデルは生成タスク、分類タスク、画像比較タスクの 3 つのタスクに分かれており、これら 3 つの異なる目標に基づいてモデルがトレーニングされているため、比較的良好な結果が得られていますが、さらに最適化していきます。

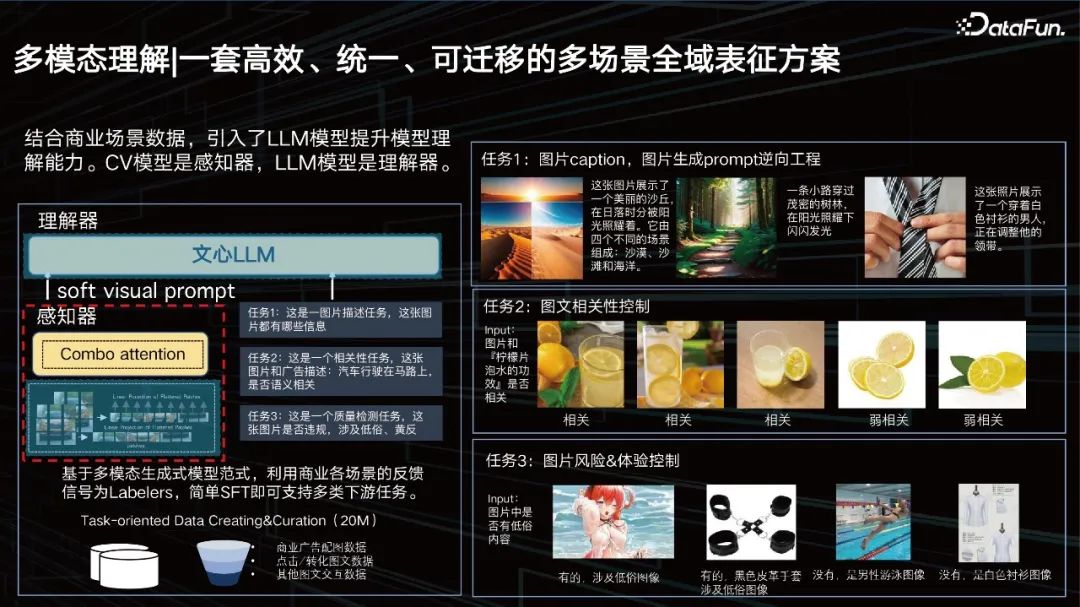

効率的で統合され、転送可能なマルチシナリオのグローバル表現スキームのセット。

LLM モデルは、ビジネス シナリオ データと組み合わせて、モデルの理解能力を向上させるために導入されています。 CV モデルはパーセプトロンであり、LLM モデルは理解者です。私たちのアプローチは、視覚的特徴をそれに応じて転送することです。なぜなら、先ほど述べたように、表現はマルチモーダルであり、大規模なモデルはテキストに基づいているためです。これを Wenxin LLM の大規模モデルに適応させるだけでよいため、対応する機能融合を実行するにはコンボ アテンションを使用する必要があります。大規模モデルの論理的推論機能を保持する必要があるため、大規模モデルを放置せず、ビジネス シナリオのフィードバック データのみを追加して、大規模モデルへの視覚機能の統合を促進するように努めます。いくつかのショットを使用してタスクをサポートできます。主なタスクは次のとおりです:

- 画像の説明。実際、これは単なる説明ではなく、プロンプト リバース エンジニアリングです。高品質のグラフィック データは、後でテキストとして使用できます。グラフのためのより良いデータ ソースです。

- 画像とテキストの相関制御。ビジネスでは画像情報の構成と理解が必要であるため、広告画像の検索用語と画像セマンティクスは実際に必要です。もちろん、これは画像やプロンプトに対して適切な判断を下すための非常に一般的な方法です。

- 画像のリスクとエクスペリエンスのコントロールでは、画像の内容を比較的うまく説明できました。その後は、単に次の小さなサンプル データを使用するだけで済みます。リスク管理 移行により、リスク問題が伴うかどうかが明確になります。

# 次に、シーンベースの微調整に焦点を当てましょう。

2. シナリオベースの微調整

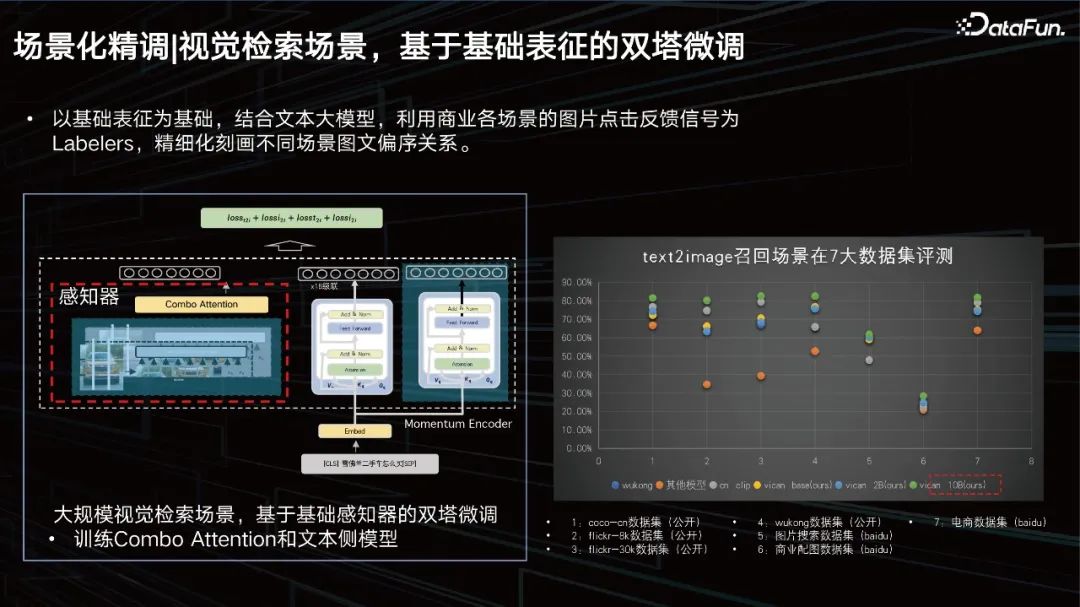

ビジュアル検索シナリオ、基本表現に基づくツインタワー微調整。

基本的な表現に基づいて、大きなテキスト モデルと組み合わせて、さまざまなビジネス シーンの画像クリック フィードバック信号をラベラーとして使用して、部分的な順序を調整します。さまざまなシーンの写真とテキストの関係。主要な 7 つのデータセットに対して評価を実施しましたが、それらはすべて SOTA の結果を達成できます。

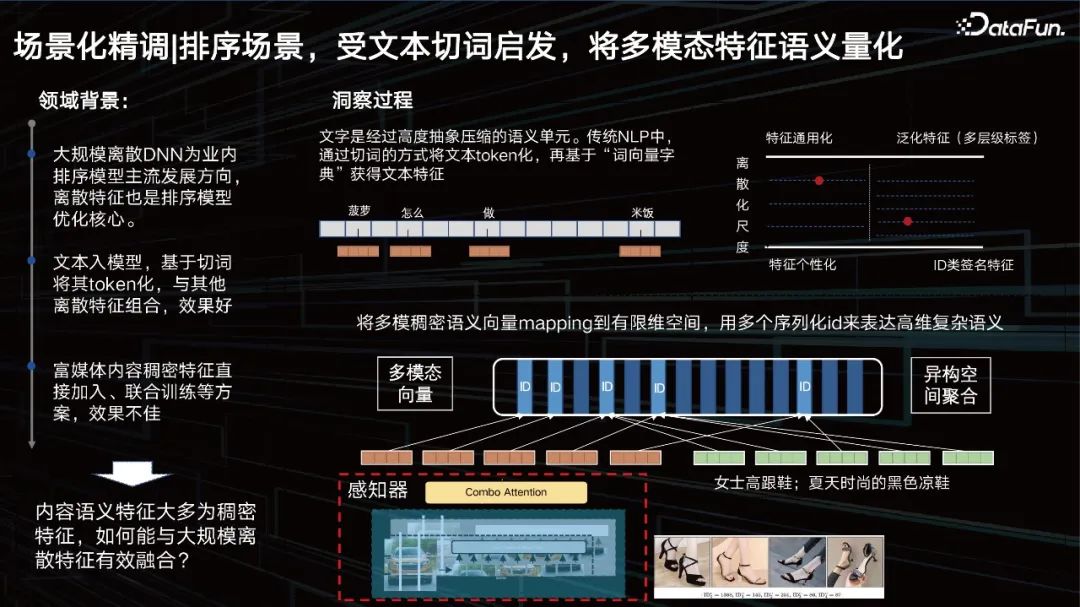

テキスト セグメンテーションからインスピレーションを得た並べ替えシナリオは、マルチモーダル機能のセマンティクスを定量化します。

#表現だけでなく、仕分けシーンにおける視覚効果をいかに向上させるかが課題です。まず分野の背景を見てみましょう. 大規模離散 DNN は業界におけるランキング モデルの開発方向の主流であり、離散特徴はランキング モデル最適化の中核でもあります。テキストはモデルに入力され、単語の分割に基づいてトークン化され、他の個別の特徴と組み合わされて、良好な結果が得られます。ビジョンに関しては、同様にトークン化したいと考えています。

ID タイプの特徴は、実際には非常に個人化された特徴ですが、汎用化された特徴がより多用途になるにつれて、その特徴付けの精度が悪化する可能性があります。データとタスクを通じてこのバランスポイントを動的に調整する必要があります。つまり、データに最も関連するスケールを見つけて、それに応じて特徴を ID に「セグメント化」し、テキストなどのマルチモーダル特徴をセグメント化したいと考えています。そこで、この問題を解決するために、マルチスケール、マルチレベルのコンテンツ定量化学習手法を提案しました。

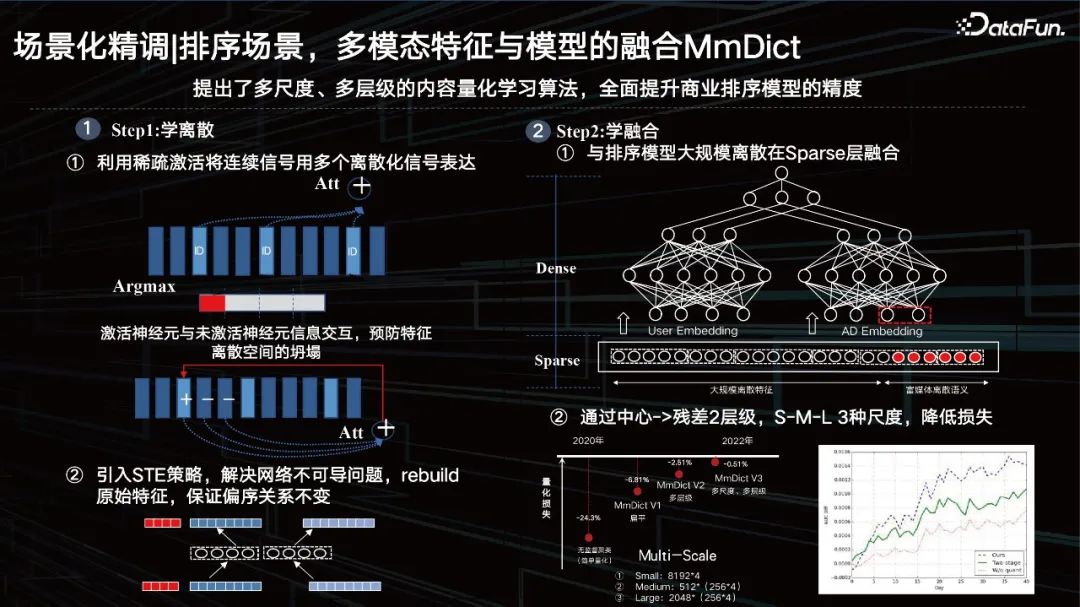

シナリオの並べ替え、マルチモーダル機能とモデルの融合 MmDict。

主に 2 つのステップに分かれており、第 1 ステップは離散性を学び、第 2 ステップは積分を学びます。

ステップ 1: 離散を学習する

① スパース アクティベーションを使用して、複数の離散化信号で連続信号を表現します。つまり、スパース アクティベーションを使用して密なフィーチャをセグメント化し、対応するマルチモーダル コードブックには ID が含まれていますが、実際には argmax 演算のみが存在し、微分不可能な問題が発生します 同時に、特徴空間の崩壊を防ぐために、活性化されたニューロンと非活性化されたニューロン間の情報相互作用がが追加されます。

② STE 戦略を導入して、ネットワーク非微分可能性の問題を解決し、元の特徴を再構築し、半順序関係が変わらないことを確認します。

エンコーダ/デコーダ方式を通じて、密な特徴が連続的に量子化され、量子化された特徴が正しい方法で復元されます。半順序関係が復元前後で変化しないことを保証する必要があり、特定のタスクにおける特徴の量的損失をほぼ 1% 未満に抑えることができ、このような ID は現在のデータ分布をパーソナライズするだけでなく、一般化特性を持っています。

Step2: 融合の学習

① Sparse層のソートモデルと大規模に融合します。

次に、先ほど述べた隠れ層の再利用が直接最上部に配置されますが、その効果は実際には平均的です。 ID 化して量子化し、スパース フィーチャ レイヤーや他のタイプのフィーチャと融合すると、より良い効果が得られます。

② センター→残留の2段階とS-M-Lの3段階でロスを軽減します。

もちろん、いくつかの残差とマルチスケール手法も使用します。 2020 年から、私たちは定量化損失を徐々に下げ、昨年のある点を下回りました。これにより、大規模なモデルが特徴を抽出した後、この学習可能な定量化手法を使用して、意味論的な関連付け ID を使用して視覚コンテンツを特徴付けることができます。特徴は実際には非常に優れています。このようなレコメンドシステムのIDに関する探索的な調査手法も含め、現在の業務システムに適したものを提案していきます。

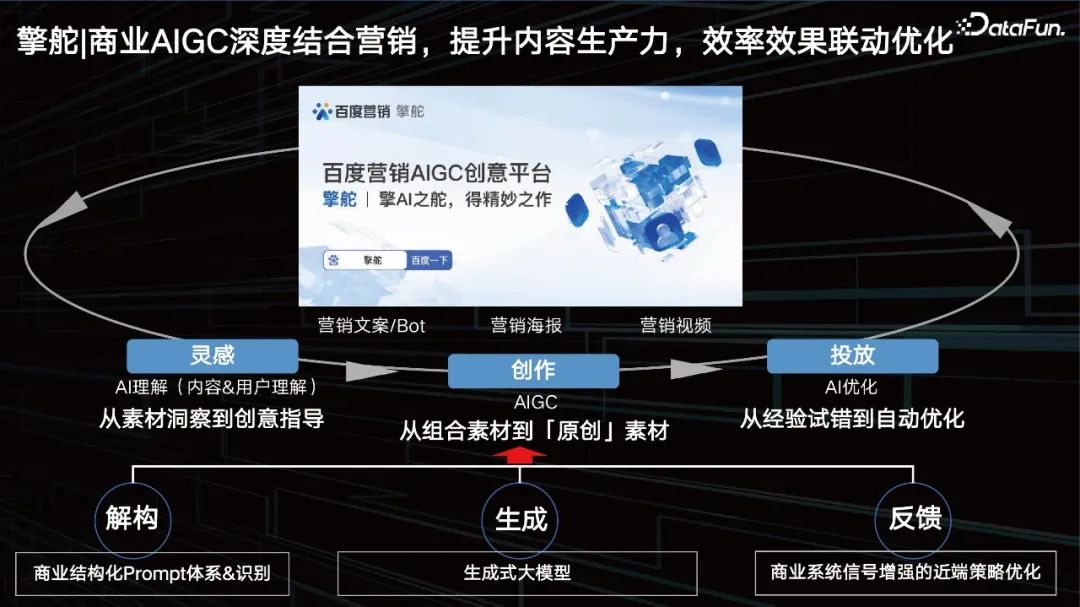

2. Qingduo

1. 商用 AIGC はマーケティングを深く統合してコンテンツの生産性を向上させ、効率と効果のつながりを最適化します

#Baidu Marketing AIGC クリエイティブ プラットフォームは、インスピレーションから制作、配信まで完璧な閉ループを形成します。解体、生成、フィードバックに至るまで、AIGC の推進と最適化を行っています。

- インスピレーション: AI の理解 (コンテンツとユーザーの理解)。 AI は、どのようなプロンプトが適切かを見つけるのに役立ちますか?素材に関する洞察からクリエイティブな方向性まで。

- 作成: AIGC (テキスト生成、画像生成、デジタル ピープル、ビデオ生成など)

- 配信: AI の最適化。経験的な試行錯誤から自動最適化へ。

優れたビジネス プロンプトには次の要素があります。

- ナレッジ マップ: たとえば、車の販売、車にはどのようなビジネス要素が含まれている必要がありますか? ブランドだけでは十分ではなく、広告主が知りたいと考えているもの詳細 完全な知識システム;

- スタイル (現在のプロパガンダ本体である「文学スタイル」など) は、実際には、判断しやすくするためにいくつかのラベルに抽象化する必要があります。主にどのようなマーケティング タイトルまたはマーケティングに関する説明です。

- セールスポイント、セールスポイントは実際には製品の属性の特徴であり、それが消費の最も強力な理由です。

- ユーザーのポートレートを、ターゲットの行動観の違いに基づいてさまざまなタイプに分類し、すばやくまとめて、新たに派生したタイプを洗練して A タイプを形成しますユーザーペルソナの。

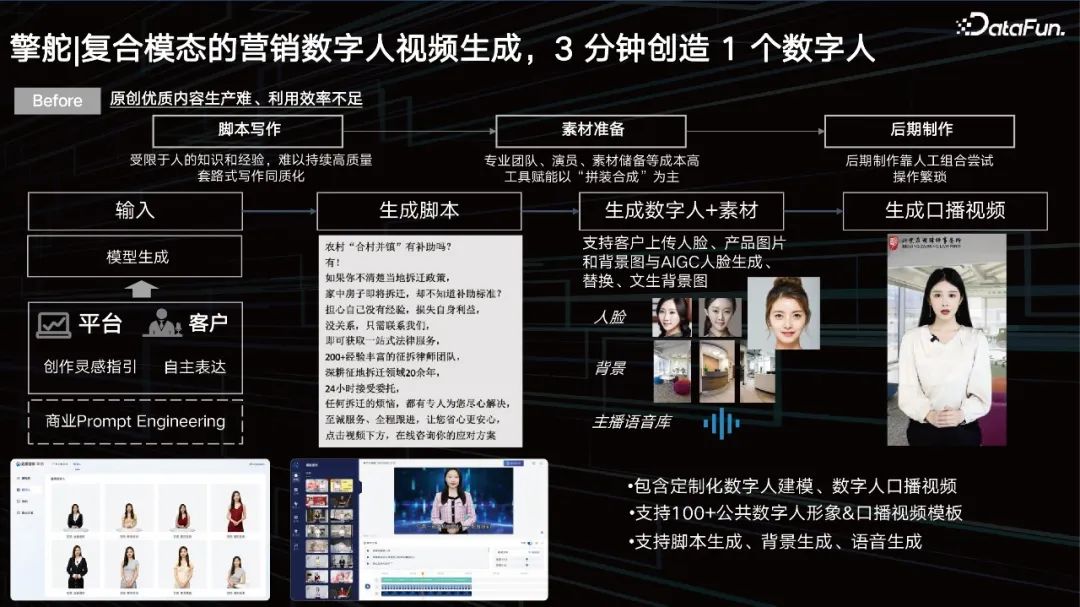

##ビデオ生成は現在、比較的成熟しています。しかし、実際にはまだいくつかの問題があります。

- スクリプトの作成: 人々の知識と経験によって制限され、高品質の執筆を維持するのが難しく、均一性が深刻です。

- 材料の準備: 専門チーム、俳優、材料の予備、およびその他の高コストのツールが「アセンブリと合成」に重点を置いて強化されます。

- ポストプロダクション: ポストプロダクションは手動の試行錯誤に依存しており、操作は煩雑です。

初期段階では、どのような動画を生成したいか、どのような人物を選択したいか、どのような人物を選択したいかをプロンプトを通じて入力します。たとえば、プロンプトを介してすべての入力を行うと、大規模なモデルを正確に制御して、その要求に基づいて対応するスクリプトを生成できます。

次に、デジタル ヒューマン ライブラリを通じて対応するデジタル ピープルを呼び出すことができますが、AI テクノロジーを使用して、顔の置き換え、背景の置き換え、アクセントなどのデジタル ピープルの多様性をさらに強化することもできます。最後に、スクリプト、デジタル唇形状の置換、背景の置換、顔の置換、およびビデオ抑制により、音声ビデオが生成されます。顧客はデジタル ヒューマンを使用して、製品に対応するいくつかのマーケティング セールス ポイントを紹介できます。このようにして、3 分でデジタル担当者になれるため、広告主のデジタル担当者になる能力が大幅に向上します。

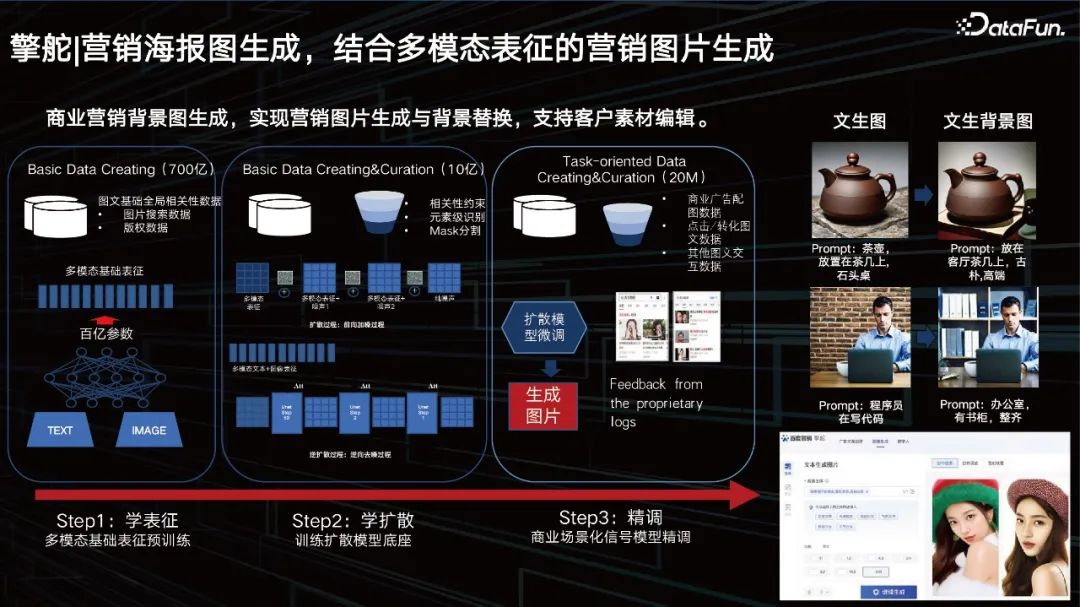

4. マーケティング画像生成のマルチモーダル表現を組み合わせたマーケティング ポスター画像の生成

大規模なモデルは、企業がマーケティング ポスターの生成を実現するのにも役立ちますおよび製品 背景の交換。私たちはすでに数百億のマルチモーダル表現を持っています. 中間層は私たちが学んだ拡散です. 私たちは優れた動的表現に基づいて unet を学習します.ビッグデータを使用したトレーニングの後、顧客は特にパーソナライズされたものを求めているため、いくつかの微調整方法も追加する必要があります。

当社は、顧客の微調整を支援するソリューション、大規模なモデルに小さなパラメータを動的にロードするソリューションを提供します。これは業界で一般的なソリューションでもあります。

まず、お客様に画像を生成する機能を提供し、編集またはプロンプトを通じて画像の背後にある背景を変更できます。

以上がBaidu ビジネスのマルチモーダル理解と AIGC イノベーションの実践の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1653

1653

14

14

1413

1413

52

52

1304

1304

25

25

1251

1251

29

29

1224

1224

24

24

ビッグモデルアプリ Tencent Yuanbao がオンラインになりました! Hunyuan がアップグレードされ、どこにでも持ち運べるオールラウンドな AI アシスタントが作成されました

Jun 09, 2024 pm 10:38 PM

ビッグモデルアプリ Tencent Yuanbao がオンラインになりました! Hunyuan がアップグレードされ、どこにでも持ち運べるオールラウンドな AI アシスタントが作成されました

Jun 09, 2024 pm 10:38 PM

5月30日、TencentはHunyuanモデルの包括的なアップグレードを発表し、Hunyuanモデルに基づくアプリ「Tencent Yuanbao」が正式にリリースされ、AppleおよびAndroidアプリストアからダウンロードできるようになりました。前のテスト段階のフンユアン アプレット バージョンと比較して、Tencent Yuanbao は、日常生活シナリオ向けの AI 検索、AI サマリー、AI ライティングなどのコア機能を提供し、Yuanbao のゲームプレイもより豊富で、複数の機能を提供します。 、パーソナルエージェントの作成などの新しいゲームプレイ方法が追加されます。 Tencent Cloud 副社長で Tencent Hunyuan 大型モデルの責任者である Liu Yuhong 氏は、「テンセントは、最初に大型モデルを開発しようとはしません。」と述べました。 Tencent Hunyuan の大型モデルは、ビジネス シナリオにおける豊富で大規模なポーランド テクノロジーを活用しながら、ユーザーの真のニーズを洞察します。

Bytedance Beanbao 大型モデルがリリース、Volcano Engine フルスタック AI サービスが企業のインテリジェントな変革を支援

Jun 05, 2024 pm 07:59 PM

Bytedance Beanbao 大型モデルがリリース、Volcano Engine フルスタック AI サービスが企業のインテリジェントな変革を支援

Jun 05, 2024 pm 07:59 PM

Volcano Engine の社長である Tan Dai 氏は、大規模モデルを実装したい企業は、モデルの有効性、推論コスト、実装の難易度という 3 つの重要な課題に直面していると述べました。複雑な問題を解決するためのサポートとして、適切な基本的な大規模モデルが必要です。また、サービスは低コストの推論を備えているため、大規模なモデルを広く使用できるようになり、企業がシナリオを実装できるようにするためには、より多くのツール、プラットフォーム、アプリケーションが必要になります。 ——Huoshan Engine 01 社長、Tan Dai 氏。大きなビーンバッグ モデルがデビューし、頻繁に使用されています。モデル効果を磨き上げることは、AI の実装における最も重要な課題です。 Tan Dai 氏は、良いモデルは大量に使用することでのみ磨かれると指摘しました。現在、Doubao モデルは毎日 1,200 億トークンのテキストを処理し、3,000 万枚の画像を生成しています。企業による大規模モデルシナリオの実装を支援するために、バイトダンスが独自に開発した豆包大規模モデルが火山を通じて打ち上げられます。

キャラクターを統一し、シーンを変更する、ビデオ生成アーティファクトである PixVerse がネチズンによって実行され、その超一貫性は「必殺技」となっています。

Apr 01, 2024 pm 02:11 PM

キャラクターを統一し、シーンを変更する、ビデオ生成アーティファクトである PixVerse がネチズンによって実行され、その超一貫性は「必殺技」となっています。

Apr 01, 2024 pm 02:11 PM

もう一度ダブルクリックすると、新しい機能がデビューします。写真の中の人物の背景を変更したいと思ったことはありますが、AI は常に「オブジェクトは人でも物でもない」ような効果を生み出します。 Midjourney や DALL・E などの成熟した生成ツールであっても、キャラクターの一貫性を維持するには、ある程度のプロンプト スキルが必要です。そうしないと、キャラクターがコロコロ変わり、望む結果が得られません。ただし、今回はチャンスです。 AIGC ツール PixVerse の新しい「Character-Video」機能は、これらすべてを実現するのに役立ちます。それだけでなく、キャラクターをより鮮やかにするダイナミックなビデオを生成することもできます。画像を入力すると、対応するダイナミックなビデオ結果を取得できます。キャラクターの一貫性を維持することに基づいて、豊富な背景要素とキャラクターのダイナミクスにより、生成された結果は

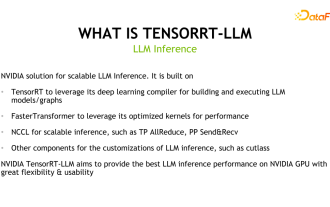

NVIDIA の大規模モデル推論フレームワークを明らかにする: TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

NVIDIA の大規模モデル推論フレームワークを明らかにする: TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

1. TensorRT-LLM の製品位置付け TensorRT-LLM は、NVIDIA が開発した大規模言語モデル (LLM) 向けのスケーラブルな推論ソリューションです。 TensorRT 深層学習コンパイル フレームワークに基づいて計算グラフを構築、コンパイル、実行し、FastTransformer の効率的なカーネル実装を利用します。さらに、デバイス間の通信には NCCL を利用します。開発者は、カットラスに基づいてカスタマイズされた GEMM を開発するなど、技術開発や需要の違いに基づいて特定のニーズを満たすためにオペレーターをカスタマイズできます。 TensorRT-LLM は、NVIDIA の公式推論ソリューションであり、高いパフォーマンスを提供し、実用性を継続的に向上させることに尽力しています。 TensorRT-LL

産業ナレッジグラフの高度な実践

Jun 13, 2024 am 11:59 AM

産業ナレッジグラフの高度な実践

Jun 13, 2024 am 11:59 AM

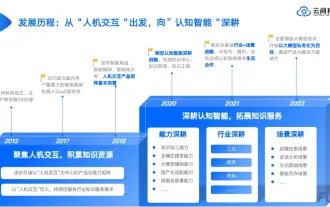

1. 背景の紹介 まず、Yunwen Technology の開発の歴史を紹介します。 Yunwen Technology Company ...2023 年は大規模モデルが普及する時期であり、多くの企業は大規模モデルの後、グラフの重要性が大幅に低下し、以前に検討されたプリセット情報システムはもはや重要ではないと考えています。しかし、RAG の推進とデータ ガバナンスの普及により、より効率的なデータ ガバナンスと高品質のデータが民営化された大規模モデルの有効性を向上させるための重要な前提条件であることがわかり、ますます多くの企業が注目し始めています。知識構築関連コンテンツへ。これにより、知識の構築と処理がより高いレベルに促進され、探索できる技術や方法が数多く存在します。新しいテクノロジーの出現によってすべての古いテクノロジーが打ち破られるわけではなく、新旧のテクノロジーが統合される可能性があることがわかります。

GPT-4をベンチマーク!中国移動の九天大型モデルが二重登録を通過

Apr 04, 2024 am 09:31 AM

GPT-4をベンチマーク!中国移動の九天大型モデルが二重登録を通過

Apr 04, 2024 am 09:31 AM

4月4日のニュースによると、中国サイバースペース局は最近、登録された大型モデルのリストを発表し、その中にチャイナモバイルの「九天自然言語インタラクション大型モデル」が含まれており、チャイナモバイルの九天AI大型モデルが生成人工言語を正式に提供できることを示した。外部世界への諜報機関。チャイナモバイルは、これは中央企業が開発した初めての大規模モデルであり、国家の「生成人工知能サービス登録」と「国内深層合成サービスアルゴリズム登録」の二重登録を通過したと述べた。報告によると、Juiutian の自然言語インタラクション大規模モデルは、強化された業界能力、セキュリティ、信頼性の特徴を持ち、フルスタック ローカリゼーションをサポートしており、90 億、139 億、570 億、1000 億などのさまざまなパラメータ バージョンを形成しており、クラウド、エッジ、エンドでは状況が異なりますが、柔軟に導入できます。

XiaomiフォトアルバムAIGC編集機能が正式リリース:インテリジェントな画像拡張と魔法除去Proをサポート

Mar 14, 2024 pm 10:22 PM

XiaomiフォトアルバムAIGC編集機能が正式リリース:インテリジェントな画像拡張と魔法除去Proをサポート

Mar 14, 2024 pm 10:22 PM

3月14日のニュースによると、Xiaomiは本日、XiaomiフォトアルバムのAIGC編集機能がXiaomi 14 Ultra携帯電話で正式に開始され、今年中にXiaomi 14、Xiaomi 14 Pro、Redmi K70シリーズの携帯電話で完全に開始されることを正式に発表しました。月。 AI大型モデルは、Xiaomiフォトアルバムに2つの新機能、インテリジェント画像拡張とマジックエリミネーションプロをもたらします。 AIスマート画像拡張機能は、合成が不十分な写真の拡張と自動合成をサポートします操作方法は、編集するフォトアルバムを開く - トリミングと回転を入力 - スマート画像拡張をクリックします。 Magic Elimination Pro は、観光写真から通行人をシームレスに排除できます。使用方法は次のとおりです: 編集するフォト アルバムを開き、Magic Elimination を入力し、右上隅の Pro をクリックします。現在、Xiaomi 14Ultra マシンは、インテリジェントな画像拡張と魔法除去 Pro 機能を開始しました。

新しいテストベンチマークがリリース、最も強力なオープンソースのLlama 3が困惑

Apr 23, 2024 pm 12:13 PM

新しいテストベンチマークがリリース、最も強力なオープンソースのLlama 3が困惑

Apr 23, 2024 pm 12:13 PM

テストの問題が簡単すぎると、上位の生徒も下位の生徒も 90 点を獲得でき、その差は広がりません。Claude3、Llama3、さらには GPT-5 などのより強力なモデルが後にリリースされるため、業界はより困難で差別化されたモデルのベンチマークが緊急に必要です。大型モデルアリーナの背後にある組織 LMSYS は、次世代ベンチマーク Arena-Hard を発表し、広く注目を集めました。 Llama3 命令の 2 つの微調整されたバージョンの強度に関する最新のリファレンスもあります。全員が同様のスコアを持っていた以前の MTBench と比較すると、アリーナとハードの識別は 22.6% から 87.4% に増加し、一目で強くも弱くもなりました。 Arena-Hard は、アリーナからのリアルタイムの人間データを使用して構築されており、人間の好みとの一致率は 89.1% です。