Intel Meteor Lake プロセッサーは NPU を統合し、PC に AI 時代をもたらします

インテルは本日、最新の Meteor Lake プロセッサーをリリースし、Meteor Lake の統合 NPU を詳しく紹介しました

Intel は、Al は人々の生活のあらゆる側面に浸透していると述べました。 Cloud Al はスケーラブルなコンピューティング機能を提供しますが、いくつかの制限があります。これはネットワーク接続に依存しており、待ち時間が長く、実装コストも高くなりますが、プライバシーの問題もあります。 MeteorLake はクライアントのパーソナル コンピュータに Al を導入し、低遅延の Al コンピューティング機能を提供し、より低コストでデータ プライバシーの保護を強化します

Intel は、MeteorLake から始めて、Al を PC に広く導入し、数億台の PC を Al 時代に導き、巨大な x86 エコシステムが幅広いソフトウェア モデルとツールを提供すると述べました。

Intel NPU アーキテクチャの詳細な説明を含む IT ホーム:

ホスト インターフェイスとデバイス管理 - デバイス管理領域では、Microsoft Computing Driver Model (MCDM) と呼ばれる Microsoft の新しいドライバー モデルがサポートされています。これにより、Meteor Lake の NPU はセキュリティを確保しながら優れた方法で MCDM をサポートできるようになり、メモリ管理ユニット (MMU) は複数のシナリオで分離を提供し、電力とワークロードのスケジューリングをサポートして、高速な低電力状態の変換を可能にします。

マルチエンジン アーキテクチャ - NPU は、単一のワークロードを共同で処理したり、それぞれが異なるワークロードを処理したりできる 2 つのニューラル コンピューティング エンジンを備えたマルチエンジン アーキテクチャで構成されています。 Neural Compute Engine には、2 つの主要なコンピューティング コンポーネントがあります。1 つは推論パイプラインです。これはエネルギー効率の高いコンピューティングのコア ドライバーであり、データの移動を最小限に抑え、固定関数の演算を活用することで、一般的な大規模な計算を処理します。タスクはエネルギー効率を達成できます。ニューラルネットワークの実行において。計算の大部分は、標準のニューラル ネットワーク操作をサポートする固定機能パイプライン ハードウェアである推論パイプラインで発生します。パイプラインは、積和演算 (MAC) アレイ、アクティベーション関数ブロック、およびデータ変換ブロックで構成されます。 2 つ目は SHAVEDSP です。これは、Al 向けに特別に設計された、高度に最適化された VLIW DSP (超長命令ワード/デジタル シグナル プロセッサ) です。ストリーミング ハイブリッド アーキテクチャ ベクトル エンジン (SHAVE) は、推論パイプラインとダイレクト メモリ アクセス (DMA) エンジンを使用してパイプライン化することができ、NPU 上で真のヘテロジニアス コンピューティングを並列実行してパフォーマンスを最大化できます。

DMA エンジンは、データの移動を最適化し、エネルギー効率のパフォーマンスを向上させるエンジンです。

元の意味を変えずに内容を書き換えます。書き換える必要がある言語は中国語であり、元の文は表示する必要はありません以上がIntel Meteor Lake プロセッサーは NPU を統合し、PC に AI 時代をもたらしますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7461

7461

15

15

1376

1376

52

52

77

77

11

11

17

17

17

17

カーソルAIでバイブコーディングを試してみましたが、驚くべきことです!

Mar 20, 2025 pm 03:34 PM

カーソルAIでバイブコーディングを試してみましたが、驚くべきことです!

Mar 20, 2025 pm 03:34 PM

バイブコーディングは、無限のコード行の代わりに自然言語を使用してアプリケーションを作成できるようにすることにより、ソフトウェア開発の世界を再構築しています。 Andrej Karpathyのような先見の明に触発されて、この革新的なアプローチは開発を許可します

2025年2月のトップ5 Genai発売:GPT-4.5、Grok-3など!

Mar 22, 2025 am 10:58 AM

2025年2月のトップ5 Genai発売:GPT-4.5、Grok-3など!

Mar 22, 2025 am 10:58 AM

2025年2月は、生成AIにとってさらにゲームを変える月であり、最も期待されるモデルのアップグレードと画期的な新機能のいくつかをもたらしました。 Xai’s Grok 3とAnthropic's Claude 3.7 SonnetからOpenaiのGまで

オブジェクト検出にYolo V12を使用する方法は?

Mar 22, 2025 am 11:07 AM

オブジェクト検出にYolo V12を使用する方法は?

Mar 22, 2025 am 11:07 AM

Yolo(あなたは一度だけ見ています)は、前のバージョンで各反復が改善され、主要なリアルタイムオブジェクト検出フレームワークでした。最新バージョンYolo V12は、精度を大幅に向上させる進歩を紹介します

ChatGpt 4 oは利用できますか?

Mar 28, 2025 pm 05:29 PM

ChatGpt 4 oは利用できますか?

Mar 28, 2025 pm 05:29 PM

CHATGPT 4は現在利用可能で広く使用されており、CHATGPT 3.5のような前任者と比較して、コンテキストを理解し、一貫した応答を生成することに大幅な改善を示しています。将来の開発には、よりパーソナライズされたインターが含まれる場合があります

Google' s Gencast:Gencast Mini Demoを使用した天気予報

Mar 16, 2025 pm 01:46 PM

Google' s Gencast:Gencast Mini Demoを使用した天気予報

Mar 16, 2025 pm 01:46 PM

Google Deepmind's Gencast:天気予報のための革新的なAI 天気予報は、初歩的な観察から洗練されたAI駆動の予測に移行する劇的な変化を受けました。 Google DeepmindのGencast、グラウンドブレイク

chatgptよりも優れたAIはどれですか?

Mar 18, 2025 pm 06:05 PM

chatgptよりも優れたAIはどれですか?

Mar 18, 2025 pm 06:05 PM

この記事では、Lamda、Llama、GrokのようなChatGptを超えるAIモデルについて説明し、正確性、理解、業界への影響における利点を強調しています(159文字)

O1対GPT-4O:OpenAIの新しいモデルはGPT-4Oよりも優れていますか?

Mar 16, 2025 am 11:47 AM

O1対GPT-4O:OpenAIの新しいモデルはGPT-4Oよりも優れていますか?

Mar 16, 2025 am 11:47 AM

OpenaiのO1:12日間の贈り物は、これまでで最も強力なモデルから始まります 12月の到着は、世界の一部の地域で雪片が世界的に減速し、雪片がもたらされますが、Openaiは始まったばかりです。 サム・アルトマンと彼のチームは12日間のギフトを立ち上げています

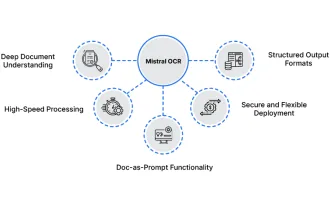

次のラグモデルにミストラルOCRを使用する方法

Mar 21, 2025 am 11:11 AM

次のラグモデルにミストラルOCRを使用する方法

Mar 21, 2025 am 11:11 AM

Mistral OCR:マルチモーダルドキュメントの理解により、検索された世代の革命を起こします 検索された生成(RAG)システムはAI機能を大幅に進めており、より多くの情報に基づいた応答のために膨大なデータストアにアクセスできるようになりました