MAmmoT を通じて、LLM は数学のジェネラリストになります: 形式論理から四則演算まで

数学的推論は、最新の大規模言語モデル (LLM) の重要な機能です。この分野における最近の進歩にもかかわらず、クローズド ソースとオープンソース LLM の間には依然として明らかなギャップがあります。 GPT-4、PaLM-2、Claude 2 などのクローズドソース モデルは、GSM8K や MATH などの一般的な数学的推論ベンチマークを支配していますが、Llama、Falcon、OPT などのオープンソース モデルはすべてのベンチマークで大幅に遅れをとっています

この問題を解決するために、研究コミュニティは 2 つの方向で懸命に取り組んでいます

(1) Gaoptica や MINERVA などの継続的な事前トレーニング手法LLM は、数学的に関連したネットワーク データに基づいて継続的にトレーニングされます。この方法では、モデルの一般的な科学的推論能力を向上させることができますが、計算コストが高くなります

拒絶サンプリング微調整 (RFT) および WizardMath などの特定のデータセット微調整方法つまり、特定のデータセット監視データを使用して LLM を微調整します。これらの方法は特定のドメイン内のパフォーマンスを向上させることができますが、データの微調整を超える広範な数学的推論タスクには一般化されません。たとえば、RFT と WizardMath は、GSM8K (そのうちの 1 つは微調整されたデータセット) では精度を 30% 以上向上させることができますが、MMLU-Math や AQuA などのドメイン外のデータセットでは精度が低下するため、精度が低くなります。最大 10%

最近、ウォータールー大学、オハイオ州立大学、その他の機関の研究チームは、軽量でありながら一般化可能な数学的命令の微調整方法を提案しました。 LLM の一般的な (つまり、微調整タスクに限定されない) 数学的推論機能。

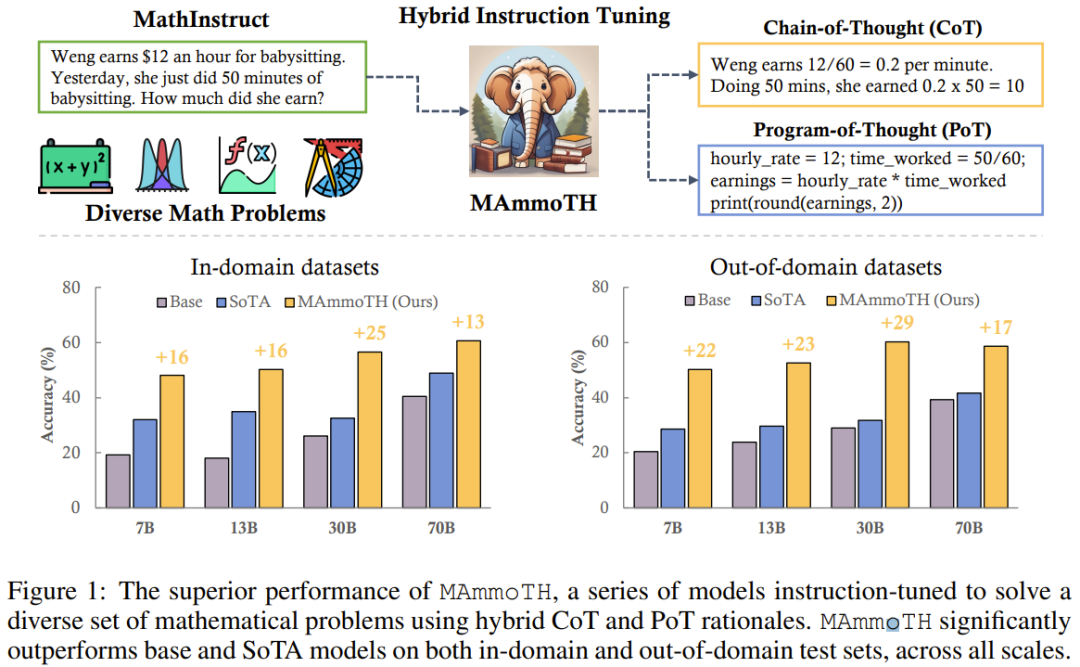

書き直された内容: 以前は、段階的な自然言語記述を通じて数学的問題を解決する思考連鎖 (CoT) 手法が主に焦点となっていました。この方法は非常に一般的で、ほとんどの数学分野に適用できますが、計算精度や複雑な数学的またはアルゴリズム的推論プロセス (二次方程式の根を解く、行列の固有値を計算するなど) にいくつかの困難があります

#対照的に、Program of Thought (PoT) や PAL などのコード形式プロンプト設計手法では、外部ツール (つまり、Python インタプリタ) を使用して数学的解決プロセスを大幅に簡素化します。このアプローチは、計算プロセスを外部の Python インタプリタにオフロードして、複雑な数学的およびアルゴリズム的推論 (sympy を使用して二次方程式を解く、または numpy を使用して行列の固有値を計算するなど) を解決することです。ただし、PoT は、特に組み込み API がない場合、常識推論、形式論理、抽象代数などのより抽象的な推論シナリオに苦労します。

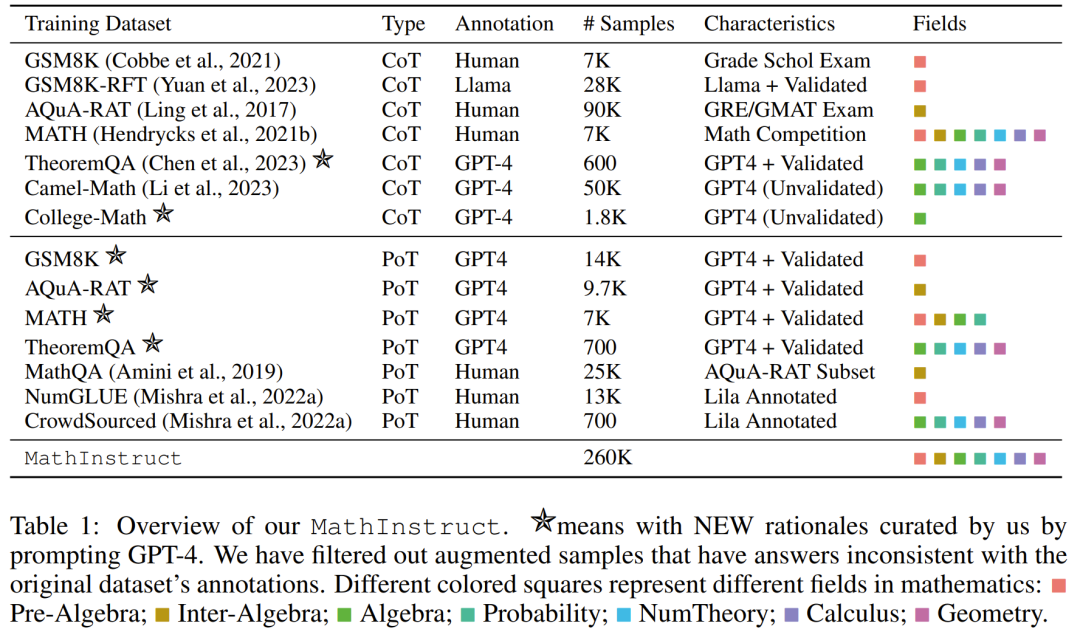

CoT メソッドと PoT メソッドの両方の利点を考慮するために、チームは新しい数学的ハイブリッド命令微調整データ セット MathInstruct を導入しました。これには 2 つの主な機能があります: ( 1) さまざまな数学分野と複雑さのレベルを幅広くカバーします。 (2) CoT 原則と PoT 原則の混合

MathInstruct 7 つの既存の数学原則データ セットと 6 つの新しくコンパイルされたデータ セットに基づいています。彼らは MathInstruct を使用して、さまざまなサイズ (7B から 70B) の Llama モデルを微調整しました。彼らは、結果として得られたモデルを MAmmoTH モデルと呼び、MAmmoTH が数学的ジェネラリストのような前例のない機能を備えていることを発見しました。

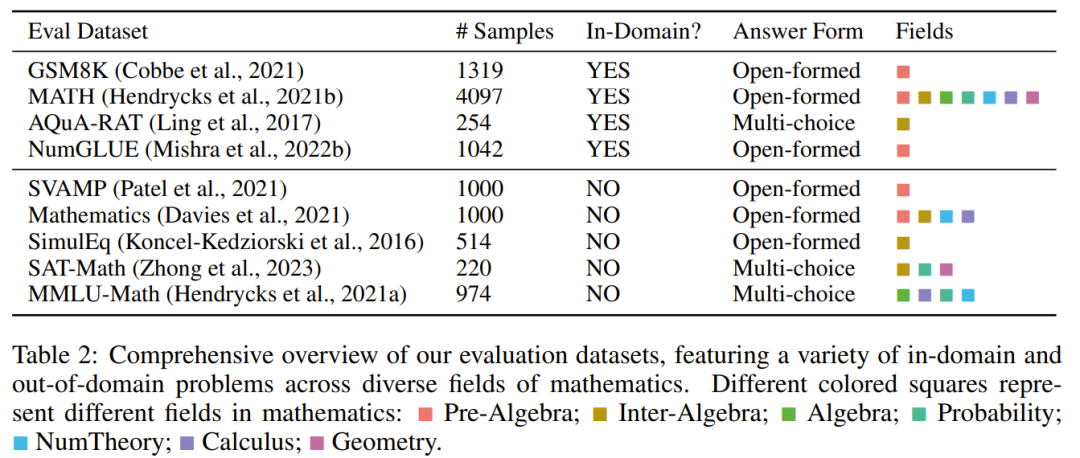

MAmmoTH を評価するために、研究チームはドメイン内テスト セット ( GSM8K、MATH、AQuA-RAT、NumGLUE) およびドメイン外のテスト セット (SVAMP、SAT、MMLU-Math、Mathematics、SimulEq)

研究結果は、MAmmoTH モデルが一般化すると、フィールド外のデータセットでのパフォーマンスが向上し、数学的推論におけるオープンソース LLM の能力も大幅に向上します

一般的に使用される競争においては、注目に値します。レベルの MATH データ セット、MAmmoTH 7B バージョンは、WizardMath (MATH における以前の最高のオープン ソース モデル) を 3.5 倍 (35.2% 対 10.7%) 上回ることができ、一方、微調整された 34B MAmmoTH-Coder は GPT-4 をも上回ることができます。 CoT を使用

この研究の貢献は 2 つの側面に要約できます: (1) データ エンジニアリングの観点から、高品質の数学的命令の微調整データ セットを提案しました。さまざまな数学の問題と混合原理が含まれています。 (2) モデリングの面では、さまざまなデータ ソースと入出力形式の影響を調査するために、7B から 70B までのサイズの 50 を超える異なる新しいモデルとベースライン モデルをトレーニングおよび評価しました

#研究結果によると、MAmmoTH や MAmmoTH-Coder などの新しいモデルは、精度の点で以前のオープンソース モデルを大幅に上回っています

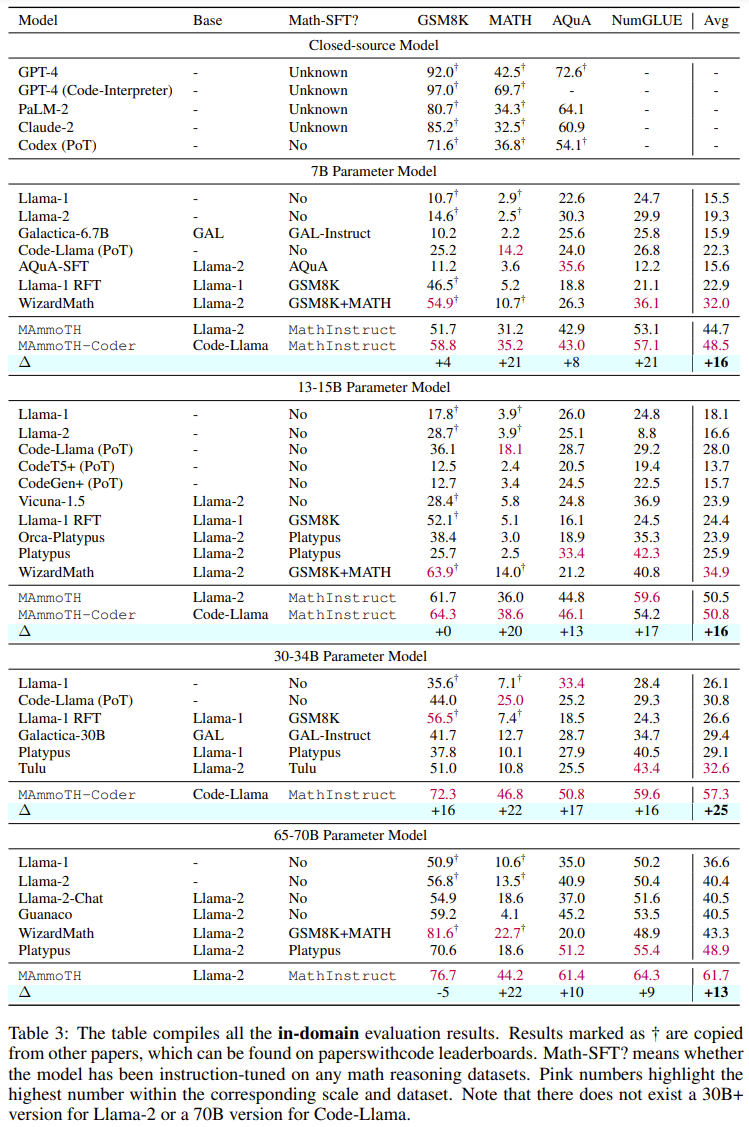

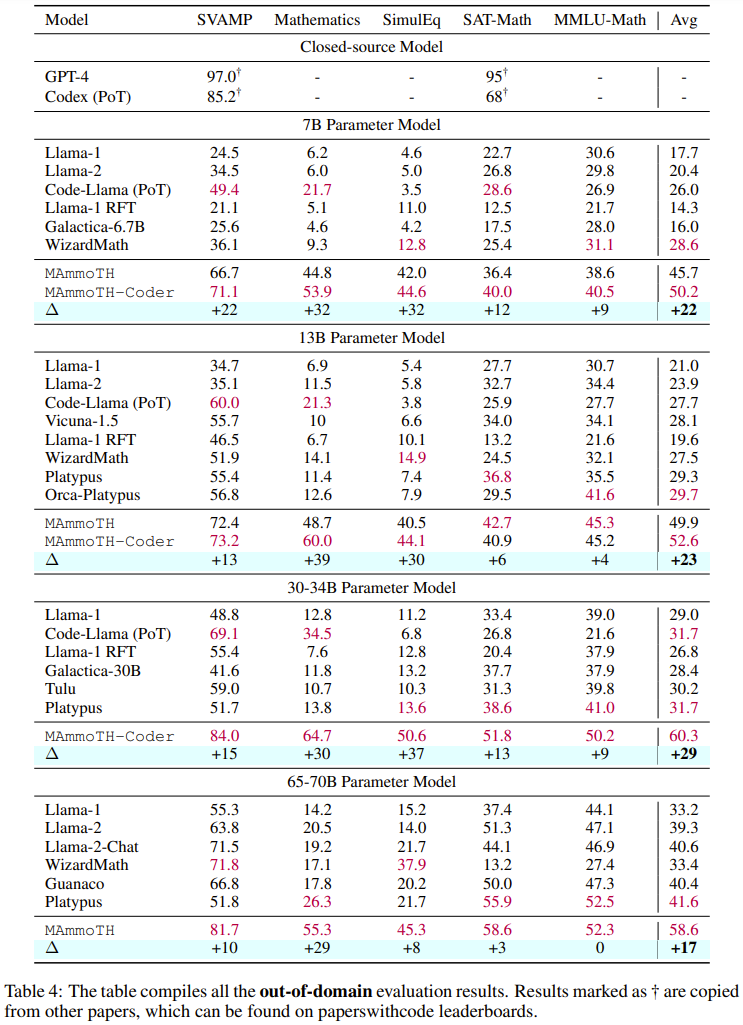

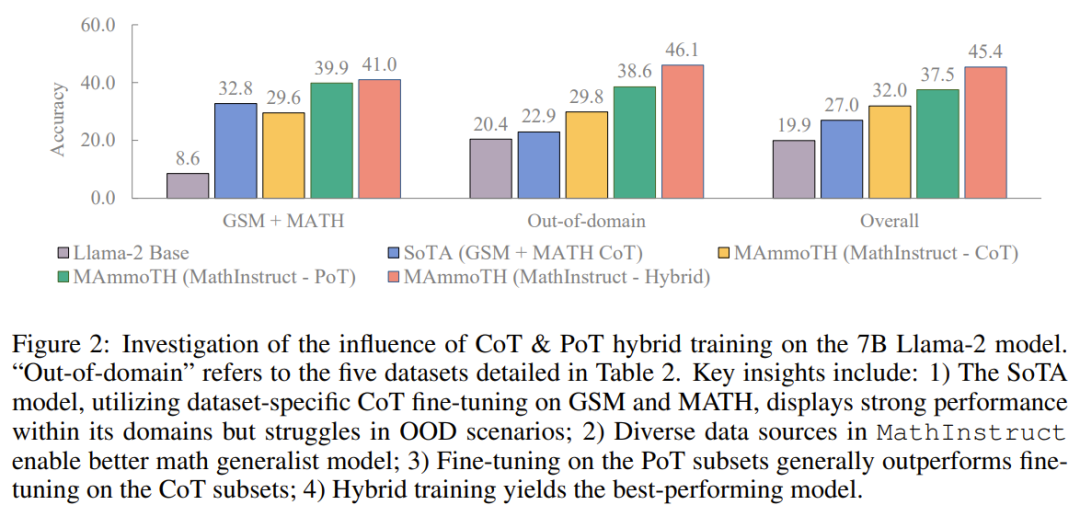

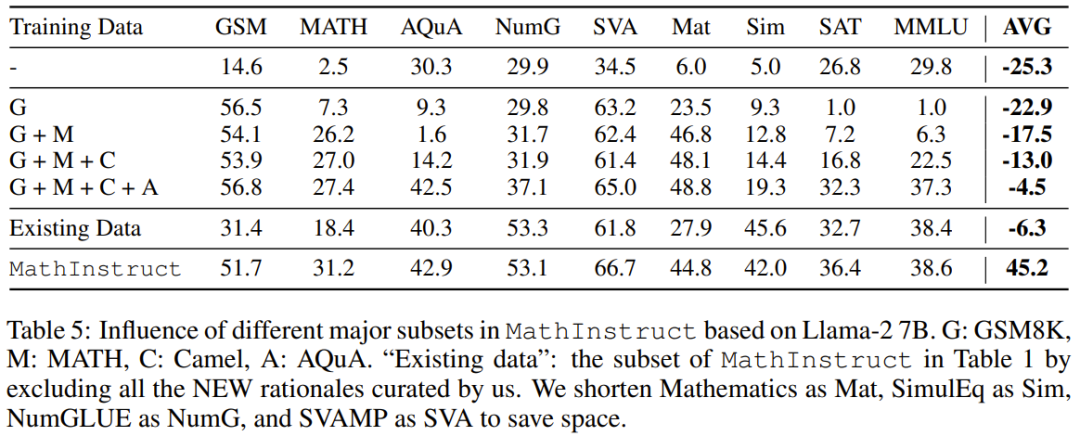

チームは、コンパイルしたデータセットをリリースし、新しいメソッドのコードをオープンソース化し、Hugging Face モデルでトレーニングされたさまざまなサイズをリリースしました 多様なハイブリッド命令微調整データセットを再構成 チームの目標は、高品質で多様な数学的命令微調整データセットのリストを編集することです。このデータセットには、(1) さまざまな数学的領域と複雑さを幅広くカバーすること、(2) CoT と PoT 原則を組み合わせるという 2 つの主な特徴があるはずです。 最初の特徴として、研究者らはまず、GSM8K、MATH、AQuA、Camel、TheoremQA など、さまざまな数学分野と複雑さのレベルを含む、広く使用されている高品質のデータセットをいくつか選択しました。その後、彼らは、抽象代数や形式論理などの大学レベルの数学が既存のデータセットに欠けていることに気づきました。この問題を解決するために、オンラインで見つかった少数のシード例を使用し、GPT-4 を使用して TheoremQA の質問の CoT 原則を合成し、自発的な方法で「質問と CoT」のペアを作成しました 2 番目の機能では、CoT と PoT の原則を組み合わせることでデータセットの汎用性が向上し、トレーニングされたモデルがさまざまなタイプの数学的問題を解決できるようになります。ただし、既存のデータセットのほとんどは手続き上の根拠が限られており、その結果、CoT 原則と PoT 原則の間に不均衡が生じています。この目的を達成するために、チームは GPT-4 を使用して、MATH、AQuA、GSM8K、TheoremQA などの選択されたデータセットの PoT 原則を補足しました。これらの GPT-4 合成プログラムは、その実行結果と人間が注釈を付けたグラウンド トゥルースとを比較することによってフィルタリングされ、高品質の原則のみが追加されることが保証されます。 これらのガイドラインに従って、以下の表 1 に示すように、新しいデータ セット MathInstruct を作成しました。 幅広い中心的な数学領域 (算術、代数、確率、微積分、幾何学など) をカバーする 260,000 のペア (コマンド、応答) が含まれています。 、CoT と PoT の原則が混在しており、さまざまな言語と難易度があります。 トレーニングのリセット MathInstruct のすべてのサブセットは、Alpaca のような命令データ セット構造に統合されました。この標準化操作により、元のデータ セットの形式に関係なく、微調整されたモデルが一貫してデータを処理できることが保証されます。 ベース モデルとして、チームは Llama-2 と Code を選択しました。ラマ MathInstruct を調整することで、7B、13B、34B、70B などのさまざまなサイズのモデルを取得しました 評価データセット モデルの数学的推論能力を評価するために、チームはいくつかの評価データ セットを選択しました。以下の表 2 を参照してください。数学のいくつかの異なる領域をカバーする、さまざまなフィールド内およびフィールド外のサンプルが含まれています。 #評価データ セットには、初等、中等、大学レベルなど、さまざまな難易度が含まれています。一部のデータセットには、形式論理と常識的推論も含まれています 選択された評価データセットには、自由回答式質問と多肢選択式質問の両方が含まれています。 オープンエンド問題 (GSM8K や MATH など) については、これらの問題のほとんどがプログラムで解決できるため、研究者は PoT デコードを採用しました。 , 多肢選択式の質問 (AQuA や MMLU など) については、このデータセット内のほとんどの質問は CoT でより適切に処理できるため、研究者らは CoT デコーディングを採用しました。 CoT デコードにはトリガー ワードは必要ありませんが、PoT デコードには「問題を解決するプログラムを作成しましょう」というトリガー ワードが必要です。 主な結果 以下の表 3 と 4 は、それぞれドメイン内とドメイン外のデータに関する結果を報告しています。 全体的に、MAmmoTH と MAmmoTH-Coder はどちらも、さまざまなモデル サイズにわたって、これまでの最高のモデルよりも優れたパフォーマンスを示しています。新しいモデルは、ドメイン内データセットよりもドメイン外データセットでパフォーマンスの向上を実現します。これらの結果は、新しいモデルが数学的ジェネラリストになる可能性を確かに持っていることを示しています。 MAmmoTH-Coder-34B と MAmmoTH-70B は、一部のデータセットではクローズドソース LLM よりも優れたパフォーマンスを発揮します。 研究者らは、さまざまな基本モデルを使用して比較も行いました。具体的には、Llama-2 と Code-Llama という 2 つの基本モデルを比較する実験を実施しました。上の 2 つの表からわかるように、Code-Llama は全体的に Llama-2 よりも優れており、特にフィールド外のデータ セットにおいて優れています。 MAmmoTH と MAmmoTH-Coder の間のギャップは 5% に達することもあります データ ソースに関するアブレーション研究の調査 ##彼らは、パフォーマンス向上の原因を探るための研究を実施しました。既存のベンチマーク モデルに対する MAmmoTH の利点の根源をより深く理解するために、研究者らは一連の対照実験を実施しました。結果は図 2 # に示されています。 ##要約すると、MAmmoTH のパフォーマンスの大きな利点は、1) さまざまな数学的領域と複雑さのレベルをカバーする多様なデータ ソース、2) CoT と PoT 命令の微調整のハイブリッド戦略に起因すると考えられます。 彼らは、主要なサブセットの影響も研究しました。 MAmmoTH のトレーニングに使用される MathInstruct のさまざまなソースに関しては、各ソースがモデルの全体的なパフォーマンスにどの程度寄与しているかを理解することも重要です。彼らは、GSM8K、MATH、Camel、AQuA の 4 つの主要なサブセットに焦点を当てています。彼らは、各データセットをトレーニングに徐々に追加し、MathInstruct 全体で微調整されたモデルとパフォーマンスを比較する実験を実施しました。 MAmmoTH に対する多様なデータ ソースの重要な影響は次のとおりです。結果で強調表示されているのは、MAmmoTH を数学的ジェネラリストにするための中心的な鍵です。これらの結果は、常に多様なデータを収集し、特定の種類のデータのみを収集することを避ける必要があるなど、今後のデータのキュレーションと収集の取り組みに対する貴重な洞察と指針も提供します。

新たに提案する手法

実験

以上がMAmmoT を通じて、LLM は数学のジェネラリストになります: 形式論理から四則演算までの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7500

7500

15

15

1377

1377

52

52

78

78

11

11

19

19

54

54

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhone のモバイル データ接続に遅延や遅い問題が発生していませんか?通常、携帯電話の携帯インターネットの強度は、地域、携帯ネットワークの種類、ローミングの種類などのいくつかの要因によって異なります。より高速で信頼性の高いセルラー インターネット接続を実現するためにできることがいくつかあります。解決策 1 – iPhone を強制的に再起動する 場合によっては、デバイスを強制的に再起動すると、携帯電話接続を含む多くの機能がリセットされるだけです。ステップ 1 – 音量を上げるキーを 1 回押して放します。次に、音量小キーを押して、もう一度放します。ステップ 2 – プロセスの次の部分は、右側のボタンを押し続けることです。 iPhone の再起動が完了するまで待ちます。セルラーデータを有効にし、ネットワーク速度を確認します。もう一度確認してください 修正 2 – データ モードを変更する 5G はより優れたネットワーク速度を提供しますが、信号が弱い場合はより適切に機能します

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

アメリカ空軍が初のAI戦闘機を公開し注目を集める!大臣はプロセス全体を通じて干渉することなく個人的にテストを実施し、10万行のコードが21回にわたってテストされました。

May 07, 2024 pm 05:00 PM

アメリカ空軍が初のAI戦闘機を公開し注目を集める!大臣はプロセス全体を通じて干渉することなく個人的にテストを実施し、10万行のコードが21回にわたってテストされました。

May 07, 2024 pm 05:00 PM

最近、軍事界は、米軍戦闘機が AI を使用して完全自動空戦を完了できるようになったというニュースに圧倒されました。そう、つい最近、米軍のAI戦闘機が初めて公開され、その謎が明らかになりました。この戦闘機の正式名称は可変安定性飛行シミュレーター試験機(VISTA)で、アメリカ空軍長官が自ら飛行させ、一対一の空戦をシミュレートした。 5 月 2 日、フランク ケンダル米国空軍長官は X-62AVISTA でエドワーズ空軍基地を離陸しました。1 時間の飛行中、すべての飛行動作が AI によって自律的に完了されたことに注目してください。ケンダル氏は「過去数十年にわたり、私たちは自律型空対空戦闘の無限の可能性について考えてきたが、それは常に手の届かないものだと思われてきた」と語った。しかし今では、