テキスト意味理解技術における意味関係認識の問題

テキスト意味理解テクノロジーにおける意味関係の識別の問題には、特定のコード例が必要です

人工知能テクノロジーの継続的な開発により、テキスト意味理解が重要な要素となっています自然言語処理の分野で重要な役割を果たします。意味関係の認識は重要な問題の 1 つです。この記事では、意味関係認識の課題と深層学習ベースのソリューションを検討し、具体的なコード例を示します。

意味的関係の特定は、テキスト理解における重要なリンクの 1 つです。これには、「人物の関係」、「時間の関係」、「場所の関係」など、テキスト内のエンティティ間の関係の種類を特定することが含まれます。 、など。意味関係を正確に識別することで、質問と回答システム、情報抽出などの後続のテキスト分析タスクに基本的なサポートを提供できます。

しかし、意味関係の認識には一連の課題があります。まず第一に、意味関係自体は多様かつ複雑であり、異なるエンティティ間には複数の関係タイプが存在する可能性があり、「リー・ミンはメアリーの友人である」や「メアリーとリー・ミンは」など、同じ関係タイプでも異なる表現が存在する場合があります。 「友達」も同じ関係を意味します。第 2 に、意味関係を特定するには、文の意味を深く理解する必要があり、これは従来のルールベースまたは統計的手法では困難です。したがって、ディープラーニングに基づく解決策を模索することは効果的なアプローチです。

意味関係認識の問題を解決するには、単語ベクトル表現とニューラル ネットワーク モデルを組み合わせた深層学習ベースの手法を使用できます。以下は、畳み込みニューラル ネットワーク (CNN) に基づくコード例です。

import torch

import torch.nn as nn

import torch.nn.functional as F

class RelationClassifier(nn.Module):

def __init__(self, embedding_dim, num_classes):

super(RelationClassifier, self).__init__()

self.embedding_dim = embedding_dim

self.num_classes = num_classes

self.embedding = nn.Embedding(vocab_size, embedding_dim)

self.conv = nn.Conv1d(embedding_dim, 256, kernel_size=3, padding=1)

self.fc = nn.Linear(256, num_classes)

def forward(self, x):

embedded = self.embedding(x)

embedded = embedded.permute(0, 2, 1)

conv_out = F.relu(self.conv(embedded))

pooled = F.max_pool1d(conv_out, conv_out.size(2))

flattened = pooled.view(pooled.size(0), -1)

output = self.fc(flattened)

return output

# 定义模型超参数

embedding_dim = 100

num_classes = 10

vocab_size = 10000

# 初始化模型

model = RelationClassifier(embedding_dim, num_classes)

# 加载训练数据,数据格式示例:

# texts = ['李明是玛丽的朋友', '玛丽和李明是朋友']

# labels = [1, 1]

train_data = load_data()

# 定义损失函数和优化器

criterion = nn.CrossEntropyLoss()

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

# 开始训练

for epoch in range(num_epochs):

total_loss = 0

for texts, labels in train_data:

optimizer.zero_grad()

inputs = preprocess(texts)

outputs = model(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

total_loss += loss.item()

print('Epoch {}, Loss: {}'.format(epoch, total_loss))上記のコード例では、最初に、埋め込み層 (embedding)、畳み込み層を含む畳み込みニューラル ネットワークに基づくモデルを定義します。そして全結合層。次に、トレーニング データをロードし、損失関数とオプティマイザーを定義しました。次に、トレーニング データを使用してモデルをトレーニングし、損失関数とオプティマイザーに基づいてパラメーターを更新します。最後に、各エポックのトレーニング損失を出力します。

上記のコード例は単なるデモンストレーションにすぎず、実際のアプリケーションでは、データと実際のタスクに基づいて、より複雑なモデル設計とトレーニング プロセスが必要になる場合があります。

要約すると、意味関係認識はテキスト意味理解技術における重要な問題です。意味関係認識の問題は、畳み込みニューラル ネットワークなどの深層学習に基づく方法を通じて効果的に解決できます。この記事では、深層学習に基づいたコード例を示し、読者が関連テクノロジーを理解して適用する際に役立つことを願っています。

以上がテキスト意味理解技術における意味関係認識の問題の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1675

1675

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

AGNOフレームワークを使用してマルチモーダルAIエージェントを構築する方法は?

Apr 23, 2025 am 11:30 AM

AGNOフレームワークを使用してマルチモーダルAIエージェントを構築する方法は?

Apr 23, 2025 am 11:30 AM

エージェントAIに取り組んでいる間、開発者は速度、柔軟性、リソース効率の間のトレードオフをナビゲートすることがよくあります。私はエージェントAIフレームワークを探索していて、Agnoに出会いました(以前はPhi-でした。

OpenaiはGPT-4.1でフォーカスをシフトし、コーディングとコスト効率を優先します

Apr 16, 2025 am 11:37 AM

OpenaiはGPT-4.1でフォーカスをシフトし、コーディングとコスト効率を優先します

Apr 16, 2025 am 11:37 AM

このリリースには、GPT-4.1、GPT-4.1 MINI、およびGPT-4.1 NANOの3つの異なるモデルが含まれており、大規模な言語モデルのランドスケープ内のタスク固有の最適化への動きを示しています。これらのモデルは、ようなユーザー向けインターフェイスをすぐに置き換えません

SQLに列を追加する方法は? - 分析Vidhya

Apr 17, 2025 am 11:43 AM

SQLに列を追加する方法は? - 分析Vidhya

Apr 17, 2025 am 11:43 AM

SQLの変更テーブルステートメント:データベースに列を動的に追加する データ管理では、SQLの適応性が重要です。 その場でデータベース構造を調整する必要がありますか? Alter Tableステートメントはあなたの解決策です。このガイドの詳細は、コルを追加します

Andrew Ngによる埋め込みモデルに関する新しいショートコース

Apr 15, 2025 am 11:32 AM

Andrew Ngによる埋め込みモデルに関する新しいショートコース

Apr 15, 2025 am 11:32 AM

埋め込みモデルのパワーのロックを解除する:Andrew Ngの新しいコースに深く飛び込む マシンがあなたの質問を完全に正確に理解し、応答する未来を想像してください。 これはサイエンスフィクションではありません。 AIの進歩のおかげで、それはRになりつつあります

Rocketpyを使用したロケットの起動シミュレーションと分析-AnalyticsVidhya

Apr 19, 2025 am 11:12 AM

Rocketpyを使用したロケットの起動シミュレーションと分析-AnalyticsVidhya

Apr 19, 2025 am 11:12 AM

Rocketpy:A包括的なガイドでロケット発売をシミュレートします この記事では、強力なPythonライブラリであるRocketpyを使用して、高出力ロケット発売をシミュレートすることをガイドします。 ロケットコンポーネントの定義からシミュラの分析まで、すべてをカバーします

Googleは、次の2025年にクラウドで最も包括的なエージェント戦略を発表します

Apr 15, 2025 am 11:14 AM

Googleは、次の2025年にクラウドで最も包括的なエージェント戦略を発表します

Apr 15, 2025 am 11:14 AM

GoogleのAI戦略の基礎としてのGemini Geminiは、GoogleのAIエージェント戦略の基礎であり、高度なマルチモーダル機能を活用して、テキスト、画像、オーディオ、ビデオ、コード全体で応答を処理および生成します。 DeepMによって開発されました

3D自分で印刷できるオープンソースのヒューマノイドロボット:抱きしめる顔を購入する花粉ロボット工学

Apr 15, 2025 am 11:25 AM

3D自分で印刷できるオープンソースのヒューマノイドロボット:抱きしめる顔を購入する花粉ロボット工学

Apr 15, 2025 am 11:25 AM

「オープンソースロボットを世界に持ち込むために花粉ロボットを獲得していることを発表して非常にうれしいです」と、Facing FaceはXで述べました。

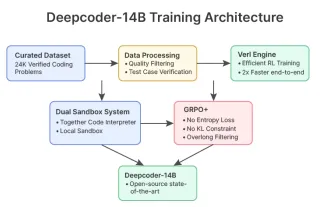

DeepCoder-14B:O3-MINIおよびO1へのオープンソース競争

Apr 26, 2025 am 09:07 AM

DeepCoder-14B:O3-MINIおよびO1へのオープンソース競争

Apr 26, 2025 am 09:07 AM

AIコミュニティの重要な開発において、Agenticaと一緒にAIは、DeepCoder-14Bという名前のオープンソースAIコーディングモデルをリリースしました。 Openaiのようなクローズドソースの競合他社と同等のコード生成機能を提供する