ASUSは上流のチップメーカーと協力してAIチップの新しいエコシステムを推進し、スマートターミナルテクノロジーの革新をリードします

最近、「Insight 2024 第 7 回中国エンタープライズサービス年次会議」では、有名なメーカー、革新的な企業、典型的な業界ユーザーの代表者が会場に集まり、人工知能の新たな機会を掴み、デジタルの波に対応する方法について議論しました。要求します。会合では、ASUSの華北事業責任者Shi Qifei氏が「コンピューティングパワーの復活、AIチップの新たなエコシステムの構築」と題した基調講演を行った。彼は、大型モデルの人気に伴い、スマート端末にも「エンドサイド」の大型モデルが登場し、新しいスマート エコシステムがもたらされると信じています

新しい AI 製品と新しいエコロジーに関して、Shi Qifei 氏は、ASUS は AMD などの上流メーカーと協力して AI チップ技術の新たな可能性を共同で探求し、将来の大規模コンピューティング環境での基本的なコンピューティング能力の向上に努めると述べました。業界の技術革新は強固な基盤を築き、インテリジェント端末製品の革新とアップグレードを保護し、促進し続けます

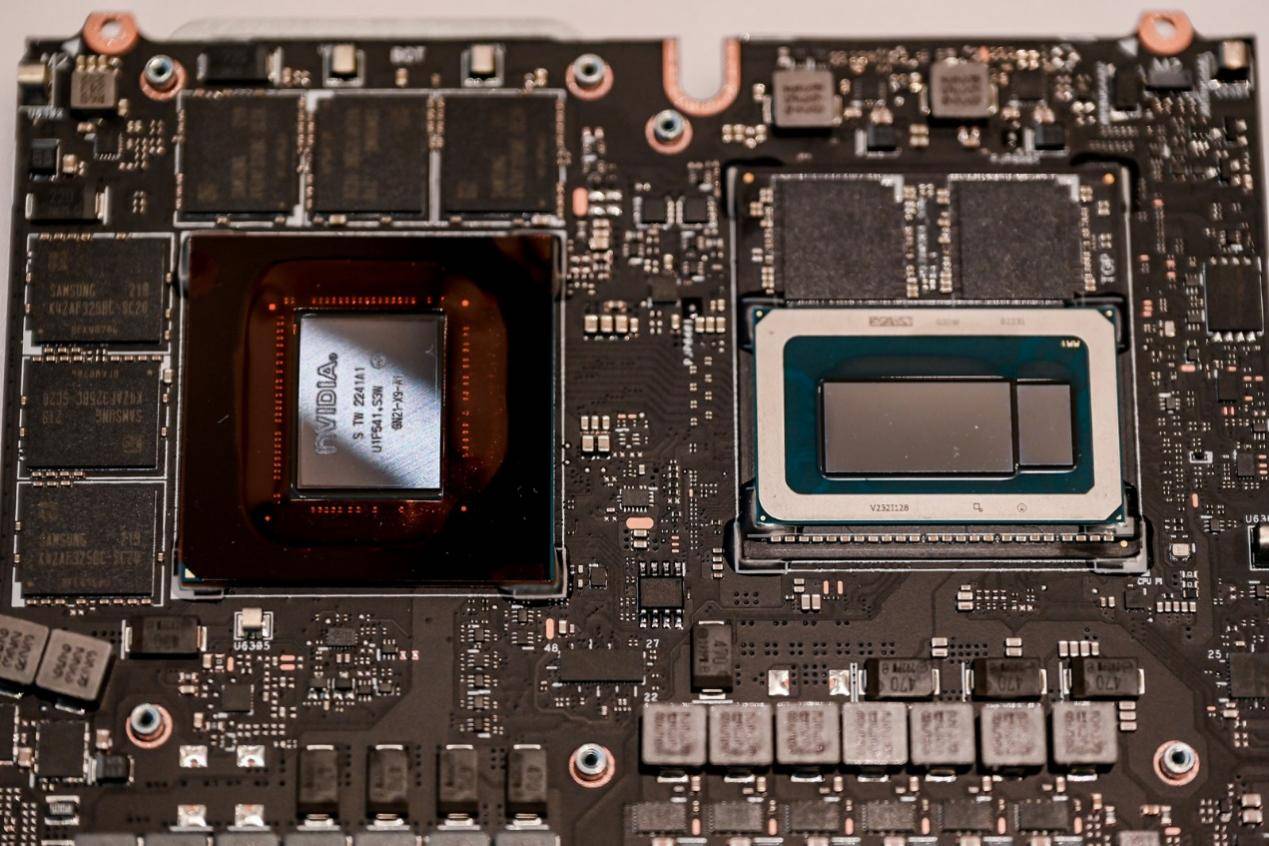

ASUSは近年、革新的な技術力を通じて薄型軽量ラップトップなどの最終製品の再定義に取り組んできましたが、これには根拠がありません。今年発売された多くの新製品の中で、最も目を引くのは薄型軽量ノートブック「ASUS AI」です。本製品は、AMD Ryzen 7 7940H モバイルプロセッサを搭載し、「CPU+GPU+AIエンジン」のスリーインワンアーキテクチャを採用し、X86プロセッサにRyzen AIエンジンを統合した初の製品となる。 Ryzen AI エンジンは AMD XDNA アーキテクチャを採用しており、ニューラル ネットワーク アルゴリズムに自然に適応するため、AI 推論がより柔軟かつ効率的になり、より強力なパフォーマンスが提供されます。将来的には、AI エンジンはより多くの AI アプリケーションにも適応し、ASUS ノートブックに AI の新時代が到来します。このカンファレンスでは、このプロセッサを搭載したASUS Fearless 16 2023が「2023 China Smart Terminal AI Innovation Pioneer Award」を受賞しました。これは、スマート端末製品に強力なAIコンピューティングパワーを提供するためのASUSと上流メーカーとの緊密な協力の縮図にすぎません。将来的には、より多くのASUSスマート端末がAIを搭載し、AIをサポートし、AIを使用することになります

ノートブック分野の革新的なパイオニアおよびリーダーとして、ASUS の新しいエコシステムの探求はこれをはるかに超えています。ユーザーの視覚体験を向上させるため、ASUSは早ければ2021年にも「ASUS Good Screen」戦略を率先して提案しました。すべての薄型軽量ノートブックにはOLED Good Screenが搭載され、ユーザーにユニークな視覚的楽しみを提供します。 ASUSは昨年、「OLEDノートブック市場でNo.1」、「クリエイティブノートブックの世界売上No.1」、「デュアルスクリーンノートブックの世界売上No.1」という三大栄誉を連続して獲得した。グッドスクリーン戦略の継続的な進歩により、より多くの消費者が「ASUS Good Screen」の素晴らしいパフォーマンスを視覚的なカラーで直接体験する機会を得ることができます

さらに、ASUS は、薄型軽量ノートブックではかなり避けられているパフォーマンスのテーマに関する技術革新において、そのハードパワーを示すことを決してやめませんでした。 2023年にASUSと上流メーカーが共同開発した「ASUS超高速システムモジュール」パッケージング技術をベースに、これまでにない最大185Wの消費電力を実現したLingyao X Ultraを発売しました。薄型軽量ノートでも、高性能ゲーミングノートでもハイエンドシリーズでしか実現できないことです。

ASUS は、将来の AI インテリジェント エコシステムの構築において重要な進歩を遂げ、その強固な基盤を築きました。 2024 年に、ASUS は ProArt、Lingyao、Fearless、Adou などの多数の新しい PC 製品を発売すると予想されています。これらの製品には新しい AI プロセッサーが搭載され、より優れた効率的な AI スマート エクスペリエンスをユーザーに提供します。上流メーカーであるAMDとの連携により、さまざまな分野やシナリオへのAI技術の応用をさらに推進していきます。 ASUSは、よりカラフルでスマートで便利なスマート端末製品を世界中のユーザーに提供し、端末デバイスへのAI実装にさらなる活力を注入することに尽力します

以上がASUSは上流のチップメーカーと協力してAIチップの新しいエコシステムを推進し、スマートターミナルテクノロジーの革新をリードしますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7643

7643

15

15

1392

1392

52

52

91

91

11

11

33

33

151

151

新しいタイトル: NVIDIA H200 リリース: HBM 容量が 76% 増加、大規模モデルのパフォーマンスが 90% 大幅に向上する最も強力な AI チップ

Nov 14, 2023 pm 03:21 PM

新しいタイトル: NVIDIA H200 リリース: HBM 容量が 76% 増加、大規模モデルのパフォーマンスが 90% 大幅に向上する最も強力な AI チップ

Nov 14, 2023 pm 03:21 PM

11月14日のニュースによると、Nvidiaは現地時間13日午前の「Supercomputing23」カンファレンスで新しいH200 GPUを正式に発表し、GH200製品ラインをアップデートしたとのことだが、このうちH200は依然として既存のHopper H100アーキテクチャをベースに構築されている。ただし、人工知能の開発と実装に必要な大規模なデータ セットをより適切に処理するために、より多くの高帯域幅メモリ (HBM3e) が追加され、大規模なモデルを実行する全体的なパフォーマンスが前世代の H100 と比較して 60% ~ 90% 向上しました。 。アップデートされた GH200 は、次世代の AI スーパーコンピューターにも搭載されます。 2024 年には、200 エクサフロップスを超える AI コンピューティング能力がオンラインになるでしょう。 H200

MediaTekはGoogleからサーバーAIチップの大量注文を獲得し、高速Serdesチップを供給すると噂されている

Jun 19, 2023 pm 08:23 PM

MediaTekはGoogleからサーバーAIチップの大量注文を獲得し、高速Serdesチップを供給すると噂されている

Jun 19, 2023 pm 08:23 PM

6月19日の台湾メディアの報道によると、Google(グーグル)は、最新のサーバー向けAIチップの開発に向けてMediaTekに協力を打診し、ファウンドリ用のTSMCの5nmプロセスに引き渡す計画であるとのこと。来年初めに量産する予定。レポートによると、情報筋は、GoogleとMediaTekの今回の協力により、MediaTekにシリアライザおよびデシリアライザ(SerDes)ソリューションが提供され、Googleが自社開発したテンソルプロセッサ(TPU)の統合を支援して、Googleが最新のサーバーAIチップをより強力に作成できるよう支援することを明らかにしました。 CPU や GPU アーキテクチャよりも優れています。業界は、Google の現在のサービスの多くは AI に関連していると指摘しており、Google は何年も前にディープ ラーニング テクノロジーに投資しており、AI の計算を実行するのに GPU を使用するとコストが非常に高いことが判明しました。

AI における次の大きな要素: NVIDIA B100 チップと OpenAI GPT-5 モデルのピーク パフォーマンス

Nov 18, 2023 pm 03:39 PM

AI における次の大きな要素: NVIDIA B100 チップと OpenAI GPT-5 モデルのピーク パフォーマンス

Nov 18, 2023 pm 03:39 PM

世界で最も強力な AI チップとして知られる NVIDIA H200 のデビュー後、業界は NVIDIA のより強力な B100 チップに期待し始めました。同時に、今年最も人気のある AI スタートアップ企業である OpenAI も動き始めました。より強力で複雑な GPT-5 モデルを開発します。 Guotai Junan氏は最新の調査報告書の中で、無限の性能を備えたB100とGPT5が2024年にリリースされる予定であり、メジャーアップグレードにより前例のない生産性が解放される可能性があると指摘した。同庁は、AIが急速な発展期に入り、その認知度は2024年まで続くだろうと楽観的であると述べた。前世代の製品と比較して、B100 と GPT-5 はどの程度強力ですか? NVIDIA と OpenAI はすでにプレビューを行っています: B100 は H100 より 4 倍以上高速になる可能性があり、GPT-5 は超高速を達成する可能性があります

Kneron が最新の AI チップ KL730 を発表、軽量 GPT ソリューションの大規模アプリケーションを推進

Aug 17, 2023 pm 01:37 PM

Kneron が最新の AI チップ KL730 を発表、軽量 GPT ソリューションの大規模アプリケーションを推進

Aug 17, 2023 pm 01:37 PM

KL730 のエネルギー効率の向上により、人工知能モデルの実装における最大のボトルネックであるエネルギーコストが解決されました。KL730 チップは、業界および以前の Nerner チップと比較して、最先端の機能をサポートしています。 nanoGPT などの軽量 GPT 大規模言語モデルを実現し、毎秒 0.35 ~ 4 テラの効率的な計算能力を提供します。AI 企業の Kneron は本日、自動車グレードの NPU と画像信号処理 (ISP) を統合した KL730 チップのリリースを発表しました。安全で低エネルギーの AI を実現 この機能は、エッジ サーバー、スマート ホーム、自動車支援運転システムなどのさまざまなアプリケーション シナリオで活用されます。サンディエゴに本拠を置く Kneron は、画期的なニューラル プロセッシング ユニット (NPU) で知られており、その最新チップ KL730 は次のことを目指しています。

NVIDIA が新しい AI チップ H200 を発表、パフォーマンスが 90% 向上!中国のコンピューティング能力が独自の躍進を達成!

Nov 14, 2023 pm 05:37 PM

NVIDIA が新しい AI チップ H200 を発表、パフォーマンスが 90% 向上!中国のコンピューティング能力が独自の躍進を達成!

Nov 14, 2023 pm 05:37 PM

世界は依然として NVIDIA H100 チップに夢中であり、AI コンピューティング能力に対する需要の高まりに応えるために狂ったように購入していますが、NVIDIA は現地時間の月曜日、他の大規模 AI モデルと比較してトレーニングに使用される最新の AI チップ H200 を静かに発売しました。前世代製品H100、H200と比べて性能が約60%~90%向上しました。 H200 は Nvidia H100 のアップグレード バージョンであり、H100 と同様にホッパー アーキテクチャに基づいており、主なアップグレードには 141 GB の HBM3e ビデオ メモリが含まれており、ビデオ メモリの帯域幅は H100 の 3.35 TB/s から 4.8 TB/s に増加しています。 Nvidia の公式 Web サイトによると、H200 は HBM3e メモリを使用する同社初のチップでもあり、このメモリはより高速で大容量であるため、大規模な言語に適しています。

Kneron が最新 AI チップ KL730 の発売を発表

Aug 17, 2023 am 10:09 AM

Kneron が最新 AI チップ KL730 の発売を発表

Aug 17, 2023 am 10:09 AM

元の言葉によると、次のように書き換えることができます: (Global TMT 2023年8月16日) サンディエゴに本社を置き、画期的なニューラル プロセッシング ユニット (NPU) で知られる AI 企業 Kneron は、KL730 チップのリリースを発表しました。このチップは車載グレードの NPU と画像信号処理 (ISP) を統合し、エッジ サーバー、スマート ホーム、自動車支援運転システムなどのさまざまなアプリケーション シナリオに安全で低エネルギーの AI 機能を提供します。エネルギー効率の点では、以前の Nerner チップと比較してエネルギー効率が 3 ~ 4 倍向上し、主要産業の同様の製品と比べて 150% ~ 200% 高くなります。このチップは毎秒 0.35 ~ 4 テラの実効計算能力を備え、最先端の軽量 GPT ラージをサポートできます。

AIチップは世界的に在庫切れです!

May 30, 2023 pm 09:53 PM

AIチップは世界的に在庫切れです!

May 30, 2023 pm 09:53 PM

Google の CEO は、AI 革命を人類の火の使用に例えましたが、現在、業界を活性化するデジタルの火、つまり AI チップを入手するのは困難です。 AI オペレーションを推進する新世代の高度なチップは、ほぼすべて NVIDIA によって製造されており、ChatGPT が爆発的に普及するにつれて、NVIDIA グラフィックス処理チップ (GPU) に対する市場の需要が供給をはるかに上回っています。チャットボットなどのAIモデル構築を支援する新興企業Laminiの共同創設者兼最高経営責任者(CEO)のシャロン・チョウ氏は、「不足しているため、鍵となるのは友人の輪だ」と述べ、「流行中のトイレットペーパーのようなものだ」と語った。このような状況により、Amazon や Microsoft などのクラウド サービス プロバイダーが ChatGPT の作成者である OpenAI などの顧客に提供できるコンピューティング パワーが制限されています。

マイクロソフトが独自のAIチップ「Athena」を開発中

Apr 25, 2023 pm 01:07 PM

マイクロソフトが独自のAIチップ「Athena」を開発中

Apr 25, 2023 pm 01:07 PM

Microsoft は、OpenAIChatGPT チャットボットを強化するような生成 AI モデルのトレーニングのコストを削減するために、AI に最適化されたチップを開発しています。 The Informationは最近、この件に詳しい2人の関係者の話として、Microsoftは少なくとも2019年からコードネーム「Athena」という新しいチップセットを開発していると伝えた。 Microsoft と OpenAI の従業員はすでに新しいチップにアクセスでき、GPT-4 などの大規模な言語モデルでチップのパフォーマンスをテストするために使用しています。大規模な言語モデルをトレーニングするには、AI が人間の会話を模倣するための新しい出力コンテンツを作成するために、大量のデータを取り込んで分析する必要があります。これは、生成 AI モデルの特徴です。数千)のA