北京大学の身体化された知性の新たな成果:トレーニング不要、指示に従えば柔軟に動ける

北京大学ドンハオチームエンボディドナビゲーション最新の結果はこちら:

追加のマッピングやトレーニングは必要なく、次のようなナビゲーションの指示を話すだけです:

部屋を横切って前に歩き、パンツの中を歩き、続いてキッチンに行きます。キッチンの端に立ってください。

ロボットが柔軟に動くように制御できます。

ここで、ロボットは、大規模なモデルで構成される「専門家チーム」と積極的にコミュニケーションをとり、コマンド分析、ビジョンを完了します。知覚、完了予測、意思決定テストなど、さまざまな視覚言語ナビゲーションの重要なタスク。

プロジェクトのホームページと論文は現在オンラインであり、コードは間もなくリリースされる予定です。ロボットは人間の指示に従って移動しますか?

視覚言語ナビゲーションには、指示分析、視覚認識、完了推定、意思決定テストなどの一連のサブタスクが含まれます。

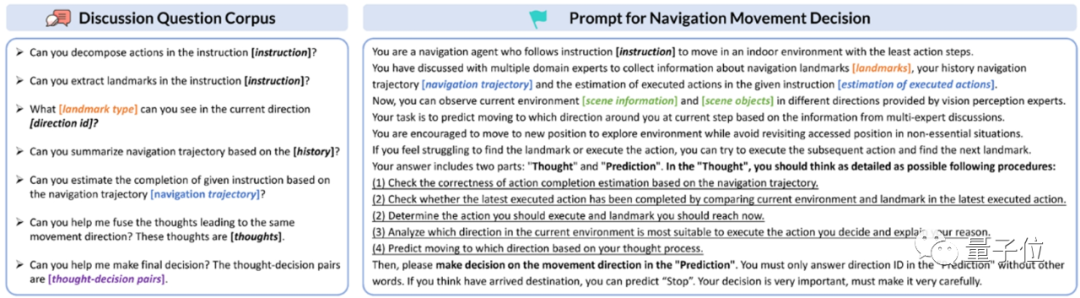

DiscussNav ナビゲーション システムを提案しました。 著者はまず専門家の役割と特定のタスクを LLM (大規模言語モデル) と MLM (マルチモーダル大規模モデル)

に迅速に割り当て、ドメイン知識を活性化します。これにより、さまざまな専門分野を持つビジュアル ナビゲーションの専門家のチームが構築されます。

その後、著者はディスカッション質問のコーパスとディスカッション メカニズムを設計しました。このメカニズムに従って、LLM によって駆動されるナビゲーション ロボットが能動的にディスカッションを開始できます。一連の視覚的インタラクション、ナビゲーション専門家のディスカッション。

ナビゲーション ロボットは、移動する前に専門家と話し合い、必要なアクションや人間の指示オブジェクトの標識に記載されている内容を理解します。

ナビゲーション ロボットは、移動する前に専門家と話し合い、必要なアクションや人間の指示オブジェクトの標識に記載されている内容を理解します。

そして、これらのオブジェクトマークの種類に基づいて、周囲の環境を知覚し、指示完了状況を推定し、事前の動作判定を行う。

意思決定プロセス中、ナビゲーション ロボットは同時に N 個の独立した情報を生成します。予測結果が矛盾する場合、ロボットは意思決定に助けを求めます。テストの専門家がモバイルに関する最終的な決定を除外します。  このプロセスから、従来の方法と比較して、追加の事前トレーニングが必要であることがわかります。この方法は、大規模モデルの専門家と対話することで人間の指示に従ってロボットが動くように誘導し、 問題を直接解決しますロボットナビゲーショントレーニングデータの不足の問題

このプロセスから、従来の方法と比較して、追加の事前トレーニングが必要であることがわかります。この方法は、大規模モデルの専門家と対話することで人間の指示に従ってロボットが動くように誘導し、 問題を直接解決しますロボットナビゲーショントレーニングデータの不足の問題

さらに、この機能があるからこそ、ゼロサンプル機能も実現しており、上記の議論のプロセスに従う限り、さまざまなナビゲーション指示に従うことができます。

以下は、古典的なビジュアル言語ナビゲーション データ セット Room2Room での DiscussionNav のパフォーマンスです。

ご覧のとおり、これはすべてのゼロショット手法よりも大幅に高く、訓練された 2 つの手法

をも上回っています。 。

著者はさらに、Turtlebot4 モバイル ロボットで実際の屋内シーンのナビゲーション実験を実行しました。

実験を通じて、著者はさらに、DiscussNav が

4 つの強力な能力を生み出すことを発見しました。

:

1.「白いテーブルの上のロボットアーム」や「椅子の上のテディベア」などのオープンワールドオブジェクトを特定します。

2.「キッチン カウンター上の植物」や「テーブル上の紙パック」など、きめ細かいナビゲーション ランドマーク オブジェクトを特定します。

3. ディスカッション内の他の専門家が回答した誤った情報を修正します。たとえば、ロゴ抽出専門家は、ナビゲーション アクション シーケンスからナビゲーション ロゴを抽出する前に、誤って分解されたアクション シーケンスをチェックして修正します。

4. 一貫性のない動作の決定を排除する: たとえば、意思決定テストの専門家は、現在の環境情報に基づいて DiscussNav によって予測された複数の一貫性のない動作の決定から、最も合理的なものを最終的な動作の決定として選択できます。

「シミュレーションと大規模モデルの事前学習はフリーランチです」

責任著者の Dong Hao は、以前のレポートで、シミュレーション データと大規模モデルを効果的に使用して大量のデータから学習する方法を詳しく調査することを提案しました。事前知識は、将来の身体化知能研究の発展方向となります。

現在、データの規模と実環境の探索にかかる高額なコストによって制限されている身体化インテリジェンスの研究は、引き続きシミュレーション プラットフォームの実験とシミュレーション データのトレーニングに焦点を当てます。

大規模モデルにおける最近の進歩は、身体化された知能に新たな方向性をもたらしました。大規模モデルにおける言語の常識と物理世界の事前知識の適切な探索と利用は、身体化された知能の開発を促進します。

論文アドレス: https://arxiv.org/abs/2309.11382

以上が北京大学の身体化された知性の新たな成果:トレーニング不要、指示に従えば柔軟に動けるの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7447

7447

15

15

1374

1374

52

52

76

76

11

11

14

14

6

6

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

以前に書きましたが、今日は、深層学習テクノロジーが複雑な環境におけるビジョンベースの SLAM (同時ローカリゼーションとマッピング) のパフォーマンスをどのように向上させることができるかについて説明します。ここでは、深部特徴抽出と深度マッチング手法を組み合わせることで、低照度条件、動的照明、テクスチャの弱い領域、激しいセックスなどの困難なシナリオでの適応を改善するように設計された多用途のハイブリッド ビジュアル SLAM システムを紹介します。当社のシステムは、拡張単眼、ステレオ、単眼慣性、ステレオ慣性構成を含む複数のモードをサポートしています。さらに、他の研究にインスピレーションを与えるために、ビジュアル SLAM と深層学習手法を組み合わせる方法も分析します。公開データセットと自己サンプリングデータに関する広範な実験を通じて、測位精度と追跡堅牢性の点で SL-SLAM の優位性を実証しました。

二代目アメカ登場!彼は観客と流暢にコミュニケーションをとることができ、表情はよりリアルで、数十の言語を話すことができます。

Mar 04, 2024 am 09:10 AM

二代目アメカ登場!彼は観客と流暢にコミュニケーションをとることができ、表情はよりリアルで、数十の言語を話すことができます。

Mar 04, 2024 am 09:10 AM

人型ロボット「アメカ」が第二世代にバージョンアップ!最近、世界移動通信会議 MWC2024 に、世界最先端のロボット Ameca が再び登場しました。会場周辺ではアメカに多くの観客が集まった。 GPT-4 の恩恵により、Ameca はさまざまな問題にリアルタイムで対応できます。 「ダンスをしましょう。」感情があるかどうか尋ねると、アメカさんは非常に本物そっくりの一連の表情で答えました。ほんの数日前、Ameca を支援する英国のロボット企業である EngineeredArts は、チームの最新の開発結果をデモンストレーションしたばかりです。ビデオでは、ロボット Ameca は視覚機能を備えており、部屋全体と特定のオブジェクトを見て説明することができます。最も驚くべきことは、彼女は次のこともできるということです。

柔軟かつ高速な 5 本の指を備え、人間のタスクを自律的に完了する初のロボットが登場、大型モデルが仮想空間トレーニングをサポート

Mar 11, 2024 pm 12:10 PM

柔軟かつ高速な 5 本の指を備え、人間のタスクを自律的に完了する初のロボットが登場、大型モデルが仮想空間トレーニングをサポート

Mar 11, 2024 pm 12:10 PM

今週、OpenAI、Microsoft、Bezos、Nvidiaが投資するロボット企業FigureAIは、7億ドル近くの資金調達を受け、来年中に自立歩行できる人型ロボットを開発する計画であると発表した。そしてテスラのオプティマスプライムには繰り返し良い知らせが届いている。今年が人型ロボットが爆発的に普及する年になることを疑う人はいないだろう。カナダに拠点を置くロボット企業 SanctuaryAI は、最近新しい人型ロボット Phoenix をリリースしました。当局者らは、多くのタスクを人間と同じ速度で自律的に完了できると主張している。人間のスピードでタスクを自律的に完了できる世界初のロボットである Pheonix は、各オブジェクトを優しくつかみ、動かし、左右にエレガントに配置することができます。自律的に物体を識別できる

AI はどのようにロボットをより自律的で順応性のあるものにすることができるのでしょうか?

Jun 03, 2024 pm 07:18 PM

AI はどのようにロボットをより自律的で順応性のあるものにすることができるのでしょうか?

Jun 03, 2024 pm 07:18 PM

産業オートメーション技術の分野では、人工知能 (AI) と Nvidia という無視できない 2 つの最近のホットスポットがあります。元のコンテンツの意味を変更したり、コンテンツを微調整したり、コンテンツを書き換えたり、続行しないでください。「それだけでなく、Nvidia はオリジナルのグラフィックス プロセッシング ユニット (GPU) に限定されていないため、この 2 つは密接に関連しています。」このテクノロジーはデジタル ツインの分野にまで広がり、新たな AI テクノロジーと密接に関係しています。「最近、NVIDIA は、Aveva、Rockwell Automation、Siemens などの大手産業オートメーション企業を含む多くの産業企業と提携に至りました。シュナイダーエレクトリック、Teradyne Robotics とその MiR および Universal Robots 企業も含まれます。最近、Nvidiahascoll

2か月後、人型ロボットWalker Sが服をたたむことができるようになった

Apr 03, 2024 am 08:01 AM

2か月後、人型ロボットWalker Sが服をたたむことができるようになった

Apr 03, 2024 am 08:01 AM

Machine Power Report 編集者: Wu Xin 国内版の人型ロボット + 大型模型チームは、衣服を折りたたむなどの複雑で柔軟な素材の操作タスクを初めて完了しました。 OpenAIのマルチモーダル大規模モデルを統合したFigure01の公開により、国内同業者の関連動向が注目を集めている。つい昨日、中国の「ヒューマノイドロボットのナンバーワン株」であるUBTECHは、Baidu Wenxinの大型モデルと深く統合されたヒューマノイドロボットWalkerSの最初のデモを公開し、いくつかの興味深い新機能を示した。 Baidu Wenxin の大規模モデル機能の恩恵を受けた WalkerS は次のようになります。 Figure01 と同様に、WalkerS は動き回るのではなく、机の後ろに立って一連のタスクを完了します。人間の命令に従って服をたたむことができる

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

純粋に視覚的な注釈ソリューションでは、主に視覚に加えて、GPS、IMU、および車輪速度センサーからのデータを動的注釈に使用します。もちろん、量産シナリオでは、純粋な視覚である必要はありません。一部の量産車両には固体レーダー (AT128) などのセンサーが搭載されています。大量生産の観点からデータの閉ループを作成し、これらすべてのセンサーを使用すると、動的オブジェクトのラベル付けの問題を効果的に解決できます。しかし、私たちの計画には固体レーダーはありません。したがって、この最も一般的な量産ラベル ソリューションを紹介します。純粋に視覚的な注釈ソリューションの中核は、高精度のポーズ再構築にあります。再構築の精度を確保するために、Structure from Motion (SFM) のポーズ再構築スキームを使用します。でもパスする

未来を形作る 10 台の人型ロボット

Mar 22, 2024 pm 08:51 PM

未来を形作る 10 台の人型ロボット

Mar 22, 2024 pm 08:51 PM

以下の 10 種類の人型ロボットが私たちの未来を形作ります。 1. ASIMO: ホンダが開発した ASIMO は、最もよく知られている人型ロボットの 1 つです。身長 4 フィート、体重 119 ポンドの ASIMO には、高度なセンサーと人工知能機能が装備されており、複雑な環境をナビゲートし、人間と対話することができます。 ASIMO は多用途性を備えているため、障害を持つ人々の支援からイベントでのプレゼンテーションまで、さまざまなタスクに適しています。 2. Pepper: ソフトバンクロボティクスによって作成された Pepper は、人間の社会的パートナーになることを目指しています。表情豊かな顔と感情を認識する能力を備えた Pepper は、会話に参加したり、小売現場で手助けしたり、教育サポートを提供したりすることもできます。コショウ

Cloud Whale Xiaoyao 001 の掃除と掃き掃除ロボットには「頭脳」があります。 | 経験

Apr 26, 2024 pm 04:22 PM

Cloud Whale Xiaoyao 001 の掃除と掃き掃除ロボットには「頭脳」があります。 | 経験

Apr 26, 2024 pm 04:22 PM

掃除ロボットやモップ拭きロボットは、近年消費者の間で最も人気のあるスマート家電製品の 1 つです。操作の利便性、あるいは操作の必要がないことで、怠け者は手を解放し、消費者は日常の家事から「解放」され、好きなことにもっと時間を費やすことができるようになり、生活の質が向上します。この流行に乗って、市場に出回っているほぼすべての家電ブランドが独自の掃除ロボットや拭き掃除ロボットを製造しており、掃除ロボット市場全体が非常に活発になっています。しかし、市場の急速な拡大は必然的に隠れた危険をもたらします。多くのメーカーがより多くの市場シェアを急速に占有するために機械の海戦術を使用し、その結果、アップグレードポイントのない多くの新製品が生まれるとも言われています。まさに「マトリョーシカ」モデルです。ただし、すべての掃除ロボットやモップロボットがそうであるわけではありません。