Tencent、コンピューティング電力コストを 50% 節約する最新の大規模モデルのトレーニング方法を公開

コンピューティング能力が不足する中、大規模モデルのトレーニングと推論の効率を向上させ、コストを削減する方法が業界の焦点になっています。

Tencent は 11 月 23 日、Tencent の Hunyuan 大規模モデルの背後にある自社開発の機械学習フレームワーク Angel が再度アップグレードされ、大規模モデルのトレーニング効率が向上したことを明らかにしました。主流のオープンソース フレームワークの 2.6 倍、数千億の大規模モデル トレーニングにより、コンピューティング電力コストを 50% 節約できます。アップグレードされた Angel は、単一タスクで 10,000 ka レベルの超大規模トレーニングをサポートし、Tencent Cloud の HCC 大型モデル専用コンピューティング クラスターのパフォーマンスと効率をさらに向上させます。

同時に、Angel はモデル開発からアプリケーション実装までのワンストップ プラットフォームも提供し、ユーザーが API インターフェイスや微調整を通じて Tencent Hunyuan の大規模モデル機能を迅速に呼び出すことをサポートします。大規模モデル アプリケーションの構築を加速するため、Tencent Conference、Tencent News、Tencent Video などの 300 を超える Tencent 製品とシナリオが Tencent Hunyuan の内部テストに接続されています。

現在、関連する機能は Tencent Cloud を通じて外部に公開されています。アップグレードされた Angel 機械学習フレームワークに基づいて、Tencent Cloud TI プラットフォームは、より優れたトレーニングと推論の高速化機能を提供し、顧客が独自のデータを使用してワンストップのトレーニングと微調整を行い、Tencent の Hunyuan ラージに基づいた独自のインテリジェント アプリケーションを作成できるようにサポートします。モデル。

自社開発の機械学習フレームワークがアップグレードされ、大規模モデルのトレーニングと推論の効率がさらに向上しました。

大規模モデルの時代の到来により、モデルパラメータは指数関数的に増加し、兆レベルに達しました。大規模なモデルは、単一のモダリティとタスクのサポートから、複数のモダリティでの複数のタスクのサポートまで徐々に開発されます。この傾向の下、大規模なモデルのトレーニングには単一チップの処理速度をはるかに超える膨大な計算能力が必要となり、マルチカード分散トレーニングの通信損失は膨大になります。ハードウェアリソースの利用率をいかに向上させるかは、国産大型モデル技術の開発と実用化にとって重要な前提条件となっている。

大規模なモデルをトレーニングするために、テンセントは、事前トレーニング、モデルの微調整、強化学習のプロセス全体を高速化する、AngelPTM と呼ばれる機械学習トレーニング フレームワークを開発しました。最適化。 AngelPTM は、最新の FP8 混合精度トレーニング テクノロジを採用し、深く最適化された 4D 並列処理と ZeROCache メカニズムを組み合わせてストレージを最適化します。国内のさまざまなハードウェアと互換性があり、より少ないリソースとより高速なトレーニングが可能です。

#2023 年 4 月、Tencent Cloud は大規模モデル向けの新世代 HCC 高性能コンピューティング クラスターをリリースしました。そのパフォーマンスは前世代の 3 倍です。ハードウェアのアップグレードに加えて、HCC はネットワーク プロトコル、通信戦略、AI フレームワーク、モデルのコンパイルに関してシステム レベルの最適化も実行し、トレーニング、チューニング、およびコンピューティングの電力コストを大幅に削減しました。 AngelPTM はこれまで HCC を通じてサービスを提供してきましたが、この Angel 機械学習フレームワークのアップグレードにより、HCC の大規模モデル専用コンピューティング クラスターのパフォーマンスがさらに向上し、企業による大規模モデルの実用化の加速が支援されます##モデルパラメータの増加によって引き起こされるトレーニングの課題と推論コストの上昇を解決するために、Tencent が自社開発した大規模モデル推論フレームワーク AngelHCF は、並列機能を拡張し、複数のアテンション最適化戦略を採用することでパフォーマンスを向上させました。同時に、このフレームワークはさまざまな圧縮アルゴリズムにも適応してスループットを向上させ、それによってより高速な推論パフォーマンスと低コストを実現し、大規模なモデル推論サービスをサポートします

業界で主流のフレームワークである AngelHCF の推論速度は 1.3 倍に向上しました。 Tencent の Hunyuan 大型モデル Wenshengtu のアプリケーションでは、推論時間が当初の 10 秒から 3 ~ 4 秒に短縮されました。さらに、AngelHCF は、さまざまな柔軟な大規模モデルの圧縮および量子化戦略もサポートし、自動圧縮もサポートします。

ワンストップのアプリケーション構築により、大規模モデルをすぐに使用できるようになります。

Tencent の Hunyuan 大型モデルは、実用レベルの大規模モデルとして、研究開発の当初からアプリケーション シナリオを重視しており、大規模モデルを実際に実装する際の困難を解決しました。 。 Tencent には多くの種類の製品とアプリケーションがあり、大量のトラフィックがあるため、モデルを実際に「使用する」のは非常に困難です。 Angel に基づいて、Tencent は、データ処理、微調整、モデル評価、ワンクリック導入、即時ワード最適化などのサービスを含む、大規模モデルのアクセスとアプリケーション開発のためのワンストップ プラットフォームを構築し、大規模モデルの使用を可能にしました。 「すぐに使える」ことが可能になります。

モデル アクセスに関して、Tencent Hunyuan Large Model は、1,000 億、100 億、10 億を超えるサイズのモデルを提供し、さまざまなアプリケーション シナリオのニーズに完全に適応します。シンプルな微調整により、ビジネス ニーズを満たし、モデルのトレーニングと推論サービスのリソース コストを削減できます。 Q&A やコンテンツ分類などの一般的なアプリケーション シナリオでは、コスト効率が高くなります。

アプリケーション開発レベルでは、Tencent 内の 300 以上のビジネスとアプリケーション シナリオが Tencent に接続されています。渾源大型モデル 社内テストの数は先月と比べて倍増し、本文の要約、要約、作成、翻訳、コーディングなどの複数の分野をカバーしています。

2023 年 9 月、Tencent が独自に開発した実用的な大規模モデルである Tencent Hunyuan が正式に発表され、Tencent Cloud を通じてオープンされました。 Tencent Hunyuan のパラメータ スケールは 1,000 億を超え、事前トレーニング コーパスには 2 兆を超えるトークンが含まれています。 Tencent の独立したテクノロジーの蓄積を事前トレーニング アルゴリズム、機械学習プラットフォーム、基盤となるコンピューティング リソースに統合し、アプリケーション内で反復処理を継続して大規模モデルの機能を継続的に最適化します。現在、小売、教育、金融、医療、メディア、運輸、官公庁などの複数の業界の顧客が、Tencent Cloudを通じてTencent Hunyuanの大規模モデルにアクセスしています

以上がTencent、コンピューティング電力コストを 50% 節約する最新の大規模モデルのトレーニング方法を公開の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7469

7469

15

15

1376

1376

52

52

77

77

11

11

19

19

28

28

ビッグモデルアプリ Tencent Yuanbao がオンラインになりました! Hunyuan がアップグレードされ、どこにでも持ち運べるオールラウンドな AI アシスタントが作成されました

Jun 09, 2024 pm 10:38 PM

ビッグモデルアプリ Tencent Yuanbao がオンラインになりました! Hunyuan がアップグレードされ、どこにでも持ち運べるオールラウンドな AI アシスタントが作成されました

Jun 09, 2024 pm 10:38 PM

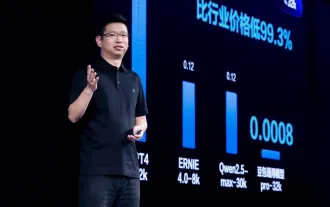

5月30日、TencentはHunyuanモデルの包括的なアップグレードを発表し、Hunyuanモデルに基づくアプリ「Tencent Yuanbao」が正式にリリースされ、AppleおよびAndroidアプリストアからダウンロードできるようになりました。前のテスト段階のフンユアン アプレット バージョンと比較して、Tencent Yuanbao は、日常生活シナリオ向けの AI 検索、AI サマリー、AI ライティングなどのコア機能を提供し、Yuanbao のゲームプレイもより豊富で、複数の機能を提供します。 、パーソナルエージェントの作成などの新しいゲームプレイ方法が追加されます。 Tencent Cloud 副社長で Tencent Hunyuan 大型モデルの責任者である Liu Yuhong 氏は、「テンセントは、最初に大型モデルを開発しようとはしません。」と述べました。 Tencent Hunyuan の大型モデルは、ビジネス シナリオにおける豊富で大規模なポーランド テクノロジーを活用しながら、ユーザーの真のニーズを洞察します。

Bytedance Beanbao 大型モデルがリリース、Volcano Engine フルスタック AI サービスが企業のインテリジェントな変革を支援

Jun 05, 2024 pm 07:59 PM

Bytedance Beanbao 大型モデルがリリース、Volcano Engine フルスタック AI サービスが企業のインテリジェントな変革を支援

Jun 05, 2024 pm 07:59 PM

Volcano Engine の社長である Tan Dai 氏は、大規模モデルを実装したい企業は、モデルの有効性、推論コスト、実装の難易度という 3 つの重要な課題に直面していると述べました。複雑な問題を解決するためのサポートとして、適切な基本的な大規模モデルが必要です。また、サービスは低コストの推論を備えているため、大規模なモデルを広く使用できるようになり、企業がシナリオを実装できるようにするためには、より多くのツール、プラットフォーム、アプリケーションが必要になります。 ——Huoshan Engine 01 社長、Tan Dai 氏。大きなビーンバッグ モデルがデビューし、頻繁に使用されています。モデル効果を磨き上げることは、AI の実装における最も重要な課題です。 Tan Dai 氏は、良いモデルは大量に使用することでのみ磨かれると指摘しました。現在、Doubao モデルは毎日 1,200 億トークンのテキストを処理し、3,000 万枚の画像を生成しています。企業による大規模モデルシナリオの実装を支援するために、バイトダンスが独自に開発した豆包大規模モデルが火山を通じて打ち上げられます。

この記事では、SHAP: 機械学習のモデルの説明について説明します。

Jun 01, 2024 am 10:58 AM

この記事では、SHAP: 機械学習のモデルの説明について説明します。

Jun 01, 2024 am 10:58 AM

機械学習とデータ サイエンスの分野では、モデルの解釈可能性が常に研究者や実務家に焦点を当ててきました。深層学習やアンサンブル手法などの複雑なモデルが広く適用されるようになったことで、モデルの意思決定プロセスを理解することが特に重要になってきました。 Explainable AI|XAI は、モデルの透明性を高めることで、機械学習モデルに対する信頼と自信を構築するのに役立ちます。モデルの透明性の向上は、複数の複雑なモデルの普及や、モデルを説明するための意思決定プロセスなどの方法によって実現できます。これらの方法には、特徴重要度分析、モデル予測間隔推定、ローカル解釈可能性アルゴリズムなどが含まれます。特徴重要度分析では、入力特徴に対するモデルの影響度を評価することで、モデルの意思決定プロセスを説明できます。モデルの予測間隔の推定

C++ での機械学習アルゴリズムの実装: 一般的な課題と解決策

Jun 03, 2024 pm 01:25 PM

C++ での機械学習アルゴリズムの実装: 一般的な課題と解決策

Jun 03, 2024 pm 01:25 PM

C++ の機械学習アルゴリズムが直面する一般的な課題には、メモリ管理、マルチスレッド、パフォーマンスの最適化、保守性などがあります。解決策には、スマート ポインター、最新のスレッド ライブラリ、SIMD 命令、サードパーティ ライブラリの使用、コーディング スタイル ガイドラインの遵守、自動化ツールの使用が含まれます。実践的な事例では、Eigen ライブラリを使用して線形回帰アルゴリズムを実装し、メモリを効果的に管理し、高性能の行列演算を使用する方法を示します。

産業ナレッジグラフの高度な実践

Jun 13, 2024 am 11:59 AM

産業ナレッジグラフの高度な実践

Jun 13, 2024 am 11:59 AM

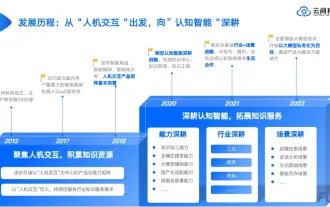

1. 背景の紹介 まず、Yunwen Technology の開発の歴史を紹介します。 Yunwen Technology Company ...2023 年は大規模モデルが普及する時期であり、多くの企業は大規模モデルの後、グラフの重要性が大幅に低下し、以前に検討されたプリセット情報システムはもはや重要ではないと考えています。しかし、RAG の推進とデータ ガバナンスの普及により、より効率的なデータ ガバナンスと高品質のデータが民営化された大規模モデルの有効性を向上させるための重要な前提条件であることがわかり、ますます多くの企業が注目し始めています。知識構築関連コンテンツへ。これにより、知識の構築と処理がより高いレベルに促進され、探索できる技術や方法が数多く存在します。新しいテクノロジーの出現によってすべての古いテクノロジーが打ち破られるわけではなく、新旧のテクノロジーが統合される可能性があることがわかります。

Xiaomi Byteが力を合わせます! Xiao Ai の Doubao へのアクセスの大規模モデル: 携帯電話と SU7 にすでにインストールされています

Jun 13, 2024 pm 05:11 PM

Xiaomi Byteが力を合わせます! Xiao Ai の Doubao へのアクセスの大規模モデル: 携帯電話と SU7 にすでにインストールされています

Jun 13, 2024 pm 05:11 PM

6月13日のニュースによると、Byteの「Volcano Engine」公開アカウントによると、Xiaomiの人工知能アシスタント「Xiao Ai」はVolcano Engineとの協力に達し、両社はbeanbao大型モデルに基づいて、よりインテリジェントなAIインタラクティブ体験を実現するとのこと。 。 ByteDance が作成した大規模な豆包モデルは、毎日最大 1,200 億のテキスト トークンを効率的に処理し、3,000 万個のコンテンツを生成できると報告されています。 Xiaomi は、Doubao 大型モデルを使用して、独自モデルの学習能力と推論能力を向上させ、ユーザーのニーズをより正確に把握するだけでなく、より速い応答速度とより包括的なコンテンツ サービスを提供する新しい「Xiao Ai Classmate」を作成しました。たとえば、ユーザーが複雑な科学的概念について質問する場合、&ldq

説明可能な AI: 複雑な AI/ML モデルの説明

Jun 03, 2024 pm 10:08 PM

説明可能な AI: 複雑な AI/ML モデルの説明

Jun 03, 2024 pm 10:08 PM

翻訳者 | Li Rui によるレビュー | 今日、人工知能 (AI) および機械学習 (ML) モデルはますます複雑になっており、これらのモデルによって生成される出力はブラックボックスになっており、関係者に説明することができません。 Explainable AI (XAI) は、利害関係者がこれらのモデルがどのように機能するかを理解できるようにし、これらのモデルが実際に意思決定を行う方法を確実に理解できるようにし、AI システムの透明性、信頼性、およびこの問題を解決するための説明責任を確保することで、この問題を解決することを目指しています。この記事では、さまざまな説明可能な人工知能 (XAI) 手法を検討して、その基礎となる原理を説明します。説明可能な AI が重要であるいくつかの理由 信頼と透明性: AI システムが広く受け入れられ、信頼されるためには、ユーザーは意思決定がどのように行われるかを理解する必要があります

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

編集者 |ScienceAI 質問応答 (QA) データセットは、自然言語処理 (NLP) 研究を促進する上で重要な役割を果たします。高品質の QA データ セットは、モデルの微調整に使用できるだけでなく、大規模言語モデル (LLM) の機能、特に科学的知識を理解し推論する能力を効果的に評価することもできます。現在、医学、化学、生物学、その他の分野をカバーする多くの科学 QA データ セットがありますが、これらのデータ セットにはまだいくつかの欠点があります。まず、データ形式は比較的単純で、そのほとんどが多肢選択式の質問であり、評価は簡単ですが、モデルの回答選択範囲が制限され、科学的な質問に回答するモデルの能力を完全にテストすることはできません。対照的に、自由回答型の Q&A