LCM: 高品質の画像を劇的に高速に生成する新しい方法

著者丨Mike Young

翻訳: 元の意味を変えずにコンテンツを再作成する言語は中国語です。元の文は表示されません

元の意味を変えずにコンテンツを確認してください、言語を書き直す必要があります 中国語では、元の文を表示する必要はありません

推奨 | 51CTO テクノロジー スタック (WeChat ID: blog51cto)

##写真

##写真

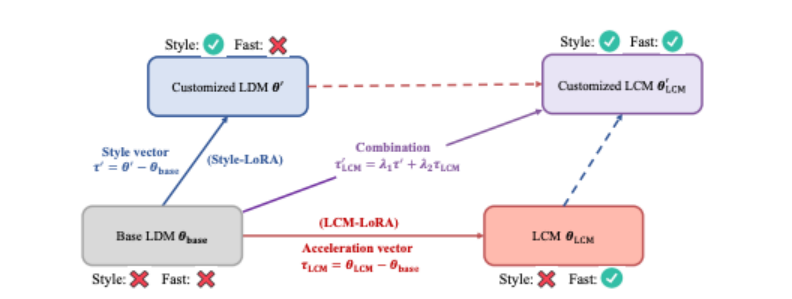

LCM の精製プロセスに LoRA を導入することによりにより、リファインによるメモリ オーバーヘッドが大幅に削減され、限られたリソースで SDXL や SSD-1B などのより大きなモデルをトレーニングできるようになります。さらに重要なことは、LCM-LoRA トレーニングを通じて取得された LoRA パラメーター (「加速ベクトル」) は、特定のスタイルのデータセットを微調整することによって取得された他の LoRA パラメーター (「スタイル ベクトル」) と直接組み合わせることができることです。トレーニングを行わなくても、加速度ベクトルとスタイル ベクトルの線形結合によって得られるモデルは、最小限のサンプリング ステップで特定の絵画スタイルの画像を生成する機能を獲得します。

LCM の精製プロセスに LoRA を導入することによりにより、リファインによるメモリ オーバーヘッドが大幅に削減され、限られたリソースで SDXL や SSD-1B などのより大きなモデルをトレーニングできるようになります。さらに重要なことは、LCM-LoRA トレーニングを通じて取得された LoRA パラメーター (「加速ベクトル」) は、特定のスタイルのデータセットを微調整することによって取得された他の LoRA パラメーター (「スタイル ベクトル」) と直接組み合わせることができることです。トレーニングを行わなくても、加速度ベクトルとスタイル ベクトルの線形結合によって得られるモデルは、最小限のサンプリング ステップで特定の絵画スタイルの画像を生成する機能を獲得します。

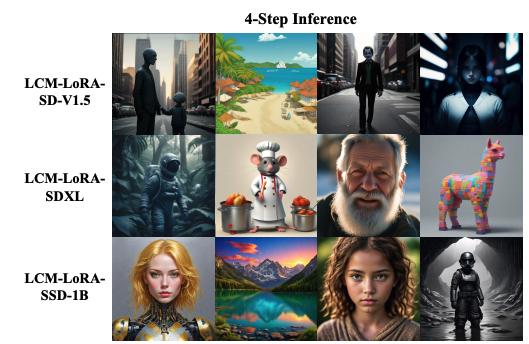

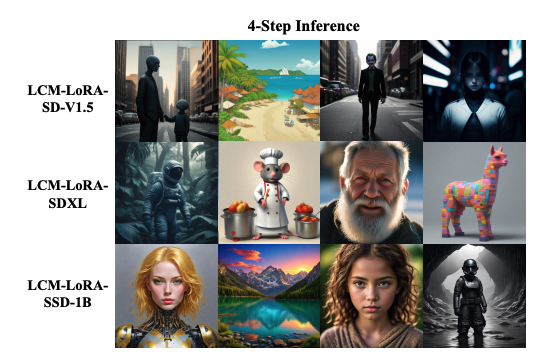

図 2. 論文では次のように主張されています。 「LCM-LoRA-SD-V1.5 を使用して 512×512 解像度の画像を生成し、LCM-LoRA-SDXL および LCM-LoRA-SSD-1B を使用して 1024×1024 解像度の画像を生成しました。」

3. 制限事項

LCM の現在のバージョンにはいくつかの制限があります。最も重要なことは 2 段階のトレーニング プロセスです。最初に LDM をトレーニングし、次にそれを使用して LCM をトレーニングします。将来の研究では、LDM を必要としない、より直接的な LDM トレーニング方法が研究される可能性があります。この文書では主に無条件画像生成について説明しますが、条件付き生成タスク (テキストから画像への合成など) にはさらに多くの作業が必要になる場合があります。

4. 主な啓発

潜在整合性モデル (LCM) は、高品質の画像を迅速に生成する上で重要な一歩を踏み出しました。これらのモデルは、わずか 1 ~ 4 ステップで低速な LDM と同等の結果を生成でき、テキストから画像へのモデルの実際の適用に革命を起こす可能性があります。現在、特にトレーニング プロセスと生成タスクの範囲に関していくつかの制限がありますが、LCM はニューラル ネットワークに基づく実用的な画像生成において大幅な進歩を示しています。提供された例は、これらのモデルの可能性を強調しています

#5、一般的な加速モジュールとしての LCM-LoRA#はじめにで述べたように、この論文は 2 つの部分に分かれています。 2 番目の部分では、LCM-LoRA テクノロジについて説明します。LCM-LoRA テクノロジにより、少ないメモリを使用して事前トレーニングされたモデルの微調整が可能になり、効率が向上します。

ここでの重要な革新は、LoRA パラメータを LCM に統合することです。 、これにより、両方の利点を組み合わせたハイブリッド モデルが生成されます。この統合は、特定のスタイルの画像を作成したり、特定のタスクに応答したりする場合に特に役立ちます。 LoRA パラメータの異なるセットを選択して組み合わせ、それぞれを独自のスタイルに合わせて微調整すると、研究者は追加のトレーニングなしで最小限の手順で画像を生成できる多用途モデルを作成できます。

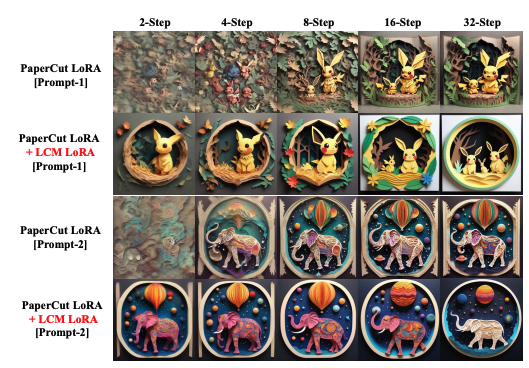

彼らは、特定の絵画スタイル向けに微調整された LoRA パラメーターと LCM-LoRA パラメーターを組み合わせた例を通じて、研究でこのことを実証しました。この組み合わせにより、さまざまなサンプリング ステップ (2 ステップ、4 ステップ、8 ステップ、16 ステップ、32 ステップなど) でさまざまなスタイルの 1024 × 1024 解像度の画像を作成できます。結果は、これらのパラメーターを組み合わせれば、さらなるトレーニングを行わなくても高品質の画像を生成できることが示されており、モデルの効率性と多用途性が強調されています。

ここで注目に値するのは、加速度ベクトル (τLCM) とスタイル ベクトル (τ) は、特定の数式を使用して結合されます (λ1 と λ2 はこれらの数式の調整可能な係数です)。この組み合わせにより、カスタム スタイルの画像を迅速に生成できるモデルが得られます。

論文の図 3 (以下に示す) は、特定のスタイルの LoRA パラメーターと LCM-LoRA パラメーターを組み合わせた結果を示すことで、このアプローチの有効性を示しています。これは、さまざまなスタイルの画像を迅速かつ効率的に生成するモデルの機能を示しています。

#図 3

# 強調表示された主要な結果には、わずか数ステップで LCM が含まれます。 高品質の 512x512 および 1024x1024 画像を作成するには、数百枚の画像が必要ですLDM を使用した手順。ただし、現在の制限として、LDM は 2 段階のトレーニング プロセスに依存しているため、開始するには依然として LDM が必要です。将来の研究により、このプロセスが簡素化される可能性があります。

LCM は、特に提案されている LCM-LoRA モデルで LoRA と組み合わせた場合、非常に賢いイノベーションです。高品質な画像をより迅速かつ効率的に作成できるという利点があり、デジタルコンテンツ制作において幅広い応用が期待できると思います。

参考リンク: https://notes.aimodels.fyi/lcm-lora-a-new-method-for-generated-high-quality-images-much-faster/

#

以上がLCM: 高品質の画像を劇的に高速に生成する新しい方法の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7465

7465

15

15

1376

1376

52

52

77

77

11

11

18

18

19

19

Windows 11でデスクトップの背景の最近の画像履歴をクリアする方法

Apr 14, 2023 pm 01:37 PM

Windows 11でデスクトップの背景の最近の画像履歴をクリアする方法

Apr 14, 2023 pm 01:37 PM

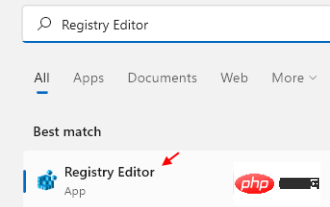

<p>Windows 11 ではシステムの個人設定が改善され、ユーザーが以前に行ったデスクトップの背景の変更の最近の履歴を表示できるようになりました。 Windows システム設定アプリケーションの個人設定セクションに入ると、さまざまなオプションが表示されます。背景の壁紙の変更もその 1 つです。ただし、システムに設定されている背景壁紙の最新の履歴を確認できるようになりました。これを見るのが嫌で、この最近の履歴を消去または削除したい場合は、この記事を読み続けてください。レジストリ エディターを使用してこれを行う方法の詳細を学ぶのに役立ちます。 </p><h2>レジストリ編集の使用方法

Windows スポットライトの壁紙画像を PC にダウンロードする方法

Aug 23, 2023 pm 02:06 PM

Windows スポットライトの壁紙画像を PC にダウンロードする方法

Aug 23, 2023 pm 02:06 PM

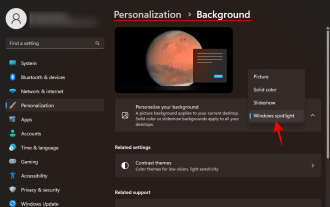

窓は決して美観を無視するものではありません。 XP の牧歌的な緑の野原から Windows 11 の青い渦巻くデザインに至るまで、デフォルトのデスクトップの壁紙は長年にわたってユーザーの喜びの源でした。 Windows スポットライトを使用すると、ロック画面やデスクトップの壁紙に使用する美しく荘厳な画像に毎日直接アクセスできるようになります。残念ながら、これらの画像は表示されません。 Windows スポットライト画像の 1 つが気に入った場合は、その画像をダウンロードして、しばらく背景として保存できるようにする方法を知りたいと思うでしょう。知っておくべきことはすべてここにあります。 Windowsスポットライトとは何ですか? Window Spotlight は、設定アプリの [個人設定] > から利用できる自動壁紙アップデーターです。

Python で画像セマンティック セグメンテーション テクノロジを使用するにはどうすればよいですか?

Jun 06, 2023 am 08:03 AM

Python で画像セマンティック セグメンテーション テクノロジを使用するにはどうすればよいですか?

Jun 06, 2023 am 08:03 AM

人工知能技術の継続的な発展に伴い、画像セマンティックセグメンテーション技術は画像分析分野で人気の研究方向となっています。画像セマンティック セグメンテーションでは、画像内のさまざまな領域をセグメント化し、各領域を分類して、画像の包括的な理解を実現します。 Python はよく知られたプログラミング言語であり、その強力なデータ分析機能とデータ視覚化機能により、人工知能技術研究の分野で最初に選択されます。この記事では、Python で画像セマンティック セグメンテーション技術を使用する方法を紹介します。 1. 前提知識が深まる

iOS 17: 写真でワンクリックトリミングを使用する方法

Sep 20, 2023 pm 08:45 PM

iOS 17: 写真でワンクリックトリミングを使用する方法

Sep 20, 2023 pm 08:45 PM

iOS 17 の写真アプリを使用すると、Apple は写真を仕様に合わせて簡単にトリミングできるようになります。その方法については、読み続けてください。以前の iOS 16 では、写真アプリで画像をトリミングするにはいくつかの手順が必要でした。編集インターフェイスをタップし、トリミング ツールを選択し、ピンチでズームするジェスチャまたはトリミング ツールの角をドラッグしてトリミングを調整します。 iOS 17 では、Apple がありがたいことにこのプロセスを簡素化し、写真ライブラリで選択した写真を拡大すると、画面の右上隅に新しい切り抜きボタンが自動的に表示されるようになりました。クリックすると、選択したズームレベルで完全なトリミングインターフェイスが表示されるので、画像の好きな部分をトリミングしたり、画像を回転したり、画像を反転したり、画面比率を適用したり、マーカーを使用したりできます。

Windows で PowerToys を使用して画像のサイズを一括変更する方法

Aug 23, 2023 pm 07:49 PM

Windows で PowerToys を使用して画像のサイズを一括変更する方法

Aug 23, 2023 pm 07:49 PM

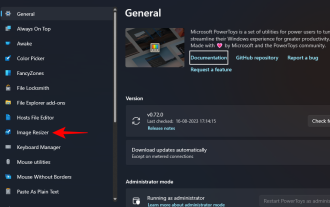

日常的に画像ファイルを扱う必要がある人は、プロジェクトや仕事のニーズに合わせて画像ファイルのサイズを変更する必要があることがよくあります。ただし、処理する画像が多すぎる場合、画像を個別にサイズ変更すると、多くの時間と労力がかかる可能性があります。この場合、PowerToys のようなツールは、画像サイズ変更ユーティリティを使用して画像ファイルのサイズをバッチで変更するのに役立ちます。 Image Resizer 設定をセットアップし、PowerToys を使用して画像のバッチ サイズ変更を開始する方法は次のとおりです。 PowerToys を使用して画像のサイズをバッチ変更する方法 PowerToys は、日常業務のスピードアップに役立つさまざまなユーティリティと機能を備えたオールインワン プログラムです。そのユーティリティの 1 つは画像です

2D画像を使って3Dの人体を作成し、好きな服を着たり、動きを変えたりすることができます。

Apr 11, 2023 pm 02:31 PM

2D画像を使って3Dの人体を作成し、好きな服を着たり、動きを変えたりすることができます。

Apr 11, 2023 pm 02:31 PM

NeRF が提供する微分可能なレンダリングのおかげで、最近の 3D 生成モデルは静止したオブジェクトに対して素晴らしい結果を達成しました。ただし、人体のようなより複雑で変形可能なカテゴリでは、3D 生成には依然として大きな課題が伴います。この論文では、超解像度モデルを使用せずに高解像度 (512x256) の 3D 人体生成を可能にする、人体の効率的な組み合わせ NeRF 表現を提案します。 EVA3D は、4 つの大規模な人体データ セットに関する既存のソリューションを大幅に上回り、コードはオープンソースになっています。論文名: EVA3D: 2D 画像コレクションからの合成 3D 人間の生成 論文アドレス: http

画像生成に関する新しい視点: NeRF ベースの一般化手法についての議論

Apr 09, 2023 pm 05:31 PM

画像生成に関する新しい視点: NeRF ベースの一般化手法についての議論

Apr 09, 2023 pm 05:31 PM

新しい透視画像生成 (NVS) は、コンピュータ ビジョンの応用分野です。1998 年のスーパーボウル ゲームで、CMU の RI は、マルチカメラ ステレオ ビジョン (MVS) を備えた NVS をデモンストレーションしました。当時、この技術は、米国のスポーツ テレビ局に移転されました。英国BBC放送社も研究開発に投資したが、結局は商品化されなかった。イメージベース レンダリング (IBR) の分野には、NVS アプリケーションの一分野、つまり深度イメージベース レンダリング (DBIR) があります。また、2010年に大流行した3Dテレビも単眼映像から両眼立体感を得る必要がありましたが、技術の未熟さから結局普及には至りませんでした。当時、次のような機械学習をベースとした手法が研究され始めていました。

ワンクリックでシミやシワを消す:DAMOアカデミーの高精細ポートレート肌美人モデルABPNの徹底解説

Apr 12, 2023 pm 12:25 PM

ワンクリックでシミやシワを消す:DAMOアカデミーの高精細ポートレート肌美人モデルABPNの徹底解説

Apr 12, 2023 pm 12:25 PM

デジタル文化産業の活発な発展に伴い、人工知能技術は画像編集や美化の分野で広く使用され始めています。その中でも、ポートレートの肌の美化は間違いなく最も広く使用され、最も需要のある技術の 1 つです。従来の美容アルゴリズムは、フィルターベースの画像編集テクノロジーを使用して、自動化された肌の再表面化とシミの除去効果を実現しており、ソーシャルネットワーキング、ライブブロードキャスト、その他のシナリオで広く使用されてきました。しかし、敷居の高いプロの写真業界では、画像解像度と品質基準に対する高い要件があるため、手動レタッチャーが依然として肖像画の美しさのレタッチにおいて主な生産力であり、肌の滑らかさ、シミの除去、美白などのタスクを完了します。仕事。通常、プロのレタッチャーによる高精細ポートレートの美肌処理の平均処理時間は1~2分ですが、より高い精度が要求される広告、映画、テレビなどの分野では、この処理が最適化されています。