写真からビデオが生成され、口を開ける、うなずく、感情、怒り、悲しみ、喜びはすべて入力によって制御できます。

最近、マイクロソフトが実施した調査で、ビデオ処理ソフトウェア PS がいかに柔軟であることが明らかになりました。

この調査では、AI に写真を撮る機能を与えるだけで済みます。 、写真に写っている人物のビデオを生成したり、キャラクターの表情や動きをテキストで制御したりできます。たとえば、「口を開けて」というコマンドを与えると、ビデオ内のキャラクターが実際に口を開きます。

#コマンドが「悲しい」の場合、彼女は悲しい表情と頭の動きをします。

「驚く」コマンドが与えられると、アバターの額の線がぎゅっと絞られます。

さらに、音声を提供して、仮想キャラクターの口の形や動きを音声と同期させることもできます。あるいは、アバターが模倣するライブ ビデオを提供することもできます。

アバターの動きにうなずいたり、振り向いたり、頭を傾けたりするなど、さらにカスタム編集が必要な場合は、この技術もサポートされています

この研究は GAIA (Generative AI for Avatar、アバターのための生成 AI) と呼ばれ、そのデモが広まり始めています。ソーシャルメディア。多くの人がその効果を賞賛し、それを死者の「復活」に利用したいと考えています。

#しかし、これらのテクノロジーの継続的な進化により、オンライン動画の真実と虚偽の区別が難しくなり、利用されにくくなるのではないかと心配する人もいます。犯罪者による詐欺です。今後も不正防止対策は強化されていくようだ。

GAIA にはどのようなイノベーションがありますか?

ゼロサンプル トーキング アバター生成テクノロジーは、音声に基づいて自然なビデオを合成し、生成される口の形、表情、頭の姿勢が音声の内容と一致することを保証することを目的としています。これまでの研究では通常、高品質の結果を達成するために、仮想キャラクターごとに特定のモデルの特定のトレーニングや調整、または推論中にテンプレート ビデオの利用が必要でした。最近、研究者は、ターゲット アバターの肖像画画像を外観基準として使用するだけで、ゼロショット トーキング アバターを生成する方法の設計と改善に焦点を当てています。ただし、これらの方法では通常、ワーピングベースのモーション表現や 3D モーファブル モデル (3DMM) などのドメイン事前分布を使用して、タスクの難易度を軽減します。このようなヒューリスティックは効果的ではありますが、多様性を制限し、不自然な結果につながる可能性があります。したがって、データ配布からの直接学習が今後の研究の焦点です

この記事では、マイクロソフトの研究者が、音声やチラシから学習できる GAIA (Generative AI for Avatar) を提案しました。生成プロセスでドメイン事前要素を排除し、自然に話す仮想キャラクター ビデオに合成されます。

プロジェクト アドレス: https://microsoft.github.io/GAIA/関連プロジェクトの詳細は、このリンクでご覧いただけます

論文リンク: https://arxiv.org/pdf/2311.15230.pdf

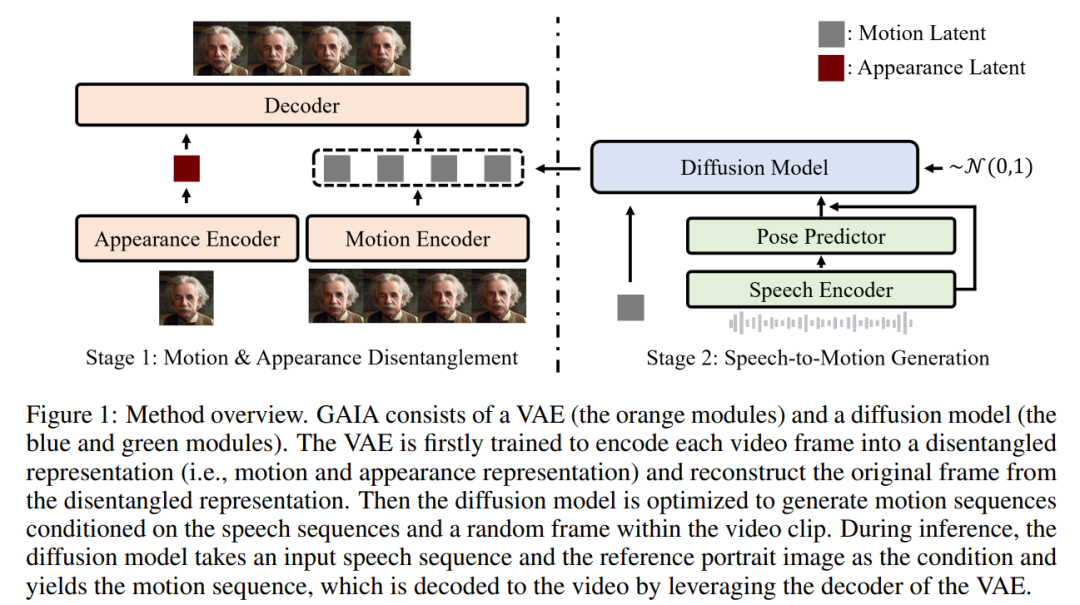

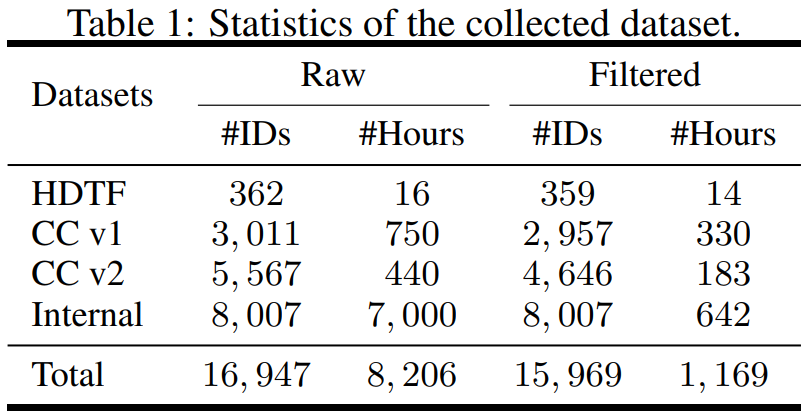

#Gaia が 2 つの重要な洞察を明らかにします:#VAE の主な機能は、動きと外観を分解することです。 2 つのエンコーダ (モーション エンコーダとアピアランス エンコーダ) と 1 つのデコーダで構成されます。トレーニング中、モーション エンコーダーへの入力は顔のランドマークの現在のフレームですが、外観エンコーダーへの入力は現在のビデオ クリップ内のランダムにサンプリングされたフレームです。次に、エンコーダの出力が最適化されて、現在のフレームが再構築されます。トレーニングされた VAE が取得されると、すべてのトレーニング データに対して潜在的なアクション (つまり、モーション エンコーダーの出力) が取得されます。 推論プロセスでは、ターゲット アバターの参照ポートレート画像が与えられると、拡散モデルは画像を次のように変換します。入力された音声シーケンスは、音声の内容に適合する運動電位シーケンスを生成するための条件として使用されます。生成されたモーション潜在シーケンスと参照ポートレート画像は、VAE デコーダーを通過して、発話ビデオ出力を合成します。 調査はデータの観点から構成されており、高精細話顔データセット (HDTF) やカジュアル会話データセット v1&v2 (CC v1&v2) など、さまざまなソースからデータセットを収集しました。これら 3 つのデータセットに加えて、この研究では、7,000 時間のビデオと 8,000 のスピーカー ID を含む大規模な内部発話アバター データセットも収集しました。データセットの統計概要を表 1に示します。

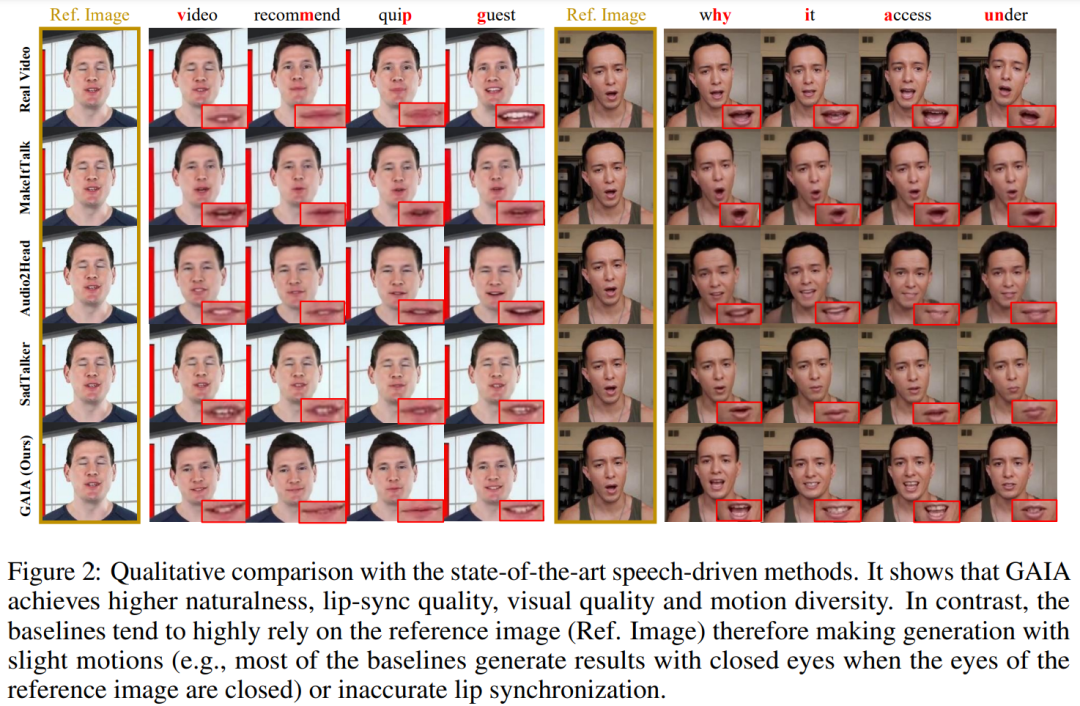

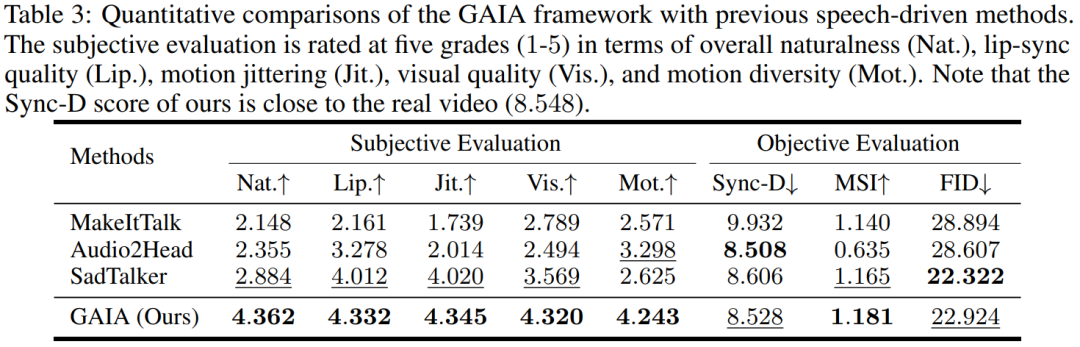

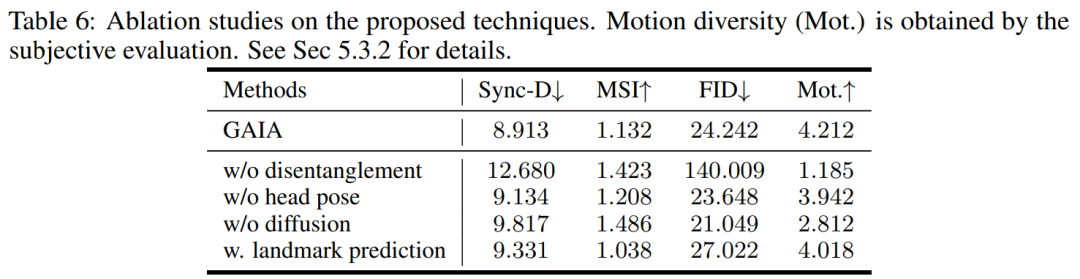

必要な情報を知るために、この記事では、次のような自動フィルタリング戦略をいくつか提案しています。トレーニング データの品質: 唇の動きを見えるようにするには、アバターの正面方向がカメラに向かう必要があります; 唇の動きが音声と一致しない極端なケースを除外するために、アバターが含まれるフレームマスクを着用しているか黙っている場合は削除する必要があります。 GAIA は、制御可能な発話アバターの生成やテキスト コマンドの仮想化キャラクター生成など、さまざまなアプリケーションを可能にする汎用的で柔軟なフレームワークです。 音声主導の結果。音声駆動型の話すアバターの生成は、音声から動きを予測することによって実現されます。表 3 と図 2 は、GAIA と MakeItTalk、Audio2Head、および SadTalker メソッドとの定量的および定性的な比較を示しています。 データから、主観的評価の点で GAIA がすべてのベースライン手法をはるかに上回っていることは明らかです。具体的には、図 2 に示すように、基準画像が目を閉じていたり、頭のポーズが異常であったとしても、ベースライン手法の生成結果は通常、基準画像に大きく依存するのに対し、GAIA はさまざまな基準画像に対して良好なパフォーマンスを示します。堅牢で、より高い自然さ、高いリップシンク、より優れたビジュアル品質、およびモーションの多様性を備えた結果を生成します ##表 3 による、最高の MSI スコアは、GAIA によって生成されたビデオが優れたモーション安定性を持っていることを示します。 Sync-D スコア 8.528 は実際のビデオ スコア (8.548) に近く、生成されたビデオが優れたリップ シンクを備えていることを示しています。この研究では、ベースラインと同等の FID スコアを達成しましたが、表 6 ## で詳しく説明されているように、拡散トレーニングを行わなかったモデルの方がより良い FID スコアを達成したことが研究で判明したため、さまざまな頭のポーズの影響を受ける可能性があります。

次に、この記事では、拡散モデルを使用して音声を予測するトレーニングを行います。ビデオ クリップ内のランダムにサンプリングされたフレームのモーション潜在シーケンスに基づいて、生成プロセスに外観情報を提供します。

次に、この記事では、拡散モデルを使用して音声を予測するトレーニングを行います。ビデオ クリップ内のランダムにサンプリングされたフレームのモーション潜在シーケンスに基づいて、生成プロセスに外観情報を提供します。

トレーニング モデルのサイズは 150M から 2B の範囲であり、その結果は、GAIA がスケーラブルであることを示しました。

#

#

以上が写真からビデオが生成され、口を開ける、うなずく、感情、怒り、悲しみ、喜びはすべて入力によって制御できます。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7554

7554

15

15

1382

1382

52

52

83

83

11

11

24

24

96

96

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

Microsoft、Win11 8月累積アップデートをリリース:セキュリティの向上、ロック画面の最適化など。

Aug 14, 2024 am 10:39 AM

Microsoft、Win11 8月累積アップデートをリリース:セキュリティの向上、ロック画面の最適化など。

Aug 14, 2024 am 10:39 AM

8 月 14 日のこのサイトのニュースによると、今日の 8 月のパッチ火曜日イベント日に、Microsoft は 22H2 および 23H2 用の KB5041585 更新プログラム、および 21H2 用の KB5041592 更新プログラムを含む、Windows 11 システム用の累積的な更新プログラムをリリースしました。 8 月の累積更新プログラムで上記の機器がインストールされた後、このサイトに添付されるバージョン番号の変更は次のとおりです。 21H2 機器のインストール後、機器のインストール後、バージョン番号は Build22000.314722H2 に増加しました。バージョン番号は Build22621.403723H2 に増加しました。 装置のインストール後、バージョン番号は Build22631.4037 に増加しました。 Windows 1121H2 の更新プログラムの主な内容は次のとおりです。 改善: 改善されました。

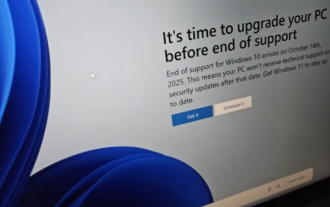

Microsoft の全画面ポップアップは、Windows 10 ユーザーに急いで Windows 11 にアップグレードするよう促します

Jun 06, 2024 am 11:35 AM

Microsoft の全画面ポップアップは、Windows 10 ユーザーに急いで Windows 11 にアップグレードするよう促します

Jun 06, 2024 am 11:35 AM

6 月 3 日のニュースによると、Microsoft はすべての Windows 10 ユーザーに全画面通知を積極的に送信し、Windows 11 オペレーティング システムへのアップグレードを奨励しています。この移行には、ハードウェア構成が新しいシステムをサポートしていないデバイスが含まれます。 2015 年以来、Windows 10 は市場シェアの 70% 近くを占め、Windows オペレーティング システムとしての優位性を確固たるものにしました。しかし、そのシェアは82%を大きく上回り、2021年に発売されるWindows 11のシェアを大きく上回っている。 Windows 11 は発売から 3 年近く経ちますが、市場への浸透はまだ遅いです。 Microsoft は、Windows 10 の技術サポートを 2025 年 10 月 14 日以降に終了すると発表しました。

総合的にDPOを超える:Chen Danqi氏のチームはシンプルなプリファレンス最適化SimPOを提案し、最強の8Bオープンソースモデルも洗練させた

Jun 01, 2024 pm 04:41 PM

総合的にDPOを超える:Chen Danqi氏のチームはシンプルなプリファレンス最適化SimPOを提案し、最強の8Bオープンソースモデルも洗練させた

Jun 01, 2024 pm 04:41 PM

大規模言語モデル (LLM) を人間の価値観や意図に合わせるには、人間のフィードバックを学習して、それが有用で、正直で、無害であることを確認することが重要です。 LLM を調整するという点では、ヒューマン フィードバックに基づく強化学習 (RLHF) が効果的な方法です。 RLHF 法の結果は優れていますが、最適化にはいくつかの課題があります。これには、報酬モデルをトレーニングし、その報酬を最大化するためにポリシー モデルを最適化することが含まれます。最近、一部の研究者はより単純なオフライン アルゴリズムを研究しており、その 1 つが直接優先最適化 (DPO) です。 DPO は、RLHF の報酬関数をパラメータ化することで、選好データに基づいてポリシー モデルを直接学習するため、明示的な報酬モデルの必要性がなくなります。この方法は簡単で安定しています

OpenAI データは必要ありません。大規模なコード モデルのリストに加わりましょう。 UIUC が StarCoder-15B-Instruct をリリース

Jun 13, 2024 pm 01:59 PM

OpenAI データは必要ありません。大規模なコード モデルのリストに加わりましょう。 UIUC が StarCoder-15B-Instruct をリリース

Jun 13, 2024 pm 01:59 PM

ソフトウェア テクノロジの最前線に立つ UIUC Zhang Lingming のグループは、BigCode 組織の研究者とともに、最近 StarCoder2-15B-Instruct 大規模コード モデルを発表しました。この革新的な成果により、コード生成タスクにおいて大きな進歩が達成され、CodeLlama-70B-Instruct を上回り、コード生成パフォーマンス リストのトップに到達しました。 StarCoder2-15B-Instruct のユニークな特徴は、その純粋な自己調整戦略であり、トレーニング プロセス全体がオープンで透過的で、完全に自律的で制御可能です。このモデルは、高価な手動アノテーションに頼ることなく、StarCoder-15B 基本モデルの微調整に応じて、StarCoder2-15B を介して数千の命令を生成します。

LLMはすべて完了しました! OmniDrive: 3D 認識と推論プランニングの統合 (NVIDIA の最新)

May 09, 2024 pm 04:55 PM

LLMはすべて完了しました! OmniDrive: 3D 認識と推論プランニングの統合 (NVIDIA の最新)

May 09, 2024 pm 04:55 PM

上記と著者の個人的な理解: この論文は、自動運転アプリケーションにおける現在のマルチモーダル大規模言語モデル (MLLM) の主要な課題、つまり MLLM を 2D 理解から 3D 空間に拡張する問題の解決に特化しています。自動運転車 (AV) は 3D 環境について正確な決定を下す必要があるため、この拡張は特に重要です。 3D 空間の理解は、情報に基づいて意思決定を行い、将来の状態を予測し、環境と安全に対話する車両の能力に直接影響を与えるため、AV にとって重要です。現在のマルチモーダル大規模言語モデル (LLaVA-1.5 など) は、ビジュアル エンコーダーの解像度制限や LLM シーケンス長の制限により、低解像度の画像入力しか処理できないことがよくあります。ただし、自動運転アプリケーションには次の要件が必要です。