Morph Studio: 無料、1080P、7 秒の強力なダークホース ビデオ編集ソフトウェアが登場

「光るクラゲが海からゆっくりと浮かび上がる」と、Morph Studio で見たいものを入力し続け、「夜空できらめく星座に変わります」。

数分後、Morph Studio によって短いビデオが生成されます。クラゲは完全に透明でキラキラと回転し上昇し、その揺れる姿は夜空の星と対照的です。

光るクラゲが魅惑的な海から浮かび上がり、暗い空で輝く星に変わります。

かつて一世を風靡した「ジョーカー シネマティック」に登場します。世界 あの顔が戻ってきた。

ホアキン フェニックスは、ニューヨークのネオンが輝く街路を舞台にした映画のようなショットで、ジョーカーとして非常にリアルな演技を披露しています。彼の周囲には煙が立ち込め、混沌とした雰囲気がさらに増しています。暗闇。

最近、新興企業の Morph Studio が、テキストからビデオへの生成テクノロジーとコミュニティに重要なアップデートを行いました。彼らのモデルは大幅なアップデートを受けており、これらのビデオ作品では、鮮明な画像と鮮やかなディテールでアップデートされたモデルを披露しています。

Morph Studio は、Runway が Gen2 をパブリック ベータ版でリリースするよりも前に、一般の人が自由にテストできるテキストからビデオへの製品を公開した世界初のチームです。

他の人気のあるテキストからビデオへの変換製品と比較すると、Morph Studio は無料サービスという点で異なります。デフォルトの 1080P 解像度と、開始から最大 7 秒のビルド時間を提供します。テキストからビデオへの製品では、より高い解像度、より長い生成時間、より適切な意図の表現が 3 つの重要な指標となります。 Morph は、これら 3 つの指標において業界の最新レベルに達しています。

ハリウッド映画の 1 ショットの平均の長さは 6 秒ですが、生成時間を 7 秒に延長することで、より多くのユーザーのクリエイティブなニーズを引き出すことができます。

Morph Studioのモデルはdiscordに登録することで簡単に無料で体験することができます。

画面上の赤いボックス内に「pro」という単語が表示されているモデルが更新されたモデルであり、この記事の体験の対象です。

カメラの動きはビデオ制作の基本言語であり、強力な物語の装置です。 Morph は、ズーム、パン (上下左右)、回転 (時計回りまたは反時計回り)、静止画ショットなど、いくつかの一般的なカメラ言語を提供します。

Morph は、ビデオの動きを制御する MOTION 機能 (1 ~ 10) も提供します。値が大きいほど動作は激しく大げさになり、値が小さいほど動作は繊細で滑らかになります。

フレーム レート (FPS) の調整範囲は 8 ~ 30 です。値が大きいほど、ビデオは滑らかになり、サイズは大きくなります。たとえば、-FPS 30 では、最もスムーズでありながら最大のビデオが生成されます。デフォルトでは、すべてのビデオは 24 フレーム/秒で作成されます。

デフォルトのビデオの長さは 3 秒です。7 秒のビデオを生成するには、コマンドに -s 7 を入力します。さらに、このモデルでは 5 つのビデオ比率から選択できます。

レンズ、フレーム レート、ビデオの長さなどの詳細に関する要件がある場合は、コンテンツ プロンプトを入力した後、引き続き対応するパラメーターを入力してください。 (現在は英語入力のみ対応しております。)

今回のアップデートモデルサービスを体験して、1080Pがもたらす視覚的な衝撃を強く感じました。

#つい最近まで、人類は星空の下を歩くユキヒョウの写真を初めて撮影していました:

# #星空の下を歩くユキヒョウを人間が撮影した初の写真。

知りたいのですが、Morph Studio のモデルはこの比較的珍しい動物のビデオを生成できるでしょうか?

同じプロンプトで、動画の上部に Morph Studio の作品を、動画の下部に Pika で生成した作品を配置します。

星空の下を歩くユキヒョウ、映画のようなリアル、超詳細、-モーション 10、-ar 16:9、-ズームイン、-パンアップ、-fps 30、- 7. 否定的: 余分な手足、欠損した腕と脚、融合した指と脚、余分な指、外観の損傷

Morph Studio の解答用紙、文章が正確に理解できます。 1080P の写真では、ユキヒョウの毛皮が細部まで豊かに表現されており、本物そっくりです。背景には天の川と星が見えます。しかし、ユキヒョウの動きは明らかではありません。

ピカの宿題では、確かにユキヒョウが歩いていますが、夜空はガチョウの羽と大雪の夜として理解されているようです。 Snow Leopard のスタイル、ディテール、画像の鮮明さの点では、まだギャップがあります。

キャラクター生成の効果を見てみましょう。

傑作最高品質の超詳細な RAW ビデオ 1 人の女の子のソロ ダンス デジタル ペインティング美しいサイボーグ少女 21 歳の長いウェーブのかかった赤い髪、青い目、繊細な淡い白い肌、完璧なボディ、不気味な夜明けの光の中で歌っています。 post-apocalyp

Morph Studio で生成された作品では、高解像度により非常に繊細な顔の輪郭や微表情が表現されており、夜明けの光の下では髪の細部がはっきりと見えます。

解像度、色、光レベルが不足しているため、Pika によって生成される全体的な画像は青みがかっており、キャラクターの顔の詳細は満足のいくものではありません。

人間や動物も経験していますが、建物(人工物)の生成効果を見てみましょう。

ラ・トーレ・アイフェル星空の夜ゴッホ壮大なスタイリッシュなファインアート複雑な深い色が流れるふわふわ動く雲

そしてピカの作品はむしろ絵画ですテクスチャ 写真と比較すると、Morph Studio の作品はゴッホの要素と写実的な要素のバランスが優れています。光のレベルが非常に豊かで、特に雲海の流れるディテールが特徴的です。Pika の作品の空はほとんど静止しています。

最後に、自然景観づくりを体験します。

ある早朝、太陽が海面からゆっくりと昇り、波が穏やかにビーチに触れました。

Morph Studio について疑問に思うかもしれません。作品は人間の写真家が自然条件下で撮影した実際の写真ではありません。

Pika によって生成されたビデオには、微妙な光と影のレベルが欠けているため、波とビーチは平坦に見え、ビーチに打ち寄せる波の動きは比較的鈍く見えます。

高解像度によってもたらされる衝撃的な体験に加えて、同じプロンプトでビデオ (動物、建物、人物、自然風景のテーマなど) を生成することで、対戦相手は多かれ少なかれ「 「ミス」、Morph Studio のパフォーマンスは比較的安定しており、例外的なケースは比較的少なく、ユーザーの意図をより正確に予測できます。

当初から、このスタートアップ企業の Vincent Video についての理解は、ビデオはユーザー入力を非常に正確に記述できなければならないということであり、すべての最適化作業もこの方向に進んでいます。 Morph Studio のモデル構造は、テキストの意図をより深く理解できるようになり、今回のアップデートでは構造にいくつかの変更が加えられ、一部のデータに対してより詳細な注釈が特別に追加されました。

比較的優れたテキスト理解能力に加えて、高解像度の出力によって画像の詳細な処理が妨げられることはありません。実際、モデル更新後は画面のモーション内容がより豊富になり、Morph Studioで生成した作品にもそれが反映されています。

『真珠の耳飾りの少女』 頭が動くとイヤリングもわずかに揺れ、乗馬などのより複雑なアクションを伴うシーンもよりスムーズで一貫性があり、論理的です。手の動きも出力も良好です。

1080P は、モデルがより多くのピクセルを処理する必要があることを意味し、ディテールの生成に大きな課題をもたらしますが、結果から判断すると、画像が崩れていないだけでなく、豊富なレイヤー より詳細でより表現力豊かに。

#これは、壮大な巨大な波や火山の噴火、繊細な花のクローズアップなど、模型を使用して生成された自然の風景のセットです。

高解像度の出力はユーザーに視覚的な楽しみをもたらしますが、モデルの出力時間が長くなり、エクスペリエンスに影響を与えます。

Morph Studio は 1080p ビデオを 3 分半で生成するようになりました。これは、Pika が 720P ビデオを生成するのと同じ速度です。新興企業のコンピューティング リソースは限られているため、Morph Studio が SOTA を維持するのは簡単ではありません。

さらに、ビデオ スタイルに関しては、映画のリアリズムに加えて、Morph Studio モデルはコミックや 3D アニメーションなどの一般的なスタイルもサポートしています。

Morph Studio が注力しているテキスト動画変換技術は、AI 業界の競争における次の段階とみなされています。

「インスタントビデオはAI技術の次の飛躍となるかもしれない」とニューヨークタイムズ紙は技術レポートの見出しで述べ、インスタントビデオはウェブブラウザやiPhoneと同じくらい重要になると主張した。

2022 年 9 月に、Meta の機械学習エンジニア チームは、Make-A-Video と呼ばれる新しいシステムを立ち上げました。ユーザーがシーンの大まかな説明を入力すると、システムは対応する短い動画を生成します。ビデオ。

2022 年 11 月には、清華大学と北京人工知能アカデミー (BAAI) の研究者も CogVideo をリリースしました。

当時、これらのモデルによって生成されたビデオはぼやけていただけでなく (たとえば、CogVideo によって生成されたビデオ解像度はわずか 480 x 480 でした)、画像も比較的歪んでいました。そして多くの技術的な制限がありました。しかし、それらは依然として AI コンテンツ生成における重要な発展を表しています。

ビデオは、表面的には、動いているように見せる方法でまとめられた一連のフレーム (静止画像) にすぎません。ただし、時間と空間における一連の画像の一貫性を確保することははるかに困難です。

普及モデルの登場により、テクノロジーの進化は加速しました。研究者たちは、この普及モデルをオーディオ、3D、ビデオなどの他の領域に一般化することを試みており、ビデオ合成技術は大幅に進歩しました。

拡散モデルに基づくテクノロジーでは、主に、大量の画像、ビデオ、テキストの説明を分類することで、ニューラル ネットワークがいくつかのパターンを自動的に学習できます。コンテンツ要件を入力すると、ニューラル ネットワークは、画像の作成に使用できると考えられるすべての特徴のリストを生成します (猫の耳の輪郭や電話の端を考えてください)。

次に、2 番目のニューラル ネットワーク (拡散モデルとも呼ばれます) が画像の作成と、これらの特徴に必要なピクセルの生成、およびピクセルの一貫した画像への変換を担当します。 。何千ものビデオを分析することで、AI は同様に一貫した方法で多くの静止画像をつなぎ合わせる方法を学習できます。重要なのは、各フレーム間の関係と一貫性を真に理解するモデルをトレーニングすることです。

「これは、私たちが過去 100 年間に構築してきた最も印象的なテクノロジーの 1 つです」と、Runway CEO のクリストバル・ヴァレンズエラ氏はかつてメディアに語ったことがあります。

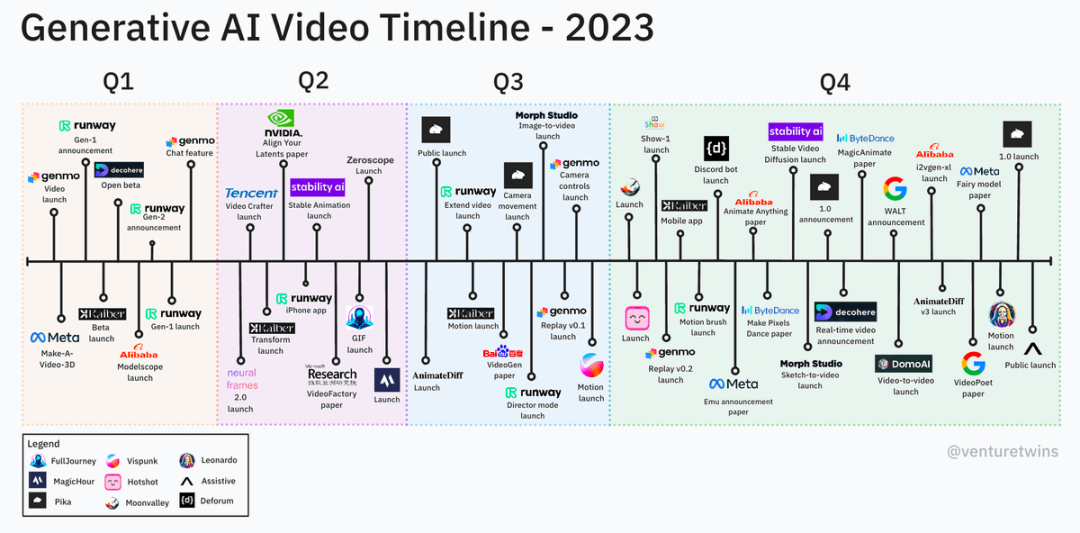

業界の一部では、2023 年はビデオ合成にとって画期的な年であると考えられています。 1 月にはテキストからビデオへの変換モデルは公開されていませんでしたが、年末までに数十の同様の製品と数百万のユーザーが存在しました。

a16z パートナーの Justine Moore が、Vincent のビデオ モデルのタイムラインをソーシャル プラットフォームで共有しました。そこから、大手メーカー以外にも多くのモデルがあることがわかります。 . さらに、スタートアップ企業はテクノロジーの反復のスピードが非常に速いです。

現在の AI 生成ビデオは、LLM のような統一的で明確な技術パラダイムを形成しておらず、業界は安定したビデオを生成する方法についてまだ模索段階にあります。しかし、研究者らは、システムがより多くのデータでトレーニングされるにつれて、これらの欠陥を排除できると信じています。最終的には、このテクノロジーにより、文章を書くのと同じくらい簡単にビデオを作成できるようになるでしょう。

国内の AI 業界の上級投資家は、Vincent Video Technology に関する最も重要な論文のいくつかが 2022 年 7 月から 8 月にかけて出版されたと語った。これは、Vincent Picture In the world と同様である。産業化の過程で、この技術が産業化に近づくポイントは1年後、つまり2023年7月から8月に現れるでしょう。

ビデオ テクノロジ全体が非常に急速に発展しており、テクノロジはますます成熟しています。この投資家は、GAN 分野でのこれまでの投資経験に基づいて、次の分野では次のことが起こると予測していると述べました。 Text-to-Video 技術の製品化期間は 6 か月から 1 年となります。

Morph チームには、ビデオ生成の分野で最も優れた若手研究者が集まっており、過去 1 年間昼夜を問わず集中的な研究開発を行った後、創設者の Xu Huaizhe と共同創設者の Li Feng は、 、イン・ジーシン、チャオ・シーハオ、リュー・シャオテン 他のコア技術バックボーンと協力して、私たちはAIビデオ生成の問題を克服しました。

技術チームに加えて、Morph Studio は最近プロダクト チームも強化しました。ハイ氏は Maoyan Films の契約プロデューサーであり、上海国際映画祭の審査員であり、中心人物でもあります。元シリコンバレーの AIGC 社のメンバーであり、Xin も最近 Morph Studio に加わりました。

Heising 氏は、Morph Studio は技術研究の面で業界全体で主導的な地位を占めており、チームはフラットで、コミュニケーション効率と実行力は特に高く、メンバー全員が業界に対して情熱を持っていると述べました。彼女の最大の夢はアニメ会社に入社することだった。 AI 時代の到来後、彼女はアニメーション業界が将来的に変化することにすぐに気づきました。過去数十年間、アニメーションのベースは 3D エンジンでしたが、間もなく AI エンジンの新時代が到来するでしょう。未来のピクサーはAI企業から生まれる。そしてモーフが彼女の選択だった。

創業者の徐淮哲氏は、「MorphはAIビデオトラックを積極的に展開しており、AIビデオ時代のスーパーアプリとなり、ユーザーの夢を実現する決意である」と述べた。

このトラックには、2024 年に独自のミッドジャーニーの瞬間が訪れるだろうと彼は付け加えた。

PS: 無料の 1080P ビデオ生成の本来の楽しみを体験するには、次のリンクにアクセスしてください:

https://discord.com/invitation /VVqS8QnBkA

以上がMorph Studio: 無料、1080P、7 秒の強力なダークホース ビデオ編集ソフトウェアが登場の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7630

7630

15

15

1389

1389

52

52

89

89

11

11

31

31

141

141

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

画質を圧縮せずにWeiboに動画を投稿する方法_画質を圧縮せずにWeiboに動画を投稿する方法

Mar 30, 2024 pm 12:26 PM

画質を圧縮せずにWeiboに動画を投稿する方法_画質を圧縮せずにWeiboに動画を投稿する方法

Mar 30, 2024 pm 12:26 PM

1. まず携帯電話で Weibo を開き、右下隅の [Me] をクリックします (図を参照)。 2. 次に、右上隅の [歯車] をクリックして設定を開きます (図を参照)。 3. 次に、[一般設定] を見つけて開きます (図を参照)。 4. 次に、[Video Follow] オプションを入力します (図を参照)。 5. 次に、[ビデオアップロード解像度]設定を開きます(図を参照)。 6. 最後に、圧縮を避けるために [オリジナルの画質] を選択します (図を参照)。

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません