GPT-5のプレビュー!アレン人工知能研究所が GPT-5 の新機能を予測する最強のマルチモーダル モデルをリリース

GPT-5 はいつ登場しますか?また、どのような機能がありますか?

アレン AI 研究所の新しいモデルがその答えを教えてくれます。

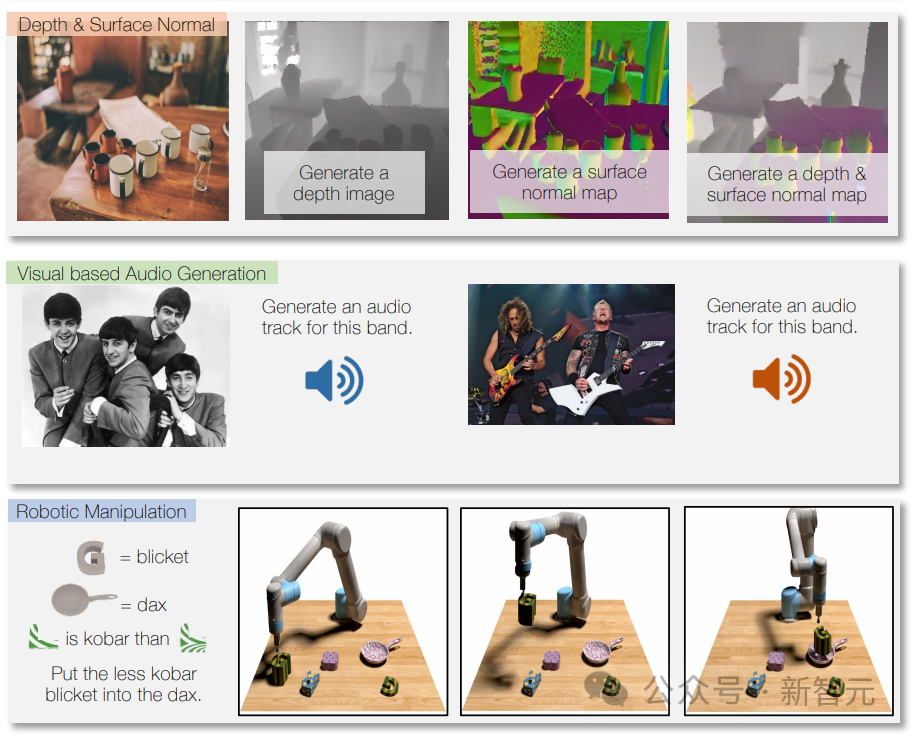

アレン人工知能研究所によって発表された Unified-IO 2 は、テキスト、画像、オーディオ、ビデオ、およびアクション シーケンスを処理および生成できる最初のモデルです。

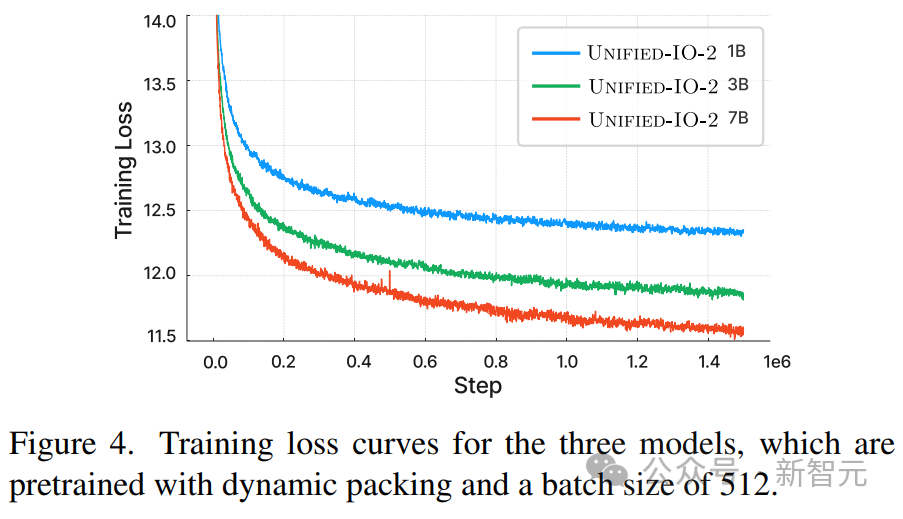

この高度な AI モデルは、数十億のデータ ポイントを使用してトレーニングされており、モデルのサイズはわずか 70 億ですが、これまでで最も広範なマルチモーダル機能を示します。

論文アドレス: https://arxiv.org/pdf/2312.17172.pdf

それでは、Unified-IO 2 と GPT-5 の関係は何ですか?

2022 年 6 月、アレン人工知能研究所は、画像と言語を同時に処理できるマルチモーダル モデルの 1 つとなる、第 1 世代の Unified-IO を発表しました。

同じ頃、OpenAI は内部で GPT-4 をテストしており、2023 年 3 月に正式にリリースする予定です。

つまり、Unified-IO は、将来の大規模 AI モデルのプレビューとして見ることができます。

とはいえ、OpenAI は内部で GPT-5 をテストしている可能性があり、数か月以内にリリースされる予定です。

#今回 Unified-IO 2 によって示された機能は、新年に期待できるものでもあります。

## New #GPT-5 のような AI モデルは、より多くのモダリティを処理し、広範な学習を通じて多くのタスクをネイティブに実行でき、オブジェクトやロボットとの対話についての基本的な理解を得ることができます。

Unified-IO 2 のトレーニング データには、10 億の画像とテキストのペア、1 兆のテキスト トークン、1 億 8,000 万のビデオ クリップ、1 億 3,000 万の画像が含まれます。テキスト、300 万の 3D アセット、および 100 万のロボット エージェントのモーション シーケンス。

研究チームは、合計 120 を超えるデータセットを、220 の視覚、言語、聴覚、運動タスクをカバーする 600 TB のパッケージに結合しました。

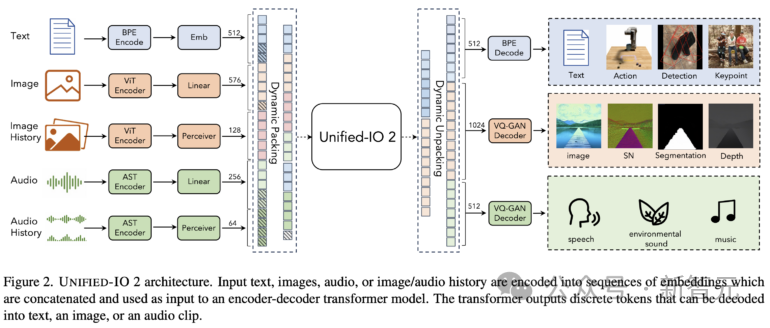

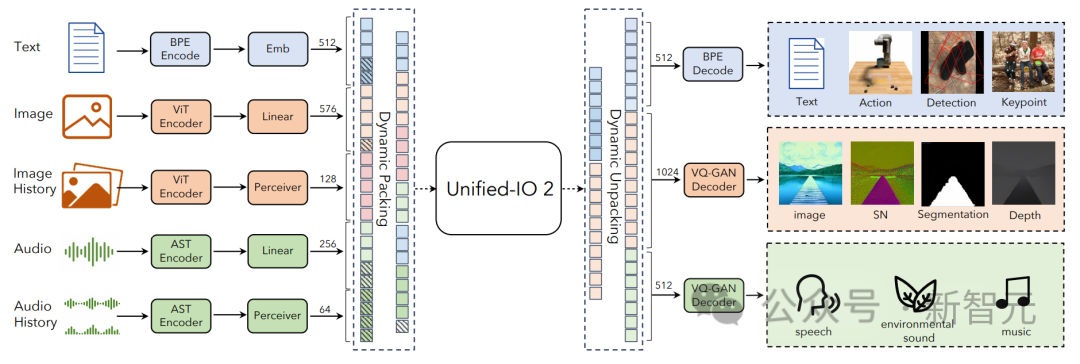

Unified-IO 2 は、トレーニングを安定させ、マルチモーダル信号を効果的に利用するために、いくつかの変更を加えたエンコーダー/デコーダー アーキテクチャを採用しています。

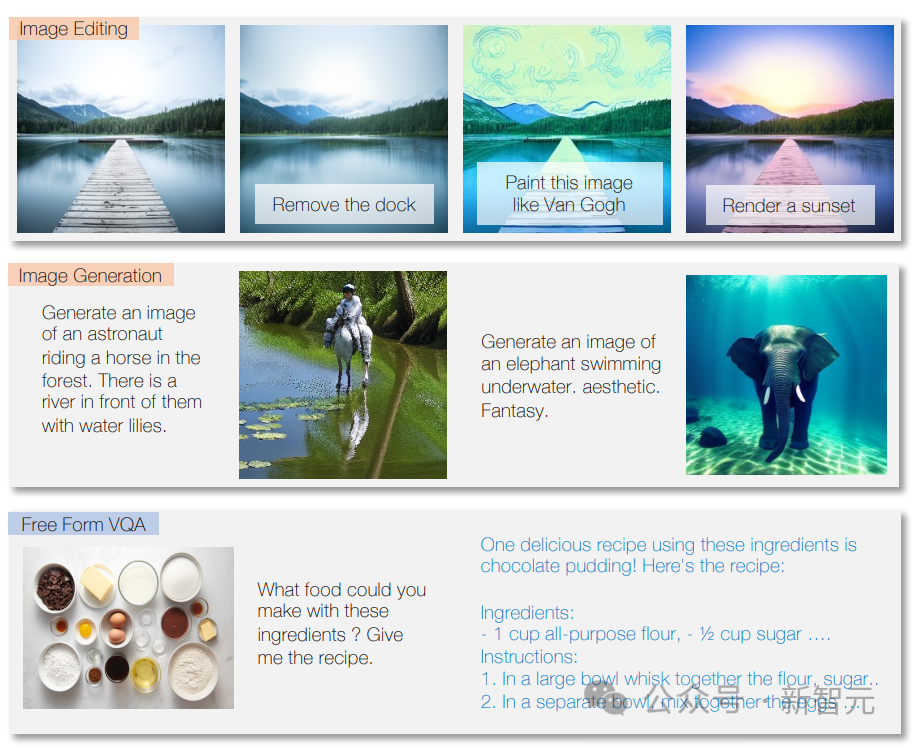

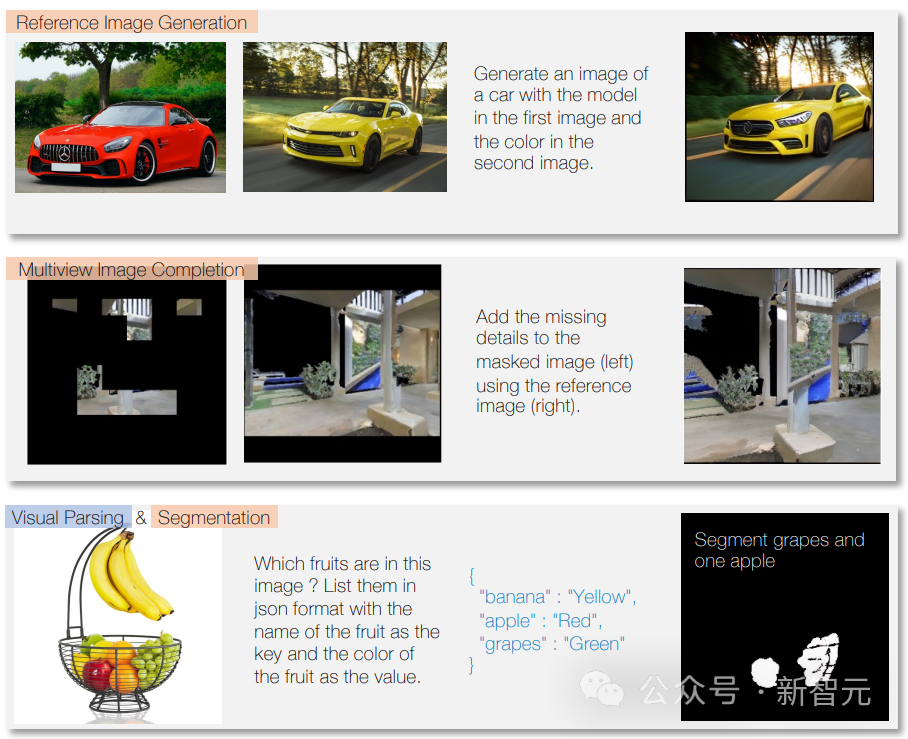

モデルは、質問に答え、指示に従ってテキストを作成し、テキストの内容を分析できます。

マルチモーダル トレーニングのおかげで、画像上の特定のトラックで使用されている楽器にラベルを付けるなど、さまざまなモダリティも処理できます。

ほとんどのタスクにおいて、専用モデルと同等かそれ以上の性能を発揮します。

Unified-IO 2 は、画像タスクの GRIT ベンチマークでこれまでのところ最高スコアを達成しました (GRIT は、モデルが画像ノイズやその他の問題をどのように処理するかをテストするために使用されます)。

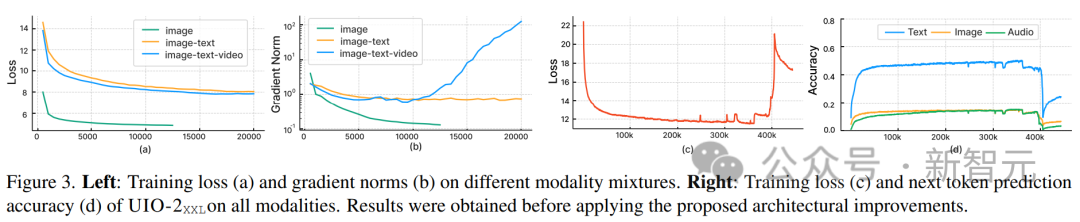

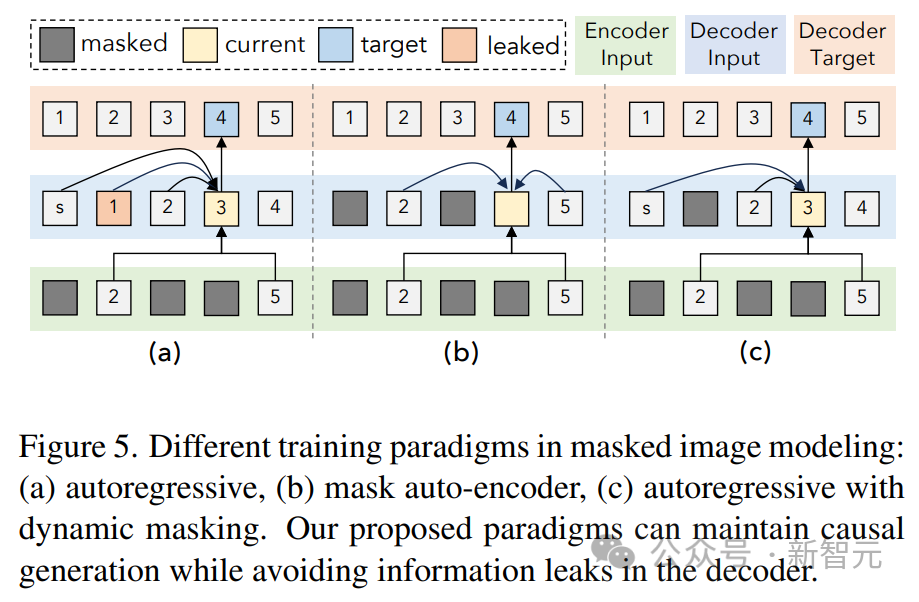

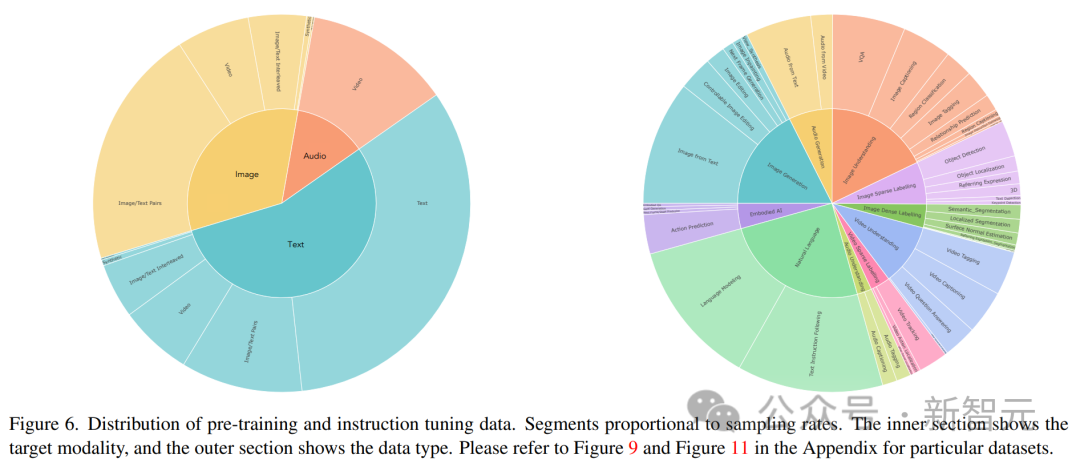

研究者らは現在、Unified-IO 2 をさらに拡張し、データ品質を向上させ、エンコーダ/デコーダ モデルを業界標準のデコーダ モデル アーキテクチャに変換することを計画しています。 Unified-IO 2 は、画像、テキスト、オーディオ、モーションのマルチモーダル モデルを理解して生成する初の自己回帰モデルです。 さまざまなモダリティを統合するために、研究者は入力と出力 (画像、テキスト、オーディオ、アクション、境界ボックスなど) を共有の意味論的空間にラベル付けし、単一のエンコーダーを使用します。デコーダコンバータモデルがそれを処理します。 モデルのトレーニングにさまざまなモダリティからの大量のデータが使用されたため、研究者は全体を改善するために一連の手法を採用しました。トレーニングのプロセス。 複数のモダリティにわたる信号の自己教師あり学習を効果的に促進するために、研究者らは、クロスモーダルなノイズ除去と生成を組み込んだ、デノイザー ターゲットの新しいマルチモーダル ハイブリッドを開発しました。 ダイナミック パッキングも開発され、非常に可変性の高いシーケンスを処理するためにトレーニング スループットを 4 倍に向上させました。 トレーニングにおける安定性とスケーラビリティの問題を克服するために、研究者らは、2D 回転埋め込み、QK 正規化、スケーリングされたコサイン アテンション メカニズムなど、パーセプトロン リサンプラーのアーキテクチャに変更を加えました。 ディレクティブを調整する場合は、既存のミッションを使用するか、新しいミッションを作成するかにかかわらず、各ミッションに明確なプロンプトがあることを確認してください。オープンエンドのタスクも含まれており、タスクと指導の多様性を高めるために、あまり一般的ではないパターンに対して合成タスクが作成されます。 マルチモーダル データを共有表現空間内の一連のトークンにエンコードします。次のものが含まれます。いくつかの側面: テキストの入出力は、LLaMA のバイト ペア エンコーディングを使用してトークン化され、次のようなスパース構造境界ボックス、キーポイント、カメラのポーズは離散化され、語彙に追加された 1000 個の特別なマーカーを使用してエンコードされます。 点は 2 つのマーカー (x、y) を使用してエンコードされ、ボックスは 4 つのマーカーのシーケンス (左上と右下) でエンコードされ、3D 直方体は 12 のマーカー (エンコード投影中心、仮想深度、対数正規化ボックス サイズ、および連続同心円回転)。 具体化されたタスクの場合、個別のロボットの動作はテキスト コマンド (「前進」など) として生成されます。特別なタグを使用して、ロボットの状態 (位置や回転など) をエンコードします。 画像は、事前トレーニングされた Visual Transformer (ViT) を使用してエンコードされます。 ViT の 2 番目と最後から 2 番目の層のパッチ フィーチャが連結されて、低レベルと高レベルの視覚情報がキャプチャされます。 画像を生成するときは、VQ-GAN を使用して画像を離散ラベルに変換します。ここでは、パッチ サイズ 8 × 8 の高密度の事前トレーニング済み VQ-GAN モデルが使用されます256 × 256 の画像を変換するには、エンコードは 1024 トークン、コードブック サイズは 16512 です。 各ピクセルのラベル (深度、表面法線、バイナリ セグメンテーション マスクを含む) は、RGB イメージとして表されます。 U-IO 2 は、最大 4.08 秒のオーディオをスペクトログラムにエンコードし、事前トレーニングされたオーディオ スペクトログラム変換を使用します。画像 ViT と同様に、AST の 2 番目と最後から 2 番目の層の特徴を連結し、線形層を適用することで、スペクトログラムをエンコードし、入力埋め込みを構築します。 オーディオを生成する場合、ViT-VQGAN を使用してオーディオを離散マーカーに変換します。モデルのパッチ サイズは 8 × 8 で、256 × 128 スペクトログラムは 512 トークンにエンコードされます. コードブックのサイズは 8196 です。 このモデルでは、最大 4 つの追加の画像と音声クリップを入力として提供できます。これらの要素も提供されますViT または AST を使用してエンコードされ、その後パーセプトロン リサンプラーを使用して特徴をさらに小さい数 (画像の場合は 32、音声の場合は 16) に圧縮します。 これにより、シーケンスの長さが大幅に短縮され、モデルが履歴の要素をコンテキストとして使用しながら、画像またはオーディオ クリップを詳細に検査できるようになります。 研究者らは、他のモデルを統合する際に、U-IO 実装結果を使用した後の標準が重要であることに気づきました。ますます不安定なトレーニング中。 以下の (a) と (b) に示すように、画像生成 (緑色の曲線) のみをトレーニングすると、安定した損失と勾配ノルムが収束します。 画像とテキストのタスクの組み合わせ (オレンジ色の曲線) を導入すると、単一モダリティと比較して勾配ノルムがわずかに増加しますが、安定したままです。ただし、ビデオ モダリティ (青い曲線) を含めると、勾配ノルムが無制限にアップグレードされます。 図の (c) と (d) に示すように、XXL バージョンのモデルをすべてのモダリティでトレーニングすると、損失はは 350k ステップの後に爆発的に増加し、次のラベルの予測精度は 400k ステップで大幅に低下します。 この問題を解決するために、研究者はアーキテクチャにさまざまな変更を加えました。 各 Transformer 層で回転位置埋め込み (RoPE) を適用します。非テキスト モダリティの場合、RoPE は 2D 位置に拡張されます。画像および音声モダリティが含まれる場合、LayerNorm はドット積アテンション計算の前に Q および K に適用されます。 また、パーセプトロン リサンプラーを使用して、各画像フレームとオーディオ クリップを固定数のトークンに圧縮し、スケーリングされたコサイン アテンションを使用してパーセプトロンのより厳密な削減を適用します。これにより、トレーニングが大幅に安定します。 。 数値の不安定性を回避するために、float32 アテンション対数も有効になり、ViT と AST は事前トレーニング中にフリーズされ、命令調整の最後に微調整されます。 上の図は、入力モダリティと出力モダリティが異質であるにもかかわらず、モデルの事前トレーニング損失が安定していることを示しています。 この記事は UL2 パラダイムに従います。画像と音声のターゲットについては、2 つの同様のパラダイムがここで定義されています: [R]: ノイズ除去をマスクし、入力画像または音声パッチの特徴の x% をランダムにマスクし、モデルを再構築させます。 it; [S]: 他の入力モーダル条件下でターゲット モダリティを生成するようにモデルに要求します。 トレーニング中は、モーダル マーカー ([テキスト]、[画像]、または [音声]) およびパラダイム マーカー ([R]、[S]、または [X]) を次のように使用します。タスクを示すテキストのプレフィックスを入力し、自動回帰に動的マスキングを使用します。 上図に示すように、画像と音声のマスキングノイズ除去の問題の 1 つは、デコーダ側での情報漏洩です。 ここでの解決策は、デコーダでトークンをマスクすることです (トークンを予測している場合を除く)。これにより、データ漏洩を排除しながら因果関係の予測を妨げません。 大量のマルチモーダル データをトレーニングすると、一連のコンバータ入力が発生します。出力の長さは大きく変化します。 ここでは、この問題を解決するためにパッキングが使用されています。複数のサンプルのタグがシーケンスにパックされ、コンバーターがサンプル間で交差するのを防ぐために注意が遮られます。 トレーニング中に、ヒューリスティック アルゴリズムを使用してモデルにストリーミングされたデータを再配置し、長いサンプルがパック可能な短いサンプルと一致するようにします。この記事のダイナミック パッケージ化により、トレーニングのスループットが 4 倍近く増加します。 マルチモーダル命令チューニングは、さまざまなモダリティで異なるスキルと能力をモデルに装備し、新しい命令にも適応することです。主要なプロセスに対する独自の指示。 研究者らは、広範囲の教師付きデータセットとタスクを組み合わせて、マルチモーダルな命令調整データセットを構築しました。 コマンドチューニングデータの分布を上図に示します。全体として、命令チューニングの組み合わせは、60% のヒント データ、30% の事前トレーニングから継承されたデータ (致命的な忘れを避けるため)、6% の既存のデータ ソースを使用して構築されたタスク拡張データ、および 4% の自由形式のテキスト (有効にするため) で構成されていました。チャットのような返信)。

Unified-IO 2

統合タスク表現

テキスト、スパース構造と操作

画像と密な構造

オーディオ

画像と音声の履歴

安定したトレーニングのためのモデル アーキテクチャとテクノロジー

マルチモーダル トレーニングの目標

効率の最適化

命令チューニング

以上がGPT-5のプレビュー!アレン人工知能研究所が GPT-5 の新機能を予測する最強のマルチモーダル モデルをリリースの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7451

7451

15

15

1374

1374

52

52

77

77

11

11

14

14

9

9

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

何?ズートピアは国産AIによって実現するのか?ビデオとともに公開されたのは、「Keling」と呼ばれる新しい大規模な国産ビデオ生成モデルです。 Sora も同様の技術的ルートを使用し、自社開発の技術革新を多数組み合わせて、大きく合理的な動きをするだけでなく、物理世界の特性をシミュレートし、強力な概念的結合能力と想像力を備えたビデオを制作します。データによると、Keling は、最大 1080p の解像度で 30fps で最大 2 分の超長時間ビデオの生成をサポートし、複数のアスペクト比をサポートします。もう 1 つの重要な点は、Keling は研究所が公開したデモやビデオ結果のデモンストレーションではなく、ショートビデオ分野のリーダーである Kuaishou が立ち上げた製品レベルのアプリケーションであるということです。さらに、主な焦点は実用的であり、白紙小切手を書かず、リリースされたらすぐにオンラインに移行することです。Ke Ling の大型モデルは Kuaiying でリリースされました。

アメリカ空軍が初のAI戦闘機を公開し注目を集める!大臣はプロセス全体を通じて干渉することなく個人的にテストを実施し、10万行のコードが21回にわたってテストされました。

May 07, 2024 pm 05:00 PM

アメリカ空軍が初のAI戦闘機を公開し注目を集める!大臣はプロセス全体を通じて干渉することなく個人的にテストを実施し、10万行のコードが21回にわたってテストされました。

May 07, 2024 pm 05:00 PM

最近、軍事界は、米軍戦闘機が AI を使用して完全自動空戦を完了できるようになったというニュースに圧倒されました。そう、つい最近、米軍のAI戦闘機が初めて公開され、その謎が明らかになりました。この戦闘機の正式名称は可変安定性飛行シミュレーター試験機(VISTA)で、アメリカ空軍長官が自ら飛行させ、一対一の空戦をシミュレートした。 5 月 2 日、フランク ケンダル米国空軍長官は X-62AVISTA でエドワーズ空軍基地を離陸しました。1 時間の飛行中、すべての飛行動作が AI によって自律的に完了されたことに注目してください。ケンダル氏は「過去数十年にわたり、私たちは自律型空対空戦闘の無限の可能性について考えてきたが、それは常に手の届かないものだと思われてきた」と語った。しかし今では、