ネットワークケーブルに沿って登るのが現実となり、対話を通じてリアルな表現や動きを生成できるAudio2Photoreal

あなたと友達が冷たいモバイル画面越しにチャットしているときは、相手の口調を推測する必要があります。彼が話すとき、彼の表情や行動さえもあなたの心に現れます。もちろんビデオ通話ができれば一番良いのですが、実際はいつでもビデオ通話ができるわけではありません。

遠隔地の友人とチャットしている場合、それは冷たい画面のテキストや表情のないアバターではなく、リアルでダイナミックで表現力豊かなデジタル仮想人物です。この仮想人物は、友人の笑顔、目、微妙な体の動きさえも完璧に再現することができます。もっと優しくて温かい気持ちになれるでしょうか?これはまさに「ネットワークケーブルに沿って這ってあなたを見つけます」という文を体現しています。

これは SF の空想ではなく、現実に実現可能なテクノロジーです。

表情や体の動きには多くの情報が含まれており、内容の意味に大きく影響します。例えば、常に相手の目を見ながら話すのと、目を合わせずに話すのでは全く違う印象を与えますし、相手のコミュニケーション内容の理解にも影響します。私たちは、コミュニケーション中にこれらの微妙な表情や動作を検出し、それらを使用して会話相手の意図、快適さのレベル、理解度を高度に理解する非常に鋭い能力を持っています。したがって、これらの微妙な点を捉えた非常に現実的な会話アバターを開発することは、インタラクションにとって重要です。

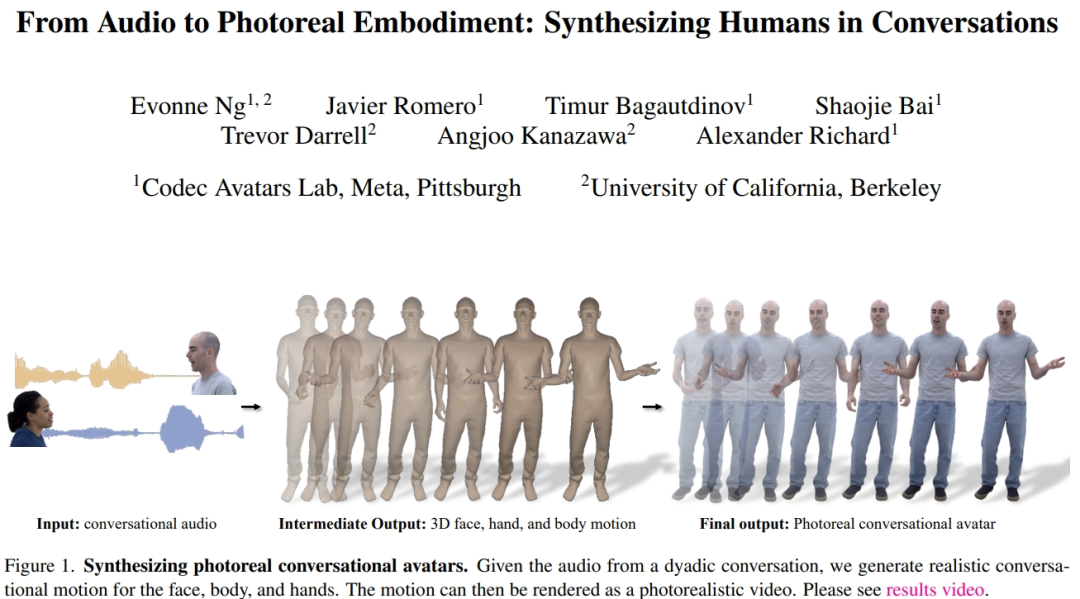

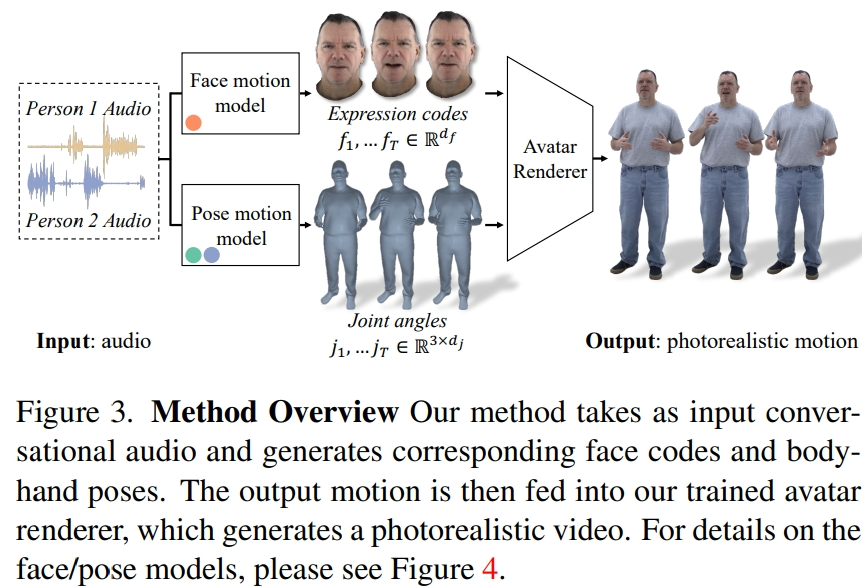

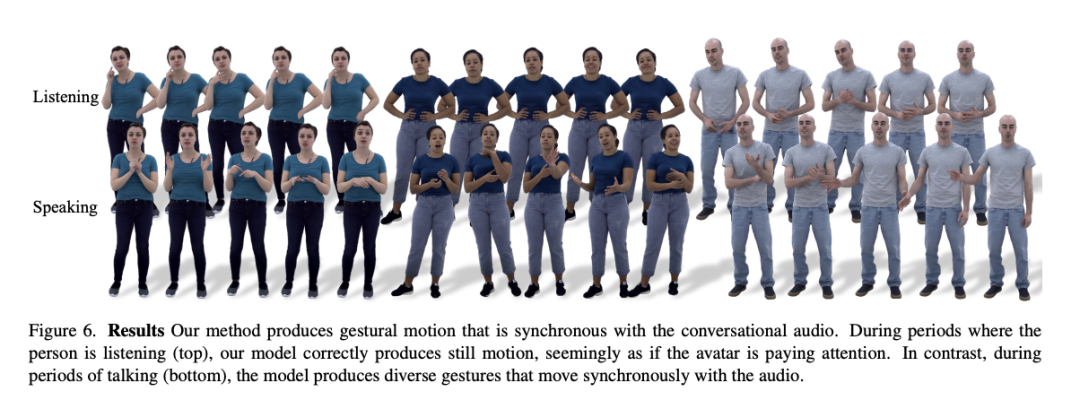

この目的を達成するために、Meta とカリフォルニア大学の研究者は、2 人の会話の音声に基づいて現実的な仮想人間を生成する方法を提案しました。音声と密接に同期したさまざまな高周波ジェスチャーや表情豊かな顔の動きを合成できます。体と手には、自己回帰 VQ ベースのアプローチと拡散モデルの利点が活用されています。顔については、音声を条件とした拡散モデルを使用します。予測された顔、体、手の動きは、現実的な仮想人間にレンダリングされます。我々は、拡散モデルにガイド付きジェスチャー条件を追加すると、以前の研究よりも多様で合理的な会話ジェスチャーを生成できることを実証します。

- 論文アドレス: https://huggingface.co/papers/2401.01885

- # プロジェクトのアドレス: https://people.eecs.berkeley.edu/~ebonne_ng/projects/audio2photoreal/

研究者らは、対人会話のためのリアルな顔、体、手の動きを生成する方法を研究した最初のチームであると述べています。以前の研究と比較して、研究者らは VQ と拡散法に基づいて、より現実的で多様なアクションを合成しました。

方法の概要

研究者らは、記録されたマルチビューデータから潜在的な表情コードを抽出して顔を表現し、運動学的骨格の関節角度を使用して、体の姿勢を表現します。図 3 に示すように、本システムは 2 人の会話音声を入力すると表情コードと体位系列を生成する 2 つの生成モデルから構成されます。表情コードと体のポーズ シーケンスは、ニューラル アバター レンダラーを使用してフレームごとにレンダリングでき、特定のカメラ ビューから顔、体、手を備えた完全にテクスチャ化されたアバターを生成できます。

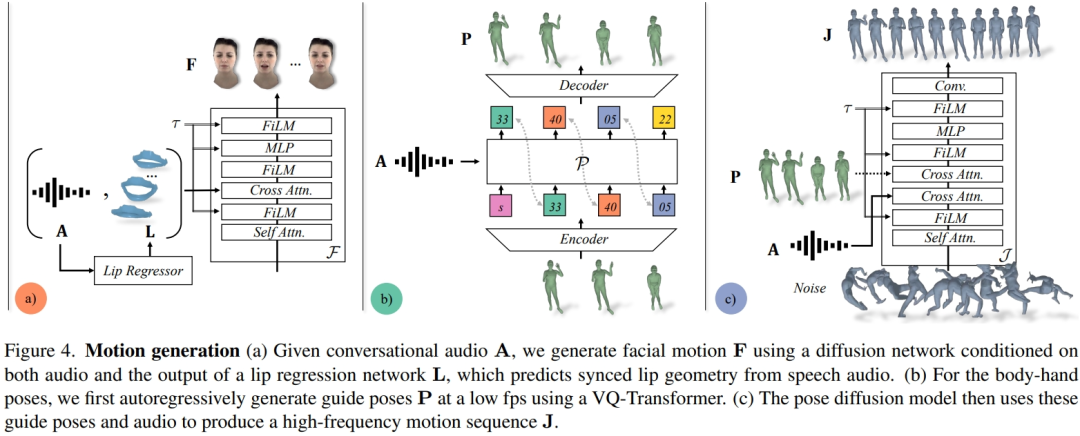

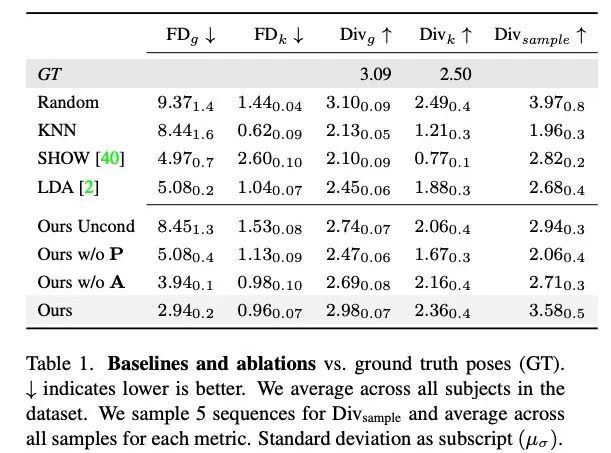

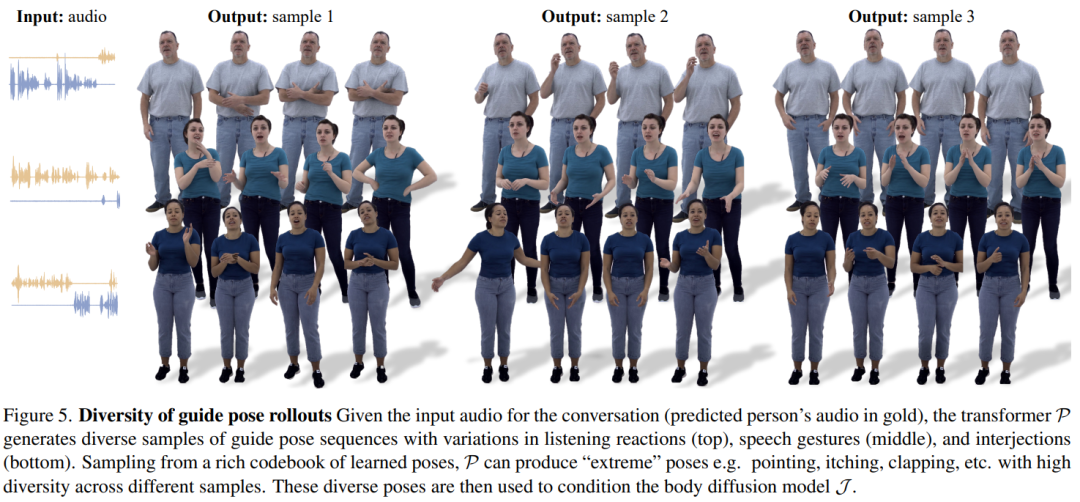

顔の動きモデルは、入力オーディオと、事前にトレーニングされた唇のリグレッサーによって生成された唇の頂点に条件付けされた拡散モデルです (図 4a)。手足の動きのモデルについて、研究者らは、音声のみを条件とした純粋な拡散モデルによって生成された動きは多様性に欠けており、時系列で十分に調整されていないことを発見しました。しかし、研究者がさまざまな指導姿勢を条件にすると、品質は向上しました。したがって、彼らは身体運動モデルを 2 つの部分に分割しました。まず、自己回帰オーディオ コンディショナーが 1 fp で粗い誘導ポーズを予測し (図 4b)、次に拡散モデルがこれらの粗い誘導ポーズを利用して、きめの細かい高精度の誘導ポーズを埋めます。周波数の動き(図4c)。メソッド設定の詳細については、元の記事を参照してください。 研究者らは、実際の音声に基づいてリアルな対話アクションを生成する Audio2Photoreal の有効性を定量的に評価しました。データ能力。定量的な結果を裏付け、特定の会話コンテキストでジェスチャを生成する際の Audio2Photoreal の適切性を測定するために、知覚評価も実行されました。実験結果は、ジェスチャが 3D メッシュではなく現実的なアバター上で提示された場合に、評価者が微妙なジェスチャに対してより敏感になることを示しました。 研究者らは、この手法の生成結果を、トレーニング セット内のランダム モーション シーケンスに基づく 3 つのベースライン手法 (KNN、SHOW、および LDA) と比較しました。アブレーション実験は、音声またはガイド付きジェスチャーなし、ガイド付きジェスチャーなしで音声に基づく、音声なしでガイド付きジェスチャーに基づく Audio2Photoreal の各コンポーネントの有効性をテストするために実施されました。 定量的結果 表 1 は、以前の研究と比較して、この方法が世代の多様性が最も高いことを示しています。 FD スコアは運動時に最も低くなります。ランダムは GT と一致する優れた多様性を持っていますが、ランダム セグメントは対応する会話のダイナミクスと一致しないため、FD_g が高くなります。 # 図 5 は、私たちの方法によって生成された誘導ポーズの多様性を示しています。 VQ ベースのトランスフォーマー P サンプリングにより、同じオーディオ入力で非常に異なるジェスチャを生成できます。

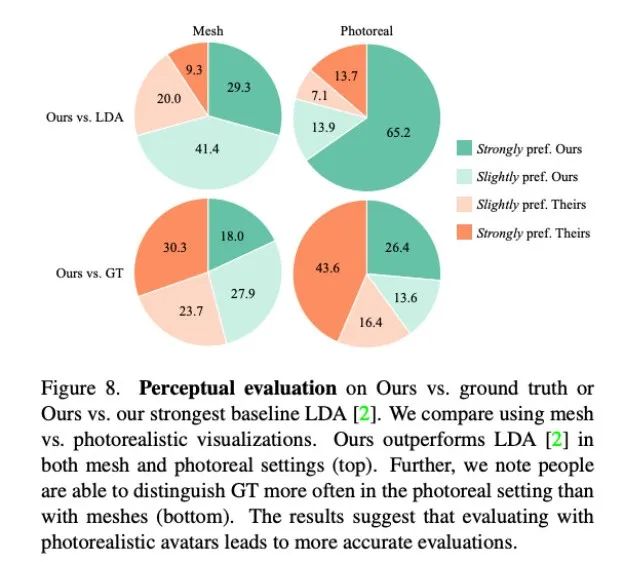

対話におけるジェスチャーの一貫性により、定量的に評価することは難しいため、研究者らは評価に定性的な方法を使用しました。彼らは MTurk で 2 セットの A/B テストを実施しました。具体的には、評価者に、私たちの手法とベースライン手法で生成された結果、または私たちの手法と実際のシーンのビデオのペアを見て、どのビデオの動きがより合理的に見えるかを評価するように依頼しました。 図 8 に示すように、この方法は以前のベースライン方法 LDA よりも大幅に優れており、レビュー担当者の約 70% がグリッドとリアリズムの点で Audio2Photoreal を好みます。 図 8 の上部のグラフに示すように、LDA と比較して、この手法に対する評価者の評価は「やや好き」から「非常に好き」に変化しました。現実と比較しても同様の評価が示されている。それでも、評価者はリアリズムに関しては、Audio2Photoreal よりも本物を支持しました。 技術的な詳細については、元の論文をお読みください。

実験と結果

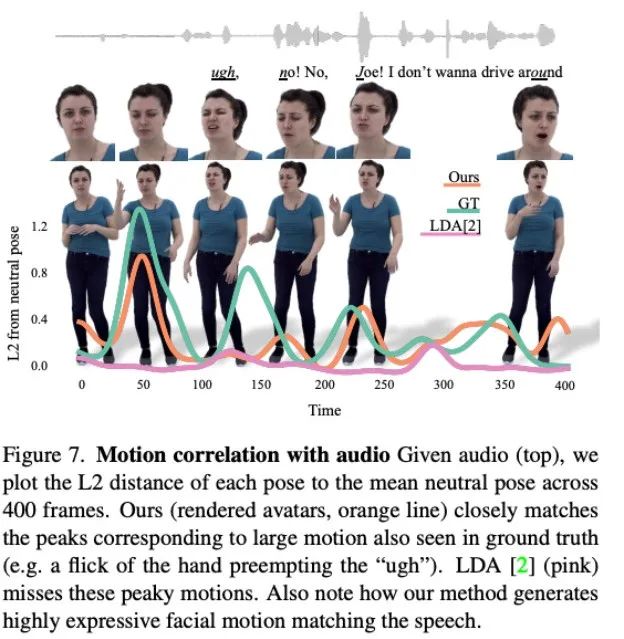

# 図 7 は、LDA によって生成されたモーションにはエネルギーが不足しており、動きが少ないことを示しています。対照的に、この方法によって合成された動きの変化は、実際の状況とより一致しています。

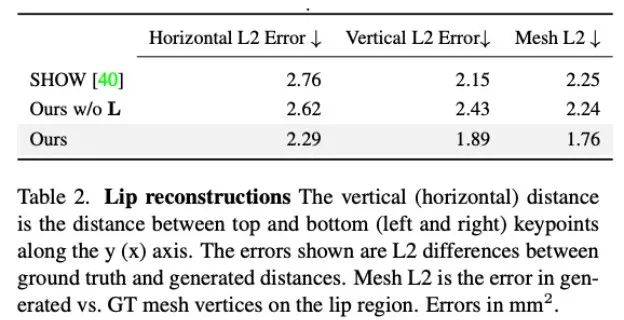

# 図 7 は、LDA によって生成されたモーションにはエネルギーが不足しており、動きが少ないことを示しています。対照的に、この方法によって合成された動きの変化は、実際の状況とより一致しています。  さらに、研究者らは、唇の動きを生成する際のこの方法の精度も分析しました。表 2 の統計が示すように、Audio2Photoreal はベースライン メソッド SHOW を大幅に上回っており、アブレーション実験で事前学習された唇リグレッサーを除去した後のパフォーマンスも大幅に上回っています。この設計により、話すときの口の形状の同期が改善され、話していないときの口のランダムな開閉の動きが効果的に回避され、モデルがより適切に唇の動きを再構築できるようになり、同時に顔のメッシュ頂点 (グリッド L2) のエラーが減少します。 。

さらに、研究者らは、唇の動きを生成する際のこの方法の精度も分析しました。表 2 の統計が示すように、Audio2Photoreal はベースライン メソッド SHOW を大幅に上回っており、アブレーション実験で事前学習された唇リグレッサーを除去した後のパフォーマンスも大幅に上回っています。この設計により、話すときの口の形状の同期が改善され、話していないときの口のランダムな開閉の動きが効果的に回避され、モデルがより適切に唇の動きを再構築できるようになり、同時に顔のメッシュ頂点 (グリッド L2) のエラーが減少します。 。  #定性的評価

#定性的評価

以上がネットワークケーブルに沿って登るのが現実となり、対話を通じてリアルな表現や動きを生成できるAudio2Photorealの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7555

7555

15

15

1383

1383

52

52

83

83

11

11

28

28

96

96

Centosシャットダウンコマンドライン

Apr 14, 2025 pm 09:12 PM

Centosシャットダウンコマンドライン

Apr 14, 2025 pm 09:12 PM

Centos Shutdownコマンドはシャットダウンし、構文はシャットダウン[オプション]時間[情報]です。オプションは次のとおりです。-hシステムをすぐに停止します。 -pシャットダウン後に電源をオフにします。 -r再起動; -t待機時間。時間は、即時(現在)、数分(分)、または特定の時間(HH:mm)として指定できます。追加の情報をシステムメッセージに表示できます。

Centosのgitlabのバックアップ方法は何ですか

Apr 14, 2025 pm 05:33 PM

Centosのgitlabのバックアップ方法は何ですか

Apr 14, 2025 pm 05:33 PM

Centosシステムの下でのGitlabのバックアップと回復ポリシーデータセキュリティと回復可能性を確保するために、Gitlab on Centosはさまざまなバックアップ方法を提供します。この記事では、いくつかの一般的なバックアップ方法、構成パラメーター、リカバリプロセスを詳細に紹介し、完全なGitLabバックアップと回復戦略を確立するのに役立ちます。 1.手動バックアップGitlab-RakeGitlabを使用:バックアップ:コマンドを作成して、マニュアルバックアップを実行します。このコマンドは、gitlabリポジトリ、データベース、ユーザー、ユーザーグループ、キー、アクセスなどのキー情報をバックアップします。デフォルトのバックアップファイルは、/var/opt/gitlab/backupsディレクトリに保存されます。 /etc /gitlabを変更できます

CentOS HDFS構成をチェックする方法

Apr 14, 2025 pm 07:21 PM

CentOS HDFS構成をチェックする方法

Apr 14, 2025 pm 07:21 PM

CENTOSシステムでHDFS構成をチェックするための完全なガイドこの記事では、CENTOSシステム上のHDFSの構成と実行ステータスを効果的に確認する方法をガイドします。次の手順は、HDFSのセットアップと操作を完全に理解するのに役立ちます。 Hadoop環境変数を確認します。最初に、Hadoop環境変数が正しく設定されていることを確認してください。端末では、次のコマンドを実行して、Hadoopが正しくインストールおよび構成されていることを確認します。HDFS構成をチェックするHDFSファイル:HDFSのコア構成ファイルは/etc/hadoop/conf/ディレクトリにあります。使用

CentosのPytorchのGPUサポートはどのようにサポートされていますか

Apr 14, 2025 pm 06:48 PM

CentosのPytorchのGPUサポートはどのようにサポートされていますか

Apr 14, 2025 pm 06:48 PM

Pytorch GPUアクセラレーションを有効にすることで、CentOSシステムでは、PytorchのCUDA、CUDNN、およびGPUバージョンのインストールが必要です。次の手順では、プロセスをガイドします。CUDAおよびCUDNNのインストールでは、CUDAバージョンの互換性が決定されます。NVIDIA-SMIコマンドを使用して、NVIDIAグラフィックスカードでサポートされているCUDAバージョンを表示します。たとえば、MX450グラフィックカードはCUDA11.1以上をサポートする場合があります。 cudatoolkitのダウンロードとインストール:nvidiacudatoolkitの公式Webサイトにアクセスし、グラフィックカードでサポートされている最高のCUDAバージョンに従って、対応するバージョンをダウンロードしてインストールします。 cudnnライブラリをインストールする:

Centosはmysqlをインストールします

Apr 14, 2025 pm 08:09 PM

Centosはmysqlをインストールします

Apr 14, 2025 pm 08:09 PM

CentOSにMySQLをインストールするには、次の手順が含まれます。適切なMySQL Yumソースの追加。 yumを実行して、mysql-serverコマンドをインストールして、mysqlサーバーをインストールします。ルートユーザーパスワードの設定など、MySQL_SECURE_INSTALLATIONコマンドを使用して、セキュリティ設定を作成します。必要に応じてMySQL構成ファイルをカスタマイズします。 MySQLパラメーターを調整し、パフォーマンスのためにデータベースを最適化します。

Dockerの原則の詳細な説明

Apr 14, 2025 pm 11:57 PM

Dockerの原則の詳細な説明

Apr 14, 2025 pm 11:57 PM

DockerはLinuxカーネル機能を使用して、効率的で孤立したアプリケーションランニング環境を提供します。その作業原則は次のとおりです。1。ミラーは、アプリケーションを実行するために必要なすべてを含む読み取り専用テンプレートとして使用されます。 2。ユニオンファイルシステム(UnionFS)は、違いを保存するだけで、スペースを節約し、高速化する複数のファイルシステムをスタックします。 3.デーモンはミラーとコンテナを管理し、クライアントはそれらをインタラクションに使用します。 4。名前空間とcgroupsは、コンテナの分離とリソースの制限を実装します。 5.複数のネットワークモードは、コンテナの相互接続をサポートします。これらのコア概念を理解することによってのみ、Dockerをよりよく利用できます。

Centos8はsshを再起動します

Apr 14, 2025 pm 09:00 PM

Centos8はsshを再起動します

Apr 14, 2025 pm 09:00 PM

SSHサービスを再起動するコマンドは次のとおりです。SystemCTL再起動SSHD。詳細な手順:1。端子にアクセスし、サーバーに接続します。 2。コマンドを入力します:SystemCtl RestArt SSHD; 3.サービスステータスの確認:SystemCTLステータスSSHD。

CentosでPytorchの分散トレーニングを操作する方法

Apr 14, 2025 pm 06:36 PM

CentosでPytorchの分散トレーニングを操作する方法

Apr 14, 2025 pm 06:36 PM

Pytorchの分散トレーニングでは、Centosシステムでトレーニングには次の手順が必要です。Pytorchのインストール:PythonとPipがCentosシステムにインストールされていることです。 CUDAバージョンに応じて、Pytorchの公式Webサイトから適切なインストールコマンドを入手してください。 CPUのみのトレーニングには、次のコマンドを使用できます。PipinstalltorchtorchtorchvisionTorchaudioGPUサポートが必要な場合は、CUDAとCUDNNの対応するバージョンがインストールされ、インストールに対応するPytorchバージョンを使用してください。分散環境構成:分散トレーニングには、通常、複数のマシンまたは単一マシンの複数GPUが必要です。場所