Transformer モデルに基づくパーソナライズされたレコメンデーション システムの実装

Transformer に基づくパーソナライズされた推奨事項は、Transformer モデルを使用して実装されたパーソナライズされた推奨方法です。 Transformer は、機械翻訳やテキスト生成などの自然言語処理タスクで広く使用されているアテンション メカニズムに基づいたニューラル ネットワーク モデルです。パーソナライズされた推奨事項では、Transformer はユーザーの興味や好みを学習し、この情報に基づいて関連コンテンツをユーザーに推奨します。アテンション メカニズムを通じて、Transformer はユーザーの興味と関連コンテンツの関係を把握できるため、レコメンデーションの精度と有効性が向上します。 Transformer モデルを使用することで、パーソナライズされたレコメンデーション システムはユーザーのニーズをより深く理解し、よりパーソナライズされた正確なレコメンデーション サービスをユーザーに提供できます。

パーソナライズされたレコメンデーションでは、まずユーザーとアイテム間の対話マトリックスを確立する必要があります。このマトリックスは、評価、クリック、購入などのアイテムに対するユーザーの行動を記録します。次に、このインタラクション情報をベクトル形式に変換し、トレーニングのために Transformer モデルに入力する必要があります。このようにして、モデルはユーザーとアイテムの関係を学習し、パーソナライズされた推奨結果を生成できます。これにより、レコメンド システムの精度とユーザー満足度を向上させることができます。

パーソナライズされた推奨事項の Transformer モデルには、通常、エンコーダーとデコーダーが含まれています。エンコーダーはユーザーとアイテムのベクトル表現を学習するために使用され、デコーダーは他のアイテムに対するユーザーの関心を予測するために使用されます。このアーキテクチャは、ユーザーとアイテム間の複雑な関係を効果的に捕捉できるため、レコメンデーションの精度とパーソナライゼーションが向上します。

エンコーダでは、最初に多層セルフアテンション メカニズムを使用して、ユーザーとアイテムのベクトル表現を操作します。セルフ アテンション メカニズムにより、入力シーケンス内のさまざまな位置の重要性に応じてベクトル表現に重みを付けることで、モデルがより効率的なベクトル表現を学習できるようになります。次に、アテンション メカニズムの出力がフィードフォワード ニューラル ネットワークを通じて処理され、最終的なベクトル表現が取得されます。この方法は、モデルがユーザーとアイテム間の相関情報をより適切に取得し、レコメンデーション システムのパフォーマンスを向上させるのに役立ちます。

デコーダでは、ユーザー ベクトルとアイテム ベクトルを使用して、他のアイテムに対するユーザーの関心を予測できます。ユーザーとアイテム間の類似性を計算するには、ドット積アテンション メカニズムを使用できます。注目スコアを計算することで、ユーザーとアイテムとの相関関係を評価し、関心度を予測するための基礎として使用できます。最後に、予測された関心に基づいてアイテムをランク付けし、ユーザーに推奨できます。このアプローチにより、レコメンデーション システムの精度とパーソナライゼーションを向上させることができます。

Transformer に基づいてパーソナライズされた推奨事項を実装するには、次の点に注意する必要があります:

1. データの準備: インタラクション データを収集します。ユーザーとアイテムの間の相互作用マトリックスを構築します。このマトリックスは、ユーザーとアイテム間のやり取りを記録します。これには、評価、クリック、購入などの情報が含まれる場合があります。

2. 機能表現: インタラクション マトリックスのユーザーとアイテムをベクトル表現に変換します。埋め込みテクノロジーを使用すると、ユーザーとアイテムを低次元空間にマッピングし、モデルへの入力として機能できます。

3. モデルの構築: Transformer に基づいてエンコーダー/デコーダー モデルを構築します。エンコーダは、多層セルフ アテンション メカニズムを通じてユーザーとアイテムのベクトル表現を学習し、デコーダはユーザーとアイテムのベクトルを使用して、他のアイテムに対するユーザーの関心を予測します。

4. モデルのトレーニング: ユーザーとアイテム間のインタラクション データをトレーニング セットとして使用し、予測結果と実際の評価の間のギャップを最小限に抑えてモデルをトレーニングします。勾配降下法などの最適化アルゴリズムを使用して、モデル パラメーターを更新できます。

5. レコメンデーションの生成: トレーニングされたモデルに基づいて、ユーザーが操作していないアイテムを予測してランク付けし、ユーザーの関心の高いアイテムをレコメンドします。

実際のアプリケーションでは、Transformer に基づくパーソナライズされた推奨事項には次の利点があります。

- モデルはユーザー間の関係を完全に考慮できます。とアイテム それらの間のインタラクティブな関係により、より豊富なセマンティック情報を取得できます。

- Transformer モデルは、優れたスケーラビリティと並列処理を備えており、大規模なデータ セットや大量の同時リクエストを処理できます。

- モデルは特徴表現を自動的に学習できるため、手動による特徴エンジニアリングの必要性が軽減されます。

ただし、Transformer ベースのパーソナライズされたレコメンデーションには、次のような課題もあります。

- データの疎性: 実際のシナリオでは、ユーザーとアイテムの間のインタラクション データは疎であることがよくあります。ユーザーが操作したアイテムは少数であるため、データには欠損値が多数存在し、モデルの学習と予測が困難になります。

- コールド スタートの問題: 新しいユーザーまたは新しいアイテムがシステムに参加すると、十分なインタラクション データが不足しているため、ユーザーの興味や好みを正確に把握できません。これには、コールド スタートの問題を解決し、他の方法 (コンテンツ ベースの推奨事項、協調フィルタリングなど) を通じて新しいユーザーや新しいアイテムに推奨事項を提供する必要があります。

- 多様性とロングテールの問題: パーソナライズされたレコメンデーションでは、人気のあるアイテムを追求するという問題に直面することが多く、その結果、レコメンデーション結果の多様性が欠如し、ロングテールアイテムが無視されることになります。 Transformer モデルは、学習プロセス中に人気のあるアイテム間の相関関係を捕捉する可能性が高くなりますが、ロングテール アイテムに対する推奨効果は不十分です。

- 解釈可能性と解釈可能性: ブラック ボックス モデルとして、Transformer モデルの予測結果は説明が難しいことがよくあります。一部のアプリケーション シナリオでは、ユーザーはそのような推奨結果が得られる理由を理解したいと考えており、モデルには特定の説明機能が必要です。

- リアルタイム性と効率性: Transformer ベースのモデルは通常、大規模なネットワーク構造とパラメーター量を持ち、大量のコンピューティング リソースを必要とします。リアルタイムのレコメンデーション シナリオでは、パーソナライズされたレコメンデーションの結果を迅速に生成する必要があり、従来の Transformer モデルでは計算の複雑さと遅延が高くなる可能性があります。

以上がTransformer モデルに基づくパーソナライズされたレコメンデーション システムの実装の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7455

7455

15

15

1375

1375

52

52

77

77

11

11

14

14

9

9

RNN、LSTM、GRU の概念、違い、長所と短所を調べる

Jan 22, 2024 pm 07:51 PM

RNN、LSTM、GRU の概念、違い、長所と短所を調べる

Jan 22, 2024 pm 07:51 PM

時系列データでは、観測間に依存関係があるため、相互に独立していません。ただし、従来のニューラル ネットワークは各観測値を独立したものとして扱うため、時系列データをモデル化するモデルの能力が制限されます。この問題を解決するために、リカレント ニューラル ネットワーク (RNN) が導入されました。これは、ネットワーク内のデータ ポイント間の依存関係を確立することにより、時系列データの動的特性をキャプチャするためのメモリの概念を導入しました。反復接続を通じて、RNN は以前の情報を現在の観測値に渡して、将来の値をより適切に予測できます。このため、RNN は時系列データを含むタスクにとって強力なツールになります。しかし、RNN はどのようにしてこの種の記憶を実現するのでしょうか? RNN は、ニューラル ネットワーク内のフィードバック ループを通じて記憶を実現します。これが RNN と従来のニューラル ネットワークの違いです。

ニューラル ネットワークの浮動小数点オペランド (FLOPS) の計算

Jan 22, 2024 pm 07:21 PM

ニューラル ネットワークの浮動小数点オペランド (FLOPS) の計算

Jan 22, 2024 pm 07:21 PM

FLOPS はコンピュータの性能評価の規格の 1 つで、1 秒あたりの浮動小数点演算の回数を測定するために使用されます。ニューラル ネットワークでは、モデルの計算の複雑さとコンピューティング リソースの使用率を評価するために FLOPS がよく使用されます。これは、コンピューターの計算能力と効率を測定するために使用される重要な指標です。ニューラル ネットワークは、データ分類、回帰、クラスタリングなどのタスクを実行するために使用される、複数のニューロン層で構成される複雑なモデルです。ニューラル ネットワークのトレーニングと推論には、多数の行列の乗算、畳み込み、その他の計算操作が必要となるため、計算の複雑さは非常に高くなります。 FLOPS (FloatingPointOperationsperSecond) を使用すると、ニューラル ネットワークの計算の複雑さを測定し、モデルの計算リソースの使用効率を評価できます。フロップ

ファジーニューラルネットワークの定義と構造解析

Jan 22, 2024 pm 09:09 PM

ファジーニューラルネットワークの定義と構造解析

Jan 22, 2024 pm 09:09 PM

ファジー ニューラル ネットワークは、ファジー ロジックとニューラル ネットワークを組み合わせたハイブリッド モデルで、従来のニューラル ネットワークでは処理が困難なファジーまたは不確実な問題を解決します。その設計は人間の認知における曖昧さと不確実性にインスピレーションを得ているため、制御システム、パターン認識、データマイニングなどの分野で広く使用されています。ファジー ニューラル ネットワークの基本アーキテクチャは、ファジー サブシステムとニューラル サブシステムで構成されます。ファジー サブシステムは、ファジー ロジックを使用して入力データを処理し、それをファジー セットに変換して、入力データの曖昧さと不確実性を表現します。ニューラル サブシステムは、ニューラル ネットワークを使用して、分類、回帰、クラスタリングなどのタスクのファジー セットを処理します。ファジー サブシステムとニューラル サブシステム間の相互作用により、ファジー ニューラル ネットワークはより強力な処理能力を持ち、

テキスト分類に双方向 LSTM モデルを使用するケーススタディ

Jan 24, 2024 am 10:36 AM

テキスト分類に双方向 LSTM モデルを使用するケーススタディ

Jan 24, 2024 am 10:36 AM

双方向 LSTM モデルは、テキスト分類に使用されるニューラル ネットワークです。以下は、テキスト分類タスクに双方向 LSTM を使用する方法を示す簡単な例です。まず、必要なライブラリとモジュールをインポートする必要があります: importosimportnumpyasnpfromkeras.preprocessing.textimportTokenizerfromkeras.preprocessing.sequenceimportpad_sequencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Em

畳み込みニューラル ネットワークを使用した画像のノイズ除去

Jan 23, 2024 pm 11:48 PM

畳み込みニューラル ネットワークを使用した画像のノイズ除去

Jan 23, 2024 pm 11:48 PM

畳み込みニューラル ネットワークは、画像のノイズ除去タスクで優れたパフォーマンスを発揮します。学習したフィルターを利用してノイズを除去し、元の画像を復元します。この記事では、畳み込みニューラル ネットワークに基づく画像ノイズ除去方法を詳しく紹介します。 1. 畳み込みニューラル ネットワークの概要 畳み込みニューラル ネットワークは、複数の畳み込み層、プーリング層、全結合層の組み合わせを使用して画像の特徴を学習および分類する深層学習アルゴリズムです。畳み込み層では、畳み込み演算を通じて画像の局所的な特徴が抽出され、それによって画像内の空間相関が捕捉されます。プーリング層は、特徴の次元を削減することで計算量を削減し、主要な特徴を保持します。完全に接続された層は、学習した特徴とラベルをマッピングして画像分類やその他のタスクを実装する役割を果たします。このネットワーク構造の設計により、畳み込みニューラル ネットワークは画像処理と認識に役立ちます。

ツイン ニューラル ネットワーク: 原理と応用分析

Jan 24, 2024 pm 04:18 PM

ツイン ニューラル ネットワーク: 原理と応用分析

Jan 24, 2024 pm 04:18 PM

シャム ニューラル ネットワークは、ユニークな人工ニューラル ネットワーク構造です。これは、同じパラメーターと重みを共有する 2 つの同一のニューラル ネットワークで構成されます。同時に、2 つのネットワークは同じ入力データも共有します。 2 つのニューラル ネットワークは構造的に同一であるため、このデザインは双子からインスピレーションを得ています。シャム ニューラル ネットワークの原理は、2 つの入力データ間の類似性や距離を比較することによって、画像マッチング、テキスト マッチング、顔認識などの特定のタスクを完了することです。トレーニング中、ネットワークは、類似したデータを隣接する領域にマッピングし、異なるデータを離れた領域にマッピングしようとします。このようにして、ネットワークはさまざまなデータを分類または照合する方法を学習して、対応するデータを実現できます。

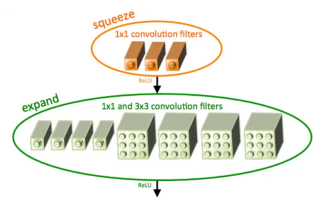

SqueezeNet の概要とその特徴

Jan 22, 2024 pm 07:15 PM

SqueezeNet の概要とその特徴

Jan 22, 2024 pm 07:15 PM

SqueezeNet は、高精度と低複雑性のバランスが取れた小型で正確なアルゴリズムであり、リソースが限られているモバイル システムや組み込みシステムに最適です。 2016 年、DeepScale、カリフォルニア大学バークレー校、スタンフォード大学の研究者は、コンパクトで効率的な畳み込みニューラル ネットワーク (CNN) である SqueezeNet を提案しました。近年、研究者は SqueezeNetv1.1 や SqueezeNetv2.0 など、SqueezeNet にいくつかの改良を加えました。両方のバージョンの改良により、精度が向上するだけでなく、計算コストも削減されます。 ImageNet データセット上の SqueezeNetv1.1 の精度

因果畳み込みニューラル ネットワーク

Jan 24, 2024 pm 12:42 PM

因果畳み込みニューラル ネットワーク

Jan 24, 2024 pm 12:42 PM

因果畳み込みニューラル ネットワークは、時系列データの因果関係の問題のために設計された特別な畳み込みニューラル ネットワークです。従来の畳み込みニューラル ネットワークと比較して、因果畳み込みニューラル ネットワークは、時系列の因果関係を保持するという独特の利点があり、時系列データの予測と分析に広く使用されています。因果畳み込みニューラル ネットワークの中心的なアイデアは、畳み込み演算に因果関係を導入することです。従来の畳み込みニューラルネットワークは、現時点の前後のデータを同時に認識できますが、時系列予測では情報漏洩の問題が発生する可能性があります。現時点での予測結果は、将来の時点のデータに影響を受けるからです。この問題を解決するのが因果畳み込みニューラル ネットワークであり、現時点と過去のデータのみを認識することができ、将来のデータを認識することはできません。