ニューラル ネットワークの浮動小数点オペランド (FLOPS) の計算

FLOPS はコンピュータのパフォーマンス評価の標準の 1 つで、1 秒あたりの浮動小数点演算の回数を測定するために使用されます。ニューラル ネットワークでは、モデルの計算の複雑さとコンピューティング リソースの使用率を評価するために FLOPS がよく使用されます。これは、コンピューターの計算能力と効率を測定するために使用される重要な指標です。

ニューラル ネットワークは、データ分類、回帰、クラスタリングなどのタスクに使用される複数のニューロン層で構成される複雑なモデルです。ニューラル ネットワークのトレーニングと推論には、多数の行列の乗算、畳み込み、その他の計算操作が必要なため、計算の複雑さが非常に高くなります。 FLOPS (1 秒あたりの浮動小数点演算) を使用すると、ニューラル ネットワークの計算の複雑さを測定し、モデルの計算リソースの使用効率を評価できます。 FLOPS は、1 秒あたりに実行できる浮動小数点演算の数を指し、コンピューティング デバイスのパフォーマンスを測定するために使用できます。ニューラル ネットワークの場合、FLOPS が高いほど、モデルはより短い時間でコンピューティング タスクを完了でき、コンピューティング効率が高くなります。したがって、ニューラル ネットワーク モデルを設計および最適化するときは、モデルの計算効率を向上させるために、計算の複雑さと計算リソースのバランスを考慮する必要があります。

ニューラル ネットワークでは、FLOPS の計算は、モデル構造、入力データ サイズ、コンピューティング デバイスのパフォーマンスなどの要素に関連します。これらの観点からの FLOPS 計算方法を以下に紹介します。

1. モデルの構造

ニューラル ネットワークの構造は通常、入力層、隠れ層、出力層で構成されます。隠れ層には複数の層を含めることができ、各層は複数のニューロンで構成されます。各ニューロンでは、重み付けされた合計や活性化関数の適用など、いくつかの計算操作が実行されます。したがって、ニューラルネットワークのFLOPSを計算する際には、各ニューロンの計算量を考慮する必要があります。

1. 全結合ニューラル ネットワークの FLOPS 計算

全結合ニューラル ネットワークを例として、各隠れ層の計算は次のようになります。 :

H_i=f(W_iH_{i-1} b_i)

このうち、H_{i-1} が前の層の出力、W_i と b_i は現在の層の重みとバイアス、f は活性化関数です。 m 個のニューロンを含む隠れ層の場合、計算量は次のようになります:

FLOPS_{\text{隠れ層}}=2\times m\times n

このうち、n は前の層の出力の次元です。したがって、全結合ニューラル ネットワークの総 FLOPS 計算量は、すべての隠れ層の FLOPS の合計として表すことができます。

2. 畳み込みニューラル ネットワークの FLOPS 計算

畳み込みニューラル ネットワークの場合、FLOPS の計算方法が若干異なります。畳み込みニューラル ネットワークでは、各畳み込み層に複数の畳み込みカーネルが含まれており、各畳み込みカーネルは入力データに対して畳み込み演算を実行する必要があります。畳み込み演算は局所的な重み付け和計算とみなすことができるため、各畳み込みカーネルの計算量は次のように表すことができます。

FLOPS_{\text{convolution kernel}}=k^ 2\times c_{\text{in}}\times c_{\text{out}}

ここで、k はコンボリューション カーネルのサイズ、c_{\text{in } } と c_{\text{out}} はそれぞれ入力チャンネル番号と出力チャンネル番号です。したがって、畳み込み層の総 FLOPS 計算量は、すべての畳み込みカーネルの FLOPS の合計として表すことができます。

2. 入力データのサイズ

ニューラルネットワークのFLOPS計算量は入力データのサイズにも関係します。完全に接続されたニューラル ネットワークでは、入力データの次元によって各ニューロンの計算量が決まります。畳み込みニューラル ネットワークでは、入力データのサイズも畳み込み演算の計算量に影響します。したがって、FLOPS を計算するときは、入力データのサイズを考慮する必要があります。

3. コンピューティング機器のパフォーマンス

FLOPS の計算は、コンピューティング機器のパフォーマンスにも関係します。コンピューティング デバイス (CPU、GPU、TPU など) が異なれば、コンピューティング機能とコンピューティング効率も異なります。 FLOPS を計算するときは、モデルのコンピューティング リソースの使用効率をより正確に評価するために、コンピューティング デバイスのパフォーマンスを考慮する必要があります。

以上がニューラル ネットワークの浮動小数点オペランド (FLOPS) の計算の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

RNN、LSTM、GRU の概念、違い、長所と短所を調べる

Jan 22, 2024 pm 07:51 PM

RNN、LSTM、GRU の概念、違い、長所と短所を調べる

Jan 22, 2024 pm 07:51 PM

時系列データでは、観測間に依存関係があるため、相互に独立していません。ただし、従来のニューラル ネットワークは各観測値を独立したものとして扱うため、時系列データをモデル化するモデルの能力が制限されます。この問題を解決するために、リカレント ニューラル ネットワーク (RNN) が導入されました。これは、ネットワーク内のデータ ポイント間の依存関係を確立することにより、時系列データの動的特性をキャプチャするためのメモリの概念を導入しました。反復接続を通じて、RNN は以前の情報を現在の観測値に渡して、将来の値をより適切に予測できます。このため、RNN は時系列データを含むタスクにとって強力なツールになります。しかし、RNN はどのようにしてこの種の記憶を実現するのでしょうか? RNN は、ニューラル ネットワーク内のフィードバック ループを通じて記憶を実現します。これが RNN と従来のニューラル ネットワークの違いです。

ニューラル ネットワークの浮動小数点オペランド (FLOPS) の計算

Jan 22, 2024 pm 07:21 PM

ニューラル ネットワークの浮動小数点オペランド (FLOPS) の計算

Jan 22, 2024 pm 07:21 PM

FLOPS はコンピュータの性能評価の規格の 1 つで、1 秒あたりの浮動小数点演算の回数を測定するために使用されます。ニューラル ネットワークでは、モデルの計算の複雑さとコンピューティング リソースの使用率を評価するために FLOPS がよく使用されます。これは、コンピューターの計算能力と効率を測定するために使用される重要な指標です。ニューラル ネットワークは、データ分類、回帰、クラスタリングなどのタスクを実行するために使用される、複数のニューロン層で構成される複雑なモデルです。ニューラル ネットワークのトレーニングと推論には、多数の行列の乗算、畳み込み、その他の計算操作が必要となるため、計算の複雑さは非常に高くなります。 FLOPS (FloatingPointOperationsperSecond) を使用すると、ニューラル ネットワークの計算の複雑さを測定し、モデルの計算リソースの使用効率を評価できます。フロップ

ファジーニューラルネットワークの定義と構造解析

Jan 22, 2024 pm 09:09 PM

ファジーニューラルネットワークの定義と構造解析

Jan 22, 2024 pm 09:09 PM

ファジー ニューラル ネットワークは、ファジー ロジックとニューラル ネットワークを組み合わせたハイブリッド モデルで、従来のニューラル ネットワークでは処理が困難なファジーまたは不確実な問題を解決します。その設計は人間の認知における曖昧さと不確実性にインスピレーションを得ているため、制御システム、パターン認識、データマイニングなどの分野で広く使用されています。ファジー ニューラル ネットワークの基本アーキテクチャは、ファジー サブシステムとニューラル サブシステムで構成されます。ファジー サブシステムは、ファジー ロジックを使用して入力データを処理し、それをファジー セットに変換して、入力データの曖昧さと不確実性を表現します。ニューラル サブシステムは、ニューラル ネットワークを使用して、分類、回帰、クラスタリングなどのタスクのファジー セットを処理します。ファジー サブシステムとニューラル サブシステム間の相互作用により、ファジー ニューラル ネットワークはより強力な処理能力を持ち、

テキスト分類に双方向 LSTM モデルを使用するケーススタディ

Jan 24, 2024 am 10:36 AM

テキスト分類に双方向 LSTM モデルを使用するケーススタディ

Jan 24, 2024 am 10:36 AM

双方向 LSTM モデルは、テキスト分類に使用されるニューラル ネットワークです。以下は、テキスト分類タスクに双方向 LSTM を使用する方法を示す簡単な例です。まず、必要なライブラリとモジュールをインポートする必要があります: importosimportnumpyasnpfromkeras.preprocessing.textimportTokenizerfromkeras.preprocessing.sequenceimportpad_sequencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Em

ツイン ニューラル ネットワーク: 原理と応用分析

Jan 24, 2024 pm 04:18 PM

ツイン ニューラル ネットワーク: 原理と応用分析

Jan 24, 2024 pm 04:18 PM

シャム ニューラル ネットワークは、ユニークな人工ニューラル ネットワーク構造です。これは、同じパラメーターと重みを共有する 2 つの同一のニューラル ネットワークで構成されます。同時に、2 つのネットワークは同じ入力データも共有します。 2 つのニューラル ネットワークは構造的に同一であるため、このデザインは双子からインスピレーションを得ています。シャム ニューラル ネットワークの原理は、2 つの入力データ間の類似性や距離を比較することによって、画像マッチング、テキスト マッチング、顔認識などの特定のタスクを完了することです。トレーニング中、ネットワークは、類似したデータを隣接する領域にマッピングし、異なるデータを離れた領域にマッピングしようとします。このようにして、ネットワークはさまざまなデータを分類または照合する方法を学習して、対応するデータを実現できます。

畳み込みニューラル ネットワークを使用した画像のノイズ除去

Jan 23, 2024 pm 11:48 PM

畳み込みニューラル ネットワークを使用した画像のノイズ除去

Jan 23, 2024 pm 11:48 PM

畳み込みニューラル ネットワークは、画像のノイズ除去タスクで優れたパフォーマンスを発揮します。学習したフィルターを利用してノイズを除去し、元の画像を復元します。この記事では、畳み込みニューラル ネットワークに基づく画像ノイズ除去方法を詳しく紹介します。 1. 畳み込みニューラル ネットワークの概要 畳み込みニューラル ネットワークは、複数の畳み込み層、プーリング層、全結合層の組み合わせを使用して画像の特徴を学習および分類する深層学習アルゴリズムです。畳み込み層では、畳み込み演算を通じて画像の局所的な特徴が抽出され、それによって画像内の空間相関が捕捉されます。プーリング層は、特徴の次元を削減することで計算量を削減し、主要な特徴を保持します。完全に接続された層は、学習した特徴とラベルをマッピングして画像分類やその他のタスクを実装する役割を果たします。このネットワーク構造の設計により、畳み込みニューラル ネットワークは画像処理と認識に役立ちます。

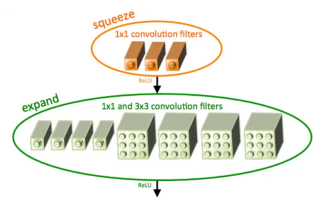

SqueezeNet の概要とその特徴

Jan 22, 2024 pm 07:15 PM

SqueezeNet の概要とその特徴

Jan 22, 2024 pm 07:15 PM

SqueezeNet は、高精度と低複雑性のバランスが取れた小型で正確なアルゴリズムであり、リソースが限られているモバイル システムや組み込みシステムに最適です。 2016 年、DeepScale、カリフォルニア大学バークレー校、スタンフォード大学の研究者は、コンパクトで効率的な畳み込みニューラル ネットワーク (CNN) である SqueezeNet を提案しました。近年、研究者は SqueezeNetv1.1 や SqueezeNetv2.0 など、SqueezeNet にいくつかの改良を加えました。両方のバージョンの改良により、精度が向上するだけでなく、計算コストも削減されます。 ImageNet データセット上の SqueezeNetv1.1 の精度

Rust を使用して単純なニューラル ネットワークを作成する手順

Jan 23, 2024 am 10:45 AM

Rust を使用して単純なニューラル ネットワークを作成する手順

Jan 23, 2024 am 10:45 AM

Rust は、安全性、パフォーマンス、同時実行性に重点を置いたシステムレベルのプログラミング言語です。オペレーティング システム、ネットワーク アプリケーション、組み込みシステムなどのシナリオに適した安全で信頼性の高いプログラミング言語を提供することを目的としています。 Rust のセキュリティは主に、所有権システムと借用チェッカーという 2 つの側面から実現されます。所有権システムにより、コンパイラはコンパイル時にコードのメモリ エラーをチェックできるため、一般的なメモリの安全性の問題が回避されます。 Rust は、コンパイル時に変数の所有権の転送のチェックを強制することで、メモリ リソースが適切に管理および解放されることを保証します。ボロー チェッカーは、変数のライフ サイクルを分析して、同じ変数が複数のスレッドによって同時にアクセスされないようにすることで、一般的な同時実行セキュリティの問題を回避します。これら 2 つのメカニズムを組み合わせることで、Rust は以下を提供できます。