TimePillars: 純粋な LiDAR 3D 検出ルートはどこに拡張できますか? 200mを直接カバー!

LiDAR 点群点に基づく 3D オブジェクト検出は非常に古典的な問題であり、学界と産業界の両方が精度、速度、堅牢性を向上させるためにさまざまなモデルを提案してきました。ただし、屋外環境が複雑なため、屋外点群に対する物体検出のパフォーマンスはあまり良くありません。 LIDAR 点群は本質的にまばらです。この問題を的を絞った方法で解決するにはどうすればよいでしょうか?この論文は、時系列情報の集約に基づいて情報を抽出するという独自の答えを示しています。

前に書いた

この論文では主に、自動運転が直面する重要な課題、つまり周囲の環境を 3 次元で正確に確立する方法について説明します。表現。これは自動運転車の信頼性と安全性を確保するために重要です。特に、自動運転車は、車両や歩行者などの周囲の物体を認識し、それらの位置、サイズ、方向を正確に判断できる必要があります。通常、このタスクを達成するには、ディープ ニューラル ネットワークを使用して LiDAR データを処理します。

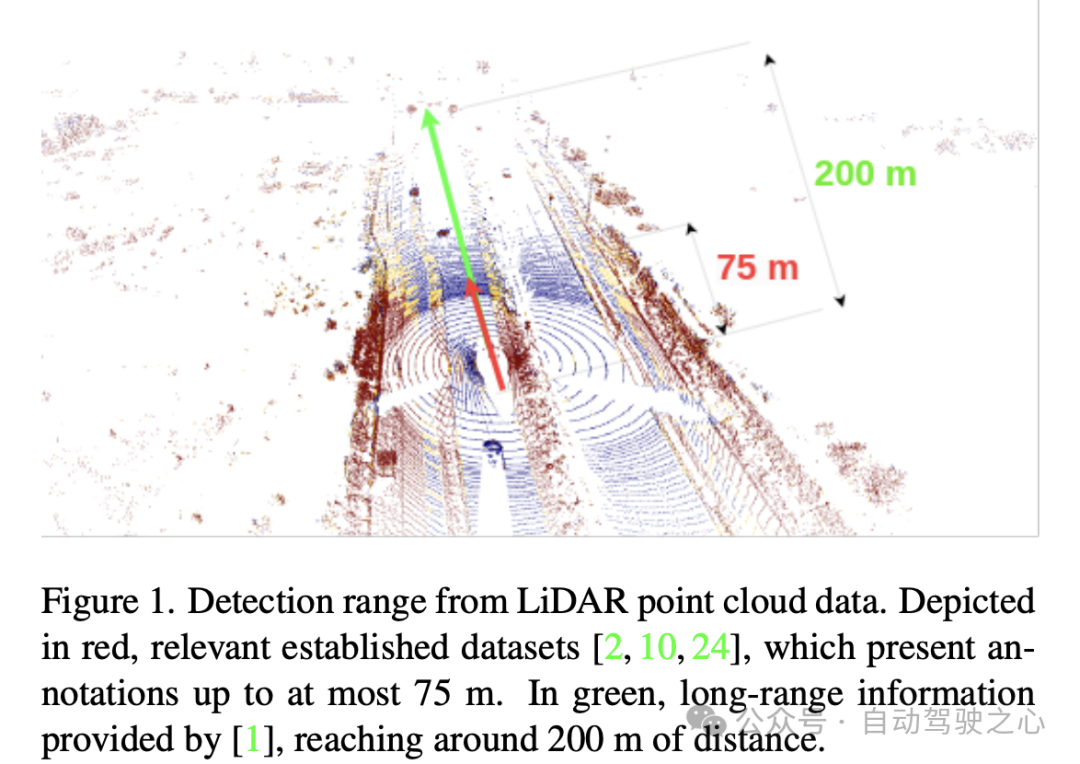

現在の研究は主に、一度に 1 つのセンサー スキャンからのデータを使用する単一フレーム手法に焦点を当てています。この方法は従来のベンチマークで優れたパフォーマンスを発揮し、最大 75 メートルの距離にある物体を検出します。ただし、LIDAR 点群のまばらさは、長距離では特に顕著です。したがって、研究者らは、長距離検出を 1 回のスキャンだけに依存するだけでは、たとえば最大 200 メートルの距離までは十分ではないと考えています。したがって、今後の研究では、この課題に対処することに焦点を当てる必要があります。

この問題を解決するには、点群集約を使用する方法があります。これは、一連の LIDAR スキャン データを連結して、より高密度の入力を取得することです。ただし、このアプローチは計算コストが高く、ネットワーク内の集約を最大限に活用できません。計算コストを削減し、情報をより有効に活用するには、再帰的手法の使用を検討してください。再帰的メソッドは時間の経過とともに情報を蓄積し、現在の入力と以前の集計結果を繰り返し融合することで、より正確な出力を生成します。この手法により、計算効率が向上するだけでなく、履歴情報を有効活用して予測精度を向上させることができます。再帰的手法は点群集約問題に幅広く応用でき、満足のいく結果が得られています。

記事では、検出範囲を拡大するために、スパース畳み込み、アテンション モジュール、3D 畳み込みなどの高度な操作を採用できることにも言及しました。ただし、これらの操作では通常、ターゲット ハードウェアの互換性の問題は無視されます。ニューラル ネットワークを展開してトレーニングする場合、使用されるハードウェアは、サポートされる操作と遅延が大きく異なることがよくあります。たとえば、Nvidia Orin DLA などのターゲット ハードウェアは、スパース コンボリューションやアテンションなどの操作をサポートしていないことがよくあります。さらに、3D 畳み込みなどのレイヤーの使用は、リアルタイムのレイテンシー要件により、多くの場合実現できません。これは、2D 畳み込みなどの単純な演算を使用する必要性を強調しています。

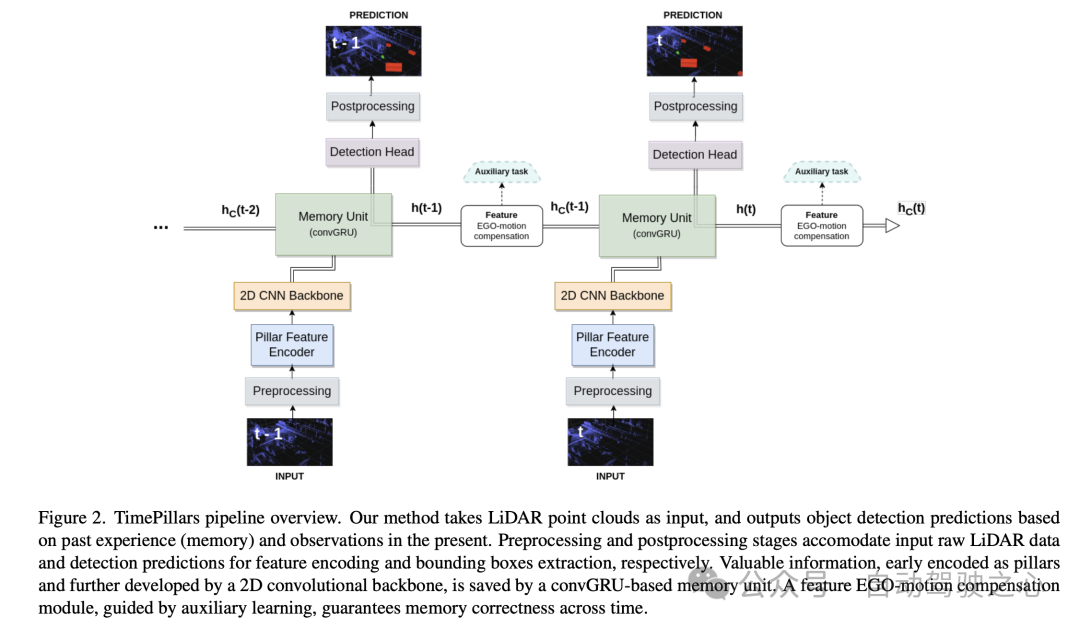

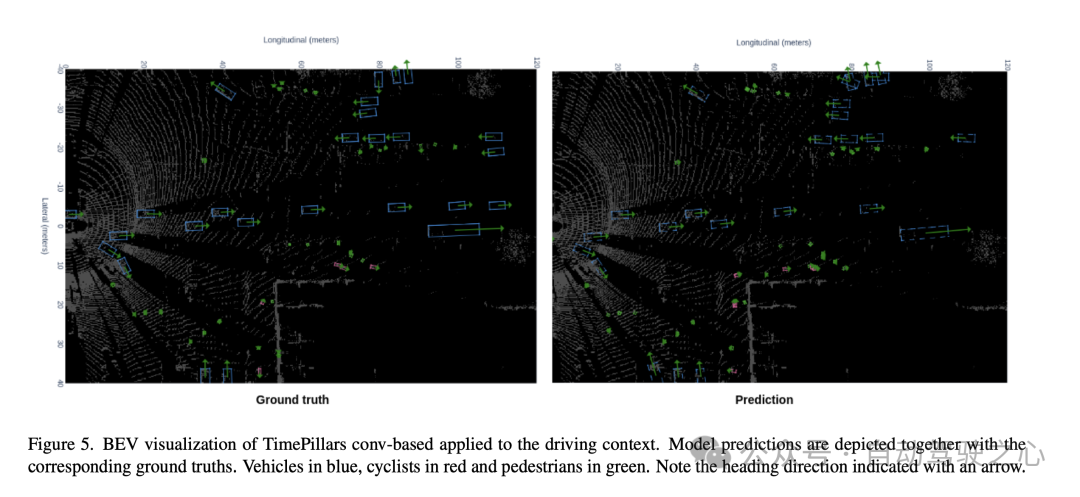

この論文では、新しい時間再帰モデル TimePillars を提案しています。これは、共通のターゲット ハードウェアでサポートされている一連の操作を尊重し、2D 畳み込みに依存し、ポイントピラー (Pillar) 入力表現と畳み込み再帰ユニットに基づいています。 。自己動き補償は、単一の畳み込みと補助学習の助けを借りて、再帰ユニットの隠れ状態に適用されます。この操作の正確さを保証するために補助タスクを使用することは、アブレーション研究を通じて適切であることが示されています。この論文では、パイプライン内の再帰的モジュールの最適な配置についても調査し、ネットワークのバックボーンと検出ヘッドの間に配置すると最高のパフォーマンスが得られることを明確に示しています。この論文では、新しくリリースされた Zenseact Open Dataset (ZOD) について、TimePillars メソッドの有効性を実証しています。シングルフレームおよびマルチフレームのポイントアンドピラー ベースラインと比較して、TimePillars は、特に重要な自転車と歩行者のカテゴリにおける長距離 (最大 200 メートル) の検出において、評価パフォーマンスの大幅な向上を実現します。最後に、TimePillars はマルチフレーム ポイント ピラーよりも遅延が大幅に低いため、リアルタイム システムに適しています。

この論文では、3D LIDAR オブジェクト検出タスクを解決するために、TimePillars と呼ばれる新しい時間再帰モデルを提案し、共通のターゲット ハードウェアによってサポートされる一連の操作を検討します。実験により、TimePillars は長距離検出において単一フレームおよびマルチフレームのポイントピラー ベースラインよりも大幅に優れたパフォーマンスを達成することが証明されました。さらに、この論文では、Zenseact オープン データセット上の 3D LIDAR 物体検出モデルのベンチマークも初めて実行しています。 ただし、この論文の限界は、LIDAR データのみに焦点を当てており、他のセンサー入力を考慮しておらず、そのアプローチが単一の最先端のベースラインに基づいていることです。それにもかかわらず、著者らは、自分たちのフレームワークが一般的である、つまり、ベースラインに対する将来の改善が全体的なパフォーマンスの改善につながると信じています。

TimePillars の詳しい説明

入力前処理

このペーパーの「入力前処理」セクションでは、著者は「柱状化」と呼ばれる手法を使用して、入力ポイントのクラウド データを処理します。従来のボクセル化とは異なり、この方法では点群を垂直方向の柱状構造に分割し、垂直方向 (z 軸) の高さを一定に保ちながら水平方向 (x 軸と y 軸) のみに分割します。この処理方法の利点は、ネットワーク入力サイズの一貫性を維持でき、効率的な処理のために 2D 畳み込みを使用できることです。このようにして、点群データを効率的に処理し、後続のタスクにより正確で信頼性の高い入力を提供できます。

ただし、Pillarisation には多くの空の列が生成され、データが非常にまばらになるという問題が 1 つあります。この問題を解決するために、この論文では動的ボクセル化技術の使用を提案しています。この手法により、各列のポイント数を事前に定義する必要がなくなり、各列での切り捨てや塗りつぶしの操作が不要になります。代わりに、点群データ全体が、必要な合計点数 (ここでは 200,000 点に設定) に一致するように処理されます。この前処理方法の利点は、情報の損失が最小限に抑えられ、生成されたデータ表現がより安定して一貫性のあるものになることです。

モデル アーキテクチャ

モデル アーキテクチャについて、著者は、ピラー フィーチャー エンコーダー (Pillar Feature Encoder)、2D 畳み込みニューラル ネットワーク (CNN) バックボーン、および検出ヘッドで構成されるニューラル ネットワーク アーキテクチャ。

- Pillar Feature Encoder: この部分は、前処理された入力テンソルを Bird's Eye View (BEV) 擬似イメージにマッピングします。動的ボクセル化を使用した後、それに応じて簡略化された PointNet が調整されます。入力は 1D 畳み込み、バッチ正規化、ReLU アクティベーション関数によって処理され、形状 のテンソルが取得されます。ここで、 はチャネル数を表します。最後の散乱最大レイヤーの前に、最大プーリングがチャネルに適用され、形状 の潜在空間が形成されます。初期テンソルは としてエンコードされ、前の層の後では になるため、最大プーリング操作は削除されます。

- バックボーン: 優れた深度効率により、元のコラム論文で提案された 2D CNN バックボーン アーキテクチャを使用します。潜在空間は 3 つのダウンサンプリング ブロック (Conv2D-BN-ReLU) を使用して削減され、3 つのアップサンプリング ブロックと転置畳み込みを使用して復元されます。出力形状は です。

- メモリ ユニット: システムのメモリをリカレント ニューラル ネットワーク (RNN) としてモデル化します。具体的には、ゲート付きリカレント ユニットの畳み込みバージョンである畳み込み GRU (convGRU) を使用します。畳み込み GRU の利点は、空間データ特性を維持しながら勾配消失問題を回避し、効率を向上できることです。 LSTM などの他のオプションと比較して、GRU はゲート数が少ないため、トレーニング可能なパラメーターが少なく、メモリ正則化手法 (隠れ状態の複雑さを軽減する) と考えることができます。同様の性質の演算をマージすることにより、必要な畳み込み層の数が減り、ユニットの効率が向上します。

- 検出ヘッド: SSD (シングルショット マルチボックス検出器) への簡単な変更。 SSD の中心概念、つまり領域提案のないシングルパスは維持されますが、アンカー ボックスの使用は排除されます。グリッド内の各セルの予測を直接出力すると、セルのマルチオブジェクト検出機能は失われますが、退屈で不正確なことが多いアンカー ボックス パラメーターの調整が回避され、推論プロセスが簡素化されます。線形層は、分類と位置特定 (位置、サイズ、角度) 回帰のそれぞれの出力を処理します。サイズのみ活性化関数(ReLU)を用いて負の値をとらないようにしています。さらに、関連文献とは異なり、この論文では、車両の走行方向の正弦成分と余弦成分を独立して予測し、それらから角度を抽出することにより、直接角度回帰の問題を回避しています。

特徴エゴモーション補償

論文のこの部分では、著者は畳み込み GRU によって出力される隠れ状態特徴を処理する方法について説明します。は、以前はフレームの座標系で表されていました。直接保存して次の予測の計算に使用すると、エゴモーションにより空間的な不一致が発生します。

変換を実行するには、さまざまな手法を適用できます。理想的には、修正されたデータはネットワーク内で変換されるのではなく、ネットワークに供給されます。ただし、これは論文で提案されている方法ではありません。推論プロセスの各ステップで隠れ状態をリセットし、以前の点群を変換し、それらをネットワーク全体に伝播する必要があるからです。これは非効率であるだけでなく、RNN を使用する目的を損なってしまいます。したがって、ループ コンテキストでは、補償を機能レベルで行う必要があります。これにより、仮説的な解決策はより効率的になりますが、問題はより複雑になります。従来の内挿方法を使用して、変換された座標系の特徴を取得できます。

対照的に、この論文は、Chen らの研究に触発されて、畳み込み演算と補助タスクを使用して変換を実行することを提案しています。前述の研究の限られた詳細を考慮して、この論文では、この問題に対するカスタマイズされた解決策を提案しています。

この論文で採用されているアプローチは、追加の畳み込み層を通じて特徴変換を実行するために必要な情報をネットワークに提供することです。 2 つの連続するフレーム間の相対変換行列、つまり特徴を正常に変換するために必要な操作が最初に計算されます。次に、そこから 2D 情報 (回転と変換部分) を抽出します。

この単純化は、主要な行列定数を回避し、2D (疑似画像) ドメインで機能し、16 個の値を 6 個に減らします。次に、補償対象の隠れた特徴の形状に一致するように行列が平坦化および拡張されます。最初の次元は、変換する必要があるフレームの数を表します。この表現は、隠れたフィーチャーのチャネル次元で潜在的な各ピラーを連結するのに適しています。 最後に、隠れ状態特徴が 2D 畳み込み層に入力され、変換プロセスに適応されます。注意すべき重要な点は、畳み込みを実行しても、変換が行われることが保証されるわけではないということです。チャネル連結は、変換がどのように実行されるかについての追加情報をネットワークに提供するだけです。この場合、学習支援の使用が適切です。トレーニング中、追加の学習目標 (座標変換) が主な目標 (オブジェクト検出) と並行して追加されます。補助タスクは、補償の正確性を保証するために、監視下で変換プロセスを通じてネットワークをガイドすることを目的として設計されており、トレーニング プロセスに限定されています。ネットワークが特徴を正しく変換することを学習すると、その適用性は失われます。したがって、このタスクは推論中に考慮されません。次のセクションでは、影響を比較するためにさらに実験が行われます。

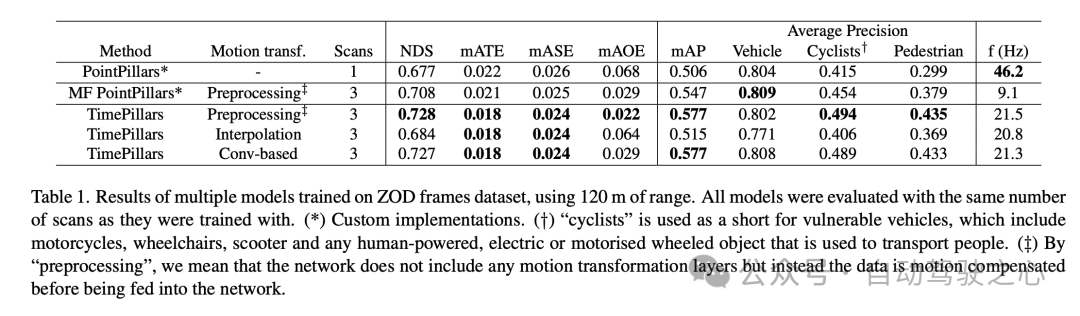

実験 実験結果は、Zenseact Open Dataset (ZOD) フレーム データ セットを処理するときに TimePillars モデルが良好にパフォーマンスすることを示しています。 、特にこれは最大 120 メートルの範囲を扱う場合に当てはまります。これらの結果は、さまざまなモーション変換方法での TimePillars のパフォーマンスの違いを強調し、他の方法と比較します。

実験結果は、Zenseact Open Dataset (ZOD) フレーム データ セットを処理するときに TimePillars モデルが良好にパフォーマンスすることを示しています。 、特にこれは最大 120 メートルの範囲を扱う場合に当てはまります。これらの結果は、さまざまなモーション変換方法での TimePillars のパフォーマンスの違いを強調し、他の方法と比較します。

ベンチマーク モデルの PointPillars とマルチフレーム (MF) PointPillars を比較すると、TimePillars が複数の主要業績評価指標で大幅な改善を達成していることがわかります。特に NuScenes 検出スコア (NDS) では、TimePillars はより高い総合スコアを示し、検出パフォーマンスと測位精度における利点を反映しています。さらに、TimePillars は平均変換誤差 (mATE)、平均スケール誤差 (mASE)、平均方位誤差 (mAOE) においても低い値を達成しており、測位精度と方位推定がより正確であることを示しています。特に注目すべきは、モーション変換に関する TimePillars のさまざまな実装がパフォーマンスに大きな影響を与えることです。畳み込みベースの動き変換 (Conv ベース) を使用する場合、TimePillars は NDS、mATE、mASE、および mAOE で特に優れたパフォーマンスを発揮し、動き補償におけるこの方法の有効性を証明し、検出精度を向上させます。対照的に、内挿法を使用する TimePillars もベースライン モデルより優れていますが、一部の指標では畳み込み法よりも劣ります。平均精度 (mAP) の結果は、TimePillars が車両、自転車、歩行者のカテゴリの検出で優れたパフォーマンスを発揮することを示しています。特に、自転車や歩行者などのより困難なカテゴリを処理する場合、そのパフォーマンスの向上はより顕著です。処理周波数 (f (Hz)) の観点から見ると、TimePillars はシングルフレームの PointPillars ほど高速ではありませんが、高い検出性能を維持しながらマルチフレームの PointPillars よりも高速です。これは、TimePillars がリアルタイム処理を維持しながら、長距離検出と動き補償を効果的に実行できることを示しています。言い換えれば、TimePillars モデルは、特にマルチフレーム データを処理し、畳み込みベースの動き変換テクノロジを使用する場合に、長距離検出、動き補償、および処理速度において大きな利点を示します。これらの結果は、自動運転車の 3D LIDAR 物体検出の分野における TimePillars の応用可能性を浮き彫りにしています。

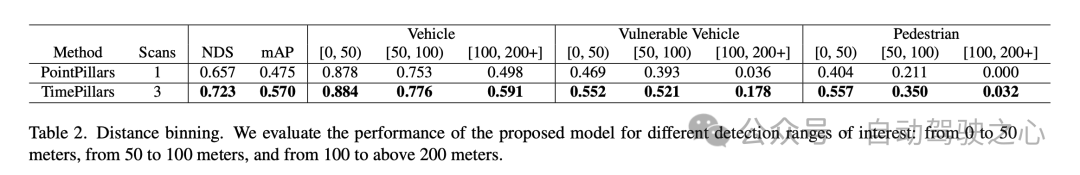

上記の実験結果は、TimePillars モデルが、特にベンチマーク モデルの PointPillars と比較して、さまざまな距離範囲での物体検出パフォーマンスにおいて優れたパフォーマンスを発揮することを示しています。これらの結果は、0 ~ 50 メートル、50 ~ 100 メートル、100 メートル以上の 3 つの主な検出範囲に分類されます。

上記の実験結果は、TimePillars モデルが、特にベンチマーク モデルの PointPillars と比較して、さまざまな距離範囲での物体検出パフォーマンスにおいて優れたパフォーマンスを発揮することを示しています。これらの結果は、0 ~ 50 メートル、50 ~ 100 メートル、100 メートル以上の 3 つの主な検出範囲に分類されます。

まず第一に、NuScenes 検出スコア (NDS) と平均精度 (mAP) は全体的なパフォーマンス指標です。 TimePillars は両方の指標で PointPillars よりも優れており、全体的に高い検出能力と測位精度を示しています。具体的には、TimePillars の NDS は 0.723 で、PointPillars の 0.657 よりもはるかに高く、mAP に関しても、TimePillars は 0.570 で PointPillars の 0.475 を大幅に上回っています。

さまざまな距離範囲でのパフォーマンスの比較では、TimePillars が各範囲でより優れたパフォーマンスを発揮していることがわかります。車両カテゴリの場合、0 ~ 50 メートル、50 ~ 100 メートル、および 100 メートルを超える範囲での TimePillars の検出精度は、それぞれ 0.884、0.776、0.591 であり、すべて同じ範囲の PointPillars のパフォーマンスよりも優れています。これは、TimePillars が近距離と遠距離の両方で車両検出の精度が高いことを示しています。 TimePillars は、脆弱な車両 (オートバイ、車椅子、電動スクーターなど) を扱う際にも優れた検出パフォーマンスを実証しました。特に 100 メートル以上の範囲では、TimePillars の検出精度は 0.178 であるのに対し、PointPillars はわずか 0.036 であり、長距離検出において大きな利点を示しています。歩行者検出についても、TimePillars は特に 50 ~ 100 メートルの範囲で優れたパフォーマンスを示し、検出精度は 0.350 でしたが、PointPillars はわずか 0.211 でした。より長い距離 (100 メートル以上) であっても、TimePillars は一定レベルの検出 (精度 0.032) を達成しますが、PointPillars はこの距離では検出能力がゼロです。

これらの実験結果は、さまざまな距離範囲での物体検出タスクの処理における TimePillars の優れたパフォーマンスを強調しています。近距離であろうと、より困難な長距離であろうと、TimePillars は、自動運転車の安全性と効率にとって重要な、より正確で信頼性の高い検出結果を提供します。

ディスカッション

まず、TimePillars モデルの主な利点は、長距離の物体検出の有効性です。動的ボクセル化と畳み込み GRU 構造を採用することにより、このモデルは、特に長距離の物体検出において、まばらな LIDAR データをより適切に処理できるようになります。これは、複雑で変化する道路環境で自動運転車を安全に運用するために重要です。さらに、このモデルは、リアルタイム アプリケーションに不可欠な処理速度の面でも優れたパフォーマンスを示します。一方、TimePillars は動き補償に畳み込みベースの方法を採用しており、従来の方法に比べて大幅に改善されています。このアプローチでは、トレーニング中の補助タスクを通じて変換の正確性が保証され、移動オブジェクトを処理する際のモデルの精度が向上します。

ただし、この論文の調査にはいくつかの限界もあります。まず、TimePillars は遠くの物体検出の処理では優れたパフォーマンスを発揮しますが、このパフォーマンスの向上には処理速度がある程度犠牲になる可能性があります。モデルの速度は依然としてリアルタイム アプリケーションに適していますが、シングルフレーム手法と比較すると依然として低下しています。さらに、この論文では主に LiDAR データに焦点を当てており、カメラやレーダーなどの他のセンサー入力は考慮されていないため、より複雑なマルチセンサー環境でのモデルの適用が制限される可能性があります。

つまり、TimePillars は、自動運転車の 3D LIDAR 物体検出、特に長距離検出と動き補償において、大きな利点を示しています。処理速度とマルチセンサー データの処理における制限に若干のトレードオフがあるにもかかわらず、TimePillars は依然としてこの分野で重要な進歩を示しています。

#結論

この研究は、過去のセンサー データを考慮することが、現在の情報のみを利用するよりも優れていることを示しています。以前の運転環境情報にアクセスすると、LIDAR 点群のまばらな性質に対処でき、より正確な予測につながります。我々は、リカレントネットワークが後者を達成する手段として適していることを実証します。システム メモリを提供すると、広範な処理を通じてより高密度のデータ表現を作成する点群集約手法と比較して、より堅牢なソリューションが実現します。私たちが提案したメソッド TimePillars は、再帰的問題を解決する方法を実装しています。推論プロセスに 3 つの畳み込み層を追加するだけで、重要な結果を達成し、既存の効率とハードウェア統合仕様が確実に満たされるようにするには、基本的なネットワーク構成要素で十分であることを示します。私たちの知る限り、この研究は、新しく導入された Zenseact オープン データセットでの 3D オブジェクト検出タスクの最初のベンチマーク結果を提供します。私たちの取り組みが将来、より安全で持続可能な道路に貢献できることを願っています。以上がTimePillars: 純粋な LiDAR 3D 検出ルートはどこに拡張できますか? 200mを直接カバー!の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7467

7467

15

15

1376

1376

52

52

77

77

11

11

19

19

22

22

自動運転シナリオにおけるロングテール問題を解決するにはどうすればよいでしょうか?

Jun 02, 2024 pm 02:44 PM

自動運転シナリオにおけるロングテール問題を解決するにはどうすればよいでしょうか?

Jun 02, 2024 pm 02:44 PM

昨日の面接で、ロングテール関連の質問をしたかと聞かれたので、簡単にまとめてみようと思いました。自動運転のロングテール問題とは、自動運転車におけるエッジケース、つまり発生確率が低い考えられるシナリオを指します。認識されているロングテール問題は、現在、単一車両のインテリジェント自動運転車の運用設計領域を制限している主な理由の 1 つです。自動運転の基礎となるアーキテクチャとほとんどの技術的問題は解決されており、残りの 5% のロングテール問題が徐々に自動運転の開発を制限する鍵となってきています。これらの問題には、さまざまな断片的なシナリオ、極端な状況、予測不可能な人間の行動が含まれます。自動運転におけるエッジ シナリオの「ロング テール」とは、自動運転車 (AV) におけるエッジ ケースを指します。エッジ ケースは、発生確率が低い可能性のあるシナリオです。これらの珍しい出来事

nuScenes の最新 SOTA | SparseAD: スパース クエリは効率的なエンドツーエンドの自動運転に役立ちます。

Apr 17, 2024 pm 06:22 PM

nuScenes の最新 SOTA | SparseAD: スパース クエリは効率的なエンドツーエンドの自動運転に役立ちます。

Apr 17, 2024 pm 06:22 PM

先頭と開始点に書かれている エンドツーエンドのパラダイムでは、統一されたフレームワークを使用して自動運転システムのマルチタスクを実現します。このパラダイムの単純さと明確さにも関わらず、サブタスクにおけるエンドツーエンドの自動運転手法のパフォーマンスは、依然としてシングルタスク手法に比べてはるかに遅れています。同時に、以前のエンドツーエンド手法で広く使用されていた高密度鳥瞰図 (BEV) 機能により、より多くのモダリティやタスクに拡張することが困難になります。ここでは、スパース検索中心のエンドツーエンド自動運転パラダイム (SparseAD) が提案されています。このパラダイムでは、スパース検索は、高密度の BEV 表現を使用せずに、空間、時間、タスクを含む運転シナリオ全体を完全に表します。具体的には、統合されたスパース アーキテクチャが、検出、追跡、オンライン マッピングなどのタスク認識のために設計されています。さらに、重い

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

純粋に視覚的な注釈ソリューションでは、主に視覚に加えて、GPS、IMU、および車輪速度センサーからのデータを動的注釈に使用します。もちろん、量産シナリオでは、純粋な視覚である必要はありません。一部の量産車両には固体レーダー (AT128) などのセンサーが搭載されています。大量生産の観点からデータの閉ループを作成し、これらすべてのセンサーを使用すると、動的オブジェクトのラベル付けの問題を効果的に解決できます。しかし、私たちの計画には固体レーダーはありません。したがって、この最も一般的な量産ラベル ソリューションを紹介します。純粋に視覚的な注釈ソリューションの中核は、高精度のポーズ再構築にあります。再構築の精度を確保するために、Structure from Motion (SFM) のポーズ再構築スキームを使用します。でもパスする

Occと自動運転の過去と現在を見てみよう!最初のレビューでは、機能強化/量産展開/アノテーションの効率化という 3 つの主要テーマを包括的にまとめています。

May 08, 2024 am 11:40 AM

Occと自動運転の過去と現在を見てみよう!最初のレビューでは、機能強化/量産展開/アノテーションの効率化という 3 つの主要テーマを包括的にまとめています。

May 08, 2024 am 11:40 AM

以上、筆者個人の理解 近年、自動運転はドライバーの負担軽減や運転の安全性の向上につながる可能性があるため、注目が高まっています。ビジョンベースの 3 次元占有予測は、自動運転の安全性に関する費用対効果の高い包括的な調査に適した新たな認識タスクです。オブジェクト中心の知覚タスクと比較して 3D 占有予測ツールの優位性は多くの研究で実証されていますが、この急速に発展している分野に特化したレビューはまだあります。このホワイトペーパーでは、まずビジョンベースの 3D 占有予測の背景を紹介し、このタスクで直面する課題について説明します。次に、現在の 3D 占有予測手法の現状と開発傾向を、機能強化、展開の容易さ、ラベル付けの効率という 3 つの側面から包括的に説明します。やっと

LLMはすべて完了しました! OmniDrive: 3D 認識と推論プランニングの統合 (NVIDIA の最新)

May 09, 2024 pm 04:55 PM

LLMはすべて完了しました! OmniDrive: 3D 認識と推論プランニングの統合 (NVIDIA の最新)

May 09, 2024 pm 04:55 PM

上記と著者の個人的な理解: この論文は、自動運転アプリケーションにおける現在のマルチモーダル大規模言語モデル (MLLM) の主要な課題、つまり MLLM を 2D 理解から 3D 空間に拡張する問題の解決に特化しています。自動運転車 (AV) は 3D 環境について正確な決定を下す必要があるため、この拡張は特に重要です。 3D 空間の理解は、情報に基づいて意思決定を行い、将来の状態を予測し、環境と安全に対話する車両の能力に直接影響を与えるため、AV にとって重要です。現在のマルチモーダル大規模言語モデル (LLaVA-1.5 など) は、ビジュアル エンコーダーの解像度制限や LLM シーケンス長の制限により、低解像度の画像入力しか処理できないことがよくあります。ただし、自動運転アプリケーションには次の要件が必要です。

「クローズド ループ」に向けて | PlanAgent: MLLM に基づく自動運転のクローズド ループ プランニングのための新しい SOTA!

Jun 08, 2024 pm 09:30 PM

「クローズド ループ」に向けて | PlanAgent: MLLM に基づく自動運転のクローズド ループ プランニングのための新しい SOTA!

Jun 08, 2024 pm 09:30 PM

中国科学院オートメーション研究所の深層強化学習チームは、Li Auto氏らとともに、マルチモーダル大規模言語モデルMLLM(PlanAgent)に基づく自動運転のための新しい閉ループ計画フレームワークを提案した。この手法は、シーンの鳥瞰図とグラフベースのテキスト プロンプトを入力として受け取り、マルチモーダル大規模言語モデルのマルチモーダル理解機能と常識推論機能を利用して、シーンの理解から生成までの階層的推論を実行します。水平移動と垂直移動の指示を作成し、プランナーが必要とする指示をさらに生成します。このメソッドは、大規模で困難な nuPlan ベンチマークでテストされており、実験では、PlanAgent が通常のシナリオとロングテール シナリオの両方で最先端 (SOTA) のパフォーマンスを達成することが示されています。従来の大規模言語モデル (LLM) メソッドと比較して、PlanAgent

パス計画の概要: サンプリング、検索、最適化に基づいてすべて完了しました。

Jun 01, 2024 pm 08:12 PM

パス計画の概要: サンプリング、検索、最適化に基づいてすべて完了しました。

Jun 01, 2024 pm 08:12 PM

1 意思決定制御と動作計画の概要 現在の意思決定制御方法は、逐次計画、行動認識型計画、およびエンドツーエンド計画の 3 つのカテゴリに分類できます。逐次計画: 最も伝統的な方法であり、認識、意思決定、制御の 3 つの部分が比較的明確です。行動を意識した計画: 最初の方法と比較して、ハイライトは人間と機械の共同運転、車両と道路の導入です。外部動的環境のコラボレーションと車両リスク推定。エンドツーエンドの計画: DL および DRL テクノロジーは、画像やハンドルのコーナーなどの感覚情報を取得するために大量のデータ トレーニングを使用します。