人間とAIの意思決定連携:意思決定問題の定式化、説明、評価

人工知能やデータ視覚化などの分野では、情報表示を使用して人間がより適切な意思決定を行えるようにする方法が重要な研究目標です。しかし、意思決定問題の定義と、人間の意思決定のパフォーマンスを評価する方法に関する実験計画については、現時点では明確な合意はありません。最近の論文では、統計的意思決定理論と情報経済学に基づいた意思決定問題の定義を提案し、人間の意思決定能力の損失を評価するためのフレームワークを提供しています。この記事ではこの論文を解釈し、意思決定に関する研究を進める上でのその意味を探ります。

論文「人間の意思決定を評価する実験のための意思決定理論の基礎」では、3 人のアメリカの専門家が、人間中心の人工知能 (HCAI)、視覚化、研究に関する意思決定を支援する情報インターフェイスを提供しています。関連分野が共通の目標を達成します。これらの専門家は、視覚化の研究者はデータ視覚化の重要な目標として意思決定支援を重視していると主張しています。同時に、人間中心の人工知能では、人間の意思決定行動に関する実証研究は、「意思決定を支援する人工知能テクノロジーの有効性を評価し、人間が人工知能とどのように相互作用するかについての基本的な理解を発展させること」とも広くみなされています。意思決定をするために必要な内容です。これらの研究の目標は、意思決定の精度と効率を向上させ、人工知能テクノロジーと人間の意思決定者との間の良好な相互作用を確保し、より良い意思決定サポートを人々に提供することです。

彼らは、人間の意思決定の情報表示を研究することで、最小限の理論的コミットメントを明確に定義でき、それによってタスクの規範的な行動を決定する可能性が得られると信じています。幸いなことに、既存の統計的意思決定理論と期待効用理論はこの課題に対処し、意思決定を研究するための厳密に導出された広く適用可能なフレームワークを提供できます。さらに、情報経済学の発展は、意思決定の問題に対する情報構造の形式化に対する解決策も提供します。これには、モデル予測の視覚化と解釈のオプションを設計する方法が含まれる場合があります。

彼らは、統計的意思決定理論と情報経済学から、明確に定義された意思決定問題の広く適用可能な定義を合成し、HCAI および意思決定における関連する価値のデータ駆動型インターフェイスからこのアプローチをインスピレーションを得ています。研究。彼らの最初の貢献は、最適な意思決定を特定し、それによって人間の意思決定におけるバイアスを特定するために、意思決定問題に対して定義する必要があるコンポーネントの最小限のセットを確立し、動機付けすることでした。彼らは、合理的ベイジアンエージェントの概念を使用して、研究参加者が提供された情報から規範的な決定を理論的に特定できる場合にのみ、パフォーマンスの損失を考慮できることを示しています。彼らは、既存の46件の研究のサンプルのうち、35件の研究が人間の意思決定の欠陥についての結論を引き出すために予測表示を使用していたが、参加者には少なくとも十分な情報が与えられていたため、明示的な研究課題であったのはそのうちの6件(17%)のみであることを発見した。原則として、最良の決定を決定できます。彼らは例を使ってこれらの結論の認識論的リスクを説明し、実験者に発見の解釈可能性を高めるための提案を提供します。

論文著者の経歴

この論文のタイトルは「人間の意思決定を評価する実験のための意思決定理論的基礎」で、ジェシカ・ハルマン、アレックスによって書かれました。 Kale 、Jason Hartline、ノースウェスタン大学の 3 人のコンピューター科学者による共著、2024 年 1 月 25 日に arXiv で公開されました (論文アドレス: https://arxiv.org/abs/2401.15106)。これら 3 人の著者は、人工知能、データ視覚化、ヒューマン コンピューター インタラクションなどの分野で著名な学者です。彼らの研究結果は、ACM CHI、ACM CSCW、IEEE VIS、ACM などの一流の学会や雑誌で発表されています。 ECなど彼らの研究関心は主に、人工知能とデータ視覚化を使用して、リスク評価、予測、推奨などの複雑な不確実性の問題を人間が理解して意思決定できるようにする方法に焦点を当てています。

この論文の主な貢献

アクション空間、状態空間、スコアリングルールなど、一般的な意思決定問題の定義が示されています。 、以前の信念、データ生成モデル、シグナリング戦略について説明し、これらの要素を使用して最適なアクションと期待される有用性を決定する方法を説明します。

事前損失、受信損失、更新損失、最適化損失を含む 4 つの潜在的な損失源を含む、人間の意思決定によるパフォーマンス損失を評価するためのフレームワークを提案し、実験的手法の使用方法を検討します。これらの損失を推定および分析するための設計と結果を作成します。

近年、研究者たちは AI 支援による意思決定をコード化して評価しましたが、参加者が規範を決定するのに十分な情報を提供した研究は少数 (約 17%) のみであることが判明しました。意思決定。むしろ、ほとんどの研究 (約 83%) は、不明確かつ不完全な意思決定の問題に悩まされており、人間の意思決定のバイアスや欠陥について信頼性の低い結論につながっています。

理論的根拠と方法

この論文の理論的基礎は主に統計的意思決定理論と情報経済学に基づいています。統計的意思決定理論では、意思決定者の好み、信念、行動の関係と、信念を更新して行動を選択するためにデータと情報を使用する方法に焦点を当て、不確実性の下で最適な選択を行う方法を研究します。情報経済学は、情報の生産、普及、消費のメカニズムと、非対称で不完全で信頼性の低い情報が市場や社会に及ぼす影響に焦点を当て、経済行動と結果に対する情報の影響を研究します。これら 2 つの分野は、この論文の重要な理論的基礎を提供し、経済における意思決定と情報の役割と影響を深く理解するのに役立ちます。

この論文の方法は主にベイズ理論と期待効用理論に基づいています。ベイジアン理論は、不確実性を説明および推論するために使用される確率理論であり、事前の信念と観察データに基づく事後信念、つまり、特定のデータ条件下で特定の仮説またはイベントが発生する確率を計算することに重点を置いています。期待効用理論は、効用関数と確率分布に基づいて、さまざまな状態で生成される効用の加重平均である期待効用を計算する方法に焦点を当てた、危険な意思決定を評価するための理論です。このアプローチは、ベイズ推論と効用評価を組み合わせて、不確実性に直面しても意思決定者に最適な決定を提供します。

意思決定問題の定義

意思決定問題と、その基準の損失に対するパフォーマンスを決定するための対応する最適な動作基準を定義します。それらの定義は、人間の行動の管理された評価、つまり規範的な意思決定の研究を目的としています。このタイプの評価研究では、研究参加者がどのような状態について質問を受けているかについて、基本的な事実を判断する能力が必要です。行動データ (人間またはシミュレーションによって生成される) は、情報提供によって引き起こされる行動を理解することを目的として、制御された条件下で収集されます。このような研究は、特定の状況における人間のパフォーマンスの質 (例: 戦略的状況における表示に基づいて人々が意思決定を行う程度) を説明したり、人間のパフォーマンスに応じてさまざまな支援要素 (例: さまざまな視覚化や人工知能など) をランク付けしたりするためによく使用されます。 ). インテリジェントな説明戦略)、または人間がどのように意思決定を行うか、または人間がより良く行うのに何が役立つかについての仮説をテストします(たとえば、認知強制機能は AI 支援の意思決定を改善します)。

最適なアクションと期待される有用性の計算

上で定義した意思決定問題を考慮して、エージェントが不確実性の下にあると仮定してこれを行います。結果 一貫した好みを持ち、状況に応じて行動の間で最善の決定を下し、規範的な (「最適な」) 決定を計算することは何を意味しますか。したがって、実験参加者のパフォーマンスをこの基準を満たす試みとして解釈し、パフォーマンスのエラー (損失) の原因を特定することができます。

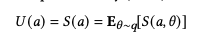

これを行うには、まずエージェントの好みがスコアリング ルールによって要約できると仮定し、期待される有用性 (スコア) を最大化するアクションをエージェントが選択すると仮定します。

#図

#図

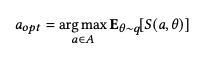

# は、被験者の信念分布、つまり世界の状態に対する被験者の信念の確率分布を示しています。最適なアクションは、エージェントの期待されるユーティリティを最大化するアクションとして定義できます。

#図

#図

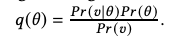

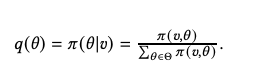

# 具体的には、最適なアクションを計算します。意思決定タスクの意思決定では、最初にエージェントを π で定義します: Pr(θ) または p(θ) 前述したように。シグナリング戦略が信号を通じて π(θ |u) を直接表示せず、θ に通知する場合は常に、エージェントが信号を見た後、ベイズの法則を使用して、信号に関する知識に基づいて信号に対する応答を予測すると仮定します。データ生成モデル 合計状態の前の信念は事後信念 π に更新されます:

picture

picture

u は正規化係数。式 3 の定義は、エージェントが知るために q(θ) が計算されることを意味していることに注意してください。

図

図

これらの事後信念を考慮して、式 2 を使用して、完全に合理的なエージェントが彼女を最大化する順序を決定します。期待されるユーティリティと選択されたアクション S.

著者のコンピューティング フレームワークは、人間と人工知能の間の意思決定のコラボレーションに便利なツールを提供します。これは、人間の意思決定の行動と影響を分析および改善し、人間の意思決定の質と満足度を向上させるのに役立ちます。 。また、彼らの計算フレームワークは、意思決定の理論と方法を拡張および深化させるための刺激的で革新的な空間を提供し、より多くの意思決定要因とメカニズム、さらにより多くの意思決定モデルと戦略を探索することができます。

人間の意思決定のパフォーマンス損失の評価

上記のフレームワークを使用する主な動機は本質的に認識論的であり、それらは私たちの知識に関連しています実験結果の説明。人間の意思決定実験における意思決定問題に対する反応を、誤った意思決定プロセスの証拠として解釈するには、原則として、参加者の行動が判断される基準となる決定を決定するのに十分な情報を実験で参加者に提供する必要があります。言い換えれば、実験は参加者に意思決定問題の理解を規範的解釈と一致させるのに十分な情報を提供しているか?

彼らは、ニューラル ネットワーク モデルが、プロスペクト理論、環境ベースのモデル、ハイブリッド モデルなどの既存の心理学研究を再現し、超えることができることを発見しました。ニューラル ネットワーク モデルは、さまざまな仮定に基づいて、さまざまなリスク認識関数とそれらの間の重みを自動的に学習できます。著者らはまた、人間のリスク認識関数は非線形でシナリオに依存しており、確率とリターンの間には相互依存関係があることも発見した。これらの調査結果は、人間のリスクに関する意思決定は非常に複雑であり、単純な仮定に起因するものではないことを示しています。

著者らは、人間の意思決定パフォーマンスの損失の程度を測定するために、人間の選択と最適な選択の平均差である単純な指標を使用しました。著者らは、人間の意思決定能力の損失はシナリオによって 0.01 から 0.5 の範囲で大きく異なることを発見しました。著者らはまた、人間の意思決定能力の損失がニューラル ネットワーク モデルの予測誤差と正の相関関係があることも発見しました。つまり、ニューラル ネットワーク モデルが人間の選択を予測することが困難であればあるほど、人間の意思決定能力の損失が大きくなるということです。意思決定のパフォーマンス。これは、ニューラル ネットワーク モデルが人間のリスク認識の特性、および人間のリスク意思決定の不合理性と矛盾を効果的に捕捉できることを示しています。

著者の評価フレームワークは、人間と人工知能の意思決定コラボレーションに役立つツールを提供します。これは、人間の意思決定の行動と影響を分析および改善し、品質を向上させるのに役立ちます。人間の意思決定の質と満足度。また、著者の評価フレームワークは、意思決定の理論と方法を拡張および深化させるための刺激的で革新的なスペースを提供し、より多くの意思決定の要素とメカニズム、さらにより多くの意思決定のモデルと戦略を探求することができます。

実証分析と結果

この論文の実証分析は主に、最近の人工知能支援意思決定に関する研究をコード化して評価します。これらの研究が意思決定理論の枠組みに準拠しているかどうか、また人間の意思決定の欠陥や損失について合理的な結論を下しているかどうかをテストするために。著者は、2018年から2021年の間にACMまたはACLカンファレンスで発表され、分類または回帰問題に対する人工知能支援の意思決定に関する実験を含む、Laiらによる文献レビューから46件の研究をランダムに選択した。

著者らは、次の 3 つの側面に従ってこれらの研究をコード化しました。

意思決定理論フレームワークの適用性: 決定できる実際の状態が存在するかどうか、およびその状態に関連して利益または損失があるかどうか。

人間の意思決定の評価:過依存や過小依存の現象の指摘など、人間の意思決定のパフォーマンスや質について評価や判断が行われているか。 - 人工知能への依存、または人間の意思決定の原因や影響要因についての推測。

意思決定の問題の明確さ: 行動空間、状態空間、スコアリングルール、事前信念、データ生成モデルとシグナリング戦略など、規範的な意思決定を特定するために十分な情報が参加者に提供されているかどうか、など。

著者のコーディング結果では、11 件の研究 (24%) に、主観的な音楽や映画の推奨、感情認識など、実際の状態を決定できないタスクが含まれていることが示されています。これらの研究は、理論的な意思決定には適していません。フレームワーク。残りの35件の研究(76%)は人間の意思決定のパフォーマンスや質について評価や判断を行ったが、規範的な決定を特定するのに十分な情報を参加者に提供したのは6件の研究(17%)だけで、残りの29件の研究(83%)は意思決定に関する問題が不明確かつ不完全であったため、人間の意思決定における偏見や欠陥について信頼性の低い結論に至りました。著者はまた、事前信念の伝達の欠如、事後信念の計算の欠如、動機付けの欠如、スコアリングルールの比較など、これらの研究の具体的な問題点と改善方法について詳細な分析と議論を提供します。著者は、これらの問題はすべて、意思決定の問題を定義して伝達する際の研究者の欠陥、および実験世界と現実世界の関係についての研究者の不明確な理解に起因していると考えています。著者は、研究者が人間の意思決定行動を効果的に評価し改善するために、実験を計画する際に意思決定理論の枠組みを十分に考慮し、意思決定の問題に必要なすべての要素を参加者や読者に明確に伝えることを推奨しています。

今後の課題

この論文の限界は主に、期待効用理論と規範的手法に対する課題と批判から来ています。期待効用理論は、合理性と最適化に基づいた意思決定理論であり、意思決定者が完全な情報と計算能力、および一貫した安定した選好を持っていることを前提としています。しかし、これらの仮定は現実世界では当てはまらないことが多く、人間の意思決定行動は認知的、感情的、社会的、道徳的、その他の要因の影響を受ける可能性があり、期待効用理論の予測からの逸脱につながる可能性があります。規範的アプローチは、意思決定に対する価値と目標に基づいたアプローチであり、意思決定者が明確な価値目標と、価値目標に対するさまざまな行動の影響を評価する方法を持っていることを前提としています。しかし、これらの仮定は現実世界では当てはまらないことが多く、人間の価値観は多様で、動的で、曖昧であり、他の人々や社会の価値観と衝突したり、調和したりする可能性があります。したがって、この論文のフレームワークと方法は、一部の主観的、複雑、多目的の意思決定の問題には適していない可能性があり、また一部の人間の意思決定に固有の価値と重要性が無視されている可能性もあります。

今後の取り組みは、主に次の 4 つの側面で拡大、深化していきます。

人間の実際の意思決定をより適切に記述し、評価するために、行動経済学、多属性効用理論、多基準意思決定分析など、他の意思決定理論と方法を探索します。行動や好みを作る。

意思決定の問題のさまざまな要素をより適切に伝達および説明するために、自然言語、グラフィックス、サウンド、タッチなどのさまざまな情報表示および対話方法を研究します。人間の情報受信および処理能力を向上させるため。

報酬、罰、信頼性、評判、社会的影響力など、さまざまなインセンティブとフィードバックのメカニズムを試して、人間の意思決定の動機と参加をさらに刺激し、維持します。人間の意思決定の学習と改善の能力を向上させます。

人工知能と人間の間のさまざまなコラボレーション モデル (支援、アドバイス、代理店、交渉、調整など) を拡張して、人工知能と人間の長所と短所のバランスを調整して活用します。人間だけでなく、人工知能と人間に対する信頼と満足度も向上します。

意義と価値

この論文は、人体実験をより適切に設計および分析するための、構造化された意思決定問題の定義と評価のための明確なフレームワークを提供します。そして人工知能による意思決定のコラボレーション。

人工知能、データ視覚化、ヒューマン・コンピューター・インタラクションなどの分野の研究者に、意思決定パフォーマンスの損失をより適切に特定して改善するための客観的かつ厳密な評価および分析方法を提供します。人間と人工知能の間の意思決定コラボレーションの有効性と質。これらは、人間と AI の意思決定のコラボレーションの問題と課題をよりよく理解し、伝達するために、意思決定の問題のコミュニケーションと解釈に関する批判的かつ思慮深い視点を提供します。また、人間と人工知能の間の意思決定コラボレーションの可能性と可能性をより良く探求し、発見するために、意思決定の問題を拡大し、より深く掘り下げるという刺激的で革新的な方向性も提供します。

要約と展望

この論文は、統計的意思決定理論と情報経済学に基づいた意思決定の問題の定義と、損失を評価するためのフレームワークを提案しています。人間の意思決定のパフォーマンス。その目的は、人工知能、データ視覚化、人間とコンピューターのインタラクション、およびその他の分野の研究者に、人間と人工知能の間の意思決定コラボレーションに関する実験をより適切に設計および分析するための、明確で体系化されたガイドとリファレンスを提供することです。彼らは、近年の関連研究をコード化して評価し、参加者に規範的な決定を特定するのに十分な情報を提供した研究はほんの一部である一方、ほとんどの研究は不明確で不完全な決定の問題に悩まされていることが判明しました。作りは信頼できません。人間の意思決定行動を効果的に評価し改善するために、研究者は実験を計画する際に意思決定理論の枠組みを十分に考慮し、意思決定の問題に必要なすべての要素を参加者や読者に明確に伝えることをお勧めします。

著者らは、フレームワークと手法の限界と今後の取り組みの必要性も認識しています。彼らの枠組みと手法は、期待効用理論と規範的手法に基づいていますが、実際の人間の意思決定行動や好みと一致しない、人間の意思決定の本質的な価値や重要性を無視しているなど、いくつかの課題や批判もあります。また、それらのフレームワークと手法は、一部の主観的、複雑、多目的の意思決定問題には適していない可能性があり、人間と人工知能の間の意思決定コラボレーションのすべての可能性と可能性をカバーしていない可能性があります。したがって、私たちの将来の仕事は主に次の側面で拡大および深化することです:他の意思決定理論と方法の探索、さまざまな情報表示と相互作用方法の研究、さまざまなインセンティブとフィードバックメカニズムの研究、さまざまな人工知能と人間のコラボレーションモードの研究。 (了)

参考: https://arxiv.org/abs/2401.15106

以上が人間とAIの意思決定連携:意思決定問題の定式化、説明、評価の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7554

7554

15

15

1382

1382

52

52

83

83

11

11

23

23

96

96

Centosシャットダウンコマンドライン

Apr 14, 2025 pm 09:12 PM

Centosシャットダウンコマンドライン

Apr 14, 2025 pm 09:12 PM

Centos Shutdownコマンドはシャットダウンし、構文はシャットダウン[オプション]時間[情報]です。オプションは次のとおりです。-hシステムをすぐに停止します。 -pシャットダウン後に電源をオフにします。 -r再起動; -t待機時間。時間は、即時(現在)、数分(分)、または特定の時間(HH:mm)として指定できます。追加の情報をシステムメッセージに表示できます。

Centosのgitlabのバックアップ方法は何ですか

Apr 14, 2025 pm 05:33 PM

Centosのgitlabのバックアップ方法は何ですか

Apr 14, 2025 pm 05:33 PM

Centosシステムの下でのGitlabのバックアップと回復ポリシーデータセキュリティと回復可能性を確保するために、Gitlab on Centosはさまざまなバックアップ方法を提供します。この記事では、いくつかの一般的なバックアップ方法、構成パラメーター、リカバリプロセスを詳細に紹介し、完全なGitLabバックアップと回復戦略を確立するのに役立ちます。 1.手動バックアップGitlab-RakeGitlabを使用:バックアップ:コマンドを作成して、マニュアルバックアップを実行します。このコマンドは、gitlabリポジトリ、データベース、ユーザー、ユーザーグループ、キー、アクセスなどのキー情報をバックアップします。デフォルトのバックアップファイルは、/var/opt/gitlab/backupsディレクトリに保存されます。 /etc /gitlabを変更できます

CentOS HDFS構成をチェックする方法

Apr 14, 2025 pm 07:21 PM

CentOS HDFS構成をチェックする方法

Apr 14, 2025 pm 07:21 PM

CENTOSシステムでHDFS構成をチェックするための完全なガイドこの記事では、CENTOSシステム上のHDFSの構成と実行ステータスを効果的に確認する方法をガイドします。次の手順は、HDFSのセットアップと操作を完全に理解するのに役立ちます。 Hadoop環境変数を確認します。最初に、Hadoop環境変数が正しく設定されていることを確認してください。端末では、次のコマンドを実行して、Hadoopが正しくインストールおよび構成されていることを確認します。HDFS構成をチェックするHDFSファイル:HDFSのコア構成ファイルは/etc/hadoop/conf/ディレクトリにあります。使用

CentosのPytorchのGPUサポートはどのようにサポートされていますか

Apr 14, 2025 pm 06:48 PM

CentosのPytorchのGPUサポートはどのようにサポートされていますか

Apr 14, 2025 pm 06:48 PM

Pytorch GPUアクセラレーションを有効にすることで、CentOSシステムでは、PytorchのCUDA、CUDNN、およびGPUバージョンのインストールが必要です。次の手順では、プロセスをガイドします。CUDAおよびCUDNNのインストールでは、CUDAバージョンの互換性が決定されます。NVIDIA-SMIコマンドを使用して、NVIDIAグラフィックスカードでサポートされているCUDAバージョンを表示します。たとえば、MX450グラフィックカードはCUDA11.1以上をサポートする場合があります。 cudatoolkitのダウンロードとインストール:nvidiacudatoolkitの公式Webサイトにアクセスし、グラフィックカードでサポートされている最高のCUDAバージョンに従って、対応するバージョンをダウンロードしてインストールします。 cudnnライブラリをインストールする:

Dockerの原則の詳細な説明

Apr 14, 2025 pm 11:57 PM

Dockerの原則の詳細な説明

Apr 14, 2025 pm 11:57 PM

DockerはLinuxカーネル機能を使用して、効率的で孤立したアプリケーションランニング環境を提供します。その作業原則は次のとおりです。1。ミラーは、アプリケーションを実行するために必要なすべてを含む読み取り専用テンプレートとして使用されます。 2。ユニオンファイルシステム(UnionFS)は、違いを保存するだけで、スペースを節約し、高速化する複数のファイルシステムをスタックします。 3.デーモンはミラーとコンテナを管理し、クライアントはそれらをインタラクションに使用します。 4。名前空間とcgroupsは、コンテナの分離とリソースの制限を実装します。 5.複数のネットワークモードは、コンテナの相互接続をサポートします。これらのコア概念を理解することによってのみ、Dockerをよりよく利用できます。

Centosはmysqlをインストールします

Apr 14, 2025 pm 08:09 PM

Centosはmysqlをインストールします

Apr 14, 2025 pm 08:09 PM

CentOSにMySQLをインストールするには、次の手順が含まれます。適切なMySQL Yumソースの追加。 yumを実行して、mysql-serverコマンドをインストールして、mysqlサーバーをインストールします。ルートユーザーパスワードの設定など、MySQL_SECURE_INSTALLATIONコマンドを使用して、セキュリティ設定を作成します。必要に応じてMySQL構成ファイルをカスタマイズします。 MySQLパラメーターを調整し、パフォーマンスのためにデータベースを最適化します。

Centos8はsshを再起動します

Apr 14, 2025 pm 09:00 PM

Centos8はsshを再起動します

Apr 14, 2025 pm 09:00 PM

SSHサービスを再起動するコマンドは次のとおりです。SystemCTL再起動SSHD。詳細な手順:1。端子にアクセスし、サーバーに接続します。 2。コマンドを入力します:SystemCtl RestArt SSHD; 3.サービスステータスの確認:SystemCTLステータスSSHD。

CentosでPytorchの分散トレーニングを操作する方法

Apr 14, 2025 pm 06:36 PM

CentosでPytorchの分散トレーニングを操作する方法

Apr 14, 2025 pm 06:36 PM

Pytorchの分散トレーニングでは、Centosシステムでトレーニングには次の手順が必要です。Pytorchのインストール:PythonとPipがCentosシステムにインストールされていることです。 CUDAバージョンに応じて、Pytorchの公式Webサイトから適切なインストールコマンドを入手してください。 CPUのみのトレーニングには、次のコマンドを使用できます。PipinstalltorchtorchtorchvisionTorchaudioGPUサポートが必要な場合は、CUDAとCUDNNの対応するバージョンがインストールされ、インストールに対応するPytorchバージョンを使用してください。分散環境構成:分散トレーニングには、通常、複数のマシンまたは単一マシンの複数GPUが必要です。場所