テクノロジー周辺機器

テクノロジー周辺機器

AI

AI

Tongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えます

Tongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えます

Tongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えます

春節前に、Tongyi Qianwen Model (Qwen) のバージョン 1.5 がオンラインになりました。今朝、新しいバージョンのニュースが AI コミュニティで懸念を引き起こしました。

大型モデルの新バージョンには、0.5B、1.8B、4B、7B、14B、72B の 6 つのモデル サイズが含まれています。その中でも最強バージョンの性能はGPT 3.5やMistral-Mediumを上回ります。このバージョンには Base モデルと Chat モデルが含まれており、多言語サポートを提供します。

アリババのTongyi Qianwenチームは、関連技術がTongyi Qianwen公式WebサイトとTongyi Qianwenアプリでもリリースされたと述べました。

さらに、Qwen 1.5 の本日のリリースには次のハイライトもあります:

- 32K コンテキスト長をサポート;

- Base Chat モデルのチェックポイントをオープン;

- Transformers を使用してローカルで実行可能;

- にリリース同時に GPTQ Int-4/Int8、AWQ、GGUF の重み付けも行います。

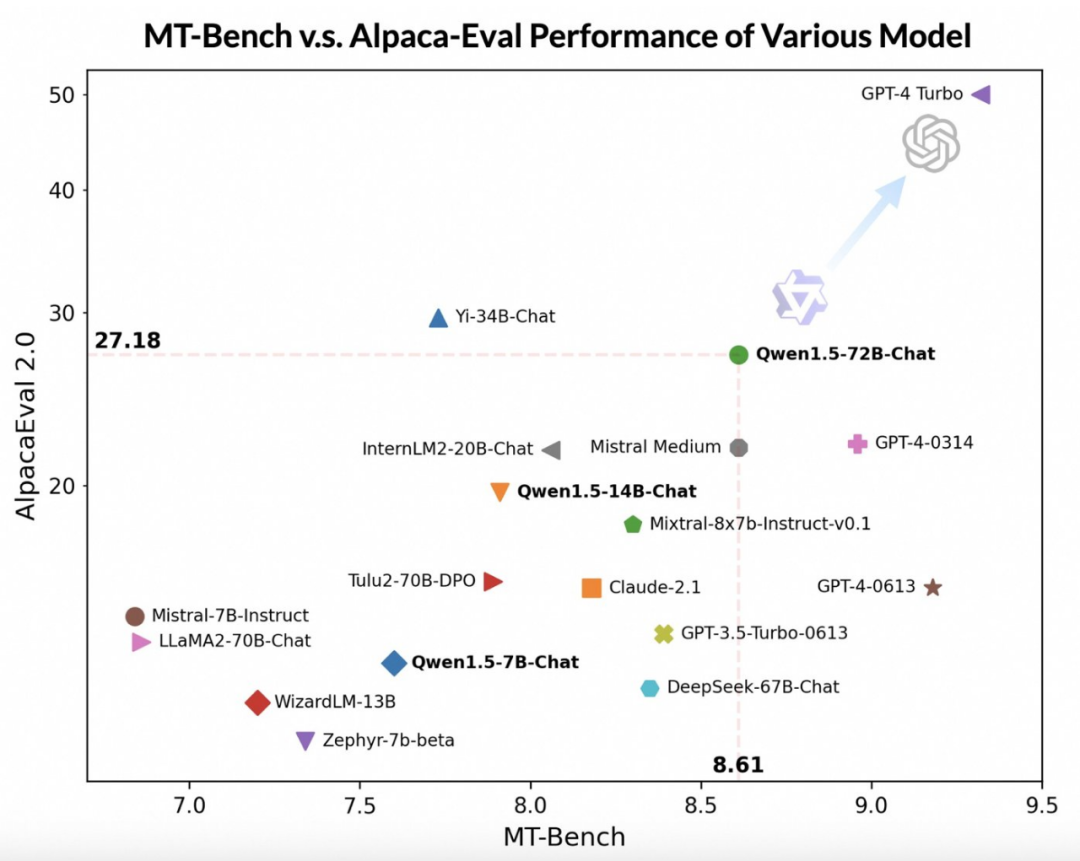

より高度な大規模モデルを審査員として使用することで、Tongyi Qianwen チームは、広く使用されている 2 つのベンチマーク、MT-Bench と Alpaca-Eval で Qwen1.5 を実行しました。事前評価。評価結果は次のとおりです。

##Qwen1.5-72B-Chat モデルは GPT-4-Turbo に比べて遅れていますが、MT ではパフォーマンスが優れています。 -Alpaca-Eval v2 でのベンチテストとインテストでは、印象的なパフォーマンスを示しました。実際、Qwen1.5-72B-Chat は、Claude-2.1、GPT-3.5-Turbo-0613、Mixtral-8x7b-instruct、TULU 2 DPO 70B を上回り、最近注目を集めている Mistral Medium モデルにも匹敵する性能を持っています。 。 匹敵します。これは、Qwen1.5-72B-Chat モデルが自然言語処理においてかなりの強みを持っていることを示しています。

Tongyi Qianwen チームは、大規模モデルのスコアは回答の長さに関係している可能性があるが、人間の観察では Qwen1.5 は過度に長い回答の影響を受けないことが示されていると指摘しました。衝撃評価。 AlpacaEval 2.0 データによると、Qwen1.5-Chat の平均長は 1618 で、GPT-4 と同じ長さですが、GPT-4-Turbo よりも短いです。

Tongyi Qianwen の開発者は、ここ数カ月間、優れたモデルを構築し、開発者のエクスペリエンスを継続的に向上させることに取り組んできたと述べました。

以前のバージョンと比較して、このアップデートはチャット モデルを人間の好みに合わせて改善することに重点を置き、モデルの多言語処理を大幅に強化しています。力。シーケンスの長さに関しては、すべてのスケール モデルで 32768 トークンのコンテキスト長範囲のサポートが実装されています。同時に、事前トレーニングされた基本モデルの品質も大幅に最適化されており、微調整プロセス中により良いエクスペリエンスを人々に提供することが期待されています。

基本機能

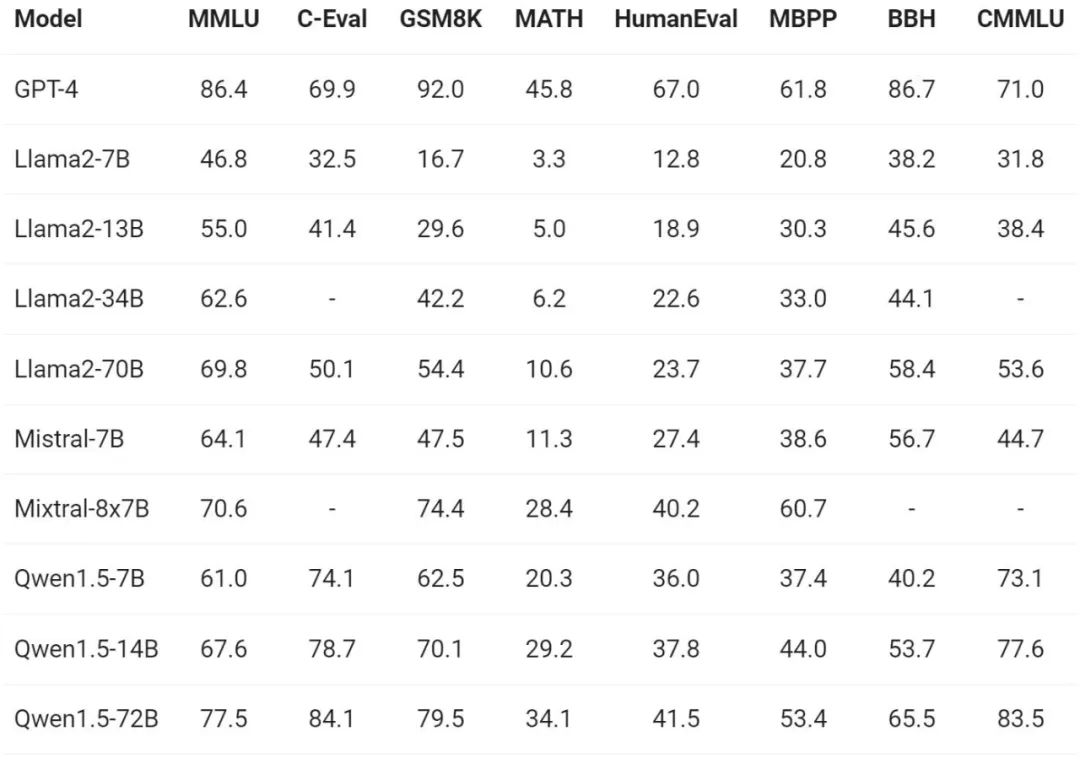

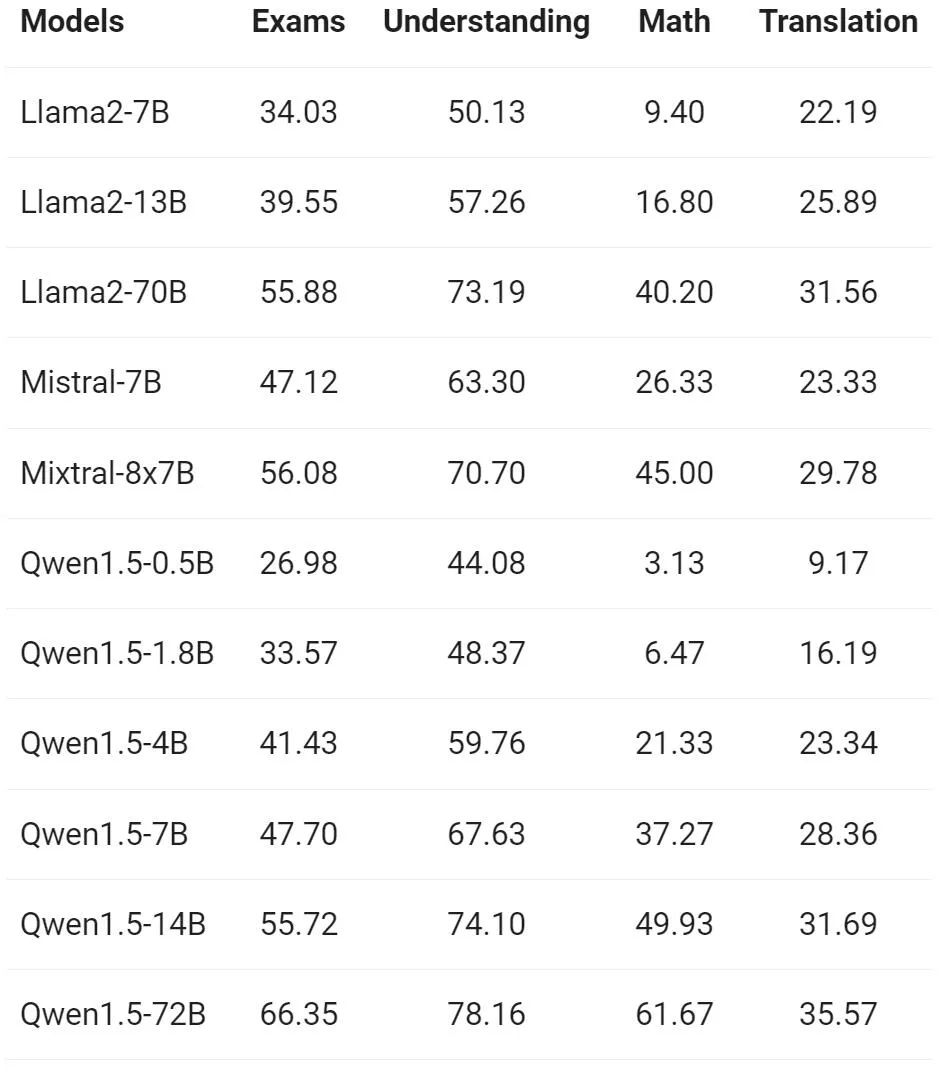

モデルの基本機能の評価に関して、Tongyi Qianwen チームは MMLU (5 ショット)、C を実施しました。 -Eval、Qwen1.5 は、Humaneval、GS8K、BBH などのベンチマーク データセットで評価されました。

さまざまなモデル サイズの下で、Qwen1.5 は評価ベンチマークで優れたパフォーマンスを示し、72B バージョンはすべてのベンチマークで良好なパフォーマンスを示しました。 70B では、言語理解、推論、数学における能力を実証しました。

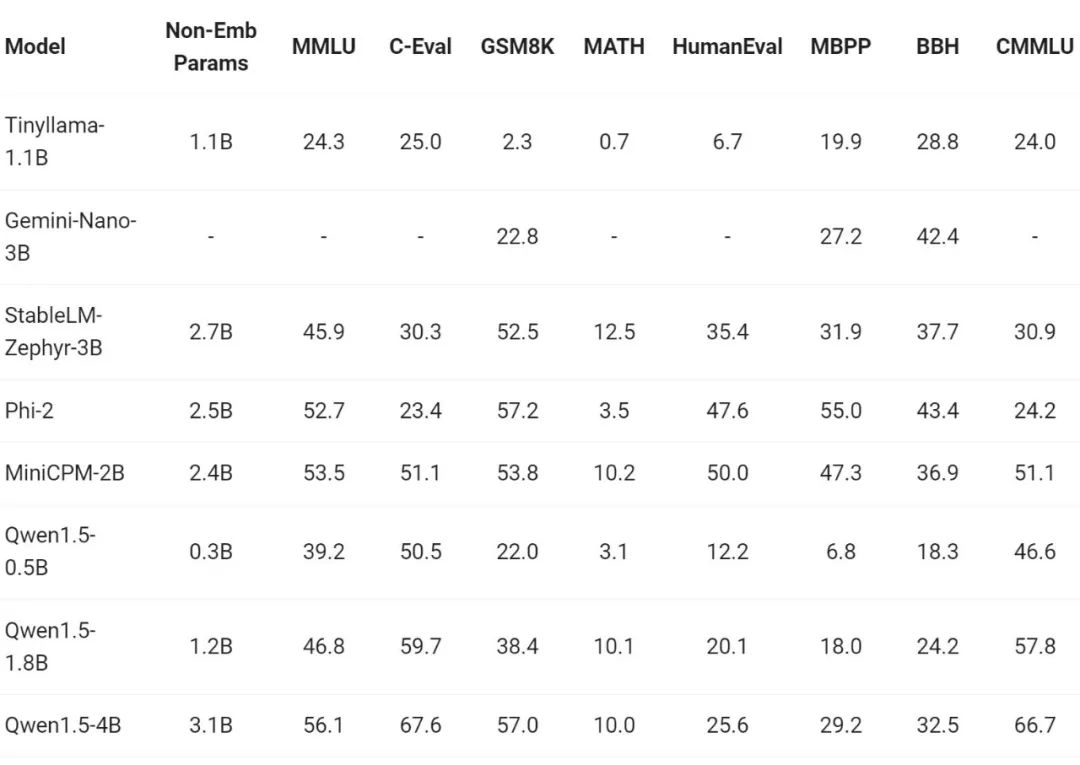

最近、小規模モデルの構築が業界で注目を集めています。Tongyi Qianwen チームは、モデル パラメーターが 70 億未満の Qwen1.5 モデルを比較しました。比較:

Qwen1.5 は、パラメーター サイズ範囲が 7 未満の業界をリードする小型モデルと非常に競争力があります。億の力。

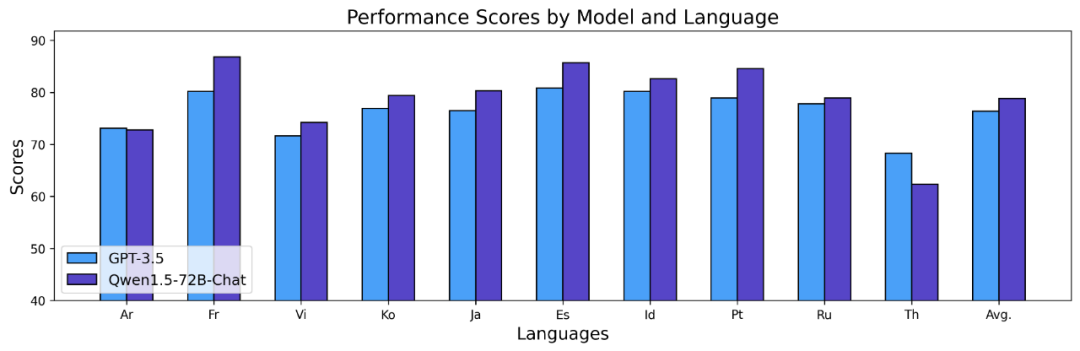

多言語機能

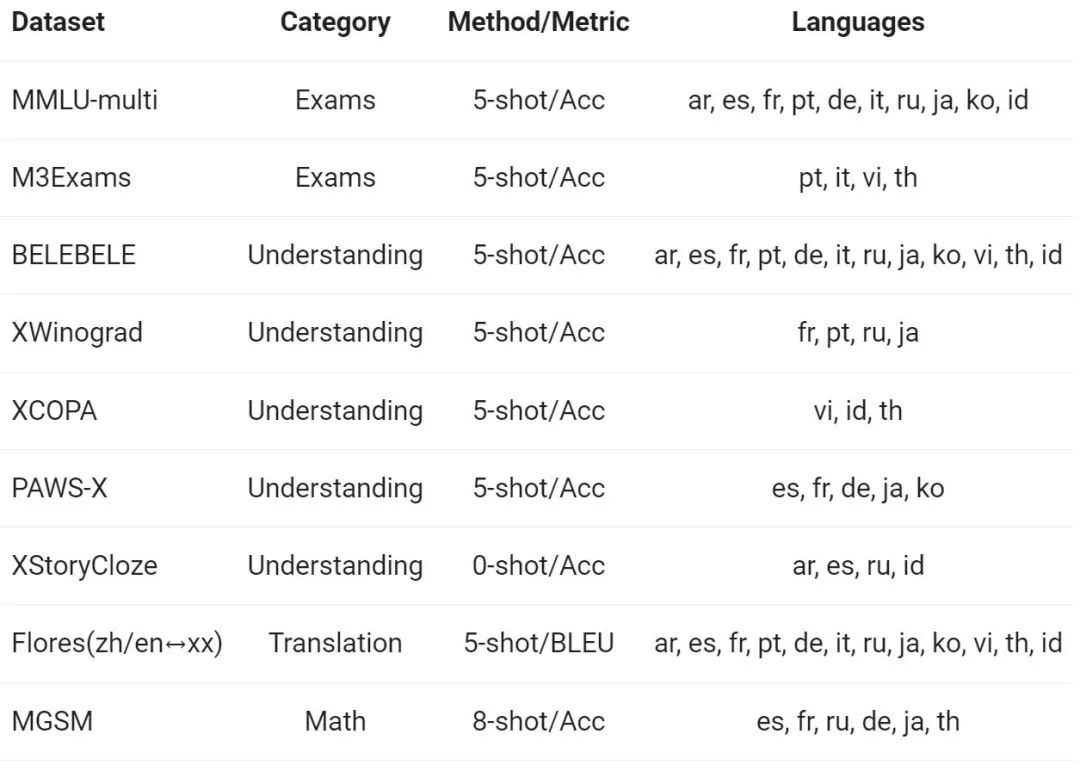

Tongyi Qianwen チームは、ヨーロッパ、東アジア、東南アジアの 12 の異なる言語で基本モデルを評価しました。アジアの多言語対応。アリババの研究者は、オープンソース コミュニティの公開データ セットから、試験、理解、翻訳、数学の 4 つの異なる側面をカバーする、次の表に示す評価セットを構築しました。以下の表は、評価構成、評価指標、関連する特定の言語など、各テスト セットの詳細を示しています。

詳細な結果は次のとおりです:

上記の結果は、Qwen1.5 基本モデルが 12 の異なる言語の多言語機能で良好なパフォーマンスを示し、主題の知識、言語理解、翻訳、数学などのさまざまな側面の評価でも優れたパフォーマンスを示していることを示しています。結果。さらに、チャット モデルの多言語機能に関しては、次の結果が観察されます。

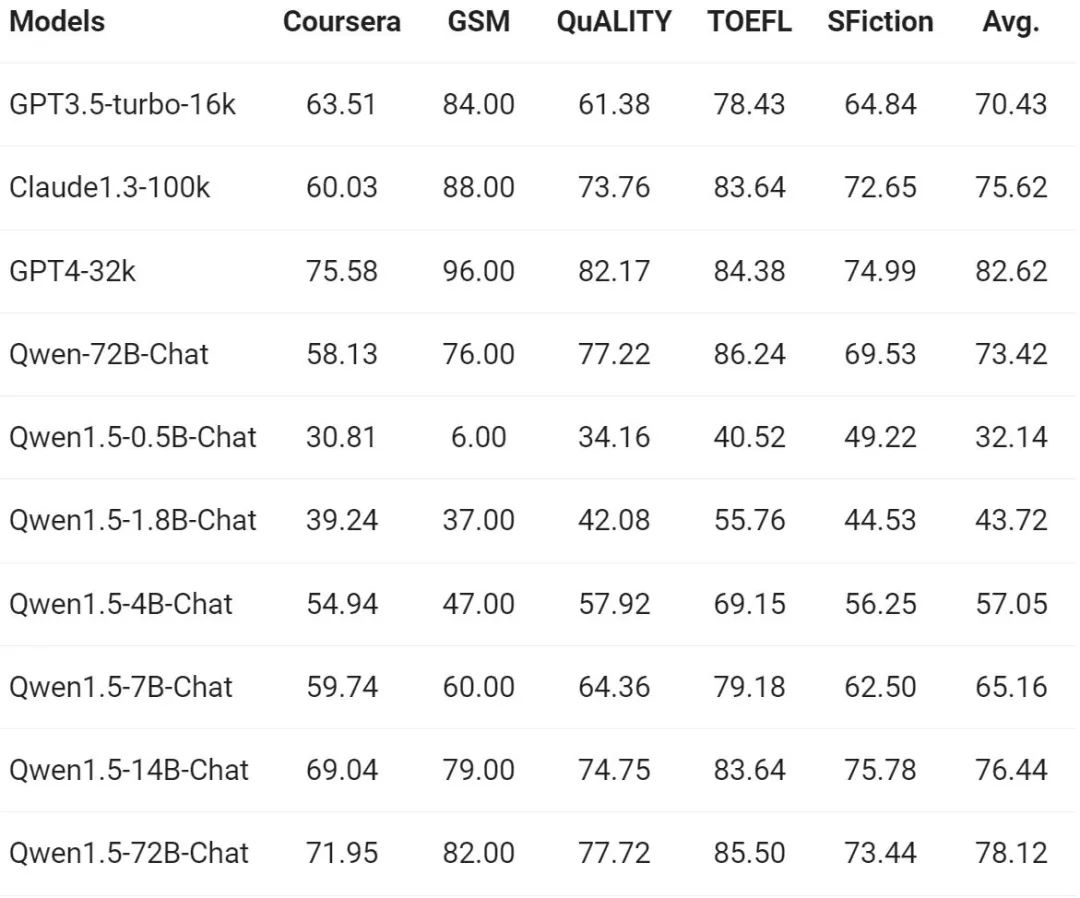

#長いシーケンス

長いシーケンスの理解に対する需要が高まり続ける中、アリババは新しいバージョンで Qianwen モデルの対応する機能を改善しました Qwen1.5 モデルの全シリーズは 32,000 トークンのコンテキストをサポートしています。 Tongyi Qianwen チームは、長いコンテキストに基づいて応答を生成するモデルの能力を測定する L-Eval ベンチマークで Qwen1.5 モデルのパフォーマンスを評価しました。結果は以下の通りです。

#結果から、Qwen1.5-7B-Chat のような小規模なモデルでも同等のパフォーマンスを示すことができます。 GPT -3.5 と同等のパフォーマンスですが、最大のモデルである Qwen1.5-72B-Chat は GPT4-32k にわずかに劣ります。

上記の結果は、トークンの長さが 32K の場合の Qwen 1.5 の効果のみを示しており、モデルが最大長の 32K しかサポートできないという意味ではないことに注意してください。 。開発者は、config.json の max_position_embedding をより大きな値に変更して、より長いコンテキスト理解シナリオでモデルが満足のいく結果を達成できるかどうかを観察できます。

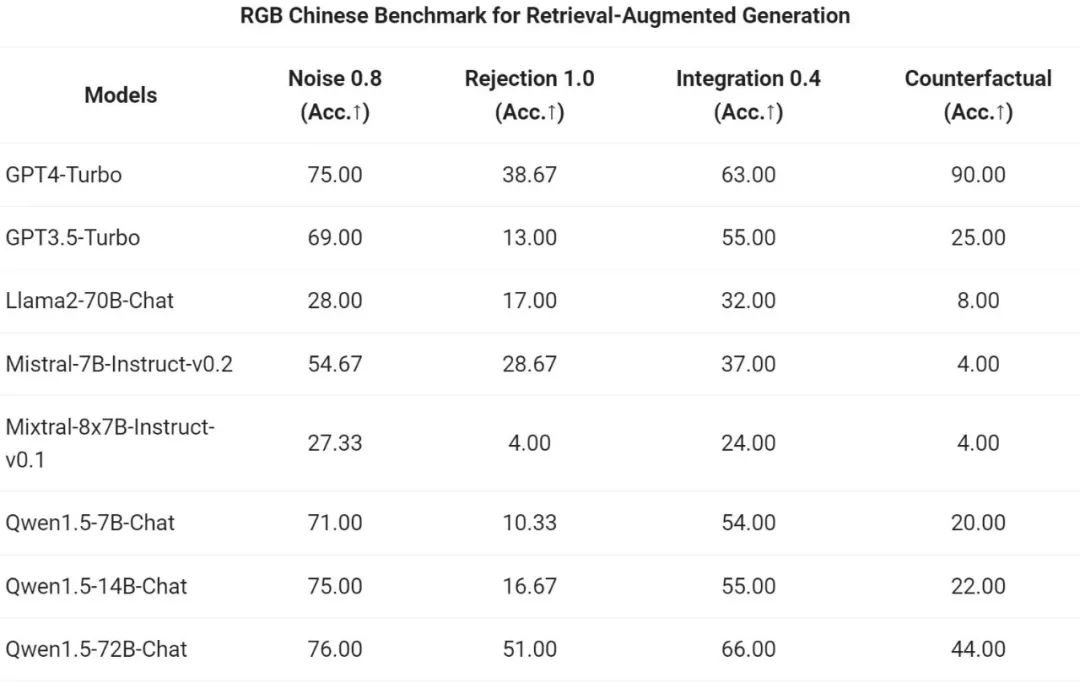

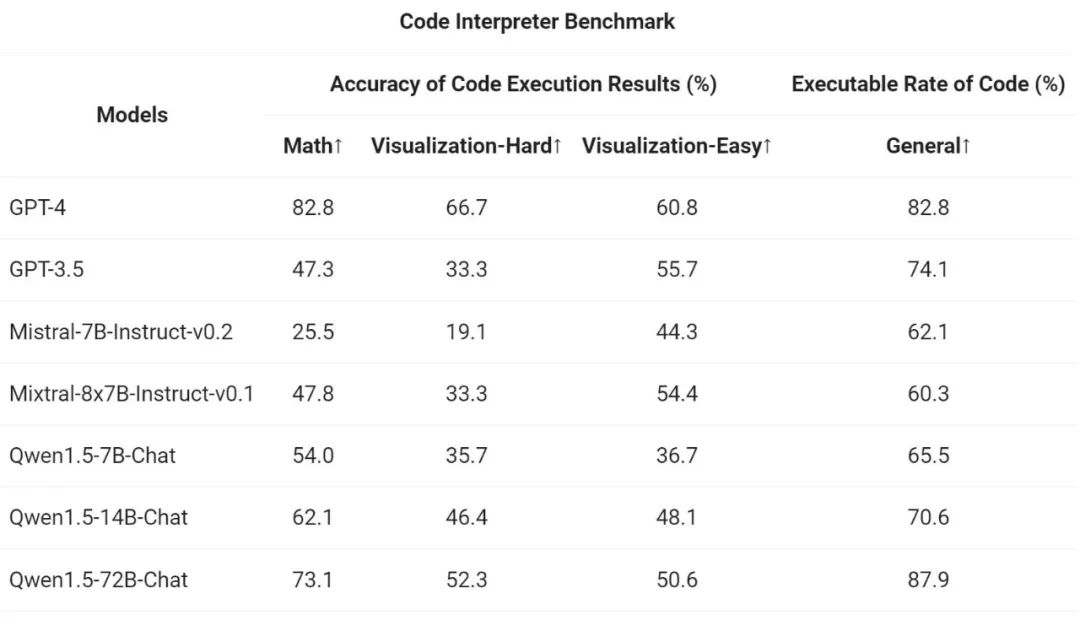

外部システムのリンク

現在、一般言語モデルの魅力の 1 つは、外部システムとインターフェイスできる潜在的な機能にあります。コミュニティで急速に浮上しているタスクとして、RAG は、幻覚やリアルタイムの更新情報やプライベート データの取得不能など、大規模な言語モデルが直面する典型的な課題のいくつかに効果的に対処します。さらに、言語モデルは、API を使用し、指示と例に基づいてコードを作成する際の強力な機能を示します。大規模なモデルは、コード インタープリターを使用したり、AI エージェントとして機能したりして、より広範な価値を実現できます。

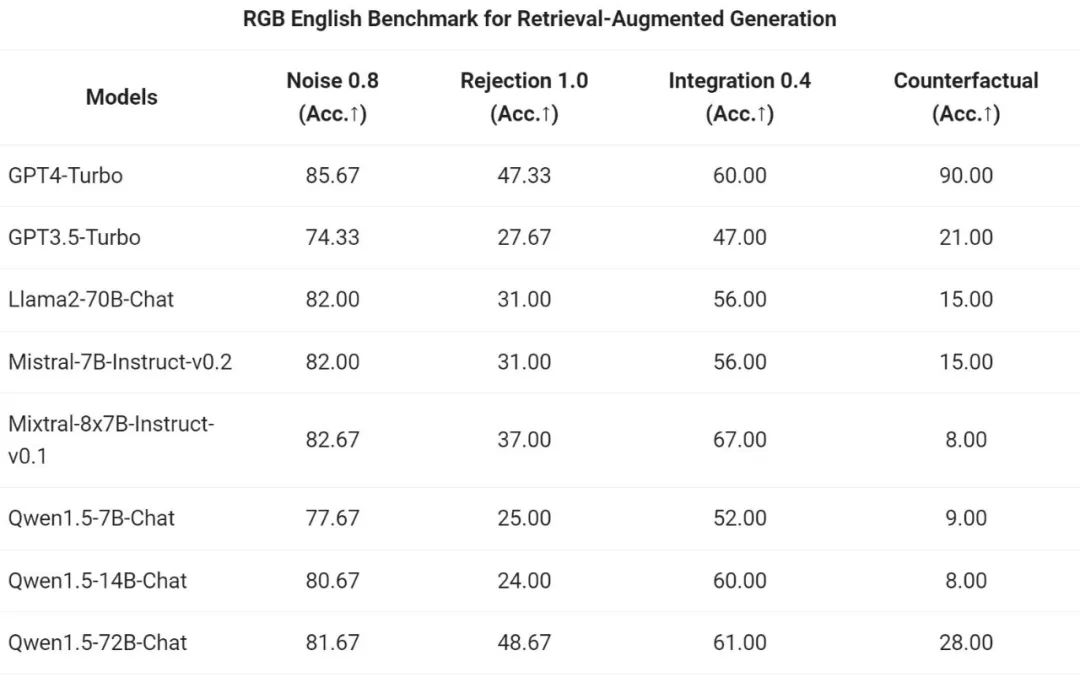

Tongyi Qianwen チームは、RAG タスクに対する Qwen1.5 シリーズ チャット モデルのエンドツーエンドの効果を評価しました。評価は、中国語と英語の RAG 評価に使用されるセットである RGB テスト セットに基づいています。

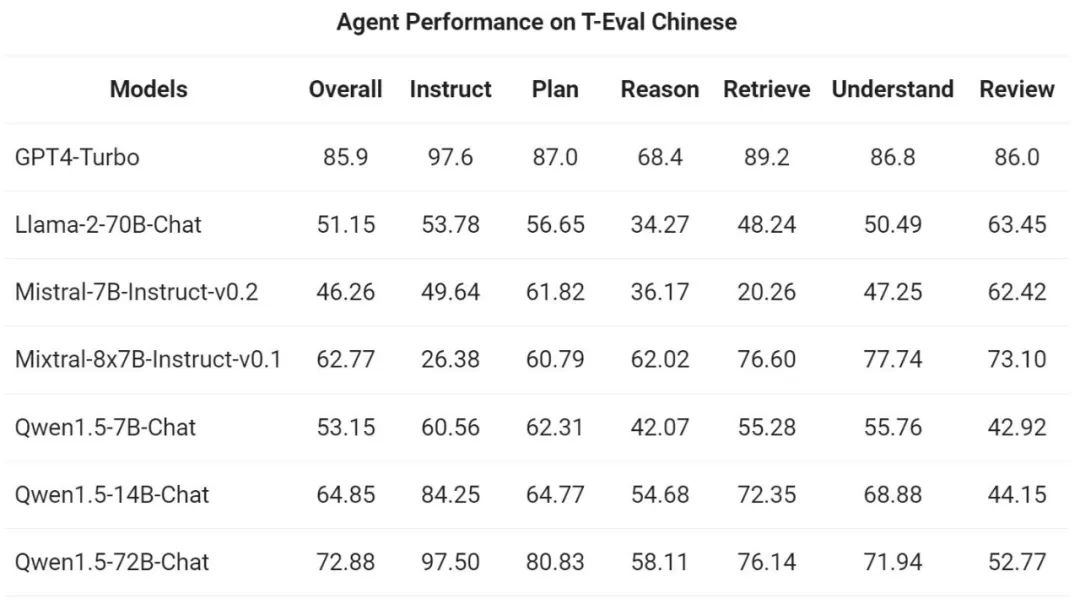

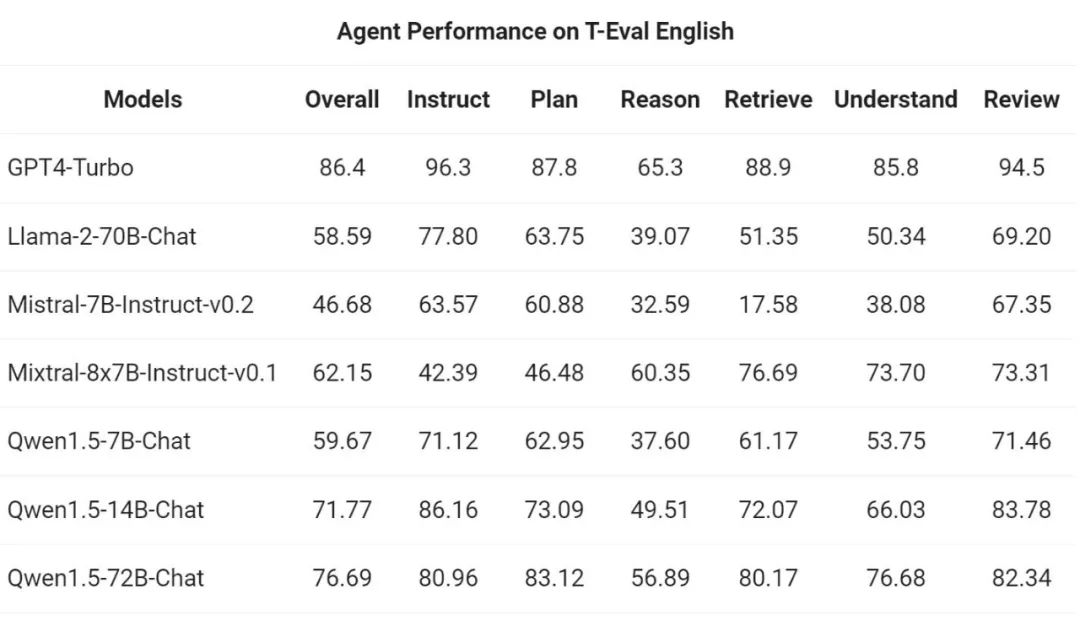

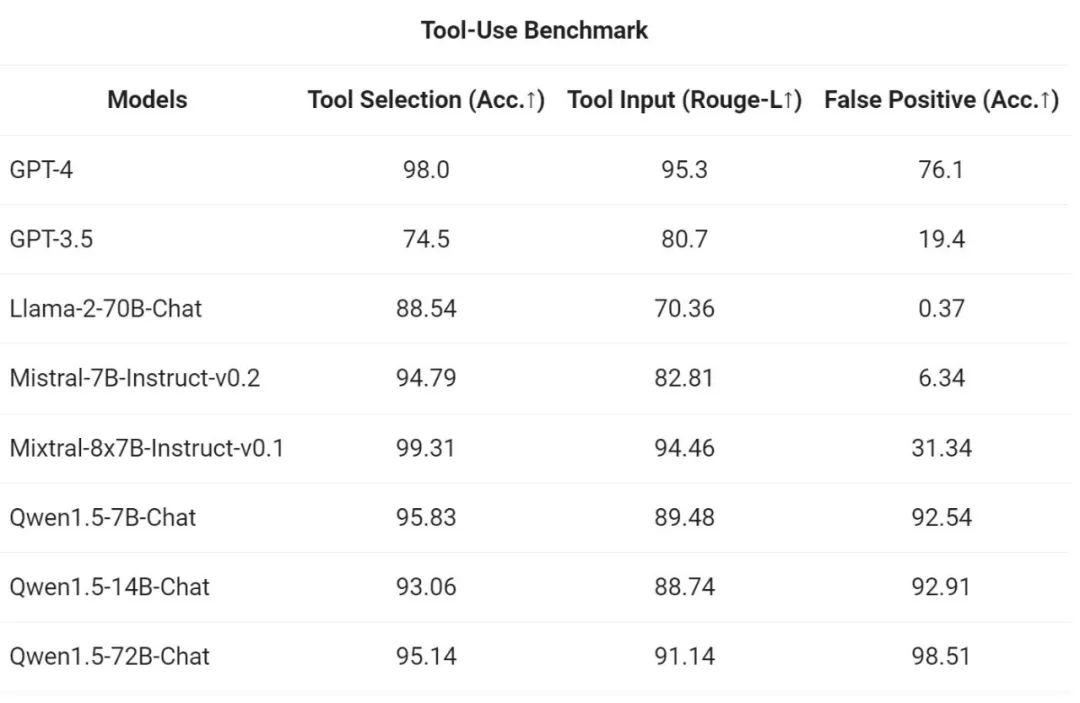

次に、パスします。 Yiqianwen チームは、T-Eval ベンチマークで汎用エージェントとして実行する Qwen1.5 の能力を評価しました。すべての Qwen1.5 モデルは、ベンチマーク専用に最適化されていません:

Qwen1.5 は、HuggingFace トランスフォーマー コード ベースと統合されています。バージョン 4.37.0 以降、開発者は Qwen1.5 を使用するためにカスタム コードをロードせずに (trust_remote_code オプションを指定して) トランスフォーマー ライブラリのネイティブ コードを直接使用できるようになりました。

オープンソース エコシステムにおいて、Alibaba は vLLM、SGLang (展開用)、AutoAWQ、AutoGPTQ (定量化用)、Axolotl、LLaMA-Factory (微調整用)、および llama.cpp (ローカル用) と協力してきました。 LLM 推論) などのフレームワークが含まれており、そのすべてが Qwen1.5 をサポートするようになりました。 Qwen1.5 シリーズは現在、Ollama や LMStudio などのプラットフォームでも利用できます。

以上がTongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7503

7503

15

15

1377

1377

52

52

78

78

11

11

19

19

54

54

Debian Apacheログ形式の構成方法

Apr 12, 2025 pm 11:30 PM

Debian Apacheログ形式の構成方法

Apr 12, 2025 pm 11:30 PM

この記事では、Debian SystemsでApacheのログ形式をカスタマイズする方法について説明します。次の手順では、構成プロセスをガイドします。ステップ1:Apache構成ファイルにアクセスするDebianシステムのメインApache構成ファイルは、/etc/apache2/apache2.confまたは/etc/apache2/httpd.confにあります。次のコマンドを使用してルートアクセス許可を使用して構成ファイルを開きます。sudonano/etc/apache2/apache2.confまたはsudonano/etc/apache2/httpd.confステップ2:検索または検索または

Tomcatログがメモリの漏れのトラブルシューティングに役立つ方法

Apr 12, 2025 pm 11:42 PM

Tomcatログがメモリの漏れのトラブルシューティングに役立つ方法

Apr 12, 2025 pm 11:42 PM

Tomcatログは、メモリリークの問題を診断するための鍵です。 Tomcatログを分析することにより、メモリの使用状況とガベージコレクション(GC)の動作に関する洞察を得ることができ、メモリリークを効果的に見つけて解決できます。 Tomcatログを使用してメモリリークをトラブルシューティングする方法は次のとおりです。1。GCログ分析最初に、詳細なGCロギングを有効にします。 Tomcatの起動パラメーターに次のJVMオプションを追加します:-xx:printgcdetails-xx:printgcdateStamps-xloggc:gc.logこれらのパラメーターは、GCタイプ、リサイクルオブジェクトサイズ、時間などの情報を含む詳細なGCログ(GC.log)を生成します。分析GC.LOG

Debian Readdirによるファイルソートを実装する方法

Apr 13, 2025 am 09:06 AM

Debian Readdirによるファイルソートを実装する方法

Apr 13, 2025 am 09:06 AM

Debian Systemsでは、Readdir関数はディレクトリコンテンツを読み取るために使用されますが、それが戻る順序は事前に定義されていません。ディレクトリ内のファイルを並べ替えるには、最初にすべてのファイルを読み取り、QSORT関数を使用してソートする必要があります。次のコードは、debianシステムにreaddirとqsortを使用してディレクトリファイルを並べ替える方法を示しています。

Debian Readdirのパフォーマンスを最適化する方法

Apr 13, 2025 am 08:48 AM

Debian Readdirのパフォーマンスを最適化する方法

Apr 13, 2025 am 08:48 AM

Debian Systemsでは、Directoryコンテンツを読み取るためにReadDirシステム呼び出しが使用されます。パフォーマンスが良くない場合は、次の最適化戦略を試してください。ディレクトリファイルの数を簡素化します。大きなディレクトリをできる限り複数の小さなディレクトリに分割し、Readdirコールごとに処理されたアイテムの数を減らします。ディレクトリコンテンツのキャッシュを有効にする:キャッシュメカニズムを構築し、定期的にキャッシュを更新するか、ディレクトリコンテンツが変更されたときに、頻繁な呼び出しをreaddirに削減します。メモリキャッシュ(memcachedやredisなど)またはローカルキャッシュ(ファイルやデータベースなど)を考慮することができます。効率的なデータ構造を採用する:ディレクトリトラバーサルを自分で実装する場合、より効率的なデータ構造(線形検索の代わりにハッシュテーブルなど)を選択してディレクトリ情報を保存およびアクセスする

Debian syslogを学ぶ方法

Apr 13, 2025 am 11:51 AM

Debian syslogを学ぶ方法

Apr 13, 2025 am 11:51 AM

このガイドでは、Debian SystemsでSyslogの使用方法を学ぶように導きます。 Syslogは、ロギングシステムとアプリケーションログメッセージのLinuxシステムの重要なサービスです。管理者がシステムアクティビティを監視および分析して、問題を迅速に特定および解決するのに役立ちます。 1. syslogの基本的な知識Syslogのコア関数には以下が含まれます。複数のログ出力形式とターゲットの場所(ファイルやネットワークなど)をサポートします。リアルタイムのログ表示およびフィルタリング機能を提供します。 2。syslog(rsyslogを使用)をインストールして構成するDebianシステムは、デフォルトでrsyslogを使用します。次のコマンドでインストールできます:sudoaptupdatesud

Debian Syslogのファイアウォールルールを構成する方法

Apr 13, 2025 am 06:51 AM

Debian Syslogのファイアウォールルールを構成する方法

Apr 13, 2025 am 06:51 AM

この記事では、Debian SystemsでiPtablesまたはUFWを使用してファイアウォールルールを構成し、Syslogを使用してファイアウォールアクティビティを記録する方法について説明します。方法1:Iptablesiptablesの使用は、Debian Systemの強力なコマンドラインファイアウォールツールです。既存のルールを表示する:次のコマンドを使用して現在のiPtablesルールを表示します。Sudoiptables-L-N-vでは特定のIPアクセスを許可します。たとえば、IPアドレス192.168.1.100がポート80にアクセスできるようにします:sudoiptables-input-ptcp - dport80-s192.166

Debian Mail Server SSL証明書のインストール方法

Apr 13, 2025 am 11:39 AM

Debian Mail Server SSL証明書のインストール方法

Apr 13, 2025 am 11:39 AM

Debian Mail ServerにSSL証明書をインストールする手順は次のとおりです。1。最初にOpenSSL Toolkitをインストールすると、OpenSSLツールキットがシステムに既にインストールされていることを確認してください。インストールされていない場合は、次のコマンドを使用してインストールできます。sudoapt-getUpdatesudoapt-getInstalopenssl2。秘密キーと証明書のリクエストを生成次に、OpenSSLを使用して2048ビットRSA秘密キーと証明書リクエスト(CSR)を生成します:Openss

Debian Nginxログパスはどこですか

Apr 12, 2025 pm 11:33 PM

Debian Nginxログパスはどこですか

Apr 12, 2025 pm 11:33 PM

Debianシステムでは、nginxのアクセスログとエラーログのデフォルトのストレージ場所は次のとおりです。アクセスログ(アクセスログ):/var/log/nginx/access.logエラーログ(errorlog):/var/log/nginx/error.log上記のパスは、標準のdebiannginxインストールのデフォルト構成です。インストールプロセス中にログファイルストレージの場所を変更した場合は、nginx構成ファイル(通常は/etc/nginx/nginx.confまたは/etc/etc/nginx/sites-abailable/directoryにあります)を確認してください。構成ファイル