音声生成の「スマートな出現」: 100,000 時間のデータトレーニング、Amazon が 10 億のパラメータを提供 BASE TTS

生成深層学習モデルの急速な発展により、自然言語処理 (NLP) とコンピューター ビジョン (CV) は大きな変化を遂げました。専門的なトレーニングが必要だった以前の教師ありモデルから、さまざまなタスクを完了するために単純かつ明確な指示のみを必要とする一般的なモデルへ。この変革により、より効率的で柔軟なソリューションが提供されます。

音声処理と音声合成 (TTS) の世界では、変革が起きています。このモデルは、何千時間ものデータを活用することで、合成を実際の人間の音声にますます近づけます。

最近の調査で、Amazon は BASE TTS を正式に開始し、TTS モデルのパラメーター スケールを 10 億という前例のないレベルに増加しました。

- #論文のタイトル: BASE TTS: 10 万時間のデータに基づく 10 億パラメータの音声合成モデルの構築から得た教訓

- 論文リンク: https://arxiv.org/pdf/2402.08093.pdf

ベース TTS モデル

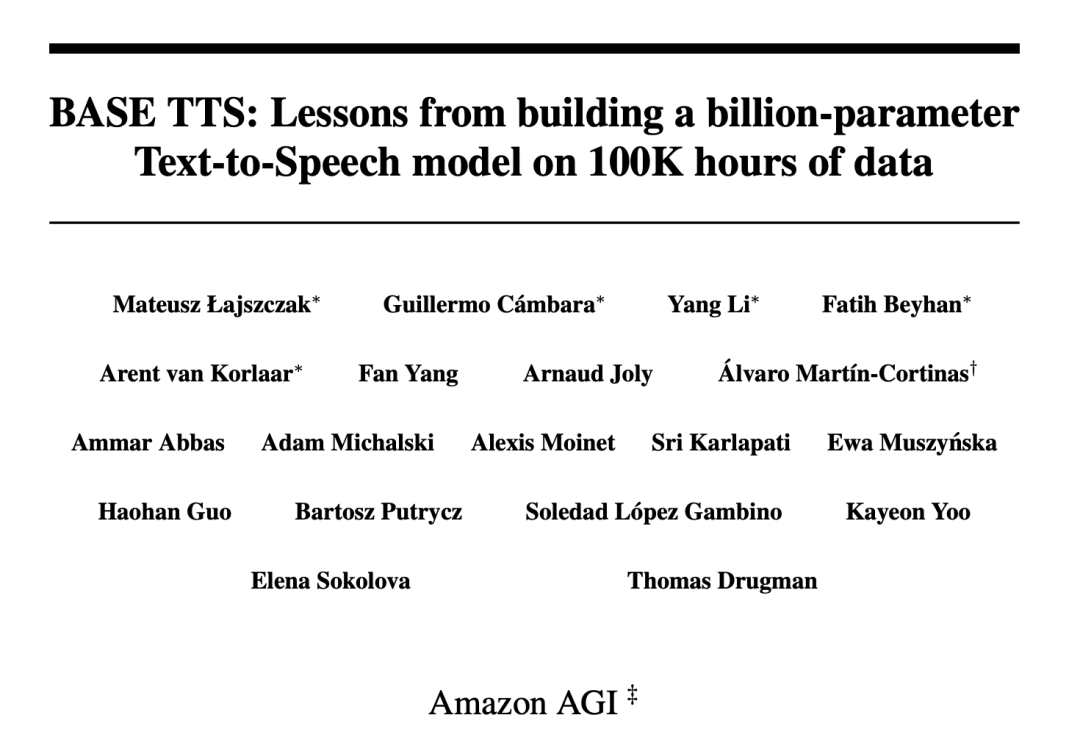

最近の音声モデリング作業と同様に、研究者は LLM ベースのアプローチを採用して TTS タスクを処理しています。テキストは、離散音声表現 (音声コードと呼ばれる) を予測する Transformer ベースの自己回帰モデルに入力され、線形層と畳み込み層で構成される個別にトレーニングされたデコーダーによって波形にデコードされます。

離散言語表現

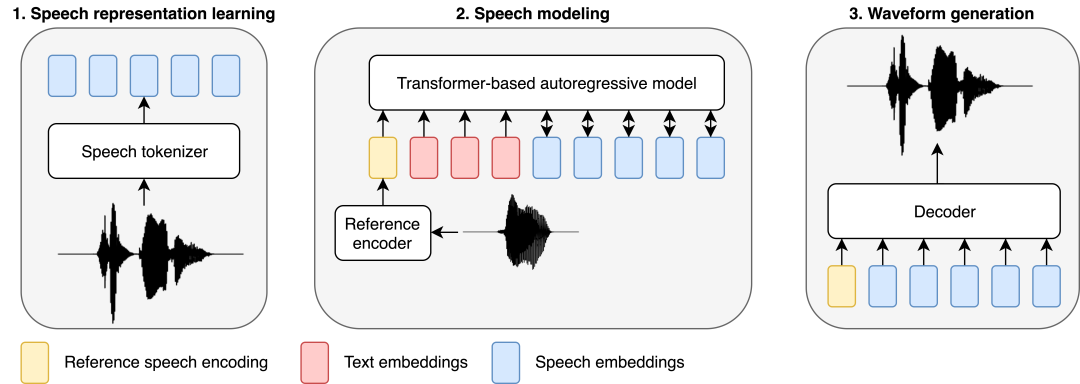

離散表現は LLM の成功の基礎ですが、音声におけるコンパクトで有益な表現を識別することはテキストほど明白ではありません。探索も減ります。 BASE TTS の場合、研究者は最初に VQ-VAE ベースライン (セクション 2.2.1) の使用を試みました。これは、個別のボトルネックを通じてメル スペクトログラムを再構築するオートエンコーダー アーキテクチャに基づいています。 VQ-VAE は、特に TTS のモデリング ユニットとして、音声および画像表現のパラダイムとして成功しました。 研究者らは、WavLM ベースの音声コーディングを通じて音声表現を学習する新しい方法も導入しました (セクション 2.2.2)。このアプローチでは、研究者は WavLM SSL モデルから抽出された特徴を離散化し、メル スペクトログラムを再構築します。研究者らは、話者の分離を容易にするために追加の損失関数を適用し、バイトペア エンコーディング (BPE) を使用して生成された音声コードを圧縮してシーケンスの長さを短縮し、より長いオーディオ モデリングにトランスフォーマーを使用できるようにしました。

與流行的音訊編解碼器相比,這兩種表示法都經過了壓縮(分別為 325 bits/s 和 400 bits/s),以實現更有效率的自回歸建模。基於此壓縮水平,接下來的目標是移除語音編碼中可在解碼過程中重建的訊息(說話者、音訊噪音等),以確保語音編碼的容量主要用於編碼語音和韻律訊息。

自回歸語音建模(SpeechGPT)

研究者訓練了一個GPT-2 架構的自回歸模型“SpeechGPT”,用於預測以文本和參考語音為條件的語音編碼。參考語音條件包括從同一說話者隨機選擇的語句,該語句被編碼為固定大小的嵌入。參考語音嵌入、文字和語音編碼被串聯成一個序列,該序列由基於 Transformer 的自回歸模型建模。研究者對文字和語音使用單獨的位置嵌入和單獨的預測頭。他們從頭開始訓練了自回歸模型,而不對文本進行預訓練。為了保留文字訊息以指導擬聲,也對 SpeechGPT 進行了訓練,目的是預測輸入序列文字部分的下一個 token,因此 SpeechGPT 部分是純文字 LM。與語音損失相比,此處對文字損失採用了較低的權重。

波形產生

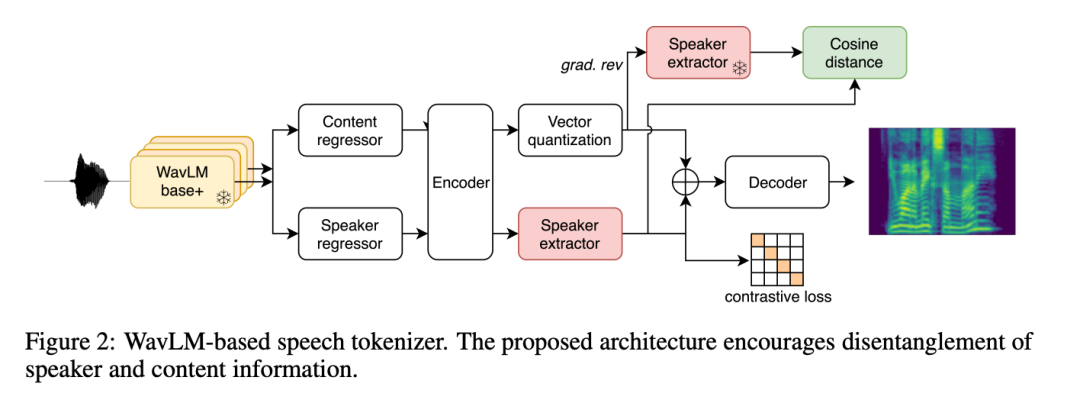

此外,研究者指定了一個單獨的語音編碼到波形解碼器(稱為「語音編碼解碼器」),負責重建說話者身份和錄音條件。為了使模型更具可擴展性,他們用卷積層取代了 LSTM 層,對中間表示進行解碼。研究表明,這種基於卷積的語音編碼解碼器計算效率高,與基於擴散的基線解碼器相比,整個系統的合成時間減少了 70% 以上。

研究者同時指出,實際上語音編碼解碼器的輸入並不是語音編碼,而是自回歸 Transformer 的最後一個隱藏狀態。之所以這樣做,是因為先前 TortoiseTTS 方法中密集的潛在表徵提供了比單一語音代碼更豐富的資訊。在訓練過程中,研究者將文字和目標程式碼輸入訓練好的 SpeechGPT(參數凍結),然後根據最後的隱藏狀態對解碼器進行調整。輸入 SpeechGPT 的最後隱藏狀態有助於提高語音的分段和聲學質量,但也會將解碼器與特定版本的 SpeechGPT 聯繫起來。這使得實驗變得複雜,因為它迫使兩個組件總是按順序建構。這項限制需要在今後的工作中加以解決。

實驗評估

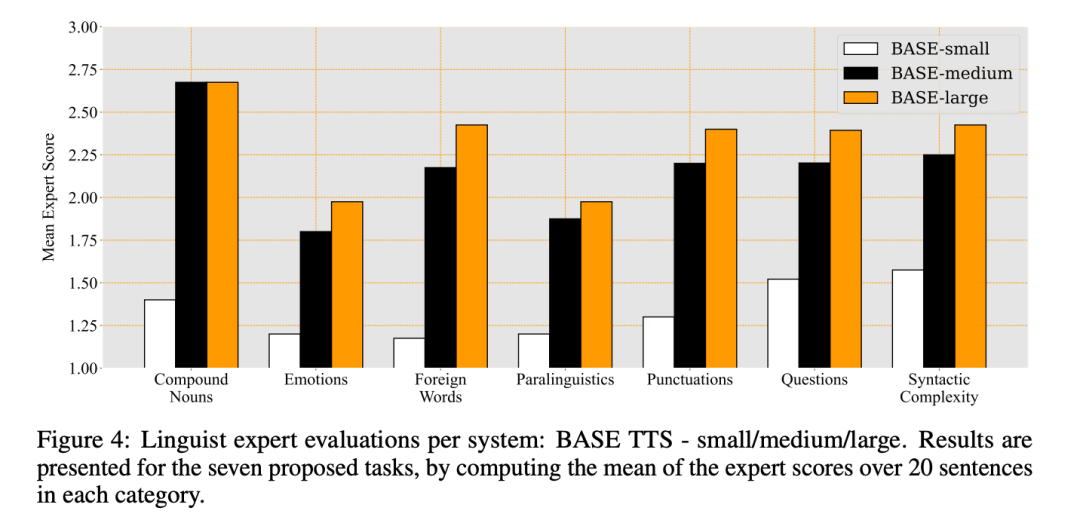

研究者探索了縮放如何影響模型針對具有挑戰性的文本輸入產生適當的韻律和表達的能力,這與LLM 透過數據和參數縮放「湧現」新能力的方式類似。為了驗證這個假設是否同樣適用於LTTS,研究者提出了一個評估方案來評估TTS 中潛在的湧現能力,確定了七個具有挑戰性的類別:複合名詞、情感、外來語、副語言、標點符號、問題和句法複雜性。

多項實驗驗證了BASE TTS 的結構及其品質、功能和計算性能:

首先,研究者比較了基於自動編碼器和基於WavLM 的語音編碼所達到的模型品質。

然後,研究者評估了對語音編碼進行聲學解碼的兩種方法:基於擴散的解碼器和語音編碼解碼器。

在完成這些結構消融後,研究者評估了 BASE TTS 在資料集大小和模型參數的 3 種變體中的湧現能力,並由語言專家進行了評估。

此外,研究者還進行了主觀的MUSHRA 測試以衡量自然度,以及自動可懂度和說話人相似度測量,還報告了與其他開源文本到語音模型的語音品質比較。

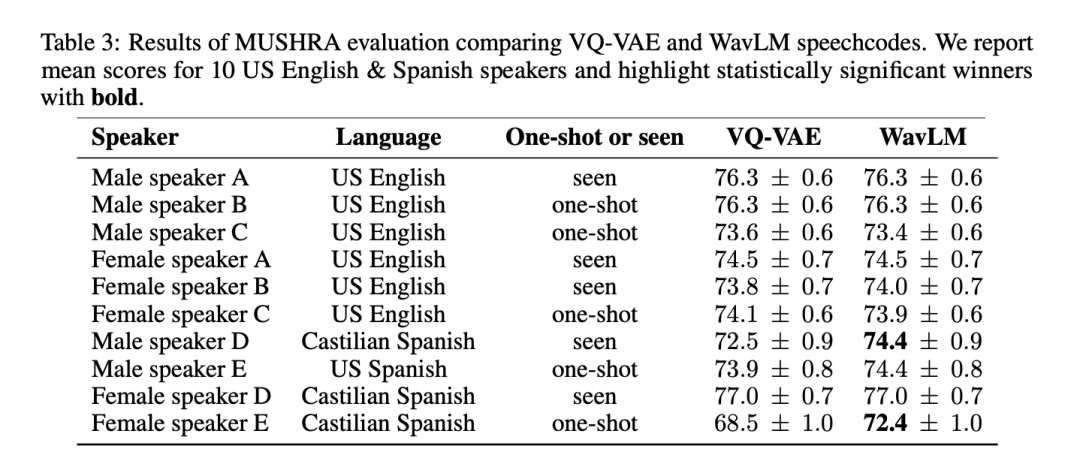

VQ-VAE 語音編碼vs. WavLM 語音編碼

為了全面測試兩種語音token 化方法的品質和通用性,研究者對6 位美式英語和4 位西班牙語說話者進行了MUSHRA 評估。就英語的平均 MUSHRA 分數而言,基於 VQ-VAE 和 WavLM 的系統不相上下(VQ-VAE:74.8 vs WavLM:74.7)。然而,對於西班牙語,基於 WavLM 的模型在統計上顯著優於 VQ-VAE 模型(VQ-VAE:73.3 vs WavLM:74.7)。請注意,英語資料約佔資料集的 90%,而西班牙語資料僅佔 2%。

表3 顯示了按說話者分類的結果:

#由於基於WavLM 的系統表現至少與VQ-VAE 基準相當或更好,因此研究者在進一步的實驗中使用它來表示BASE TTS。

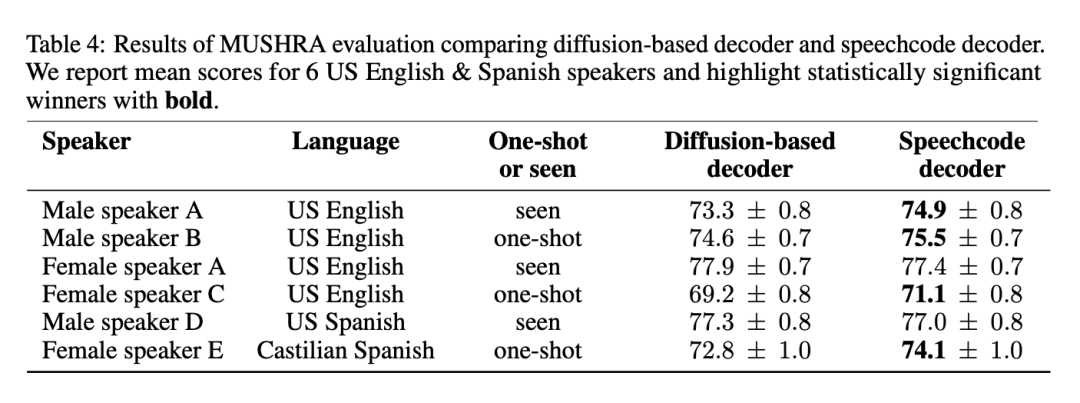

基於擴散的解碼器 vs. 語音代碼解碼器

如上文所述,BASE TTS 透過提出端對端語音編碼解碼器,簡化了基於擴散的基線解碼器。此方法具有流暢性,推理速度提高了 3 倍。為了確保這種方法不會降低質量,研究者對所提出的語音編碼解碼器與基準進行了評估。表4 列出了對4 位說英語的美國人和2 位說西班牙語的人進行的MUSHRA 評估結果:

結果顯示,語音編碼解碼器是首選方法,因為它不會降低質量,而且對大多數語音而言,它能提高質量,同時提供更快的推理。研究者同時表示,結合兩個強大的生成模型進行語音建模是多餘的,可以透過放棄擴散解碼器來簡化。

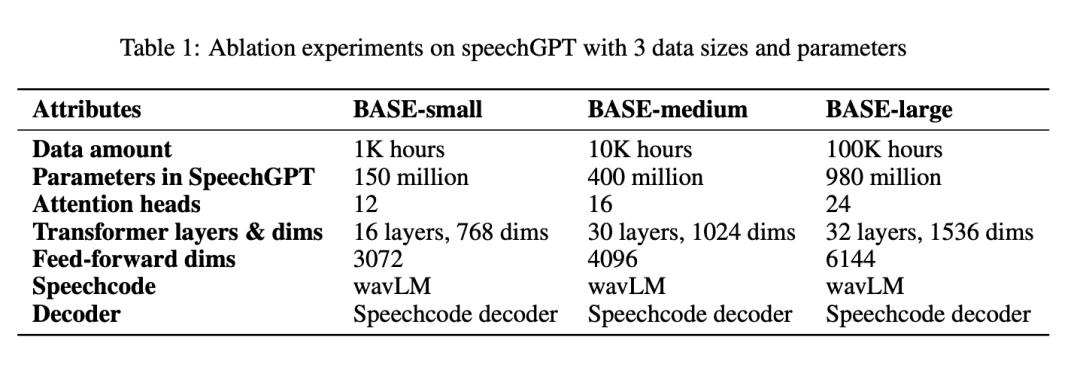

湧現能力:資料和模型規模的消融

表1 按BASE-small、BASE-medium 和BASE-large 系統報告了所有參數:

三個系統的語言專家判斷結果以及每個類別的平均分數如圖4 所示:

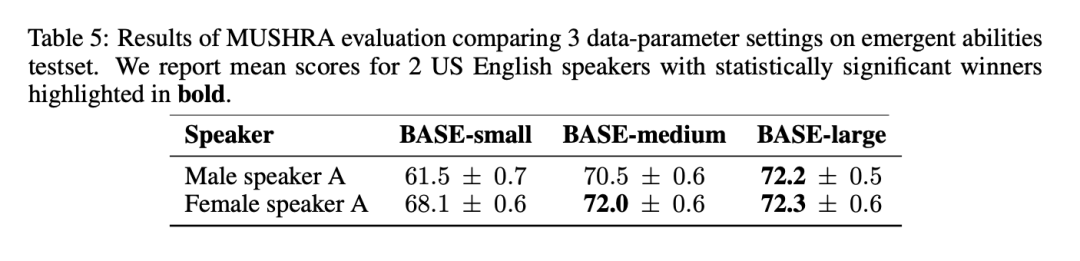

在表5 的MUSHRA 結果中,可以注意到語音自然度從BASE-small 到BASE-medium 有明顯改善,但從BASE-medium 到BASE-large 的改善幅度較小:

BASE TTS vs. 產業baseline

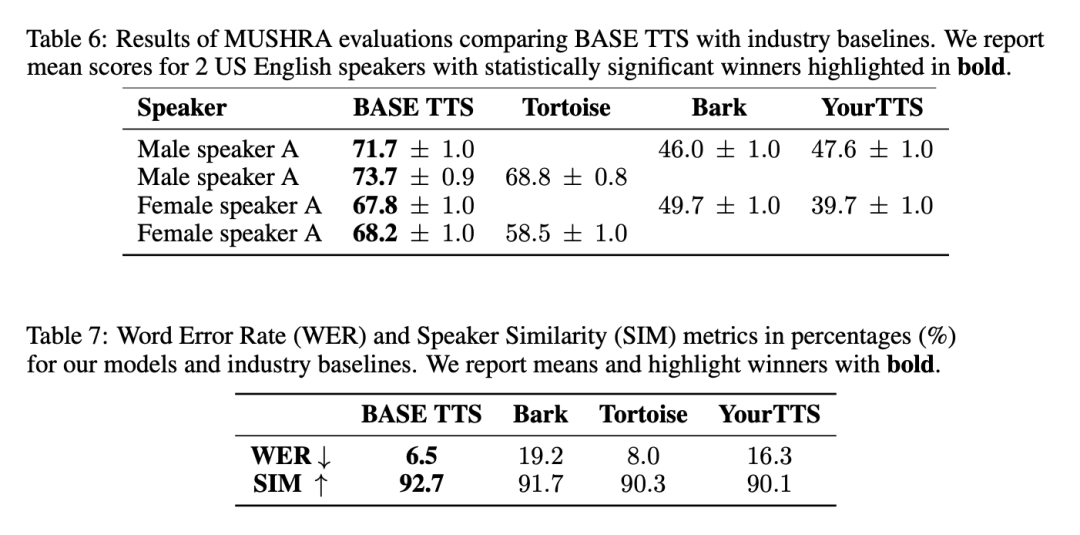

整體來說,BASE TTS 產生的語音最自然,與輸入文字的錯位最少,與參考說話者的語音最相似,相關結果如表6 及表7 所示:

語音編碼解碼器帶來的合成效率提升

語音編碼解碼器能夠進行串流處理,即以增量方式產生語音。將這項功能與自回歸 SpeechGPT 結合,該系統的首字節延遲可低至 100 毫秒 —— 只需幾個解碼語音代碼就足以產生可懂的語音。

這種最低延遲與基於擴散的解碼器形成了鮮明對比,後者需要一次性生成整個語音序列(一個或多個句子),而首字節延遲等於總生成時間。

此外,研究者還觀察到,與擴散基線相比,語音編碼解碼器使整個系統的計算效率提高了 3 倍。他們執行了一個基準測試,在 NVIDIA® V100 GPU 上產生 1000 個持續時間約 20 秒的語句,批次大小為 1。平均而言,使用擴散解碼器的十億參數 SpeechGPT 需要 69.1 秒才能完成合成,而使用語音編碼解碼器的相同 SpeechGPT 只需要 17.8 秒。

更多研究細節,可參考原論文。

以上が音声生成の「スマートな出現」: 100,000 時間のデータトレーニング、Amazon が 10 億のパラメータを提供 BASE TTSの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7447

7447

15

15

1374

1374

52

52

76

76

11

11

14

14

6

6

DeepMind ロボットが卓球をすると、フォアハンドとバックハンドが空中に滑り出し、人間の初心者を完全に打ち負かしました

Aug 09, 2024 pm 04:01 PM

DeepMind ロボットが卓球をすると、フォアハンドとバックハンドが空中に滑り出し、人間の初心者を完全に打ち負かしました

Aug 09, 2024 pm 04:01 PM

でももしかしたら公園の老人には勝てないかもしれない?パリオリンピックの真っ最中で、卓球が注目を集めています。同時に、ロボットは卓球のプレーにも新たな進歩をもたらしました。先ほど、DeepMind は、卓球競技において人間のアマチュア選手のレベルに到達できる初の学習ロボット エージェントを提案しました。論文のアドレス: https://arxiv.org/pdf/2408.03906 DeepMind ロボットは卓球でどれくらい優れていますか?おそらく人間のアマチュアプレーヤーと同等です: フォアハンドとバックハンドの両方: 相手はさまざまなプレースタイルを使用しますが、ロボットもそれに耐えることができます: さまざまなスピンでサーブを受ける: ただし、ゲームの激しさはそれほど激しくないようです公園の老人。ロボット、卓球用

初のメカニカルクロー!元羅宝は2024年の世界ロボット会議に登場し、家庭に入ることができる初のチェスロボットを発表した

Aug 21, 2024 pm 07:33 PM

初のメカニカルクロー!元羅宝は2024年の世界ロボット会議に登場し、家庭に入ることができる初のチェスロボットを発表した

Aug 21, 2024 pm 07:33 PM

8月21日、2024年世界ロボット会議が北京で盛大に開催された。 SenseTimeのホームロボットブランド「Yuanluobot SenseRobot」は、全製品ファミリーを発表し、最近、世界初の家庭用チェスロボットとなるYuanluobot AIチェスプレイロボット - Chess Professional Edition(以下、「Yuanluobot SenseRobot」という)をリリースした。家。 Yuanluobo の 3 番目のチェス対局ロボット製品である新しい Guxiang ロボットは、AI およびエンジニアリング機械において多くの特別な技術アップグレードと革新を経て、初めて 3 次元のチェスの駒を拾う機能を実現しました。家庭用ロボットの機械的な爪を通して、チェスの対局、全員でのチェスの対局、記譜のレビューなどの人間と機械の機能を実行します。

クロードも怠け者になってしまった!ネチズン: 自分に休日を与える方法を学びましょう

Sep 02, 2024 pm 01:56 PM

クロードも怠け者になってしまった!ネチズン: 自分に休日を与える方法を学びましょう

Sep 02, 2024 pm 01:56 PM

もうすぐ学校が始まり、新学期を迎える生徒だけでなく、大型AIモデルも気を付けなければなりません。少し前、レディットはクロードが怠け者になったと不満を漏らすネチズンでいっぱいだった。 「レベルが大幅に低下し、頻繁に停止し、出力も非常に短くなりました。リリースの最初の週は、4 ページの文書全体を一度に翻訳できましたが、今では 0.5 ページの出力さえできません」 !」 https://www.reddit.com/r/ClaudeAI/comments/1by8rw8/something_just_feels_wrong_with_claude_in_the/ というタイトルの投稿で、「クロードには完全に失望しました」という内容でいっぱいだった。

世界ロボット会議で「未来の高齢者介護の希望」を担う家庭用ロボットを囲みました

Aug 22, 2024 pm 10:35 PM

世界ロボット会議で「未来の高齢者介護の希望」を担う家庭用ロボットを囲みました

Aug 22, 2024 pm 10:35 PM

北京で開催中の世界ロボット会議では、人型ロボットの展示が絶対的な注目となっているスターダストインテリジェントのブースでは、AIロボットアシスタントS1がダルシマー、武道、書道の3大パフォーマンスを披露した。文武両道を備えた 1 つの展示エリアには、多くの専門的な聴衆とメディアが集まりました。弾性ストリングのエレガントな演奏により、S1 は、スピード、強さ、正確さを備えた繊細な操作と絶対的なコントロールを発揮します。 CCTVニュースは、「書道」の背後にある模倣学習とインテリジェント制御に関する特別レポートを実施し、同社の創設者ライ・ジエ氏は、滑らかな動きの背後にあるハードウェア側が最高の力制御と最も人間らしい身体指標(速度、負荷)を追求していると説明した。など)、AI側では人の実際の動きのデータが収集され、強い状況に遭遇したときにロボットがより強くなり、急速に進化することを学習することができます。そしてアジャイル

Li Feifei 氏のチームは、ロボットに空間知能を与え、GPT-4o を統合する ReKep を提案しました

Sep 03, 2024 pm 05:18 PM

Li Feifei 氏のチームは、ロボットに空間知能を与え、GPT-4o を統合する ReKep を提案しました

Sep 03, 2024 pm 05:18 PM

ビジョンとロボット学習の緊密な統合。最近話題の1X人型ロボットNEOと合わせて、2つのロボットハンドがスムーズに連携して服をたたむ、お茶を入れる、靴を詰めるといった動作をしていると、いよいよロボットの時代が到来するのではないかと感じられるかもしれません。実際、これらの滑らかな動きは、高度なロボット技術 + 精緻なフレーム設計 + マルチモーダル大型モデルの成果です。有用なロボットは多くの場合、環境との複雑かつ絶妙な相互作用を必要とし、環境は空間領域および時間領域の制約として表現できることがわかっています。たとえば、ロボットにお茶を注いでもらいたい場合、ロボットはまずティーポットのハンドルを掴んで、お茶をこぼさないように垂直に保ち、次にポットの口がカップの口と揃うまでスムーズに動かす必要があります。 、そしてティーポットを一定の角度に傾けます。これ

ACL 2024 賞の発表: HuaTech による Oracle 解読に関する最優秀論文の 1 つ、GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

ACL 2024 賞の発表: HuaTech による Oracle 解読に関する最優秀論文の 1 つ、GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

貢献者はこの ACL カンファレンスから多くのことを学びました。 6日間のACL2024がタイのバンコクで開催されています。 ACL は、計算言語学と自然言語処理の分野におけるトップの国際会議で、国際計算言語学協会が主催し、毎年開催されます。 ACL は NLP 分野における学術的影響力において常に第一位にランクされており、CCF-A 推奨会議でもあります。今年の ACL カンファレンスは 62 回目であり、NLP 分野における 400 以上の最先端の作品が寄せられました。昨日の午後、カンファレンスは最優秀論文およびその他の賞を発表しました。今回の優秀論文賞は7件(未発表2件)、最優秀テーマ論文賞1件、優秀論文賞35件です。このカンファレンスでは、3 つの Resource Paper Award (ResourceAward) と Social Impact Award (

宏蒙スマートトラベルS9とフルシナリオ新製品発売カンファレンス、多数の大ヒット新製品が一緒にリリースされました

Aug 08, 2024 am 07:02 AM

宏蒙スマートトラベルS9とフルシナリオ新製品発売カンファレンス、多数の大ヒット新製品が一緒にリリースされました

Aug 08, 2024 am 07:02 AM

今日の午後、Hongmeng Zhixingは新しいブランドと新車を正式に歓迎しました。 8月6日、ファーウェイはHongmeng Smart Xingxing S9およびファーウェイのフルシナリオ新製品発表カンファレンスを開催し、パノラマスマートフラッグシップセダンXiangjie S9、新しいM7ProおよびHuawei novaFlip、MatePad Pro 12.2インチ、新しいMatePad Air、Huawei Bisheng Withを発表しました。レーザー プリンタ X1 シリーズ、FreeBuds6i、WATCHFIT3、スマート スクリーン S5Pro など、スマート トラベル、スマート オフィスからスマート ウェアに至るまで、多くの新しいオールシナリオ スマート製品を開発し、ファーウェイは消費者にスマートな体験を提供するフル シナリオのスマート エコシステムを構築し続けています。すべてのインターネット。宏孟志興氏:スマートカー業界のアップグレードを促進するための徹底的な権限付与 ファーウェイは中国の自動車業界パートナーと提携して、

AI の使用 | Microsoft CEO のクレイジーなアムウェイ AI ゲームは私を何千回も苦しめた

Aug 14, 2024 am 12:00 AM

AI の使用 | Microsoft CEO のクレイジーなアムウェイ AI ゲームは私を何千回も苦しめた

Aug 14, 2024 am 12:00 AM

Machine Power Report 編集者: Yang Wen 大型モデルや AIGC に代表される人工知能の波は、私たちの生活や働き方を静かに変えていますが、ほとんどの人はまだその使い方を知りません。そこで、直感的で興味深く簡潔な人工知能のユースケースを通じてAIの活用方法を詳しく紹介し、皆様の思考を刺激するコラム「AI in Use」を立ち上げました。また、読者が革新的な実践的な使用例を提出することも歓迎します。なんと、AIは本当に天才になってしまったのです。最近、AIが生成した写真の真贋を見分けるのが難しいと話題になっています。 (詳しくはこちら:AI活用中 | 3ステップでAI美女になり、1秒でAIに元に戻される) インターネット上で人気のAI Google ladyのほかにも、さまざまなFLUXジェネレーターが登場しています。ソーシャルプラットフォーム上に出現した