このサイトの 3 月 14 日のニュースによると、TrendForce は最近、2024 年の HBM メモリ市場の主流の仕様は HBM3 になるが、Nvidia の今後の B100 または H200 アクセラレータ カードは HBM3e 仕様を使用するというレポートを発表しました。

現在の AI アクセラレータ カードの CoWoS パッケージングのボトルネックに加えて、別の重要な制限が HBM にあることが報告されています。この主な理由は、AI アクセラレータ カードの生産サイクルに問題があることです。 HBM は DDR5 よりも長く、チップの製造とパッケージングが完了するまでに少なくとも 2 四半期かかります。

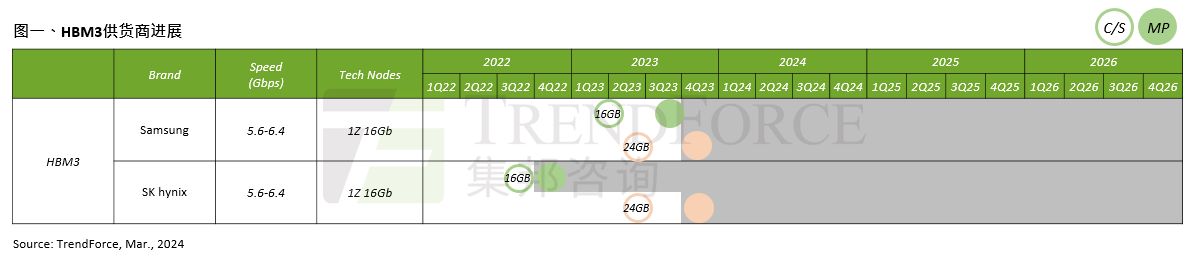

NVIDIA の現在の主流 H100 アクセラレータ カードは HBM3 メモリを使用しており、その主要サプライヤーは SK Hynix ですが、現時点では AI 市場全体の需要を満たすことができません。 TrendForce は、Samsung が 2023 年末に 1Znm 製品で Nvidia のサプライチェーンに加わると述べました。その割合はまだ小さいですが、これは HBM 分野における Samsung にとって大きな進歩と見なすことができます。

Samsung は長年にわたり AMD の最も重要な戦略的供給パートナーであるため、Samsung HBM3 製品も、8 時間および 12 時間の製品を含め、2024 年の第 1 四半期に連続して AMD MI300 シリーズの検証に合格しました。 2024 年の四半期 この四半期以降、Samsung HBM3 製品の販売量は徐々に増加します。

2024 年から、市場の焦点は HBM3 から HBM3e に移り、その量は下半期に四半期ごとに増加し、徐々に増加すると予想されます。 HBM市場の主流。 TrendForceの調査によると、SK Hynixが第1四半期の検証通過で先頭に立ち、それに僅差でMicronが続き、Micronは第1四半期末に出荷予定のNVIDIA H200に合わせてHBM3eの量産製品を提出し始めた。第2四半期の終わり。

Samsung は他の 2 つのサプライヤーよりわずかに遅れてサンプルを提出したため、同社の HBM3e は第 1 四半期が終わる前に検証に合格し、第 2 四半期から開始されると予想されます。 . 正式に出荷されました。

レポートの元のアドレスはこの Web サイトに添付されているので、興味のあるユーザーは詳細を読むことができます。

以上がHBMの競争激化:SamsungがAMDの認定を受け、SK Hynixに追いつくために加速の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。