Llama3が突然やってくる!オープンソース コミュニティが再び沸騰: GPT4 レベルのモデルに無料でアクセスできる時代が到来

ラマ 3 が登場します!

たった今、Meta の公式 Web サイトが更新され、Llama 3 の 80 億パラメータと 700 億パラメータのバージョンが正式に発表されました。

そして、このリリースはオープンソース SOTA です:

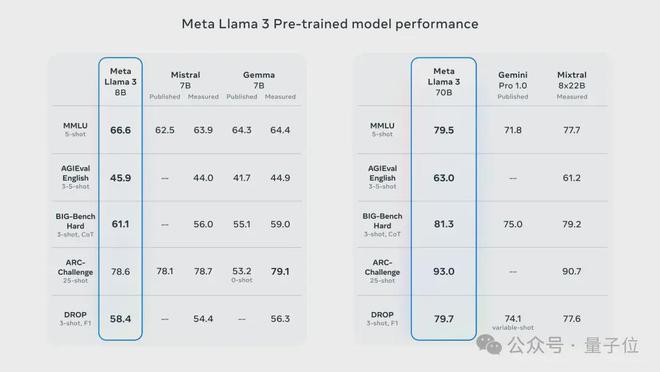

メタ公式データによると、Llama 3 8B および 70B バージョンは、それぞれのパラメーター スケールですべての対戦相手を上回っています。

8B モデルは、MMLU、GPQA、HumanEval などの多くのベンチマークで Gemma 7B および Mistral 7B Instruct よりも優れたパフォーマンスを示します。

70B モデルは、人気のあるクローズドソースの Claude 3 Sonnet を超え、Google の Gemini Pro 1.5 と行き来しました。

Huggingface リンクが公開されるとすぐに、オープンソース コミュニティは再び興奮しました。

鋭い目の盲目の学生たちもすぐに華甸を発見しました:

メタは、クロード 3 の超大型オーパスに匹敵する 4,000 億個のパラメーターを持つラマ 3 のバージョンさえ隠していました。

AI ライティング アシスタントのスタートアップ HyperWriteAI の CEO は、これを見てため息をつかずにはいられませんでした。新しい世界、GPT - レベル 4 モデルがオープンソースで自由にアクセスできる世界。

NVIDIA の科学者 Jim Fan は、まだトレーニング中の Llama 3 400B がオープンソースの大規模モデルの分水嶺となり、多くの学術モデルの開発を変えるだろうと信じています。研究とスタートアップ企業の方法。

フル SOTA、ただし 8k ウィンドウ

その結果、8B バージョンであっても 70B バージョンであっても、Llama 3 は、同様のサイズの前世代の Llama 2 と比較して大きな進歩を遂げました。

これらの従来のデータ セットに加えて、Meta AI は現実のシナリオにおける Llama 3 のパフォーマンスも評価し、この目的のために高品質のテスト データ セットを開発しました。

Llama 3 のパフォーマンスは、AGIEval、BIG-Bench、ARC-Challenge などの高次でより困難なデータセットでも顕著です。

8B バージョンはこれらのタスクで Mistral と Gemma を上回り、70B バージョンは MoE アーキテクチャの Gemini Pro と Mixtral を破り、それぞれ対応するサイズの SOTA を獲得しました。

ただし、唯一の欠点は、Llama 3 のコンテキスト ウィンドウが数十、数百万のウィンドウを持つ現在の大型モデルと比較して、わずか 8k であることです。まだ前の世代(手動の犬の頭)に残っています。

しかし、マット シューマー氏はこれについて楽観的であり、オープンソース コミュニティの努力により、その期間はすぐに短縮されるだろうと述べています。拡張されました。

Llama が公式 Web バージョンを歓迎します

現在、Llama 3 の両方のパラメーターの基本バージョンと指示バージョンは、Hugging Face でダウンロードできます。

さらに、Microsoft Azure、Google Cloud、Amazon AWS、NVIDIA NIM などのクラウド サービス プラットフォームでも、Llama 3 が続々とリリースされる予定です。

同時にメタ氏は、Llama 3はIntel、Nvidia、AMD、Qualcommなどのメーカーが提供するハードウェアプラットフォームでサポートされるだろうとも述べた。

今回は、基本モデルとともに、Meta AI と呼ばれる、Llama 3 に基づく公式 Web バージョンがあることを言及する価値があります。

現在、プラットフォームにはダイアログとペイントの2つの主要な機能がありますが、ダイアログのみを使用する場合は、登録とログインを必要とせずに使用できます。すぐにペイント機能を使用するには、まずアカウントにログインする必要があります。

ただし、プラットフォームは現在中国語をサポートしておらず、テキストのアップロードなどの機能はまだ開始されていません。

コードに関しては、このプラットフォームはいくつかの単純な Python プログラムも実行できますが、テキストの出力のみが可能で、描画を伴うタスクは実行できないようです。

# 全体的に見ると、この Web バージョンはまだ比較的初歩的なものですが、その後の更新の波に期待するのもよいでしょう。

One More Thing

小さな事件は、実際、Meta の公式発表の数時間前に、Microsoft の Azure マーケットが Llama 3 8B Instruct バージョンのニュースをすでに盗んでいたことです。

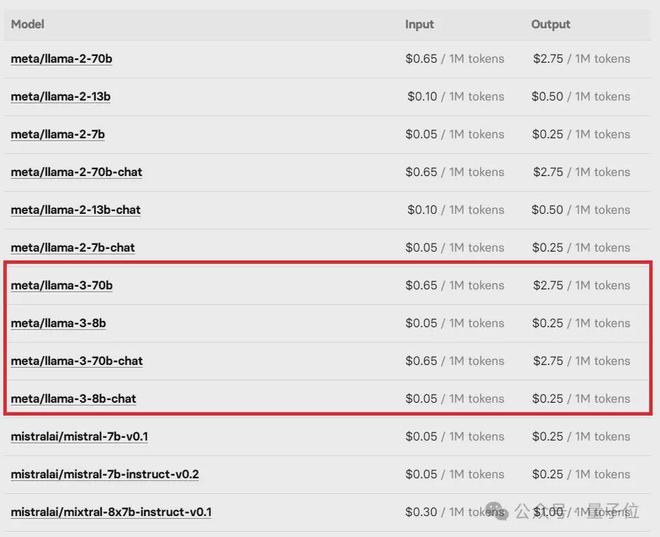

オープンソース モデルの機械学習オンライン プラットフォーム Replicate にある Llama 3 の価格表も、すぐにネチズンによって削除されました。

#しかしすぐに、これらの「ちょっとした豆知識」はすべて 404 にされてしまいました。

幸いなことに、間違いは終わったので、当局はオープンソースの大規模モデルに関心を持つ友人がそれを遅らせるつもりはありません。

参考リンク:

[1]https://ai.meta.com/blog/meta-llama-3/。

[2]https://about.fb.com/news/2024/04/meta-ai-assistant-built-with-llama-3/。

[3]https://huggingface.co/メタラマ/メタラマ-3-70B。

以上がLlama3が突然やってくる!オープンソース コミュニティが再び沸騰: GPT4 レベルのモデルに無料でアクセスできる時代が到来の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1663

1663

14

14

1420

1420

52

52

1313

1313

25

25

1266

1266

29

29

1238

1238

24

24

PHPおよびPython:さまざまなパラダイムが説明されています

Apr 18, 2025 am 12:26 AM

PHPおよびPython:さまざまなパラダイムが説明されています

Apr 18, 2025 am 12:26 AM

PHPは主に手順プログラミングですが、オブジェクト指向プログラミング(OOP)もサポートしています。 Pythonは、OOP、機能、手続き上のプログラミングなど、さまざまなパラダイムをサポートしています。 PHPはWeb開発に適しており、Pythonはデータ分析や機械学習などのさまざまなアプリケーションに適しています。

PHPとPythonの選択:ガイド

Apr 18, 2025 am 12:24 AM

PHPとPythonの選択:ガイド

Apr 18, 2025 am 12:24 AM

PHPはWeb開発と迅速なプロトタイピングに適しており、Pythonはデータサイエンスと機械学習に適しています。 1.PHPは、単純な構文と迅速な開発に適した動的なWeb開発に使用されます。 2。Pythonには簡潔な構文があり、複数のフィールドに適しており、強力なライブラリエコシステムがあります。

PHPとPython:彼らの歴史を深く掘り下げます

Apr 18, 2025 am 12:25 AM

PHPとPython:彼らの歴史を深く掘り下げます

Apr 18, 2025 am 12:25 AM

PHPは1994年に発信され、Rasmuslerdorfによって開発されました。もともとはウェブサイトの訪問者を追跡するために使用され、サーバー側のスクリプト言語に徐々に進化し、Web開発で広く使用されていました。 Pythonは、1980年代後半にGuidovan Rossumによって開発され、1991年に最初にリリースされました。コードの読みやすさとシンプルさを強調し、科学的コンピューティング、データ分析、その他の分野に適しています。

Python vs. JavaScript:学習曲線と使いやすさ

Apr 16, 2025 am 12:12 AM

Python vs. JavaScript:学習曲線と使いやすさ

Apr 16, 2025 am 12:12 AM

Pythonは、スムーズな学習曲線と簡潔な構文を備えた初心者により適しています。 JavaScriptは、急な学習曲線と柔軟な構文を備えたフロントエンド開発に適しています。 1。Python構文は直感的で、データサイエンスやバックエンド開発に適しています。 2。JavaScriptは柔軟で、フロントエンドおよびサーバー側のプログラミングで広く使用されています。

Sublime Code Pythonを実行する方法

Apr 16, 2025 am 08:48 AM

Sublime Code Pythonを実行する方法

Apr 16, 2025 am 08:48 AM

PythonコードをSublimeテキストで実行するには、最初にPythonプラグインをインストールし、次に.pyファイルを作成してコードを書き込み、Ctrl Bを押してコードを実行する必要があります。コードを実行すると、出力がコンソールに表示されます。

vscodeでコードを書く場所

Apr 15, 2025 pm 09:54 PM

vscodeでコードを書く場所

Apr 15, 2025 pm 09:54 PM

Visual Studioコード(VSCODE)でコードを作成するのはシンプルで使いやすいです。 VSCODEをインストールし、プロジェクトの作成、言語の選択、ファイルの作成、コードの書き込み、保存して実行します。 VSCODEの利点には、クロスプラットフォーム、フリーおよびオープンソース、強力な機能、リッチエクステンション、軽量で高速が含まれます。

Golang vs. Python:パフォーマンスとスケーラビリティ

Apr 19, 2025 am 12:18 AM

Golang vs. Python:パフォーマンスとスケーラビリティ

Apr 19, 2025 am 12:18 AM

Golangは、パフォーマンスとスケーラビリティの点でPythonよりも優れています。 1)Golangのコンピレーションタイプの特性と効率的な並行性モデルにより、高い並行性シナリオでうまく機能します。 2)Pythonは解釈された言語として、ゆっくりと実行されますが、Cythonなどのツールを介してパフォーマンスを最適化できます。

Visual StudioコードはPythonで使用できますか

Apr 15, 2025 pm 08:18 PM

Visual StudioコードはPythonで使用できますか

Apr 15, 2025 pm 08:18 PM

VSコードはPythonの書き込みに使用でき、Pythonアプリケーションを開発するための理想的なツールになる多くの機能を提供できます。ユーザーは以下を可能にします。Python拡張機能をインストールして、コードの完了、構文の強調表示、デバッグなどの関数を取得できます。デバッガーを使用して、コードを段階的に追跡し、エラーを見つけて修正します。バージョンコントロールのためにGitを統合します。コードフォーマットツールを使用して、コードの一貫性を維持します。糸くずツールを使用して、事前に潜在的な問題を発見します。