オックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)

前に書いてあります

プロジェクトリンク: https://nianticlabs.github.io/mickey/

2 つの画像が与えられた場合、画像間の対応関係を確立することで、それらの間のカメラのポーズを推定できます。通常、これらの対応は 2D 対 2D であり、推定されたポーズはスケール不定です。いつでもどこでもインスタント拡張現実などの一部のアプリケーションでは、スケール メトリクスの姿勢推定が必要なため、スケールを回復するために外部深度推定器に依存します。

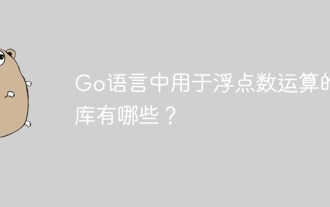

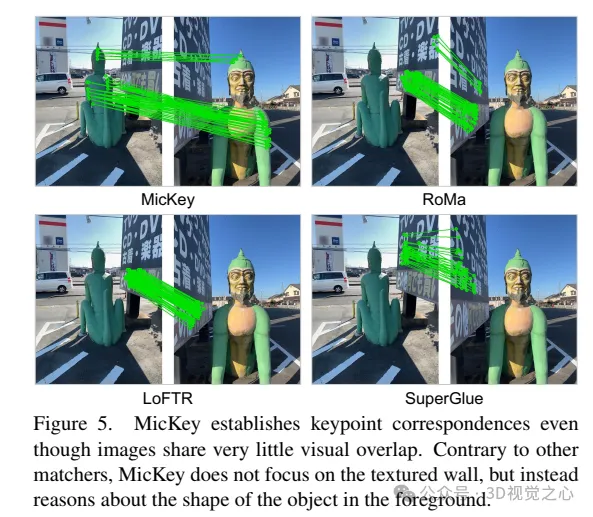

この記事では、3 次元カメラ空間でのメトリックの対応を予測できるキー ポイント マッチング プロセスである MicKey を提案します。画像全体の 3D 座標マッチングを学習することで、深度テストを行わずにメトリクスの相対姿勢を推測できます。また、トレーニング中に深度テスト、シーンの再構成、または画像のオーバーラップ情報も必要ありません。 MicKey は、画像のペアとその相対的なポーズによってのみ監視されます。 MicKey は、他の競合する方法よりも少ない監視を必要としながら、マップフリーの再ローカリゼーション ベンチマークで最先端のパフォーマンスを実現します。

「メトリック + キーポイント (MicKey) は 2 つの問題を解決する特徴検出プロセスです。まず、MicKey はカメラ空間内のキーポイントの位置を回帰します。これにより、記述子のマッチングを通じてメトリックの対応関係を確立できます。メトリックからの対応では、メトリックの相対図 1 に示すように、ポーズは復元できます。第 2 に、エンドツーエンドのトレーニングに微分可能なポーズの最適化を使用することで、MicKey はトレーニング プロセス中に監視なしで画像ペアとその真の相対的なポーズのみを必要とします。キーポイントの深さを暗黙的に、正確に検出された特徴領域に対してのみ取得します。私たちのトレーニング プロセスは、未知の視覚的オーバーラップを持つ画像のペアに対して堅牢であるため、SFM によって取得される情報 (画像のオーバーラップなど) は必要ありません。MicKey は非常にアクセスしやすくなります。新しいドメインでのトレーニングにはポーズ以外の追加情報が必要ないため、魅力的です。 MicKey は、特に疎な特徴のマッチングを対象とした深度予測によってサポートされる、極端な視野角変化下でも信頼性の高いスケールメトリック姿勢推定を提供します。この精度によってサポートされる極端な視野角変化下での変形マッチングにより、MicKey は、特に疎な特徴のマッチングのための深度予測によってサポートされる深度推定マッチングに必要な深度推定をサポートするのに最適になります。

主な貢献は次のとおりです:

MicKey は、単一の画像から重要なポイントを予測し、それらを記述することができるニューラル ネットワークです。このような記述子により、画像間のメトリック相対姿勢の推定が可能になります。

このトレーニング戦略では、相対的な姿勢のモニタリングのみが必要で、深さの測定は必要なく、画像ペアのオーバーラップに関する知識も必要ありません。

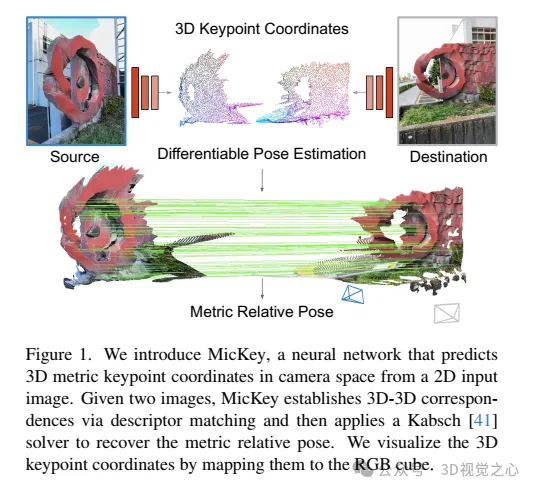

MicKey の紹介MicKey は、カメラ空間内のキーポイントの 3 次元座標を予測します。このネットワークは、キーポイントの選択確率 (キーポイント分布) と、一致の確率をガイドする記述子 (一致分布) も予測します。これら 2 つの分布を組み合わせることで、2 つのキー ポイントが対応点となる確率を取得し、対応点が出現しやすくなるようにネットワークを最適化します。微分可能な RANSAC ループでは、複数の相対姿勢仮説が生成され、真の変換に対するそれらの損失が計算されます。 REINFORCE を通じて勾配を生成し、対応する確率をトレーニングします。ポーズ ソルバーと損失関数は微分可能であるため、バックプロパゲーションは 3D キーポイント座標をトレーニングするための直接信号も提供します。

2 つの画像が与えられた場合、それらのメトリクスの相対ポーズ、キーポイント スコア、マッチング確率、およびポーズの信頼度 (ソフト インライア カウントの形式で) を計算します。私たちの目標は、すべての相対姿勢推定モジュールをエンドツーエンドの方法でトレーニングすることです。トレーニング プロセス中、トレーニング データは次のとおりであると仮定します。ここで、 は実際の変換であり、K/K' はカメラの固有パラメータです。システム全体の概略図を図2に示します。

3D キーポイントの座標、信頼度、記述子を学習するには、システムが完全に微分可能である必要があります。ただし、キーポイント サンプリングやインライア カウントなど、パイプライン内の一部の要素は微分可能ではないため、相対姿勢推定パイプラインは確率的として再定義されます。これは、ネットワークの出力を潜在的な一致の確率として扱い、トレーニング中にネットワークがその出力を最適化して、正しい一致が選択される可能性が高くなるような確率を生成することを意味します。

2) ネットワーク構造MicKey は、図 3 に示すように、入力画像から 3D メトリック キーポイントと記述子を推論する共有エンコーダーを備えたマルチヘッド ネットワーク アーキテクチャに従います。

エンコーダー。事前トレーニングされた DINOv2 モデルを特徴抽出器として採用し、さらなるトレーニングや微調整を行わずにその機能を直接使用します。 DINOv2 は、入力画像をサイズ 14×14 のブロックに分割し、各ブロックに特徴ベクトルを提供します。最終的な特徴マップ F の解像度は (1024, w, h) です。ここで、w = W/14、h = H/14 です。

重要なポイントは頭です。ここでは 4 つの並列ヘッドが定義されており、特徴マップ F を処理し、マップの各エントリが入力 A 14 に対応する xy オフセット (U)、深度 (Z)、信頼度 (C)、および記述子 (D) マップを計算します。画像の×14ブロック。 MicKey には、疎な規則的なグリッドからの相対オフセットとしてキーポイントを予測するという珍しい特性があります。絶対 2D 座標は次のように取得されます:

実験比較

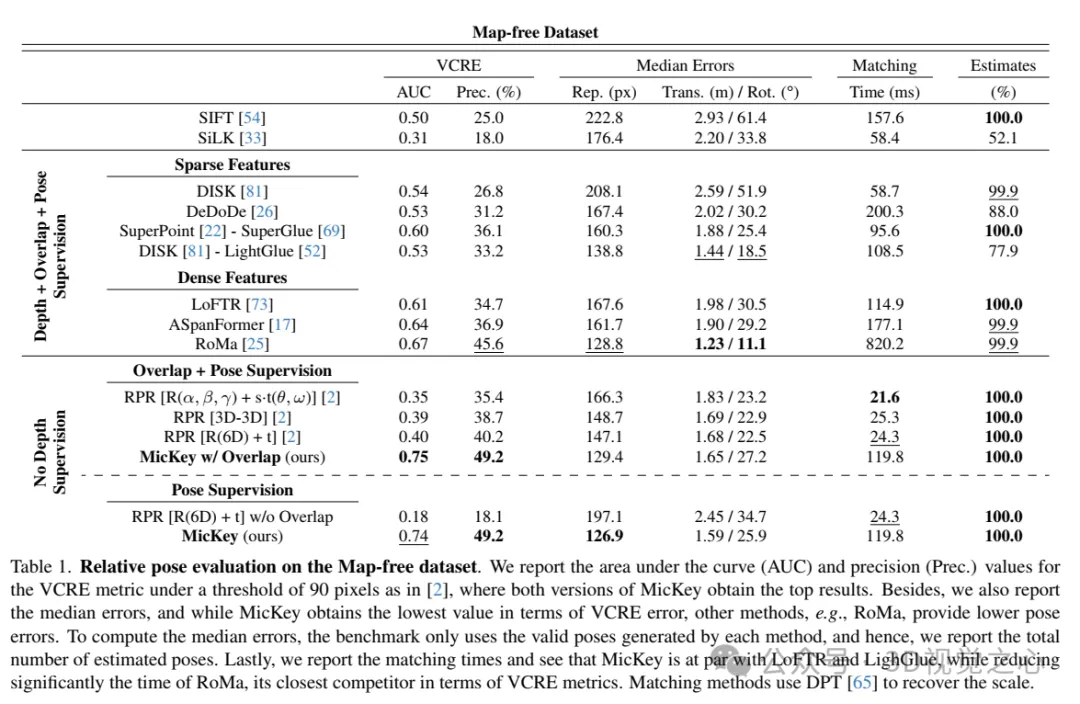

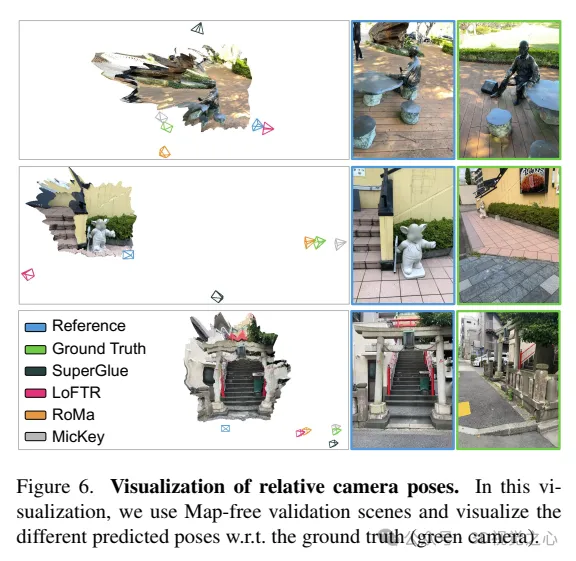

マップフリー データセットでの相対姿勢評価。 90 ピクセルのしきい値での VCRE メトリクスの曲線下面積 (AUC) と精度 (Preci.) の値が報告され、MicKey の両方のバージョンで最高の結果が得られます。さらに、中央値誤差も報告され、MicKey は VCRE 誤差に関して最低値を取得しますが、RoMa などの他の方法ではより低いポーズ誤差が得られます。中央値誤差を計算するために、ベースラインは各メソッドによって生成された有効なポーズのみを使用するため、ポーズの推定総数を報告します。最後に、マッチング時間が報告され、MicKey は LoFTR および LighGlue に匹敵し、VCRE メトリクスの点で MicKey に最も近い競合である RoMa の時間を大幅に短縮していることがわかりました。マッチング方法では、DPT を使用してスケールを復元します。

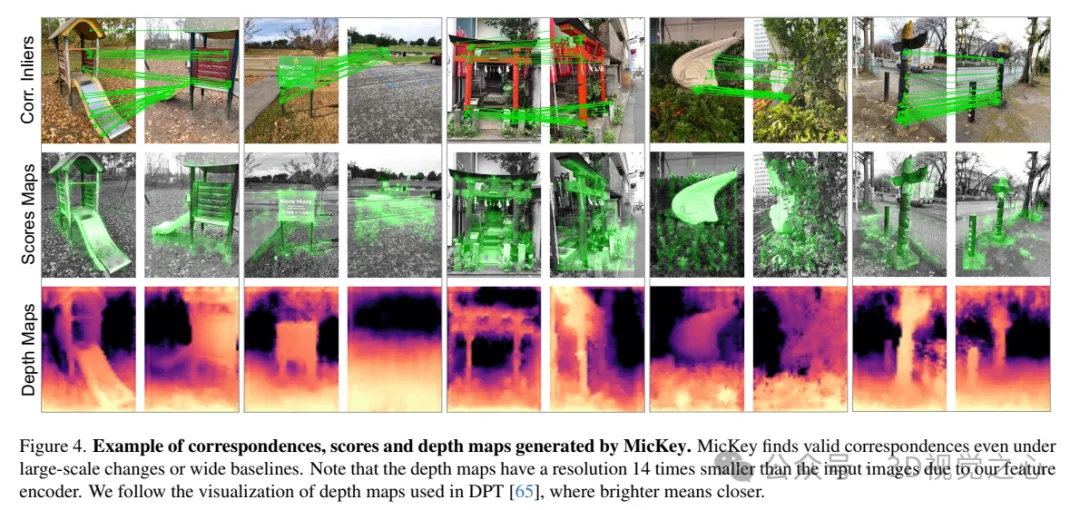

MicKey によって生成された対応するポイント、スコア、深度マップの例。 MicKey は、大規模な変更や幅広いベースラインが存在する場合でも、効果的な対応点を見つけます。特徴エンコーダーにより、深度マップの解像度は入力画像の 14 分の 1 であることに注意してください。 DPT で使用される深度マップ視覚化方法に従っています。明るい色は近い距離を表します。

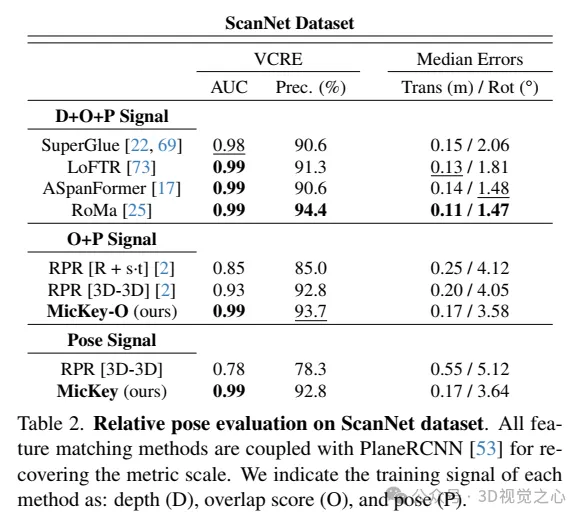

ScanNet データセット上の相対姿勢評価。すべての特徴マッチング方法は、PlaneRCNN と組み合わせて使用され、メトリック スケールを回復します。各メソッドのトレーニング信号、深さ (D)、オーバーラップ スコア (O)、ポーズ (P) を示します。

以上がオックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7455

7455

15

15

1375

1375

52

52

77

77

11

11

14

14

9

9

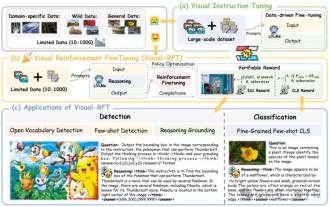

SFTを大幅に超えて、O1/DeepSeek-R1の背後にある秘密は、マルチモーダルの大規模モデルでも使用できます

Mar 12, 2025 pm 01:03 PM

SFTを大幅に超えて、O1/DeepSeek-R1の背後にある秘密は、マルチモーダルの大規模モデルでも使用できます

Mar 12, 2025 pm 01:03 PM

上海ジョトン大学、上海アイラブ、および香港中国大学の研究者は、Visual Language Big Model(LVLM)のパフォーマンスを大幅に改善するために少量のデータのみを必要とする視覚RFT(視覚エンハンスメントファインチューニング)オープンソースプロジェクトを開始しました。 Visual-RFTは、DeepSeek-R1のルールベースの強化学習アプローチとOpenAIの強化微調整(RFT)パラダイムを巧みに組み合わせて、このアプローチをテキストフィールドから視野に拡張しました。視覚的サブカテゴリ化やオブジェクト検出などのタスクの対応するルール報酬を設計することにより、Visual-RFTは、テキスト、数学的推論、その他のフィールドに限定されているDeepSeek-R1メソッドの制限を克服し、LVLMトレーニングの新しい方法を提供します。 Vis

GOのどのライブラリが大企業によって開発されていますか、それとも有名なオープンソースプロジェクトによって提供されていますか?

Apr 02, 2025 pm 04:12 PM

GOのどのライブラリが大企業によって開発されていますか、それとも有名なオープンソースプロジェクトによって提供されていますか?

Apr 02, 2025 pm 04:12 PM

大企業または有名なオープンソースプロジェクトによって開発されたGOのどのライブラリが開発されていますか? GOでプログラミングするとき、開発者はしばしばいくつかの一般的なニーズに遭遇します...

Giteeページ静的なWebサイトの展開に失敗しました:単一のファイル404エラーをトラブルシューティングと解決する方法

Apr 04, 2025 pm 11:54 PM

Giteeページ静的なWebサイトの展開に失敗しました:単一のファイル404エラーをトラブルシューティングと解決する方法

Apr 04, 2025 pm 11:54 PM

GiteEpages静的Webサイトの展開が失敗しました:404エラーのトラブルシューティングと解像度Giteeを使用する

H5プロジェクトの実行方法

Apr 06, 2025 pm 12:21 PM

H5プロジェクトの実行方法

Apr 06, 2025 pm 12:21 PM

H5プロジェクトを実行するには、次の手順が必要です。Webサーバー、node.js、開発ツールなどの必要なツールのインストール。開発環境の構築、プロジェクトフォルダーの作成、プロジェクトの初期化、コードの書き込み。開発サーバーを起動し、コマンドラインを使用してコマンドを実行します。ブラウザでプロジェクトをプレビューし、開発サーバーURLを入力します。プロジェクトの公開、コードの最適化、プロジェクトの展開、Webサーバーの構成のセットアップ。

海外バージョンの配送地域データを取得する方法は?利用可能な既製のリソースは何ですか?

Apr 01, 2025 am 08:15 AM

海外バージョンの配送地域データを取得する方法は?利用可能な既製のリソースは何ですか?

Apr 01, 2025 am 08:15 AM

質問の説明:海外バージョンの配送地域データを取得する方法は?既製のリソースはありますか?国境を越えた電子商取引またはグローバル化ビジネスで正確に入手してください...

Redisストリームを使用してGO言語でメッセージキューを実装する場合、user_idタイプの変換の問題を解決する方法は?

Apr 02, 2025 pm 04:54 PM

Redisストリームを使用してGO言語でメッセージキューを実装する場合、user_idタイプの変換の問題を解決する方法は?

Apr 02, 2025 pm 04:54 PM

redisstreamを使用してGo言語でメッセージキューを実装する問題は、GO言語とRedisを使用することです...

Python hourglassグラフ図面:可変未定義エラーを避ける方法は?

Apr 01, 2025 pm 06:27 PM

Python hourglassグラフ図面:可変未定義エラーを避ける方法は?

Apr 01, 2025 pm 06:27 PM

Python:Hourglassグラフィック図面と入力検証この記事では、Python NoviceがHourglass Graphic Drawingプログラムで遭遇する可変定義の問題を解決します。コード...