超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

死ぬほど泣いてください、全世界が大きなモデルの作成に夢中になっています、インターネット上のデータは十分ではありません、まったく十分ではありません。

トレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、こうしたビッグデータを食べる人たちにどのように餌を与えるかを心配しています。

この問題は、マルチモーダル タスクで特に顕著です。

が途方に暮れていたとき、人民大学 学部のスタートアップ チーム は独自の新しいモデルを使用して、中国で先駆けて「モデル」の転換を図りました。 -それ自体を現実にフィードするために生成されたデータ。

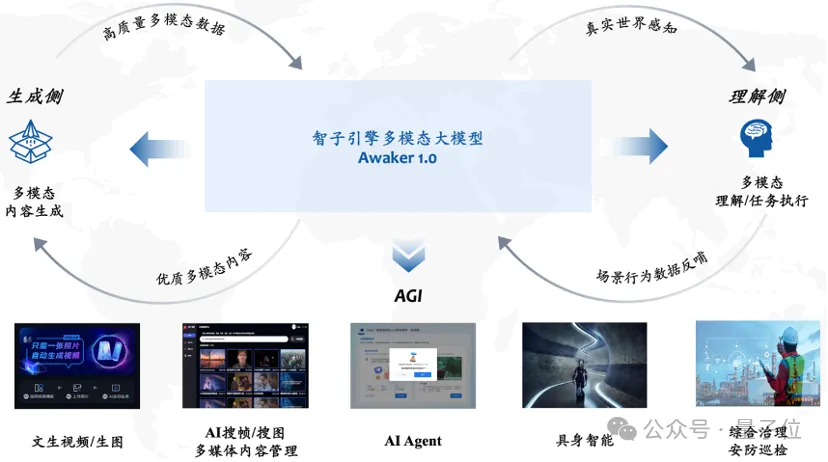

さらに、理解側と生成側の 2 つのアプローチにより、高品質でマルチモーダルな新しいデータを生成し、データのフィードバックを提供できます。モデル自体に。 モデルは何ですか?

マルチモーダル大型モデル Awaker 1.0

が中関村フォーラムに登場しました。 チームは誰ですか?

ソフォンエンジン。

は、中国人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立され、ヒルハウス人工知能大学院の陸志烏教授がコンサルタントを務めています。同社は 2021 年に設立されたとき、早くからマルチモダリティの「無人地帯」路線に参入しました。 MOE アーキテクチャ、マルチモーダルおよびマルチタスク トレーニングの競合問題を解決するSophon Engine がモデルをリリースするのはこれが初めてではありません。

昨年 3 月 8 日、2 年間の研究開発を費やしたチームは、初の自社開発マルチモーダル モデル、数百億のパラメータを持つ ChatImg シーケンス モデルをリリースし、世界初のこれに基づく公開評価。マルチモーダル会話アプリケーション ChatImg

(元乗算画像)。

その後、ChatImgは反復を続け、新モデルAwakerの研究開発も並行して進められました。後者も前モデルの基本性能を継承しています。 前世代の ChatImg シーケンス モデルと比較して、Awaker 1.0

は MoE モデル アーキテクチャを採用しています。

その理由は、マルチモーダルおよびマルチタスクのトレーニングにおける深刻な競合の問題を解決したいからです。 MoE モデル アーキテクチャを使用すると、マルチモーダルの一般的な機能と各タスクに必要な固有の機能をより適切に学習できるため、複数のタスクにおける Awaker 1.0 全体の機能がさらに向上します。

データは百聞は一見に如かず:

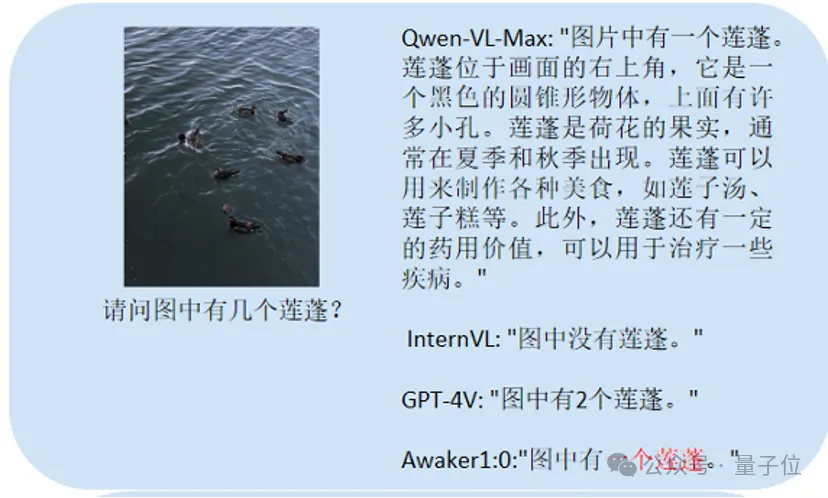

主流のマルチモーダル評価リストにおける評価データ漏洩の問題を考慮して、ソフォン チームは厳密に構築しました独自の評価セット。ほとんどのテスト画像は個人の携帯電話のフォト アルバムから取得したものです。 表は、チームが Awaker 1.0 と国内外の 3 つの最も先進的なマルチモーダル大規模モデルを評価したことを示しています。

表は、チームが Awaker 1.0 と国内外の 3 つの最も先進的なマルチモーダル大規模モデルを評価したことを示しています。

もう 1 つ言及しておきたいのは、GPT-4V と Intern-VL は検出タスクを直接サポートしていないため、それらの検出結果は、オブジェクトの方向を記述する言語をモデルに要求することによって取得されます。

ビジュアルな質問応答やビジネス アプリケーション タスクにおいて、Awaker 1.0 のベース モデルは GPT-4V、Qwen-VL-Max、Intern-VL を上回っていることがわかります。

Awaker 1.0 の基本モデルは、記述、推論、検出タスクに関して 2 番目に良い結果を達成しました。

最後に、平均スコアを見ると、Awaker 1.0 が最も高い値を示しています。

したがって、上記の結果は、MoE アーキテクチャを使用したマルチタスク マルチモーダル モデルの有効性も確認します。

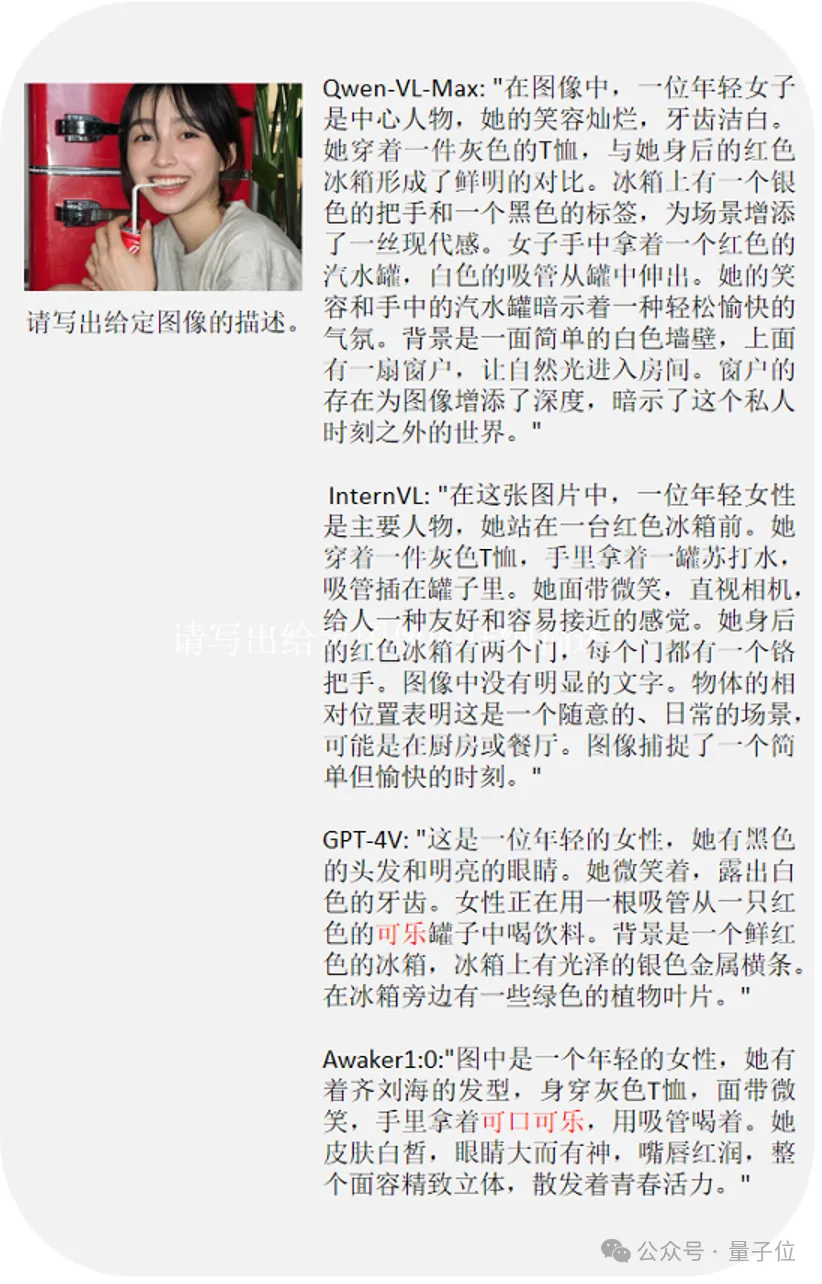

データセットの評価結果は入手可能ですが、実際の効果はさらに体験する必要があります。

ここでは主に中国語 OCR

(画像テキスト認識)や、大型モデルと比較したカウントの問題、詳細な記述タスクなどについて質問します。

このメインテスト数

:Awaker 1.0は正しい答えを与えることができますが、他の3つのモデルはすべて不正解です。

#このメインテスト

中国語 OCR

正解したプレイヤーは Qwen-VL-Max ですそしてAwaker 1.0。

最後の質問では、

画像の内容の理解をテストします。

Awaker 1.0 は、Sophon チームが以前に多くの注目を集めた研究結果の一部を継承していることを言及しなければなりません。

私が話しているのは、Awaker 1.0

の

(Video Diffusion Transformer) です。 VDT の学術論文は、OpenAI Sora (昨年 5 月)

のリリースに先立って発表され、トップカンファレンス ICLR 2024 に採択されました。

ディスプレイの独自の革新性は主に 2 点あります。

1 つ目は、技術アーキテクチャに Diffusion Transformer を採用することです。OpenAI が登場する前に、ビデオ生成の分野における Transformer の大きな可能性が示されました。

その利点は、時間の経過に伴う 3 次元オブジェクトの物理ダイナミクスのシミュレーションなど、時間的に一貫したビデオ フレームを生成できる優れた時間依存キャプチャ機能にあります。

2 つ目は、VDT がさまざまなビデオ生成タスクを処理できるようにするための、統合された時空間マスク モデリング メカニズムを提案することです。 単純なトークン空間スプライシングなどの VDT の柔軟な条件付き情報処理方法は、さまざまな長さや形式の情報を効果的に統合します。

同時に、本研究で提案した時空間マスクモデリング機構と組み合わせることで、VDTは一般的なビデオ拡散ツールとなり、モデル構造を変更することなく無条件生成やビデオの後続フレーム予測に適用できます。 、フレーム挿入、画像生成ビデオ、ビデオ画面完成およびその他のビデオ生成タスク。

Sophon エンジン チームは、VDT による単純な物理法則のシミュレーションを研究しただけでなく、

物理プロセスをシミュレートできることも発見したことがわかりました。:

は、

は、

超リアルなポートレート ビデオ生成タスク # についても詳細な調査を実施しました。 肉眼は顔や人の動的な変化に非常に敏感であるため、このタスクではビデオ生成の品質に対して非常に高い要件が求められます。しかし、Sophon エンジンは、超リアルなポートレート ビデオ生成のための主要なテクノロジーのほとんどを突破しており、Sora に劣らない優れた性能を持っています。

あなたの言うことには根拠がありません。

これは、ポートレートビデオ生成の品質を向上させるために、VDT と制御可能な生成を組み合わせた Sophon エンジンの効果です:

Sophon エンジンは、キャラクター制御可能な生成アルゴリズムの最適化を継続し、積極的に行うと報告されています。商業探査を実施します。

新しいインタラクティブ データの安定したストリームの生成

さらに注目に値するのは、Sophon エンジン チームが次のように強調したことです。

Awaker 1.0 は、

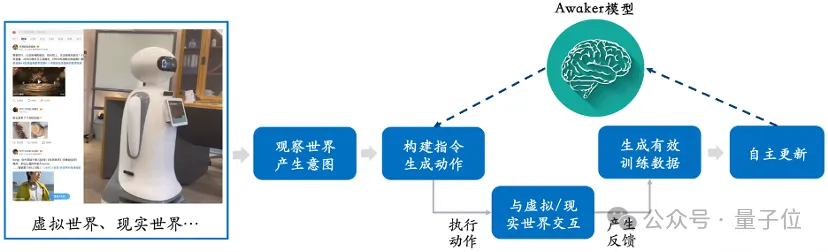

世界初の自己更新型マルチモーダル大規模モデル。 言い換えれば、Awaker 1.0 は「ライブ」であり、そのパラメータはリアルタイムで継続的に更新できます。これが、Awaker 1.0 を他のすべてのマルチモーダル大規模モデルとは異なるものにしています。 1.0 の更新メカニズムには、次の 3 つの主要なテクノロジが含まれています。 #これら 3 つのテクノロジーにより、Awaker 1.0 は独立して学習し、自動的に反映し、独立して更新できるため、世界を自由に探索し、人間と対話することもできます。

これに基づいて、Awaker 1.0 は、理解する側と生成する側の両方で新しいインタラクティブ データの安定したストリームを生成できます。

どうやってやったのですか?

- 理解面では、

- Awaker 1.0 はデジタル世界と現実世界と相互作用します。

- タスクの実行プロセスにおいて、Awaker 1.0 はシーンの動作データをモデルにフィードバックして、継続的な更新とトレーニングを実現します。

生成側では、

Awaker 1.0 は高品質のマルチモーダル コンテンツ生成を実行でき、理解側モデルにより多くのトレーニング データを提供します。

Awaker 1.0 は、理解側と生成側の 2 つのループで、視覚的な理解と視覚的な生成の統合を実際に実現します。 ご存知のように、Sora の登場以降、AGI を達成するには「理解と生成の統一」が達成されなければならないという声がますます増えてきました。

新しい知識の注入を例として、ランスルーの具体的な例を見てみましょう。Awaker 1.0 は、インターネット上のリアルタイムのニュース情報を継続的に学習すると同時に、新しく学習したニュース情報を組み合わせて、さまざまな複雑な質問に答えます。 これは、現在主流の 2 つのメソッド、つまり RAG と従来のロング コンテキスト メソッドとは異なります。Awaker 1.0 は、実際には

独自のモデルのパラメーターに関する新しい知識を「記憶」します#。 ##。

連続 3 日間の自己更新プロセス中に、Awaker 1.0 が毎日その日のニュース情報を学習し、対応する情報を正確に記述できることがわかります。説明。

連続 3 日間の自己更新プロセス中に、Awaker 1.0 が毎日その日のニュース情報を学習し、対応する情報を正確に記述できることがわかります。説明。

そして、Awaker 1.0 は学習を続けていますが、学んだ知識をすぐに忘れることはありません。

たとえば、4 月 16 日に学習した Zhijie S7 に関連する知識は、2 日後も Awaker 1.0 によって記憶または理解されていました。

ですから、データが金のようなこの時代に、「データが足りない」と嘆くのはやめてください。 データのボトルネックに直面しているチームにとって、Awaker 1.0 は実現可能で使用可能な新しいオプションではないでしょうか? そうは言っても、視覚理解と視覚生成が統合されているからこそ、「マルチモーダルな大きなモデルが身体化された知性に適応する」のです。 " "Awaker 1.0 のプライドが明確に明らかになりました。 問題は次のとおりです: Awaker 1.0 のような大規模なマルチモーダル モデルの視覚的理解機能は、身体化された知性の「目」と自然に組み合わせることができます。 そして主流派はまた、「マルチモーダル大規模モデルの身体化インテリジェンス」には、身体化インテリジェンスの適応性と創造性を大幅に向上させる可能性があり、AGI を実現する実現可能な道であると信じています。 理由は2点に過ぎません。 第一に、人々は、身体化されたインテリジェンスが適応可能であること、つまり、エージェントが継続的な学習を通じて変化するアプリケーション環境に適応できることを期待しています。 このようにして、身体化された知能は、既知のマルチモーダル タスクでますます優れたパフォーマンスを発揮できるだけでなく、未知のマルチモーダル タスクにも迅速に適応することができます。 第二に、人々はまた、身体化された知性が真に創造的であることを期待しており、環境の自律的な探索を通じて新しい戦略や解決策を発見し、境界を探索できることを期待しています。 AIの能力について。 しかし、この 2 つの適応は、単純に大規模なマルチモーダル モデルを身体にリンクしたり、身体化された知性の中に脳を直接組み込んだりするほど単純ではありません。 マルチモーダルな大規模モデルを例に挙げると、少なくとも 2 つの明らかな問題が直面しています。 第一に、モデルの反復更新サイクルが長くなります。これには多くの人的投資が必要です;第二に、モデルのトレーニング データモデルはすべて既存のデータから派生したものであるため、モデル は大量の新しい知識を継続的に取得することはできません。 RAG とコンテキスト ウィンドウの拡張を通じて継続的に出現する新しい知識を注入することも可能ですが、モデルはそれを記憶することができず、修復方法はさらなる問題を引き起こします。 つまり、現在の大規模なマルチモーダル モデルは、創造性はおろか、実際のアプリケーション シナリオにおける高い適応性もなく、業界で実装する際には常にさまざまな困難を引き起こします。 素晴らしい - 先ほど述べたことを思い出してください。Awaker 1.0 は新しい知識を学習できるだけでなく、新しい知識を記憶することもできます。この種の学習は毎日、継続的かつタイムリーに行われます。 #このフレームワーク図からわかるように、Awaker 1.0 はさまざまなスマート デバイスと組み合わせることができ、スマート デバイスを通じて世界を観察し、行動意図を生成し、コマンド制御を自動的に構築できます。インテリジェンス デバイスはさまざまなアクションを実行します。 (狗头) 特に重要なのは、Awaker 1.0# は独立して更新できることです。 ## は、身体化されたインテリジェンスに適応できるだけでなく、より幅広い業界シナリオにも適用でき、より複雑な実践的なタスクを解決できます。 たとえば、Awaker 1.0 はさまざまなスマート デバイスと統合され、クラウド エッジのコラボレーションを実現します。 現時点では、Awaker 1.0 はクラウドに展開された「頭脳」であり、さまざまなタスクを実行するためにさまざまなエッジ スマート デバイスを監視、命令、制御します。 さまざまなタスクを実行するときにエッジ スマート デバイスによって取得されるフィードバックは、継続的に Awaker 1.0 に送信され、トレーニング データを継続的に取得し、継続的に自身を更新できるようになります。 これは単なる机上の話ではありません。Awaker 1.0 とスマート デバイスとのクラウド エッジ コラボレーションの技術的なルートは、スマート グリッド検査やスマート シティなどのアプリケーション シナリオに適用され、以前よりもはるかに高い評価を獲得しています。伝統的な小型モデル。 マルチモーダル大型模型にとって、内なる力の涵養と武術の向上は重要な課題となっていると言えるでしょう。 Sophon エンジン Awaker 1.0 の出現は、マルチモーダル大規模モデルの自己超越への鍵を提供します。 それは、独立した更新メカニズムを通じて、データ不足のボトルネックを打破し、マルチモーダルな大規模モデルの継続的な学習と自己進化の可能性を提供します。クラウドエッジコラボレーションテクノロジーを使用し、身体化されたインテリジェンスなどのインテリジェントデバイスの特定のアプリケーションシナリオを勇敢に探索します。 これは AGI への小さな一歩かもしれませんが、マルチモーダル大規模モデルの自己超越の旅の始まりでもあります。 長くて困難な旅には、Sophon Engine のようなチームがテクノロジーの頂点に継続的に登る必要があります。 身体化された知性の「生きた」脳

しかし、その問題は明らかです。新しい知識を継続的に吸収し、新しい変化に適応するにはどうすればよいでしょうか。

しかし、その問題は明らかです。新しい知識を継続的に吸収し、新しい変化に適応するにはどうすればよいでしょうか。

以上が超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7748

7748

15

15

1643

1643

14

14

1397

1397

52

52

1291

1291

25

25

1234

1234

29

29

ddrescue を使用して Linux 上のデータを回復する

Mar 20, 2024 pm 01:37 PM

ddrescue を使用して Linux 上のデータを回復する

Mar 20, 2024 pm 01:37 PM

DDREASE は、ハード ドライブ、SSD、RAM ディスク、CD、DVD、USB ストレージ デバイスなどのファイル デバイスまたはブロック デバイスからデータを回復するためのツールです。あるブロック デバイスから別のブロック デバイスにデータをコピーし、破損したデータ ブロックを残して正常なデータ ブロックのみを移動します。 ddreasue は、回復操作中に干渉を必要としないため、完全に自動化された強力な回復ツールです。さらに、ddasue マップ ファイルのおかげでいつでも停止および再開できます。 DDREASE のその他の主要な機能は次のとおりです。 リカバリされたデータは上書きされませんが、反復リカバリの場合にギャップが埋められます。ただし、ツールに明示的に指示されている場合は切り詰めることができます。複数のファイルまたはブロックから単一のファイルにデータを復元します

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhoneのセルラーデータインターネット速度が遅い:修正

May 03, 2024 pm 09:01 PM

iPhone のモバイル データ接続に遅延や遅い問題が発生していませんか?通常、携帯電話の携帯インターネットの強度は、地域、携帯ネットワークの種類、ローミングの種類などのいくつかの要因によって異なります。より高速で信頼性の高いセルラー インターネット接続を実現するためにできることがいくつかあります。解決策 1 – iPhone を強制的に再起動する 場合によっては、デバイスを強制的に再起動すると、携帯電話接続を含む多くの機能がリセットされるだけです。ステップ 1 – 音量を上げるキーを 1 回押して放します。次に、音量小キーを押して、もう一度放します。ステップ 2 – プロセスの次の部分は、右側のボタンを押し続けることです。 iPhone の再起動が完了するまで待ちます。セルラーデータを有効にし、ネットワーク速度を確認します。もう一度確認してください 修正 2 – データ モードを変更する 5G はより優れたネットワーク速度を提供しますが、信号が弱い場合はより適切に機能します

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

Alibaba 7B マルチモーダル文書理解の大規模モデルが新しい SOTA を獲得

Apr 02, 2024 am 11:31 AM

Alibaba 7B マルチモーダル文書理解の大規模モデルが新しい SOTA を獲得

Apr 02, 2024 am 11:31 AM

マルチモーダル文書理解機能のための新しい SOTA!アリババの mPLUG チームは、最新のオープンソース作品 mPLUG-DocOwl1.5 をリリースしました。これは、高解像度の画像テキスト認識、一般的な文書構造の理解、指示の遵守、外部知識の導入という 4 つの主要な課題に対処するための一連のソリューションを提案しています。さっそく、その効果を見てみましょう。複雑な構造のグラフをワンクリックで認識しMarkdown形式に変換:さまざまなスタイルのグラフが利用可能:より詳細な文字認識や位置決めも簡単に対応:文書理解の詳しい説明も可能:ご存知「文書理解」 「」は現在、大規模な言語モデルの実装にとって重要なシナリオです。市場には文書の読み取りを支援する多くの製品が存在します。その中には、主にテキスト認識に OCR システムを使用し、テキスト処理に LLM と連携する製品もあります。